第5章 回归方程

- 格式:ppt

- 大小:1.73 MB

- 文档页数:57

第五章 异方差二、简答题1.异方差的存在对下面各项有何影响? (1)OLS 估计量及其方差; (2)置信区间;(3)显著性t 检验和F 检验的使用。

2.产生异方差的经济背景是什么?检验异方差的方法思路是什么? 3.从直观上解释,当存在异方差时,加权最小二乘法(WLS )优于OLS 法。

4.下列异方差检查方法的逻辑关系是什么? (1)图示法 (2)Park 检验 (3)White 检验5.在一元线性回归函数中,假设误差方差有如下结构:()i i i x E 22σε=如何变换模型以达到同方差的目的?我们将如何估计变换后的模型?请列出估计步骤。

三、计算题1.考虑如下两个回归方程(根据1946—1975年美国数据)(括号中给出的是标准差):t t t D GNP C 4398.0624.019.26-+= e s :(2.73)(0.0060) (0.0736)R ²=0.999t t t GNP D GNP GNP C ⎥⎦⎤⎢⎣⎡-+=⎥⎦⎤⎢⎣⎡4315.06246.0192.25 e s : (2.22) (0.0068)(0.0597)R ²=0.875式中,C 为总私人消费支出;GNP 为国民生产总值;D 为国防支出;t 为时间。

研究的目的是确定国防支出对经济中其他支出的影响。

(1)将第一个方程变换为第二个方程的原因是什么?(2)如果变换的目的是为了消除或者减弱异方差,那么我们对误差项要做哪些假设? (3)如果存在异方差,是否已成功地消除异方差?请说明原因。

(4)变换后的回归方程是否一定要通过原点?为什么?(5)能否将两个回归方程中的R²加以比较?为什么?2.1964年,对9966名经济学家的调查数据如下:资料来源:“The Structure of Economists’Employment and Salaries”, Committee on the National Science Foundation Report on the Economics Profession, American Economics Review, vol.55, No.4, December 1965.(1)建立适当的模型解释平均工资与年龄间的关系。

统计学习题集第五章相关与回归分析(总4页)--本页仅作为文档封面,使用时请直接删除即可----内页可以根据需求调整合适字体及大小--所属章节:第五章相关分析与回归分析1■在线性相关中,若两个变量的变动方向相反,一个变量的数值增加,另一个变量数值随之减少,或一个变量的数值减少,另一个变量的数值随之增加,则称为()。

答案:负相关。

干扰项:正相关。

干扰项:完全相关。

干扰项:非线性相关。

提示与解答:本题的正确答案为:负相关。

2■在线性相关中,若两个变量的变动方向相同,一个变量的数值增加,另一个变量数值随之增加,或一个变量的数值减少,另一个变量的数值随之减少,则称为()。

答案:正相关。

干扰项:负相关。

干扰项:完全相关。

干扰项:非线性相关。

提示与解答:本题的正确答案为:正相关。

3■下面的陈述中哪一个是错误的()。

答案:相关系数不会取负值。

干扰项:相关系数是度量两个变量之间线性关系强度的统计量。

干扰项:相关系数是一个随机变量。

干扰项:相关系数的绝对值不会大于1。

提示与解答:本题的正确答案为:相关系数不会取负值。

4■下面的陈述中哪一个是错误的()。

答案:回归分析中回归系数的显着性检验的原假设是:所检验的回归系数的真值不为0。

干扰项:相关系数显着性检验的原假设是:总体中两个变量不存在相关关系。

干扰项:回归分析中回归系数的显着性检验的原假设是:所检验的回归系数的真值为0。

干扰项:回归分析中多元线性回归方程的整体显着性检验的原假设是:自变量前的偏回归系数的真值同时为0。

提示与解答:本题的正确答案为:回归分析中回归系数的显着性检验的原假设是:所检验的回归系数的真值不为0。

5■根据你的判断,下面的相关系数值哪一个是错误的()。

答案:。

干扰项:。

干扰项:。

干扰项:0。

提示与解答:本题的正确答案为:。

6■下面关于相关系数的陈述中哪一个是错误的()。

答案:数值越大说明两个变量之间的关系越强,数值越小说明两个变量之间的关系越弱。

第5章自变量选择与逐步回归思考与练习参考答案自变量选择对回归参数的估计有何影响答:回归自变量的选择是建立回归模型得一个极为重要的问题。

如果模型中丢掉了重要的自变量, 出现模型的设定偏误,这样模型容易出现异方差或自相关性,影响回归的效果;如果模型中增加了不必要的自变量, 或者数据质量很差的自变量, 不仅使得建模计算量增大, 自变量之间信息有重叠,而且得到的模型稳定性较差,影响回归模型的应用。

自变量选择对回归预测有何影响答:当全模型(m元)正确采用选模型(p元)时,我们舍弃了m-p个自变量,回归系数的最小二乘估计是全模型相应参数的有偏估计,使得用选模型的预测是有偏的,但由于选模型的参数估计、预测残差和预测均方误差具有较小的方差,所以全模型正确而误用选模型有利有弊。

当选模型(p元)正确采用全模型(m 元)时,全模型回归系数的最小二乘估计是相应参数的有偏估计,使得用模型的预测是有偏的,并且全模型的参数估计、预测残差和预测均方误差的方差都比选模型的大,所以回归自变量的选择应少而精。

如果所建模型主要用于预测,应该用哪个准则来衡量回归方程的优劣C统计量达到最小的准则来衡量回答:如果所建模型主要用于预测,则应使用p归方程的优劣。

试述前进法的思想方法。

答:前进法的基本思想方法是:首先因变量Y对全部的自变量x1,x2,...,xm建立m 个一元线性回归方程, 并计算F检验值,选择偏回归平方和显着的变量(F值最大且大于临界值)进入回归方程。

每一步只引入一个变量,同时建立m-1个二元线性回归方程,计算它们的F检验值,选择偏回归平方和显着的两变量变量(F 值最大且大于临界值)进入回归方程。

在确定引入的两个自变量以后,再引入一个变量,建立m-2个三元线性回归方程,计算它们的F检验值,选择偏回归平方和显着的三个变量(F值最大)进入回归方程。

不断重复这一过程,直到无法再引入新的自变量时,即所有未被引入的自变量的F检验值均小于F检验临界值Fα(1,n-p-1),回归过程结束。

求回归方程公式回归方程是统计学和机器学习中常用的一种数学模型,用于描述自变量与因变量之间的关系。

回归分析旨在找到最适合数据的线性或非线性关系,以便进行预测或解释变量之间的关系。

在本文中,我们将探讨回归方程的定义、用途、以及如何通过回归分析来得出回归方程。

同时也会解释回归方程的含义和如何应用它。

一、回归方程的定义及用途回归方程是描述自变量和因变量之间关系的数学模型。

在回归分析中,我们试图找到一个最优的模型,使得自变量与因变量之间的关系得以最好地解释和预测。

回归方程可以是线性的,也可以是非线性的,这取决于自变量和因变量之间的实际关系。

回归方程在实际应用中有着广泛的用途。

它可以被用来预测未来的趋势,找到变量之间的相互关系,解释因果关系,以及进行实验设计和数据分析。

回归方程的建立和应用对于商业决策、科学研究、市场营销、医学诊断等领域都有着重要的意义。

二、回归方程的建立建立回归方程的过程通常是通过回归分析来完成的。

回归分析是一种统计学方法,它可以帮助我们确认自变量和因变量之间的关系,并得出一个最适合数据的回归方程。

回归分析通常包括以下几个步骤:1.数据收集:首先,我们需要收集自变量和因变量的数据。

这些数据可能来自实验、调查、观察或者其他渠道。

数据的质量和完整性对于建立回归方程至关重要。

2.散点图分析:在建立回归方程之前,我们需要通过散点图来观察自变量和因变量之间的关系。

散点图可以帮助我们初步判断两个变量之间的关系是线性还是非线性。

3.回归模型拟合:一旦确认了自变量和因变量之间的关系,我们可以通过回归分析进行模型拟合。

在这一步骤中,我们会选择合适的回归模型,并将数据拟合到模型中,以得出最佳的回归方程。

4.模型评估:最后,我们需要对建立的回归模型进行评估,以确认模型的拟合度和预测能力。

通常会使用一些统计指标来评估模型的有效性,比如R方值、残差分析等。

通过以上步骤,我们可以建立出一个最优的回归方程,并用它来解释和预测自变量和因变量之间的关系。

回归方程计算回归方程是用来描述一个或多个自变量与因变量之间的关系的数学模型。

在统计学中,回归分析是一种常用的方法,用来估计自变量和因变量之间的关联度。

回归方程的计算涉及到很多数学知识和统计方法,下面我们来详细介绍一下回归方程的计算过程。

首先,我们需要明确回归方程的形式。

在简单线性回归中,回归方程通常表示为y = β0 + β1x + ε,其中 y 表示因变量,x 表示自变量,β0 和β1 分别是截距和斜率,ε 表示误差项。

而在多元线性回归中,回归方程的形式为y = β0 + β1x1 + β2x2 + ... + βnxn + ε,其中 x1, x2, ..., xn 分别表示多个自变量。

其次,我们需要通过最小二乘法来估计回归方程的参数。

最小二乘法是一种常用的参数估计方法,通过最小化观测值与回归方程预测值的残差平方和来确定参数的值。

对于简单线性回归来说,参数β0 和β1 的估计值可以通过以下公式计算得到:β1 = Σ((xi - x)(yi - ȳ)) / Σ((xi - x)²)β0 = ȳ - β1x其中,x和ȳ 分别表示自变量 x 和因变量 y 的均值,xi 和 yi 分别表示第 i 个观测值,Σ 表示求和符号。

对于多元线性回归来说,参数的估计需要使用矩阵的运算方法。

参数向量β 的估计值可以通过以下公式计算得到:β = (X^T X)^(-1) X^T y其中,X 是自变量 x 的设计矩阵,y 是因变量 y 的观测向量,^T 表示矩阵的转置,^(-1) 表示矩阵的逆运算。

最后,我们需要检验回归方程的拟合程度。

通常使用残差分析、方差分析和回归系数的显著性检验来评估回归方程的拟合效果。

残差分析用于检验误差项的独立性和常数方差性,方差分析用于检验回归模型的显著性,回归系数的显著性检验用于确定自变量对因变量的影响是否显著。

综上所述,回归方程的计算涉及到参数估计和拟合效果检验两个方面。

通过适当的数学推导和统计方法,我们可以得到有效的回归方程,从而描述自变量和因变量之间的关系。

第五章 多元线性回归模型在第四章中,我们讨论只有一个解释变量影响被解释变量的情况,但在实际生活中,往往是多个解释变量同时影响着被解释变量。

需要我们建立多元线性回归模型。

一、多元线性模型及其假定 多元线性回归模型的一般形式是i iK K i i i x x x y εβββ++++= 2211令列向量x 是变量x k ,k =1,2,的n 个观测值,并用这些数据组成一个n ×K 数据矩阵X ,在多数情况下,X 的第一列假定为一列1,则β1就是模型中的常数项。

最后,令y 是n 个观测值y 1, y 2, …, y n 组成的列向量,现在可将模型写为:εββ++=K K x x y 11构成多元线性回归模型的一组基本假设为 假定1. εβ+=X y我们主要兴趣在于对参数向量β进行估计和推断。

假定2. ,0][][][][21=⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=n E E E E εεεε 假定3. n I E 2][σεε='假定4. 0]|[=X E ε我们假定X 中不包含ε的任何信息,由于)],|(,[],[X E X Cov X Cov εε= (1)所以假定4暗示着0],[=εX Cov 。

(1)式成立是因为,对于任何的双变量X ,Y ,有E(XY)=E(XE(Y|X)),而且])')|()([(])')((),(EY X Y E EX X E EY Y EX X E Y X Cov --=--=))|(,(X Y E X Cov =这也暗示 βX X y E =]|[假定5 X 是秩为K 的n ×K 随机矩阵 这意味着X 列满秩,X 的各列是线性无关的。

在需要作假设检验和统计推断时,我们总是假定: 假定6 ],0[~2I N σε 二、最小二乘回归 1、最小二乘向量系数采用最小二乘法寻找未知参数β的估计量βˆ,它要求β的估计βˆ满足下面的条件 22min ˆ)ˆ(ββββX y X y S -=-∆ (2)其中()()∑∑==-'-=⎪⎪⎭⎫ ⎝⎛-∆-nj Kj j ij i X y X y x y X y 1212ββββ,min 是对所有的m 维向量β取极小值。

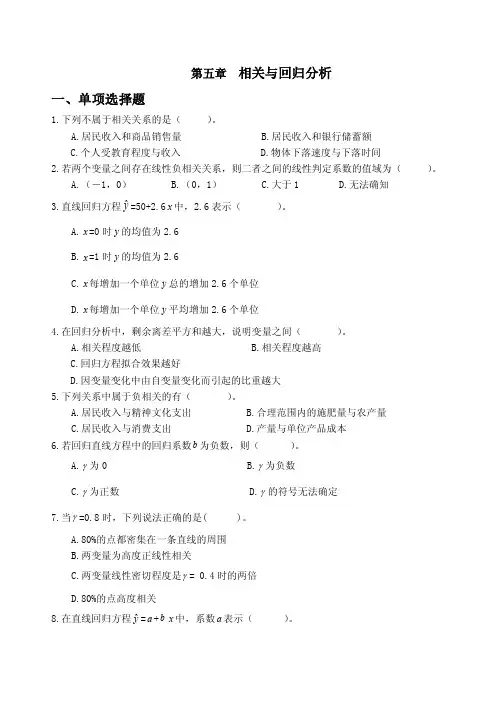

第五章相关与回归分析一、单项选择题1.下列不属于相关关系的是()。

A.居民收入和商品销售量B.居民收入和银行储蓄额C.个人受教育程度与收入D.物体下落速度与下落时间2.若两个变量之间存在线性负相关关系,则二者之间的线性判定系数的值域为()。

A.(-1,0)B.(0,1)C.大于1D.无法确知3.直线回归方程yˆ=50+2.6x中,2.6表示()。

A.x=0时y的均值为2.6B.x=1时y的均值为2.6C.x每增加一个单位y总的增加2.6个单位D.x每增加一个单位y平均增加2.6个单位4.在回归分析中,剩余离差平方和越大,说明变量之间()。

A.相关程度越低B.相关程度越高C.回归方程拟合效果越好D.因变量变化中由自变量变化而引起的比重越大5.下列关系中属于负相关的有()。

A.居民收入与精神文化支出B.合理范围内的施肥量与农产量C.居民收入与消费支出D.产量与单位产品成本6.若回归直线方程中的回归系数b为负数,则()。

A.γ为0B.γ为负数C.γ为正数D.γ的符号无法确定7.当γ=0.8时,下列说法正确的是( )。

A.80%的点都密集在一条直线的周围B.两变量为高度正线性相关C.两变量线性密切程度是γ= 0.4时的两倍D.80%的点高度相关8.在直线回归方程yˆ=a+b x中,系数a表示()。

A. x变动一个单位时y的平均变动量B. x变动一个单位时y的变动总量C. 当x=0时y的平均值D. y变动一个单位时x的平均变动量9.已知x与y之间存在负相关关系,指出下列哪一个回归方程肯定是错误的()。

A. yˆ= 300-1.82xB.yˆ=-20-0.82xC. yˆ=-150+0.75xD.yˆ= 87-0.32x10.由同一资料计算的相关系数γ与回归系数b之间的关系是()。

A.γ大b也大B.γ小b也小C.γ与b符号相反D.γ与b同符号11.在总离差平方和中,如果回归平方和所占比重大,剩余平方和所占比重小,则两变量之间()。

第5章相关分析和回归分析作业答案1.当变量x按一定数值变化时,变量y也近似地按固定数值变化,这表明变量x和变量y之间存在着( 3 )①完全相关关系②复相关关系③直线相关关系④没有相关关系2.单位产品成本与其产量的相关:单位产品成本与单位产品原材料消耗量的相关( 2 )①前者是正相关,后者是负相关②前者是负相关,后者是正相关③两者都是正相关④两者都是负相关3.相关系数r的取值范围( 2 )①-∞<r<+∞②-1≤r≤+1③-I<r<1 ④0≤r≤+14.当所有观测值都落在回归直线y=a+bx上,则x 与y之间的相关系数( 4 )①r=O.②r=1 ③r=-1 ④IrI=15.相关分析与回归分析,在是否需要确定自变量和因变量的问题上( 1 )①前者无须确定,后者需要确定②前者需要确定,后者勿需确定③两者均需确定④两者都无需确定6.—元线性回归模型的参数有( 2 )①一个②两个③三个④三个以上7.直线相关系数的绝对值接近1时,说明两变量相关关系的密切程度是( 1 )①完全相关②微弱相关③无线性相关④高度相关8.年劳动生产率x(千元)和工人工资y(元)之间的回归方程为y=10+7Ox,这意味着年劳动生产率每提高1千元时,工人工资平均( 1 )①增加70元②减少70元③增加80元④减少80元9.下面的几个式子中,错误的是( 1,3 )①y=-40-1.6x r=0.89 (说明:正相关,x前面的系数应该为正值)②y=-5-3.8x r=-0.94③y=36-2.4x r=0.96④y=-36+3.8x r=0.9810.相关系数r与回归系数b的关系可以表达为( 1 )①r=b*σx/σy ②r=b*③r=b* ④r=b*11.下列关系中,属于正相关关系的有( 1 )①合理限度内,施肥量和平均单产量之间的关系②产品产量与单位产品成本之间的关系③商品的流通费用与销售利润之间的关系.④流通费用率与商品销售量之间的关系12.直线相关分析与直线回归分析的联系表现为( 1 )①相关分析是回归分析的基础②回归分析是相关分析的基础③相关分析是回归分析的深入④相关分析与回归分析互为条件13.如果估计标准误差Sy=O,则表明( 1 )①全部观测值和回归值都相等②回归值等于Y 、③全部观测值与回归值的离差之和为零④全部观测值都落在回归直线上14.进行相关分析,要求相关的两个变量( 1 )。

SPSS第五章-回归分析一元回归分析在数学关系式中只描述了一个变量与另一个变量之间的数量变化关系,则称其为一元回归分析。

其回归模型为y 称为因变量,x称为自变量,称为随机误差,a,b 称为待估计的回归参数,下标i表示第i个观测值。

如果给出a和b的估计量分别为,,则经验回归方程:一般把称为残差,残差可视为扰动的“估计量”。

例子:湖北省汉阳县历年越冬代二化螟发蛾盛期与当年三月上旬平均气温的数据如表1-1,分析三月上旬平均温度与越冬代二化螟发蛾盛期的关系。

表1-1 三月上旬平均温度与越冬代二化螟发蛾盛期的情况表年份1961 1962 1963 1964 1965 1966 1967 1968 1969 1970 三月上旬平均温度8.6 8.3 9.7 8.5 7.5 8.4 7.3 9.7 5.4 5.5 越冬代二化螟发蛾 3 5 3 1 4 4 5 2 7 5盛期(6月30日为0)数据保存在“DATA6-1.SAV”文件中。

1)准备分析数据在数据编辑窗口中输入数据。

建立因变量历期“历期”在SPSS数据编辑窗口中,创建“年份”、“温度”和“发蛾盛期”变量,并把数据输入相应的变量中。

或者打开已存在的数据文件“DATA6-1.SAV”。

2)启动线性回归过程单击SPSS主菜单的“Analyze”下的“Regression”中“Linear”项,将打开如图1-1所示的线性回归过程窗口。

设置控制变量“Selection Variable”为控制变量输入栏。

控制变量相当于过滤变量,即必须当该变量的值满足设置的条件时,观测量才能参加回归分析。

当你输入控制变量后,单击“Rule”按钮,将打开如图1-2所示的对话。

图1-2“Rule”对话框在“Rule”对话框中,右边的“Value”框用于输入数值,左边的下拉列表中列出了观测量的选择关系,其中各项的意义分别为:•“equal to”等于。

•“not equal to”不等于。

第五章相关分析和回归分析5.1有人研究了黏虫孵化历期平均温度(x,℃)与历期天数(y,d)之间关系,试验资料如下表,试求黏虫孵化历期平均温度(x,℃)与历期天数(y,d)的简单相关系数。

并建立孵化历期平均温度(x,℃)与历期天数(y,d)之间的一元线性回归方程(要求给出检验结果并描述)。

表5.1 黏虫孵化历期平均温度与历期天数资料5.2 下表为某县1960-1971年的1月份雨量(x1,mm)、3月上旬平均温度(x2,℃)、3月中旬平均温度(x3,℃)、2月份雨量(x4,mm)和第一代三化螟蛾高峰期(y,以4月30日为0)的测定结果。

试计算1月份雨量(x1,mm)、3月上旬平均温度(x2,℃)分别与第一代三化螟蛾高峰期(y)的偏相关系数。

5.3 下表为观测的七个不同高度的风速资料,试建立风速随高度变化的曲线方程。

并确定最合理的是什么样的曲线类型(要求写出曲线方程)。

表5.3 观测的不同高度的风速资料5.4根据多年的大豆分期播种资料,建立大豆产量(y)与生育期降水量(x i)之间的多元线性回归方程。

表5.4 大豆不同生育期降水量与产量数据产量(kg/ha)y生育期降水量(mm)播种-出苗x1出苗-第三叶x2第三叶-开花x3开花-结荚x4结荚-成熟x53982 52 132 180 219 206 3397 25 132 198 201 206 2915 29 170 149 190 202 2142 25 207 111 192 204 1874 43 167 188 111 205 1934 40 85 216 64 189 1692 4 107 192 64 194 1532 18 46 138 165 301 1203 15 49 149 153 299 1200 32 30 137 233 248 1168 7 112 168 158 225 1160 0 111 181 145 225 887 14 104 199 138 208 1124 22 34 26 50 156 927 22 35 25 50 156 870 9 33 25 50 154 979 16 28 22 50 156 924 32 12 37 30 154 1071 33 13 52 20 149 1056 29 15 50 20 149 1124 1 14 50 20 149 924 3 12 50 20 149 1374 11 34 30 8 1635.5根据表5.2的数据试应用逐步回归方法求预报第一代三化螟蛾高峰期的最优线性回归方程(要求给出方程和系数的检验结果)。

第5章自变量选择与逐步回归思考与练习参考答案自变量选择对回归参数的估计有何影响?答:回归自变量的选择是建立回归模型得一个极为重要的问题。

如果模型中丢掉了重要的自变量, 出现模型的设定偏误,这样模型容易出现异方差或自相关性,影响回归的效果;如果模型中增加了不必要的自变量, 或者数据质量很差的自变量, 不仅使得建模计算量增大, 自变量之间信息有重叠,而且得到的模型稳定性较差,影响回归模型的应用。

自变量选择对回归预测有何影响?答:当全模型(m元)正确采用选模型(p元)时,我们舍弃了m-p个自变量,回归系数的最小二乘估计是全模型相应参数的有偏估计,使得用选模型的预测是有偏的,但由于选模型的参数估计、预测残差和预测均方误差具有较小的方差,所以全模型正确而误用选模型有利有弊。

当选模型(p元)正确采用全模型(m 元)时,全模型回归系数的最小二乘估计是相应参数的有偏估计,使得用模型的预测是有偏的,并且全模型的参数估计、预测残差和预测均方误差的方差都比选模型的大,所以回归自变量的选择应少而精。

如果所建模型主要用于预测,应该用哪个准则来衡量回归方程的优劣?C统计量达到最小的准则来衡量回答:如果所建模型主要用于预测,则应使用p归方程的优劣。

试述前进法的思想方法。

答:前进法的基本思想方法是:首先因变量Y对全部的自变量x1,x2,...,xm建立m个一元线性回归方程, 并计算F检验值,选择偏回归平方和显著的变量(F 值最大且大于临界值)进入回归方程。

每一步只引入一个变量,同时建立m-1个二元线性回归方程,计算它们的F检验值,选择偏回归平方和显著的两变量变量(F值最大且大于临界值)进入回归方程。

在确定引入的两个自变量以后,再引入一个变量,建立m-2个三元线性回归方程,计算它们的F检验值,选择偏回归平方和显著的三个变量(F值最大)进入回归方程。

不断重复这一过程,直到无法再引入新的自变量时,即所有未被引入的自变量的F检验值均小于F检验临界值Fα(1,n-p-1),回归过程结束。