ffmpeg码流控制

- 格式:docx

- 大小:10.80 KB

- 文档页数:2

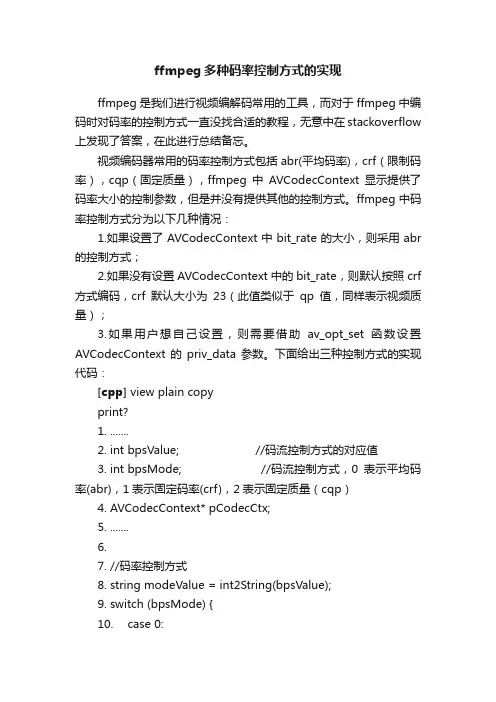

ffmpeg多种码率控制方式的实现ffmpeg是我们进行视频编解码常用的工具,而对于ffmpeg中编码时对码率的控制方式一直没找合适的教程,无意中在stackoverflow 上发现了答案,在此进行总结备忘。

视频编码器常用的码率控制方式包括abr(平均码率),crf(限制码率),cqp(固定质量),ffmpeg中AVCodecContext显示提供了码率大小的控制参数,但是并没有提供其他的控制方式。

ffmpeg中码率控制方式分为以下几种情况:1.如果设置了AVCodecContext中bit_rate的大小,则采用abr 的控制方式;2.如果没有设置AVCodecContext中的bit_rate,则默认按照crf 方式编码,crf默认大小为23(此值类似于qp值,同样表示视频质量);3.如果用户想自己设置,则需要借助av_opt_set函数设置AVCodecContext的priv_data参数。

下面给出三种控制方式的实现代码:[cpp] view plain copyprint?1........2.int bpsValue; //码流控制方式的对应值3.int bpsMode; //码流控制方式,0表示平均码率(abr),1表示固定码率(crf),2表示固定质量(cqp)4.AVCodecContext* pCodecCtx;5........6.7.//码率控制方式8.string modeValue = int2String(bpsValue);9.switch (bpsMode) {10.case 0:11.pCodecCtx->bit_rate = bpsValue*1000;12.break;13.case 1:14.av_opt_set(pCodecCtx->priv_data,"crf",modeValue.c_s tr(),AV_OPT_SEARCH_CHILDREN);15.break;16.case 2:17.av_opt_set(pCodecCtx->priv_data,"qp",modeValue.c_s tr(),AV_OPT_SEARCH_CHILDREN);18.break;19.default:20.pCodecCtx->bit_rate = bpsValue;21.break;22.}同时ffmpeg中采用H264,H265标准编码时,可能需要设置preset、tune和profile,ffmpeg中需要采用额外参数AVDictionary 传入avcodec_open2()函数中实现。

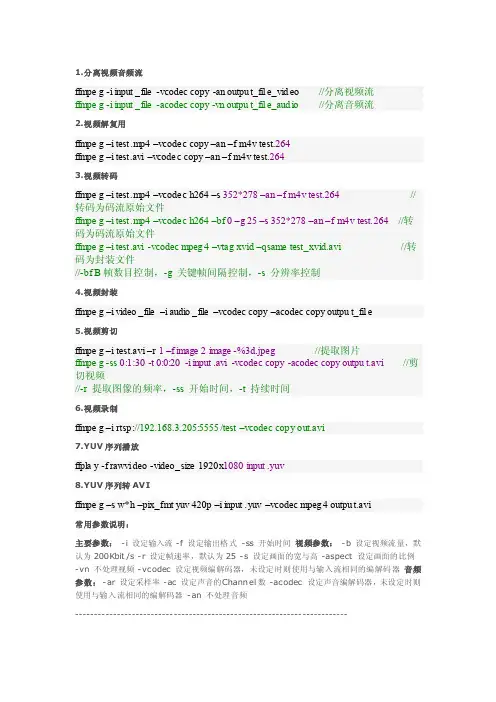

1.分离视频音频流ffmpeg -i input_file-vcodec copy -an output_file_vide o//分离视频流ffmpeg -i input_file-acodec copy -vn output_file_audi o//分离音频流2.视频解复用ffmpeg–i test.mp4 –vcodec copy –an –f m4v test.264ffmpeg–i test.avi –vcodec copy –an –f m4v test.2643.视频转码ffmpeg–i test.mp4 –vcodec h264 –s 352*278 –an –f m4v test.264 //转码为码流原始文件ffmpeg–i test.mp4 –vcodec h264 –bf 0 –g 25 –s 352*278 –an –f m4v test.264 //转码为码流原始文件ffmpeg–i test.avi -vcodec mpeg4–vtag xvid –qsametest_x vid.avi //转码为封装文件//-bf B帧数目控制,-g 关键帧间隔控制,-s 分辨率控制4.视频封装ffmpeg–i video_file–i audio_file–vcodec copy –acodec copy output_file5.视频剪切ffmpeg–i test.avi –r 1 –f image2 image-%3d.jpeg //提取图片ffmpeg -ss 0:1:30 -t 0:0:20 -i input.avi -vcodec copy -acodec copy output.avi //剪切视频//-r 提取图像的频率,-ss 开始时间,-t 持续时间6.视频录制ffmpeg–i rtsp://192.168.3.205:5555/test –vcodec copy out.avi7.YUV序列播放ffplay -f rawvid eo -video_size1920x1080 input.yuv8.YUV序列转AVIffmpeg–s w*h –pix_fm t yuv420p –i input.yuv –vcodec mpeg4output.avi常用参数说明:主要参数: -i 设定输入流-f 设定输出格式-ss 开始时间视频参数: -b 设定视频流量,默认为200Kbit/s -r 设定帧速率,默认为25-s 设定画面的宽与高 -aspect设定画面的比例-vn 不处理视频-vcodec设定视频编解码器,未设定时则使用与输入流相同的编解码器音频参数: -ar 设定采样率-ac 设定声音的C hanne l数 -acodec设定声音编解码器,未设定时则使用与输入流相同的编解码器-an 不处理音频----------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------1、将文件当做直播送至li veffmpeg-re -i localF ile.mp4 -c copy -f flv rtmp://server/live/stream Name2、将直播媒体保存至本地文件ffmpeg -i rtmp://server/live/stream Name-c copy dump.flv3、将其中一个直播流,视频改用h264压缩,音频不变,送至另外一个直播服务流ffmpeg-i rtmp://server/live/origin alStr eam -c:a copy -c:v libx264 -vpre slow -f flv rtmp://server/live/h264St ream4、将其中一个直播流,视频改用h264压缩,音频改用fa ac压缩,送至另外一个直播服务流ffmpeg -i rtmp://server/live/origin alStr eam -c:a libfaa c -ar 44100-ab 48k -c:v libx264 -vpre slow -vpre baseli ne -f flvrtmp://server/live/h264St ream5、将其中一个直播流,视频不变,音频改用fa ac压缩,送至另外一个直播服务流ffmpeg -i rtmp://server/live/origin alStr eam -acodec libfaa c -ar 44100-ab 48k -vcodec copy -f flv rtmp://server/live/h264_A AC_St ream6、将一个高清流,复制为几个不同视频清晰度的流重新发布,其中音频不变ffmpeg -re -i rtmp://server/live/high_F MLE_s tream -acodec copy -vcodec x264li b -s 640×360 -b 500k -vpre medium -vpre baseli nertmp://server/live/baseli ne_500k -acodec copy -vcodec x264li b -s480×272 -b 300k -vpre medium -vpre baseli nertmp://server/live/baseli ne_300k -acodec copy -vcodec x264li b -s320×200 -b 150k -vpre medium -vpre baseli nertmp://server/live/baseli ne_150k -acodec libfaa c -vn -ab 48krtmp://server/live/audio_only_AAC_48k7、功能一样,只是采用-x264op ts选项ffmpeg-re -i rtmp://server/live/high_F MLE_s tream-c:a copy -c:v x264li b -s 640×360 -x264op ts bitrat e=500:profil e=baseli ne:preset=slowrtmp://server/live/baseli ne_500k -c:a copy -c:v x264li b -s 480×272-x264op ts bitrat e=300:profil e=baseli ne:preset=slowrtmp://server/live/baseli ne_300k -c:a copy -c:v x264li b -s 320×200-x264op ts bitrat e=150:profil e=baseli ne:preset=slowrtmp://server/live/baseli ne_150k -c:a libfaa c -vn -b:a 48krtmp://server/live/audio_only_AAC_48k8、将当前摄像头及音频通过DSSHO W采集,视频h264、音频faac压缩后发布ffmpeg -r 25 -f dshow-s 640×480 -i video=”videosourcename”:audio=”audiosource name” -vcodec libx264 -b 600k -vpre slow -acodec libfaa c -ab 128k -f flv rtmp://server/applic ation/stream_name9、将一个JPG图片经过h264压缩循环输出为mp4视频ffmpeg.exe -i INPUT.jpg -an -vcodec libx264 -coder1 -flags+loop -cmp +chroma -subq 10 -qcomp0.6 -qmin 10 -qmax 51 -qdiff4 -flags2 +dct8x8 -trelli s 2 -partit ions+parti8x8+parti4x4 -crf 24 -thread s 0 -r 25 -g 25 -y OUTPUT.mp410、将普通流视频改用h264压缩,音频不变,送至高清流服务(新版本FMS live=1)ffmpeg-i rtmp://server/live/origin alStr eam -c:a copy -c:v libx264 -vpre slow -f flv “rtmp://server/live/h264St reamlive=1〃----------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------1.采集usb摄像头视频命令:ffm peg -t 20 -f vfwcap -i 0 -r 8 -f m p4 cap1111.mp4./ffm peg -t 10 -f vfwcap -i 0 -r 8 -f m p4 cap.mp4具体说明如下:我们采集10秒,采集设备为v fwcap类型设备,第0个vfw cap采集设备(如果系统有多个vfw的视频采集设备,可以通过-i nu m来选择),每秒8帧,输出方式为文件,格式为m p4。

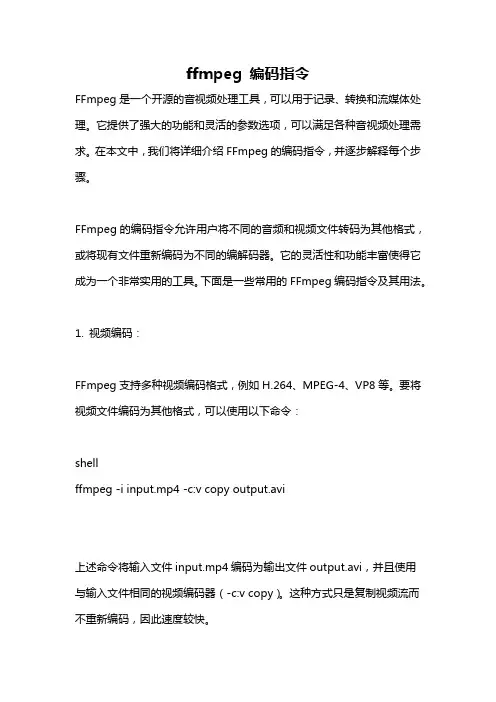

ffmpeg 编码指令FFmpeg是一个开源的音视频处理工具,可以用于记录、转换和流媒体处理。

它提供了强大的功能和灵活的参数选项,可以满足各种音视频处理需求。

在本文中,我们将详细介绍FFmpeg的编码指令,并逐步解释每个步骤。

FFmpeg的编码指令允许用户将不同的音频和视频文件转码为其他格式,或将现有文件重新编码为不同的编解码器。

它的灵活性和功能丰富使得它成为一个非常实用的工具。

下面是一些常用的FFmpeg编码指令及其用法。

1. 视频编码:FFmpeg支持多种视频编码格式,例如H.264、MPEG-4、VP8等。

要将视频文件编码为其他格式,可以使用以下命令:shellffmpeg -i input.mp4 -c:v copy output.avi上述命令将输入文件input.mp4编码为输出文件output.avi,并且使用与输入文件相同的视频编码器(-c:v copy)。

这种方式只是复制视频流而不重新编码,因此速度较快。

可以通过修改-c:v参数来选择不同的编码器,例如使用H.264编码器:shellffmpeg -i input.mp4 -c:v libx264 output.avi以上命令将输入文件input.mp4重新编码为输出文件output.avi,并使用libx264作为视频编码器。

libx264是一个开源的H.264编码器,提供了很好的视频质量和压缩效率。

2. 音频编码:类似于视频编码,FFmpeg也支持多种音频编码格式,例如AAC、MP3、Vorbis等。

要将音频文件编码为其他格式,可以使用以下命令:shellffmpeg -i input.wav -c:a copy output.mp3上述命令将输入文件input.wav编码为输出文件output.mp3,并且使用与输入文件相同的音频编码器(-c:a copy)。

这种方式只是复制音频流而不重新编码。

如果希望重新编码音频,可以使用以下命令:shellffmpeg -i input.wav -c:a libmp3lame output.mp3以上命令将输入文件input.wav重新编码为输出文件output.mp3,并使用libmp3lame作为音频编码器。

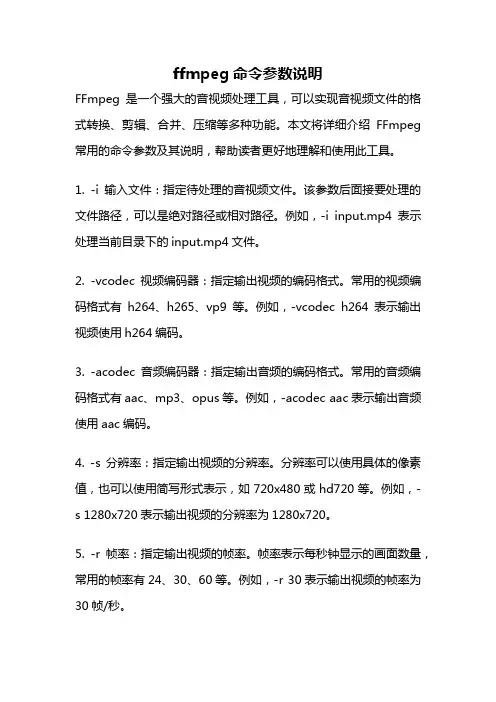

ffmpeg命令参数说明FFmpeg是一个强大的音视频处理工具,可以实现音视频文件的格式转换、剪辑、合并、压缩等多种功能。

本文将详细介绍FFmpeg 常用的命令参数及其说明,帮助读者更好地理解和使用此工具。

1. -i 输入文件:指定待处理的音视频文件。

该参数后面接要处理的文件路径,可以是绝对路径或相对路径。

例如,-i input.mp4表示处理当前目录下的input.mp4文件。

2. -vcodec 视频编码器:指定输出视频的编码格式。

常用的视频编码格式有h264、h265、vp9等。

例如,-vcodec h264表示输出视频使用h264编码。

3. -acodec 音频编码器:指定输出音频的编码格式。

常用的音频编码格式有aac、mp3、opus等。

例如,-acodec aac表示输出音频使用aac编码。

4. -s 分辨率:指定输出视频的分辨率。

分辨率可以使用具体的像素值,也可以使用简写形式表示,如720x480或hd720等。

例如,-s 1280x720表示输出视频的分辨率为1280x720。

5. -r 帧率:指定输出视频的帧率。

帧率表示每秒钟显示的画面数量,常用的帧率有24、30、60等。

例如,-r 30表示输出视频的帧率为30帧/秒。

6. -b 码率:指定输出视频的码率。

码率表示每秒钟传输的数据量,常用的码率有500k、1M、2M等。

例如,-b 1M表示输出视频的码率为1Mbps。

7. -ss 起始时间:指定剪辑视频的起始时间。

起始时间可以使用具体的时间值,也可以使用时间偏移量表示,如00:01:30或-30表示从视频的第1分30秒开始剪辑。

例如,-ss 00:01:30表示从视频的第1分30秒开始剪辑。

8. -t 持续时间:指定剪辑视频的持续时间。

持续时间可以使用具体的时间值,也可以使用时间偏移量表示,如00:00:30或30表示剪辑30秒。

例如,-t 00:00:30表示剪辑30秒的视频。

ffmpeg控制参数ffmpeg是一款强大的多媒体处理工具,通过控制参数可以实现各种视频和音频处理功能。

本文将介绍一些常用的ffmpeg控制参数及其用法,帮助读者更好地使用ffmpeg进行多媒体处理。

一、视频参数控制1. -r 参数:用于设置输出视频的帧率。

例如,使用命令“-r 30”表示输出视频的帧率为30帧/秒。

2. -s 参数:用于设置输出视频的分辨率。

例如,使用命令“-s 1280x720”表示输出视频的宽度为1280像素,高度为720像素。

3. -b:v 参数:用于设置输出视频的比特率。

比特率决定了视频的画质和文件大小。

例如,使用命令“-b:v 2000k”表示输出视频的比特率为2000kbps。

4. -c:v 参数:用于设置视频编码器。

ffmpeg支持多种视频编码器,如H.264、MPEG-4等。

例如,使用命令“-c:v libx264”表示使用libx264编码器进行视频编码。

二、音频参数控制1. -ar 参数:用于设置输出音频的采样率。

采样率决定了音频的音质和文件大小。

例如,使用命令“-ar 44100”表示输出音频的采样率为44100Hz。

2. -ac 参数:用于设置输出音频的声道数。

例如,使用命令“-ac 2”表示输出音频为立体声。

3. -b:a 参数:用于设置输出音频的比特率。

比特率决定了音频的音质和文件大小。

例如,使用命令“-b:a 128k”表示输出音频的比特率为128kbps。

4. -c:a 参数:用于设置音频编码器。

ffmpeg支持多种音频编码器,如AAC、MP3等。

例如,使用命令“-c:a aac”表示使用AAC编码器进行音频编码。

三、其他参数控制1. -ss 参数:用于设置从输入文件的哪个时间点开始处理。

例如,使用命令“-ss 00:01:30”表示从输入文件的1分30秒处开始处理。

2. -t 参数:用于设置处理的时长。

例如,使用命令“-t 10”表示处理10秒钟的视频或音频。

数字⾳视频技术:码率控制⼀. 概述1.1 来源及其作⽤为什么要使⽤码率控制?这个问题是由现实产⽣的。

在传输压缩编码视频的时候,必须要考虑两个问题:视频质量和传输带宽,如果带宽⼤,肯定要尽可能传输质量更好的视频;如果带宽低,则需要提⾼压缩⽐,减⼩码流;如果带宽动态变化,那么码流也需要动态改变来适应带宽,总之,码流与带宽紧密相关。

与此同时,我们希望尽可能的得到⾼清晰的还原图像,所以在能接受的视频质量范围内对视频尽可能的压缩来提⾼带宽利⽤率是码率控制的根本。

码率控制的来源知道以后,它的作⽤也就很明显,就是提⾼带宽利⽤率,在保持视频还原清晰度的情形下,尽可能的节省带宽。

视频编码(有损)的⽬标是尽可能多的节省⽐特(码率)的同时尽量保持视频质量,码率控制是平衡码率和质量的重要⼯具。

1.2 ⾯临的问题码率控制是个说起来简单做起来的事情。

之前已经总结过,可以从两个⽅⾯来理解码率控制,⼀是从内容的率失真优化⾓度考虑量化与码率关系,⼆是从信道传输和转移概率的⾓度来分析码率和编码模式的关系。

这两个⽅向都有同样的⼀个问题,与“先有鸡还是先有蛋”类似。

以QP和R的关系为例,为了得到可控的码流,我们需要提前控制QP,但是QP⼜依赖码流来计算给出,所以这个先后问题变成⼀个死循环,需要找到⼀个突破点。

1.3 主要发展为了解决先有鸡还是先有蛋的问题,我们找到⼀个突破⼝,既然理论的⽅法被证明是很难⾛通,那么可以选择⾛数值模拟的⽅法,通过⼀系列的实验,得到⼀系列的经验公式,尤其是选取⼀个合适的初始值,进⽽破解鸡还是蛋的问题。

在选择实验模拟这条路之后,突然有了很多的思路可以去做,⾸先是和理论结合最紧密的部分:概率分布。

通过计算不同概率分布下的率失真函数,得到⼀系列经验公式和参考模型,在利⽤DCT变化对亮度和⾊度系数进⾏处理后,最优模拟是拉普拉斯分布以及⼀部分⾼斯分布。

通过计算可以得到常⽤的6中R-D模型,⽽这些基础模型⼜被进⼀步演化成不同的码率控制算法。

ffmpeg多路编码命令FFmpeg是一个开源的音视频处理工具,可以用于转码、剪辑、合并等多种操作。

其中一个常用的功能是多路编码,也就是同时对多个输入流进行编码。

在本篇文章中,我们将详细介绍如何使用FFmpeg进行多路编码,并提供一些实际应用的示例。

首先,我们需要了解一下FFmpeg的基本命令格式。

在命令行中输入以下命令可以查看FFmpeg的帮助文档:shellffmpeg -h这将列出FFmpeg的所有可用选项和参数。

在进行多路编码之前,我们需要确定输入流的来源。

可以是视频文件、摄像头、音频文件等。

在本文中,我们将以一个视频文件和一个音频文件作为输入流进行演示。

接下来,我们需要了解FFmpeg的输入选项。

使用以下命令可以查看输入选项的帮助文档:shellffmpeg -h input在命令行中输入上述命令后,会列出所有的输入选项及其用法。

根据需要选择适合的选项。

在本文的示例中,我们将使用以下选项进行输入流的设置:- `-i input_file`:指定输入文件路径。

- `-f format`:指定输入文件的格式,如mp4、avi等。

然后,我们需要了解FFmpeg的输出选项。

使用以下命令可以查看输出选项的帮助文档:shellffmpeg -h output在命令行中输入上述命令后,会列出所有的输出选项及其用法。

根据需要选择适合的选项。

在本文的示例中,我们将使用以下选项进行输出流的设置:- `-c:v codec`:指定视频编码器,如h264、hevc等。

- `-c:a codec`:指定音频编码器,如aac、mp3等。

- `-b:v bitrate`:指定视频比特率,能够控制视频质量和文件大小。

- `-b:a bitrate`:指定音频比特率,能够控制音频质量和文件大小。

- `-s resolution`:指定输出视频的分辨率。

- `-r framerate`:指定输出视频的帧率。

在设置好输入流和输出流之后,我们可以使用以下命令进行多路编码:shellffmpeg -i input1 -i input2 -c:v codec -c:a codec -b:v bitrate -b:a bitrate -s resolution -r framerate output其中,`input1`和`input2`是输入流的文件路径,`codec`是编码器的名称,`bitrate`是比特率,`resolution`是分辨率,`framerate`是帧率,`output`是输出文件的路径。

ffmpeg 转码参数FFmpeg是一个开源跨平台的音视频处理工具,它可以用于录制、转换和流媒体处理等多种音视频处理任务。

在使用FFmpeg进行转码时,可以通过指定一系列参数来控制转码过程,下面我将从不同角度介绍一些常用的转码参数。

1. 输入输出参数,在使用FFmpeg进行转码时,需要指定输入文件和输出文件的路径,可以使用"-i"参数指定输入文件,使用输出文件路径作为命令的最后一个参数。

2. 视频编解码参数,可以使用"-c:v"参数指定视频编解码器,例如"-c:v libx264"表示使用H.264编码器进行视频编码。

还可以通过"-b:v"参数指定视频的比特率,"-s"参数指定视频的分辨率等。

3. 音频编解码参数,使用"-c:a"参数指定音频编解码器,例如"-c:a aac"表示使用AAC编码器进行音频编码。

可以使用"-b:a"参数指定音频的比特率,"-ar"参数指定音频的采样率等。

4. 视频滤镜参数,可以使用"-vf"参数指定视频滤镜,例如"-vf scale=1280:720"表示将视频缩放到1280x720的分辨率。

还可以使用"-af"参数指定音频滤镜。

5. 格式参数,可以使用"-f"参数指定输出文件的格式,例如"-f mp4"表示将输出文件格式设置为MP4。

6. 其他参数,除了上述参数外,还可以使用一些其他参数来控制转码过程,例如"-preset"参数用于指定转码速度和质量的预设值,"-t"参数用于指定转码的时长等。

总的来说,使用FFmpeg进行转码时,需要根据具体的需求选择合适的参数来控制转码过程,以达到所需的转码效果。

ffmpeg编码个参数的设置以及作用具体参考b 设置一个目标码率qscale 设置固定的量化因子qmin qmax 最小和最大量化因子,使用了该参数,就可以不使用qscale参数bt 设置容许的码率误差(固定误差)maxrate minrate 设置最大和最小码率误差(可变误差)bufsize 设置码率控制的缓冲区大小max_qdiff=3//视频中所有桢(包括i/b/P)的最大Q值差距max_b_frames=2//两个非B桢之间的最大B桢数目。

qcompress=0.5//浮点数值,表示在压制“容易压的场景”和“难压的场景”时,允许Q值之比值的变化范围。

可选值是0.0-1.0。

mb_qmin=1// MicroBlock的最小Q值mb_qmax=31// MicroBlock的最大Q值pre_me=2// 提前进行运动场景预测.rc_eq=tex//选择码率控制的方法。

TEX是方法之一。

lmin=1//最小拉格朗日乘数。

拉格朗日乘数法(lagrange multipler)是用來檢定瞬間平均值的一种统计学方法。

lmax=5//最大拉格朗日乘数qmin=1//Q值最小值qmax=5//Q值最大值.qblur=0//浮点数,表示Q值的比例随时间消减的程度,取之范围是0.0-1.0,取0就是不消减。

spatial_cplx_masking=0.3//浮点数,表示空间复杂性的masking力度。

0.0-1.0strict_std_compliance=-1//表示严格遵照既定标准(MPEG4等等)me_pre_cmp=2//运动场景预判功能的力度。

数值越大编码时间越长。

rc_qsquish=1.0//采用Qmin/Qmax的比值来限定和控制码率的方法。

选1表示局部(即一个clip)采用此方法,选1表示全部采用。

rc_buffer_aggressivity=1.0//浮点数. 表示开启解码器码流缓冲(decoder bitstream buffer) bit_rate_tolerance=8000000//表示有多少bit的视频流可以偏移出目前的设定.这里的"设定"是指的cbr或者vbr.mb_decision=0//Macroblock的判定模式.有3种,0表示采用用Macroblock比较,2表示采用失真率(rate distortion)参考,1表示选择0和2中码率需求最低的一种b_quant_factor=1.25//表示i/p与B的Q值比例因子,值越大B桢劣化越严重b_quant_offset=1.25//表示1/p与B的Q值比例的偏移量,值越大B桢劣化越严重.如果大于0,那么下一个B的Q=前一个P的Q乘以b_quant_factor再加上offset,如果小于0,则B的Q=负的normal_Q乘以factor加上offset.i_quant_factor=0.8//p和i的Q值比例因子,越接近1则P越优化.i_quant_offset=0.0//p和i的Q的偏移量rc_strategy=2//设定码率控制策略. 这个策略记不得了;(b_frame_strategy=0//B桢生成策略.(我也说不清)luma_elim_threshold=0//消除luma(亮度,"红楼梯")门限chroma_elim_threshold=0//从名字上看像是消除色度错误的门限,不理解.dct_algo=0//离散余弦变换算法设置,有7种预设置,包括:0:FF_DCT_AUTO1:FF_DCT_FASTINT,2:FF_DCT_INT ,3:FF_DCT_MMX ,4:FF_DCT_MLIB,5:FF_DCT_ALTIVEC6:FF_DCT_FAAN有印象好像这些与设算法是针对不同的CPU指令集作优化的,根据作压制的机器CPU来选择0-6.lumi_masking=0.0dark_masking=0.0//这两个表示对过亮或过暗的场景作masking的力度.0表示不作。

ffmpeg常用基本命令1.分离视频音频流ffmpeg -i input_file –c:v copy -an output_file_video//分离视频流ffmpeg -i input_file –c:a copy -vn output_file_audio//分离音频流2.视频解复用ffmpeg –i test.mp4 –c:v copy –an –f m4v test.264ffmpeg –i test.avi –c:v copy –an –f m4v test.2643.视频转码ffmpeg –i test.mp4 –c:v h264 –s 352*278 –an –f m4v test.264 //转码为码流原始文件ffmpeg –i test.mp4 –vcodec h264 –bf 0 –g 25 –s 352*278 –an –f m4v test.264 //转码为码流原始文件ffmpeg –i test.avi -vcodec mpeg4 –vtag xvid –qsame test_xvid.avi //转码为封装文件//-bf B帧数目控制,-g 关键帧间隔控制,-s 分辨率控制4.视频封装ffmpeg –i video_file –i audio_file –c copy output_file5.视频剪切ffmpeg –i test.avi –r 1 –f image2 image-%3d.jpeg//提取图片, -r 提取图像的频率ffmpeg -ss 0:1:30 -t 0:0:20 -i input.avi –c copy output.avi//剪切视频-ss 开始时间,-t 持续时间à从0:1:30开始持续20秒6.视频录制ffmpeg –i rtsp://192.168.3.205:5555/test –vcodec copy out.avi7.YUV序列播放ffplay -f rawvideo -s 1920x1080 input.yuv8.YUV序列转AVIffmpeg –s w*h –pix_fmt yuv420p –i input.yuv –vcodec mpeg4 output.avi常用参数说明:主要参数:-i 设定输入流-f 设定输出格式-ss 开始时间视频参数:-b 设定视频流量,默认为200Kbit/s -r 设定帧速率,默认为25 -s 设定画面的宽与高320x240àqvga 176x144 à qcif -vn 不处理视频–vcodec(c:v) 设定视频编解码器音频参数:-ar 设定采样率-ac 设定声音的Channel数–acodec(c:a) 设定声音编解码器,-an 不处理音频1、将文件当做直播送至liveffmpeg -re -i localFile.mp4 -c copy -f flvrtmp://server/live/streamName2、将直播媒体保存至本地文件ffmpeg -i rtmp://server/live/streamName -c copy dump.flv3、将其中一个直播流,视频改用h264压缩,音频不变,送至另外一个直播服务流ffmpeg -i rtmp://server/live/originalStream -c:a copy -c:v libx264 -vpre slow -f flv rtmp://server/live/h264Stream4、将其中一个直播流,视频改用h264压缩,音频改用faac压缩,送至另外一个直播服务流ffmpeg -i rtmp://server/live/originalStream -c:a libfaac -ar 44100 -ab 48k -c:v libx264 -vpre slow -vpre baseline -f flv rtmp://server/live/h264Stream5、将其中一个直播流,视频不变,音频改用faac压缩,送至另外一个直播服务流ffmpeg -i rtmp://server/live/originalStream -acodec libfaac -ar 44100 -ab 48k -vcodec copy -f flv rtmp://server/live/h264_AAC_Stream6、将一个高清流,复制为几个不同视频清晰度的流重新发布,其中音频不变ffmpeg -re -i rtmp://server/live/high_FMLE_stream -acodec copy -vcodec x264lib -s 640×360 -b 500k -vpre medium -vpre baselinertmp://server/live/baseline_500k -acodec copy -vcodec x264lib -s480×272 -b 300k -vpre medium -vpre baselinertmp://server/live/baseline_300k -acodec copy -vcodec x264lib -s320×200 -b 150k -vpre medium -vpre baselinertmp://server/live/baseline_150k -acodec libfaac -vn -ab 48k rtmp://server/live/audio_only_AAC_48k7、功能一样,只是采用-x264opts选项ffmpeg -re -i rtmp://server/live/high_FMLE_stream -c:a copy -c:vx264lib -s 640×360 -x264optsbitrate=500:profile=baseline:preset=slowrtmp://server/live/baseline_500k -c:a copy -c:v x264lib -s 480×272 -x264opts bitrate=300:profile=baseline:preset=slow rtmp://server/live/baseline_300k -c:a copy -c:v x264lib -s 320×200 -x264opts bitrate=150:profile=baseline:preset=slow rtmp://server/live/baseline_150k -c:a libfaac -vn -b:a 48krtmp://server/live/audio_only_AAC_48k8、将当前摄像头及音频通过DSSHOW采集,视频h264、音频faac压缩后发布ffmpeg -r 25 -f dshow -s 640×480 -i video=”video source name”:audio=”audio source name” -vcodec libx264 -b 600k -vpre slow -acodec libfaac -ab 128k -f flv rtmp://server/application/stream_name9、将一个JPG图片经过h264压缩循环输出为mp4视频ffmpeg.exe -i INPUT.jpg -an -vcodec libx264 -coder 1 -flags +loop -cmp +chroma -subq 10 -qcomp 0.6 -qmin 10 -qmax 51 -qdiff 4 -flags2+dct8x8 -trellis 2 -partitions +parti8x8+parti4x4 -crf 24 -threads 0 -r 25 -g 25 -y OUTPUT.mp410、将普通流视频改用h264压缩,音频不变,送至高清流服务(新版本FMS live=1)ffmpeg -i rtmp://server/live/originalStream -c:a copy -c:v libx264 -vpre slow -f flv “rtmp://server/live/h264Stream live=1〃1.采集usb摄像头视频命令:ffmpeg -t 10 -f vfwcap -i 0 -r 8 -f mp4 cap.mp4具体说明如下:我们采集10秒,采集设备为vfwcap类型设备,第0个vfwcap采集设备(如果系统有多个vfw的视频采集设备,可以通过-i num来选择),每秒8帧,输出方式为文件,格式为mp4。

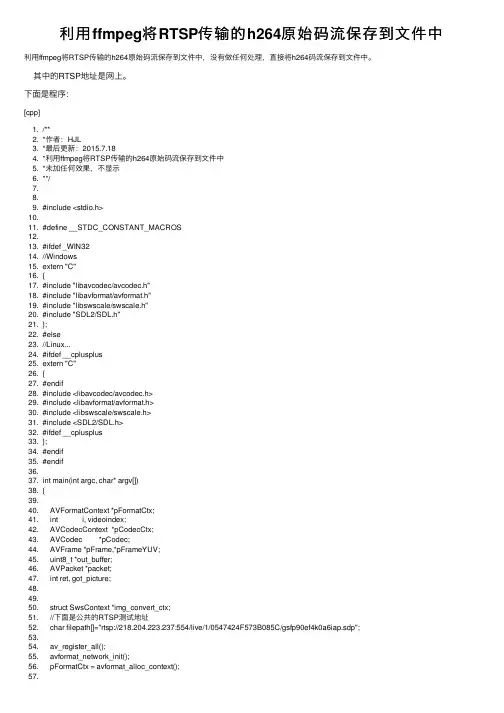

利⽤ffmpeg将RTSP传输的h264原始码流保存到⽂件中利⽤ffmpeg将RTSP传输的h264原始码流保存到⽂件中,没有做任何处理,直接将h264码流保存到⽂件中。

其中的RTSP地址是⽹上。

下⾯是程序:[cpp]1. /**2. *作者:HJL3. *最后更新:2015.7.184. *利⽤ffmpeg将RTSP传输的h264原始码流保存到⽂件中5. *未加任何效果,不显⽰6. **/7.8.9. #include <stdio.h>10.11. #define __STDC_CONSTANT_MACROS12.13. #ifdef _WIN3214. //Windows15. extern "C"16. {17. #include "libavcodec/avcodec.h"18. #include "libavformat/avformat.h"19. #include "libswscale/swscale.h"20. #include "SDL2/SDL.h"21. };22. #else23. //Linux...24. #ifdef __cplusplus25. extern "C"26. {27. #endif28. #include <libavcodec/avcodec.h>29. #include <libavformat/avformat.h>30. #include <libswscale/swscale.h>31. #include <SDL2/SDL.h>32. #ifdef __cplusplus33. };34. #endif35. #endif36.37. int main(int argc, char* argv[])38. {39.40. AVFormatContext *pFormatCtx;41. int i, videoindex;42. AVCodecContext *pCodecCtx;43. AVCodec *pCodec;44. AVFrame *pFrame,*pFrameYUV;45. uint8_t *out_buffer;46. AVPacket *packet;47. int ret, got_picture;48.49.50. struct SwsContext *img_convert_ctx;51. //下⾯是公共的RTSP测试地址52. char filepath[]="rtsp://218.204.223.237:554/live/1/0547424F573B085C/gsfp90ef4k0a6iap.sdp";53.54. av_register_all();55. avformat_network_init();56. pFormatCtx = avformat_alloc_context();57.58. if(avformat_open_input(&pFormatCtx,filepath,NULL,NULL)!=0)////打开⽹络流或⽂件流59. {60. printf("Couldn't open input stream.\n");61. return -1;62. }63. if(avformat_find_stream_info(pFormatCtx,NULL)<0)64. {65. printf("Couldn't find stream information.\n");66. return -1;67. }68. videoindex=-1;69. for(i=0; i<pFormatCtx->nb_streams; i++)70. if(pFormatCtx->streams[i]->codec->codec_type==AVMEDIA_TYPE_VIDEO)71. {72. videoindex=i;73. break;74. }75. if(videoindex==-1)76. {77. printf("Didn't find a video stream.\n");78. return -1;79. }80. pCodecCtx=pFormatCtx->streams[videoindex]->codec;81. pCodec=avcodec_find_decoder(pCodecCtx->codec_id);82. if(pCodec==NULL)83. {84. printf("Codec not found.\n");85. return -1;86. }87. if(avcodec_open2(pCodecCtx, pCodec,NULL)<0)88. {89. printf("Could not open codec.\n");90. return -1;91. }92. pFrame=av_frame_alloc();93. pFrameYUV=av_frame_alloc();94. out_buffer=(uint8_t *)av_malloc(avpicture_get_size(PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height));95. avpicture_fill((AVPicture *)pFrameYUV, out_buffer, PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height);96.97. //Output Info---输出⼀些⽂件(RTSP)信息98. printf("---------------- File Information ---------------\n");99. av_dump_format(pFormatCtx,0,filepath,0);100. printf("-------------------------------------------------\n");101.102. img_convert_ctx = sws_getContext(pCodecCtx->width, pCodecCtx->height, pCodecCtx->pix_fmt,103. pCodecCtx->width, pCodecCtx->height, PIX_FMT_YUV420P, SWS_BICUBIC, NULL, NULL, NULL);104.105.106. packet=(AVPacket *)av_malloc(sizeof(AVPacket));107.108. FILE *fpSave;109. if((fpSave = fopen("geth264.h264", "ab")) == NULL) //h264保存的⽂件名110. return 0;111. for (;;)112. {113. //------------------------------114. if(av_read_frame(pFormatCtx, packet)>=0)115. {116. if(packet->stream_index==videoindex)117. {118. fwrite(packet->data,1,packet->size,fpSave);//写数据到⽂件中119. }120. av_free_packet(packet);121. }122. }123.124.125. //--------------126. av_frame_free(&pFrameYUV);127. av_frame_free(&pFrame);128. avcodec_close(pCodecCtx);129. avformat_close_input(&pFormatCtx);130.131. return 0;132. }/***作者:HJL*最后更新:2015.7.18*利⽤ffmpeg将RTSP传输的h264原始码流保存到⽂件中*未加任何效果,不显⽰**/#include <stdio.h>#define __STDC_CONSTANT_MACROS#ifdef _WIN32//Windowsextern "C"{#include "libavcodec/avcodec.h"#include "libavformat/avformat.h"#include "libswscale/swscale.h"#include "SDL2/SDL.h"};#else//Linux...#ifdef __cplusplusextern "C"{#endif#include <libavcodec/avcodec.h>#include <libavformat/avformat.h>#include <libswscale/swscale.h>#include <SDL2/SDL.h>#ifdef __cplusplus};#endif#endifint main(int argc, char* argv[]){AVFormatContext *pFormatCtx;int i, videoindex;AVCodecContext *pCodecCtx;AVCodec *pCodec;AVFrame *pFrame,*pFrameYUV;uint8_t *out_buffer;AVPacket *packet;int ret, got_picture;struct SwsContext *img_convert_ctx;//下⾯是公共的RTSP测试地址char filepath[]="rtsp://218.204.223.237:554/live/1/0547424F573B085C/gsfp90ef4k0a6iap.sdp"; av_register_all();avformat_network_init();pFormatCtx = avformat_alloc_context();if(avformat_open_input(&pFormatCtx,filepath,NULL,NULL)!=0)////打开⽹络流或⽂件流{printf("Couldn't open input stream.\n");return -1;}if(avformat_find_stream_info(pFormatCtx,NULL)<0){printf("Couldn't find stream information.\n");return -1;}videoindex=-1;for(i=0; i<pFormatCtx->nb_streams; i++)if(pFormatCtx->streams[i]->codec->codec_type==AVMEDIA_TYPE_VIDEO){videoindex=i;break;}if(videoindex==-1){printf("Didn't find a video stream.\n");return -1;}pCodecCtx=pFormatCtx->streams[videoindex]->codec;pCodec=avcodec_find_decoder(pCodecCtx->codec_id);if(pCodec==NULL){printf("Codec not found.\n");return -1;}if(avcodec_open2(pCodecCtx, pCodec,NULL)<0){printf("Could not open codec.\n");return -1;}pFrame=av_frame_alloc();pFrameYUV=av_frame_alloc();out_buffer=(uint8_t *)av_malloc(avpicture_get_size(PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height)); avpicture_fill((AVPicture *)pFrameYUV, out_buffer, PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height); //Output Info---输出⼀些⽂件(RTSP)信息printf("---------------- File Information ---------------\n");av_dump_format(pFormatCtx,0,filepath,0);printf("-------------------------------------------------\n");img_convert_ctx = sws_getContext(pCodecCtx->width, pCodecCtx->height, pCodecCtx->pix_fmt,pCodecCtx->width, pCodecCtx->height, PIX_FMT_YUV420P, SWS_BICUBIC, NULL, NULL, NULL);packet=(AVPacket *)av_malloc(sizeof(AVPacket));FILE *fpSave;if((fpSave = fopen("geth264.h264", "ab")) == NULL) //h264保存的⽂件名return 0;for (;;){//------------------------------if(av_read_frame(pFormatCtx, packet)>=0){if(packet->stream_index==videoindex){fwrite(packet->data,1,packet->size,fpSave);//写数据到⽂件中}av_free_packet(packet);}}//--------------av_frame_free(&pFrameYUV);av_frame_free(&pFrame);avcodec_close(pCodecCtx);avformat_close_input(&pFormatCtx);return 0;}控制台打印的信息如下:最后保存的h264码流的⽂件⽤h264播放器打开后如下:整个VS2012⼯程⽂件可以在下载。

调整摄像头的码流大小的方法

当我们使用摄像头进行视频录制或者视频流传输时,可能会遇到码流大小不合

适的问题。

调整摄像头的码流大小可以有多种方法,下面我将介绍几种常用的方法。

1. 软件设置:

大多数摄像头都提供了软件来管理和控制摄像头的设置。

通过打开摄像头的

软件界面,我们可以找到相关的设置选项,如分辨率、码率等。

在这些选项中,我们可以调整摄像头的码流大小。

通常情况下,较高的分辨率和码率会带来更清晰的图像质量,但同时也会占用更大的带宽和存储空间。

因此,根据需求调整摄像头的码流大小是很重要的。

2. 硬件设置:

除了软件设置外,一些高级摄像头还可以通过硬件设置来调整码流大小。

这

些设置通常是通过摄像头上的物理按钮、旋钮或者遥控器来完成的。

我们可以通过查看摄像头的用户手册或者使用指南来了解摄像头的硬件设置方法。

硬件设置可以提供更直观和精细的控制,可以根据需要进行更精确的调整。

3. 视频编码器设置:

视频编码器是控制视频流码率和大小的重要组成部分。

我们可以使用视频编

码器软件来调整码流大小。

常见的视频编码器软件包括FFmpeg、Handbrake等。

通过设置视频编码器的参数,如码率、压缩质量、关键帧间隔等,我们可以实现对摄像头的码流大小进行调整。

需要注意的是,在调整编码器参数时,我们需要兼顾视频质量和码流大小之间的平衡。

总结来说,调整摄像头的码流大小可以通过软件设置、硬件设置或者视频编码

器设置来实现。

根据实际需求和操作设备的不同,我们可以选择合适的方法来进行调整,以达到更好的视频录制和传输效果。

ffmpeg preset参数FFmpeg是一个免费开源的跨平台音视频转码库,可以处理几乎所有主流音视频格式,不同分辨率、帧率、码率视频的转换,支持各种音视频编解码器等。

在使用FFmpeg时,可以通过命令行对参数进行设置调整,更好的实现音视频转码。

FFmpeg 的 preset 参数是指事先设定好的某种参数,40多个预设参数可用于视频编码和解码,preset在使用FFmpeg进行视频编码时,会对编码质量产生影响,本文详细介绍ffmpeg preset参数。

一、preset参数简介Preset参数可以通过设置编码过程的多个参数共同影响输出的视频质量和大小。

目标是平衡视频质量和视频大小之间的权衡。

FFmpeg提供了多种preset参数可供调整和选择,常见的预设参数有:1. ultrafast:转换速度最快。

2. superfast:超快模式,转换速度快,但输出文件较大。

3. veryfast:非常快的转换速度,输出文件中等大小/质量。

4. faster:快速的转换速度,中等大小的输出文件/质量。

5. fast:快速的转换速度,相对较小的输出文件/质量。

6. medium:普通模式,输出文件大小和质量平衡。

7. slow:较慢的转换速度,质量较好的输出文件,输出文件相对较小。

8. slower:更慢的转换速度,输出文件大小较小,质量优秀。

9. veryslow:转换速度最慢,输出文件大小最小,质量最好。

参数相互之间并不是量化的,而应该视为代表针对预设目标的优化的不同权衡。

转换速度和文件大小(编码速度)与输出文件质量(编码质量)之间的关系取决于文件本身,带宽和压缩格式等因素。

二、参数设置使用FFmpeg进行预设参数的设置非常简单,可以通过命令行或程序方式进行控制。

下面是一些使用preset参数的示例:例1:ffmpeg -i input.mp4 -c:v libx264 -preset ultrafast output.mp4例2:ffmpeg -i input.mp4 -c:v libx264 -preset slow output.mp4在这些命令中,我们设置了预设参数为“ultrafast”和“slow”。

FFmpeg X264编码参数1.目录1.码率控制 (1)2.X264的preset和tune (2)3.编码延时建议 (2)4.ffmpeg编码参数和x264参数对照 (3)5.x264参数说明 (6)2.码率控制X264提供三种码率控制的方式:bitrate, qp, crf。

这三种方式是互斥的,使用时设置其中之一即可。

(1)bitratex264会尝试把给定的位元率作为整体平均值来编码。

这意味着最终编码文件的大小是已知的,但最终的品质未知。

此选项通常与-pass(两阶段编码)一起使用。

注意,ffmpeg中设置bitrate的具体参数为bit_rate,单位是bits/s(x264里面对应参数i_bitrate 的单位则是kbits/s, 1kbits为1000bits而非1024bits).(2)qp使用qp选项时,表示P帧的量化值为qp。

I帧和B帧的量化值则是从--ipratio和--pbratio中取得。

可使用默认参数,也可自己设定。

使用qp模式,即固定量化值,意味着停用弹性量化(aq_mode)。

当qp为0时,为无损编码。

(3)crf固定位元率系数,C onstant R ate f actor,可用的值从1到51,越小编码质量越好,码率越高。

一般使用16到24,可以为浮点。

(crf 并不是恒定质量的方式,同一片子同一crf值,其他参数不同可能码率和质量差较大,不同的片子之间就更没有可比性了)此模式把某个“质量”作为编码目标,根据片子质量自动分配码率的vbr(Variable Bit Rate 动态比特率)。

X264中构想是让crf n提供与qp n相当的视觉品质,但编码文件更小一些。

CRF是借由降低“较不重要”帧的品质来达到此目的。

在此情况下,“较不重要”是指在复杂或高动态场景的帧,其品质不是很耗费位元数就是不易察觉,所以会提高它们的量化值。

从这些帧里所节省下来的位元数被重新分配到可以更有效利用的帧。

ffmpeg调整码率用法

要使用FFmpeg调整视频的码率,你可以使用以下命令:

shell.

ffmpeg -i input.mp4 -b:v 2M output.mp4。

在这个命令中,`-i input.mp4` 表示输入文件的名称,`-b:v 2M` 表示视频的目标码率为2兆比特每秒,`output.mp4` 是输出文件的名称。

你可以根据需要调整目标码率的数值。

另外,你还可以使用其他选项来调整视频的码率,例如:

shell.

ffmpeg -i input.mp4 -vf scale=1280:720 -b:v 2M output.mp4。

在这个命令中,`-vf scale=1280:720` 表示将视频的分辨率调整为1280x720,`-b:v 2M` 表示视频的目标码率为2兆比特每秒,

`output.mp4` 是输出文件的名称。

这个命令将同时调整视频的分辨

率和码率。

需要注意的是,调整视频的码率可能会影响视频的质量,过高

或过低的码率都会导致画质损失。

因此,在调整码率时,你需要权

衡视频质量和文件大小之间的关系,选择一个合适的码率来满足你

的需求。

总的来说,FFmpeg提供了丰富的选项来调整视频的码率,你可

以根据具体的需求来选择合适的命令和参数来完成视频码率的调整。

希望这些信息能够帮助到你。

ffmpeg rate_control_methodrate_control_method 是 FFmpeg 中视频编码时用于控制码率的一个关键参数。

它决定了编码器如何选择不同的量化参数和其他设置来优化视频的质量和大小。

选择正确的rate_control_method 对于生成满足不同需求(如文件大小、视频质量、网络传输等)的视频至关重要。

在 FFmpeg 中,rate_control_method 可以有多种选择,如 cqp、crf、vbr、abr 和vbv_maxrate 等。

cqp(Constant Quantization Parameter):这种方法使用固定的量化参数进行编码,不考虑视频内容的复杂性。

它提供了一致的质量,但可能不是最高效的码率控制方法。

crf(Constant Rate Factor):crf 是 FFmpeg 中最常用的码率控制方法之一。

它通过调整量化参数来平衡质量和文件大小,而不需要用户手动设置量化参数。

crf 值越小,视频质量越高,文件大小也越大。

通常,crf 的值在 0 到 51 之间,其中 18 到 28 被认为是视觉上的“透明”编码(即几乎无损)。

vbr(Variable Bitrate):可变比特率编码会根据视频内容的复杂性动态调整比特率。

这可以在保持视频质量的同时更有效地利用带宽。

abr(Average Bitrate):平均比特率编码试图保持一个恒定的平均比特率,但在复杂场景下可能会牺牲一些质量以保持恒定的比特率。

vbv_maxrate:这种方法允许你设置视频缓冲验证器(Video Buffer Verifier, VBV)的最大比特率。

它通常与 vbv_bufsize 一起使用,以控制视频编码时的缓冲区大小和码率波动。

选择哪种 rate_control_method 取决于你的具体需求。

例如,如果你希望生成尽可能小的文件并保持可接受的质量,crf 是一个不错的选择。

FFmpeg 编码格式1. 什么是 FFmpeg?FFmpeg 是一个开源的多媒体处理工具,可以用于录制、转换和流媒体传输音视频。

它由一组库和命令行工具组成,提供了丰富的功能,包括编码、解码、转码、过滤、流媒体等。

2. 编码格式的概念在音视频处理中,编码格式指的是将原始音视频数据转换为特定格式的过程。

不同的编码格式有不同的特点和用途,如压缩比、画质损失、兼容性等。

常见的音频编码格式有 MP3、AAC、FLAC 等;常见的视频编码格式有 H.264、H.265、VP9 等。

3. FFmpeg 支持的编码格式FFmpeg 支持大量的音视频编码格式,下面列举一些常用的:音频编码格式•MP3:一种常用的有损压缩音频格式,适合于存储和传输。

•AAC:一种高质量有损压缩音频格式,广泛应用于各种设备和平台。

•FLAC:一种无损压缩音频格式,保留了原始音频质量。

•PCM:无压缩脉冲编码调制,是一种无损音频编码格式。

•Opus:一种开放、高效的音频编码格式,适用于各种应用场景。

视频编码格式•H.264:一种广泛应用的视频编码格式,具有高压缩比和良好的画质。

•H.265:也称为 HEVC,是 H.264 的继任者,具有更高的压缩效率。

•VP9:由 Google 开发的开源视频编码格式,适用于网络传输和流媒体。

•AV1:由 Alliance for Open Media 开发的开源视频编码格式,具有较好的压缩性能。

4. FFmpeg 编码格式转换示例使用 FFmpeg 进行编码格式转换非常简单,以下是一个示例:ffmpeg -i input.mp4 -c:v h264 -c:a aac output.mp4上述命令将输入文件input.mp4转换为 H.264 视频编码和 AAC 音频编码的 MP4文件output.mp4。

在上述命令中,-c:v指定视频编码器,h264表示使用 H.264 编码;-c:a指定音频编码器,aac表示使用 AAC 编码。

ffmpeg码流控制

FFmpeg是一个开源的多媒体处理工具,它可以用于音视频编解码、转码、流媒体处理等多种用途。

在这里,我们来讨论FFmpeg中的码流控制。

码流控制是指控制音视频数据的传输速率,以确保在不同网络环境下的媒体播放的稳定性和流畅性。

在FFmpeg中,有几种方法可以实现码流控制。

1. 码率控制:

码率控制是一种通过控制编码参数来控制输出媒体文件的码率的方法。

在FFmpeg中,可以通过设置编码器的参数,如码率(bitrate)、帧率(framerate)、关键帧间隔(gop size)等来控制输出文件的码率。

通过调整这些参数,可以实现对码率的精确控制。

2. 帧丢弃:

在某些情况下,网络带宽不足或媒体播放设备性能有限,无法实时处理所有的音视频帧。

为了保证播放的连续性,可以通过在编码过程中丢弃一些帧来减少数据量。

在FFmpeg中,可以使用参数"-vf"或"-af"来进行帧丢弃,通过设置适当的帧丢弃策略,可以在保持播放连续性的前提下减少码流大小。

3. 媒体格式转换:

码流控制还可以通过转换媒体文件的格式来实现。

对于某些网络环境下传输速率较慢的情况,可以通过将媒体文件转换为更高压缩率的格式,如从AVI转换为MP4,从WAV转换为AAC等,来减小数据量,从而实现码流控制。

需要注意的是,在进行码流控制时,需要综合考虑网络带宽、媒体文件质量要求和播放设备性能等因素,以达到合理的码流控制效果。

FFmpeg提供了丰富的参数和选项,可以根据实际情况进行调整和优化。

以上是关于FFmpeg中码流控制的简要说明,希望能对你有所帮助。

如有更多细节或相关问题,请随时提问。