第14章有序多分类逻辑斯蒂回归模型

- 格式:ppt

- 大小:652.00 KB

- 文档页数:32

逻辑斯蒂回归在分类问题中的应用逻辑斯蒂回归(Logistic Regression)是一种常用的分类算法,尤其在二分类问题中得到广泛应用。

逻辑斯蒂回归通过将线性回归模型的输出映射到一个概率范围内,从而实现对样本进行分类。

本文将介绍逻辑斯蒂回归的原理、优缺点以及在分类问题中的具体应用。

### 一、逻辑斯蒂回归原理逻辑斯蒂回归是一种广义线性回归模型,其模型形式为:$$P(y=1|x) = \frac{1}{1+e^{-(w^Tx+b)}}$$其中,$P(y=1|x)$表示在给定输入$x$的情况下,输出为类别1的概率;$w$和$b$分别为模型的参数,$w$为权重向量,$b$为偏置项;$e$为自然对数的底。

逻辑斯蒂回归通过对线性回归模型的输出进行Sigmoid函数的映射,将输出限制在0到1之间,表示样本属于某一类别的概率。

### 二、逻辑斯蒂回归优缺点1. 优点:- 实现简单,计算代价低;- 输出结果具有概率意义,便于理解和解释;- 可以处理非线性关系。

2. 缺点:- 容易受到异常值的影响;- 对特征工程要求较高;- 无法很好地处理多分类问题。

### 三、逻辑斯蒂回归在分类问题中的应用逻辑斯蒂回归在分类问题中有着广泛的应用,以下是一些常见的应用场景:1. 金融风控在金融领域,逻辑斯蒂回归常用于信用评分和风险控制。

通过构建逻辑斯蒂回归模型,可以根据客户的个人信息、财务状况等特征,预测其违约概率,从而制定相应的风险控制策略。

2. 医疗诊断在医疗领域,逻辑斯蒂回归可用于疾病诊断和预测。

通过医疗数据的特征提取和逻辑斯蒂回归模型的构建,可以帮助医生判断患者是否患有某种疾病,提前进行治疗和干预。

3. 市场营销在市场营销中,逻辑斯蒂回归可用于客户分类和营销策略制定。

通过分析客户的购买行为和偏好,构建逻辑斯蒂回归模型,可以预测客户的购买意向,从而制定个性化的营销方案。

4. 文本分类在自然语言处理领域,逻辑斯蒂回归可用于文本分类任务。

标题:深入探讨多分类有序logit模型的模型结果解释在统计学和机器学习领域,多分类有序logit模型是一种常用的模型,用来处理有序分类变量的预测和解释。

在本文中,我们将深入探讨多分类有序logit模型的模型结果解释,帮助读者更好地理解其原理和应用。

1. 多分类有序logit模型的基本原理多分类有序logit模型是一种广义线性模型,用于对有序分类变量进行建模和预测。

它建立在logistic函数的基础上,通过最大似然估计对模型参数进行拟合,从而推断不同自变量对特定有序分类变量的影响。

其基本原理是将有序分类变量转化为一组二分类变量,然后使用logistic回归模型进行建模。

这种方法可以有效地处理有序分类变量,对于解释性强的场景非常适用。

2. 模型结果解释的重要性和方法在使用多分类有序logit模型进行建模和预测时,模型结果的解释至关重要。

在解释模型结果时,我们可以使用各种方法,比如变量的边际效应、相对风险比、转移概率等。

这些方法可以帮助我们理解不同自变量对有序分类变量的影响程度,从而更好地理解模型的预测能力和应用场景。

图表和统计检验也是解释模型结果的常用方法,可以直观地展现变量之间的关系和影响程度。

3. 在多分类有序logit模型中如何解释模型结果在多分类有序logit模型中,我们可以通过计算变量的边际效应来解释模型结果。

边际效应可以反映出自变量对因变量的影响程度,帮助我们理解模型的预测能力。

相对风险比是另一种重要的解释方法,可以告诉我们不同自变量水平之间的风险差异。

转移概率可以帮助我们理解不同分类变量之间的转移规律,从而为决策提供参考。

4. 个人观点和理解在使用多分类有序logit模型进行建模和解释时,我认为深入理解模型结果和解释方法是非常重要的。

只有通过对模型结果的全面解释,我们才能更好地理解自变量对有序分类变量的影响,从而做出合理的预测和决策。

在解释模型结果时,我倾向于使用边际效应和相对风险比这两种方法,因为它们可以直观地展现变量之间的关系和影响程度,帮助我更好地应用模型进行预测和分析。

逻辑斯蒂模型各参数的意义

一、逻辑斯蒂模型的概念

逻辑斯蒂回归模型是一种用于建立二元分类的统计学模型,它将预测结果视作一个随机变量(可能的值是0或1),而结果由一个条件概率分布来确定。

当对一个新样本做预测时,将计算出一个概率,如果概率超过某个已设定的阈值,则判定此样本属于1类,反之属于0类。

二、参数的概念

在逻辑斯蒂回归模型中,参数指模型中变量的权重,参数的估计即为拟合样本所需要调整的参数,以最大化模型的拟合精度。

三、参数的含义

1、w:w是权值向量,可以确定一个样本分类的阈值,模型预测的概率大于或小于这个阈值就可以得出类别的判断结果。

2、b:b是偏置,是模型决定正负样本的阈值,b的取值不用影响模型的预测结果,但是影响到分类的阈值。

3、θ:θ是参数的集合,即w和b。

4、α:α是学习率,是一种超参数,改变其值可以调整参数更新的速度,从而影响模型收敛的速度和性能。

四、参数的调整

参数的调整包括参数估计和超参数调整。

(1)参数估计

参数估计是指根据训练样本,计算出逻辑斯蒂模型的参数,从而

拟合训练样本。

在估计参数的过程中,可以使用最大似然估计、最小二乘估计等方法。

(2)超参数调整

超参数调整是指调整逻辑斯蒂回归模型中的其他参数,比如学习率、迭代次数、正则化强度等,从而使模型的拟合精度更高。

逻辑斯蒂回归(LogisticRegression)展开全文本文是结合书来作出自己的理解和总结的,主要的参考书目是《统计学习方法》,后期的修改中,我会加入相关的其他书籍进来。

欢迎批评和指正~~本文的思路是根据《统计学习方法》第一章所提到的:统计学习方法 = 模型+策略+算法的思路来讲的,所以,如果对于这个思路有疑问,自行看第一章。

本文主要介绍的是逻辑斯蒂模型的模型、策略和算法,至于最大熵模型,这里不予介绍。

首先会介绍逻辑斯蒂模型的基本模型,然后会介绍极大似然估计的基本原理和逻辑回归的策略并求出逻辑回归的目标函数,最后介绍梯度上升算法和逻辑回归目标函数的最优化。

1、逻辑斯蒂模型1.1、逻辑斯蒂分布为什么先讲逻辑斯蒂分布呢?因为我们的逻辑斯蒂模型就是根据逻辑斯蒂分布得到的,所以说逻辑斯蒂方法是属于判别方法,即知道了P(Y|X)的形式(当然,我们是不知道P(X,Y)的,要不然机器学习也就没有意义了。

),通过参数估计方法直接估计出参数,从而得到P(Y|X)。

下面给出《统计学习方法》上逻辑斯蒂分布的定义:1.2、二项逻辑斯蒂回归模型知道分布的定义之后,就是给出我们的逻辑斯蒂模型了:这里需要注意的有两点:(1)最终的结果是通过比较P(Y=1|X)和P(Y=0|X)的大小来确定类别的;(2)b在这里其实可以看做是w0x0,其中x0 = 1;(3)其实本质上这个就是一个二项分布,所以遵循二项分布的分布律。

1.3、事件的对数几率(log odds)废话不说,还是看看统计学习方法上面的定义:1.4、第一个结论根据之前,我们就得到了两个定义:(1)逻辑回归模型;(2)事件的对数几率。

那么从这两个定义,我们可以得到什么推论呢?也就是说,如果我的模型是逻辑回归模型,那么事件{Y=1|X}发生的对数几率就是输入X的线性函数(模型)。

所以只要知道了这个推论,我们是可以反推出逻辑斯蒂模型的形式的:1.5、比较逻辑斯蒂模型和感知机首先,很显然,这里的逻辑斯蒂模型可以看成是f(wx),也就是wx的函数:sigmoid函数,感知机则是sign函数。

逻辑斯蒂回归模型参数估计逻辑斯蒂回归模型是一种经典的统计学方法,被广泛应用于分类问题的参数估计。

本文将以通俗易懂的语言介绍逻辑斯蒂回归模型参数估计的原理、步骤和指导意义。

逻辑斯蒂回归模型是一种用于解决分类问题的统计模型。

它的核心思想是通过建立一个函数,将输入的特征与输出的概率联系起来。

逻辑斯蒂回归模型的输出是一个概率值,表示样本属于某个类别的可能性。

在逻辑斯蒂回归模型中,参数估计就是为了找到最佳的函数参数,使其能够最好地拟合样本数据。

参数估计的过程是通过最大似然估计方法来进行的。

最大似然估计是一种常用的参数估计方法,它的核心思想是找到使得样本观测概率最大的参数值。

具体来说,在逻辑斯蒂回归模型中,参数估计的步骤如下:首先,我们需要准备训练数据集,包括一组已知类别的样本和其对应的特征。

然后,我们需要选择适当的损失函数,用于衡量模型的拟合程度和预测结果的准确性。

在逻辑斯蒂回归模型中,常用的损失函数是对数似然损失函数。

接下来,我们需要使用优化算法,如梯度下降法,来最小化损失函数。

优化算法的目标是搜索最佳的参数值,使损失函数达到最小值。

在每次迭代中,参数值会根据当前的负梯度方向进行更新,直到达到收敛条件为止。

最后,我们可以使用估计得到的参数值来做预测。

通过将样本特征代入逻辑斯蒂回归函数,可以得到样本属于某个类别的概率值。

根据设定的阈值,我们可以将概率值转换为二分类的预测结果。

逻辑斯蒂回归模型参数估计的意义在于,它可以帮助我们理解变量之间的关系,并且可以用于预测新样本的类别。

通过分析参数的大小和符号,我们可以判断不同特征对于样本分类的重要性。

此外,逻辑斯蒂回归模型还具有一些优点,使其在实际应用中得到广泛使用。

首先,逻辑斯蒂回归模型是一种线性模型,计算效率较高。

其次,逻辑斯蒂回归模型输出的是概率值,可以提供更为精细的预测结果。

总之,逻辑斯蒂回归模型参数估计是一项重要的统计学任务。

通过合理选择损失函数和优化算法,我们可以得到一个较好的模型,用于解决分类问题。

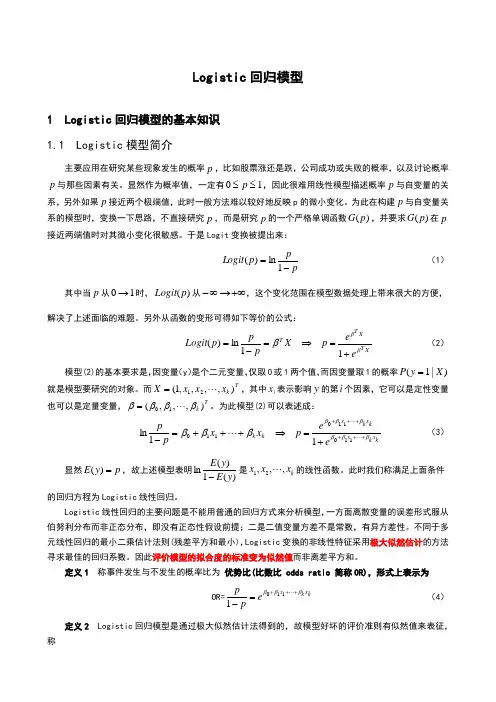

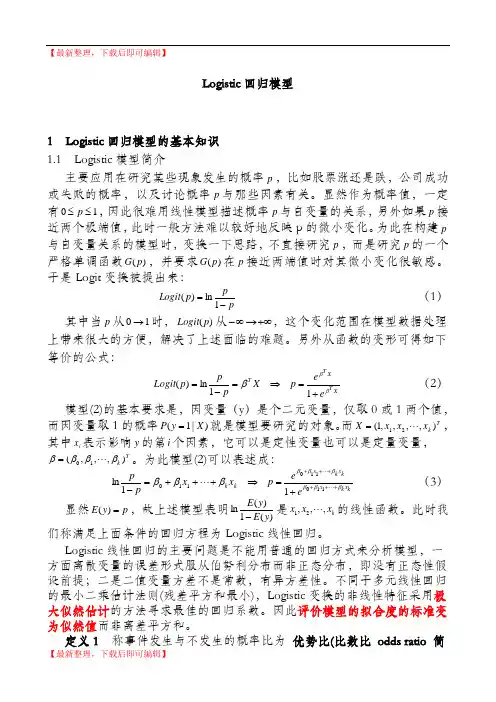

Logistic 回归模型1 Logistic 回归模型的基本知识 1.1 Logistic 模型简介主要应用在研究某些现象发生的概率p ,比如股票涨还是跌,公司成功或失败的概率,以及讨论概率p 与那些因素有关。

显然作为概率值,一定有10≤≤p ,因此很难用线性模型描述概率p 与自变量的关系,另外如果p 接近两个极端值,此时一般方法难以较好地反映p 的微小变化。

为此在构建p 与自变量关系的模型时,变换一下思路,不直接研究p ,而是研究p 的一个严格单调函数)(p G ,并要求)(p G 在p 接近两端值时对其微小变化很敏感。

于是Logit 变换被提出来:ppp Logit -=1ln)( (1)其中当p 从10→时,)(p Logit 从+∞→∞-,这个变化范围在模型数据处理上带来很大的方便,解决了上述面临的难题。

另外从函数的变形可得如下等价的公式:XT XT T ee p Xppp Logit βββ+=⇒=-=11ln )( (2)模型(2)的基本要求是,因变量(y )是个二元变量,仅取0或1两个值,而因变量取1的概率)|1(X y P =就是模型要研究的对象。

而Tk x x x X ),,,,1(21 =,其中i x 表示影响y 的第i 个因素,它可以是定性变量也可以是定量变量,Tk ),,,(10ββββ =。

为此模型(2)可以表述成:kx k x k x k x kk eep x x pp βββββββββ+++++++=⇒+++=- 11011011011ln (3)显然p y E =)(,故上述模型表明)(1)(lny E y E -是k x x x ,,,21 的线性函数。

此时我们称满足上面条件的回归方程为Logistic 线性回归。

Logistic 线性回归的主要问题是不能用普通的回归方式来分析模型,一方面离散变量的误差形式服从伯努利分布而非正态分布,即没有正态性假设前提;二是二值变量方差不是常数,有异方差性。

在一定条件下,生物种群增长并不是按几何级数无限增长的。

即开始增长速度快,随后速度慢直至停止增长(只是就某一值产生波动),这种增长曲线大致呈“S”型,这就是统称的逻辑斯谛(Logistic)增长模型。

意义

当一个物种迁入到一个新生态系统中后,其数量会发生变化.假设该物种的起始数量小于环境的最大容纳量,则数量会增长.增长方式有以下两种:

(1)J型增长若该物种在此生态系统中无天敌,且食物空间等资源充足(理想环境),则增长函数为N(t)=n(p^t).其中,N(t)为第t年的种群数量,t为时间,p为每年的增长率(大于1).图象形似J形。

(2)S型增长若该物种在此生态系统中有天敌,食物空间等资源也不充足(非理想环境),则增长函数满足逻辑斯谛方程。

图象形似S形.。

【最新整理,下载后即可编辑】Logistic 回归模型1 Logistic 回归模型的基本知识 1.1 Logistic 模型简介主要应用在研究某些现象发生的概率p ,比如股票涨还是跌,公司成功或失败的概率,以及讨论概率p 与那些因素有关。

显然作为概率值,一定有10≤≤p ,因此很难用线性模型描述概率p 与自变量的关系,另外如果p 接近两个极端值,此时一般方法难以较好地反映p 的微小变化。

为此在构建p 与自变量关系的模型时,变换一下思路,不直接研究p ,而是研究p 的一个严格单调函数)(p G ,并要求)(p G 在p 接近两端值时对其微小变化很敏感。

于是Logit 变换被提出来:pp p Logit -=1ln)( (1)其中当p 从10→时,)(p Logit 从+∞→∞-,这个变化范围在模型数据处理上带来很大的方便,解决了上述面临的难题。

另外从函数的变形可得如下等价的公式:XT XT T ee p Xppp Logit βββ+=⇒=-=11ln )( (2)模型(2)的基本要求是,因变量(y )是个二元变量,仅取0或1两个值,而因变量取1的概率)|1(X y P =就是模型要研究的对象。

而T k x x x X ),,,,1(21 =,其中i x 表示影响y 的第i 个因素,它可以是定性变量也可以是定量变量,T k ),,,(10ββββ =。

为此模型(2)可以表述成:kx k x k x k x kk eep x x pp βββββββββ+++++++=⇒+++=- 11011011011ln (3)显然p y E =)(,故上述模型表明)(1)(lny E y E -是k x x x ,,,21 的线性函数。

此时我们称满足上面条件的回归方程为Logistic 线性回归。

Logistic 线性回归的主要问题是不能用普通的回归方式来分析模型,一方面离散变量的误差形式服从伯努利分布而非正态分布,即没有正态性假设前提;二是二值变量方差不是常数,有异方差性。

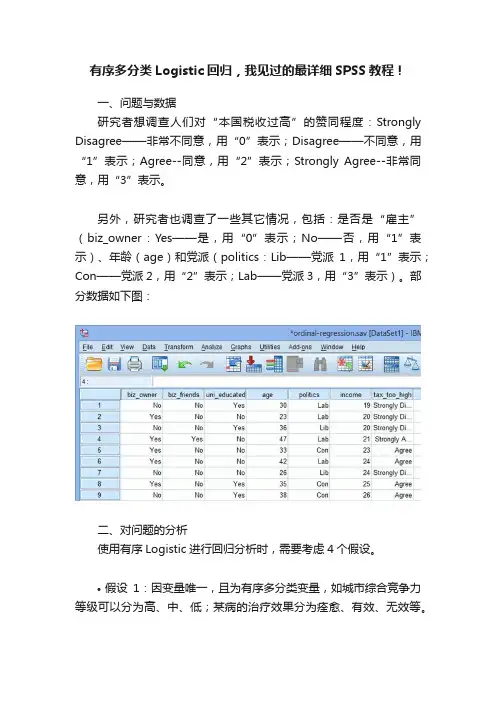

有序多分类Logistic回归,我见过的最详细SPSS教程!一、问题与数据研究者想调查人们对“本国税收过高”的赞同程度:Strongly Disagree——非常不同意,用“0”表示;Disagree——不同意,用“1”表示;Agree--同意,用“2”表示;Strongly Agree--非常同意,用“3”表示。

另外,研究者也调查了一些其它情况,包括:是否是“雇主”(biz_owner:Yes——是,用“0”表示;No——否,用“1”表示)、年龄(age)和党派(politics:Lib——党派1,用“1”表示;Con——党派2,用“2”表示;Lab——党派3,用“3”表示)。

部分数据如下图:二、对问题的分析使用有序Logistic进行回归分析时,需要考虑4个假设。

•假设1:因变量唯一,且为有序多分类变量,如城市综合竞争力等级可以分为高、中、低;某病的治疗效果分为痊愈、有效、无效等。

•假设2:存在一个或多个自变量,可为连续、有序多分类或无序分类变量。

•假设3:自变量之间无多重共线性。

•假设4:模型满足“比例优势”假设。

意思是无论因变量的分割点在什么位置,模型中各个自变量对因变量的影响不变,也就是自变量对因变量的回归系数与分割点无关。

有序多分类的Logistic回归原理是将因变量的多个分类依次分割为多个二元的Logistic回归,例如本例中因变量“本国的税收过高”的赞同程度有4个等级,分析时拆分为三个二元Logistic回归,分别为(0 vs 1+2+3) 、(0+1 vs 2+3)、(0+1+2 vs 3),均是较低级与较高级对比。

在有序多分类Logistic回归中,假设几个二元Logistic回归中,自变量的系数相等,仅常数项不等,结果也只输出一组自变量的系数。

因此,有序多分类的Logistic回归模型,必须对自变量系数相等的假设(即“比例优势”假设)进行检验(又称平行线检验)。

如果不满足该假设,则考虑使用无序多分类Logistic回归。

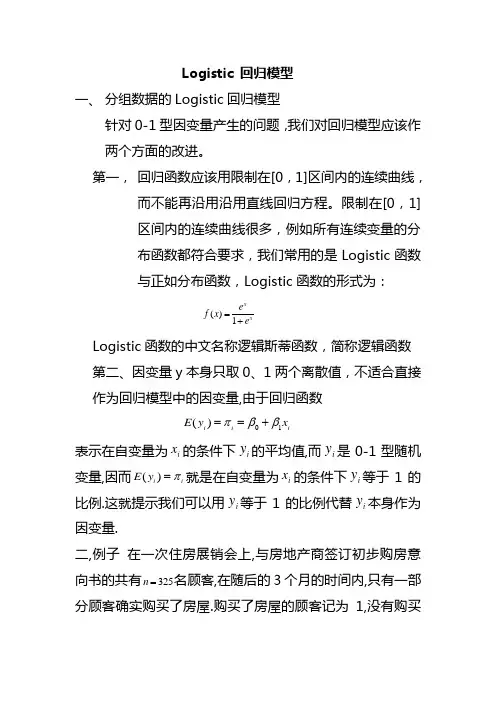

Logistic 回归模型一、 分组数据的Logistic 回归模型针对0-1型因变量产生的问题,我们对回归模型应该作两个方面的改进。

第一, 回归函数应该用限制在[0,1]区间内的连续曲线,而不能再沿用沿用直线回归方程。

限制在[0,1]区间内的连续曲线很多,例如所有连续变量的分布函数都符合要求,我们常用的是Logistic 函数与正如分布函数,Logistic 函数的形式为:()1x xef x e=+Logistic 函数的中文名称逻辑斯蒂函数,简称逻辑函数 第二、因变量y 本身只取0、1两个离散值,不适合直接作为回归模型中的因变量,由于回归函数01()i i i E y x πββ==+表示在自变量为i x 的条件下i y 的平均值,而i y 是0-1型随机变量,因而()i i E y π=就是在自变量为i x 的条件下i y 等于1的比例.这就提示我们可以用i y 等于1的比例代替i y 本身作为因变量.二,例子 在一次住房展销会上,与房地产商签订初步购房意向书的共有325n =名顾客,在随后的3个月的时间内,只有一部分顾客确实购买了房屋.购买了房屋的顾客记为1,没有购买房屋的顾客记为0,以顾客的年家庭收入为自变量x,对下面表所示的数据,序号年家庭收入(万元)x 签订意向书人数n 实际购房人数m 实际购房比例p逻辑变换p′=ln(p/(1-p))权重w=np(1-p)1 1.52580.32-0.7537718 5.442 2.532130.40625-0.37948967.718753 3.558260.448276-0.207639414.344834 4.552220.423077-0.310154912.692315 5.543200.465116-0.139761910.697676 6.539220.5641030.257829119.58974477.528160.5714290.287682076.85714388.521120.5714290.287682075.14285799.515100.6666670.693147183.333333建立Logistic 回归模型:ci x x pi i i,,2,1,)exp(1)exp(1010 =+++=ββββ,其中,c 为分组数据的组数,本例中c=9.将以上回归方程作线性变换,令 )1ln(ii ip p p -='该变换称为逻辑变换,变换后的线性回归模型为 i i ix p εββ++='10该式是一个普通的一元线性回归模型。

有序多分类逻辑回归-回复有序多分类逻辑回归是一种用于解决多分类问题的机器学习算法。

它在预测输出类别时考虑了类别的有序性,通常用于情感分析、星级评价等问题。

本文将详细介绍有序多分类逻辑回归的原理、应用以及实现步骤。

一、有序多分类逻辑回归的原理有序多分类逻辑回归是基于逻辑回归进行拓展的,逻辑回归是一种广泛应用于二分类问题的线性回归模型。

它通过将样本的线性组合映射到一个0和1之间的概率值,来预测样本属于某一类别的概率。

有序多分类逻辑回归将逻辑回归推广到了多分类问题上,并考虑了类别之间的有序性。

它通过引入有序分类器的概念,将多分类问题转化为多个二分类问题。

每个有序分类器都用于预测样本是否属于某个特定的类别或者前面的某个类别。

具体来说,有序多分类逻辑回归模型为每个类别设置了一个二分类模型,这些模型之间包含了类别的有序关系。

对于每个二分类模型,模型输出的是样本属于该类别的概率,而不属于其他类别的概率。

然后,通过比较这些概率值来确定样本所属的类别。

二、有序多分类逻辑回归的应用有序多分类逻辑回归在实际应用中具有广泛的应用场景。

其中最常见的应用是情感分析,即根据文本内容判断其表示的情感是积极的、消极的还是中性的。

此外,有序多分类逻辑回归还可以用于星级评价预测、产品评级等问题。

在情感分析中,有序多分类逻辑回归可以根据文本的特征对其进行分类。

通过训练样本,模型学习到了不同情感类别之间的区分特征,并能够根据输入的文本内容预测出其情感类别。

这种应用在社交媒体分析、评论分析等领域具有重要意义。

三、有序多分类逻辑回归的实现步骤下面将介绍有序多分类逻辑回归的实现步骤。

1. 数据准备:收集并准备有标签的训练数据,确保数据的质量和完整性,包括文本数据和对应的情感标签。

2. 特征提取:从训练数据中提取有用的特征。

常用的特征提取方法包括词袋模型、TF-IDF、word2vec等。

通过这些特征,可以将文本数据转化为向量表示。

3. 模型训练:使用有序多分类逻辑回归算法对提取的特征进行训练。

多项逻辑斯蒂回归模型

多项逻辑斯蒂回归模型是一种广泛应用于分类问题的统计学方法。

它是逻辑斯蒂回归模型的扩展,可以处理多个分类变量的情况。

在实际应用中,多项逻辑斯蒂回归模型被广泛应用于医学、社会科学、市场营销等领域。

多项逻辑斯蒂回归模型的基本思想是将多个分类变量的概率分布建模为一个多项分布。

在这个模型中,每个分类变量都有一个对应的参数向量,用来描述该变量在不同类别下的概率分布。

模型的目标是通过最大化似然函数来估计这些参数向量,从而实现对分类问题的预测。

在实际应用中,多项逻辑斯蒂回归模型可以用于多个分类变量的预测。

例如,在医学领域,可以使用该模型来预测患者的疾病类型。

在社会科学领域,可以使用该模型来预测人们的政治倾向或消费习惯。

在市场营销领域,可以使用该模型来预测客户的购买行为。

多项逻辑斯蒂回归模型的优点在于它可以处理多个分类变量,并且可以对分类变量的概率分布进行建模。

此外,该模型还可以通过调整参数向量来实现对分类变量的预测。

然而,该模型也存在一些缺点,例如需要大量的数据来进行训练,以及对参数向量的解释不够直观。

多项逻辑斯蒂回归模型是一种广泛应用于分类问题的统计学方法。

它可以处理多个分类变量,并且可以对分类变量的概率分布进行建模。

在实际应用中,该模型被广泛应用于医学、社会科学、市场营销等领域。

逻辑斯蒂回归1.引⾔·解决响应变量为定性变量的情形。

⽐如⼀个候选⼈被分为“好”或“差”。

2.定性数据的建模·对响应变量取值的概率建模。

区间为[0,1]。

3. Logit模型·逻辑斯谛响应函数:刻画概率π与X之间的关系,逻辑斯谛分布函数构造:如果只有⼀个X变量,图形如下:·也可以利⽤其他分布函数来构造这种S型关系,⽐如,利⽤正态分布函数构造的模型称为probit模型。

⼀般认为逻辑斯谛模型更简单,性能更优。

·线性化:·⽤传统的最⼤似然法估计参数,计算的时候,采⽤迭代的⽅法求解。

è不像通常的OLS⽅法,逻辑斯谛回归没有精确解的表达式。

·解决问题的⼯具,不再是R2,t检验,F检验等,⽽是其他⽅法。

相应的假设检验帮也完全不同。

·信息准则如AIC和BIC还是适⽤的,可⽤于变量选择。

⽤拟合模型的对数替代原来的SSE。

4.例⼦:破产概率的估计·发现经营不善的⾦融商业机构是审计核查⼯作的重要职能。

· X系数的变化,logit变量的期望改变量有其他含义。

例如,固定X1和X3的值,X2的值增加⼀个单位,其概率π的优势为原来的eβ2 = e0.181 = 1.198倍,即增加了将近20%。

·某⼀变量X j改变时,在其他变量保持不变的情况下优势的变化率为eβj,若X j可以连续变化,此处的变化率的解释类似于可微函数的变化率。

当X j为只取0或1的⼆值变量时,eβj就是两个优势的⽐,称为优势⽐。

·优势⽐的置信区间不包含1,则这个变量对优势⽐的值会有显著影响;区间在1以下,当变量增⼤时,优势⽐的值会显著减⼩;区间在1以上,当变量增⼤时,优势⽐的值会显著增⼤。

·若查看变量联合起来对优势有没有影响,可以检验系数是否全部为0。

等价于多元回归分析中回归系数是否全为0的检验。

当变量联合起来对logit的值没有影响时,G的分布为χ2分布。

回归预测。

LR 模型多⽤用于解决⼆二分类问题,如⼴广告是否被点击(是/否)、商品是否被购买(是/否)等互联⽹网领域中常⻅见的应⽤用场景。

但是实际场景中,我们⼜又不不把它处理理成“绝对的”分类问题,⽽而是⽤用其预测值作为事件发⽣生的概率。

这⾥里里从事件、变量量以及结果的⻆角度给予解释。

我们所能拿到的训练数据统称为观测样本。

问题:样本是如何⽣生成的?⼀一个样本可以理理解为发⽣生的⼀一次事件,样本⽣生成的过程即事件发⽣生的过程。

对于0/1分类问题来讲,产⽣生的结果有两种可能,符合伯努利利试验的概率假设。

因此,我们可以说样本的⽣生成过程即为伯努利利试验过程,产⽣生的结果(0/1)服从伯努利利分布。

这⾥里里我们假设结果为1的概率为h θ(x ),结果为0的概率为1−h θ(x )。

那么对于第i 个样本,概率公式表示如下:P (y (i )=1|x (i );θ)=h θ(x (i ))P (y (i )=0|x (i );θ)=1−h θ(x (i ))将上⾯面两个公式合并在⼀一起,可得到第i 个样本正确预测的概率:P (y (i )|x (i );θ)=(h θ(x (i ))y (i ))·(1−h θ(x (i )))1−y (i )上式是对⼀一个样本进⾏行行建模的数据表达。

对于所有的样本,假设每条样本⽣生成过程独⽴立,在整个样本空间中(N 个样本)的概率分布(即似然函数)为:P (Y |X ;θ)=N∏i =1h θx (i )y (i )1−h θx (i )1−y (i )通过极⼤大似然估计(Maximum Likelihood Evaluation ,简称MLE )⽅方法求概率参数。

具体地,第三节给出了了通过随机梯度下降法(SGD )求参数。

2.2.3 概率解释(()(()))三、模型参数估计3.1 Sigmoid 函数上图所示即为sigmoid函数,它的输⼊入范围为−∞→+∞,⽽而值域刚好为(0,1),正好满⾜足概率分布为(0,1)的要求。

逻辑回归模型讲解逻辑回归(LogisticRegression)是一种用于解决分类问题的机器学习算法。

虽然名字中有“回归”这个词,但实际上逻辑回归是一种分类模型,用于预测离散型的输出变量。

它被广泛应用于各个领域,如医学、金融、市场营销和电子商务等。

什么是逻辑回归模型?逻辑回归模型的基本原理很简单,它通过一个线性方程的组合,将输入特征映射为一个介于0和1之间的值,表示属于某一类别的概率。

这个映射函数一般是一个Sigmoid函数,它的形式为:其中,表示输出变量的类别,表示输入特征,表示模型的参数。

逻辑回归模型的优势逻辑回归模型有以下几点优势:1.可解释性强逻辑回归模型的输出可以被解释为属于某一类别的概率,这使得模型的结果更容易被理解和解释。

与其他黑盒模型相比,逻辑回归模型更容易为我们提供关于影响结果的因素和它们的作用方式。

2.计算效率高逻辑回归模型的计算效率相对较高,特别是在处理大规模数据时。

由于逻辑回归模型只使用线性方程,它的复杂度较低,计算速度较快。

3.可解决多分类问题虽然逻辑回归模型本身是二分类模型,但可以通过一些技巧将其扩展到多分类问题。

例如,一对多(One-vs-Rest)和一对一(One-vs-One)方法。

逻辑回归模型的应用场景逻辑回归模型广泛应用于各个领域,包括但不限于以下几个方面:1.金融风控逻辑回归模型可以根据借款人的个人信息、资产情况和借贷历史等因素,预测其违约的风险,从而帮助金融机构进行风险评估和决策。

2.市场营销逻辑回归模型可以根据用户的个人信息、消费行为和兴趣偏好,预测用户是否对某个产品或服务感兴趣,从而帮助企业进行精准营销和推广。

3.医学诊断逻辑回归模型可以根据患者的临床特征和检查结果,预测患者是否患有某种疾病,从而帮助医生进行诊断和决策。

逻辑回归模型是一种常用的分类模型,具有可解释性强、计算效率高和可解决多分类问题等优势。

它在金融风控、市场营销和医学诊断等领域都有广泛应用。