MapReduce 原理与实践

- 格式:pptx

- 大小:4.47 MB

- 文档页数:25

运用实例简述mapreduce原理MapReduce是一种编程模型和模型化的方法,用于大规模数据集(如分布式文件系统)的并行处理。

它通常用于处理和转换大数据集,以进行数据挖掘、机器学习、数据库等领域的应用。

MapReduce原理的核心思想是将一个复杂的问题拆解成多个小问题,然后将小问题分配给多个处理器(可以是多个计算机或处理器),最后将处理结果汇总并生成最终结果。

这个过程主要包括两个阶段:Map阶段和Reduce阶段。

1.Map阶段:Map阶段的任务是将输入数据集分解为多个小的数据块,并对每个数据块进行处理,生成中间结果。

这个过程通常是一个用户定义的函数,它接受输入数据块并产生一组键-值对。

这些键-值对随后被合并并发送到Reduce阶段。

举个例子,假设我们要对一个大规模的文本文件进行词频统计。

Map阶段会将文本文件分解为单词,并对每个单词生成一个键值对(键为单词,值为该单词在文本中出现的次数)。

2.Reduce阶段:Reduce阶段的任务是将Map阶段产生的中间结果进行汇总,并执行用户定义的Reduce函数,对汇总后的键值对进行处理并生成最终结果。

Reduce函数通常也是用户自定义的函数,它接受一组键值对并产生一个输出结果。

同样以词频统计为例,Reduce阶段会对所有相同的单词进行计数,并将结果输出为一个新的文本文件,其中包含每个单词及其对应的频数。

MapReduce原理的优势在于它能够充分利用多台计算机或处理器的计算资源,实现大规模数据的并行处理。

同时,MapReduce还提供了简单易用的编程接口,使得用户可以轻松地处理大规模数据集。

在实际应用中,MapReduce已被广泛应用于各种领域,如数据挖掘、机器学习、数据库等。

通过MapReduce,我们可以轻松地处理和分析大规模数据集,从而获得更有价值的信息和知识。

需要注意的是,MapReduce原理并不是适用于所有类型的大规模数据处理任务。

对于一些特定的任务,可能需要使用其他类型的并行处理模型和方法。

MapReduce数据处理原理1. 概述MapReduce是一种用于大规模数据处理的编程模型,由Google首先提出并应用于分布式计算中。

它通过将大规模数据集划分为小的子集,并在多个计算节点上同时进行处理,从而实现高效的数据处理。

MapReduce的核心思想是将复杂的数据处理任务分解成简单的、可并行执行的任务。

2. 基本原理MapReduce模型基于两个基本操作:Map和Reduce。

下面将详细介绍这两个操作以及它们在数据处理中的作用。

2.1 Map操作Map操作是将输入数据集中的每个元素进行转换,并生成一个键值对集合作为输出。

具体来说,Map操作接受一个键值对作为输入,经过转换后输出一个新的键值对。

在Map操作中,用户需要自定义一个Map函数,该函数接受输入键值对作为参数,并根据具体需求进行转换操作。

在词频统计任务中,用户可以定义一个Map函数来将输入文本切分成单词,并为每个单词生成一个键值对(单词,1)。

2.2 Reduce操作Reduce操作是将经过Map操作后生成的键值对集合按照键进行分组,并对每个组进行聚合计算。

具体来说,Reduce操作接受一个键和与该键相关联的一组值作为输入,经过聚合计算后输出一个新的键值对。

在Reduce操作中,用户需要自定义一个Reduce函数,该函数接受输入键和与之相关联的值集合作为参数,并根据具体需求进行聚合计算。

在词频统计任务中,用户可以定义一个Reduce函数来对每个单词出现的次数进行累加。

2.3 数据流MapReduce模型通过Map和Reduce操作将数据流划分为三个阶段:输入阶段、中间阶段和输出阶段。

在输入阶段,原始数据集被划分成多个小的数据块,并分配给不同的计算节点进行处理。

每个计算节点上的Map操作并行处理自己分配到的数据块,并生成中间结果。

在中间阶段,所有计算节点上生成的中间结果被按照键进行分组,相同键的结果被发送到同一个Reduce操作所在的计算节点。

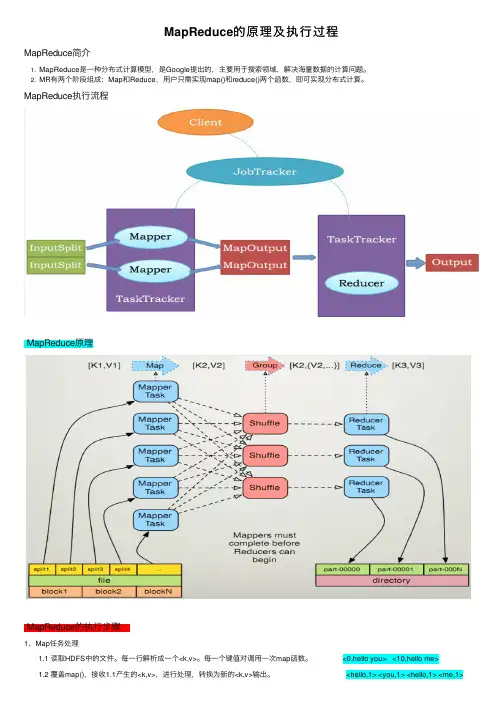

MapReduce的原理及执⾏过程MapReduce简介1. MapReduce是⼀种分布式计算模型,是Google提出的,主要⽤于搜索领域,解决海量数据的计算问题。

2. MR有两个阶段组成:Map和Reduce,⽤户只需实现map()和reduce()两个函数,即可实现分布式计算。

MapReduce执⾏流程MapReduce原理MapReduce的执⾏步骤:1、Map任务处理 1.1 读取HDFS中的⽂件。

每⼀⾏解析成⼀个<k,v>。

每⼀个键值对调⽤⼀次map函数。

<0,hello you> <10,hello me> 1.2 覆盖map(),接收1.1产⽣的<k,v>,进⾏处理,转换为新的<k,v>输出。

<hello,1> <you,1> <hello,1> <me,1> 1.3 对1.2输出的<k,v>进⾏分区。

默认分为⼀个区。

详见《》 1.4 对不同分区中的数据进⾏排序(按照k)、分组。

分组指的是相同key的value放到⼀个集合中。

排序后:<hello,1> <hello,1><me,1> <you,1> 分组后:<hello,{1,1}><me,{1}><you,{1}> 1.5 (可选)对分组后的数据进⾏归约。

详见《》2、Reduce任务处理 2.1 多个map任务的输出,按照不同的分区,通过⽹络copy到不同的reduce节点上。

(shuffle)详见《》 2.2 对多个map的输出进⾏合并、排序。

覆盖reduce函数,接收的是分组后的数据,实现⾃⼰的业务逻辑, <hello,2> <me,1> <you,1> 处理后,产⽣新的<k,v>输出。

mapreduce编程实验报告心得【实验报告心得】总结:本次mapreduce编程实验通过实际操作,使我对mapreduce编程框架有了更深入的理解。

在实验过程中,我学会了如何编写map和reduce函数,并利用这些函数从大数据集中进行数据提取和聚合分析。

通过这个实验,我还掌握了如何调试和优化mapreduce任务,以提高数据处理效率和性能。

一、实验目的:本次实验的目的是掌握mapreduce编程框架的使用方法,理解其实现原理,并在实际编程中熟练运用map和reduce函数进行数据处理和分析。

二、实验环境和工具:本次实验使用Hadoop分布式计算框架进行mapreduce编程。

使用的工具包括Hadoop集群、HDFS分布式文件系统以及Java编程语言。

三、实验过程:1. 实验准备:在开始实验前,我首先了解了mapreduce的基本概念和特点,以及Hadoop集群的配置和使用方法。

2. 实验设计:根据实验要求,我选择了一个适当的数据集,并根据具体需求设计了相应的map和reduce函数。

在设计过程中,我充分考虑了数据的结构和处理逻辑,以保证mapreduce任务的高效完成。

3. 实验编码:在实验编码过程中,我使用Java编程语言来实现map 和reduce函数。

我按照mapreduce编程模型,利用输入键值对和中间结果键值对来进行数据处理。

在编码过程中,我注意了代码的规范性和可读性,并进行了适当的优化。

4. 实验测试:完成编码后,我在Hadoop集群上部署和运行了我的mapreduce任务。

通过对数据集进行分析和处理,我验证了自己编写的map和reduce函数的正确性和性能。

5. 实验总结:在实验结束后,我对本次实验进行了总结。

我分析了实验中遇到的问题和挑战,并提出了相应的解决方法。

我还对mapreduce编程框架的优缺点进行了评估,并给出了自己的观点和建议。

四、实验结果和观点:通过本次实验,我成功实现了对选定数据集的mapreduce处理。

mapreduce编程模型的原理MapReduce编程模型的原理MapReduce是一种分布式计算模型,它可以将大规模数据集分成多个小数据集,然后在多个计算节点上并行处理这些小数据集,最后将结果合并成一个最终结果。

MapReduce编程模型的原理是将数据处理过程分成两个阶段:Map阶段和Reduce阶段。

Map阶段Map阶段是将输入数据集分成若干个小数据集,然后在多个计算节点上并行处理这些小数据集。

在Map阶段中,每个计算节点都会执行相同的Map函数,将输入数据集中的每个元素映射成一个键值对。

Map函数的输入是一个键值对,输出也是一个键值对。

Map 函数的输出会被分成若干个小数据集,然后传输到Reduce节点上。

Reduce阶段Reduce阶段是将Map阶段输出的若干个小数据集合并成一个最终结果。

在Reduce阶段中,每个计算节点都会执行相同的Reduce 函数,将Map阶段输出的若干个小数据集合并成一个最终结果。

Reduce函数的输入是一个键和一个值的列表,输出也是一个键和一个值的列表。

Reduce函数的输出会被合并成一个最终结果。

MapReduce编程模型的优点MapReduce编程模型的优点是可以处理大规模数据集,可以在多个计算节点上并行处理数据,可以容错,可以自动处理节点故障,可以自动处理数据分片和数据传输。

MapReduce编程模型的优点是可以处理大规模数据集,可以在多个计算节点上并行处理数据,可以容错,可以自动处理节点故障,可以自动处理数据分片和数据传输。

MapReduce编程模型的应用MapReduce编程模型的应用包括数据挖掘、机器学习、搜索引擎、图像处理、自然语言处理等领域。

MapReduce编程模型的应用可以处理大规模数据集,可以在多个计算节点上并行处理数据,可以容错,可以自动处理节点故障,可以自动处理数据分片和数据传输。

MapReduce编程模型的实现MapReduce编程模型的实现包括Hadoop、Spark、Flink等分布式计算框架。

MapReduce概述,原理,执⾏过程MapReduce概述 MapReduce是⼀种分布式计算模型,运⾏时不会在⼀台机器上运⾏.hadoop是分布式的,它是运⾏在很多的TaskTracker之上的. 在我们的TaskTracker上⾯跑的是Map或者是Reduce Task任务. 通常我们在部署hadoop taskTracker 的时候,我们的TaskTracker同时还是我们的Datanode节点.datanode和tasktracker总是部署在⼀起的. MapReduce执⾏流程: 为什么要有多个datanode: 因为我们的datanode是专门⽤来存储数据的,我们的数据很⼤,在⼀个节点上是存不下的,存不下的情况下,我们就把数据存放在多个节点上. MapReduce:分布式计算模型.把我们的程序代码分到所有的tasktracker节点上去运⾏.只处理当前datanode上的数据,datanode和程序代码都在⼀台机器上处理,避免了⽹络传输.我们的代码拿到tasktracker上去执⾏,我们的tasktracker执⾏的数据来源于datanode,我们的程序就把各个datanode上的数据给处理了. reduce汇总的是这种map的输出,map处理的数据来⾃于datanode,但是map程序处理后的结果不⼀定放在datanode中,可以放到linux磁盘.reduce处理的数据来⾃于各个数据处理节点的linux磁盘.reduce处理完之后的输出放到datanode上.如果有节点空闲,reduce节点就在空闲节点上运⾏,如果都跑程序,就随机⼀个节点跑reducetasktracker处理的任务都是来⾃于datanode,处理数据是并⾏的.map处理完之后结果放到linux磁盘上.r educe程序的处理,是把map处理后linux磁盘上的数据都汇总到reduce节点处理,reduce处理完之后,将结果输出到datanode上. 我们的数据是放在hdfs中,hdfs决定把数据是放在哪个datanode上的,决定的权利不在于我们的处理,⽽是在于hdfs.到底放在哪个datanode 上不需要我们去关⼼. datanode有副本,数据在进⾏存储的时候,是把数据放到多个datanode上. 并⾏处理数据,把我们处理问题的应⽤程序放到各个存放数据的节点上进⾏处理,处理完之后获得的是每⼀个本地的数据,通过redcue把各个本地的数据进⾏汇总起来,就得到⼀个最终的结果.reduce可以有多个. 原来集中式的数据处理⽅式,缺点是海量数据移动到⼀个数据处理节点上,程序运⾏的⼤量时间消耗在⽹络传输上.串⾏,性能不好. 把计算程序放到存储数据的各个节点上并⾏执⾏.map程序计算本地节点的数据,并⾏结束后,会有很多的中间结果,reduce程序是把Map程序运⾏的中间结果汇总到⼀起,作为最终结果.原来的这种处理数据的⽅式,是把应⽤程序放到⼀个地⽅,然后海量的数据不断的往这个应⽤上挪,它的⼤量时间消耗在⽹络传输上还有磁盘的io上.程序处理起来并不复杂,因为数据量太⼤,所以把时间都耗费到这上⾯了. 我们改进⾏⼀下计算⽅法,把我们的⼩程序放到各个的数据节点上,map程序就去处理本机的数据,每⼀个map程序都去处理本机的数据,处理完之后,会得到多个中间结果.map处理本地操作可以节省⽹络传输,在本地就可以把数据处理了.map程序适合于计算的本地化.我们的Reduce程序不能实现计算的本地化,因为是汇总map的输出,map的输出必然会分布在很多的机器上. 我们的map是放在各个tasktracker上去执⾏的,就是把各个tasktracker的本地数据给处理掉,处理后会得到⼀个中间结果,reduce程序就会各个map处理的结果给汇总起来,mapreduce在这⾥就是这么⼀个过程,map是处理各个节点的.reduce是汇总map输出的. MapReduce是⼀个分布式计算模型,主要是⽤来处理海量数据的. MapReduce原理: MapReduce计算模型包括Map和Reduce两个阶段,我们⽤户只需要处理map阶段和reduce阶段就⾏了. 1) map⽤来处理本机数据,在处理本地的数据时,需要想我的数据存放在本机的什么位置,我要进⾏什么样的计算,计算结果我要放在本机的什么位置.这些东西都是由mapreduce框架给我们实现的,数据在哪,我们只需要知道hdfs就⾏了,数据处理之后的中间结果放在哪,这个也是mapreduce框架给我们做的,我们⾃⼰不需要管. 2) reduce是把map输出的结果给汇总到⼀起,map输出的结果在哪,怎样传输到reduce中,我们开发⼈员也不需要管,我们只需要管数据汇总这⼀件事就可以了,处理之后的结果,只需要再写进hdfs中就可以了,别的就不需要管了. 所以我们实现⼀个分布式计算还是⽐较简单的,这⾥边我们关⼼的是我们map处理的数据来⾃于hdfs,处理之后⼜会写出到中间结果,reduce程序⼜会把我们的中间结果的数据拿过来进⾏处理.处理完成之后⼜会把结果写出到hdfs中,在处理的过程中是在不断的传输数据,数据传输的的⽅式是采⽤键值(key,value)对的形式.键值对也就是我们两个函数的形参,输⼊参数.MapReduce执⾏流程: Mapper任务处理的数据位于各个程序上的,处理完之后,会产⽣⼀个中间的输出,Reduce就是专门处理Mapper产⽣的中间输出的.reduce 处理完之后,就会把结果作为⼀个中间结果输出出来.Map任务和Reduce任务到底在那个TaskTracker上去执⾏,什么样的tasktracker执⾏map 任务,什么样的taskTracker去执⾏Reduce任务,这个事不需要我们去关⼼,是框架中的JobTracker管理的.Jobtracker它⾥边的这个程序来⾃于客户的提交.客户把我们的程序提交给Jobtracker之后,⽤户就不需要参与了,JobTracker就会⾃动把我们的程序分配到TaskTracker上去执⾏,有的tasktracker上跑map,有的taskTracker上跑reduce.Map程序读数据来⾃于hdfs,我们只需要告诉是哪个⽂件的路径就可以了,别的不需要我们去管.MapReduce就会把我们的程序⾃动的运⾏,把原始的数据处理完产⽣中间数据,然后在处理,最终就会产⽣⼀个最终的结果,⽤户看到的其实是最后的reduce输出结果.map任务处理完之后产⽣的数据位于我们各个节点本地的,也就是我们linux磁盘,⽽不是位于hdfs中.会起多个reduce任务,每个reduce任务会取每个map任务对应的数据,这样reduce就会把各个map任务的需要的数据给拿到. map和reduce之间数据分发的过程称作shuffle过程,shuffle在细节中:map数据产⽣之后需要进⾏分区,每个reduce处理的数据就是不同map分区下的数据.reduce就会把所有map分区中的数据处理完之后写出到磁盘中. 按官⽅的源码步骤讲会把shuffle归结为reduce阶段,map到reduce数据分发的过程叫做shuffle. shuffle是把我们map中的数据分发到reduce中去的⼀个过程. reduce执⾏完之后就直接结束了,直接写出去.不会经过Jobtracker,但是会通知Jobtracker运⾏结束. 有⼏个reduce就有⼏个shuffle分发的过程. map它只做本机的处理,处理完之后,是由reduce做汇总的.会读取所有map中相同分区中的数据,所以shuffle可以认为是reduce的⼀部分,因为map执⾏完之后就已经结束了. 汇总节点是主动去其他节点要数据.reduce这个节点其实是知道各个map的,⼀些map执⾏完之后,会把数据写到本地linux磁盘,那么我们的reduce就会通过http的协议把map端处理后的数据要过来. JobTracker是管理者,TaskTracker是⼲活的,TaskTracker分map任务和reduce任务,那么map任务运⾏完成之后,会告诉JobTracker我写完了,JobTracker⼀看map写完之后,就会在⼀个TaskTracker起⼀个Reduce任务,把他们这些执⾏完毕之后的map任务的地址告诉reduce,reduce 就会通过http协议去map那读取数据.理解这些东西需要有JobTracker做管理,只要是出现他们之间做协调的时候,全部都是JobTracker做协调,管理的.哪个机器承担reduce任务也是JobTracaker在接到任务之后分配好了的.因为TasktTracker只是⼯作者,本⾝没有思考能⼒的,只有JobTracker有思考能⼒. JobTracker分配的原理:在存储数据的节点上起map任务,jobTracker怎么会知道哪些节点存放数据呢这个需要问namenode,namenode会知道哪些Datanode会存放数据. 要处理的⽂件被划分为多少个block就会有多少个map.JobTracker 没有存储任何东西,只是⼀个管理⾓⾊. map在输出的时候会确定分成多少个区对应的就会有多少个reduce任务,数据分发的时候就会由shuffle的这个过程进⾏分发.所以说按道理来讲的话,reduce分区的数量应该有map分区的数量来决定的. map的个数由inputSplit的个数决定的.因为inputSplit的⼤⼩默认和block的⼤⼩⼀样的. hadoop的⼀个特点就是⾼容错性,JobTracker会监控各个节点的map任务和reduce任务的执⾏情况,如果有⼀个map任务宕了,会启⽤⼀个重启机制,会再重启⼀个mapper任务去执⾏.如果连续宕个三次左右,就不会重启了.那么这个程序的整个运⾏就失败了.会有⼀定的容错性在⾥边的,这个容错性是由JobTracker来进⾏控制的. map处理其他节点的block,我们⽤户是没法控制的. 有datanode的节点杀死Tasktracker,我们的程序在运⾏的时候只能使⽤其他节点的block了.我们的处理的原始数据,不允许被很多的map任务处理,只允许被⼀个处理,我们的数据是分配到多个dataNode上的,那么这⼀个map势必要读取其他节点的block. MapReduce的执⾏过程: 1.map任务处理: 1.1 读取hdfs⽂件为内容,把内容中的每⼀⾏解析成⼀个个的键(key)值(value)对.⽂件总是有⾏的,键是字节的偏移量,值是每⼀⾏的内容,每⼀个键值对调⽤⼀次map函数.map函数处理输⼊的每⼀⾏. 1.2 ⾃定义map函数,写⾃⼰的逻辑,对输⼊的key,value(把每⼀⾏解析出的key,value)处理,转换成新的key,value输出. 1.3 对输出的key,value进⾏分区.根据业务要求,把map输出的数据分成多个区.. 1.4 对不同分区上的数据,按照key进⾏排序,分组.相同key的value放到⼀个集合中. 1.5 把分组后的数据进⾏归约. 2.reduce任务处理: shuffle:把我们map中的数据分发到reduce中去的⼀个过程,分组还是在map这边的. 2.1 每个reduce会接收各个map中相同分区中的数据.对多个map任务的输出,按照不同的分区通过⽹络copy到不同reduce节点.shuffle实际指的就是这个过程. 2.2 对多个map任务的输出进⾏合并,排序.写reduce函数⾃⼰的逻辑,对输⼊的key,value处理,转换成新的key,value输出. 2.3 把reduce的输出保存到新的⽂件中. TaskTracker节点上如果跑的是map任务,我们的map任务执⾏完之后,就会告诉我们的JobTracker执⾏完毕,把这个数据让我们的reduce来读取.读取的时机是⼀个map执⾏完毕之后让reduce去处理获取数据. JobTracker只做管理和通知,数据只在map和reduce之间流动,准确的说,只会在TaskTracker之间流动. 排序是框架内置的.默认就有.分组不是减少⽹络开销,分组不是合并,只是把相同的key的value放到⼀起,并不会减少数据. 分组是给了同⼀个map中相同key的value见⾯的机会.作⽤是为了在reduce中进⾏处理. map函数仅能处理⼀⾏,两⾏中出现的这个单词是⽆法在⼀个map中处理的.map不能处理位于多⾏中的相同的单词.分组是为了两⾏中的相同的key的value合并到⼀起. 在⾃定义MyMapper类内部定义HashMap处理的是⼀个block,在map⽅法内部定义处理的是⼀⾏. 在hadoop全局中不会有线程问题,因为hadoop起的是进程,不会有并发问题存在. 为什么hadoop不使⽤线程? 线程实际指的是在集中式开发下,通过线程,可以让我们的并发量,处理的吞吐量上升,线程会带来⼀个数据竞争的问题.hadoop中MapReduce是通过分布式多进程来实现⾼吞吐量,在⾥边不会通过线程来解决问题,因为它⾥边已经有很多的服务器,很多的线程了,没有必要使⽤线程.。

MapReduce和HBase实训自我总结1.引言在进行M ap Re du ce和H Ba se实训后,我深入了解了这两个关键技术对大数据处理和存储的重要性。

本文将总结我在实训中的学习和体验,包括M ap Re du ce的基本原理和应用场景,H B as e的特点和使用方法,以及我在实训中遇到的挑战和解决方案。

2. Ma pReduce的原理和应用2.1M a p R e d u c e的概念M a pR ed uc e是一种分布式计算框架,由G oo gl e公司提出,用于解决大规模数据处理和分析的问题。

其基本原理是将任务分解成多个M ap和R e du ce阶段,通过并行计算和数据分片来提高处理效率。

2.2M a p R e d u c e的应用场景M a pR ed uc e广泛应用于大数据处理和分析,特别适合以下场景:-数据清洗和转换:通过Ma pR ed uc e可以对原始数据进行过滤、清洗和转换,提取出有用的信息;-数据聚合和统计:M a pR ed uc e可以实现大规模数据的聚合和统计,例如计算平均值、查找最大值等;-倒排索引:Ma p R edu c e可以快速构建倒排索引,用于搜索引擎等应用;-图计算:M ap Re du ce可以高效地进行图计算,例如P ag eR an k算法等。

3. HB ase的特点和使用方法3.1H B a s e的概念和特点H B as e是一种分布式、可扩展、面向列的N oS QL数据库,基于H a do op的H DF S存储。

其特点包括:-高可靠性:HB as e通过数据的冗余存储和自动故障转移来保证数据的可靠性;-高性能:H Ba se支持快速读写和随机访问,适用于实时查询和写入场景;-水平扩展:HB as e可以通过增加节点来实现数据的水平扩展,适应不断增长的数据量;-灵活的数据模型:H B as e提供灵活的表结构和丰富的数据类型支持,适用于各种数据存储需求。

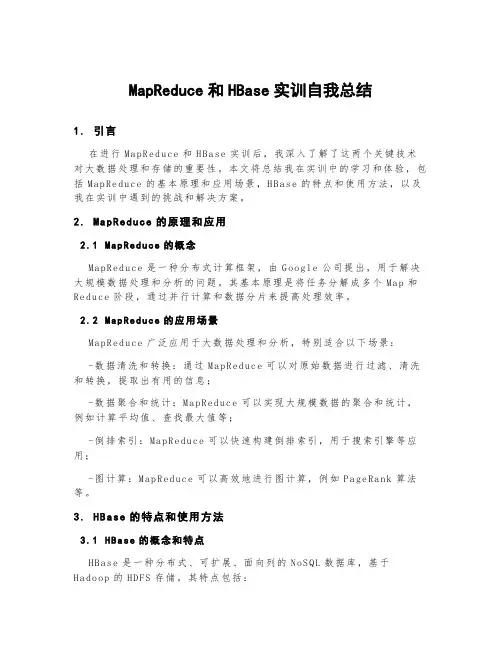

【原创】MapReduce运⾏原理和过程⼀.Map的原理和运⾏流程Map的输⼊数据源是多种多样的,我们使⽤hdfs作为数据源。

⽂件在hdfs上是以block(块,Hdfs上的存储单元)为单位进⾏存储的。

1.分⽚我们将这⼀个个block划分成数据分⽚,即Split(分⽚,逻辑划分,不包含具体数据,只包含这些数据的位置信息),那么上图中的第⼀个Split则对应两个个⽂件块,第⼆个Split对应⼀个块。

需要注意的是⼀个Split只会包含⼀个File的block,不会跨⽂件。

2. 数据读取和处理当我们把数据块分好的时候,MapReduce(以下简称mr)程序将这些分⽚以key-value的形式读取出来,并且将这些数据交给⽤户⾃定义的Map函数处理。

3.⽤户处理完这些数据后同样以key-value的形式将这些数据写出来交给mr计算框架。

mr框架会对这些数据进⾏划分,此处⽤进⾏表⽰。

不同颜⾊的partition矩形块表⽰为不同的partition,同⼀种颜⾊的partition最后会分配到同⼀个reduce节点上进⾏处理。

Map是如何将这些数据进⾏划分的?默认使⽤Hash算法对key值进⾏Hash,这样既能保证同⼀个key值的数据划分到同⼀个partition中,⼜能保证不同partition的数据梁是⼤致相当的。

总结:1.⼀个map指挥处理⼀个Split2.map处理完的数据会分成不同的partition3.⼀类partition对应⼀个reduce那么⼀个mr程序中 map的数量是由split的数量决定的,reduce的数量是由partiton的数量决定的。

⼆.ShuffleShuffle,翻译成中⽂是混洗。

mr没有排序是没有灵魂的,shuffle是mr中⾮常重要的⼀个过程。

他在Map执⾏完,Reduce执⾏前发⽣。

Map阶段的shuffle数据经过⽤户⾃定的map函数处理完成之后,数据会放⼊内存中的环形缓冲区之内,,他分为两个部分,数据区和索引区。

mapreduce实验报告总结一、引言MapReduce是一种用于处理和生成大数据集的编程模型和模型化工具,它由Google提出并广泛应用于各种大数据处理场景。

通过MapReduce,我们可以将大规模数据集分解为多个小任务,并分配给多个计算节点并行处理,从而大大提高了数据处理效率。

在本实验中,我们通过实践操作,深入了解了MapReduce的工作原理,并尝试解决了一些实际的大数据处理问题。

二、实验原理MapReduce是一种编程模型,它通过两个核心阶段——Map阶段和Reduce阶段,实现了对大规模数据的处理。

Map阶段负责处理输入数据集中的每个元素,生成一组中间结果;Reduce阶段则对Map阶段的输出进行汇总和聚合,生成最终结果。

通过并行处理和分布式计算,MapReduce可以在大量计算节点上高效地处理大规模数据集。

在本实验中,我们使用了Hadoop平台来实现MapReduce模型。

Hadoop是一个开源的分布式计算框架,它提供了包括MapReduce在内的一系列数据处理功能。

通过Hadoop,我们可以方便地搭建分布式计算环境,实现大规模数据处理。

三、实验操作过程1.数据准备:首先,我们需要准备一个大规模的数据集,可以是结构化数据或非结构化数据。

在本实验中,我们使用了一个包含大量文本数据的CSV文件。

2.编写Map任务:根据数据处理的需求,我们编写了一个Map任务,该任务从输入数据集中读取文本数据,提取出关键词并进行分类。

3.编写Reduce任务:根据Map任务的输出,我们编写了一个Reduce任务,该任务将相同关键词的文本数据进行汇总,生成最终结果。

4.运行MapReduce作业:将Map和Reduce任务编译成可执行脚本,并通过Hadoop作业调度器提交作业,实现并行处理。

5.数据分析:获取处理后的结果,并进行数据分析,以验证数据处理的有效性。

四、实验结果与分析实验结束后,我们得到了处理后的数据结果。

Hadoop化繁为简探索Mapreduce简要原理与实践_光环大数据培训目录-探索mapreduce1、Mapreduce的模型简介与特性?Yarn的作用?2、mapreduce的工作原理是怎样的?3、配置Yarn与Mapreduce、演示Mapreduce例子程序4、javaApi开发Mapreduce程序发散思考-入门mapreduce思考题:假设有一个长度为1000万的int数组,求数组数据长度。

答:如果是应试考试,你说觉得太简单了吧,一个for循环就搞定。

可是,它是一个面试,你如何通过解决这一个问题就脱颖而出呢?凡是,大数据量计算一定要向多线程方向去靠。

思考题:设计一个解决方案,把分布在四台机器上的数据报表统计出来。

数据向计算靠近:把数据网络传输全部汇总在一起,然后用应用程序计算。

算结果汇总。

mapreduce简介mapreduce就是将存储在分布式文件系统hdfs的一个大规模数据集,会被切分许多个独立的小数据块,这些小数据块可以被多个Map任务并行处理。

mapreduce特性:分布式存储、工作调度、负载均衡、容错处理、网络通信。

mapreduce设计理念:计算向数据靠拢、“分而治之”。

Yarn被称为调度引擎,那怎么个调度法?答:假设你已经了解Hdfs文件系统,当客户端提交一个计算任务给hadoop集群,Master(NameNode)会先拆分计算任务,那么怎么把任务分配给空闲机器呢?那怎么识别空闲机器呢?这些任务就交给Yarn这个调度引擎处理。

如果你对Hadoop的环境部署、分布式文件系统还为入门,可参照下述文章:mapreduce工作流程举例:计算文件中单词出现的次数,我们可以用抽象的思维假设它是一个超级超级大的文件。

注:我的机器的物理架构是一个Master、三个Slave,如上图所示。

此处暂且不讨论Block与InputSplit的关系。

Master负责协调调度作业,Slave负责执行Map、Reduce任务。

CSDN 实验5 MapReduce初级编程实践一、实验背景在大数据时代,数据处理是非常重要的任务。

MapReduce是一种用于处理大规模数据集的编程模型,它可以有效地分解任务并进行并行化处理。

通过MapReduce编程,可以实现大规模数据的分布式处理,提高数据处理的效率和速度。

二、实验目的本实验旨在让学生掌握MapReduce的基本原理和编程方法,通过实际的编程操作,运用MapReduce处理大规模数据集,并理解MapReduce在数据处理中的重要作用。

三、实验内容1. 环境准备在进行MapReduce编程之前,需要搭建好相应的开发环境。

首先需要安装Hadoop,搭建Hadoop集裙环境。

然后安装MapReduce程序的开发工具,如Eclipse等。

2. 编程任务任务一:WordCount编写一个简单的MapReduce程序,对给定的文本文件进行词频统计,统计每个单词出现的次数。

任务二:InvertedIndex编写一个MapReduce程序,对给定的文本文件进行倒排索引生成。

将每个单词与出现该单词的文档进行关联,生成倒排索引表。

任务三:TopN编写一个MapReduce程序,对给定的数据集中找出出现频率最高的前N个单词。

3. 实验步骤步骤一:环境搭建在实验开始前,搭建好Hadoop集裙环境,安装并配置MapReduce 程序的开发环境。

步骤二:WordCount编程根据给定的文本文件,编写MapReduce程序,实现对文本中单词出现次数的统计。

步骤三:InvertedIndex编程编写MapReduce程序,实现对文本中单词的倒排索引生成。

步骤四:TopN编程编写MapReduce程序,实现对文本中出现频率最高的前N个单词的统计。

步骤五:程序调试与测试编写完毕MapReduce程序后,进行程序的调试与测试,确保程序运行正确并得到期望的结果。

四、实验总结通过本次实验,我深入理解了MapReduce的编程模型和原理。

实验6:Mapreduce实例——WordCount实验⽬的1.准确理解Mapreduce的设计原理2.熟练掌握WordCount程序代码编写3.学会⾃⼰编写WordCount程序进⾏词频统计实验原理MapReduce采⽤的是“分⽽治之”的思想,把对⼤规模数据集的操作,分发给⼀个主节点管理下的各个从节点共同完成,然后通过整合各个节点的中间结果,得到最终结果。

简单来说,MapReduce就是”任务的分解与结果的汇总“。

1.MapReduce的⼯作原理在分布式计算中,MapReduce框架负责处理了并⾏编程⾥分布式存储、⼯作调度,负载均衡、容错处理以及⽹络通信等复杂问题,现在我们把处理过程⾼度抽象为Map与Reduce两个部分来进⾏阐述,其中Map部分负责把任务分解成多个⼦任务,Reduce部分负责把分解后多个⼦任务的处理结果汇总起来,具体设计思路如下。

(1)Map过程需要继承org.apache.hadoop.mapreduce包中Mapper类,并重写其map⽅法。

通过在map⽅法中添加两句把key值和value值输出到控制台的代码,可以发现map⽅法中输⼊的value值存储的是⽂本⽂件中的⼀⾏(以回车符为⾏结束标记),⽽输⼊的key值存储的是该⾏的⾸字母相对于⽂本⽂件的⾸地址的偏移量。

然后⽤StringTokenizer类将每⼀⾏拆分成为⼀个个的字段,把截取出需要的字段(本实验为买家id字段)设置为key,并将其作为map⽅法的结果输出。

(2)Reduce过程需要继承org.apache.hadoop.mapreduce包中Reducer类,并重写其reduce⽅法。

Map过程输出的<key,value>键值对先经过shuffle过程把key值相同的所有value值聚集起来形成values,此时values是对应key字段的计数值所组成的列表,然后将<key,values>输⼊到reduce⽅法中,reduce⽅法只要遍历values并求和,即可得到某个单词的总次数。

实验五MapReduce实验:单词计数5.1 实验目的基于MapReduce思想,编写WordCount程序。

5.2 实验要求1.理解MapReduce编程思想;2.会编写MapReduce版本WordCount;3.会执行该程序;4.自行分析执行过程。

5.3 实验原理MapReduce是一种计算模型,简单的说就是将大批量的工作(数据)分解(MAP)执行,然后再将结果合并成最终结果(REDUCE)。

这样做的好处是可以在任务被分解后,可以通过大量机器进行并行计算,减少整个操作的时间。

适用范围:数据量大,但是数据种类小可以放入内存。

基本原理及要点:将数据交给不同的机器去处理,数据划分,结果归约。

理解MapReduce和Yarn:在新版Hadoop中,Yarn作为一个资源管理调度框架,是Hadoop下MapReduce程序运行的生存环境。

其实MapRuduce除了可以运行Yarn 框架下,也可以运行在诸如Mesos,Corona之类的调度框架上,使用不同的调度框架,需要针对Hadoop做不同的适配。

一个完成的MapReduce程序在Yarn中执行过程如下:(1)ResourcManager JobClient向ResourcManager提交一个job。

(2)ResourcManager向Scheduler请求一个供MRAppMaster运行的container,然后启动它。

(3)MRAppMaster启动起来后向ResourcManager注册。

(4)ResourcManagerJobClient向ResourcManager获取到MRAppMaster相关的信息,然后直接与MRAppMaster进行通信。

(5)MRAppMaster算splits并为所有的map构造资源请求。

(6)MRAppMaster做一些必要的MR OutputCommitter的准备工作。

(7)MRAppMaster向RM(Scheduler)发起资源请求,得到一组供map/reduce task 运行的container,然后与NodeManager一起对每一个container执行一些必要的任务,包括资源本地化等。

MapReduce基本原理及应⽤⼀:MapReduce模型简介 MapReduce将复杂的、运⾏于⼤规模集群上的并⾏计算过程⾼度地抽象到了两个函数:Map和Reduce。

它采⽤“分⽽治之”策略,⼀个存储在分布式⽂件系统中的⼤规模数据集,会被切分成许多独⽴的分⽚(split),这些分⽚可以被多个Map任务并⾏处理 1.Map和Reduce函数Map和Reduce 2.MapReduce体系结构 MapReduce体系结构主要由四个部分组成,分别是:Client、JobTracker、TaskTracker以及Task 1)Client ⽤户编写的MapReduce程序通过Client提交到JobTracker端⽤户可通过Client提供的⼀些接⼝查看作业运⾏状态 2)JobTracker JobTracker负责资源监控和作业调度 JobTracker 监控所有TaskTracker与Job的健康状况,⼀旦发现失败,就将相应的任务转移到其他节点 JobTracker 会跟踪任务的执⾏进度、资源使⽤量等信息,并将这些信息告诉任务调度器(TaskScheduler),⽽调度器会在资源出现空闲时, 选择合适的任务去使⽤这些资源 3)TaskTracker TaskTracker 会周期性地通过“⼼跳”将本节点上资源的使⽤情况和任务的运⾏进度汇报给JobTracker,同时接收JobTracker 发送过来的命令并执⾏相应的操作(如启动新任务、杀死任务等) TaskTracker 使⽤“slot”等量划分本节点上的资源量(CPU、内存等)。

⼀个Task 获取到 ⼀个slot 后才有机会运⾏,⽽Hadoop调度器的作⽤就是将各个TaskTracker上的空闲slot分配给Task使⽤。

slot 分为Map slot 和Reduce slot 两种,分别供MapTask 和Reduce Task 使⽤ 4)Task Task 分为Map Task 和Reduce Task 两种,均由TaskTracker 启动 3.MapReduce⼯作流程 1) ⼯作流程概述不同的Map任务之间不会进⾏通信不同的Reduce任务之间也不会发⽣任何信息交换⽤户不能显式地从⼀台机器向另⼀台机器发送消息所有的数据交换都是通过MapReduce框架⾃⾝去实现的 2) MapReduce各个执⾏阶段 4.MapReduce应⽤程序执⾏过程⼆:WordCount运⾏实例 ⼯作流程是Input从HDFS⾥⾯并⾏读取⽂本中的内容,经过MapReduce模型,最终把分析出来的结果⽤Output封装,持久化到HDFS中 <⼀>WordCount的Map过程 1、使⽤三个Map任务并⾏读取三⾏⽂件中的内容,对读取的单词进⾏map操作,每个单词都以<key, value>形式⽣成 2.Map端源码public class WordMapper extendsMapper<Object, Text, Text, IntWritable> {private final static IntWritable one = new IntWritable(1);private Text word = new Text();public void map(Object key, Text value, Context context)throws IOException, InterruptedException {String line = value.toString();StringTokenizer itr = new StringTokenizer(line);while (itr.hasMoreTokens()) {word.set(itr.nextToken().toLowerCase());context.write(word, one);}}} <⼆>、WordCount的Reduce过程 1、Reduce操作是对Map的结果进⾏排序、合并等操作最后得出词频 2、Reduce端源码public class WordReducer extendsReducer<Text, IntWritable, Text, IntWritable> {private IntWritable result = new IntWritable();public void reduce(Text key, Iterable<IntWritable> values,Context context) throws IOException, InterruptedException {int sum = 0;for (IntWritable val : values) {sum += val.get();}result.set(sum);context.write(key, new IntWritable(sum));}}三:WordCount源码import java.io.IOException;import java.util.StringTokenizer;import org.apache.hadoop.conf.Configuration;import org.apache.hadoop.fs.Path;import org.apache.hadoop.io.IntWritable;import org.apache.hadoop.io.Text;import org.apache.hadoop.mapreduce.Job;import org.apache.hadoop.mapreduce.Mapper;import org.apache.hadoop.mapreduce.Reducer;import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;import org.apache.hadoop.util.GenericOptionsParser;public class WordCount {public static class WordMapper extendsMapper<Object, Text, Text, IntWritable> {private final static IntWritable one = new IntWritable(1);private Text word = new Text();public void map(Object key, Text value, Context context)throws IOException, InterruptedException {String line = value.toString();StringTokenizer itr = new StringTokenizer(line);while (itr.hasMoreTokens()) {word.set(itr.nextToken().toLowerCase());context.write(word, one);}}}public static class WordReducer extendsReducer<Text, IntWritable, Text, IntWritable> {private IntWritable result = new IntWritable();public void reduce(Text key, Iterable<IntWritable> values,Context context) throws IOException, InterruptedException { int sum = 0;for (IntWritable val : values) {sum += val.get();}result.set(sum);context.write(key, new IntWritable(sum));}}public static void main(String[] args) throws Exception {Configuration conf = new Configuration();String[] otherArgs = new GenericOptionsParser(conf, args).getRemainingArgs();if (otherArgs.length != 2) {System.err.println("Usage: wordcount <in> <out>");System.exit(2);}Job job = new Job(conf, "word count");job.setJarByClass(WordCount.class);job.setMapperClass(WordMapper.class);job.setCombinerClass(WordReducer.class);job.setReducerClass(WordReducer.class);job.setOutputKeyClass(Text.class);job.setOutputValueClass(IntWritable.class);FileInputFormat.addInputPath(job, new Path(otherArgs[0]));FileOutputFormat.setOutputPath(job, new Path(otherArgs[1]));System.exit(job.waitForCompletion(true) ? 0 : 1);}}。

MapReduce数据处理原理一、概述在大数据时代,数据处理变得越来越重要。

MapReduce是一种经典的数据处理模型,它以其高效、可扩展和容错等特点被广泛应用于分布式数据处理。

本文将详细介绍MapReduce的原理,包括其基本概念、流程、组成部分以及实现方式等。

二、MapReduce基本概念MapReduce是一种将大规模数据集并行处理的编程模型。

它由两个阶段组成,即Map阶段和Reduce阶段。

在Map阶段中,原始数据被切分成若干个小数据块,然后通过Map函数进行处理;在Reduce阶段中,Map阶段的输出被分类整理并传递给Reduce函数进行进一步处理。

下面我们将详细介绍MapReduce的基本概念。

2.1 Map函数Map函数是MapReduce的核心部分之一。

它接收一个输入键值对,将其转换为若干个中间键值对。

通常情况下,Map函数的输入是一行文本,输出是零个或多个中间结果。

2.2 Reduce函数Reduce函数是MapReduce的另一个核心部分。

它接收同一个键的多个值,并将它们聚合为一个或多个结果。

Reduce函数的输入是一个键和与该键相关的一个或多个值,输出是最终的结果。

2.3 MapReduce过程MapReduce过程由Map阶段和Reduce阶段组成。

首先,在Map阶段中,原始数据被切分成若干个小数据块,每个小数据块由一个Map任务处理。

然后,Map任务对每个小数据块分别执行Map函数,生成中间键值对。

接着,在Reduce阶段中,中间结果被分类整理,并根据键进行排序。

每个键及其相关的值被传递给一个或多个Reduce任务,Reduce任务通过Reduce函数将多个值聚合为一个或多个结果。

三、MapReduce过程详解3.1 数据划分在MapReduce过程中,原始数据被划分成若干个小数据块,每个小数据块由一个Map任务处理。

数据划分的目的是将原始数据分解成多个小块,使得每个Map任务可以并行处理自己的数据。