数学建模-主成分分析法模板

- 格式:docx

- 大小:27.30 KB

- 文档页数:5

针对问题三,本文首先对主要风险因子进行了灰色预测,计算出未来几年水资源总量、降水量、平均气温、生活用水量、工业用水量。

然后采用问题二中的BP神经网络预测每年的缺水量。

最后通过整合往年的数据,运用问题二中的熵值取权的模糊评价模型预测出未来几年内水资源短缺的风险等级。

由于考虑到降水量和地下储水相关系数高,我们依据历年的降水量估测出平水年,偏枯年,枯水年三种不同年份的水资源总量,并应用问题二的风险评价模型进行评估,得到三种不同年份水资源短缺风险等级依次为高,较高,较低。

最后我们分析了南水北调工程对北京市未来两年水资源短缺的风险等级影响,风险等级依次变为低,偏低,无。

针对问题四,我们从北京市水资源现状及分析、北京市严重缺水的原因探究、北京市水资源开发利用对策三个层面向相关行政主管部门提交建议报告,以求帮助其合理规避水资源短缺风险。

关键字:水资源短缺风险、灰色关联度分析、主成分分析,模糊综合评价、BP 神经网络、熵值取权一、问题重述1.1 问题背景水是生命之源,万物之本,是人类生存和发展不可或缺的物质,是地球上最普遍、最常见同时也是最珍贵的自然资源。

水是人类一切生产活动的基础,有水的地方欣欣向荣,水资源枯竭的地方则文明消失。

长期以来,我们注重经济社会发展,却忽略了水资源的承载能力,注重水资源开发利用,却没有同等重视节约和保护。

随着经济社会发展,1.2 问题重述水资源短缺危险泛指在特定的时空环境下,由于来水和用水的不确定性,室区域水资源系统发生供水短缺的可能性以及有此产生的损失。

近年来我国水资源短缺问题日趋严重,以北京市为例,北京是世界上水资源严重缺乏的大都市之一,属严重缺水地区。

虽然政府采取了一些列措施,如南水北调工程建设, 建立污水处理厂,产业结构调整等。

但是,气候变化和经济社会不断发展,水资源短缺风险始终存在。

如何对水资源风险的主要因子进行识别,对风险造成的危害等级进行划分,对不同风险因子采取相应的有效措施规避风险或减少其造成的危害,这对社会经济的稳定、可持续发展战略的实施具有重要的意义。

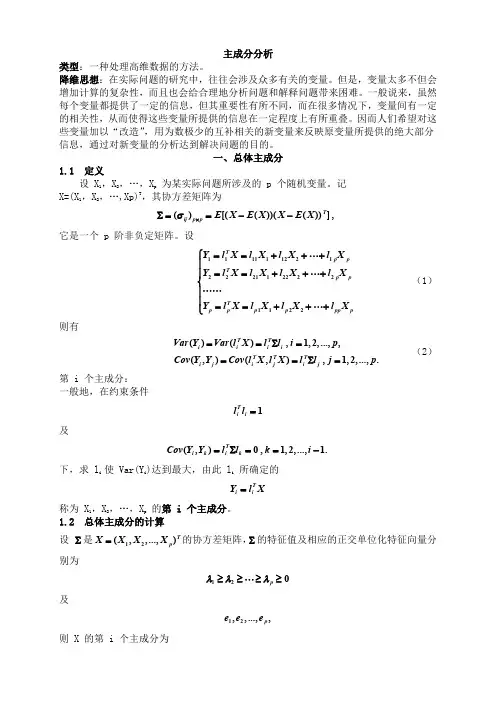

可编辑修改精选全文完整版第六章 主成分分析法主成分分析法是将高维空间变量指标转化为低维空间变量指标的一种统计方法。

由于评价对象往往具有多个属性指标,较多的变量对分析问题会带来一定的难度和复杂性。

然而,这些指标变量彼此之间常常又存在一定程度的相关性,这就使含在观测数据中的信息具有一定的重叠性。

正是这种指标间的相互影响和重叠,才使得变量的降维成为可能。

即在研究对象的多个变量指标中,用少数几个综合变量代替原高维变量以达到分析评价问题的目的。

当然,这少数指标应该综合原研究对象尽可能多的信息以减少信息的失真和损失,而且指标之间彼此相互独立。

第一节 引言主成分分析,也称主分量分析,由皮尔逊(Pearson )于1901年提出,后由霍特林(Hotelling )于1933年发展了,这也正是现在多元统计分析中的一种经典统计学观点。

经典统计学家认为主成分分析是确定一个多元正态分布等密度椭球面的主轴,这些主轴由样本来估计。

然而,现代越来越多的人从数据分析的角度出发,用一种不同的观点来考察主成分分析。

这时,不需要任何关于概率分布和基本统计模型的假定。

这种观点实际上是采用某种信息的概念,以某种代数或几何准则最优化技术对一个数据阵的结构进行描述和简化。

主成分分析方法的主要目的就是通过降维技术把多个变量化为少数几个主要成分进行分析的统计方法。

这些主要成分能够反映原始变量的绝大部分信息,它们通常表示为原始变量的某种线性组合。

为了使这些主要成分所含的信息互不重迭,应要求它们互不相关。

当分析结束后,最后要对主成分做出解释。

当主成分用于回归或聚类时,就不需要对主成分做出解释。

另外,主成分还有简化变量系统的统计数字特征的作用。

对于任意p 个变量,描述它们自身及其相互关系的数字特征包括均值、方差、协方差等,共有)1(21-+p p p 个参数。

经过主成分分析后,每个新变量的均值和协方差都为零,所以,变量系统的数字特征减少了)1(21-+p p p 个。

§8 主成分分析的应用主成分分析的基本思想是通过构造原变量的适当的线性组合,以产生一系列互不相关的新变量,从中选出少数几个新变量并使它们尽可能多地包含原变量的信息(降维),从而使得用这几个新变量替代原变量分析问题成为可能。

即在尽可能少丢失信息的前提下从所研究的m 个变量中求出几个新变量,它们能综合原有变量的信息,相互之间又尽可能不含重复信息,用这几个新变量进行统计分析(例如回归分析、判别分析、聚类分析等等)仍能达到我们的目的。

设有n 个样品,m 个变量(指标)的数据矩阵(1)11121(2)21222()12m m n mn n n nm x x x x x x x x X x x x x ⨯⎛⎫⎛⎫⎪ ⎪ ⎪⎪== ⎪⎪ ⎪ ⎪ ⎪⎝⎭⎝⎭寻找k 个新变量12,,,()k y y y k m ≤ ,使得 1、1122,(1,2,,)l l l lm m y a x a x a x l k =+++= 2、12,,k y y y 彼此不相关这便是主成分分析。

主成分的系数向量12(,,,)l l l lm a a a a = 的分量lj a 刻划出第j 个变量关于第l 个主成分的重要性。

可以证明,若12(,,,)T m x x x x = 为m 维随机向量,它的协方差矩阵V 的m 个特征值为120m λλλ≥≥≥≥ ,相应的标准正交化的特征向量为12,,,m u u u ,则12(,,,)T m x x x x = 的第i 主成分为(1,2,,)T i i y u x i m == 。

称1/mi jj λλ=∑为主成分(1,2,,)Ti i y u x i m == 的贡献率,11/k mj jj j λλ==∑∑为主成分12,,k y y y 的累计贡献率,它表达了前k 个主成分中包含原变量12,,,m x x x 的信息量大小,通常取k 使累计贡献率在85%以上即可。

当然这不是一个绝对不变的标准,可以根据实际效果作取舍,例如当后面几个主成分的贡献率较接近时,只选取其中一个就不公平了,若都选入又达不到简化变量的目的,那时常常将它们一同割舍。

主成分分析法范文PCA的计算过程可以分为以下几个步骤:1.数据标准化:对原始数据进行标准化处理,将各个特征的尺度调整为相同的范围,防止一些特征的取值范围过大造成不必要的干扰。

2.计算协方差矩阵:对标准化后的数据计算其协方差矩阵。

协方差矩阵描述了数据之间的相关性,一般而言,协方差越大表示两个特征之间的相关性越强。

3.计算特征值和特征向量:对协方差矩阵进行特征值分解,得到特征值和特征向量。

4.选择主成分:按照特征值的大小,选择前几个特征值对应的特征向量作为主成分。

特征值越大表示该主成分保留了更多的数据方差。

5.数据投影:将原始数据投影到选择的主成分上,得到降维后的数据。

PCA的主要思想是通过找到一组新的坐标系,使得数据在新坐标系中的方差尽可能大。

由于协方差矩阵是对称矩阵,故存在若干正交的特征向量,这些特征向量称为主成分。

在选择主成分时,通常会根据特征值的大小进行排序,选取前几个特征值对应的特征向量。

降维是PCA的一个重要应用。

当数据维度较高时,往往存在冗余信息,而且高维数据的处理与可视化较为困难。

通过PCA可以将高维数据映射到低维空间中,保留主要特征的同时减少数据的维度,从而方便后续的分析和处理。

另外,PCA还可以用于特征选择。

在一些机器学习任务中,特征的数量往往远大于样本的数量,这样容易导致过拟合问题。

通过PCA可以将特征空间从原始的高维空间转换到低维空间,同时保留了原始数据的主要特征,将维度降低到一个较合适的范围。

此外,PCA还可以用于数据压缩。

通过PCA将高维数据映射到低维空间,可以实现对数据的压缩,减少存储空间和计算开销。

综上所述,主成分分析是一种常用的数据分析方法,可以通过降维、特征选择和数据压缩等手段来提取数据的主要特征,帮助解决高维数据分析中的问题。

在实际应用中,我们需要根据具体的问题和需求,合理选择PCA的使用方式和参数。

1 / 5 根据主成分分析的方法,分析 ……的数据。步骤如下: Step 1为了消除不同变量的量纲的影响,首先需要对变量进行标准化,设检测 数据样本

共有n个,指标共有p个,分别设Xi,X2,Xp,令

Xj(i=1,2,…,n;j=1,2,…,p)为第i个样本第j个指标的值。作变换

X 乂」已心“,…,p

)

Var(X j)

Step 2:在标准化数据矩阵Y (yj)np的基础上计算p个原始指标相关系数矩阵

R (rj)pp

r11 *2 r21 r22 r1p

r2p

rp1 rp2 rpp

n (Xki Xi)(xkj

Xj)

其中,rj

k 1

(i j=1 2 -・・ p)

n n (I,J=I,2, ,p)

(Xki X i ) (X Xj)2

.k 1 k 1

Step 3:求相关系数矩阵 R的特征值并排序1 2 p 0,再求出R的特征

值相应的正则化特征向量 ei (ei1 , ei2 , ,eip), 则第i个主成分表示为各指标Xk

p 的组合Zi eik Xk

i 1

Step 4:计算累积贡献率确定主成分的数目。主成分

累计贡献率为

(i 1,2, ,p)

得到标准化数据矩阵yj

Xij

Sj

仝,其中Xj 2

Xj ,Sj

n i i

(Xj Xj)2 n i i

wi i p

k k 1

(i 1,2, ,p)

乙的贡献率为 般取累计贡献率达85%~95%的特征值 1, 2 , m所对应的第1、第2,…, 2 / 5 第m (mW p)个主成分

Step 5:计算主成分载荷,确定综合得分。当主成分之间不相关时,主成分载荷 是主成分

和各指标的相关系数,相关系数越大,说明主成分对该指标变量的代 表性就越好,计算公式为

lj P( Zi ,xj ... iej(i,j 1,2, ,p) Step 6:各主成分的得分,确定综合评分函数。得到各主成分的载荷以后,可以 计算各主

成分的得分

m 则第i个样本的综合得分fi Wk Zik (i=1,2,…,n);

k 1

附件中共有28个月的数据,这里仅随机选择 2005年4月的数据来说明利 分析进行水质综合评价的过程(同理可进行其他月份的数据分析)。 调用MATLAB统计工具箱princomp函数,格式为: [pc,score,late nt,tsquare]=pri ncomp(i ngredie nts) 其中in gredie nts指标准化后的样本指标矩阵,pc是指各主成分关于指标的线性 组合的系数矩阵,score为各主成分得分,late nt是方差矩阵的特征值,tsquare为

Hotelling T2 统计量。

各种指标的相关系数矩阵:

Zi 111 X i l 12 X 2 l1pX

Z2 1 21 X 1 1 22 X 2

2p X p

m1X 1 1 m 2X 2 m pX p

Z (Zj)n

Z11 Z12 Z21 Z22 Z1 m

Z2m

,其中zij表示第i个样本第j个主成分得分,

Z n1 Zn2 z nm 3 / 5

(填充数据) 各个主成分的贡献率: 表1主成分的贡献率表 特征值 贡献率 累积贡献率 第1主成分 第2主成分

由表可看出,前三个主成分的累积贡献率已达到(填充数据), 取控制参数a =0.06(因为28个月中前三个成分贡献率最低为 94%),因此取前三个主成分对

(填充文字)进行综合评价。

根据R的特征值的相应的正则化单位特征向量, 前m个主成分关于指标的线 性组合为:

(填充表达式) (分析)根据线性表达式中的系数及符号,可对各主成分的实际意义作如下解 释:第1主成分为除(变量)之外的三项指标的综合;第 2主成分与(变量) 成正相关,与(变量)成负相关;第 3主成分为除(变量)之外的三项指标的 综合。以各个主成分的方差贡献率为权重可得到(文字)的最终综合评价。

表2 XX综合评价表 第1主成分 第2主成分 综合得分 排名 样本1 样本2

上表给出了 XX的综合评价,综合得分越高说明(文字),排名越高 x=[0.0581 0.0356 0.0435 0.1184 0.1083 0.1392 0.0423 0.0346 0.0354 0.0770 0.0089 0.0642 0.0534 0.0544 0.0407 0.0139 0.0688 0.0234 0.0080 0.0047 0.0252 0.0183 0.0139 0.0391 0.0056 0.0093 0.0053 0.0290 0.0234 0.0158 0.0097 0.0263 0.0086 0.0028 0.0064 0.0064 0.0111 0.0075 0.0680 0.0557 0.1112 0.1194

0.0483 0.0499 0.0151 0.0314 0.0087 0.0174 0.0045 0.00624 / 5

0.0315 0.0375 0.0305 0.0198 0.0213 0.0376 0.0243 0.0398 0.0357 0.0278 0.0253 0.0295 0.0443 0.0286 0.0295 0.0468 0.0304 0.0334 0.0248 0.0233 0.0321 0.0242 0.0437 0.0203 0.0132 0.0233 0.0153 0.0212 0.0270 0.0213 0.0431 0.0276 0.0628 0.0142 0.0184 0.0184 0.0206 0.0285 0.0455 0.0316 0.0610 0.0440 0.0488 0.1853 0.0176 0.1086 0.1848 0.1148 0.0888 0.1352 0.0250 0.0318 0.0233 0.0444 0.0391 0.0273 0.0284 0.0251 0.0300 0.0327 0.0286 0.0212 0.0334 0.0408 0.0490 0.0285 0.0192 0.0328 0.0255 0.0285 0.0250 0.0152 0.0337 0.0361 0.0609 0.0251 0.0215 0.0232 0.0164 0.0199 0.0200 0.0190 0.0148 0.0085 0.0134 0.0037 0.0100 0.0072 0.0125 0.0089 0.0271 0.0163 0.0508 0.0223 0.0243 0.0175 0.0200 0.0222 0.0183 0.0164 0.0060 0.0290 0.0079 0.0195 0.0102 0.0063 0.0179 0.0093 0.0124 0.0159 0.0197 0.0237 0.0162 0.0078 0.0101 0.0078 0.0072 0.0117 0.0164 0.0116 0.0259 0.0243 0.0350 0.0214 0.0162 0.0287 0.0197 0.0182 0.0220 0.0182 0.0327 0.0220 0.0562 0.0391 0.0367 0.0416 0.0282 0.0220 0.0273 0.0232 0.0286 0.0204 0.0160 0.0180 0.0286 0.0165 0.0166 0.0227 0.0223 0.0168 0.0344 0.0349 0.0286 0.0255 0.0268 0.0377 0.0259 0.0254 0.0393 0.0317 0.0271 0.0185 0.0270 0.0105 0.0239 0.0140 0.0139 0.0153 0.0183 0.0144 0.0318 0.0370 0.0377 0.0793 0.0603 0.0582 0.0754 0.0901 0.0482 0.0735 0.0056 0.0472 0.0071 0.0692 0.0240 0.0104 0.0791 0.0421 0.0240 0.0456 0.0133 0.0242 0.0170 0.0039 0.0141 0.0080 0.0064 0.0097 0.0119 0.0090 0.0025 0.0497 0.0011 0.0024 0.0146 0.0057 0.0049 0.0072 0.0050 0.0048 0.1428 0.0123 0.0983 0.0292 0.1437 0.0613 0.0385 0.0402 0.0590 0.0387