鲍威尔算法

- 格式:pptx

- 大小:595.37 KB

- 文档页数:18

韦尔奇-鲍威尔算法Welsh–Powell Algorithm

决定一个图的色数是一个难题(准确地讲,它是一个NP完全问题),目前尚不存在有效的方法

因此在对图进行点着色时常采用近似算法——尽管不能得到最优结果,但是算法的执行却是快捷有效的。

下面将介绍韦尔奇-鲍威尔(Welch-Powell)点着色算法:

韦尔奇-鲍威尔算法Welch-Powell (G)

输入:图G

输出:图G 的一个点着色方案

1. 将图中顶点按度数不增的方式排成一个序列

2. 使用一种新颜色对序列中的第一个顶点进行着色,并且按照序列次序,对与已着色顶点不邻接的每一顶点着同样的颜色,直至序列末尾。

然后从序列中去掉已着色的顶点得到一个新的序列

3. 对新序列重复步骤2直至得到空序列

acgbdef cgbef

gbe

e

c

a

g d

f

b

e

要说明的是,韦尔奇-鲍威尔算法并不总能得到最少颜色数目的染色方案。

韦尔奇-鲍威

尔算法共使

用四种颜色

1

3

5

7 2 4 6 8

韦尔奇-鲍威

尔算法共使

用两种颜色

1

2

3

4 5 6 7 8

E nd。

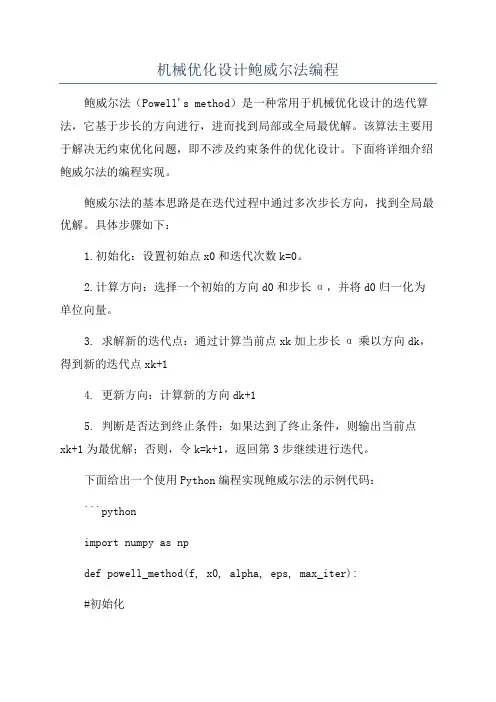

机械优化设计鲍威尔法编程鲍威尔法(Powell's method)是一种常用于机械优化设计的迭代算法,它基于步长的方向进行,进而找到局部或全局最优解。

该算法主要用于解决无约束优化问题,即不涉及约束条件的优化设计。

下面将详细介绍鲍威尔法的编程实现。

鲍威尔法的基本思路是在迭代过程中通过多次步长方向,找到全局最优解。

具体步骤如下:1.初始化:设置初始点x0和迭代次数k=0。

2.计算方向:选择一个初始的方向d0和步长α,并将d0归一化为单位向量。

3. 求解新的迭代点:通过计算当前点xk加上步长α乘以方向dk,得到新的迭代点xk+14. 更新方向:计算新的方向dk+15. 判断是否达到终止条件:如果达到了终止条件,则输出当前点xk+1为最优解;否则,令k=k+1,返回第3步继续进行迭代。

下面给出一个使用Python编程实现鲍威尔法的示例代码:```pythonimport numpy as npdef powell_method(f, x0, alpha, eps, max_iter):#初始化x=x0d = np.eye(len(x0))k=0while k < max_iter:#计算方向和步长g=f(x)d_norm = np.linalg.norm(d, axis=0) d = d / d_normalpha = alpha / d_norm#求解新的迭代点x_new = x + alpha * d#更新方向g_new = f(x_new)delta = g_new - gd = np.roll(d, -1, axis=0)d[-1] = (x_new - x) / alpha#判断终止条件if np.linalg.norm(delta) < eps: return x_new#更新迭代点x = x_newk+=1return x#示例函数,目标是求解f(x)=(x[0]-1)^2+(x[1]-2)^2 def f(x):return (x[0] - 1) ** 2 + (x[1] - 2) ** 2#设置初始点、步长、终止条件和最大迭代次数x0 = np.array([0.0, 0.0])alpha = 0.1eps = 1e-6max_iter = 100#调用鲍威尔法进行优化设计x_opt = powell_method(f, x0, alpha, eps, max_iter) #输出最优解print("Optimal solution: ", x_opt)print("Optimal value: ", f(x_opt))```在上述代码中,目标函数f(x)为示例函数,可以根据具体的优化设计问题进行修改。

数据分析知识:数据分析中的鲍威尔法在数据分析中,鲍威尔法(Box-Jenkins方法)是一种常用的时间序列分析方法。

它的主要目的是利用历史数据来预测未来数据,以便制定在合适的时间做出相应决策的策略。

本文将对于鲍威尔法进行详细介绍。

一、鲍威尔法鲍威尔法是由英国统计学家George Box和美国统计学家GM Jenkins于1970年提出来的。

它是一种识别、估计和预测时间序列模型的方法,包括(AR)自回归模型、(MA)移动平均模型和(ARIMA)自回归移动平均模型等。

定量的时间序列数据越来越广泛地应用于经济、金融、气象等日常领域和科学研究中,准确预测和解释时间序列数据的变化越来越重要。

鲍威尔法的基本思路是把观察到的时间序列数据转变成计算机可以处理的数据模型,然后利用这些模型来预测未来的数据。

这样,它可以帮助我们更好地理解与预测一系列未知的数据,包括预测市场趋势、月销量、流量分析、旅游业务、未来的气温和气候变化等。

二、鲍威尔法模型的建立鲍威尔法的建立是一个动态迭代过程,包含模型的建立、模型诊断、模型修正和模型的应用等步骤。

下面,我们将详细讲述具体流程。

1.模型的建立首先,我们需要定义时间序列模型的“参数集”,包括“自回归”参数、“移动平均”参数和“截距”参数等。

自回归是指复杂系统内部的历史行为会影响未来行为的现象,移动平均是指未来行为可能会受到突发事件或预测错误影响的现象。

基于已有的数据,我们需要计算各个参数的值,建立时间序列模型。

2.模型诊断在模型诊断的过程中,我们需要评估和诊断模型的各个方面和参数选择的合理性,以确定模型是否能够有效预测未来数据。

其中,常用的诊断工具包括统计检验、残差诊断以及预测诊断等。

通过对时间序列数据的观察和诊断,可以找出模型中可能存在的错误和不一致之处,并根据诊断的结果及时地修正和更新模型。

3.模型修正在模型修正的过程中,如果我们发现时间序列的参数集合不足以对未来数据进行准确的预测,我们需要对模型进行修正。

鲍威尔法的基本原理在数学优化领域,鲍威尔法(Powell's Method)是一种求解无约束优化问题的重要方法。

它以其独特的思路和有效的性能,在众多优化算法中占据了一席之地。

要理解鲍威尔法,首先得清楚什么是无约束优化问题。

简单来说,就是在没有任何限制条件的情况下,寻找一个函数的最小值或最大值。

比如说,我们有一个函数 f(x),目标就是找到那个能让 f(x)取到最小或最大的 x 值。

鲍威尔法的核心思想在于通过一系列的线性搜索来逐步逼近最优解。

它不是一下子就找到最终的答案,而是一步一步地靠近。

具体来看,鲍威尔法从一个初始点开始。

这个初始点可以是随意选择的,但通常会根据问题的特点和一些先验知识来进行合理的设定。

然后,它会沿着一组给定的方向进行搜索。

这些方向是怎么来的呢?一开始,鲍威尔法会选择一组固定的线性无关的方向。

比如说,在二维空间中,可能就是 x 轴和 y 轴的方向;在三维空间中,可能就是 x、y、z 轴的方向。

随着算法的进行,这些方向会不断地更新和优化。

在每次的迭代中,鲍威尔法会沿着当前的方向进行线性搜索,找到函数值下降最快的点。

这个过程就像是在黑暗中摸索,沿着一个方向走,看看哪里更低。

当完成一轮沿着所有给定方向的搜索后,鲍威尔法会根据这一轮搜索的结果来更新方向。

它会把这一轮中函数值下降最多的方向保留下来,然后用新产生的方向替换掉原来的某个方向。

新产生的方向是通过把这一轮搜索的起点和终点连接起来得到的。

这样做的目的是为了让新的方向更能反映函数的特性,从而更有效地引导搜索朝着最优解的方向前进。

比如说,如果在一轮搜索中,沿着某个方向函数值下降得特别多,那么这个方向就被认为是比较好的方向,会被保留。

而新产生的方向则是基于这一轮搜索的整体效果,希望能够捕捉到函数的变化趋势,更好地指导下一轮的搜索。

鲍威尔法的一个重要特点是它不需要计算目标函数的导数。

这在一些情况下是非常有用的,因为计算导数可能会很复杂,甚至有时候根本无法计算。

机械优化设计鲍威尔法

机械优化设计鲍威尔法(Powell method)是一种常用的非线性优化

算法,它以鲍威尔的名字命名,用于解决无约束非线性优化问题。

该方法

在各个领域都有广泛的应用,如工程优化设计、机器学习等。

下面将详细

介绍机械优化设计鲍威尔法的原理及应用。

鲍威尔法的具体步骤如下:

1.初始化参数:选择初始设计参数和方向。

2.寻找一维极小值点:沿着方向找到目标函数在该方向上的极小值点。

3.更新方向:通过比较前后两个极小值点的差异来更新方向。

4.迭代优化:重复步骤2和步骤3,直到达到指定的收敛条件。

鲍威尔法的优点是收敛速度较快、计算量较小,同时可以处理非线性

的优化问题。

然而,该方法也存在一些不足之处,如可能陷入局部最优解、对初值敏感等。

机械优化设计鲍威尔法在工程领域中有广泛的应用。

例如,在机械结

构设计中,可以利用鲍威尔法来优化结构参数,以满足特定的性能指标。

在汽车工业中,可以使用鲍威尔法来优化车辆的燃油效率和性能。

在航空

航天领域,可以利用该方法来优化飞行器的飞行性能。

此外,该方法还可

以用于机器学习中的参数优化,如调整神经网络的权重和偏置等。

总之,机械优化设计鲍威尔法是一种常用的非线性优化算法,通过迭

代逼近最优解。

虽然该方法有一些不足之处,但在实际应用中具有广泛的

适用性,尤其在工程优化设计和机器学习等领域。

通过使用该方法,可以

优化设计参数,改进性能指标,提高工程效率和产品质量。

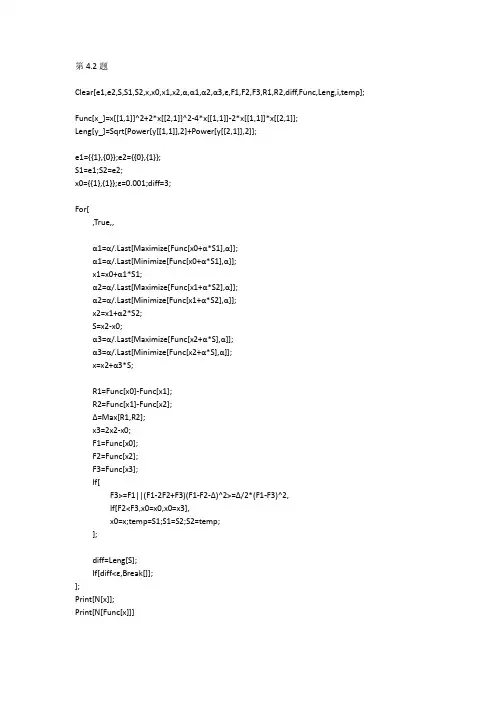

第4.2题Clear[e1,e2,S,S1,S2,x,x0,x1,x2,α,α1,α2,α3,ε,F1,F2,F3,R1,R2,diff,Func,Leng,i,temp];Func[x_]=x[[1,1]]^2+2*x[[2,1]]^2-4*x[[1,1]]-2*x[[1,1]]*x[[2,1]];Leng[y_]=Sqrt[Power[y[[1,1]],2]+Power[y[[2,1]],2]];e1={{1},{0}};e2={{0},{1}};S1=e1;S2=e2;x0={{1},{1}};ε=0.001;diff=3;For[,True,,α1=α/.Last[Maximize[Func[x0+α*S1],α]];α1=α/.Last[Minimize[Func[x0+α*S1],α]];x1=x0+α1*S1;α2=α/.Last[Maximize[Func[x1+α*S2],α]];α2=α/.Last[Minimize[Func[x1+α*S2],α]];x2=x1+α2*S2;S=x2-x0;α3=α/.Last[Maximize[Func[x2+α*S],α]];α3=α/.Last[Minimize[Func[x2+α*S],α]];x=x2+α3*S;R1=Func[x0]-Func[x1];R2=Func[x1]-Func[x2];Δ=Max[R1,R2];x3=2x2-x0;F1=Func[x0];F2=Func[x2];F3=Func[x3];If[F3>=F1||(F1-2F2+F3)(F1-F2-Δ)^2>=Δ/2*(F1-F3)^2,If[F2<F3,x0=x0,x0=x3],x0=x;temp=S1;S1=S2;S2=temp;];diff=Leng[S];If[diff<ε,Break[]];];Print[N[x]];Print[N[Func[x]]]Part::partd: 部分指定x[[1,1]] 比对象深度更长. >>Part::partd: 部分指定x[[2,1]] 比对象深度更长. >>Part::partd: 部分指定x[[1,1]] 比对象深度更长. >>General::stop: 在本次计算中,Part::partd 的进一步输出将被抑制. >> Part::partd: 部分指定y[[1,1]] 比对象深度更长. >>Part::partd: 部分指定y[[2,1]] 比对象深度更长. >>Maximize::natt: 无法在任何满足给定约束条件的点取得最大值. >> Maximize::natt: 无法在任何满足给定约束条件的点取得最大值. >> Maximize::natt: 无法在任何满足给定约束条件的点取得最大值. >> General::stop: 在本次计算中,Maximize::natt 的进一步输出将被抑制. >>x=(3.99992)1.99988F(x)=−8.。

MATLAB鲍威尔算法鲍威尔算法(Broyden-Fletcher-Goldfarb-Shanno, BFGS)是用于非线性优化问题的一种数值优化算法。

它是一种拥有全局收敛性和快速收敛速度的准牛顿法。

BFGS算法的基本思想是通过近似二次函数来逼近原函数的局部结构,并利用此近似函数来求解极值。

它通过建立二次模型来估计目标函数的海森矩阵的逆(或近似逆),然后使用逆海森矩阵来更新方向。

算法的基本步骤如下:1.初始化参数:给定初始点x_0,设定精度要求ε,设置迭代次数k=0,以及初始H_0=I。

2.计算梯度:计算目标函数在当前点x_k的梯度g_k。

3.求解方向:计算方向d_k=-H_k*g_k,其中H_k表示当前的逆海森矩阵。

4.一维:在方向上进行一维线,求解最优步长α_k。

5.更新参数:更新参数x_{k+1}=x_k+α_k*d_k。

6.判断停止条件:如果,g_{k+1},<ε,则停止迭代。

7. 更新逆海森矩阵:更新逆海森矩阵H_{k+1} = H_k + \frac{y_k* y_k^T}{y_k^T * s_k} - \frac{H_k * s_k * s_k^T * H_k}{s_k^T *H_k * s_k},其中y_k = g_{k+1} - g_k,s_k = x_{k+1} - x_k。

8.如果迭代次数k超过预设迭代次数或者步长α_k小于预设步长,则停止迭代。

BFGS算法通过逆海森矩阵的更新来逼近目标函数的局部曲率,从而实现更快的收敛速度。

在每一次迭代中,BFGS算法更新逆海森矩阵,使其逐渐收敛到目标函数的真实海森矩阵的逆。

由于逆海森矩阵的计算复杂度为O(n^2),其中n为变量的维度,BFGS算法在高维问题中的计算效率较低。

需要注意的是,BFGS算法只适用于无约束的非线性优化问题。

对于带有线性等式约束或者线性不等式约束的优化问题,需要使用相应的约束处理方法来进行求解。

总之,BFGS算法是一种拥有全局收敛性和快速收敛速度的准牛顿法。

机械优化设计鲍威尔法编程鲍威尔法编程,又称行进法、射线法,是一种无约束极值问题的最优化算法。

其核心思想是通过不断更新方向,寻找函数极小值点。

鲍威尔法编程结合了线和模式的特点,具有全局能力和局部能力,因此在机械优化设计中得到广泛应用。

在机械优化设计中,通常需要考虑多个设计参数对机械性能的影响。

鲍威尔法编程可以通过不断迭代的方式,寻找最佳的设计参数组合,以达到设计要求。

其具体步骤如下:1.初始化设计参数和步长。

2.计算当前设计参数下的目标函数值。

3.在当前方向上进行线,找到使目标函数值下降的步长。

4.更新设计参数,将方向和步长相乘加到当前设计参数上。

5.检查当前设计参数的变化是否满足终止条件,如果满足则结束,否则返回步骤26.返回最佳设计参数组合及对应的目标函数值。

下面以一个简单的机械优化设计案例为例进行详细说明。

假设有一个弹簧悬挂系统,需要设计合适的弹簧刚度和阻尼系数来满足特定的振动要求。

目标函数为最小化系统振动幅值。

首先,需要定义设计参数和目标函数。

设计参数可以选择弹簧刚度和阻尼系数。

目标函数可以定义为系统振动幅值的平方。

其次,需要确定方向和初始步长。

对于弹簧刚度和阻尼系数来说,方向可以选择正方向和负方向。

初始步长可以根据经验或试验来确定。

然后,根据鲍威尔法编程的步骤,进行迭代。

首先,初始化设计参数和步长。

然后,计算当前设计参数下的目标函数值。

接下来,根据当前方向和步长进行线,找到使目标函数值下降的步长。

再更新设计参数,将方向和步长相乘加到当前设计参数上。

最后,检查当前设计参数的变化是否满足终止条件,如果满足则结束,否则返回到线步骤继续。

最后,得到最佳的设计参数组合及对应的目标函数值。

可以根据实际情况进行设计参数的调整和优化,以获得更好的机械性能。

总之,鲍威尔法编程是一种常用的机械优化设计方法。

通过不断迭代的方式,寻找最佳的设计参数组合,以满足设计要求。

其原理和步骤相对简单,但需要结合具体问题进行参数的选择和调整。

⼗⼀、Powell算法(鲍威尔算法)原理以及实现⼀、介绍 Powell算法是图像配准⾥⾯的常⽤的加速算法,可以加快搜索速度,⽽且对于低维函数的效果很好,所以本篇博客主要是为了介绍Powell算法的原理以及实现。

由于⽹上已经有了对于Powell算法的讲解,所以我只是把链接放出来(我觉得⾃⼰⽬前还没有这个讲解的能⼒),⼤家⾃⼰去了解。

放在这⾥主要也是为了节省⼤家搜索的时间。

(都是我⾟⾟苦苦搜出来的^-^)。

⼆、预备知识 了解⼀维搜索算法:进退法,消去法,黄⾦分割法 阅读以下博客:三、鲍威尔算法 具体原理阅读这⾥: 参考博客: 原理与例⼦(⼀个例⼦的计算过程):四、matlab代码实现⼀个简单函数的求解 代码来源: 这个代码的程序与思路很是简洁,我觉得写得很好。

原⽂代码放在这⾥: ⽂件:MyPowell.m function MyPowell()syms x1 x2 x3 a;f=10*(x1+x2-5)^4+(x1-x2+x3)^2 +(x2+x3)^6;error=10^(-3);D=eye(3);x0=[000]';for k=1:1:10^6MaxLength=0;x00=x0;m=0;if k==1,s=D;endfor i=1:3x=x0+a*s(:,i);ff=subs(f,{x1,x2,x3},{x(1),x(2),x(3)});t=Divide(ff,a); %调⽤了进退法分割区间aa=OneDemensionslSearch(ff,a,t); %调⽤了0.618法进⾏⼀维搜索 xx=x0+aa*s(:,i);fx0=subs(f,{x1,x2,x3},{x0(1),x0(2),x0(3)});fxx=subs(f,{x1,x2,x3},{xx(1),xx(2),xx(3)});length=fx0-fxx;if length>MaxLength,MaxLength=length;m=m+1;endx0=xx;endss=x0-x00;ReflectX=2*x0-x00;f1=subs(f,{x1,x2,x3},{x00(1),x00(2),x00(3)});f2=subs(f,{x1,x2,x3},{x0(1),x0(2),x0(3)});f3=subs(f,{x1,x2,x3},{ReflectX(1),ReflectX(2),ReflectX(3)});if f3<f1&&(f1+f3-2*f2)*(f1-f2-MaxLength)^2<0.5*MaxLength*(f1-f3)^2x=x0+a*ss;ff=subs(f,{x1,x2,x3},{x(1),x(2),x(3)});t=Divide(ff,a);aa=OneDemensionslSearch(ff,a,t);x0=x0+aa*ss;for j=m:(3-1),s(:,j)=s(:,j+1);ends(:,3)=ss;elseif f2>f3, x0=ReflectX;endendif norm(x00-x0)<error,break;endk;x0;endopx=x0;val=subs(f,{x1,x2,x3},{opx(1),opx(2),opx(3)});disp('最优点:');opx'disp('最优化值:');valdisp('迭代次数:');k ⽂件 Divide.m :%对任意⼀个⼀维函数函数进⾏区间分割,使其出现“⾼—低—⾼”的型式function output=Divide(f,x,m,n)if nargin<4,n=1e-6;endif nargin<3,m=0;endstep=n;t0=m;ft0=subs(f,{x},{t0});t1=t0+step;ft1=subs(f,{x},{t1});if ft0>=ft1t2=t1+step;ft2=subs(f,{x},{t2});while ft1>ft2t0=t1;%ft0=ft1;t1=t2;ft1=ft2;step=2*step;t2=t1+step;ft2=subs(f,{x},{t2});endelsestep=-step;t=t0;t0=t1;t1=t;ft=ft0;%ft0=ft1;ft1=ft;t2=t1+step;ft2=subs(f,{x},{t2});while ft1>ft2t0=t1;%ft0=ft1;t1=t2;ft1=ft2;step=2*step;t2=t1+step;ft2=subs(f,{x},{t2});endendoutput=[t0,t2];View Code ⽂件:OneDemensionslSearch.mfunction output=OneDemensionslSearch(f,x,s,r)if nargin<4,r=1e-6;enda=s(1);b=s(2);a1=a+0.382*(b-a);fa1=subs(f,{x},{a1});a2=a+0.618*(b-a);fa2=subs(f,{x},{a2});while abs((b-a)/b)>r && abs((fa2-fa1)/fa2)>rif fa1<fa2b=a2;a2=a1;fa2=fa1;a1=a+0.382*(b-a);fa1=subs(f,{x},{a1});elsea=a1;a1=a2;fa1=fa2;a2=a+0.618*(b-a);fa2=subs(f,{x},{a2});endendop=(a+b)/2;%fop=subs(f,{x},{op});output=op;View Code 全部放到同⼀个⼯程⽬录⾥⾯,设置为当前⽬录,然后输⼊Powell即可运⾏得到结果。

鲍威尔法实验报告姓名:刘阳阳学号:1201013009鲍威尔法程序设计1 方法(算法)介绍1.1 方法原理简介鲍威尔法——多维无约束优化算法是在无约束优化算法之一,首先选取一组共轭方向,从某个初始点出发,求目标函数在这些方向上的极小值点,然后以该点为新的出发点,重复这一过程直到获得满意解,其优点是不必计算目标函数的梯度就可以在有限步内找到极值点。

鲍威尔法是以共轭方向为基础的收敛较快的直接法之一,是一种十分有效的算法。

在无约束方法中许多算法都是以共轭方向作为搜索方向,它们具有许多特点。

根据构造共轭方向的原理不同,可以形成不同的共轭方向法。

基本算法1)任选一初始点x0,再选两个线性无关的向量,如坐标轴单位向量e1=[1,0]T 和e2=[0,1]T作为初始搜索方向。

2)从x0出发,顺次沿e1,e2作一维搜索,得x10,x20点,两点连线得一新方向d1=x20-x0。

用d1代替e1形成两个线性无关向量d1 ,e2 ,作为下一轮迭代的搜索方向。

再x20 出发,沿d1 作一维搜索得点x01,作为下一轮迭代的初始点。

3)从x1 出发,顺次沿,e2。

d1 作一维搜索,得到点x11,x21,两点连线得一新方向:d2=x21-x11。

4)沿d2d2作一维搜索得点.x2 ,即是二维问题的极小点x*把二维情况的基本算法扩展到n维,则鲍威尔基本算法的要点是:在每一轮迭代中总有一个始点(第一轮的始点是任选的初始点)和n个线性独立的搜索方向。

从始点出发顺次沿n个方向作一维搜索得一终点,由始点和终点决定了一个新的搜索方向。

用这个方向替换原来n个方向中的一个,于是形成新的搜索方向组。

替换的原则是去掉原方向组的第一个方向而将新方向排在原方向的最后。

此外规定,从这一轮的搜索终点出发沿新的搜索方向作一维搜索而得到的极小点,作为下一轮迭代的始点。

这样就形成算法的循环。

1.2 程序设计框图1.3程序说明本程序使用VB程序语言设计,在该程序中插入command模块picture模块利用矩阵函数语句迭代计算出鲍威尔最小值并将之在picture模块中显示出2 例题计算2.1 例题:用鲍威尔法求f(x1,x2)=10*(x1+x2-5)^2+(x1-x2)^22.2 计算结果与分析VB程序计算结果如图:经演算迭代后得到结果为:X0^2= 2.49952.5091 F0=f0(x0^2)=0.0008可见已足够接近极值点x*=(2.5,2.5)T 及极小值f(x*)=02.3 结论经验算鲍威尔法VB程序计算结果正确且为最优解。

matlab鲍威尔法求二元二次函数的极小值鲍威尔法(Powell's method)是一种用于求解无约束优化问题的迭代算法。

在MATLAB中,你可以使用内建函数,比如fminunc 或fminsearch,或者手动实现鲍威尔法来求解二元二次函数的极小值。

不过,MATLAB并没有直接提供鲍威尔法的内建函数,因此你需要自己实现它。

下面是一个简化的鲍威尔法实现,用于求解二元二次函数的极小值。

假设我们的二元二次函数是f(x, y) = ax^2 + bxy + cy^2 + dx + ey + f。

matlabfunction [xmin, fmin] = powell_method(func, x0, tol, max_iter) % func: 目标函数句柄% x0: 初始点% tol: 收敛容忍度% max_iter: 最大迭代次数n = length(x0); % 变量的维数x = x0;B = eye(n); % 初始基矩阵为单位矩阵for k = 1:max_iter% 在当前基方向上进行一维搜索for i = 1:n% 定义搜索方向d = B(:, i);% 一维线搜索确定步长alpha = linesearch(func, x, d);% 更新当前点x_new = x + alpha * d;% 检查收敛性if norm(x_new - x) < tolreturnend% 更新xx = x_new;% 更新基矩阵B(:, n) = x_new - x;B = B(:, 1:n-1);end% 使用QR分解更新基矩阵[Q, R] = qr(B);B = Q(:, 1:n);endxmin = x;fmin = func(x);endfunction alpha = linesearch(func, x, d)% 简单的线搜索实现(这里假设函数是凸的)alpha = 0.1; % 初始步长c1 = 1e-4; % 足够小的正数while func(x + alpha * d) > func(x) + c1 * alpha * d' * grad(func, x)alpha = alpha / 2;endendfunction g = grad(func, x)% 计算梯度(这里需要func的梯度信息)% 对于二次函数ax^2 + bxy + cy^2 + dx + ey + f% 梯度是[2ax + by + d, bx + 2cy + e]'% 这里只是一个示例,你需要根据实际的func来计算梯度% 假设a = 1;b = 2;c = 1;d = -4;e = -6;g = [2*a*x(1) + b*x(2) + d; b*x(1) + 2*c*x(2) + e];end% 示例:求解函数f(x, y) = x^2 + 2xy + y^2 - 4x - 6y 的极小值func = @(x) x(1)^2 + 2*x(1)*x(2) + x(2)^2 - 4*x(1) - 6*x(2);x0 = [0; 0]; % 初始点tol = 1e-6; % 容忍度max_iter = 1000; % 最大迭代次数% 调用鲍威尔法[xmin, fmin] = powell_method(func, x0, tol, max_iter);% 显示结果disp(['极小值点:', mat2str(xmin)]);disp(['函数极小值:', num2str(fmin)]);请注意,上面的代码片段中有几个地方需要特别注意:grad 函数需要根据你的目标函数来计算梯度。

改进鲍威尔法更新寻优方向组条件的证明与补充鲍威尔法是一种常用的寻优算法,它通常用于求解无约束优化问题。

该算法通过权衡历史搜索方向和当前梯度信息,寻找最优解的方向。

然而,鲍威尔法在更新搜索方向时需要一系列条件的约束,在某些情况下可能会导致算法失效。

本文将对鲍威尔法的更新搜索方向的条件进行改进,并加以证明与补充。

首先,我们回顾鲍威尔法的基本思想。

在每一次迭代中,鲍威尔法首先计算当前的梯度方向g,然后选择一个搜索方向p。

在原始的鲍威尔法中,p的选择是基于历史搜索方向的加权和,即:p = -g + βp_his其中,p_his表示历史搜索方向的加权和,β是一个权衡历史搜索方向和当前梯度信息的参数。

然而,这种简单的更新方式可能导致搜索方向在某些情况下不准确或无效。

为了解决这个问题,我们对原始的鲍威尔法进行改进。

改进的思路是通过增加一系列条件来限制搜索方向的选择,以提高搜索的准确性和有效性。

具体来说,我们可以添加以下三个条件:1.搜索方向与梯度方向的夹角小于90度:这个条件的目的是确保搜索方向与梯度方向足够接近,从而使得搜索方向在靠近最优解的路径上。

为了满足这个条件,我们可以引入一个夹角限制参数φ,然后更新搜索方向p如下:p = -g + βp_his, if |cos(φ)| < 1否则,我们选择梯度方向作为搜索方向,即p = -g。

2.搜索方向的长度小于历史搜索方向的加权和的长度:这个条件的目的是确保搜索方向的长度不会大于历史搜索方向的长度,从而避免搜索方向过长。

为了满足这个条件,我们可以引入一个长度限制参数λ,然后更新搜索方向p如下:p = min(-g + βp_his, λ)其中,min()函数表示取两个向量中长度较小的一个。

3.在搜索方向与梯度方向夹角大于90度的情况下,搜索方向与历史搜索方向夹角小于90度:这个条件的目的是在搜索方向与梯度方向夹角大于90度的情况下,尽可能减小搜索方向与历史搜索方向的夹角。

鲍威尔算法课程设计一、课程目标知识目标:1. 学生能理解鲍威尔算法的基本原理及其在数值分析中的应用;2. 学生能掌握鲍威尔算法的数学推导和计算步骤;3. 学生能运用鲍威尔算法解决实际问题,并对结果进行分析。

技能目标:1. 学生能够运用所学的鲍威尔算法,对给定的问题进行数学建模;2. 学生能够运用编程工具(如Python等)实现鲍威尔算法,并解决实际问题;3. 学生能够通过小组合作,共同探讨和解决复杂问题,提高团队协作能力。

情感态度价值观目标:1. 学生培养对数学学科的热爱,增强对算法学习的兴趣;2. 学生在学习过程中,形成积极思考、主动探究的良好学习习惯;3. 学生通过解决实际问题,认识到数学知识在实际生活中的应用价值,培养学以致用的意识。

课程性质分析:本课程属于数学学科,旨在让学生掌握鲍威尔算法这一重要数值方法,培养其数学建模和问题解决能力。

学生特点分析:学生为高中年级,具备一定的数学基础和逻辑思维能力,对新鲜事物充满好奇,但可能缺乏实际应用经验。

教学要求:1. 教师应注重理论与实践相结合,引导学生将所学知识应用于实际问题;2. 教师应关注学生的个体差异,实施分层教学,使每个学生都能在原有基础上得到提高;3. 教师应鼓励学生积极参与课堂讨论,培养学生的表达能力和团队协作精神。

二、教学内容1. 鲍威尔算法的引入:介绍鲍威尔算法的发展背景、基本概念和应用领域,激发学生兴趣,使其了解算法的重要性。

教材章节:第二章 数值优化方法2. 鲍威尔算法的理论基础:讲解鲍威尔算法的数学原理、几何意义和迭代过程。

教材章节:第二章 数值优化方法 第二节 鲍威尔算法3. 鲍威尔算法的计算步骤:详细阐述鲍威尔算法的执行步骤,包括初始化、迭代和收敛判断等。

教材章节:第二章 数值优化方法 第二节 鲍威尔算法4. 鲍威尔算法的编程实现:利用编程工具(如Python等)实现鲍威尔算法,解决实际数值优化问题。

教材章节:第二章 数值优化方法 第三节 算法编程实现5. 鲍威尔算法的应用案例分析:分析典型应用案例,使学生了解鲍威尔算法在实际问题中的应用。

Fun.m文件function f=fun( x1,x2 )f=3*(x1+x2-2)^2+(x1-x2)^2主程序:x0=[0.8;0.8];%设置初始点xk=x0;ideal_error=10^(-7);%设置收敛精度actural_error=1;%实际收敛精度%初始化搜索方向d=zeros(2,2);d(:,1)=[1;0];d(:,2)=[0;1];Inc =zeros(2,1);%设置初始化增量k=0;%初始化迭代变量MaxLoopNum=100;%初始化最大迭代次数%迭代求解while(actural_error>ideal_error&&MaxLoopNum>k) syms x1;syms x2;xktemp =xk;fun1=fun(x1,x2);fun1=inline(fun1);f0=feval(fun1,xk(1),xk(2));%求初始点处函数值F0=f0;if k>0F0=eval(F0);end%沿d1方向进行一维搜索syms a;syms x1;syms x2;xk1=xk+a*d(:,1);x1=xk1(1);x2=xk1(2);fun1=fun(x1,x2);fxa=diff(fun1,'a');a=solve(fxa);xk1=inline(xk1);xk1=feval(xk1,a);xk1(1)=eval(xk1(1));xk1(2)=eval(xk1(2)); syms x1;syms x2;fun1=fun(x1,x2);fun1=inline(fun1);f1=feval(fun1,xk1(1),xk1(2)); f1=eval(f1);Inc(1)=f0-f1;%沿d2方向进行搜索syms a ;syms x1;syms x2;xk2=xk1+a*d(:,2);x1=xk2(1);x2=xk2(2);fun1=fun(x1,x2);fxa=diff(fun1,'a');a=solve(fxa);xk2=inline(xk2);xk2=feval(xk2,a);xk2(1)=eval(xk2(1));xk2(2)=eval(xk2(2));syms x1;syms x2;fun1=fun(x1,x2);fun1=inline(fun1);f2=feval(fun1,xk2(1),xk2(2));f2=eval(f2);F2=f2;Inc(2)=f1-f2;[Incm,row]=max(Inc);x3=2*xk2-xk;%计算反射点syms x1;syms x2;fun1=fun(x1,x2);fun1=inline(fun1);f3=feval(fun1,x3(1),x3(2));f3=eval(f3);F3=f3;temp1=(F0-2*F2+F3)*(F0-F2-Incm)^2; temp2=0.5*Incm*(F0-F3)^2;%判断是否更换搜索方向if(F3<F0&&temp1<temp2)syms a;syms x1;syms x2;d(:,row)=xk2-xk;x1=xk(1);x2=xk(2);fun1=fun(x1,x2);fxa=diff(fun1,'a');a=solve(fxa);xk=inline(xk);xk=feval(xk,a);%不更换搜索方向else if F2<F3xk=xk2;elsexk=x3;endendxkerror=eval(xk2-xktemp);%计算实际收敛精度actural_error=norm(xkerror);k=k+1;endx=eval(xk);。