代价敏感决策树模板

- 格式:doc

- 大小:294.50 KB

- 文档页数:11

I SSN1673—9418C O D E N JK Y T A8Jour nal of C o m p ut er S c i e nce a nd Fr ont i er s1673—941812007/01(03)-0314-11基于相对等待时间的代价敏感决策树水袁鼎荣,张师超+,朱晓峰,张晨Y U A N D i ngr ong,Z H A N G Shi chao+,Z H U X i aof eng,Z H A N G C hen E-m ai l:fcs t@pu bl i c2.bt a.net.cn —ht t p://w w w.ce aj.or gT e l:+86一l o-51616056广西师范大学计算机科学与信息工程学院。

广西桂林541004C o U e g e of C o m pu t er S c i e nceand Tec hnol ogy。

G uangxi N o r m al U n i ve r s i t y,G ui l i n,G uan gxi541004,C h i na+Cor r esp on di n g aut hor:E-m ai l:zha ngsc@m ai l box.gxn u.e du.caY U A N D i ngr ong,Z H A N G Shi chao,Z H U X i ao f eng,et a1.C ost-s en s i t i ve deci s i o n t re es bas ed on r e l a-t i ve w ai t i ng t i m e.Jour nal of C om p ut er Sci ence a nd Fr ont i er s,2007,1(3):314-324.A bs t r ac t:The pape r def i nes a‘r el at i ve w ai t i ng t i m e co s t’,an d com bi nes i t w i t h‘t est cost’as‘t angi b l e c os t’.T hen a pr i nci pl e i s pr es ent ed f or se l e ct i ng spl i t t i ng a t t r i but e s,i n w hi ch t hose at t ri but e s t ha t m axi m al l y decr ease i nt angi bl e cos t(i.e.,‘m i scl a ssi fi cat i on cos t’)i n an uni t of t a ngi bl e c os t,w i l l be f i r st l y s el ect ed a sspl i t t i ng at t r i but es.Furt herm or e,cos t-sens i t i ve deci si on t r ees w i t h r el at i vew ai t i ng t i m e cos t i s pr opos ed bycom bi ni ng t he s eque nt i al t es t st r a t eg y w i t h bat ch t es t s t rat eg y.Ex per i m ent al r e sul t s dem ons t r at e t ha t t he m et hod outper for m s t he exi s t i ng m et h ods not on l y at t he decr eas e of i nt a ngi bl e cost,b ut al s o at t he quant i t y of t he t angi bl e cos t.O n t he ot her hand,t he r e sul t s sho w t h at it is nec e ss a ry t o co ns i der t he r el at i ve w ai t i ng t i m e cos t w hen bui l di ng c ost-se ns i t i ve deci si on t r ees.K ey w or d s:cos t-s ens i t i v e;deci si on bee s;s pl i t t i ng a t t ri but es;w ai t i ng t i m e;t i m e-s en s i t i v e摘要:首先引入相对等待时间代价,将它与测试代价一起称为有形代价,利用单位有形代价中无形代价(即误分类代价)降低最多的原则选择分裂属性;然后结合序列测试策略和批量测试策略建立相对等待时间代价敏感决策树。

用于欺诈检测的一种代价敏感决策树方法cba Yusuf Sahin , Serol Bulkan , Ekrem DumanaKadikoy,Engineering, Marmara University, Department of Electrical & Electronics34722 Istanbul, Turkeyb Istanbul,University, Kadikoy, 34722 Department of Industrial Engineering, MarmaraTurkeyc Department of Industrial Engineering, Ozyegin, Cekmekoy, 34794 Istanbul, Turkey可变误分类代价信用卡欺诈检测决策树分类关键词:代价敏感建模虽然诸如摘要:随着信息技术的发展,欺诈行为遍布世界各地,这导致了巨大的经济损失。

等欺诈预防机制已经被开发应用于信用卡系统,但这些机制并不能阻止一些最常CHIP&PIN或者是所谓的在线信用卡欺诈邮购。

POS机上的信用卡欺诈使用,见的欺诈类型,比如在虚拟在欺诈检测成为了一种必不可少的工具,并且可能是阻止此类欺诈类型的最佳方法。

所以,它将在每个非叶节点选择分裂属性时此次研究中,提出了一种全新的代价敏感决策树方法,其在现实世界信用卡数据集上的性能可以与那些众所周知的传统分最小化误分类代价之和,在给定的问题集误分类代价将取不同的值。

结果表明,类模型相比较。

在这种分类方法中,此代价敏感决策树算法胜过现有公知的方比如准确度和真阳性率,上使用已知的性能指标,通过在欺因此,法,而且针对特定的信用卡欺诈检测领域,还新定义了一种代价敏感指标。

诈检测系统中实施该方法,可以更好的减少由于欺诈交易造成的金融损失。

信用卡欺诈检测有很多以前已经完成引言1.关于信用卡系统以及欺诈领域非技的研究。

Hanagandi, 术性知识的一般背景可以分别从欺诈可以被定义为为了取得财务或个Dhar, and Buescher (1996) and Hand and 两种避免由于诈人利益的非法或刑事欺骗。

基于关联度的代价敏感决策树生成方法刘春英【摘要】针对常用决策树生成方法中存在的缺点,通过引用属性关联度和代价敏感学习,利用粗糙集理论对条件属性进行约减.在构建决策树过程中,把属性的关联程度和性价比作为选择分裂结点的依据,利用改进的信息增益构建代价敏感决策树.试验结果表明,该方法在分类准确度和生成决策的结点总量上比常用决策树生成方法优越.【期刊名称】《长春工业大学学报(自然科学版)》【年(卷),期】2013(034)002【总页数】5页(P218-222)【关键词】关联度;决策树;代价敏感;属性约简【作者】刘春英【作者单位】菏泽学院计算机与信息工程系,山东菏泽274015【正文语种】中文【中图分类】TP3010 引言决策树方法是数据挖掘中最常用的一种方法,它具有较好的分类预测能力,并能方便提取决策规则。

决策树采用树形结构的表示方法,内部结点代表测试属性,分支代表测试属性的不同取值,叶节点代表分类的结果。

在构建决策树的过程中,首先从所有测试属性中选择一个属性作为根节点,并根据此属性的不同取值划分成若干个分支,从上到下通过选择不同的测试属性递归构造决策树,直到叶子节点将测试样本划分为一类。

常用的决策树生成方法有ID3方法[1]、C4.5方法[2]、CART 方法[3]、SLIQ 方法和 SPRINT[4]方法等。

常用的决策树生成方法在选择属性分裂标准时以获得分类准确率为目标,没有考虑代价和自适应性问题。

在追求分类准确率的前提下,综合考虑代价和自适应问题,提出了一种基于粗糙集的代价敏感决策树自适应生成方法。

1 相关概念和原理定义1 决策表。

形式上,四元组I=(U,R,V,f)是一个知识表达系统,其中U是对象的非空。

U×R→V是一个信息函数,它为每个对象的每个属性赋予一个信息值,即有限集合,称为论域R是属性的非空有限集合。

其中是属性r 的值域;f:∀r∈R,x∈U,f(x,r)∈V,一般简记为I=(U,R)。

代价敏感决策树讲解决策树是机器学习中常见的一种算法,适用于分类和回归问题。

决策树可以将数据样本分成多个互不重叠的子集,称为叶子节点。

每个叶子节点代表一个类别或者一个数值。

在训练过程中,决策树从根节点开始,对每个样本计算一个特征,然后根据特征值将样本分成左右子节点,不断重复这个过程,最终到达叶子节点。

但是决策树也有一些缺陷,比如容易过拟合、对噪声敏感等。

为了克服这些问题,研究者提出了代价敏感决策树。

什么是代价敏感决策树?代价敏感决策树是一种能够考虑样本类别间代价不对等的决策树算法。

在传统的决策树算法中,所有的分裂点都被视为同等重要,即所有的分裂点对分类准确性的影响是相同的。

而在代价敏感决策树中,每个分裂点都被赋予了一个代价,表示该分裂点对不同类别的分类代价不同。

我们知道,在现实生活中,许多任务中不同类别之间的代价非常不同。

比如,在疾病预测任务中,将一个患者误诊为健康人的代价相对较小,但将一个健康人误诊为患者的代价却很大。

又比如,在信用评估任务中,将一个违约客户误判为正常客户的代价相对较小,但将一个正常客户误判为违约客户的代价却很大。

代价敏感决策树能够针对这种任务,根据不同类别之间的代价进行分类。

代价敏感决策树的算法原理代价敏感决策树通常采用基于分治策略的递归生成算法。

具体来说,算法的流程如下:1.从根节点开始,选择最优特征,对数据集进行划分,并计算不同类别之间的代价。

2.对每个子节点,递归执行步骤1,直到到达叶子节点。

3.在每个叶子节点上,采用多数表决的方式确定样本所属类别。

4.对测试样本,从根节点开始,根据特征值递归往下走,直到到达叶子节点,将测试样本分到相应的类别中。

在代价敏感决策树中,每个分裂点不仅需要考虑分类错误率,还需要考虑不同类别之间的代价。

作为度量这个代价的标准,一般采用代价矩阵,代价矩阵的每一个元素表示在分类错误时所造成的代价。

算法的核心是如何寻求最优特征并计算代价。

一般来说,常用的算法有CART、C4.5和ID3等。

代价敏感决策树讲解代价敏感决策树(Cost-Sensitive Decision Tree)是一种机器学习算法,用于解决分类问题。

与传统的决策树算法相比,代价敏感决策树在构建决策树的过程中,考虑了不同分类错误所带来的代价差异,能够更好地适应真实问题的需求。

代价敏感决策树的基本思想是,在构建决策树的过程中,在计算不纯度的基础上,增加了代价和收益的权重。

通常情况下,代价用来衡量分类错误所带来的不良后果,收益用于衡量正确分类所带来的好处。

代价敏感决策树根据代价和收益的权重来选择最优的划分属性和划分点,以最小化总的代价或最大化总的收益。

代价敏感决策树的构建过程与传统的决策树算法相似,主要包括特征选择、划分属性、划分点选择和剪枝等步骤。

在特征选择中,代价敏感决策树算法通常使用基于代价的评价指标来选择最优的特征。

常用的评价指标有代价不确定度、代价熵和代价基尼指数等。

在划分属性和划分点选择中,代价敏感决策树算法根据代价和收益的权重来计算每个候选划分的代价或收益,选择代价或收益最小(最大)的候选划分。

在剪枝过程中,代价敏感决策树算法采用代价或收益的权重来调整剪枝过程中的代价或收益。

代价敏感决策树的优点在于能够更好地解决真实问题中的分类代价不平衡的情况。

在很多实际问题中,不同类别的分类错误带来的代价是不同的,例如医疗诊断中,将一个患病的人误判为健康的代价远远高于将一个健康的人误判为患病。

代价敏感决策树能够根据不同的代价权重来准确判断分类结果,从而避免产生过多的代价。

然而,代价敏感决策树也存在一些局限性。

首先,代价敏感决策树在构建过程中需要事先确定好代价和收益的权重,但在实际问题中,很难准确估计每种错误分类所带来的代价。

其次,代价敏感决策树通常只考虑了一种错误分类的代价,对于多种错误分类的代价差异无法准确处理。

最后,代价敏感决策树算法在处理大规模数据集时,计算代价和收益的复杂度较高,训练时间较长。

综上所述,代价敏感决策树是一种考虑分类代价的机器学习算法,能够更好地适应真实问题的需求。

代价敏感学习中属性约简与决策树分类若干关键问题研究的开题报告一、研究背景随着数据规模和维度的不断扩大,部分属性对分类结果的影响越来越小,甚至噪声属性会影响分类的准确性。

因此,属性约简成为了处理高维数据的重要手段。

在代价敏感学习中,属性约简不仅能够提高分类器的准确率,还能考虑样本的代价,使分类器更符合现实需求。

二、研究目的本研究旨在解决代价敏感学习中属性约简与决策树分类若干关键问题,包括:1. 基于代价敏感学习的属性约简方法研究;2. 属性约简对决策树分类器的影响研究;3. 代价敏感学习与属性约简结合的决策树分类研究。

三、研究方法1. 文献综述:对代价敏感学习、属性约简和决策树分类等相关领域的研究进行综述和分析,总结现有研究方法和成果,为后续研究做好准备。

2. 方法研究:在前期研究的基础上,提出一种基于代价敏感学习的属性约简方法,并将此方法应用于决策树分类器中。

并对比不同方法的优劣性,为优化算法提供支持。

3. 实验验证:利用各种公开的数据集来验证提出的方法的有效性和稳定性,包括实验室自拟数据集和经典数据集。

四、研究计划本研究预计用时12个月,计划分为以下几个阶段:1.文献综述(1个月):对代价敏感学习、属性约简和决策树分类等相关研究领域的文献进行综合、分析。

2.方法研究(5个月):提出一种基于代价敏感学习的属性约简方法,并将此方法应用于决策树分类器中,比较不同方法的优劣性。

3.实验验证(4个月):使用各种公开数据集并集成实验室自拟的数据集,验证提出的方法的有效性和稳定性。

4.论文撰写与提交(2个月):根据研究结果撰写论文,并提交到相关期刊进行审稿。

五、研究意义本研究的成果将有助于提高代价敏感学习的分类准确度和效率,同时有望推动决策树分类器在实际应用中的推广。

本研究的算法及成果还可应用于大数据对策略的建立,模型数据对比分析等领域。

广西师范大学硕士学位论文改进代价敏感的决策树学习方法研究姓名:***申请学位级别:硕士专业:计算机软件与理论指导教师:张师超;严小卫20060401改进代价敏感的决策树学习方法研究研究生姓名:倪艾玲导师姓名:张师超严小卫专业:计算机软件与理论研究方向:数据库与数据挖掘年级:2003级中文摘要从广义上讲,机器学习(Machine Learning)是以使其包括任何计算机程序通过经验来提高其任务处理性能的行为。

如果机器能够真正完全地根据经验来自动提高,其影响将是空前的。

为此,自从第一台电子计算机ENIAC问世以来,大批学者与专家就在为使其能够自我学习而不懈努力。

到目前为止,针对特定学习任务的算法已产生[58][59],关于学习的理论认识已开始形成[60][61],其中,从特殊的训练样例中归纳出一般函数是机器学习的中心问题,而决策树学习则是应用最广的归纳推理算法之一[1][10]。

决策树方法在实际中有着广泛的应用,如根据疾病分类患者[58];根据起因分类设备故障;根据拖欠支付的可能性分类贷款申请。

这类问题的核心任务都是把样例分入各个可能的对应的类别中,因此称为分类问题(Classification problem)[1]。

经典的分类问题是在假设为各种分类错误所要付出的代价相同的情况下,要求达到高的分类正确率。

然而这种假设在实际应用中很难满足,如根据疾病分类患者问题中,将病人判断为健康者与将健康者判断为病人,这两种错误的诊断所要付出的代价一定是不相同的。

针对此类问题,专家们提出了代价敏感的学习方法(Cost-sensitive Learning,CSL)。

由于其在现实中广泛的应用,近年来一直是机器学习领域中的一个研究热点[20][51]。

本文首先介绍了机器学习的主要研究领域,并分析了目前国内外关于代价敏感学习的理论与方法,指出现有的代价敏感学习方法的优点与不足。

针对存在的问题与不足,提出了一些新方法,并通过实验证明本文所提出的方法的可行性与有效性。

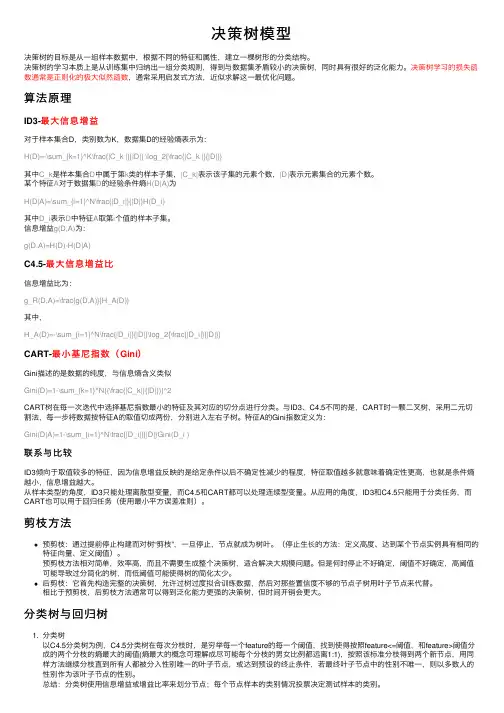

决策树模型决策树的⽬标是从⼀组样本数据中,根据不同的特征和属性,建⽴⼀棵树形的分类结构。

决策树的学习本质上是从训练集中归纳出⼀组分类规则,得到与数据集⽭盾较⼩的决策树,同时具有很好的泛化能⼒。

决策树学习的损失函数通常是正则化的极⼤似然函数,通常采⽤启发式⽅法,近似求解这⼀最优化问题。

算法原理ID3-最⼤信息增益对于样本集合D,类别数为K,数据集D的经验熵表⽰为:H(D)=-\sum_{k=1}^K\frac{|C_k |}{|D|} \log_2{\frac{|C_k |}{|D|}}其中C_k是样本集合D中属于第k类的样本⼦集,|C_k|表⽰该⼦集的元素个数,|D|表⽰元素集合的元素个数。

某个特征A对于数据集D的经验条件熵H(D|A)为H(D|A)=\sum_{i=1}^N\frac{|D_i|}{|D|}H(D_i)其中D_i表⽰D中特征A取第i个值的样本⼦集。

信息增益g(D,A)为:g(D,A)=H(D)-H(D|A)C4.5-最⼤信息增益⽐信息增益⽐为:g_R(D,A)=\frac{g(D,A)}{H_A(D)}其中,H_A(D)=-\sum_{i=1}^N\frac{|D_i|}{|D|}\log_2{\frac{|D_i|}{|D|}}CART-最⼩基尼指数(Gini)Gini描述的是数据的纯度,与信息熵含义类似Gini(D)=1-\sum_{k=1}^N{(\frac{|C_k|}{|D|})}^2CART树在每⼀次迭代中选择基尼指数最⼩的特征及其对应的切分点进⾏分类。

与ID3、C4.5不同的是,CART时⼀颗⼆叉树,采⽤⼆元切割法,每⼀步将数据按特征A的取值切成两份,分别进⼊左右⼦树。

特征A的Gini指数定义为:Gini(D|A)=1-\sum_{i=1}^N\frac{|D_i|}{|D|}Gini(D_i )联系与⽐较ID3倾向于取值较多的特征,因为信息增益反映的是给定条件以后不确定性减少的程度,特征取值越多就意味着确定性更⾼,也就是条件熵越⼩,信息增益越⼤。

用于欺诈检测的一种代价敏感决策树方法Yusuf Sahin a, Serol Bulkan b, Ekrem Duman ca Department of Electrical & Electronics Engineering, Marmara University, Kadikoy, 34722Istanbul, Turkeyb Department of Industrial Engineering, Marmara University, Kadikoy, 34722 Istanbul,Turkeyc Department of Industrial Engineering, Ozyegin, Cekmekoy, 34794 Istanbul, Turkey关键词:代价敏感建模信用卡欺诈检测决策树分类可变误分类代价摘要:随着信息技术的发展,欺诈行为遍布世界各地,这导致了巨大的经济损失。

虽然诸如CHIP&PIN等欺诈预防机制已经被开发应用于信用卡系统,但这些机制并不能阻止一些最常见的欺诈类型,比如在虚拟POS机上的信用卡欺诈使用,或者是所谓的在线信用卡欺诈邮购。

所以,欺诈检测成为了一种必不可少的工具,并且可能是阻止此类欺诈类型的最佳方法。

在此次研究中,提出了一种全新的代价敏感决策树方法,它将在每个非叶节点选择分裂属性时最小化误分类代价之和,其在现实世界信用卡数据集上的性能可以与那些众所周知的传统分类模型相比较。

在这种分类方法中,误分类代价将取不同的值。

结果表明,在给定的问题集上使用已知的性能指标,比如准确度和真阳性率,此代价敏感决策树算法胜过现有公知的方法,而且针对特定的信用卡欺诈检测领域,还新定义了一种代价敏感指标。

因此,通过在欺诈检测系统中实施该方法,可以更好的减少由于欺诈交易造成的金融损失。

1.引言欺诈可以被定义为为了取得财务或个人利益的非法或刑事欺骗。

两种避免由于诈骗活动导致欺诈和损失的机制是欺诈预防以及欺诈检测系统。

用于欺诈检测的一种代价敏感决策树方法Yusuf Sahin a, Serol Bulkan b, Ekrem Duman ca Department of Electrical & Electronics Engineering, Marmara University, Kadikoy,34722 Istanbul, Turkeyb Department of Industrial Engineering, Marmara University, Kadikoy, 34722 Istanbul,Turkeyc Department of Industrial Engineering, Ozyegin, Cekmekoy, 34794 Istanbul, Turkey 关键词:代价敏感建模信用卡欺诈检测决策树分类可变误分类代价摘要:随着信息技术的发展,欺诈行为遍布世界各地,这导致了巨大的经济损失。

虽然诸如CHIP&PIN等欺诈预防机制已经被开发应用于信用卡系统,但这些机制并不能阻止一些最常见的欺诈类型,比如在虚拟POS机上的信用卡欺诈使用,或者是所谓的在线信用卡欺诈邮购。

所以,欺诈检测成为了一种必不可少的工具,并且可能是阻止此类欺诈类型的最佳方法。

在此次研究中,提出了一种全新的代价敏感决策树方法,它将在每个非叶节点选择分裂属性时最小化误分类代价之和,其在现实世界信用卡数据集上的性能可以与那些众所周知的传统分类模型相比较。

在这种分类方法中,误分类代价将取不同的值。

结果表明,在给定的问题集上使用已知的性能指标,比如准确度和真阳性率,此代价敏感决策树算法胜过现有公知的方法,而且针对特定的信用卡欺诈检测领域,还新定义了一种代价敏感指标。

因此,通过在欺诈检测系统中实施该方法,可以更好的减少由于欺诈交易造成的金融损失。

1.引言欺诈可以被定义为为了取得财务或个人利益的非法或刑事欺骗。

两种避免由于诈骗活动导致欺诈和损失的机制是欺诈预防以及欺诈检测系统。

欺诈预防是以防止欺诈行为发生为目标的主动机制。

欺诈检测系统在诈骗者越过欺诈预防系统并且开始一个欺诈交易时发挥作用。

有关欺诈领域以及检测技术的综述可以在Bolton and Hand (2002), Kou, Lu, Sirwongwattana, and Huang (2004), Phua, Lee, Smith, and Gayler (2005), Sahin and Duman (2010)的研究中找到。

其中最知名的欺诈领域是信用卡系统。

可以通过许多方法进行信用卡欺诈,如简单盗窃,申请欺诈,伪造卡片,从未达卡问题(NRI)以及在线诈骗(在持卡人不存在的情况下)。

在网络诈骗中,交易是通过远程完成的,并且只需要信用卡信息。

由于网络的国际可用性和易用性,用户可以在互联网交易中隐藏自身位置以及身份,所以通过该媒介发生的欺诈行为正在快速增长。

信用卡欺诈检测有很多以前已经完成的研究。

关于信用卡系统以及欺诈领域非技术性知识的一般背景可以分别从Hanagandi, Dhar, and Buescher (1996) and Hand and Blunt (2001)学习。

在这个领域中,最常用的欺诈检测方法有规则归纳技术,决策树,人工神经网络(ANN),支持向量机(SVM),逻辑回归以及诸如遗传算法的启发式算法。

这些技术可以单独使用,也可以通过集成以及元学习技术协同使用来构建分类器。

大多数信用卡欺诈检测系统在使用监督算法,比如神经网络(Brause, Langsdorf, & Hepp, 1999; Dorronsoro, Ginel, Sanchez, & Cruz, 1997; Juszczak, Adams, Hand, Whitrow, & Weston, 2008; Quah & Sriganesh, 2008; Schindeler, 2006; Shen, Tong, & Deng, 2007; Stolfo, Fan, Lee, Prodromidis, & Chan, 1997; Stolfo, Fan, Lee, Prodromidis, & Chan, 1999; Syeda, Zhang, & Pan, 2002; Prodromidis, Chan, & Stolfo, 2000),ID3、C4.5和C&RT一类的决策树技术(Chen, Chiu, Huang, & Chen, 2004; Chen, Luo, Liang, & Lee, 2005;Mena, 2003;Wheeler & Aitken, 2000)以及支持向量机(Gartner Reports, 2010; Leonard, 1993)。

信用卡欺诈检测是一个非常困难,但也很受欢迎的亟待解决的问题。

总是仅有有限数量有关犯罪交易的数据。

同时,也有可能存在诈骗者进行符合正常(合法)行为模式(Aleskerov, Freisleben, & Rao, 1997)的交易通过的情况。

此外,该问题还有很多限制。

首先,正常和诈骗行为的表现不断地改变。

其次,新欺诈检测方法的发展变得更加困难是由在欺诈检测中交换思想的事实造成的,尤其是信用卡欺诈检测因为安全和隐私问题被严格限制。

第三,数据集不一定是可用的,其结果往往是截尾的,这使得它们难以评估。

甚至,一些研究使用合成产生的数据进行(Brause等, 1999; Dorronsoro 等, 1997)。

第四,信用卡欺诈数据集是高度倾斜集。

最后,该数据集正在不断发展,使得正常和诈骗行为的表现总是在变化(Bolton & Hand, 2002; Kou等, 2004; Phua et al., 2005; Sahin & Duman, 2010)。

因此,信用卡欺诈检测仍然是一个流行的,具有挑战性以及困难的研究课题。

Visa关于欧洲国家的信用卡欺诈报告指出在2008年,大约50%的信用卡欺诈损失是由于在线欺诈(Ghosh & Reilly, 1994)。

许多文献报道了大量不同国家的损失(Bolton & Hand, 2002; Dahl, 2006; Schindeler, 2006)。

因此,新方法提高了在这一领域的分类器性能兼有经济意义与研究贡献。

基于这个领域的特性,定义一个新的代价敏感方法是改善的最佳途径之一。

虽然传统的机器学习技术在许多分类问题上一般是成功的,但是具有高准确度或最小化误分类误差并不总是开发分类器的目标。

在现实世界的机器学习问题领域的应用中,有各种类型的代价参与,Turney定义了其中的九种主要类型(Turney, 2000)。

然而,大多数机器学习文献并不采取任何这些代价的考虑,仅仅剩下的一小部分考虑了误分类代价。

Turney还指出误分类误差的代价在分类中具有独特的地位(Turney, 2000)。

而根据ML-netll项目(European Network of Excellence in Machine Learning)的技术路线图,代价敏感学习据称是在机器学习研究的未来中一个非常流行的课题(Saitta, 2000; Zhou & Liu, 2006)。

因此,通过构建代价敏感分类器来改善分类器在欺诈检测系统中的性能是一个使大量经济损失恢复的最好办法。

此外,客户的忠诚度和信任度也将有所增加。

并且代价敏感分类器已经被证明能够有效处理类不平衡问题(Thai-Nghe, Gantner, & Schmidt-Thieme, 2010; Zhou & Liu, 2006)。

大量过去的研究是在恒定的误分类代价矩阵或者由一些恒定的合成误分类代价组成的代价矩阵上进行的;然而,每个假阴性(FN)具有它固有的独特的误分类代价。

因此,每个假阴性(FN)应当以某种方式排列来显示误分类代价的差异。

例如,具有较大交易量的或者更大可用额度的欺诈交易应该比具有较小数量或可用额度的更需要被检测。

恒定代价矩阵或者不变代价矩阵的组合不能描述这个场景。

所以,本研究是在可变误分类代价的分类问题工作中,将这样的情况纳入考虑的开拓者之一。

这项研究的目的是填补信用欺诈检测文献的一项空白。

在此研究中,开发了一个新的代价敏感决策树归纳算法,它将在树的每个非叶节点选择分裂属性时最小化误分类代价之和,并且分类性能可以与那些无论是代价不敏感还是代价敏感的具有固定误分类代价率的传统分类方法相比较,比如传统决策树算法,人工神经网络和支持向量机。

结果表明,就诈骗交易的辨别和防止可能的损失量而言,这个代价敏感决策树算法在我们现实世界数据集上的表现优于现有公知的方法。

在信用卡欺诈检测中,误分类代价以及欺诈的优先序基于个人记录来区别不同。

其结果是,常见的性能指标,如准确率,真阳性率(TPR)或者甚至曲线下面积(AUC)并不适合评估模型的性能,因为它们接受每个欺诈是具有相同优先级,不管欺诈交易量或者当时交易中用卡的可用信用额度是多少。

应该使用一个使用有意义的方式按序排列欺诈交易以及检查模型在最小化总经济损失时性能的全新性能指标。

一旦诈骗者得到使用信用卡进行诈骗交易的机会,他们通常消耗完一张信用卡的可用信用额度。

因此,一个欺诈交易的经济损失可以假定为交易前卡的可用信用额度,而不是交易的数量。

这样,模型在测试集上的性能比较可以使用新定义的代价敏感性能指标挽回损失率(SLR),也就是从欺诈交易中信用卡可用额度之和的潜在经济损失中挽回的百分比。

为了显示我们观点的正确性,在模型性能的比较中,代表模型性能的真阳性率(TPR)的值也会给出。

本文的其余部分安排如下:第二章节给出机器学习中代价敏感方法的回顾;第三章节给出对于信用卡数据的结构的一些见解;第四章节给出新开发的代价敏感决策树算法的细节;第五章节给出结果以及对结果的简短讨论;第六章节总结本研究。

2.机器学习中的代价敏感方法有不同方法用于构建将代价敏感性考虑在内的分类模型。

第一个通过改变过采样或欠采样的训练数据分布来建立代价敏感分类模型,使得该集合中数据的代价可以表现出例子的形态。

一些研究试图通过分层来克服误分类代价问题;以及当数据集不平衡时复制或丢弃样本(Japkowicz, 2000; Kubat & Matwin, 1997)。

然而,这些研究人员假设代价矩阵的内容是固定的数字,而不是依赖记录的值。

研究人员如Domingos 试图建立像MetaCost的机制去将代价不敏感分类器转换为代价敏感分类器(Domingos, 1999; Elkan, 2001)。