字符与字符编码

- 格式:pdf

- 大小:248.07 KB

- 文档页数:32

常用的中文字符编码

常用的中文字符编码有以下几种:

1. GB2312:是中国国家标准简体中文字符集,共收录了6763个汉字。

GB2312是最早的汉字字符集,主要用于简体中文的编码。

2. GBK:是GB2312的扩展字符集,共收录了21886个汉字。

GBK 支持繁体中文字符和少数民族文字。

GBK是目前最常用的中文字符编码。

3. GB18030:是GB2312和GBK的升级版字符集,共收录了27533个汉字。

GB18030支持所有中国少数民族文字,并且还包含了Unicode

3.0的全部字符。

4. UTF-8:是一种以Unicode为基础的字符编码,采用可变长度的编码方式,支持全球范围内几乎所有的字符。

UTF-8是互联网上最常用的字符编码,也是目前推荐使用的中文字符编码。

除了上述字符编码,还有一些其他的字符编码,如Big5(主要用于繁体中文)、ISO-8859-1(用于西欧字符集)等,但在日常使用中较少见。

字符编码和字符集到底有什么区别?Unicode和UTF-8是什么关系?前⾔想必⼤家编写代码时肯定和我⼀样,也遇到过汉字乱码的问题。

特别是,有时候和上下游对接接⼝,不能统⼀编码格式的话,⼀堆乱码问题,让⼈头⽪发⿇。

那么为什么会有这么多的乱码问题?什么是字符编码?什么是字符集?他们之间有什么区别和联系?什么是 Unicode ? Unicode 和我们常说的 UTF-8 ⼜有什么关系?字符编码和解码要想搞清楚上⾯的问题,⾸先我们要知道,在计算机中,不管是⼀段⽂字、⼀张图⽚还是⼀段视频,最终都是以⼆进制的⽅式来存储。

也就是最终都会转化为0001 1011 0010 0110这样的格式。

换句话说,计算机只认识 0 和 1 这样的数字,并不能直接存储字符。

所以我们需要告诉它什么样的字符对应的是什么数字。

例如,我们的业务中有记录客户端的客户⾏为⽇志,然后导出⽂件来分析,字段间会以ESC来分隔。

我在编写代码的时候,就需要定义⼀下这个ESC字符应该对应什么数字,这样计算机才能识别并存储。

⽐如我把它定为0001 1011,这样计算机就把ESC这个字符存了下来。

等我下次需要查看的时候,根据对应关系把它解出来就可以了。

上边的两个过程就对应字符的编码和解码过程。

字符编码就是把字符按⼀定的规则,转换成数字。

字符解码是编码的逆过程,即把数字按规则转换成字符。

这样看来,貌似没有什么问题。

但是,这是我⾃⼰定义的编码规则,我同桌阿霄就不乐意了。

他⾮要认为ESC应该定义为1101 1000,好家伙正好和我定义的⼆进制数字顺序相反。

那结果肯定不⽤说了,我把0001 1011这串数字给他之后,按照他的编码规则来解,肯定是&$#!这样的东西。

所以,乱码问题说到底,就是编码和解码的规则对应不上导致的。

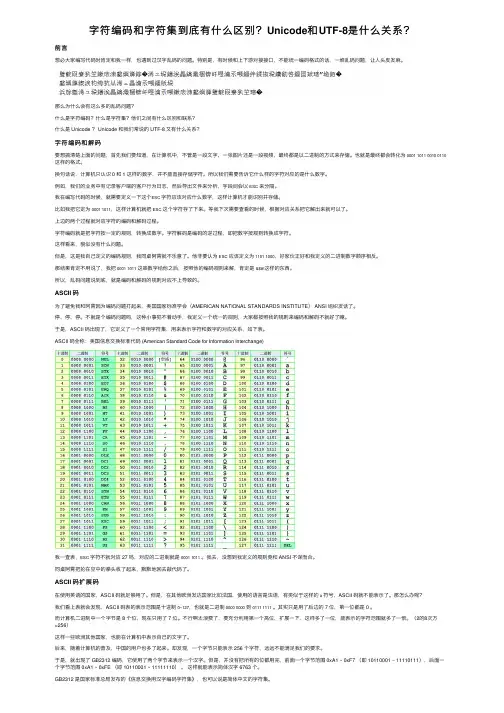

ASCII 码为了避免我和阿霄因为编码问题打起来,美国国家标准学会(AMERICAN NATIONAL STANDARDS INSTITUTE) ANSI 组织发话了。

字符和汉字编码一、字符集编码字符集编码是指将字符集中的字符转换为计算机可识别的二进制编码。

常见的字符集编码包括ASCII编码、GB2312编码、GBK编码、UTF-8编码等。

1. ASCII编码:ASCII编码是最常用的字符集编码,它包含了128个字符,每个字符用一个字节的二进制数表示。

2. GB2312编码:GB2312编码是中国大陆使用的字符集编码,它包含了6763个汉字和一些其他的字符。

3. GBK编码:GBK编码是中国大陆使用的扩展字符集编码,它包含了20902个汉字和一些其他的字符。

4. UTF-8编码:UTF-8编码是一种可变长度的字符集编码,它包含了几乎所有的语言字符,包括汉字。

二、汉字编码汉字编码是指将汉字转换为计算机可识别的二进制编码。

常见的汉字编码包括GB2312编码、GBK编码、UTF-8编码等。

1. GB2312编码:GB2312编码是中国大陆使用的汉字编码,它包含了6763个汉字。

2. GBK编码:GBK编码是中国大陆使用的扩展汉字编码,它包含了20902个汉字。

3. UTF-8编码:UTF-8编码是一种可变长度的汉字编码,它包含了几乎所有的语言字符,包括汉字。

三、字符和汉字的输入方法字符和汉字的输入方法包括键盘输入、手写输入、语音输入等。

1. 键盘输入:通过键盘输入字符和汉字,是最常用的输入方法。

2. 手写输入:通过手写输入汉字,通常需要使用专门的识别软件。

3. 语音输入:通过语音输入汉字,通常需要使用语音识别软件。

四、字体和字形的表示字体和字形的表示包括矢量字体和点阵字体。

矢量字体是一种数学描述的字体,可以无损放大;点阵字体是一种像素点的集合,放大后会出现失真。

五、编码标准编码标准是指制定字符集编码和汉字编码的规范和标准。

中国制定了《信息交换用汉字编码字符集》等标准,国际上制定了ISO/IEC 10646等标准。

六、字符和汉字的输出方法字符和汉字的输出方法包括屏幕输出、打印机输出、文件输出等。

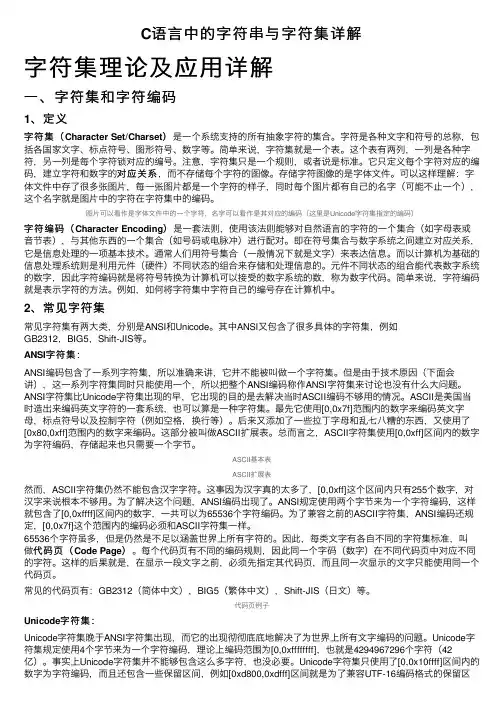

C语⾔中的字符串与字符集详解字符集理论及应⽤详解⼀、字符集和字符编码1、定义字符集(Character Set/Charset)是⼀个系统⽀持的所有抽象字符的集合。

字符是各种⽂字和符号的总称,包括各国家⽂字、标点符号、图形符号、数字等。

简单来说,字符集就是⼀个表。

这个表有两列,⼀列是各种字符,另⼀列是每个字符锁对应的编号。

注意,字符集只是⼀个规则,或者说是标准。

它只定义每个字符对应的编对应关系,⽽不存储每个字符的图像。

存储字符图像的是字体⽂件。

可以这样理解:字码,建⽴字符和数字的对应关系体⽂件中存了很多张图⽚,每⼀张图⽚都是⼀个字符的样⼦,同时每个图⽚都有⾃⼰的名字(可能不⽌⼀个),这个名字就是图⽚中的字符在字符集中的编码。

图⽚可以看作是字体⽂件中的⼀个字符,名字可以看作是其对应的编码(这⾥是Unicode字符集指定的编码)字符编码(Character Encoding)是⼀套法则,使⽤该法则能够对⾃然语⾔的字符的⼀个集合(如字母表或⾳节表),与其他东西的⼀个集合(如号码或电脉冲)进⾏配对。

即在符号集合与数字系统之间建⽴对应关系,它是信息处理的⼀项基本技术。

通常⼈们⽤符号集合(⼀般情况下就是⽂字)来表达信息。

⽽以计算机为基础的信息处理系统则是利⽤元件(硬件)不同状态的组合来存储和处理信息的。

元件不同状态的组合能代表数字系统的数字,因此字符编码就是将符号转换为计算机可以接受的数字系统的数,称为数字代码。

简单来说,字符编码就是表⽰字符的⽅法。

例如,如何将字符集中字符⾃⼰的编号存在计算机中。

2、常见字符集常见字符集有两⼤类,分别是ANSI和Unicode。

其中ANSI⼜包含了很多具体的字符集,例如GB2312,BIG5,Shift-JIS等。

ANSI字符集:ANSI编码包含了⼀系列字符集,所以准确来讲,它并不能被叫做⼀个字符集。

但是由于技术原因(下⾯会讲),这⼀系列字符集同时只能使⽤⼀个,所以把整个ANSI编码称作ANSI字符集来讨论也没有什么⼤问题。

256 257 258字符编码一、什么是字符编码字符编码是计算机技术中的一个重要概念,它指的是将字符转换为计算机能够识别和处理的数据形式的过程。

计算机内部只能识别和处理数字,而字符编码就是将字符映射为对应的数字或者二进制形式,以便计算机能够正确地处理和显示文本信息。

二、常见的字符编码方案在计算机领域,常见的字符编码方案有ASCII、Unicode和UTF-8等。

这些字符编码方案分别具有不同的特点和适用范围。

1. ASCII编码ASCII编码是最早的字符编码方案,它规定了128个字符的编码,包括英文字母、数字和一些特殊字符。

由于ASCII编码只能表示128个字符,无法满足其他语种的需要,因此逐渐被Unicode和UTF-8所取代。

2. Unicode编码Unicode编码是一种全球通用的字符编码方案,它包含了世界上几乎所有的文字字符,可以表示多种语言的文字。

Unicode编码使用16位或32位来表示字符,能够满足不同语种的需求,是目前最为广泛应用的字符编码方案之一。

3. UTF-8编码UTF-8是一种可变长度的Unicode编码方案,它可以使用1~4个字节来表示一个字符,适合在互联网上传输和存储文本信息。

由于UTF-8编码具有良好的兼容性和节省空间的特点,因此在互联网应用中得到了广泛的应用。

三、字符编码的重要性字符编码在计算机领域具有非常重要的作用,它直接影响着计算机能否正确地显示和处理文本信息。

正确的字符编码方案可以保证不同语言的文字能够被准确地表达和显示,从而实现跨语言的信息交流和共享。

1. 多语言支持随着全球化的发展,不同国家和地区之间的交流日益频繁,多语言支持成为了计算机系统的基本需求。

而正确的字符编码方案可以实现在同一个系统中支持多种语言的显示和输入,为用户提供更加便捷的操作体验。

2. 数据传输在网络通信和数据传输过程中,字符编码的选择直接影响着数据的准确传输和解析。

采用合适的字符编码方案可以有效地避免因编码问题造成的数据丢失和信息不清晰的情况,保证数据的完整性和可靠性。

字符集和字符编码(CharsetEncoding)——每个软件开发⼈员应该⽆条件掌握的知识!——Unicode伟⼤的创想!相信⼤家⼀定碰到过,打开某个⽹页,却显⽰⼀堆像乱码,如"бЇЯАзЪСЯ"、"�????????"?还记得HTTP中的Accept-Charset、Accept-Encoding、Accept-Language、Content-Encoding、Content-Language等消息头字段?这些就是接下来我们要探讨的。

⽬录:1.*础知识计算机中储存的信息都是⽤⼆进制数表⽰的;⽽我们在屏幕上看到的英⽂、汉字等字符是⼆进制数转换之后的结果。

通俗的说,按照何种规则将字符存储在计算机中,如'a'⽤什么表⽰,称为"编码";反之,将存储在计算机中的⼆进制数解析显⽰出来,称为"解码",如同密码学中的加密和解密。

在解码过程中,如果使⽤了错误的解码规则,则导致'a'解析成'b'或者乱码。

字符集(Charset):是⼀个系统⽀持的所有抽象字符的集合。

字符是各种⽂字和符号的总称,包括各国家⽂字、标点符号、图形符号、数字等。

字符编码(Character Encoding):是⼀套法则,使⽤该法则能够对⾃然语⾔的字符的⼀个集合(如字母表或⾳节表),与其他东西的⼀个集合(如号码或电脉冲)进⾏配对。

即在符号集合与数字系统之间建⽴对应关系,它是信息处理的⼀项*本技术。

通常⼈们⽤符号集合(⼀般情况下就是⽂字)来表达信息。

⽽以计算机为*础的信息处理系统则是利⽤元件(硬件)不同状态的组合来存储和处理信息的。

元件不同状态的组合能代表数字系统的数字,因此字符编码就是将符号转换为计算机可以接受的数字系统的数,称为数字代码。

2.常⽤字符集和字符编码常见字符集名称:ASCII字符集、GB2312字符集、BIG5字符集、GB18030字符集、Unicode字符集等。

常用字符编码

ASCII码是一种7位编码,共可以表示128个字符,包括大写字母、小写字母、数字、标点符号和一些特殊字符。

因为只有7位,所以ASCII码的字符集非常有限,只能表示英文字符,无法表示其他国家的文字。

Unicode码是一种全球通用的编码方式,共可以表示超过120万个字符,包括中文汉字、日文汉字、韩文汉字、拉丁文字符等。

Unicode 码采用32位编码,所以可以表示更多的字符。

UTF-8码是Unicode码的一种实现方式,它采用可变长度编码,可以根据字符的不同采用1至4个字节进行编码。

这种编码方式既能表示ASCII码的字符,又能表示Unicode码的字符,是目前最常用的字符编码方式之一。

在使用字符编码时需要注意一些问题,比如在不同的编码方式下,相同的字符可能会被编码成不同的二进制位,导致出现乱码等问题。

此外,在进行数据传输或存储时,也需要选择适合的字符编码方式,以确保数据的正确性和可读性。

- 1 -。

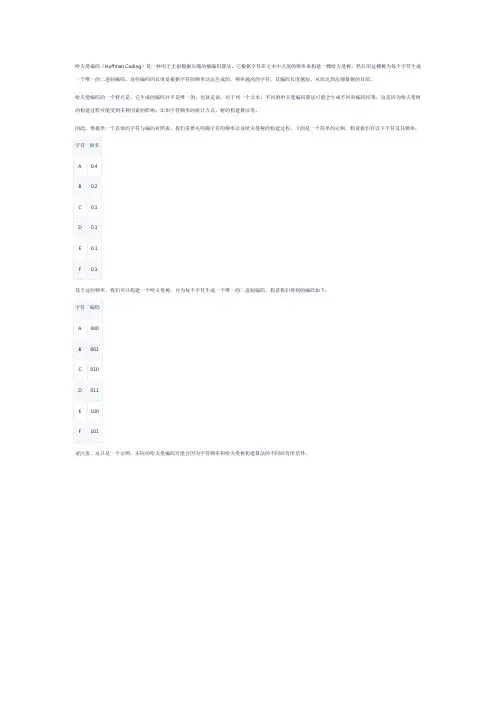

哈夫曼编码(Huffman Coding)是一种用于无损数据压缩的熵编码算法。

它根据字符在文本中出现的频率来构建一棵哈夫曼树,然后用这棵树为每个字符生成一个唯一的二进制编码。

这些编码的长度是根据字符的频率动态生成的,频率越高的字符,其编码长度越短,从而达到压缩数据的目的。

哈夫曼编码的一个特点是,它生成的编码并不是唯一的。

也就是说,对于同一个文本,不同的哈夫曼编码算法可能会生成不同的编码结果。

这是因为哈夫曼树的构建过程可能受到多种因素的影响,比如字符频率的统计方式、树的构建算法等。

因此,要提供一个具体的字符与编码对照表,我们需要先明确字符的频率以及哈夫曼树的构建过程。

下面是一个简单的示例,假设我们有以下字符及其频率:

基于这些频率,我们可以构建一个哈夫曼树,并为每个字符生成一个唯一的二进制编码。

假设我们得到的编码如下:

请注意,这只是一个示例,实际的哈夫曼编码可能会因为字符频率和哈夫曼树构建算法的不同而有所差异。

计算机中的字符编码0. 字符与编码的发展 (1)0.1 字符,字节,字符串 (2)0.2字符集与编码 (3)1. ASCII码 (4)2. 非ASCII编码 (5)3. Unicode (5)3.1 Unicode的问题 (5)4.UTF-8 (6)4.1 Unicode与UTF-8之间的转换 (6)4.2 Little endian和Big endian (7)4.3 实例 (8)4.4 关于BOM (8)5. GB2312 (9)0. 字符与编码的发展从计算机对多国语言的支持角度看,大致可以分为三个阶段:字符串在内存中的存放方法:在 ASCII 阶段,单字节字符串使用一个字节存放一个字符(SBCS)。

比如,"Bob123" 在内存中为:42 6F 62 31 32 33 00B o b 1 2 3 \0在使用 ANSI 编码支持多种语言阶段,每个字符使用一个字节或多个字节来表示(MBCS),因此,这种方式存放的字符也被称作多字节字符。

比如,"中文123" 在中文 Windows 95 内存中为7个字节,每个汉字占2个字节,每个英文和数字字符占1个字节:D6 D0 CE C4 31 32 33 00中文 1 2 3 \0在 UNICODE 被采用之后,计算机存放字符串时,改为存放每个字符在 UNICODE 字符集中的序号。

目前计算机一般使用 2 个字节(16 位)来存放一个序号(DBCS),因此,这种方式存放的字符也被称作宽字节字符。

比如,字符串 "中文123" 在 Windows 2000 下,内存中实际存放的是 5 个序号:2D 4E 87 65 31 00 32 00 33 00 00 00 ←在 x86 CPU 中,低字节在前中文 1 2 3 \0一共占 10 个字节。

0.1 字符,字节,字符串理解编码的关键,是要把字符的概念和字节的概念理解准确。

关于⽹页乱码和字符编码⽅式⽹页出现乱码的原因⼀般是因为字符的编码⽅式不同。

字符编码是计算机技术的基础,对于计算机来说,所有的信息都是0或者1的⼆进制序列,计算机是⽆法直接识别和存储字符的,所以,字符必须经过编码才能被计算机处理。

⼀、两个概念:字符集和字符编码字符集:直观上来讲就是⼈们统计预先规定好的⼀系列字符与⼆进制序列(数字)之间的映射关系。

⽐较常⽤字符集有ASCII、GBK、Unicode等。

但是当我们规定好了字符与数字之间的对应关系,但这并不代表计算机⼀定要按照字符对应的数字将数字本⾝直接存储,所以,我们需要设定⼀种规则,将这些字符的码元再次处理,使之更加适应计算机存储、⽹络传输的需要。

字符编码,就是规定了如何编码、存储这些字符对应的⼆进制序列。

所以,字符集是⼀种协议,⽽字符编码就是对字符集更好实现的⼀种规则,所以,⼀种字符集就有了不同的编码⽅式。

⼆、常见的编码⽅式:Unicode、ASCII、GBK、GB2312、UTF-8三、关于ASCII码这是美国在19世纪60年代的时候为了建⽴英⽂字符和⼆进制的关系时制定的编码规范,它能表⽰128个字符,其中包括英⽂字符、阿拉伯数字、西⽂字符以及32个控制字符。

它⽤⼀个字节来表⽰具体的字符,但它只⽤后7位来表⽰字符(2^7=128),最前⾯的⼀位统⼀规定为0。

四、扩展的ASCII码原本的ASCII码对于英⽂语⾔的国家是够⽤了,但是欧洲国家的⼀些语⾔会有拼⾳,这时7个字节就不够⽤了。

因此⼀些欧洲国家就决定,利⽤字节中闲置的最⾼位编⼊新的符号。

⽐如,法语中的é的编码为130(⼆进制10000010)。

这样⼀来,这些欧洲国家使⽤的编码体系,可以表⽰最多256个符号。

但这时问题也出现了:不同的国家有不同的字母,因此,哪怕它们都使⽤256个符号的编码⽅式,代表的字母却不⼀样。

⽐如,130在法语编码中代表了é,在希伯来语编码中却代表了字母Gimel (ג),在俄语编码中⼜会代表另⼀个符号。

字符集和字符编码格式有什么区别和作用?导读:字符集和字符编码格式有什么区别和作用?为什么码好的代码在别人的电脑上运行会出现乱码?其实主要问题在于计算机存储介质中存放的二进制比特流。

如果字符集和字符编码两者之间的转换规则不统一标准,就会乱码现象。

字符集和字符编码格式有什么区别和作用?在介绍字符集之前,我们先了解下为什么要有字符集。

我们在计算机屏幕上看到的是实体化的文字,而在计算机存储介质中存放的实际是二进制的比特流。

那么在这两者之间的转换规则就需要一个统一的标准,否则把我们的U盘插到别的电脑上,文档就乱码了;小伙伴QQ上传过来的文件,在我们本地打开又乱码了。

什么是字符集?在介绍字符集之前,我们先了解下为什么要有字符集。

我们在计算机屏幕上看到的是实体化的文字,而在计算机存储介质中存放的实际是二进制的比特流。

那么在这两者之间的转换规则就需要一个统一的标准,否则把我们的U盘插到老板的电脑上,文档就乱码了;小伙伴QQ上传过来的文件,在我们本地打开又乱码了。

于是为了实现转换标准,各种字符集标准就出现了。

简单的说字符集就规定了某个文字对应的二进制数字存放方式(编码)和某串二进制数值代表了哪个文字(解码)的转换关系。

那么为什么会有那么多字符集标准呢?这个问题实际非常容易回答。

问问自己为什么我们的插头拿到英国就不能用了呢?为什么显示器同时有DVI,VGA,HDMI,DP这么多接口呢?很多规范和标准在最初制定时并不会意识到这将会是以后全球普适的准则,或者处于组织本身利益就想从本质上区别于现有标准。

于是,就产生了那么多具有相同效果但又不相互兼容的标准了。

说了那么多我们来看一个实际例子,下面就是屌这个字在各种编码下的十六进制和二进制编码结果,怎么样有没有一种很屌的感觉?什么是字符编码?字符集只是一个规则集合的名字,对应到真实生活中,字符集就是对某种语言的称呼。

例如:英语,汉语,日语。

对于一个字符集来说要正确编码转码一个字符需要三个关键元素:字库表(character repertoire)、编码字符集(coded character set)、字符编码(character encoding form)。

Python的字符串和编码1. 字符编码 字符串也是⼀种数据类型,但是,字符串⽐较特殊的是还有⼀个编码问题。

因为计算机只能处理数字,如果要处理⽂本,就必须先把⽂本转换为数字才能处理。

最早的计算机在设计时采⽤8个⽐特(bit)作为⼀个字节(byte),所以,⼀个字节能表⽰的最⼤的整数就是255(⼆进制11111111=⼗进制255),如果要表⽰更⼤的整数,就必须⽤更多的字节。

⽐如两个字节可以表⽰的最⼤整数是65535,4个字节可以表⽰的最⼤整数是4294967295。

由于计算机是美国⼈发明的,因此,最早只有127个字符被编码到计算机⾥,也就是⼤⼩写英⽂字母、数字和⼀些符号,这个编码表被称为ASCII编码,⽐如⼤写字母A的编码是65,⼩写字母z的编码是122。

但是要处理中⽂显然⼀个字节是不够的,⾄少需要两个字节,⽽且还不能和ASCII编码冲突,所以,中国制定了GB2312编码,⽤来把中⽂编进去。

你可以想得到的是,全世界有上百种语⾔,⽇本把⽇⽂编到Shift_JIS⾥,韩国把韩⽂编到Euc-kr⾥,各国有各国的标准,就会不可避免地出现冲突,结果就是,在多语⾔混合的⽂本中,显⽰出来会有乱码。

因此,Unicode字符集应运⽽⽣。

Unicode把所有语⾔都统⼀到⼀套编码⾥,这样就不会再有乱码问题了。

Unicode标准也在不断发展,但最常⽤的是UCS-16编码,⽤两个字节表⽰⼀个字符(如果要⽤到⾮常偏僻的字符,就需要4个字节)。

现代操作系统和⼤多数编程语⾔都直接⽀持Unicode。

现在,捋⼀捋ASCII编码和Unicode编码的区别:ASCII编码是1个字节,⽽Unicode编码通常是2个字节。

字母A⽤ASCII编码是⼗进制的65,⼆进制的01000001; 字符0⽤ASCII编码是⼗进制的48,⼆进制的00110000,注意字符'0'和整数0是不同的; 汉字中已经超出了ASCII编码的范围,⽤Unicode编码是⼗进制的20013,⼆进制的0100111000101101。

编程语言中的字符集与字符编码的关系在计算机编程中,字符集和字符编码是两个非常重要的概念。

字符集是指一组字符的集合,而字符编码则是将这些字符映射到计算机内部表示的数字的规则。

字符集和字符编码之间的关系密切,理解它们之间的关系对于编程工程师来说至关重要。

一、字符集的定义与作用字符集是指一组字符的集合,可以包含字母、数字、标点符号、特殊字符等。

常见的字符集包括ASCII、Unicode等。

ASCII字符集是最早的字符集之一,它包含了128个字符,包括英文字母、数字和一些常用的符号。

ASCII字符集使用7位二进制数表示一个字符,因此最多可以表示128个字符。

随着计算机的普及和发展,ASCII字符集已经不能满足所有语言的需求。

为了解决这个问题,Unicode字符集应运而生。

Unicode字符集是一种全球字符集,它包含了几乎所有语言的字符。

Unicode字符集使用32位二进制数表示一个字符,因此最多可以表示4294967296个字符。

二、字符编码的定义与作用字符编码是将字符映射到计算机内部表示的数字的规则。

计算机内部只能处理二进制数据,因此需要将字符转换为二进制表示。

常见的字符编码包括ASCII编码、UTF-8编码等。

ASCII编码是最早的字符编码之一,它将字符映射到一个7位的二进制数。

由于ASCII编码只能表示128个字符,无法满足所有语言的需求。

为了解决这个问题,出现了扩展的ASCII编码,如ISO-8859系列。

这些编码使用8位二进制数表示一个字符,可以表示更多的字符。

然而,随着Unicode字符集的出现,为了节省存储空间和传输带宽,出现了一种变长的字符编码,即UTF-8编码。

UTF-8编码根据字符的不同,使用1到4个字节表示一个字符。

对于ASCII字符,UTF-8编码与ASCII编码完全兼容,只使用一个字节表示;对于非ASCII字符,UTF-8编码使用多个字节表示。

三、字符集与字符编码的关系字符集和字符编码是密不可分的。

0x1 鼠标左键0x2 鼠标右键0x3 CANCEL 键0x4 鼠标中键0x8 BACKSPACE 键0x9 TAB 键0xC CLEAR 键0xD ENTER 键0x10 SHIFT 键0x11 CTRL 键0x12 MENU 键0x13 PAUSE 键0x14 CAPS LOCK 键0x1B ESC 键0x20 SPACEBAR 键0x21 PAGE UP 键0x22 PAGE DOWN 键0x23 END 键0x24 HOME 键0x25 LEFT ARROW 键0x26 UP ARROW 键0x27 RIGHT ARROW 键0x28 DOWN ARROW 键0x29 SELECT 键0x2A PRINT SCREEN 键0x2B EXECUTE 键0x2C SNAPSHOT 键0x2D INSERT 键0x2E DELETE 键0x2F HELP 键0x90 NUM LOCK 键A 至Z 键与 A – Z 字母的ASCII 码相同:值描述65 A 键66 B 键67 C 键69 E 键70 F 键71 G 键72 H 键73 I 键74 J 键75 K 键76 L 键77 M 键78 N 键79 O 键80 P 键81 Q 键82 R 键83 S 键84 T 键85 U 键86 V 键88 X 键89 Y 键90 Z 键97 a98 b99 c 100 d 101 e 102 f 103 g 104 h 105 i 106 j 107 k 108 l 109 m 110 n 111 o 112 p 113 q 114 r 115 s 116 t 117 u 118 v 119 w120 x121 y122 z0 至9 键与数字0 – 9 的ASCII 码相同:值描述48 0 键49 1 键50 2 键51 3 键52 4 键53 5 键54 6 键55 7 键56 8 键57 9 键下列常数代表数字键盘上的键:值描述0x60 0 键0x62 2 键0x63 3 键0x64 4 键0x65 5 键0x66 6 键0x67 7 键0x68 8 键0x69 9 键0x6A MULTIPLICATION SIGN (*) 键0x6B PLUS SIGN (+) 键0x6C ENTER 键0x6D MINUS SIGN (–) 键0x6E DECIMAL POINT (.) 键0x6F DIVISION SIGN (/) 键下列常数代表功能键:值描述0x70 F1 键0x72 F3 键0x73 F4 键0x74 F5 键0x75 F6 键0x76 F7 键0x77 F8 键0x78 F9 键0x79 F10 键0x7A F11 键0x7B F12 键0x7C F13 键0x7D F14 键0x7E F15 键0x7F F16 键。

最常用的字母与字符的编码介绍在计算机科学和信息技术领域,字符编码是将字符映射到数字的过程。

最常用的字符编码是ASCII码(American Standard Code for Information Interchange),它使用7位二进制数表示128个字符,包括大写和小写字母、数字、标点符号和一些控制字符。

然而,随着计算机的发展和国际化的需求,ASCII码已经不足以满足各种语言和特殊字符的编码需求。

因此,出现了更多的字符编码标准,如Unicode和UTF-8。

ASCII码ASCII码是最早的字符编码标准,它于1963年被制定,并在计算机领域广泛使用。

ASCII码使用7位二进制数(0-127)表示128个字符,其中包括了大写和小写字母、数字、标点符号和一些控制字符。

例如,字符’A’的ASCII码是65,字符’a’的ASCII码是97。

ASCII码的编码范围非常有限,只能表示英文字符和一些常用的符号,对于其他语言和特殊字符的编码无法满足需求。

UnicodeUnicode是一种更为全面的字符编码标准,它包含了世界上几乎所有的字符,无论是字母、数字、标点符号,还是各种语言和特殊字符。

Unicode使用32位二进制数表示字符,可以表示超过100万个字符。

Unicode的编码范围非常广泛,可以满足各种语言和特殊字符的需求。

例如,字符’中’的Unicode编码是20013,字符’?’的Unicode编码是128522。

UTF-8UTF-8是Unicode的一种变长字符编码方式,它可以使用1至4个字节表示一个字符,根据字符的不同而变化。

UTF-8编码可以兼容ASCII码,即ASCII码中的字符仍然使用1个字节表示,而非ASCII码的字符则使用2至4个字节表示。

UTF-8编码在互联网上广泛使用,它可以表示几乎所有的字符,同时兼顾了存储空间和传输效率。

最常用的字母编码在英文文本中,有一些字母出现的频率比其他字母更高。