实验3--感知器神经网络的实现

- 格式:doc

- 大小:73.00 KB

- 文档页数:2

神经网络实验报告神经网络实验报告引言:神经网络是一种模仿人脑神经元网络结构和功能的计算模型,它通过学习和训练来实现模式识别、分类和预测等任务。

本次实验旨在探索神经网络的基本原理和应用,并通过实践验证其效果。

一、神经网络的基本原理1.1 神经元模型神经元是神经网络的基本单元,它接收来自其他神经元的输入信号,并通过激活函数进行处理后输出。

我们采用的是Sigmoid函数作为激活函数,它能够将输入信号映射到0到1之间的值。

1.2 神经网络结构神经网络由输入层、隐藏层和输出层组成。

输入层接收外部输入的数据,隐藏层用于处理和提取特征,输出层给出最终的预测结果。

隐藏层的数量和每层神经元的数量是根据具体问题而定的。

1.3 反向传播算法反向传播算法是神经网络中最常用的训练算法,它通过计算误差和调整权重来不断优化网络的预测能力。

具体而言,它首先进行前向传播计算得到预测结果,然后计算误差,并通过链式法则将误差反向传播到每个神经元,最后根据误差调整权重。

二、实验设计2.1 数据集选择本次实验选择了一个手写数字识别的数据集,其中包含了大量的手写数字图片和对应的标签。

这个数据集是一个经典的机器学习数据集,可以用来评估神经网络的分类能力。

2.2 神经网络参数设置为了探究神经网络的性能和泛化能力,我们设置了不同的参数组合进行实验。

主要包括隐藏层数量、每层神经元数量、学习率和训练轮数等。

2.3 实验步骤首先,我们将数据集进行预处理,包括数据归一化和标签编码等。

然后,将数据集划分为训练集和测试集,用于训练和评估网络的性能。

接下来,根据不同的参数组合构建神经网络,并使用反向传播算法进行训练。

最后,通过测试集评估网络的分类准确率和损失函数值。

三、实验结果与分析3.1 参数优化我们通过对不同参数组合的实验进行比较,找到了在手写数字识别任务上表现最好的参数组合。

具体而言,我们发现增加隐藏层数量和神经元数量可以提高网络的分类准确率,但同时也会增加训练时间。

一、实验背景随着人工智能技术的飞速发展,神经网络作为一种强大的机器学习模型,在各个领域得到了广泛应用。

为了更好地理解神经网络的原理和应用,我们进行了一系列的实训实验。

本报告将详细记录实验过程、结果和分析。

二、实验目的1. 理解神经网络的原理和结构。

2. 掌握神经网络的训练和测试方法。

3. 分析不同神经网络模型在特定任务上的性能差异。

三、实验内容1. 实验一:BP神经网络(1)实验目的:掌握BP神经网络的原理和实现方法,并在手写数字识别任务上应用。

(2)实验内容:- 使用Python编程实现BP神经网络。

- 使用MNIST数据集进行手写数字识别。

- 分析不同学习率、隐层神经元个数对网络性能的影响。

(3)实验结果:- 在MNIST数据集上,网络在训练集上的准确率达到98%以上。

- 通过调整学习率和隐层神经元个数,可以进一步提高网络性能。

2. 实验二:卷积神经网络(CNN)(1)实验目的:掌握CNN的原理和实现方法,并在图像分类任务上应用。

(2)实验内容:- 使用Python编程实现CNN。

- 使用CIFAR-10数据集进行图像分类。

- 分析不同卷积核大小、池化层大小对网络性能的影响。

(3)实验结果:- 在CIFAR-10数据集上,网络在训练集上的准确率达到80%以上。

- 通过调整卷积核大小和池化层大小,可以进一步提高网络性能。

3. 实验三:循环神经网络(RNN)(1)实验目的:掌握RNN的原理和实现方法,并在时间序列预测任务上应用。

(2)实验内容:- 使用Python编程实现RNN。

- 使用Stock数据集进行时间序列预测。

- 分析不同隐层神经元个数、学习率对网络性能的影响。

(3)实验结果:- 在Stock数据集上,网络在训练集上的预测准确率达到80%以上。

- 通过调整隐层神经元个数和学习率,可以进一步提高网络性能。

四、实验分析1. BP神经网络:BP神经网络是一种前向传播和反向传播相结合的神经网络,适用于回归和分类问题。

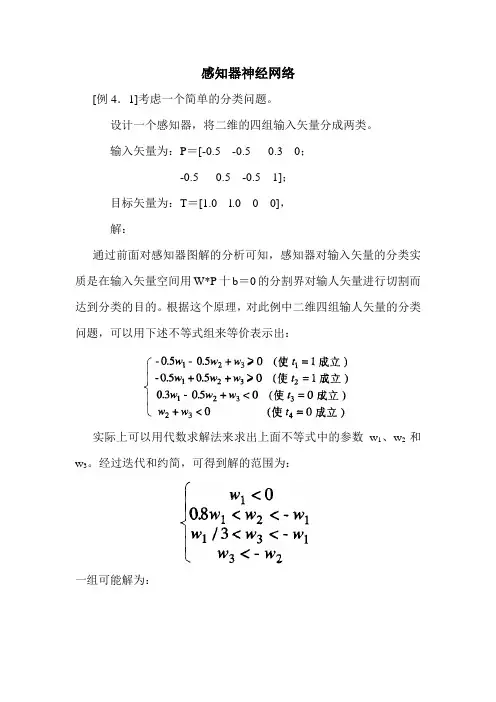

感知器神经网络[例4.1]考虑一个简单的分类问题。

设计一个感知器,将二维的四组输入矢量分成两类。

输入矢量为:P=[-0.5 -0.5 0.3 0;-0.5 0.5 -0.5 1];目标矢量为:T=[1.0 l.0 0 0],解:通过前面对感知器图解的分析可知,感知器对输入矢量的分类实质是在输入矢量空间用W*P十b=0的分割界对输人矢量进行切割而达到分类的目的。

根据这个原理,对此例中二维四组输人矢量的分类问题,可以用下述不等式组来等价表示出:实际上可以用代数求解法来求出上面不等式中的参数w1、w2和w3。

经过迭代和约简,可得到解的范围为:一组可能解为:而当采用感知器神经网络来对此题进行求解时,意味着采用具有阈值激活函数的神经网络,按照问题的要求设计网络的模型结构,通过训练网络权值W=[w11,w12]和b,并根据学习算法和训练过程进行程序编程,然后运行程序,让网络自行训练其权矢量,直至达到不等式组的要求。

鉴于输入和输出目标矢量已由问题本身确定,所以所需实现其分类功能的感知器网络结构的输人节点r,以及输出节点数,已被问题所确定而不能任意设置。

根据题意,网络结构图如图4.5所示。

图4.5 网络结构图由此可见,对于单层网络,网络的输入神经元数r和输出神经元数s分别由输入矢量P和目标矢量T唯一确定。

网络的权矩阵的维数为:W s×r,B s×1权值总数为s×r个,偏差个数为s个。

在确定了网络结构并设置了最大循环次数和赋予权值初始值后,设计者可方便地利用MATLAB,根据题意以及感知器的学习、训练过程来编写自己的程序。

下面是对[例4.1]所编写的网络权值训练用的MATLAB程序:%percep1.m%P=[—0.5 —0.5 0.3 0;—0.5 0.5 —0.5 1];T=[1,1,0,0];%初始化[R, Q]=size(P);[S, Q]=size(T);W=rands(S,R);B=rands(S, 1);max_epoch=20;%表达式A=hardlim(W*P,B);%求网络输出for epoch=1:max_epoch %开始循环训练、修正权值过程%检查if all(A==T) %当A=T时结束epoch=epoch-1;beakend%学习[dW, dB]=learnp(P, A, T); %感知器学习公式W=W十dw;B=B十dB;A=hardlim(W*P,B);%计算权值修正后的网络输出end %程序结束以上就是根据前面所阐述的感知器训练的三个步骤:表达式、检查和学习而编写的MATLAB网络设计的程序。

一、实验目的与要求1. 掌握神经网络的原理和基本结构;2. 学会使用Python实现神经网络模型;3. 利用神经网络对手写字符进行识别。

二、实验内容与方法1. 实验背景随着深度学习技术的不断发展,神经网络在各个领域得到了广泛应用。

在手写字符识别领域,神经网络具有较好的识别效果。

本实验旨在通过实现神经网络模型,对手写字符进行识别。

2. 神经网络原理神经网络是一种模拟人脑神经元结构的计算模型,由多个神经元组成。

每个神经元接收来自前一个神经元的输入,通过激活函数处理后,输出给下一个神经元。

神经网络通过学习大量样本,能够自动提取特征并进行分类。

3. 实验方法本实验采用Python编程语言,使用TensorFlow框架实现神经网络模型。

具体步骤如下:(1)数据预处理:从公开数据集中获取手写字符数据,对数据进行归一化处理,并将其分为训练集和测试集。

(2)构建神经网络模型:设计网络结构,包括输入层、隐藏层和输出层。

输入层用于接收输入数据,隐藏层用于提取特征,输出层用于输出分类结果。

(3)训练神经网络:使用训练集对神经网络进行训练,调整网络参数,使模型能够准确识别手写字符。

(4)测试神经网络:使用测试集对训练好的神经网络进行测试,评估模型的识别效果。

三、实验步骤与过程1. 数据预处理(1)从公开数据集中获取手写字符数据,如MNIST数据集;(2)对数据进行归一化处理,将像素值缩放到[0, 1]区间;(3)将数据分为训练集和测试集,比例约为8:2。

2. 构建神经网络模型(1)输入层:输入层节点数与数据维度相同,本实验中为28×28=784;(2)隐藏层:设计一个隐藏层,节点数为128;(3)输出层:输出层节点数为10,对应10个类别。

3. 训练神经网络(1)定义损失函数:均方误差(MSE);(2)选择优化算法:随机梯度下降(SGD);(3)设置学习率:0.001;(4)训练次数:10000;(5)在训练过程中,每100次迭代输出一次训练损失和准确率。

一、实验背景感知器算法是一种简单的线性二分类模型,由Frank Rosenblatt于1957年提出。

它是一种基于误分类项进行学习,以调整权重来拟合数据集的算法。

感知器算法适用于线性可分的数据集,能够将数据集中的样本正确分类。

本次实验旨在通过编程实现感知器算法,并使用iris数据集进行验证。

通过实验,我们能够熟悉感知器算法的基本原理,了解其优缺点,并掌握其在实际应用中的使用方法。

二、实验目的1. 理解感知器算法的基本原理;2. 编程实现感知器算法;3. 使用iris数据集验证感知器算法的性能;4. 分析感知器算法的优缺点。

三、实验环境1. 操作系统:Windows 102. 编程语言:Python3. 机器学习库:Scipy、Numpy、Matplotlib、sklearn四、实验步骤1. 导入必要的库```pythonimport numpy as npimport matplotlib.pyplot as pltfrom sklearn import datasetsfrom sklearn.model_selection import train_test_split```2. 读取iris数据集```pythoniris = datasets.load_iris()X = iris.datay = iris.target```3. 将数据集划分为训练集和测试集```pythonX_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)```4. 编写感知器算法```pythondef perceptron(X, y, w, b, learning_rate):for i in range(len(X)):if np.dot(X[i], w) + b <= 0:w += learning_rate y[i] X[i]b += learning_rate y[i]return w, b```5. 训练感知器模型```pythonlearning_rate = 0.1max_iter = 100w = np.zeros(X.shape[1])b = 0for _ in range(max_iter):w, b = perceptron(X_train, y_train, w, b, learning_rate)```6. 评估感知器模型```pythondef predict(X, w, b):return np.sign(np.dot(X, w) + b)y_pred = predict(X_test, w, b)accuracy = np.mean(y_pred == y_test)print("感知器算法的准确率:", accuracy)```7. 可视化感知器模型```pythondef plot_decision_boundary(X, y, w, b):plt.figure(figsize=(8, 6))plt.scatter(X[:, 0], X[:, 1], c=y, cmap=plt.cm.Paired,edgecolors='k', marker='o')x_min, x_max = X[:, 0].min() - 1, X[:, 0].max() + 1y_min, y_max = X[:, 1].min() - 1, X[:, 1].max() + 1xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.1), np.arange(y_min, y_max, 0.1))Z = np.dot(np.c_[xx.ravel(), yy.ravel()], w) + bZ = Z.reshape(xx.shape)plt.contourf(xx, yy, Z, alpha=0.4)plt.xlabel("Sepal length (cm)")plt.ylabel("Sepal width (cm)")plt.title("Perceptron Decision Boundary")plt.show()plot_decision_boundary(X_train, y_train, w, b)```五、实验结果与分析1. 感知器算法的准确率为约0.9,说明感知器算法在iris数据集上表现良好。

BP神经网络实验2010年12月目录1自主学习模块 (2)1.1书面回答预习问题 (2)1.1.1训练神经网络网络之前,需要进行的三个步骤的准备工作是什么? (2)1.1.2神经网络(例如BP 训练仪)训练的中止条件是什么? (2)1.1.3如何根据检验结果判断训练好的网络可用来实测? (2)1.2远程测控实验室网上学习与练习 (2)1.2.1经典常规传感器的交叉敏感与传感器的稳定性 (2)1.2.2多传感器数据融合改善传感器稳定性的基本原理 (3)1.2.3数据融合算法简介 (4)1.2.4 BP神经网络 (6)2自主训练模块 (12)2.1实验目的 (12)2.2实验内容 (12)2.2.1基本训练部分一 (12)2.2.2基本训练部分二 (14)2.2.3用BP 网络训练仪消除压力传感器对工作电流的交叉敏感,提高压力测量精度 (19)2.2.4 组建智能压力传感器系统 (22)3自主应用模块 (23)3.1实验目的 (23)3.2实验内容 (23)3.3实验步骤 (23)3.3.1 消除压力传感器对温度的交叉敏感 (24)3.3.2消除压力传感器对电流的交叉敏感 (26)4.自主提高模块 (27)4.1 神经网络结构的移植与实测 (27)4.2思考问题 (28)1自主学习模块1.1书面回答预习问题1.1.1训练神经网络网络之前,需要进行的三个步骤的准备工作是什么?训练神经网络网络之前,需要进行的三个步骤的准备工作是:准备训练样本、根据实际情况设置神经网络各层节点数及测量误差目标值与迭代次数(反向传播次数)、输入样本训练及检验。

1.1.2神经网络(例如BP 训练仪)训练的中止条件是什么?将网络输出结果与期望输出样本比较,计算其偏差。

若偏差小于给定的目标值,则训练结束;反之,则要调整网络结构参数,进行新的网络训练,直至偏差小于目标值。

如设置网络训练终止条件:如训练代数为1000,均方差指标为1*10-61.1.3如何根据检验结果判断训练好的网络可用来实测?将检验输入样本输入训练好的网络,并计算网络输出结果与期望输出样本的偏差。

一、实验目的通过本次实验,我们旨在了解大脑神经元之间传递信号的过程,从而探讨决策、记忆和学习等认知功能。

通过使用MATLAB软件,我们模拟了不同数值模型在大脑神经元之间的信号传递过程,并对实验结果进行分析和讨论。

二、实验方法1. 实验材料(1)MATLAB软件(2)实验数据:神经元模型参数、突触权重、神经元数量等2. 实验步骤(1)单神经元模型:使用欧拉方法对积分和发射模型进行编码,以近似估算不同的电流I。

(2)神经网络:对环形网络的活动进行编码,该网络提供正反馈以关闭神经元,而负反馈则向较远的神经元提供反馈。

然后提供一个输入,该输入也取决于每个神经元的方向。

最后,测试有无连接时输入方向的变化如何影响神经元活动。

(3)学习与记忆:实现Bienenstock-Cooper-Munro(BCM)学习规则,在每次模拟开始时随机选择的两种输入模式。

在两个神经元之间执行尖峰时序相关可塑性(STDP),其中重量变化取决于与突触前神经元尖峰的时间差。

实现感知器以根据体重变化学习模式。

三、实验结果与分析1. 单神经元模型通过欧拉方法对积分和发射模型进行编码,我们得到了不同电流I下的神经元活动情况。

实验结果表明,当电流I增加时,神经元活动频率也随之增加,神经元放电阈值得到满足。

2. 神经网络在环形网络中,我们观察到正反馈和负反馈对神经元活动的影响。

实验结果表明,当存在连接时,输入方向的变化对神经元活动的影响较大;而当不存在连接时,输入方向的变化对神经元活动的影响较小。

3. 学习与记忆通过实现BCM学习规则,我们模拟了神经元之间的学习过程。

实验结果表明,在每次模拟开始时随机选择的两种输入模式下,神经元能够通过学习规则调整突触权重,从而实现输入模式的学习。

此外,我们通过实现STDP和感知器,进一步探讨了学习与记忆的过程。

实验结果表明,STDP能够使神经元在尖峰时序相关可塑性过程中调整突触权重,从而提高学习效果。

感知器能够根据体重变化学习模式,从而实现输入模式的学习。

多层感知器--MLP神经⽹络算法提到⼈⼯智能(Artificial Intelligence,AI),⼤家都不会陌⽣,在现今⾏业领起风潮,各⾏各业⽆不趋之若鹜,作为技术使⽤者,到底什么是AI,我们要有⾃⼰的理解.⽬前,在⼈⼯智能中,⽆可争议的是深度学习占据了统治地位,,其在图像识别,语⾳识别,⾃然语⾔处理,⽆⼈驾驶领域应⽤⼴泛.如此,我们要如何使⽤这门技术呢?下⾯我们来⼀起了解"多层感知器",即MLP算法,泛称为神经⽹络.神经⽹络顾名思义,就像我们⼈脑中的神经元⼀样,为了让机器来模拟⼈脑,我们在算法中设置⼀个个节点,在训练模型时,输⼊的特征与预测的结果⽤节点来表⽰,系数w(⼜称为"权重")⽤来连接节点,神经⽹络模型的学习就是⼀个调整权重的过程,训练模型⼀步步达到我们想要的效果.理解了原理,下⾯来上代码直观看⼀下:1.神经⽹络中的⾮线性矫正每个输⼊数据与输出数据之间都有⼀个或多个隐藏层,每个隐藏层包含多个隐藏单元.在输⼊数据和隐藏单元之间或隐藏单元和输出数据之间都有⼀个系数(权重).计算⼀系列的加权求和和计算单⼀的加权求和和普通的线性模型差不多.线性模型的⼀般公式:y = w[0]▪x[0]+w[1]▪x[1] + ▪▪▪ + w[p]▪x[p] + b为了使得模型⽐普通线性模型更强⼤,所以我们要进⾏⼀些处理,即⾮线性矫正(rectifying nonlinearity),简称为(rectified linear unit,relu).或是进⾏双曲正切处理(tangens hyperbolicus,tanh)############################# 神经⽹络中的⾮线性矫正 ########################################导⼊numpyimport numpy as np#导⼊画图⼯具import matplotlib.pyplot as plt#导⼊numpyimport numpy as py#导⼊画图⼯具import matplotlib.pyplot as plt#⽣成⼀个等差数列line = np.linspace(-5,5,200)#画出⾮线性矫正的图形表⽰plt.plot(line,np.tanh(line),label='tanh')plt.plot(line,np.maximum(line,0),label='relu')#设置图注位置plt.legend(loc='best')#设置横纵轴标题plt.xlabel('x')plt.ylabel('relu(x) and tanh(x)')#显⽰图形plt.show()tanh函数吧特征X的值压缩进-1到1的区间内,-1代表的是X中较⼩的数值,⽽1代表X中较⼤的数值.relu函数把⼩于0的X值全部去掉,⽤0来代替2.神经⽹络的参数设置#导⼊MLP神经⽹络from sklearn.neural_network import MLPClassifier#导⼊红酒数据集from sklearn.datasets import load_wine#导⼊数据集拆分⼯具from sklearn.model_selection import train_test_splitwine = load_wine()X = wine.data[:,:2]y = wine.target#下⾯我们拆分数据集X_train,X_test,y_train,y_test = train_test_split(X,y,random_state=0)#接下来定义分类器mlp = MLPClassifier(solver='lbfgs')mlp.fit(X_train,y_train)MLPClassifier(activation='relu', alpha=0.0001, batch_size='auto', beta_1=0.9,beta_2=0.999, early_stopping=False, epsilon=1e-08,hidden_layer_sizes=(100,), learning_rate='constant',learning_rate_init=0.001, max_iter=200, momentum=0.9,n_iter_no_change=10, nesterovs_momentum=True, power_t=0.5,random_state=None, shuffle=True, solver='lbfgs', tol=0.0001,validation_fraction=0.1, verbose=False, warm_start=False)identity对样本特征不做处理,返回值是f(x) = xlogistic返回的结果会是f(x)=1/[1 + exp(-x)],其和tanh类似,但是经过处理后的特征值会在0和1之间#导⼊画图⼯具import matplotlib.pyplot as pltfrom matplotlib.colors import ListedColormap#定义图像中分区的颜⾊和散点的颜⾊cmap_light = ListedColormap(['#FFAAAA','#AAFFAA','#AAAAFF'])cmap_bold = ListedColormap(['#FF0000','#00FF00','#0000FF'])#分别⽤样本的两个特征值创建图像和横轴和纵轴x_min,x_max = X_train[:, 0].min() - 1,X_train[:, 0].max() + 1y_min,y_max = X_train[:, 1].min() - 1,X_train[:, 1].max() + 1xx,yy = np.meshgrid(np.arange(x_min,x_max, .02),np.arange(y_min,y_max, .02))Z = mlp.predict(np.c_[xx.ravel(),yy.ravel()])#给每个分类中的样本分配不同的颜⾊Z = Z.reshape(xx.shape)plt.figure()plt.pcolormesh(xx, yy, Z, cmap=cmap_light)#⽤散点图把样本表⽰出来plt.scatter(X[:, 0],X[:, 1],c=y,edgecolor='k',s=60)plt.xlim(xx.min(),xx.max())plt.ylim(yy.min(),yy.max())plt.title("MLPClassifier:solver=lbfgs")plt.show()(1)设置隐藏层中节点数为10#设置隐藏层中节点数为10mlp_20 = MLPClassifier(solver='lbfgs',hidden_layer_sizes=[10])mlp_20.fit(X_train,y_train)Z1 = mlp_20.predict(np.c_[xx.ravel(),yy.ravel()])#给每个分类中的样本分配不同的颜⾊Z1 = Z1.reshape(xx.shape)plt.figure()plt.pcolormesh(xx, yy, Z1, cmap=cmap_light)#⽤散点图把样本表⽰出来plt.scatter(X[:, 0],X[:, 1],c=y,edgecolor='k',s=60)plt.xlim(xx.min(),xx.max())plt.ylim(yy.min(),yy.max())plt.title("MLPClassifier:nodes=10")plt.show()(2)设置神经⽹络有两个节点数为10的隐藏层#设置神经⽹络2个节点数为10的隐藏层mlp_2L = MLPClassifier(solver='lbfgs',hidden_layer_sizes=[10,10])mlp_2L.fit(X_train,y_train)ZL = mlp_2L.predict(np.c_[xx.ravel(),yy.ravel()])#给每个分类中的样本分配不同的颜⾊ZL = ZL.reshape(xx.shape)plt.figure()plt.pcolormesh(xx, yy, ZL, cmap=cmap_light)#⽤散点图把样本表⽰出来plt.scatter(X[:, 0],X[:, 1],c=y,edgecolor='k',s=60)plt.xlim(xx.min(),xx.max())plt.ylim(yy.min(),yy.max())plt.title("MLPClassifier:2layers")plt.show()(3)设置激活函数为tanh#设置激活函数为tanhmlp_tanh = MLPClassifier(solver='lbfgs',hidden_layer_sizes=[10,10],activation='tanh')mlp_tanh.fit(X_train,y_train)Z2 = mlp_tanh.predict(np.c_[xx.ravel(),yy.ravel()])#给每个分类中的样本分配不同的颜⾊Z2 = Z2.reshape(xx.shape)plt.figure()plt.pcolormesh(xx, yy, Z2, cmap=cmap_light)#⽤散点图把样本表⽰出来plt.scatter(X[:, 0],X[:, 1],c=y,edgecolor='k',s=60)plt.xlim(xx.min(),xx.max())plt.ylim(yy.min(),yy.max())plt.title("MLPClassifier:2layers with tanh")plt.show()(4)修改模型的alpha参数#修改模型的alpha参数mlp_alpha = MLPClassifier(solver='lbfgs',hidden_layer_sizes=[10,10],activation='tanh',alpha=1)mlp_alpha.fit(X_train,y_train)Z3 = mlp_alpha.predict(np.c_[xx.ravel(),yy.ravel()])#给每个分类中的样本分配不同的颜⾊Z3 = Z3.reshape(xx.shape)plt.figure()plt.pcolormesh(xx, yy, Z3, cmap=cmap_light)#⽤散点图把样本表⽰出来plt.scatter(X[:, 0],X[:, 1],c=y,edgecolor='k',s=60)plt.xlim(xx.min(),xx.max())plt.ylim(yy.min(),yy.max())plt.title("MLPClassifier:alpha=1")plt.show()总结: 如此,我们有4种⽅法可以调节模型的复杂程度: 第⼀种,调整神经⽹络每⼀个隐藏层上的节点数 第⼆种,调节神经⽹络隐藏层的层数 第三种,调节activation的⽅式 第四种,通过调整alpha值来改变模型正则化的过程 对于特征类型⽐较单⼀的数据集来说,神经⽹络的表现还是不错的,但是如果数据集中的特征类型差异⽐较⼤的话,随机森林或梯度上升随机决策树等基于决策树的算法的表现会更好⼀点. 神经⽹络模型中的参数调节⾄关重要,尤其是隐藏层的数量和隐藏层中的节点数. 这⾥给出⼀个参考原则:神经⽹络中的隐藏层的节点数约等于训练数据集的特征数量,但⼀般不超过500. 如果想对庞⼤复杂⾼维的数据集做处理与分析,建议往深度学习发展,这⾥介绍两个流⾏的python深度学习库:keras,tensor-flow⽂章引⾃ : 《深⼊浅出python机器学习》。

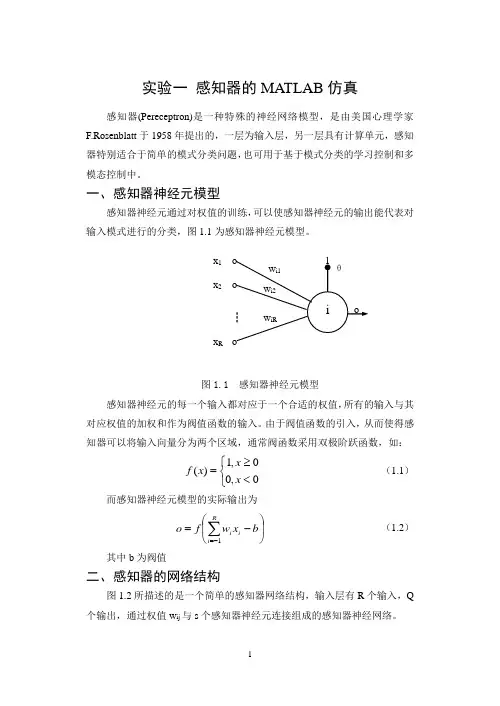

实验一 感知器的MATLAB 仿真感知器(Pereceptron)是一种特殊的神经网络模型,是由美国心理学家F.Rosenblatt 于1958年提出的,一层为输入层,另一层具有计算单元,感知器特别适合于简单的模式分类问题,也可用于基于模式分类的学习控制和多模态控制中。

一、感知器神经元模型感知器神经元通过对权值的训练,可以使感知器神经元的输出能代表对输入模式进行的分类,图1.1为感知器神经元模型。

图1.1 感知器神经元模型感知器神经元的每一个输入都对应于一个合适的权值,所有的输入与其对应权值的加权和作为阀值函数的输入。

由于阀值函数的引入,从而使得感知器可以将输入向量分为两个区域,通常阀函数采用双极阶跃函数,如:⎩⎨⎧<≥=0,00,1)(x x x f (1.1) 而感知器神经元模型的实际输出为⎪⎭⎫⎝⎛-=∑-=R i i i b x w f o 1 (1.2)其中b 为阀值二、感知器的网络结构图1.2所描述的是一个简单的感知器网络结构,输入层有R 个输入,Q 个输出,通过权值w ij 与s 个感知器神经元连接组成的感知器神经网络。

根据网络结构,可以写出感知器处理单元对其输入的加权和操作,即:∑==Rj j ij i p w n 1(1.3)而其输出a i 为a i =f (n i +b i ) (1.4)由式2.1易知⎩⎨⎧<+≥+=0001i i i i i b n b n a (1.5) 则当输入n i +b i 大于等于0,即有n i ≥-b i 时,感知器的输出为1;否则输出为0。

上面所述的单层感知器神经网络是不可能解决线性不可分的输入向量分类问题,也不能推广到一般的前向网络中去。

为解决这一问题,我们可以设计多层感知器神经网络以实现任意形状的划分。

图1.3描述了一个双层感知器神经网络。

其工作方式与单层感知器网络一样,只不过是增加了一层而已,具体的内容这里不做讨论。

三、感知器神经网络的学习规则感知器的学习规则主要是通过调整网络层的权值和阀值以便能够地网络的输入向量进行正确的分类。

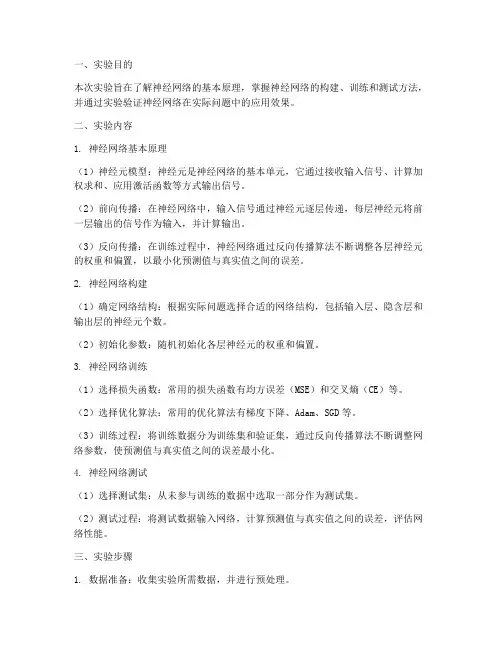

一、实验目的本次实验旨在了解神经网络的基本原理,掌握神经网络的构建、训练和测试方法,并通过实验验证神经网络在实际问题中的应用效果。

二、实验内容1. 神经网络基本原理(1)神经元模型:神经元是神经网络的基本单元,它通过接收输入信号、计算加权求和、应用激活函数等方式输出信号。

(2)前向传播:在神经网络中,输入信号通过神经元逐层传递,每层神经元将前一层输出的信号作为输入,并计算输出。

(3)反向传播:在训练过程中,神经网络通过反向传播算法不断调整各层神经元的权重和偏置,以最小化预测值与真实值之间的误差。

2. 神经网络构建(1)确定网络结构:根据实际问题选择合适的网络结构,包括输入层、隐含层和输出层的神经元个数。

(2)初始化参数:随机初始化各层神经元的权重和偏置。

3. 神经网络训练(1)选择损失函数:常用的损失函数有均方误差(MSE)和交叉熵(CE)等。

(2)选择优化算法:常用的优化算法有梯度下降、Adam、SGD等。

(3)训练过程:将训练数据分为训练集和验证集,通过反向传播算法不断调整网络参数,使预测值与真实值之间的误差最小化。

4. 神经网络测试(1)选择测试集:从未参与训练的数据中选取一部分作为测试集。

(2)测试过程:将测试数据输入网络,计算预测值与真实值之间的误差,评估网络性能。

三、实验步骤1. 数据准备:收集实验所需数据,并进行预处理。

2. 神经网络构建:根据实际问题确定网络结构,初始化参数。

3. 神经网络训练:选择损失函数和优化算法,对网络进行训练。

4. 神经网络测试:将测试数据输入网络,计算预测值与真实值之间的误差,评估网络性能。

四、实验结果与分析1. 实验结果(1)损失函数曲线:观察损失函数随训练轮数的变化趋势,分析网络训练效果。

(2)测试集误差:计算测试集的预测误差,评估网络性能。

2. 结果分析(1)损失函数曲线:从损失函数曲线可以看出,随着训练轮数的增加,损失函数逐渐减小,说明网络训练效果较好。

神经网络中的感知器与多层感知器神经网络是一种模仿人类神经系统的信息处理系统,能够通过学习和自我适应来完成任务。

神经网络在图像识别、语音识别、自然语言处理等领域有着广泛的应用。

其中,感知器和多层感知器是神经网络中最基本的结构,本文将分别介绍它们的原理、应用和局限性。

一、感知器(Perceptron)感知器是神经网络的最基本单元,它基于线性分类模型,能够将输入数据进行分类。

感知器的构成由输入层、权值、偏移量、激活函数和输出层组成。

1、输入层:输入层是感知器的数据源,同时也是神经元的接收器,输入层的节点数决定了输入数据的维度。

2、权值:输入信号与感知器之间的连接是用权值来表示的,权值决定了输入节点的重要程度。

权值的调整也是感知器训练的核心。

3、偏移量:偏移量是一个常数,它与权值结合起来作为阈值判断的依据。

4、激活函数:激活函数是连接多个神经元之间的唯一方式,也是用于处理输入数据的函数,它将输入的信号进行处理后输出到输出层。

5、输出层:输出层的节点数决定了对数据进行分类的结果。

可以是二分类或多分类。

感知器的训练过程就是通过上面的结构来不停地调整每个输入节点的权值,从而不停地改进分类结果。

感知器的应用:感知器广泛应用于二元分类的问题中,例如数字识别和人脸识别。

感知器的局限性:但是,感知器有很大的局限性,例如无法处理非线性分类问题,只能进行两类问题的分类。

因此,需要使用多层感知器来解决这些问题。

二、多层感知器(Multi-Layer Perceptron, MLP)多层感知器是感知器的扩展,通过添加多个隐藏层使其可以处理非线性分类问题。

隐藏层的加入使得神经网络学习到了更加复杂的特征,并且可以解决分类问题。

多层感知器的结构与感知器相似,只是中间加入了隐藏层,隐藏层将原数据进行转换和处理,以得到更好的输入数据。

隐层和输出之间的连接仍然可以使用任何激活函数,例如Sigmoid函数。

多层感知器的训练过程和感知器类似,也是不断地调整权重来训练,但多层感知器的训练相较于单层感知器显得更加复杂,因为它需要在每个隐藏层之间做权值传导和梯度求导。

第4章感知器(Perceptron)感知器是由美国计算机科学家罗森布拉特(F.Roseblatt)于1957年提出的。

单层感知器神经元模型图:图4.1 感知器神经元模型F.Roseblatt已经证明,如果两类模式是线性可分的(指存在一个超平面将它们分开),则算法一定收敛。

感知器特别适用于简单的模式分类问题,也可用于基于模式分类的学习控制中。

本节中所说的感知器是指单层的感知器。

多层网络因为要用到后面将要介绍的反向传播法进行权值修正,所以把它们均归类为反向传播网络之中。

4.1 感知器的网络结构根据网络结构,可以写出第i个输出神经元(i=1,2,…,s)的加权输入和ni 及其输出ai为:感知器的输出值是通过测试加权输入和值落在阈值函数的左右来进行分类的,即有:阈值激活函数如图4.3所示。

4.2 感知器的图形解释由感知器的网络结构,我们可以看出感知器的基本功能是将输入矢量转化成0或1的输出。

这一功能可以通过在输人矢量空间里的作图来加以解释。

感知器权值参数的设计目的,就是根据学习法则设计一条W*P+b=0的轨迹,使其对输入矢量能够达到期望位置的划分。

以输入矢量r=2为例,对于选定的权值w1、w2和b,可以在以p1和p2分别作为横、纵坐标的输入平面内画出W*P+b=w1p1十w2p2十b=0的轨迹,它是一条直线,此直线上的及其线以上部分的所有p1、p2值均使w1p1十w2p2十b>0,这些点若通过由w1、w2和b构成的感知器则使其输出为1;该直线以下部分的点则使感知器的输出为0。

所以当采用感知器对不同的输入矢量进行期望输出为0或1的分类时,其问题可转化为:对于已知输入矢量在输入空间形成的不同点的位置,设计感知器的权值W和b,将由W*P+b=0的直线放置在适当的位置上使输入矢量按期望输出值进行上下分类。

图4.4 输入矢量平面图(此图横坐标有问题)4.3 感知器的学习规则学习规则是用来计算新的权值矩阵W及新的偏差B的算法。

第2章感知神经网络感知器是一种前馈神经网络,是神经网络中的一种典型结构。

感知器具有分层结构,信息从输入层进入网络,逐层向前传递至输出层。

根据感知器神经元变换函数、隐层数以及权值调整规则的不同,可以形成具有各种功能特点的神经网络。

2.1 单层感知器1958年,美国心理学家Frank Posenblatt提出一种具有单层计算单元的神经网络,称为Perceptron,即感知器。

感知器模拟人的视觉接受环境信息,并由神经冲动进行信息传递。

感知器研究中首次提出了自组织、自学习的思想,而且对所能解决的问题存在着收敛算法,并能从数学上严格证明,因而对神经网络的研究起了重要的推动作用。

单层感知器的结构与功能都非常简单,以至于目前在解决实际问题时很少被采用,但由于它在神经网络研究中具有重要的意义,是研究其他网络的基础,而且较易学习和理解,适合作为学习神经网络的起点。

2.1.1 感知器模型单层感知器是指只有一层处理单元的感知器,如果包括输入层在内,应为两层。

其拓扑结构如图2-1所示。

图中输入层也称为感知层,有n个神经元节点,这些节点只负责引入外部信息,自身无信息处理能力,每个节点接收一个输入信号,n个输入信号构成输入列向量X。

输出层也称为处理层,有m个神经元节点,每个节点均具有信息处理能力,m个节点向外部输出处理信息,构成输出列向量O。

两层之间的连接权值用权值列向量Wj表示,m个权向量构成单层感知器的权值矩阵W。

3种列向量分别表示为图2-1 单层感知器由第1章介绍的神经元数学模型知,对于处理层中任一节点,其净输入为来自输入层各节点的输入加权和。

(2-1)输出由节点的变换函数决定,离散型单计算层感知器的变换函数一般采用符号函数。

(2-2)2.1.2 感知器的功能为便于直观分析,考虑图2-2中单计算节点感知器的情况。

不难看出,单计算节点感知器实际上就是一个M-P神经元模型,由于采用了符号变换函数,又称为符号单元。

式(2-2)可进一步表达为下面分三种情况讨论单计算节点感知器的功能。

一、实验背景随着人工智能和机器学习技术的不断发展,多层感知器(Multilayer Perceptron,MLP)作为一种重要的前向神经网络模型,在图像识别、自然语言处理等领域得到了广泛应用。

本次实验旨在通过实现一个简单的多层感知器模型,加深对MLP的理解,并验证其在实际应用中的效果。

二、实验目的1. 理解多层感知器的基本原理和结构;2. 掌握多层感知器的实现方法;3. 通过实验验证多层感知器在非线性分类问题上的应用效果。

三、实验环境1. 操作系统:Windows 102. 编程语言:Python3. 库:NumPy、TensorFlow四、实验内容1. 多层感知器模型搭建(1)输入层:根据实际问题,确定输入层的节点数。

例如,在图像识别问题中,输入层节点数等于图像像素数。

(2)隐藏层:确定隐藏层的层数和每层的节点数。

通常情况下,随着层数的增加,模型的性能会提高,但过深的网络可能导致过拟合。

(3)输出层:根据实际问题,确定输出层的节点数。

例如,在二分类问题中,输出层节点数为1。

(4)激活函数:选择合适的激活函数,如Sigmoid、ReLU等。

2. 损失函数和优化算法(1)损失函数:常用的损失函数有均方误差(MSE)和交叉熵(Cross-Entropy)等。

(2)优化算法:常用的优化算法有梯度下降(Gradient Descent)、Adam等。

3. 模型训练(1)将数据集划分为训练集和测试集。

(2)使用训练集对模型进行训练,并不断调整参数。

(3)使用测试集对模型进行评估,以验证模型的性能。

4. 模型评估(1)计算模型的准确率、召回率、F1值等指标。

(2)可视化模型预测结果,分析模型的性能。

五、实验结果与分析1. 实验数据本次实验以MNIST数据集为例,MNIST数据集包含0-9数字的手写图像,共有60000个训练样本和10000个测试样本。

2. 实验结果(1)模型准确率:在训练集和测试集上,多层感知器的准确率分别为98.5%和96.2%。

Neural Networks & Application1第3章感知器神经网络z 单层感知器z 多层感知器z 基本BP 算法z 标准BP 算法的改进z 基于BP 算法的多层感知器设计基础z 基于BP 算法的多层感知器应用与设计实例z课件下载::8080/aiwebdrive/wdshare/getsh are.do?action=exhibition&theParam=liangjing@zzu.e Neural Networks & Application23.1 单层感知器z 1958年,美国心理学家Frank Rosenblatt 提出一种具有单层计算单元的神经网络,称为Perceptron, 及感知器。

z感知器研究中首次提出了自组织、自学习的思想,而且对于所能解决的问题存在着收敛算法,并能从数学上严格证明,因而对神经网络的研究起了重要推动作用。

z单层感知器的结构与功能都非常简单,所以在解决实际问题时很少被采用,但在神经网络研究中具有重要意义,是研究其他网络的基础,而且较易学习和理解,适合于作为学习神经网络的起点。

Neural Networks & Application33.1 单层感知器z3.1.1 感知器模型单层感知器:只有一层处理单元的感知器12(,,...,)Tm o o o =O 单层感知器输入层(感知层)输出层(处理层)12(,,...,)Tn x x x =X 12(,,...,),1,2,...,T j j nj w w w j m==j W Neural Networks & Application43.1 单层感知器对于处理层中任一节点,其净输入net ’j 为来自输入层各节点的输入加权和离散型单层感知器的变换函数一般采用符号函数1'nj ij ii net w x ==∑0sgn(')sgn()sgn()nT j j j ij i j i o net T w x ==−==∑W XNeural Networks & Application53.1 单层感知器z 3.1.2 感知器的功能z单计算节点感知器就是一个M-P 神经元模型,采取符号变换函数,又称为符号单元。

实验3 感知器神经网络的实现

一、实验目的:

1. 理解单层感知器的工作原理

2. 通过调节算法参数了解参数的变化对于感知器训练的影响

3. 了解单层感知器局限性

二、实验内容:

1. 使用Matlab编程实现单层感知器

2. 调节学习率η,观察对于不同学习率算法的收敛速度(迭代次数)

3. 用单层感知器处理非线性分类问题,观察结果

三、实验原理:

单层感知器:只有一层处理单元的感知器:

感知器的学习算法

采用感知器学习规则,训练步骤如下:

Step 1:

对各权值w0j(0), w2j(0), …, w nj(0), j=1, 2, …, m (m为计算层的节点数)赋予较小的非

零随机数,设置p=1;

Step 2:

输入样本对,其中

为期望的输出向量(教师信号),上标p表示样本对的模式序号,设样本总数为P,则p = 1, 2, …, P;

Step 3:

计算各节点的实际输出

Step 4:

调整各节点对应的权值,

η为学习率,用于控制调整速度,η值太大会影响训练的稳定性,太小则使训练的收敛速度变慢,一般取0<η≤1;

Step 5:

p=p+1,如果p ≤P,返回到Step2 ,否则转到Step 6 ;

Step 6:

如果感知器对所有样本的实际输出与期望输出相等,则停止;否则设置p=1,返回Step2。

实验要求:

用MATLAB/C/C++,实现上述算法

实验实例,在下面实例中任选一种进行实验。

一、用单层感知器实现“与”运算

“与”运算真值表:

x1 x2 y

0 0 0

0 1 0

1 0 0

1 1 1

二、用多层感知器实现“异或”运算

“异或”运算真值表:

x1 x2 y

0 0 0

0 1 1

1 0 1

1 1 0。