信息论与编码课后答案

- 格式:pdf

- 大小:819.37 KB

- 文档页数:31

信息论与编码理论课后答案【篇一:《信息论与编码》课后习题答案】式、含义和效用三个方面的因素。

2、 1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

3、按照信息的性质,可以把信息分成语法信息、语义信息和语用信息。

4、按照信息的地位,可以把信息分成客观信息和主观信息。

5、人们研究信息论的目的是为了高效、可靠、安全地交换和利用各种各样的信息。

6、信息的是建立信息论的基础。

7、8、是香农信息论最基本最重要的概念。

9、事物的不确定度是用时间统计发生概率的对数来描述的。

10、单符号离散信源一般用随机变量描述,而多符号离散信源一般用随机矢量描述。

11、一个随机事件发生某一结果后所带来的信息量称为自信息量,定义为其发生概率对数的负值。

12、自信息量的单位一般有比特、奈特和哈特。

13、必然事件的自信息是。

14、不可能事件的自信息量是15、两个相互独立的随机变量的联合自信息量等于两个自信息量之和。

16、数据处理定理:当消息经过多级处理后,随着处理器数目的增多,输入消息与输出消息之间的平均互信息量趋于变小。

17、离散平稳无记忆信源x的n次扩展信源的熵等于离散信源x的熵的。

limh(xn/x1x2?xn?1)h?n???18、离散平稳有记忆信源的极限熵,。

19、对于n元m阶马尔可夫信源,其状态空间共有m个不同的状态。

20、一维连续随即变量x在[a,b] 。

1log22?ep21、平均功率为p的高斯分布的连续信源,其信源熵,hc(x)=2。

22、对于限峰值功率的n维连续信源,当概率密度均匀分布时连续信源熵具有最大值。

23、对于限平均功率的一维连续信源,当概率密度24、对于均值为0,平均功率受限的连续信源,信源的冗余度决定于平均功率的限定值p和信源的熵功率p25、若一离散无记忆信源的信源熵h(x)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为。

2728、同时掷两个正常的骰子,各面呈现的概率都为1/6,则“3和5同时出现”这件事的自信息量是 ?mn?ki?11?mp(x)?em29、若一维随即变量x的取值区间是[0,∞],其概率密度函数为,其中:x?0,m是x的数学2期望,则x的信源熵c。

1. 有一个马尔可夫信源,已知p(x 1|x 1)=2/3,p(x 2|x 1)=1/3,p(x 1|x 2)=1,p(x 2|x 2)=0,试画出该信源的香农线图,并求出信源熵。

解:该信源的香农线图为:1/3○ ○2/3 (x 1) 1 (x 2)在计算信源熵之前,先用转移概率求稳固状态下二个状态x 1和 x 2 的概率)(1x p 和)(2x p 立方程:)()()(1111x p x x p x p =+)()(221x p x x p=)()(2132x p x p +)()()(1122x p x x p x p =+)()(222x p x x p =)(0)(2131x p x p + )()(21x p x p +=1 得431)(=x p 412)(=x p马尔可夫信源熵H = ∑∑-IJi j i jix x p x xp x p )(log )()( 得 H=0.689bit/符号2.设有一个无经历信源发出符号A 和B ,已知4341)(.)(==B p A p 。

求:①计算该信源熵;②设该信源改成发出二重符号序列消息的信源,采纳费诺编码方式,求其平均信息传输速度; ③又设该信源改成发三重序列消息的信源,采纳霍夫曼编码方式,求其平均信息传输速度。

解:①∑-=Xiix p x p X H )(log )()( =0.812 bit/符号②发出二重符号序列消息的信源,发出四种消息的概率别离为1614141)(=⨯=AA p 1634341)(=⨯=AB p1634143)(=⨯=BA p 1694343)(=⨯=BB p用费诺编码方式 代码组 b i BB 0 1 BA 10 2 AB 110 3 AA 111 3无经历信源 624.1)(2)(2==X H X H bit/双符号 平均代码组长度 2B =1.687 bit/双符号BX H R )(22==0.963 bit/码元时刻③三重符号序列消息有8个,它们的概率别离为641)(=AAA p 643)(=AAB p 643)(=BAA p 643)(=ABA p 649)(=BBA p 649)(=BAB p 649)(=ABB p 6427)(=BBB p用霍夫曼编码方式 代码组 b iBBB 6427 0 0 1 BBA 649 0 )(6419 1 110 3BAB 649 1 )(6418 )(644 1 101 3ABB 649 0 0 100 3AAB 6431 )(6461 11111 5 BAA 643 0 1 11110 5ABA6431 )(6440 11101 5 AAA641 0 11100 5)(3)(3X H X H ==2.436 bit/三重符号序列 3B =2.469码元/三重符号序列3R =BX H )(3=0.987 bit/码元时刻3.已知符号集合{ 321,,x x x }为无穷离散消息集合,它们的显现概率别离为 211)(=x p ,412)(=x p 813)(=x p ···ii x p 21)(=···求: ① 用香农编码方式写出各个符号消息的码字(代码组); ② 计算码字的平均信息传输速度; ③ 计算信源编码效率。

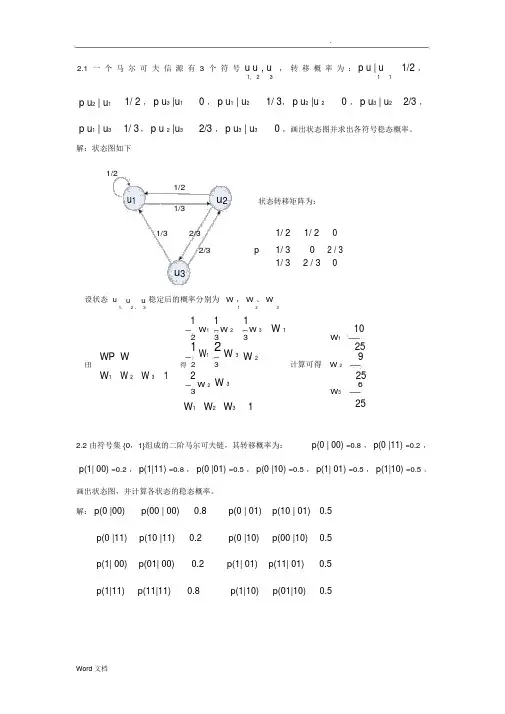

.2.1 一 个 马 尔 可 夫 信 源 有 3 个 符 号 u u , u , 转 移 概 率 为 : p u | u1 1/2 ,1, 231p u 2 | u 1 1/ 2 , p u 3 |u 1 0 , p u 1 | u 21/ 3, p u 2 |u 2 0 , p u 3 | u 2 2/3 ,p u 1 | u 31/ 3 , p u 2 |u 32/3 , p u 3 | u 30 ,画出状态图并求出各符号稳态概率。

解:状态图如下1/2u 11/2 u 21/3状态转移矩阵为:1/32/31/ 2 1/ 2 02/3p1/ 30 2 / 3u 3 1/ 32 /3 0设状态 u u2 u 稳定后的概率分别为 W , W 、 W31, , 312111W 1 10 W 1W 2 W 3 233W 1WP W 1W 12W 3 W 225计算可得 9由W 2W 3 1 得 23W 2W 12W 325W 2 63W 3W 1 W 2 W 3 1252.2 由符号集 {0,1}组成的二阶马尔可夫链,其转移概率为:p(0 | 00) =0.8 , p(0 |11) =0.2 ,p(1| 00) =0.2 , p(1|11) =0.8 , p(0 |01) =0.5 , p(0 |10) =0.5 , p(1| 01) =0.5 , p(1|10) =0.5 。

画出状态图,并计算各状态的稳态概率。

解: p(0 |00)p(00 | 00) 0.8 p(0 | 01) p(10 | 01) 0.5 p(0 |11)p(10 |11)0.2 p(0 |10)p(00 |10) 0.5p(1| 00) p(01| 00) 0.2 p(1| 01) p(11| 01) 0.5 p(1|11)p(11|11)0.8p(1|10)p(01|10)0.5.0.8 0.2 00000.5 0.5于是可以列出转移概率矩阵:p0.5 0.5 000 0 0.2 0.8状态图为:0.8 00 0.2010.5 0.50.50.510 0.211 0.8设各状态00, 01, 10, 11 的稳态分布概率为W ,W W W4 有1 2, 3,W1 50.8W1 0.5W 3 W1 14WP W 0.2W1 0.5W 3 W 2 W 2 1 74 得0.5W 2 0.2W 4 W 3 计算得到W i 1 10.5W 2 0.8W 4 W 4 W 3i 1 7W1 W 2 W 3 W 4 1W 45 14X x1 0 x21 x2 x432.7 设有一离散无记忆信源,其概率空间为3P 3/8 1/ 4 1/ 4 1/8( 1)求每个符号的自信息量( 2)信源发出一消息符号序列为{202 120 130 213 001 203 210 110 321 010 021 032 011 223 210},求该序列的自信息量和平均每个符号携带的信息量解: I ( x1) log 2 1 log 2 8 1.415bitp( x1) 3同理可以求得I ( x2) 2bit , I (x3) 2bit , I ( x3)3bit因为信源无记忆,所以此消息序列的信息量就等于该序列中各个符号的信息量之和就有: I 14I ( x1) 13I (x2) 12I (x3) 6I ( x4 )87.81bit平均每个符号携带的信息量为87.811.95 bit/符号452.11 有一个可以旋转的圆盘,盘面上被均匀的分成38 份,用 1 ,,38 的数字标示,其中有两份涂绿色,18 份涂红色, 18 份涂黑色,圆盘停转后,盘面上的指针指向某一数字和颜色。

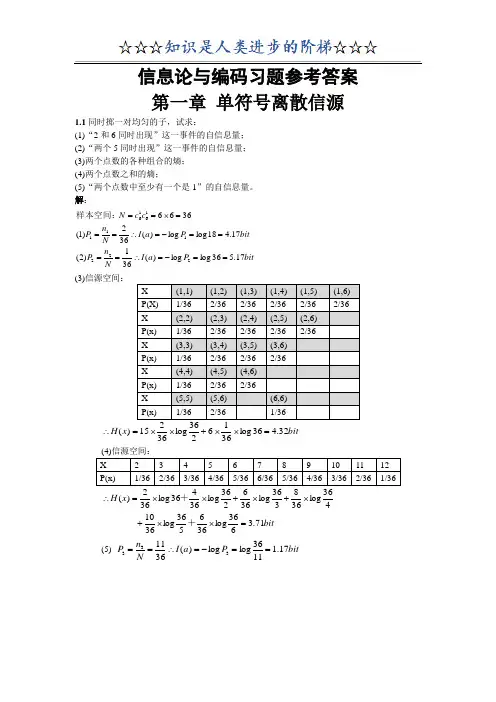

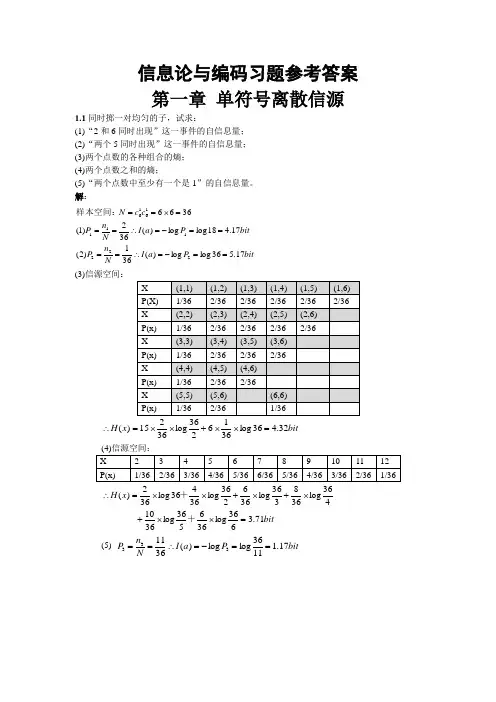

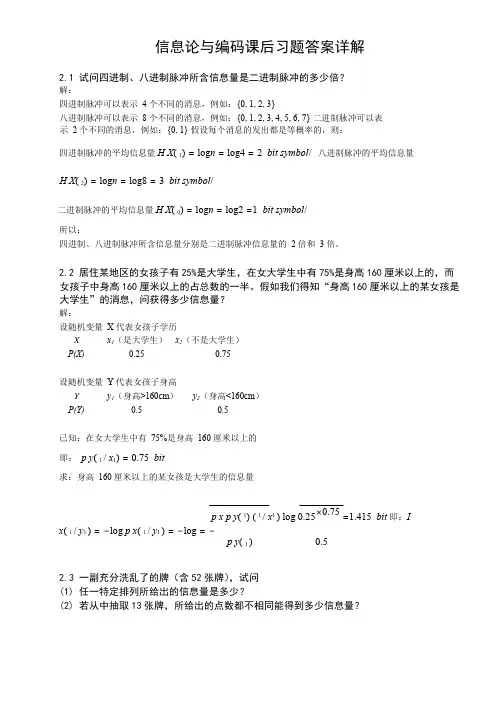

信息论与编码习题参考答案 第一章 单符号离散信源1.1同时掷一对均匀的子,试求:(1)“2和6同时出现”这一事件的自信息量; (2)“两个5同时出现”这一事件的自信息量; (3)两个点数的各种组合的熵; (4)两个点数之和的熵;(5)“两个点数中至少有一个是1”的自信息量。

解:bitP a I N n P bit P a I N n P c c N 17.536log log )(361)2(17.418log log )(362)1(36662221111616==-=∴====-=∴===⨯==样本空间:(3)信源空间:bit x H 32.436log 3662log 3615)(=⨯⨯+⨯⨯=∴ bitx H 71.3636log 366536log 3610 436log 368336log 366236log 36436log 362)(=⨯⨯+⨯+⨯+⨯⨯=∴++ (5) bit P a I N n P 17.11136log log )(3611333==-=∴==1.2如有6行、8列的棋型方格,若有两个质点A 和B ,分别以等概落入任一方格,且它们的坐标分别为(Xa ,Ya ), (Xb ,Yb ),但A ,B 不能同时落入同一方格。

(1) 若仅有质点A ,求A 落入任一方格的平均信息量; (2) 若已知A 已落入,求B 落入的平均信息量; (3) 若A ,B 是可辨认的,求A ,B 落入的平均信息量。

解:bita P a P a a P a I a P A i 58.548log )(log )()(H 48log )(log )(481)(:)1(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率Θbitb P b P b b P b I b P A i 55.547log )(log )()(H 47log )(log )(471)(:B ,)2(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率是落入任一格的情况下在已知ΘbitAB P AB P AB H AB P AB I AB P AB i i i i i i i 14.11)4748log()(log )()()(log )(471481)()3(47481=⨯=-=-=∴⨯=∑⨯=是同时落入某两格的概率1.3从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为0.5%.如果你问一位男士:“你是否是红绿色盲?”他的回答可能是:“是”,也可能“不是”。

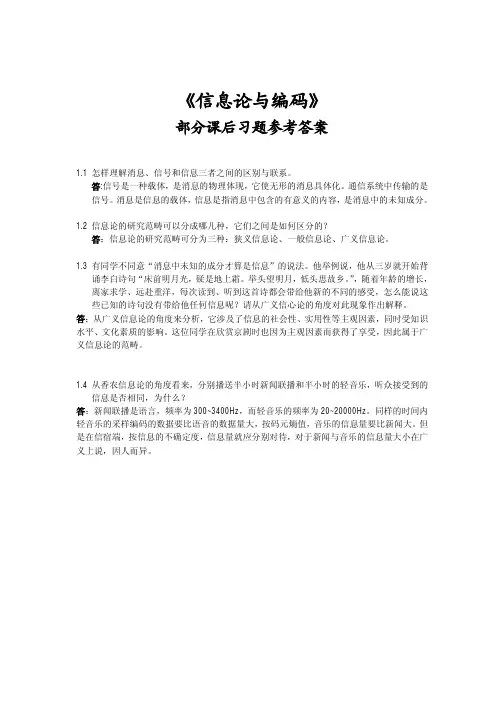

《信息论与编码》课后习题答案1、在认识论层次上研究信息的时候,必须同时考虑到形式、含义和效用三个方面的因素。

2、1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

3、按照信息的性质,可以把信息分成语法信息、语义信息和语用信息。

4、按照信息的地位,可以把信息分成客观信息和主观信息。

5、人们研究信息论的目的是为了高效、可靠、安全地交换和利用各种各样的信息。

6、信息的可度量性是建立信息论的基础。

7、统计度量是信息度量最常用的方法。

8、熵是香农信息论最基本最重要的概念。

9、事物的不确定度是用时间统计发生概率的对数来描述的。

10、单符号离散信源一般用随机变量描述,而多符号离散信源一般用随机矢量描述。

11、一个随机事件发生某一结果后所带来的信息量称为自信息量,定义为其发生概率对数的负值。

12、自信息量的单位一般有比特、奈特和哈特。

13、必然事件的自信息是 0 。

14、不可能事件的自信息量是∞ 。

15、两个相互独立的随机变量的联合自信息量等于两个自信息量之和。

16、数据处理定理:当消息经过多级处理后,随着处理器数目的增多,输入消息与输出消息之间的平均互信息量趋于变小。

17、离散平稳无记忆信源X 的N 次扩展信源的熵等于离散信源X 的熵的 N 倍。

18、离散平稳有记忆信源的极限熵,。

19、对于n 元m 阶马尔可夫信源,其状态空间共有 n m 个不同的状态。

20、一维连续随即变量X 在[a ,b]区间内均匀分布时,其信源熵为 log 2(b-a )。

21、平均功率为P 的高斯分布的连续信源,其信源熵,H c (X )=。

22、对于限峰值功率的N 维连续信源,当概率密度均匀分布时连续信源熵具有最大值。

23、对于限平均功率的一维连续信源,当概率密度高斯分布时,信源熵有最大值。

24、对于均值为0,平均功率受限的连续信源,信源的冗余度决定于平均功率的限定值P 和信源的熵功率之比。

25、若一离散无记忆信源的信源熵H (X )等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为 3 。

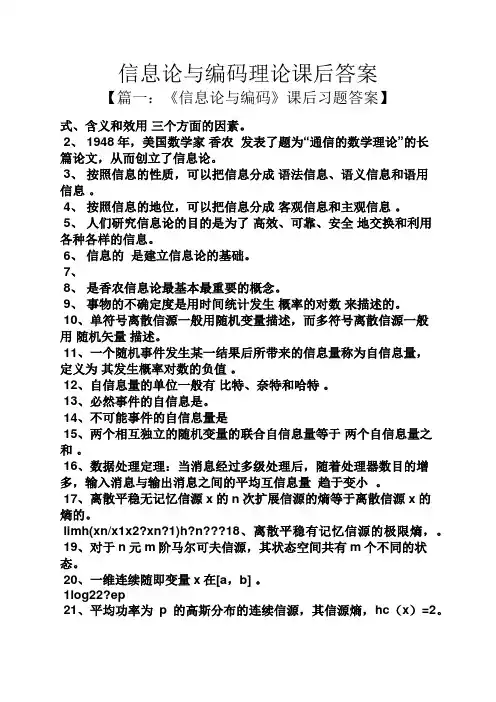

《信息论与编码》课后习题答案第二章2.1一个马尔可夫信源有3个符号{}1,23,u u u ,转移概率为:()11|1/2p u u =,()21|1/2p u u =,()31|0p u u =,()12|1/3p u u =,()22|0p u u =,()32|2/3p u u =,()13|1/3p u u =,()23|2/3p u u =,()33|0p u u =,画出状态图并求出各符号稳态概率。

解:状态图如下状态转移矩阵为:1/21/201/302/31/32/30p ⎛⎫ ⎪= ⎪ ⎪⎝⎭设状态u 1,u 2,u 3稳定后的概率分别为W 1,W 2、W 3由1231WP W W W W =⎧⎨++=⎩得1231132231231112331223231W W W W W W W W W W W W ⎧++=⎪⎪⎪+=⎪⎨⎪=⎪⎪⎪++=⎩计算可得1231025925625W W W ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩2.2 由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:(0|00)p =0.8,(0|11)p =0.2,(1|00)p =0.2,(1|11)p =0.8,(0|01)p =0.5,(0|10)p =0.5,(1|01)p =0.5,(1|10)p =0.5。

画出状态图,并计算各状态的稳态概率。

解:(0|00)(00|00)0.8p p == (0|01)(10|01)0.5p p ==(0|11)(10|11)0.2p p == (0|10)(00|10)0.5p p == (1|00)(01|00)0.2p p == (1|01)(11|01)0.5p p == (1|11)(11|11)0.8p p == (1|10)(01|10)0.5p p ==于是可以列出转移概率矩阵:0.80.200000.50.50.50.500000.20.8p ⎛⎫ ⎪⎪= ⎪ ⎪⎝⎭ 状态图为:设各状态00,01,10,11的稳态分布概率为W 1,W 2,W 3,W 4 有411i i WP W W ==⎧⎪⎨=⎪⎩∑ 得 13113224324412340.80.50.20.50.50.20.50.81W W W W W W W W W W W W W W W W +=⎧⎪+=⎪⎪+=⎨⎪+=⎪+++=⎪⎩ 计算得到12345141717514W W W W ⎧=⎪⎪⎪=⎪⎨⎪=⎪⎪⎪=⎩2.3 同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求:(1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的熵和平均信息量; (4) 两个点数之和(即2, 3, … , 12构成的子集)的熵; (5) 两个点数中至少有一个是1的自信息量。

信息论与编码习题参考答案 第一章 单符号离散信源1.1同时掷一对均匀的子,试求:(1)“2和6同时出现”这一事件的自信息量; (2)“两个5同时出现”这一事件的自信息量; (3)两个点数的各种组合的熵; (4)两个点数之和的熵;(5)“两个点数中至少有一个是1”的自信息量。

解:bitP a I N n P bit P a I N n P c c N 17.536log log )(361)2(17.418log log )(362)1(36662221111616==-=∴====-=∴===⨯==样本空间:(3)信源空间:bit x H 32.436log 3662log 3615)(=⨯⨯+⨯⨯=∴ bitx H 71.3636log 366536log 3610 436log 368336log 366236log 36436log 362)(=⨯⨯+⨯+⨯+⨯⨯=∴++ (5) bit P a I N n P 17.11136log log )(3611333==-=∴==1.2如有6行、8列的棋型方格,若有两个质点A 和B ,分别以等概落入任一方格内,且它们的坐标分别为(Xa ,Ya ), (Xb ,Yb ),但A ,B 不能同时落入同一方格内。

(1) 若仅有质点A ,求A 落入任一方格的平均信息量; (2) 若已知A 已落入,求B 落入的平均信息量; (3) 若A ,B 是可辨认的,求A ,B 落入的平均信息量。

解:bita P a P a a P a I a P A i 58.548log )(log )()(H 48log )(log )(481)(:)1(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率Θbitb P b P b b P b I b P A i 55.547log )(log )()(H 47log )(log )(471)(:B ,)2(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率是落入任一格的情况下在已知ΘbitAB P AB P AB H AB P AB I AB P AB i i i i i i i 14.11)4748log()(log )()()(log )(471481)()3(47481=⨯=-=-=∴⨯=∑⨯=是同时落入某两格的概率1.3从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为0.5%.如果你问一位男士:“你是否是红绿色盲?”他的回答可能是:“是”,也可能“不是”。

第二章课后习题【2.1】设有12 枚同值硬币,其中有一枚为假币。

只知道假币的重量与真币的重量不同,但不知究竟是重还是轻。

现用比较天平左右两边轻重的方法来测量。

为了在天平上称出哪一枚是假币,试问至少必须称多少次?解:从信息论的角度看,“12 枚硬币中,某一枚为假币”该事件发生的概率为P =112;“假币的重量比真的轻,或重”该事件发生的概率为P = 12;为确定哪一枚是假币,即要消除上述两事件的联合不确定性,由于二者是独立的,因此有I = log12 + log 2 = log 24 比特而用天平称时,有三种可能性:重、轻、相等,三者是等概率的,均为P = 平每一次消除的不确定性为I = log 3 比特因此,必须称的次数为13,因此天I 1 I 2 log 24log 3H 2.9 次因此,至少需称3 次。

【延伸】如何测量?分 3 堆,每堆4 枚,经过 3 次测量能否测出哪一枚为假币。

【2.2】同时扔一对均匀的骰子,当得知“两骰子面朝上点数之和为2”或“面朝上点数之和为8”或“两骰子面朝上点数是3 和4”时,试问这三种情况分别获得多少信息量?解:“两骰子总点数之和为2”有一种可能,即两骰子的点数各为1,由于二者是独立的,..⋅因此该种情况发生的概率为 P =1 1 6 6 136,该事件的信息量为:I = log 36 H 5.17 比特“两骰子总点数之和为8”共有如下可能:2 和6、3 和5、4 和4、5 和3、6 和2,概率为P = 1 16 6536,因此该事件的信息量为:36I = logH 2.85 比特5“两骰子面朝上点数是3 和4”的可能性有两种:3 和4、4 和3,概率为P = 1 16 6118,因此该事件的信息量为:I = log18 H 4.17 比特【2.3】如果你在不知道今天是星期几的情况下问你的朋友“明天星期几?”则答案中含有多少信息量?如果你在已知今天是星期四的情况下提出同样的问题,则答案中你能获得多少信息量(假设已知星期一至星期日的顺序)?解:如果不知今天星期几时问的话,答案可能有七种可能性,每一种都是等概率的,均为P = 17,因此此时从答案中获得的信息量为I = log 7 = 2.807 比特而当已知今天星期几时问同样的问题,其可能性只有一种,即发生的概率为1,此时获得的信息量为0 比特。

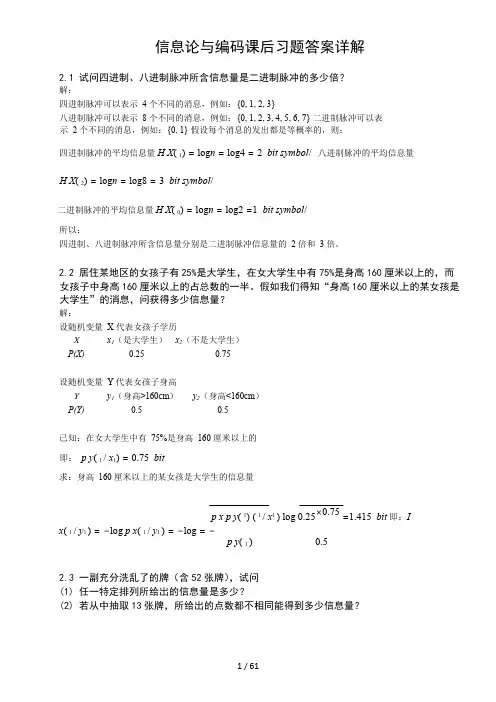

《信息论与编码》-曹雪虹-课后习题答案第二章2. 1 一个马尔可夫信源有3个符号{“⑷,呵,转移概率 为:〃(曲)= 1/2 , p (lll\u\) = \//l ,/?(M3l W1) = O , /2(MllW2)= l/3 ,2.2由符号集{0, 1}组成的二阶马尔可夫链,其转移 槪£率为:p (oioo )=0・ 8 9 p (oiii )=0・ 2, /?(i I oo )=0. 2, p (i111)=0. 8, P (OIOI )=0. 59 〃(oiio )=0・ 5, p (iioi )= 0. 5, p(iiio )=0. 5。

iffll 出 状态图,并计算各状态的稳态概率。

解: p (0100) = /?(00100) = 0.8P (U2\U2)= O y p (m\U2)= 2/3 y 〃("llU3)= l/3 , ”(“2丨心) = 2/3, /?(M3lM3)=O y画出状态图并求出各符号稳态概率。

解:状态图如下 状态转移矩阵为:设状态5, %比稳定后的概率分别为W” W2、Ws-Wi + -W2+-Wi = Wi2 3 31 2 _Wl+_W3 = W22 3-W2 = VV33Wi + Wi + W3 = \WP = w彳曰Wl + W2 + W3=l '寸v 计算可得 W\ =VV2 =vv? =10一259256一25 /XOIOl) = p(lOIOl)=O.5于是可以列出转移概率矩阵:厂08 0.2 0 0、0 0 0.5 0.50.5 0.5 0 00 0.2 0.8 .状态图为:设各状态00, 01,10, 11的稳态分布概率为叽 w 2>w 3,w 4 有率都为1/6,求:(1) “3和5同时出现”这事件的自信息; (2) “两个1同时出现”这事件的自信息;(3) 两个点数的各种组合(无序)对的爛和平均信息 量; (4) 两个点数之和(即2, 3,・・・,12构成的子集) 的嫡; (5) 两个点数中至少有一个是1的自信息量。

信息论与编码习题参考答案 第一章 单符号离散信源1.1同时掷一对均匀的子,试求:(1)“2和6同时出现”这一事件的自信息量; (2)“两个5同时出现”这一事件的自信息量; (3)两个点数的各种组合的熵; (4)两个点数之和的熵;(5)“两个点数中至少有一个是1”的自信息量。

解:bitP a I N n P bit P a I N n P c c N 17.536log log )(361)2(17.418log log )(362)1(36662221111616==-=∴====-=∴===⨯==样本空间:(3)信源空间:bit x H 32.436log 3662log 3615)(=⨯⨯+⨯⨯=∴ bitx H 71.3636log 366536log 3610 436log 368336log 366236log 36436log 362)(=⨯⨯+⨯+⨯+⨯⨯=∴++ (5) bit P a I N n P 17.11136log log )(3611333==-=∴==1.2如有6行、8列的棋型方格,若有两个质点A 和B ,分别以等概落入任一方格,且它们的坐标分别为(Xa ,Ya ), (Xb ,Yb ),但A ,B 不能同时落入同一方格。

(1) 若仅有质点A ,求A 落入任一方格的平均信息量; (2) 若已知A 已落入,求B 落入的平均信息量; (3) 若A ,B 是可辨认的,求A ,B 落入的平均信息量。

解:bita P a P a a P a I a P A i 58.548log )(log )()(H 48log )(log )(481)(:)1(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率Θbitb P b P b b P b I b P A i 55.547log )(log )()(H 47log )(log )(471)(:B ,)2(481i i i i i ==-=∴=-=∴=∑=落入任一格的概率是落入任一格的情况下在已知ΘbitAB P AB P AB H AB P AB I AB P AB i i i i i i i 14.11)4748log()(log )()()(log )(471481)()3(47481=⨯=-=-=∴⨯=∑⨯=是同时落入某两格的概率1.3从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为0.5%.如果你问一位男士:“你是否是红绿色盲?”他的回答可能是:“是”,也可能“不是”。