一元线性回归(假设检验)

- 格式:ppt

- 大小:1.89 MB

- 文档页数:48

从统计学看线性回归(1)——⼀元线性回归⽬录1. ⼀元线性回归模型的数学形式2. 回归参数β0 , β1的估计3. 最⼩⼆乘估计的性质 线性性 ⽆偏性 最⼩⽅差性⼀、⼀元线性回归模型的数学形式 ⼀元线性回归是描述两个变量之间相关关系的最简单的回归模型。

⾃变量与因变量间的线性关系的数学结构通常⽤式(1)的形式:y = β0 + β1x + ε (1)其中两个变量y与x之间的关系⽤两部分描述。

⼀部分是由于x的变化引起y线性变化的部分,即β0+ β1x,另⼀部分是由其他⼀切随机因素引起的,记为ε。

该式确切的表达了变量x与y之间密切关系,但密切的程度⼜没有到x唯⼀确定y的这种特殊关系。

式(1)称为变量y对x的⼀元线性回归理论模型。

⼀般称y为被解释变量(因变量),x为解释变量(⾃变量),β0和β1是未知参数,成β0为回归常数,β1为回归系数。

ε表⽰其他随机因素的影响。

⼀般假定ε是不可观测的随机误差,它是⼀个随机变量,通常假定ε满⾜:(2)对式(1)两边求期望,得E(y) = β0 + β1x, (3)称式(3)为回归⽅程。

E(ε) = 0 可以理解为ε对 y 的总体影响期望为 0,也就是说在给定 x 下,由x确定的线性部分β0 + β1x 已经确定,现在只有ε对 y 产⽣影响,在 x = x0,ε = 0即除x以外其他⼀切因素对 y 的影响为0时,设 y = y0,经过多次采样,y 的值在 y0 上下波动(因为采样中ε不恒等于0),若 E(ε) = 0 则说明综合多次采样的结果,ε对 y 的综合影响为0,则可以很好的分析 x 对 y 的影响(因为其他⼀切因素的综合影响为0,但要保证样本量不能太少);若 E(ε) = c ≠ 0,即ε对 y 的综合影响是⼀个不为0的常数,则E(y) = β0 + β1x + E(ε),那么 E(ε) 这个常数可以直接被β0 捕获,从⽽变为公式(3);若 E(ε) = 变量,则说明ε在不同的 x 下对 y 的影响不同,那么说明存在其他变量也对 y 有显著作⽤。

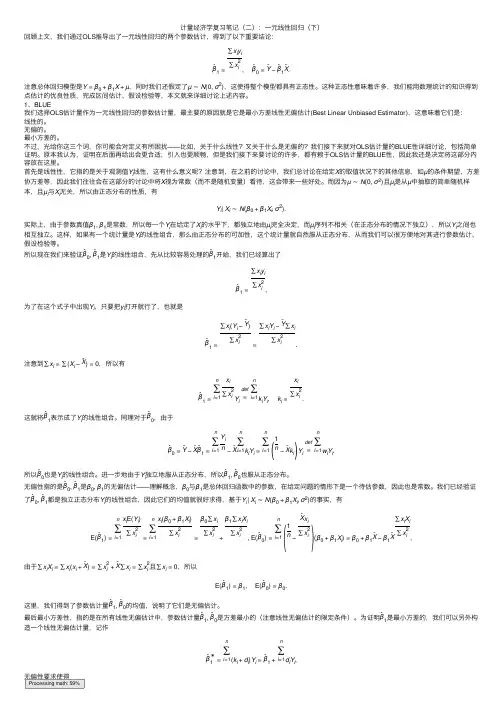

计量经济学复习笔记(⼆):⼀元线性回归(下)回顾上⽂,我们通过OLS推导出了⼀元线性回归的两个参数估计,得到了以下重要结论:ˆβ1=∑x i y i∑x2i,ˆβ0=¯Y−ˆβ1¯X.注意总体回归模型是Y=β0+β1X+µ,同时我们还假定了µ∼N(0,σ2),这使得整个模型都具有正态性。

这种正态性意味着许多,我们能⽤数理统计的知识得到点估计的优良性质,完成区间估计、假设检验等,本⽂就来详细讨论上述内容。

1、BLUE我们选择OLS估计量作为⼀元线性回归的参数估计量,最主要的原因就是它是最⼩⽅差线性⽆偏估计(Best Linear Unbiased Estimator),这意味着它们是:线性的。

⽆偏的。

最⼩⽅差的。

不过,光给你这三个词,你可能会对定义有所困扰——⽐如,关于什么线性?⼜关于什么是⽆偏的?我们接下来就对OLS估计量的BLUE性详细讨论,包括简单证明。

原本我认为,证明在后⾯再给出会更合适,引⼊也更顺畅,但是我们接下来要讨论的许多,都有赖于OLS估计量的BLUE性,因此我还是决定将这部分内容放在这⾥。

⾸先是线性性,它指的是关于观测值Y i线性,这有什么意义呢?注意到,在之前的讨论中,我们总讨论在给定X的取值状况下的其他信息,如µ的条件期望、⽅差协⽅差等,因此我们往往会在这部分的讨论中将X视为常数(⽽不是随机变量)看待,这会带来⼀些好处。

⽽因为µ∼N(0,σ2)且µi是从µ中抽取的简单随机样本,且µi与X i⽆关,所以由正态分布的性质,有Y i|X i∼N(β0+β1X i,σ2).实际上,由于参数真值β1,β1是常数,所以每⼀个Y i在给定了X i的⽔平下,都独⽴地由µi完全决定,⽽µi序列不相关(在正态分布的情况下独⽴),所以Y i之间也相互独⽴。

这样,如果有⼀个统计量是Y i的线性组合,那么由正态分布的可加性,这个统计量就⾃然服从正态分布,从⽽我们可以很⽅便地对其进⾏参数估计、假设检验等。

一元线性回归方程回归系数的假设检验方法

一元线性回归方程是一种统计学方法,用于研究两个变量之间的关系。

它可以

用来预测一个变量(被解释变量)的值,另一个变量(解释变量)的值已知。

回归系数是一元线性回归方程的重要参数,它可以用来衡量解释变量对被解释变量的影响程度。

回归系数的假设检验是一种统计学方法,用于检验回归系数是否具有统计学意义。

它的基本思想是,如果回归系数的值不是0,则表明解释变量对被解释变量有

显著的影响,反之则表明解释变量对被解释变量没有显著的影响。

回归系数的假设检验一般采用t检验或F检验。

t检验是检验单个回归系数是

否具有统计学意义的方法,而F检验是检验多个回归系数是否具有统计学意义的方法。

在进行回归系数的假设检验时,首先要确定检验的显著性水平,一般为0.05

或0.01。

然后,根据检验的类型,计算t值或F值,并与检验的显著性水平比较,如果t值或F值大于显著性水平,则拒绝原假设,即认为回归系数具有统计学意义;反之,则接受原假设,即认为回归系数没有统计学意义。

回归系数的假设检验是一种重要的统计学方法,它可以用来检验回归系数是否

具有统计学意义,从而更好地理解解释变量对被解释变量的影响程度。

一元线性回归模型的统计检验概述(doc 8页)§2.3 一元线性回归模型的统计检验回归分析是要通过样本所估计的参数来代替总体的真实参数,或者说是用样本回归线代替总体回归线。

尽管从统计性质上已知,如果有足够多的重复抽样,参数的估计值的期望(均值)就等于其总体的参数真值,但在一次抽样中,估计值不一定就等于该真值。

那么,在一次抽样中,参数的估计值与真值的差异有多大,是否显著,这就需要进一步进行统计检验。

主要包括拟合优度检验、变量的显著性检验及参数的区间估计。

一、拟合优度检验拟合优度检验,顾名思义,是检验模型对样本观测值的拟合程度。

检验的方法,是构造一个可以表征拟合程度的指标,在这里称为统计量,统计量是样本的函数。

从检验对象中计算出该统计量的数值,然后与某一标准进行比较,得出检验结论。

有人也许会问,采用普通最小二乘估计方法,已经保证了模型最好地拟合了样本观测值,为什么还要检验拟合程度?问题在于,在一个特定的条件下做得最好的并不一定就是高质量的。

普通最小二乘法所保证的最好拟合,是同一个问题内部的比较,拟合优度检验结果所表示优劣是不同问题之间的比较。

例如图2.3.1和图2.3.2中的直线方程都是由散点表示的样本观测值的最小二乘估计结果,对于每个问题它们都满足残差的平方和最小,但是二者对样本观测值的拟合程度显然是不同的。

....... . .. .图2.3.1 图2.3.21、总离差平方和的分解已知由一组样本观测值),(ii Y X ,i =1,2…,n 得到如下样本回归直线i i X Y 10ˆˆˆββ+=而Y 的第i 个观测值与样本均值的离差)(Y Y y i i -=可分解为两部分之和:ii i i i i i y e Y Y Y Y Y Y y ˆ)ˆ()ˆ(+=-+-=-= (2.3.1)图2.3.3示出了这种分解,其中,)ˆ(ˆY Y y ii -=是样本回归直线理论值(回归拟合值)与观测值i Y 的平均值之差,可认为是由回归直线解释的部分;)ˆ(i i i Y Y e -=是实际观测值与回归拟合值之差,是回归直线不能解释的部分。