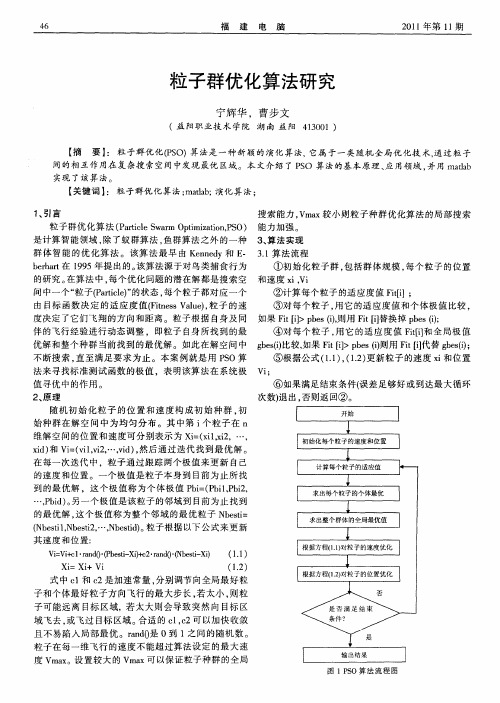

粒子群优化算法的研究进展

- 格式:pdf

- 大小:104.07 KB

- 文档页数:2

智能控制技术课程论文中文题目: 粒子群算法的研究现状及其应用姓名学号:指导教师:年级与专业:所在学院:XXXX年XX月XX日1 研究的背景优化问题是一个古老的问题,可以将其定义为:在满足一定约束条件下,寻找一组参数值,使系统的某些性能指标达到最大值或最小值。

在我们的日常生活中,我们常常需要解决优化问题,在一定的范围内使我们追求的目标得到最大化。

为了解决我们遇到的最优化问题,科学家,们进行了不懈的努力,发展了诸如牛顿法、共轭梯度法等诸多优化算法,大大推动了优化问题的发展,但由于这些算法的低运行效率,使得在计算复杂度、收敛性等方面都无法满足实际的生产需要。

对此,受达尔文进化论的影响,一批新的智能优化算法相继被提出。

粒子群算法(PSO )就是其中的一项优化技术。

1995 年Eberhart 博士和Kennedy 博士[1]-[3]通过研究鸟群捕食的行为后,提出了粒子群算法。

设想有一群鸟在随机搜索食物,而在这个区域里只有一块食物,所有的鸟都不知道食物在哪里。

那么找到食物最简单有效的办法就是鸟群协同搜寻,鸟群中的每只鸟负责离其最近的周围区域。

粒子群算法是一种基于群体的优化工具,尤其适用于复杂和非线性问题。

系统初始化为一组随机解,通过迭代搜寻最优值,通过采用种群的方式组织搜索,同时搜索空间内的多个区域,所以特别适合大规模并行计算,具有较高的效率和简单、易操作的特性。

目前使用的粒子群算法的数学描述[3]为:设粒子的寻优空间是m 维的,粒子的数目为ps ,算法的最大寻优次数为Iter 。

第i 个粒子的飞行速度为T i i1i2im v [v v ]= ,,,v ,位置为T i i1i2im x [x x x ]= ,,,,粒子的个体极值T i i1i2im Pbest [,]P = ,P ,P ,全局极值为T i i1i2im Gbest [,]g = ,g ,g 。

粒子群算法的寻优过程主要由粒子的速度更新和位置更新两部分组成,其更新方式如下:i+11122v ()()i i i i i v c r Pbest x c r Gbest x =+−+−;i+1i+1i x x v =+,式中:12c c ,为学习因子,一般取2;12r r ,是均与分布着[0,1]上的随机数。

粒子群优化算法研究进展粒子群优化算法(Particle Swarm Optimization,PSO)是一种基于群体智能的优化算法,灵感来自鸟群觅食行为。

粒子群算法最早由Eberhart和Kennedy于1995年提出,并在之后的二十多年间得到广泛应用和研究。

在粒子群优化算法中,解空间被看作是粒子在多维空间中的运动轨迹。

每个粒子代表一个解,通过移动位置来最优解。

粒子根据自身的历史最优解和群体中最优解进行更新,以找到全局最优解。

粒子群算法的研究进展可以从以下几个方面来概括。

首先,对基本粒子群算法的改进。

由于基本粒子群算法存在易陷入局部最优解的问题,研究者提出了一系列的改进方法。

例如,引入惯性权重控制粒子运动的方向和速度,改进了粒子的更新策略;引入自适应策略使粒子能够自适应地调整自身的行为。

其次,对约束优化问题的处理。

在实际应用中,许多优化问题还需要满足一定的约束条件。

针对约束优化问题,研究者提出了多种处理方法,如罚函数法、外罚函数法和修正的粒子群优化算法等,用于保证过程中的可行性。

此外,粒子群算法的应用领域也得到了广泛拓展。

粒子群算法已成功应用于许多领域,如函数优化、神经网络训练、图像分割、机器学习等。

在这些领域的应用中,粒子群算法往往能够找到较好的解,并具有较快的收敛速度。

最后,还有一些衍生算法被提出。

基于粒子群算法的思想,研究者提出了一些衍生算法,如混合算法和改进算法等。

这些算法在解决特定问题或克服粒子群算法的局限性方面具有一定的优势。

总结起来,粒子群优化算法是一种高效、简单而又灵活的优化算法,其研究进展包括对基本算法的改进、对约束优化问题的处理、应用领域的拓展以及衍生算法的提出等。

未来的研究方向可能包括进一步改进算法的性能、提升算法的收敛速度以及应用于更广泛的领域等。

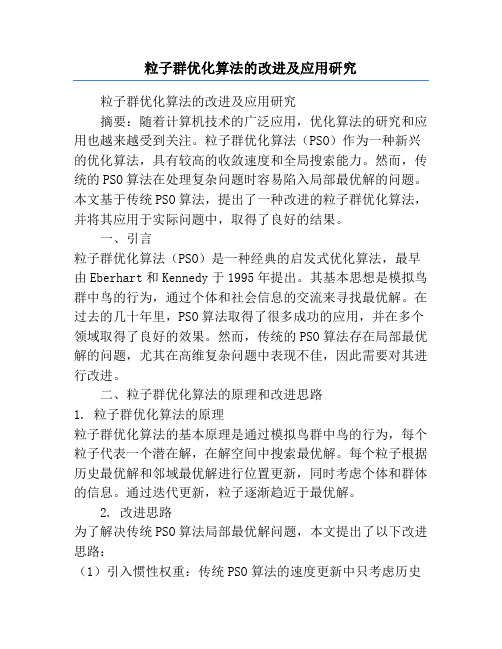

粒子群优化算法的改进及应用研究粒子群优化算法的改进及应用研究摘要:随着计算机技术的广泛应用,优化算法的研究和应用也越来越受到关注。

粒子群优化算法(PSO)作为一种新兴的优化算法,具有较高的收敛速度和全局搜索能力。

然而,传统的PSO算法在处理复杂问题时容易陷入局部最优解的问题。

本文基于传统PSO算法,提出了一种改进的粒子群优化算法,并将其应用于实际问题中,取得了良好的结果。

一、引言粒子群优化算法(PSO)是一种经典的启发式优化算法,最早由Eberhart和Kennedy于1995年提出。

其基本思想是模拟鸟群中鸟的行为,通过个体和社会信息的交流来寻找最优解。

在过去的几十年里,PSO算法取得了很多成功的应用,并在多个领域取得了良好的效果。

然而,传统的PSO算法存在局部最优解的问题,尤其在高维复杂问题中表现不佳,因此需要对其进行改进。

二、粒子群优化算法的原理和改进思路1. 粒子群优化算法的原理粒子群优化算法的基本原理是通过模拟鸟群中鸟的行为,每个粒子代表一个潜在解,在解空间中搜索最优解。

每个粒子根据历史最优解和邻域最优解进行位置更新,同时考虑个体和群体的信息。

通过迭代更新,粒子逐渐趋近于最优解。

2. 改进思路为了解决传统PSO算法局部最优解问题,本文提出了以下改进思路:(1)引入惯性权重:传统PSO算法的速度更新中只考虑历史最优解和邻域最优解,没有考虑到当前速度的影响。

为了引入速度的信息,本文在速度更新公式中引入了惯性权重。

惯性权重用于调节上一次速度对当前速度的影响程度,可以提高算法的全局搜索能力。

(2)引入自适应参数:传统PSO算法通常需要手动设置参数,对于不同问题,最优参数的选择可能不同。

为了克服这个问题,本文引入了自适应参数机制。

通过遗传算法等方法,自动调整PSO算法的参数,提高算法的鲁棒性和适应性。

三、实验设计与结果分析本文将改进的PSO算法应用于函数优化问题和组合优化问题中,并与传统PSO算法进行对比实验。

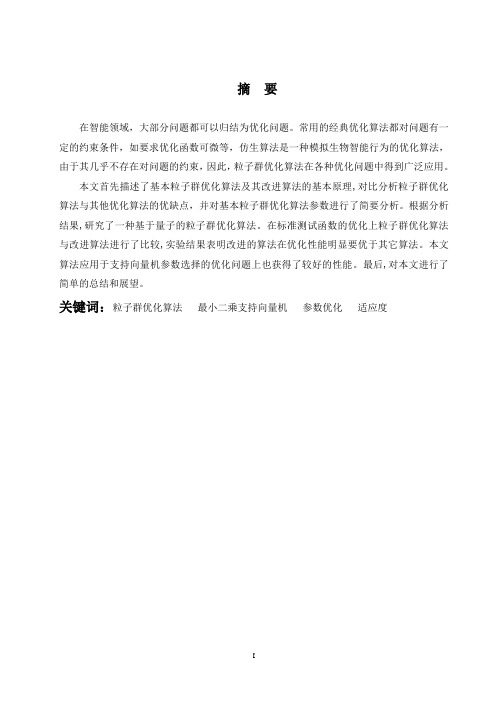

摘要在智能领域,大部分问题都可以归结为优化问题。

常用的经典优化算法都对问题有一定的约束条件,如要求优化函数可微等,仿生算法是一种模拟生物智能行为的优化算法,由于其几乎不存在对问题的约束,因此,粒子群优化算法在各种优化问题中得到广泛应用。

本文首先描述了基本粒子群优化算法及其改进算法的基本原理,对比分析粒子群优化算法与其他优化算法的优缺点,并对基本粒子群优化算法参数进行了简要分析。

根据分析结果,研究了一种基于量子的粒子群优化算法。

在标准测试函数的优化上粒子群优化算法与改进算法进行了比较,实验结果表明改进的算法在优化性能明显要优于其它算法。

本文算法应用于支持向量机参数选择的优化问题上也获得了较好的性能。

最后,对本文进行了简单的总结和展望。

关键词:粒子群优化算法最小二乘支持向量机参数优化适应度目录摘要 (I)目录 (II)1.概述 (1)1.1引言 (1)1.2研究背景 (1)1.2.1人工生命计算 (1)1.2.2 群集智能理论 (2)1.3算法比较 (2)1.3.1粒子群算法与遗传算法(GA)比较 (2)1.3.2粒子群算法与蚁群算法(ACO)比较 (3)1.4粒子群优化算法的研究现状 (4)1.4.1理论研究现状 (4)1.4.2应用研究现状 (5)1.5粒子群优化算法的应用 (5)1.5.1神经网络训练 (6)1.5.2函数优化 (6)1.5.3其他应用 (6)1.5.4粒子群优化算法的工程应用概述 (6)2.粒子群优化算法 (8)2.1基本粒子群优化算法 (8)2.1.1基本理论 (8)2.1.2算法流程 (9)2.2标准粒子群优化算法 (10)2.2.1惯性权重 (10)2.2.2压缩因子 (11)2.3算法分析 (12)2.3.1参数分析 (12)2.3.2粒子群优化算法的特点 (14)3.粒子群优化算法的改进 (15)3.1粒子群优化算法存在的问题 (15)3.2粒子群优化算法的改进分析 (15)3.3基于量子粒子群优化(QPSO)算法 (17)3.3.1 QPSO算法的优点 (17)3.3.2 基于MATLAB的仿真 (18)3.4 PSO仿真 (19)3.4.1 标准测试函数 (19)3.4.2 试验参数设置 (20)3.5试验结果与分析 (21)4.粒子群优化算法在支持向量机的参数优化中的应用 (22)4.1支持向量机 (22)4.2最小二乘支持向量机原理 (22)4.3基于粒子群算法的最小二乘支持向量机的参数优化方法 (23)4.4 仿真 (24)4.4.1仿真设定 (24)4.4.2仿真结果 (24)4.4.3结果分析 (25)5.总结与展望 (26)5.1 总结 (26)5.2展望 (26)致谢 (28)参考文献 (29)Abstract (30)附录 (31)PSO程序 (31)LSSVM程序 (35)1.概述1.1引言最优化问题是在满足一定约束条件下,寻找一组参数值,使得系统的某些性能指标达到最大或者最小。

多目标优化的粒子群算法及其应用研究共3篇多目标优化的粒子群算法及其应用研究1多目标优化的粒子群算法及其应用研究随着科技的发展,人们对于优化问题的求解需求越来越高。

在工程实践中,很多问题都涉及到多个优化目标,比如说在物流方面,安全、效率、成本等指标都需要被考虑到。

传统的单目标优化算法已不能满足这些需求,因为单目标算法中只考虑单一的优化目标,在解决多目标问题时会失效。

因此,多目标优化算法应运而生。

其中,粒子群算法是一种被广泛应用的多目标优化算法,本文将对这种算法进行介绍,并展示其在实际应用中的成功案例。

1. 算法原理粒子群算法(Particle Swarm Optimization,PSO)是一种仿生智能算法,源自对鸟群的群体行为的研究。

在算法中,将待优化的问题抽象成一个高维的空间,然后在空间中随机生成一定数量的粒子,每个粒子都代表了一个潜在解。

每个粒子在空间中移动,并根据适应度函数对自身位置进行优化,以期找到最好的解。

粒子的移动和优化过程可以通过以下公式表示:$$v_{i,j} = \omega v_{i,j} + c_1r_1(p_{i,j} - x_{i,j}) + c_2r_2(g_j - x_{i,j})$$$$x_{i,j} = x_{i,j} + v_{i,j}$$其中,$i$ 表示粒子的编号,$j$ 表示该粒子在搜索空间中的第 $j$ 个维度,$v_{i,j}$ 表示粒子在该维度上的速度,$x_{i,j}$ 表示粒子在该维度上的位置,$p_{i,j}$ 表示粒子当前的最佳位置,$g_j$ 表示整个种群中最好的位置,$\omega$ 表示惯性权重,$c_1$ 和 $c_2$ 分别为粒子向自己最优点和全局最优点移动的加速度系数,$r_1$ 和 $r_2$ 为两个 $[0,1]$ 之间的随机值。

通过粒子群的迭代过程,粒子逐渐找到最优解。

2. 多目标优化问题多目标优化问题的具体表述为:给出一个目标函数集 $f(x) = \{f_1(x), f_2(x),...,f_m(x)\}$,其中 $x$ 为决策向量,包含 $n$ 个变量,优化过程中需求出 $f(x)$ 的所有最佳解。

基于粒子群优化算法的神经网络架构搜索与参数优化方法

研究

近年来,神经网络在深度学习领域取得了巨大的成功。

然而,设计一个有效的神经网络架构仍然是一个具有挑战性的问题。

传统的人工设计方法需要大量的经验和时间,而且很难找到最佳的架构。

为了解决这个问题,研究人员提出了一种基于粒子群优化算法的神经网络架构搜索与参数优化方法。

粒子群优化算法是一种模仿鸟群寻找食物的行为而发展起来的优化算法。

它通过不断地迭代搜索空间中的解空间,从而找到最佳的解。

在这个方法中,每个粒子代表一个神经网络架构。

每个粒子都有一个位置和速度,位置表示当前的网络架构,速度表示网络架构的变化方向。

粒子群中的每个粒子根据当前的位置和速度更新自己的位置,并根据一个评价函数计算其适应度。

适应度高的粒子将会被保留下来,并作为下一次迭代的起点。

为了进一步优化神经网络的性能,该方法还引入了参数优化。

在每次更新粒子位置之前,通过使用梯度下降算法对神经网络的参数进行优化。

这样可以在搜索过程中同时优化网络架构和参数,从而得到更好的结果。

通过在多个数据集上的实验证明,基于粒子群优化算法的神经网络架构搜索与参数优化方法相比于传统的方法具有更高的准

确性和更快的收敛速度。

该方法能够自动地搜索到最佳的网络架构和参数,在各种任务中都取得了良好的结果。

总之,基于粒子群优化算法的神经网络架构搜索与参数优化方法为神经网络的设计提供了一种新的思路。

它能够自动地找到最佳的架构和参数,并在各种任务中取得优秀的性能。

这一方法的研究为深度学习的发展提供了新的方向,有望在未来得到更广泛的应用。

粒子群优化算法的改进方法研究的开题报告一、研究背景及意义粒子群优化算法(Particle Swarm Optimization,PSO)是一种基于种群智能的优化算法,主要用于函数优化问题的解决。

采用了类似鸟群寻找饲料的方式,将候选解视为粒子,通过粒子之间的信息交流和学习,找到最优解。

PSO算法具有迭代速度快、易于实现、优化效果好等优点,在机器学习、数据挖掘和智能计算等领域都有广泛的应用。

但是,PSO算法在解决复杂问题时,常常存在早熟收敛、局部最优等问题。

为解决这些问题,目前已经涌现出了很多的改进方法。

例如,在速度方面,可考虑采用非线性速度衰减策略、引入基于时间的加速因子机制;在搜索范围方面,可引入自适应搜索范围机制等等。

因此,本文将研究PSO算法的改进方法,以提高其搜索效率和优化精度。

二、研究内容本文将研究PSO算法的改进方法,主要包括以下方面:1. 更优秀的适应度函数设计在PSO算法中,适应度函数的设计对算法的性能和效果具有重要影响。

本文将探讨更好的适应度函数设计方法,以优化算法性能和效果。

2. 引入多目标优化策略在实际应用中,存在多个决策变量需要优化,且它们之间可能存在相互制约或相互依赖的关系。

本文将引入多目标优化策略,以满足实际应用需求。

3. 优化搜索范围本文将研究如何优化粒子搜索的范围,以提高算法的效率和精度。

具体而言,将考虑采用自适应搜索范围机制和非线性速度衰减策略等。

4. 基于自适应机制的参数选择本文将选取适当的参数来描述粒子在搜索空间中的行为。

将探索和研究自适应机制,以便自动地选择最佳参数组合。

三、研究方法与流程本文将采用以下流程来研究PSO算法的改进方法:1. 收集相关文献,并对PSO算法进行深入了解。

2. 建立模型,包括适应度函数、搜索范围等。

3. 针对PSO算法存在的问题,提出具体的改进方法。

4. 设计实验方案,并在不同情况下对比不同方法的优化效果。

5. 分析实验结果,评估各种方法的优缺点。

粒子群优化算法的研究进展郭文忠 陈国龙(福州大学数学与计算机科学学院,福建福州350002)摘 要 粒子群优化算法是一类新兴的基于群智能的随机优化算法,同其它的进化算法相比,其最具吸引人的特征是简单容易实现和更强的全局优化能力。

本文介绍了PS O算法的研究现状,并讨论了PSO将来的研究方向。

关键字 粒子群优化群智能 优化1 引言粒子群优化(Particle Sw arm O ptimization,PSO)算法是一类新兴的基于群智能的随机优化算法,同其它的进化算法相比,其最具吸引人的特征是简单容易实现和更强的全局优化能力。

为此,PSO一提出,立刻引起了演化计算等领域的学者们的广泛关注并在短短的几年时间里出现大量的研究成果,形成了一个研究热点,在函数优化、神经网络训练、工业系统优化和模糊系统控制等领域得到了广泛的应用[1,2]。

大量实验结果表明了PSO算法能解决遗传算法(G enet ic A logor ithm,GA)所能解决的各类优化问题,也显示出PSO算法确实是有力的优化工具且具有强大的生命力[3]。

PSO算法是由Eberhart博士和Kennedy博士于1995年提出,是一种基于迭代的优化方法[4]。

在P SO中,每个粒子都是解空间(D维)的一点,并且都具有一个速度(D维的矢量),不同粒子具有对应于与目标函数相关的个体适应度。

每个粒子根据自身的飞行经验和群体的飞行经验来调整自己的飞行轨迹,向最优点靠拢。

对于某个粒子i,它的位置表示为X i=(X i1, X i2,...,X iD),飞行速度V i=(V i1,V i2,...,V iD),它所经历过的最好位置记为p i=(p i1,p i2,...,p iD),它所能获取的群体的最好位置以索引g表示,记为p g。

在每一步中,粒子根据以下公式更新自己的速度和位置:v id=w!v id+c1r1(p id-x id)+c2r2(p gd-x id)(1) x id=x id+v id(2)其中w称为惯性权值,c1,c2是两个正常数,称为加速因子,r1和r2是两个0~1之间的随机数。

通常使用一个常量V max来限制粒子的速度,改善搜索结果。

从式(1)和式(2)可以看出,粒子的飞行轨迹由三部分决定,自己原有的速度v i,与自己的最佳经历的距离(p i-x i),以及与群体最好位置的距离(p g-x i),而参数w,c1和c2是控制这三部分内容的权重。

为此,参数w,c1和c2在整个速度的更新过程中起着举足轻重的作用,从而引起了许多研究者的兴趣,相应也提出了多种的改进算法。

2 PSO算法的改进算法PSO算法一提出就吸引了学术界的广泛重视,目前已成为一个研究热点,各种关于PSO算法应用研究的成果不断涌现,有力地推动了PSO研究。

当前已经有多种对PSO算法的改进,然而正如∀没有免费午餐#的理论所认为的,这些改进算法需要针对具体问题的特点,根据领域知识对算法参数进行设置,在提高某种性能的同时也为此付出相应代价。

2.1基于惯性权值的改进粒子群优化算法以种群行为而不是适者生存原则来激励粒子的运动。

每个潜在解与粒子运行速度相联系,该速度不停地根据粒子经验以及粒子邻居们的经验来调整大小、方向,总是希望粒子能朝着更好的方向发展。

在搜索过程中,全局搜索能力与局部搜索能力的平衡关系对于算法的成功起着至关重要的作用。

Shi和Eber hart研究了惯性权值对优化性能的影响,发现较大的值有利于跳出局部极小点,而较小的值有利于算法收敛,提出了一种是根据算法叠代次数使惯性权值线性递减的方法。

算法在初期使用较大惯性权值,具有较强全局搜索能力,后期则使用较小惯性权值,提高局部搜索能力[5]。

惯性权值的计算公式如下:w=(w1-w2)!(MA X iter-iter)M A Xiter+w2(3)其中,w1和w2是惯性权值的初始值和最终值,M AXiter 和iter分别为算法最大叠代次数和当前代数。

Shi和Eber hart在文献[6]中提出了使用模糊控制系统自适应调整惯性权值和针对动态优化问题的随机惯性权值等方法,这些改进算法虽然提高了收敛速度并且在单峰问题上取得了更高的性能,但在解决多峰值函数问题时,容易陷入局部最优且实现也比较困难。

2.2基于加速因子的改进从粒子的速度更新公式来看,第一部分表示了粒子当前速度对粒子飞行的影响,这部分提供了粒子在搜索空间飞行的动力。

第二部分是所谓的∀个体认知#部分,代表了粒子的个人经验,促使粒子朝着自身所经历过的最好位置移动。

第三部分是所谓∀群体认知#部分,代表了群体经验对粒子飞行轨迹的影响,促使粒子朝着群体发现的最好位置移动。

加速因子c1和c2决定了粒子本身经验信息和其他粒子的经验信息对粒子运行轨迹的影响,反映了粒子群之间的信息交流。

设置较大c1的值,会使粒子过多的在局部范围徘徊,相反,较大的c2值会促使粒子过早收敛到局部最小值。

Shi和Eber hart[5]建议,为了平衡随机因素的作用,一般情况下设置c1=c2 =2。

大部分算法都采用这个建议,不过在其它文献中也有不同的取值。

但是一般c1等于c2并且范围在0和4之间。

为了更好地朝着最优方向移动,文献[7]等对加速因子做了一些较为深入地研究并提出了相应的改进算法。

实验结果表明了改进算法确实加快了算法的收敛,在单峰问题的测试表现优异,却付出了算法容易陷入局部最优的代价,且在多峰值函数的测试中容易过早收敛。

2.3其他一些改进算法文献[8]使用了不同连接拓扑的PSO进行实验。

实验结果都表明了,选择一种合适的邻近群拓扑,对算法性能的影响是明显的。

然而没有一种邻近群拓扑对所有基准函数都是最合适的,具体选择哪一中邻近群拓扑与具体的问题有关。

例如,使用信息交流率越高的拓扑(如轮形),算法的收敛速度越快,适用于单峰值分布的函数。

继而也相应出现了一些其他的改进算法,如:基于遗传算法思想的改进算法[9]以及基于种群规模的改进算法[10]等,然而正如∀没有免费午餐#的理论所认为的,这些改进算法需要针对具体问题的特点,根据领域知识对72005年第4期 福 建 电 脑*本文研究工作获福建省自然科学基金(A0410010)和福州大学科技发展基金(2003-XQ-23)资助。

算法参数进行设置,在提高某种性能的同时也为此付出相应的代价,即有些改进算法容易陷入局部最优,特别是在多峰函数的测试中导致容易过早收敛,并且有些算法在某些基准函数提高了优化性能,而在另外基准函数中却恶化了优化性能。

这也说明了单纯对PSO算法的参数等问题作一些简单的改进并不能从根本上解决PSO自身的缺点。

3 值得进一步研究的相关问题3.1PSO算法机理的数学理论自PSO于1995年由Eber hart博士和K ennedy博士提出以来,大部分研究成果关注的是通过修改原PSO算法的某些方面而获得试验结果,当然试验比较结果对洞察PSO算法的本质能提供强有力的帮助,但若没有一个如何运行算法的形式模型,要确定算法内部机理是不可能的。

目前PSO算法研究者主要致力于算法的应用研究,很少人去关心算法本身的工作原理,即很少涉及到对算法内部机理的研究,如:(1)P SO中位置和速度的构造及参数的设计理论不成熟;(2)对P SO中的参数分析没有实质性的认识,都处在试验分析阶段;(3)P SO的改进算法及其应用也都停留在试验阶段,缺乏理论支持。

为此,对于这么一个年轻的、具有很大开发潜力的启发式算法,开展对一些对PSO算法机理的研究具有较大的科学意义,不但可以加深对PSO算法机制的认识,而且对于扩展PSO的应用领域也具有比较深远的意义。

3.2PSO算法的参数调整模型由于实际问题的多样性和复杂性,尽管目前已经有了多种不同版本的PSO改进算法,但这些PSO算法不具有通用性,或者参数的设置要求使用者具备较高的经验,否则难以达到理想的效果。

特别在参数w,c1和c2上,由于适应度较高的粒子需要更高的局部搜索能力,适应度较低的粒子却需要提高它们的全局搜索能力,以期跳出局部最优解的陷阱,而PS O的惯性权值w的设置正好控制了粒子的全局搜索能力与局部搜索能力之间的平衡,为此如何构造一个惯性权值的自适应调整模型,达到控制粒子的全局搜索能力与局部搜索能力之间的平衡是今后研究的一个方向。

而加速因子c1和c2决定了粒子本身经验信息和其它粒子的经验信息对粒子运行轨迹的影响,反应了粒子群之间的信息交流。

设置较大c1的值,会使粒子过多的在局部范围内徘徊,而较大的c2值却会促使粒子过早收敛,即c1和c2协同控制着PSO算法朝着最优解方向进化。

为此如何构造一个c1和c2的协调模型也是值得深入研究的一个方向。

3.3PSO算法应用领域的拓展科学与工程实践中一大类问题都可以归结为优化问题,而一般说来,科学研究与工程实践中许多优化问题大都是多目标优化问题。

多目标优化问题(M ulti-object ive O ptimization Problems,M OPs)通常难以处理,由于实际问题常由多个相互冲突的指标组成,问题的解通常不是单个的最优解,而是一组非劣解,因而采用传统多目标优化方法通常无法解决。

由于PSO算法的生命力在于工程应用,为此开拓新的PSO算法的应用领域特别是在解决多目标优化问题上是一项很有意义的工作。

4 结束语粒子群优化算法是一类新兴的基于群智能的随机优化算法,同其它的进化算法相比,其最具吸引人的特征是简单容易实现和更强的全局优化能力。

本文在介绍了一些目前常见的PSO改进算法之后,对这些改进算法的优缺点也做了简要的分析,最后指出并阐释了值得进一步研究的相关问题。

PSO算法的研究处于初期,待研究的问题还很多,如PSO 算法的收敛性问题、PSO算法的参数空间问题、PSO算法的数学理论、PSO算法与其它优化算法的融合以及PSO新应用领域的开拓等等,这些都是目前的研究热点。

参考文献[1]Shi Y H,Eberhart R C.A M odified Particle Sw arm Optimizer.In:IEEE International Conference of Evolutionary Computati on,Pi scataway,NJ:IEEE,1998.69~73[2]Salerno ing th e particle sw arm optimization technique to train a recurrent neural model.In:Proceedings of the Ninth IEEE International Con ference on Tools w ith Artificial Intelligence,Newport Beach,CA,USA:IEEE Computer Society,1997:45-49.[3]Kennedy J,Eberhart R C.S warm Intelligence.San M ateo,CA:M organ Kaufmann,2001[4]Eberhart R.C.,and Kennedy J.A new optimi z er using particles swarm theory,Proc.Sixth International Symposi um on M icro M achine and HumanScience,Nagoya,Japan,IEEE S ervi ce Center,Piscataw ay,NJ,1995,39~43.[5]Shi Y.H.and Eberhart R. C.Parameter selection in particle sw arm optimizati on.1998Annual Conference on Evolutionary Programming,SanDiego,M arch1998.[6]Shi Y.H.and Eberhart R.C.Fuzzy Adaptive Particle Sw arm Optimization.Proceedi ngs of the Congress on Evoluti onary Computation,Seoul,Korea,2001.[7]Ratnaw eera A,Halgamuge S.S elf-organizing hierarchical particle sw arm opti m i z er w ith time-varying acceleration coefficients.IEEE T rans.Evolutionary Computation,2004,8(3):240~255[8]Ven den Bergh F.and Engelbrecht ing Neighbourhoods w ith the Guarranteed Convergence PS O.Proceedings of the2003IEEE,Sw arm Intelligence Symposium,2003.235-242.[9]Lovbjerg M,Rasmussen T K,Krink T.Hybrid particle sw arm optimizer w ith breedi ng and subpopul-ations.In:Proceedings of the third Geneticand Evolutionary Computation Conference,San Francisco,CA:M organ Kaufmann,2001.[10]Clerc M.Think locall y,act locally:the way of life of cheap-PSO,an Adapti ve particle swarm optimizer:http://w w 8福 建 电 脑 2005年第4期。