浅谈矩阵的特征向量特征值的意义

- 格式:doc

- 大小:25.50 KB

- 文档页数:3

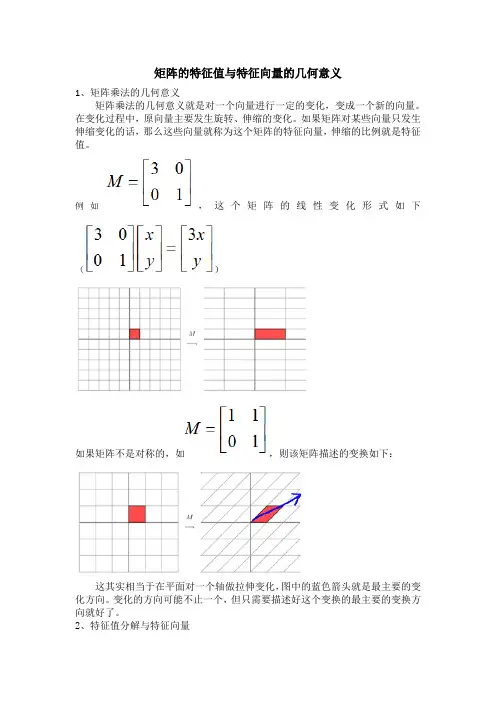

矩阵的特征值与特征向量的几何意义1、矩阵乘法的几何意义矩阵乘法的几何意义就是对一个向量进行一定的变化,变成一个新的向量。

在变化过程中,原向量主要发生旋转、伸缩的变化。

如果矩阵对某些向量只发生伸缩变化的话,那么这些向量就称为这个矩阵的特征向量,伸缩的比例就是特征值。

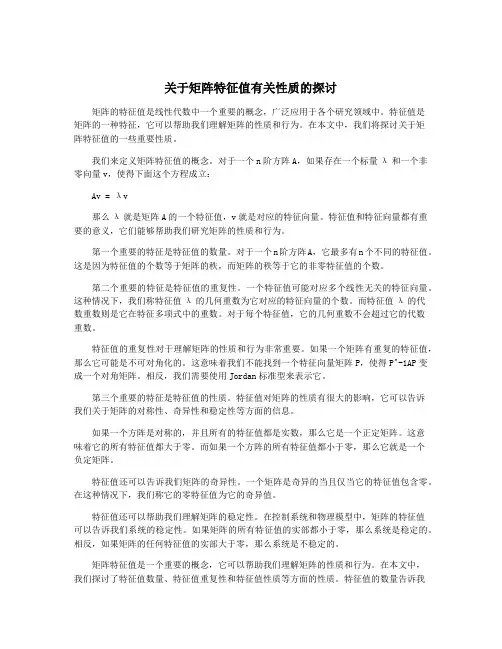

例如,这个矩阵的线性变化形式如下()如果矩阵不是对称的,如,则该矩阵描述的变换如下:这其实相当于在平面对一个轴做拉伸变化,图中的蓝色箭头就是最主要的变化方向。

变化的方向可能不止一个,但只需要描述好这个变换的最主要的变换方向就好了。

2、特征值分解与特征向量设A为一个方阵,v为一个非零列向量,若,则称λ为A的特征值,v为矩阵A 对应于特征值λ的特征向量。

特征值分解:将矩阵A分解为如下形式:。

Q为矩阵A的特征向量v组成的矩阵(一个变换方阵的所有特征向量组成了这个变换矩阵的一组基),∑为一个对角阵,主对角线上的元素为A的特征值从小到大排列。

这些特征值所对应的特征向量用来描述矩阵A的变换方向,从最主要的变换到最次要的变换排列。

也就是说,一个矩阵的信息可由其特征值和特征向量来描述。

对于矩阵为高维的情况下,那么这个矩阵就是高维空间下的一个线性变换。

可以想象,这个变换也同样有很多的变换方向,我们通过特征值分解得到的前N 个特征向量,那么就对应了这个矩阵最主要的N个变化方向。

我们利用这前N 个变化方向,就可以近似这个矩阵(变换)。

总结一下,特征值分解可以得到特征值与特征向量,特征值表示的是这个特征到底有多重要,而特征向量表示这个特征是什么。

不过,特征值分解也有很多的局限,比如说变换的矩阵必须是方阵。

在机器学习的特征提取中,对应特征值越大的特征向量包含的信息越多。

若果某特征向量对应的特征值很小,就可以把它去掉(降维),只保留特征值大的方向的信息,这样就可以减少数据量,PCA降维就是应用了这一原理。

矩阵特征值与特征向量是线性代数中非常重要的概念,广泛应用于数学、物理、工程等领域。

本文将详细介绍矩阵特征值与特征向量的定义、性质以及其在实际问题中的应用。

首先,我们需要了解矩阵的特征值与特征向量的定义。

对于一个n阶方阵A,如果存在一个非零向量x使得Ax=λx,其中λ为一个常数,则称λ为矩阵A的特征值,x为矩阵A对应于特征值λ的特征向量。

特征值与特征向量是通过矩阵与向量的乘法关系定义出来的,并且特征值与特征向量总是成对出现的。

矩阵的特征值与特征向量有以下几个重要性质:1.特征值与特征向量的存在性:对于任意一个n阶方阵A,必然存在n个特征值和对应的特征向量。

特征值可以是实数也可以是复数。

2.特征向量的线性相关性:对于相同特征值λ的特征向量x和y,存在一个非零常数c,使得x=cy。

也就是说,特征向量存在线性相关性。

3.特征值的重复性:一个特征值可能对应多个线性无关的特征向量,称为重复特征值。

4.特征值与行列式:矩阵A的特征值都是其特征多项式的根。

特别地,矩阵的迹等于特征值之和,行列式等于特征值之积。

5.相似矩阵的特征值相同:如果两个矩阵A和B相似(即存在一个可逆矩阵P,使得B=P⁻¹AP),则它们有相同的特征值。

矩阵特征值与特征向量在实际问题中有广泛的应用。

以下举几个例子说明:1.物理学中的应用:矩阵特征值与特征向量在量子力学和振动分析中起到重要作用。

在量子力学中,矩阵表示了物理系统的哈密顿算符,其特征值与特征向量对应于能量和波函数。

在振动分析中,矩阵表示了系统的质量矩阵,其特征值与特征向量对应于自然频率和振型。

2.图像处理中的应用:特征值与特征向量广泛应用于图像处理和模式识别中。

通过计算图像矩阵的特征值和特征向量,可以提取出图像的主要特征,如边缘、纹理等,从而实现图像分类和识别。

3.经济学中的应用:矩阵特征值与特征向量在经济学中有很多应用,如马尔可夫链模型、投入产出模型等。

通过计算矩阵的特征值和特征向量,可以分析经济系统的稳定性、动态演化和结构关系。

关于矩阵特征值有关性质的探讨矩阵的特征值是线性代数中一个重要的概念,广泛应用于各个研究领域中。

特征值是矩阵的一种特征,它可以帮助我们理解矩阵的性质和行为。

在本文中,我们将探讨关于矩阵特征值的一些重要性质。

我们来定义矩阵特征值的概念。

对于一个n阶方阵A,如果存在一个标量λ和一个非零向量v,使得下面这个方程成立:Av = λv那么λ就是矩阵A的一个特征值,v就是对应的特征向量。

特征值和特征向量都有重要的意义,它们能够帮助我们研究矩阵的性质和行为。

第一个重要的特征是特征值的数量。

对于一个n阶方阵A,它最多有n个不同的特征值。

这是因为特征值的个数等于矩阵的秩,而矩阵的秩等于它的非零特征值的个数。

第二个重要的特征是特征值的重复性。

一个特征值可能对应多个线性无关的特征向量。

这种情况下,我们称特征值λ的几何重数为它对应的特征向量的个数。

而特征值λ的代数重数则是它在特征多项式中的重数。

对于每个特征值,它的几何重数不会超过它的代数重数。

特征值的重复性对于理解矩阵的性质和行为非常重要。

如果一个矩阵有重复的特征值,那么它可能是不可对角化的。

这意味着我们不能找到一个特征向量矩阵P,使得P^-1AP变成一个对角矩阵。

相反,我们需要使用Jordan标准型来表示它。

第三个重要的特征是特征值的性质。

特征值对矩阵的性质有很大的影响,它可以告诉我们关于矩阵的对称性、奇异性和稳定性等方面的信息。

如果一个方阵是对称的,并且所有的特征值都是实数,那么它是一个正定矩阵。

这意味着它的所有特征值都大于零。

而如果一个方阵的所有特征值都小于零,那么它就是一个负定矩阵。

特征值还可以告诉我们矩阵的奇异性。

一个矩阵是奇异的当且仅当它的特征值包含零。

在这种情况下,我们称它的零特征值为它的奇异值。

特征值还可以帮助我们理解矩阵的稳定性。

在控制系统和物理模型中,矩阵的特征值可以告诉我们系统的稳定性。

如果矩阵的所有特征值的实部都小于零,那么系统是稳定的。

相反,如果矩阵的任何特征值的实部大于零,那么系统是不稳定的。

矩阵的特征向量与特征值的几何意义我们都知道说到矩阵的特征向量和特征值的时候,都会提到Ax=λx这个式子,也就是众所周知的特征值方程。

下面就从这里展开,来解释一下特征向量和特征值的几何意义。

首先允许我介绍一下特征值方程(Ap=λp为了后面表述的更好理解一些,暂且使用p吧)中的各项:A是一个矩阵,也可以说是一个变换阵;p是一个向量(暂且说成是一个吧),比如说是二维空间的一个向量p,其坐标为(x,y);λ是一个标量,暂且理解为一个实数好了。

接下来,分析他们之间的关系:Ap=λp的几何意义就是p这个向量通过A这个变换阵将其变为了λp(p向量乘了一个λ标量,依然是一个向量)这个向量;并且由于λ是标量,故作此变换之后并没有改变原来p向量的方向,只是在p向量原来的方向上对其拉伸了λ倍。

注意,此时我们的关注的焦点是p向量。

若我们转移我们所关注的焦点到A身上,从而也可以理解为p这个向量是对于A矩阵的一个很特别的向量(因为它可以限制A只能对它作拉伸变换,而不能对它作旋转变换,这个特性是相当有价值的),这里先称其为A的特征向量,至于为什么可以称为特征向量,后面慢慢的说明。

我们知道在Ap=λp中,存在的特征值不一定只有一个,并且用特征值和特征向量就可以唯一的表达出对应的矩阵,比如此例中若是存在两个特征值λ1和λ2,那么,A=λ1*p1+λ2* p2,其中p1、p2是对应的特征向量;前面说过矩阵可以称为变换阵,也就是说它可以将一个向量做拉伸或者旋转变换或者两种变换同时完成。

下面用几个图来说明一下:矩阵A对向量n变换之后。

特征值与特征向量的应用特征值与特征向量是线性代数中重要的概念,它们在许多领域中都有广泛的应用,如物理学、工程学和计算机科学等。

在本文中,我们将探讨特征值与特征向量的定义、性质以及它们在不同领域中的具体应用。

一、特征值与特征向量的定义与性质特征值是矩阵运算中的一个重要概念,它可以帮助我们了解矩阵的变换特性。

对于一个n×n的矩阵A,如果存在一个非零向量x,使得Ax=λx,其中λ是一个标量,那么λ就是矩阵A的特征值,x是矩阵A的特征向量。

特征向量与特征值有以下几个重要性质:1. 特征值可以是实数或复数;2. 特征值与特征向量是成对出现的,一个特征值可以对应多个特征向量;3. 特征向量不唯一,只要是与一个特征值对应的特征向量都可以。

特征值与特征向量的定义及其性质可以帮助我们更好地理解它们在实际问题中的应用。

二、特征值与特征向量在物理学中的应用特征值与特征向量在物理学中有广泛的应用。

例如,在量子力学中,波函数的时间演化可以通过求解薛定谔方程得到,其中的波函数就是特征向量,特征值则对应能量的值。

特征值的大小和符号决定了体系的稳定性和行为。

此外,在经典力学中,特征向量可以用于描述刚体的转动运动。

特征值告诉我们刚体的运动状态,如旋转的角速度和转动惯量等。

特征值与特征向量在物理学中的应用经常涉及到矩阵运算和计算特征值分解,能够帮助我们解决实际问题。

三、特征值与特征向量在工程学中的应用特征值与特征向量在工程学中也有广泛的应用。

例如,在结构动力学中,特征值可以用于判断结构物的稳定性。

通过求解结构物的特征值问题,可以得到结构物的固有频率,从而判断结构物是否会发生共振等问题。

此外,在信号处理领域中,特征值与特征向量被广泛应用于降维和数据压缩。

通过对数据进行特征值分解,可以将高维数据降低到低维空间,从而减少计算量和存储空间。

四、特征值与特征向量在计算机科学中的应用特征值与特征向量在计算机科学中也有着重要的应用。

例如,在图像处理中,特征值与特征向量被用于图像压缩和特征提取。

特征值与特征向量_一、特征值与特征向量的定义在线性代数中,对于一个nxn的矩阵A,如果存在一个非零向量v,使得Av=λv,其中λ是一个常数,则称λ为矩阵A的特征值,v为对应的特征向量。

特征向量是指矩阵在一些方向上的不发生变化的向量,而特征值则表示该方向上的缩放比例。

矩阵乘以特征向量v等于用特征值λ来放缩这个向量。

二、特征值与特征向量的性质1.特征值和特征向量总是成对出现,即一个特征向量对应一个特征值,可能有多个特征向量对应同一个特征值。

2.特征值可以为复数,但如果A是实对称矩阵,则特征值一定是实数。

3.矩阵的特征值可以通过求解方程,A-λI,=0得到,其中I是单位矩阵。

4.特征向量可以通过求解方程(A-λI)v=0得到,其中0是全零向量。

5.特征值的和等于矩阵的迹(所有主对角线上的元素之和),特征值的乘积等于矩阵的行列式。

三、特征值与特征向量的应用1.特征值分解特征值分解是矩阵分析中非常重要的一种分解方法,对于一个nxn的矩阵A,其特征值分解为A=VΛV^(-1),其中V是由特征向量构成的矩阵,Λ是由特征值构成的对角矩阵。

特征值分解可以用于求解线性方程组、矩阵的幂次计算、矩阵的逆等问题,也可以用于降维和数据压缩等领域。

2.特征值与特征向量的几何意义特征向量可以表示矩阵的一些方向上的不变性,通过求解矩阵的特征向量,可以了解矩阵对于不同方向上的变化情况。

例如,在计算机图形学中,可以通过矩阵的特征向量来描述形状的变化、旋转、缩放等操作。

3.矩阵的谱分析通过分析矩阵的特征值和特征向量,可以了解矩阵的性质和结构。

例如,对于对角矩阵,其特征值就是主对角线上的元素,特征向量为标准基向量。

四、总结特征值与特征向量是线性代数中的重要概念,具有广泛的应用。

特征值与特征向量可以用于矩阵分解、线性方程组求解、数据压缩和图形变换等问题,对于理解和分析矩阵的性质和结构有着重要的意义。

深入理解特征值与特征向量的概念和性质,对于掌握线性代数和应用数学具有重要的作用。

特征值特征向量物理含义《特征值特征向量的物理含义》特征值和特征向量是线性代数中重要的概念,它们在物理学中有着广泛的应用和深刻的物理含义。

特征值(eigenvalue)是矩阵运算中的一个概念,它用来描述在特定的变换下,向量发生的拉伸或压缩程度。

对于一个n阶方阵A,如果存在一个非零向量v,使得Av=λv,其中λ是一个常数,则称λ为矩阵A的特征值,v为对应的特征向量。

特征值告诉我们向量在变换下的缩放程度,而特征向量确定了该缩放所发生的方向。

在物理学中,特征值和特征向量的概念被广泛应用于量子力学和振动问题的研究中。

在量子力学中,波函数可以被看作是特征向量,其对应的特征值则表示测量得到的物理量。

特征值告诉我们量子系统的能量级别,而特征向量则表示能量对应的波函数形状。

以振动问题为例,当一个物体受到外力作用时,它会产生振动。

在某些情况下,振动问题可以转化为矩阵的特征值问题。

通过求解特征值和特征向量,我们可以得到系统的固有频率和对应的振动模式。

特征值告诉我们固有频率的大小,而特征向量则表示振动的形状和方向。

另外,特征值和特征向量还可以用于分析矩阵的稳定性和受力分布。

在力学问题中,矩阵可以表示材料的刚度矩阵或效应矩阵。

通过求解特征值和特征向量,我们可以确定结构的稳定性和受力分布。

特征值告诉我们系统的稳定性,而特征向量则表示力的传递路径和受力方向。

总而言之,特征值和特征向量在物理学中具有重要的意义和广泛的应用。

它们不仅能够描述物理量的测量结果和系统的固有特性,还可以用于分析振动问题、结构稳定性和力的传递路径。

通过深入理解特征值和特征向量的物理含义,我们可以更好地理解和解决物理问题。

矩阵的特征值与特征向量矩阵是线性代数中的重要概念,它在各个领域均有广泛的应用。

在研究矩阵的性质时,特征值与特征向量是一个不可或缺的概念。

本文将详细介绍矩阵的特征值与特征向量,探讨它们在矩阵理论和实际问题中的应用。

1. 特征值与特征向量的定义对于一个 n 阶方阵 A,如果存在一个非零向量 X 和一个实数λ,使得Ax = λX 成立,则称λ 为矩阵 A 的特征值,X 称为特征值λ 对应的特征向量。

2. 计算特征值与特征向量为了计算特征值与特征向量,我们可以使用特征值方程 det(A-λI) = 0。

其中,det() 表示矩阵的行列式,A 是待求特征值与特征向量的矩阵,I 是单位矩阵,λ 是未知数。

解特征值方程得到的λ 值即为矩阵的特征值。

3. 求解特征向量在得到特征值λ 后,我们可以通过代入特征值到方程 (A-λI)X = 0 中,求解出对应的特征向量 X。

需要注意的是,特征向量并不唯一,可以乘以一个非零常数得到不同的特征向量。

4. 特征值与特征向量的性质特征值与特征向量有以下重要性质:- 矩阵 A 的特征值的个数等于矩阵的阶数 n,包括重复的特征值。

- 所有特征值的和等于矩阵的迹(主对角线元素的和)。

- 矩阵 A 的特征向量构成的集合是线性无关的。

5. 矩阵的对角化与相似矩阵如果能找到一个可逆矩阵 P,使得 P^-1AP = D,其中 D 是对角矩阵,则称矩阵 A 是可对角化的。

对角矩阵 D 的对角线上的元素就是矩阵 A的特征值。

P 的列向量组成的矩阵就是 A 的特征向量矩阵。

6. 特征值与矩阵的性质关系矩阵的特征值与矩阵的性质之间存在一定的联系:- 如果矩阵 A 是奇异矩阵,则它的特征值中至少有一个为零。

- 如果矩阵 A 是对称矩阵,则它的特征值都为实数,并且相应的特征向量可以取为正交向量。

- 如果矩阵 A 是正定矩阵,则它的特征值都大于零。

7. 应用举例:主成分分析(PCA)主成分分析是一种常用的统计学方法,用于数据降维和特征提取。

矩阵在数学和物理学中具有很重要的地位,它是线性代数的基础,对于描述线性变换和矩阵变换有着重要的作用。

在矩阵的研究中,特征向量和特征值是一个基本概念,它们揭示了矩阵变换的重要性质和结构。

在矩阵运算中,特征向量和特征值是矩阵的相关性质。

特征向量是指在矩阵变换下不改变方向的向量,即矩阵A乘以特征向量v的结果与特征向量v成正比。

也就是说,特征向量v在矩阵A的作用下,只发生缩放不发生旋转或反转。

数学表示为Av=λv,其中A是矩阵,v是特征向量,λ是特征值。

那么,为什么矩阵会有特征向量和特征值呢?这是因为矩阵变换本质上是一个拉伸和旋转的过程。

特征向量表示的是在矩阵变换下不发生旋转的向量,而特征值则表示特征向量在变换中的缩放因子。

特征向量和特征值的重要性在于它们可以帮助我们理解矩阵变换的行为和结构。

特征值在矩阵的性质和应用中起着重要的作用。

特征值可以告诉我们矩阵变换过程中的缩放因子,也就是变换前后向量长度的比例。

如果特征值为正,表示变换会拉伸向量;如果特征值为负,表示变换会反转向量;如果特征值为零,表示变换会将向量压缩到一条直线上。

通过研究矩阵的特征值,我们可以推断矩阵变换的特性和变换后向量的特性。

特征向量和特征值的计算可以通过线性代数的方法进行。

对于一个n阶矩阵A,要求解其特征向量和特征值,我们需要求解方程Av=λv,也就是(A-λI)v=0。

其中I是单位矩阵。

这是一个齐次线性方程组,当(A-λI)的行列式为零时,方程组有非零解,也就是λ是矩阵A的特征值。

进一步,我们可以通过求解(A-λI)v=0的解得到特征向量。

矩阵特征向量和特征值具有一些重要的性质和应用。

首先,特征向量和特征值可以帮助我们理解矩阵变换的行为和性质。

特征向量表示的是在变换中不改变方向的向量,特征值表示的是在变换中的缩放因子。

通过研究特征向量和特征值,我们可以了解矩阵变换过程中的缩放、旋转和反转关系。

其次,特征向量和特征值在数据分析、图像处理等领域有着广泛的应用。

矩阵特征值的几何意义与方程特性的分析矩阵是线性代数中广泛使用的基本工具。

其中,矩阵的特征值和特征向量是非常重要的概念,在多个领域有着广泛的应用。

特征值和特征向量是矩阵特有的性质,它们具有深刻的几何意义,并在许多实际问题的求解中起到了关键作用。

本文将介绍矩阵特征值和特征向量的定义、计算方法以及它们的几何意义和方程特性的分析。

1. 矩阵特征值和特征向量的定义矩阵的特征值与特征向量是矩阵的一种本征性质,也是矩阵理论中最具代表性的概念之一。

设有一个n阶矩阵A,如果存在一个非零向量X,使得下面的式子成立:AX=λX其中,λ称为矩阵A的特征值,X称为矩阵A的特征向量。

换句话说,如果向量X被A矩阵作用后,只变化了一个常数λ的倍数,那么λ就是A的特征值,X就是A的特征向量。

需要注意的是,特征向量存在不唯一性,即如果一个向量X是A的特征向量,则kX(k为非零常数)也是A的特征向量,λ值不变。

2. 矩阵特征值和特征向量的计算方法计算矩阵的特征值和特征向量是线性代数中的一个重要的课题,有多种方法可以用来计算。

其中,求解矩阵的特征值和特征向量,可以用代数补全、特征多项式和迭代法等多种方法。

代数补全法是一种古老的计算特征值和特征向量的方法,其基本思想是根据矩阵的性质构造代数方程式W(x)=0,其中W(x)是一个n阶多项式,方程的0根就是矩阵A的特征值,然后通过矩阵运算求出每个特征值对应的特征向量。

特征多项式法是一种简化代数补全法的计算方法,通过求矩阵W(A)的特征值,就可以求出矩阵A的特征值。

迭代法是求解特征值的一种数值方法。

它是一种逐步逼近的方法,通过不断迭代求解,寻找矩阵的特征值和对应的特征向量。

3. 矩阵特征值和特征向量的几何意义矩阵的特征值和特征向量具有深刻的几何意义,在计算机图形学、机器学习和信号处理等领域广泛应用。

几何意义一:特征向量表示变换方向。

矩阵的特征向量代表着变换方向。

当我们通过A作用于向量X 时,X会被变换到其特征向量的方向上,并且变换的大小是特征值λ。

矩阵的特征值和特征向量的性质及其应用矩阵作为数学中一个非常重要的概念,广泛应用于各个科学领域中。

在矩阵的运算中,特征值和特征向量是其中的一个重要概念。

本文将介绍矩阵的特征值和特征向量的性质以及它们的应用。

一、矩阵的特征值和特征向量的定义对于一个n阶方阵A,如果存在一个实数λ和一个n维非零向量x使得Ax = λx,则称λ为矩阵A的一个特征值,x为矩阵A的对应于特征值λ的一个特征向量。

特征向量可以是任意量值,但是特征向量的长度必须是1。

特征值和特征向量的性质特征值和特征向量都有一些重要的性质,其中一些性质如下:1.特征值的和等于矩阵A的迹假设A的特征值为λ1,λ2,……,λn,则有:λ1+λ2+…+λn=tr(A)其中tr(A)表示矩阵A的迹,即矩阵A的主对角线上元素的总和。

2.特征值的积等于矩阵A的行列式假设A的特征值为λ1,λ2,……,λn,则有:λ1λ2…λn=det(A)其中det(A)表示矩阵A的行列式。

3.对于对称矩阵,所有特征向量都是正交的如果一个矩阵A是对称矩阵,那么所有特征向量都是正交的,即对于不同的特征向量x和y,都有xTy=0。

4.如果一个矩阵是正定矩阵,那么所有特征值都是正的如果一个矩阵A是正定矩阵,那么所有特征值都是正的。

反之,如果一个矩阵A的特征值都是正的,那么矩阵A不一定是正定矩阵。

特征向量的应用特征向量在各个领域中都有非常广泛的应用,其中一些应用如下:1.图像处理特征向量在图像处理中有着非常重要的应用。

通过对一个图像的像素矩阵进行特征向量分解,我们可以得到该图像的主要特征,包括图像的边缘,轮廓等。

2.信号处理特征向量在信号处理中也有重要应用。

通过分析信号的特征向量,我们可以得到信号的主要频率分量,进行频率分析,识别峰值等。

3.机器学习特征向量在机器学习中也非常重要。

在特征提取中,我们可以通过对样本数据进行主成分分析,得到样本的主要特征向量,然后再利用这些特征向量进行分类。

矩阵特征值的物理意义在物理学中,矩阵特征值可以用于描述物理系统的稳定性、振动模式、耗散和耦合等关键特性。

下面我们将逐一探讨这些物理意义。

首先,特征值可以用于判断物理系统的稳定性。

在动力学系统中,通常可以通过线性化系统方程得到一个矩阵,这个矩阵的特征值可以用于分析系统的稳定性。

如果所有特征值的实部都是负数,则系统是稳定的;如果存在特征值的实部为正数,则系统是不稳定的。

特征值的绝对值越大,表示系统离稳定性越远。

因此,特征值提供了一种定量判断和描述物理系统稳定性的方法。

其次,矩阵特征值和特征向量可以用于描述物理系统的振动模式。

物理系统中的振动往往可以表示为线性组合的简谐振动模式。

特征向量对应于振动模式中的一个正交基,特征值则对应于相应振动模式的频率。

特征值越大,表示该模式的频率越高。

这种分解方法有助于我们理解和描述复杂系统中的振动现象,例如声波在空腔中的分立频率,或者结构物中的模态振形等。

此外,矩阵特征值和特征向量还可以用于描述物理系统中的耗散和耦合过程。

在物理系统中,耗散和耦合通常导致能量转移和能级混合。

特征向量对应于一个物理模式,特征值则对应于该模式与其他模式耦合的强度。

特征值越小,表示耦合越弱;特征值越大,表示耦合越强。

这种描述方法使得我们能够定量分析和理解复杂系统中的能量转化和粒子间相互作用,例如原子的电子能级和分子的振动模式等。

最后,矩阵特征值还可以用于求解量子力学中的能量本征值和波函数。

在量子力学中,哈密顿算符对应于物理系统的能量,能量本征值和本征波函数则可以通过求解哈密顿算符的特征值和特征向量得到。

通过求解特征值问题,我们能够获得物理系统的能谱和波函数,从而揭示物质微观结构和宏观性质背后的规律和关联。

总之,矩阵特征值在物理学中有重要的物理意义。

它们可以用于描述物理系统的稳定性、振动模式、耗散和耦合等关键特性,帮助我们理解和解释物理系统的性质和行为。

特征值和特征向量的求解方法也为物理学家提供了强大的工具,用于解决各种复杂系统和问题。

矩阵特征值与特征向量矩阵是线性代数中重要的概念之一,它在各个领域中都有广泛的应用。

矩阵的特征值和特征向量是矩阵的重要性质,具有很大的研究价值和应用潜力。

本文将介绍矩阵特征值与特征向量的概念、计算方法以及其在实际问题中的应用。

一、特征值与特征向量的定义矩阵A的特征值(eigenvalue)是一个标量λ,使得满足方程Av=λv 成立的非零向量v称为矩阵A的特征向量(eigenvector)。

其中,方程为矩阵特征值方程。

特征值与特征向量之间存在一一对应关系。

特征值与特征向量是描述矩阵在特定线性变换下的性质的重要指标。

特征值表示变换后的向量与原向量之间的比例关系,特征向量则表示在特定变换下保持方向不变的向量。

二、特征值与特征向量的计算为了求解矩阵的特征值和特征向量,可以通过解特征值方程来实现。

给定一个矩阵A,求解特征值和特征向量的步骤如下:1. 求解特征值方程det(A-λI)=0,其中I是单位矩阵,det()表示行列式。

2. 解得特征值λ1,λ2,...,λn。

3. 对每个特征值λi,求解方程组(A-λiI)v=0,得到特征向量vi。

特征向量vi可以有多个,对应于不同的特征值λi。

特征向量可以通过高斯消元法或其他方法求解。

三、特征值与特征向量的性质特征值与特征向量具有以下重要性质:1. 矩阵A与其特征向量组成的矩阵P的乘积AP=PD,其中D是一个对角矩阵,对角线上的值是矩阵A的特征值,P是由特征向量组成的矩阵。

2. 特征值的和等于矩阵的迹(trace),特征值的乘积等于矩阵的行列式的值。

3. 特征向量线性无关,可以构成矩阵的一组基。

这些性质为矩阵的分析和计算提供了便利。

四、特征值与特征向量的应用特征值和特征向量在实际问题中具有广泛的应用。

以下是几个经典的应用示例:1. 特征值分解:利用特征值和特征向量的分析,可以将矩阵分解为对角矩阵的形式,简化计算和求解问题。

2. 主成分分析(PCA):主成分分析是一种常用的数据降维方法,通过求解协方差矩阵的特征值和特征向量,将原始数据转换为一组线性无关的主成分。

特征值和特征向量物理意义一.特征值就是那个矩阵所对应的一元多次方程组的根特征值表示一个矩阵的向量被拉伸或压缩的程度,例如特征值为1111111111,则表示经过变换以后,向量没有被拉伸,在物理上表示做刚体运动,相当与整体框架做了变动,但内部结构没有变化.量子力学中,矩阵代表力学量,矩阵的特征向量代表定态波函数,矩阵的特征植代表力学量的某个可能的观测值。

一个向量(或函数)被矩阵相乘,表示对这个向量做了一个线性变换。

如果变换后还是这个向量本身乘以一个常数,这个常数就叫特征值。

这是特征值的数学涵义;至于特征值的物理涵义,根据具体情况有不同的解释。

比如动力学中的频率,稳定分析中的极限荷载,甚至应力分析中的主应力矩阵的特征值要想说清楚还要从线性变换入手,把一个矩阵当作一个线性变换在某一组基下的矩阵,最简单的线性变换就是数乘变换,求特征值的目的就是看看一个线性变换对一些非零向量的作用是否能够相当于一个数乘变换,特征值就是这个数乘变换的变换比,这样的一些非零向量就是特征向量,其实我们更关心的是特征向量,希望能把原先的线性空间分解成一些和特征向量相关的子空间的直和,这样我们的研究就可以分别限定在这些子空间上来进行,这和物理中在研究运动的时候将运动分解成水平方向和垂直方向的做法是一个道理!二.特征向量-定义数学上,线性变换的特征向量(本征向量)是一个非退化的向量,其方向在该变换下不变。

该向量在此变换下缩放的比例称为其特征值(本征值)。

图1给出了一幅图像的例子。

一个变换通常可以由其特征值和特征向量完全描述。

特征空间是相同特征值的特征向量的集合。

这些概念在纯数学和应用数学的很多领域发挥着巨大的作用—在线性代数,泛函分析,甚至在一些非线性的情况中也有着显著的重要性。

空间上的变换—如平移(移动原点),旋转,反射,拉伸,压缩,或者这些变换的组合;以及其它变换—可以通过它们在向量上的作用来显示。

向量可以用从一点指向另一点的箭头来表示。

浅谈矩阵的特征向量特征值的意义描述了矩阵的特征向量和特征值的定义,简述了矩阵的特征向量特征值在数学、物理、信息和哲学上的一些意义,对于从多角度深入理解矩阵的特征向量特征值有积极意义。

标签:线性代数;矩阵;特征向量;特征值1 线性变换与矩阵的特征向量特征值[1]线性变换是指一个n维列向量被左乘一个n阶矩阵后得到另一个n维列向量,它是同维向量空间中的把一个向量线性映射成了另一个向量。

即Y=AX (Y,X∈Rn A=(aij)A=(aij)n×n)如果对于数λ,存在一个n维零列向量X(即X∈Rn且X≠0),使得AX=?姿X则称数λ为矩阵A的一个特征值,X为矩阵A对应于λ的特征向量。

在线性代数中研究线性变换就是研究相应的矩阵A,矩阵A的特征向量和特征值是线性变换研究的重要内容。

2 在数学上的意义矩阵乘法对应了一个变换,是把任意一个向量变成另一个方向或长度都大多不同的新向量。

在这个变换的过程中,原向量主要发生旋转、伸缩的变化。

如果矩阵对某一个向量或某些向量只发生伸缩变换,不对这些向量产生旋转的效果,那么这些向量就称为这个矩阵的特征向量,伸缩的比例就是特征值。

这里可以将特征值为负,特征向量旋转180度,也可看成方向不变,伸缩比为负值。

所以特征向量也叫线性不变量。

特征向量的不变性是他们变成了与其自身共线的向量,他们所在的直线在线性变换下保持不变;特征向量和他的变换后的向量们在同一根直线上,变换后的向量们或伸长或缩短,或反向伸长或反向缩短,甚至变成零向量(特征值为零时)[2]。

对对称矩阵而言,可以求得的特征向量是正交的,就是把矩阵A所代表的空间,进行正交分解,使得A的向量集合可以表示为每个向量a在各个特征向量上面的投影长度。

例如,对于x,y平面上的一个点(x,y),我对它作线性变换A,这个线性变换相当于关于横轴x做镜像。

我们可以求出矩阵A的特征向量有两个[1,0]和[0,1],也就是x轴和y 轴。

什么意思呢?在x轴上的投影,经过这个线性变换,没有改变。

矩阵的特征值要想说清楚还要从线性变换入手,把一个矩阵当作一个线性变换在某一组基下的矩阵,最简单的线性变换就是数乘变换,求特征值的目的就是看看一个线性变换对一些非零向量的作用是否能够相当于一个数乘变换,特征值就是这个数乘变换的变换比,这样的一些非零向量就是特征向量,其实我们更关心的是特征向量,希望能把原先的线性空间分解成一些和特征向量相关的子空间的直和,这样我们的研究就可以分别限定在这些子空间上来进行,这和物理中在研究运动的时候将运动分解成水平方向和垂直方向的做法是一个道理!长时间以来一直不了解矩阵的特征值和特征向量到底有何意义(估计很多兄弟有同样感受)。

知道它的数学公式,但却找不出它的几何含义,教科书里没有真正地把这一概念从各种角度实例化地进行讲解,只是一天到晚地列公式玩理论——有个屁用啊。

根据特征向量数学公式定义,矩阵乘以一个向量的结果仍是同维数的一个向量,因此,矩阵乘法对应了一个变换,把一个向量变成同维数的另一个向量,那么变换的效果是什么呢?这当然与方阵的构造有密切关系,比如可以取适当的二维方阵,使得这个变换的效果就是将平面上的二维向量逆时针旋转30度,这时我们可以问一个问题,有没有向量在这个变换下不改变方向呢?可以想一下,除了零向量,没有其他向量可以在平面上旋转30度而不改变方向的,所以这个变换对应的矩阵(或者说这个变换自身)没有特征向量(注意:特征向量不能是零向量),所以一个变换的特征向量是这样一种向量,它经过这种特定的变换后保持方向不变,只是进行长度上的伸缩而已(再想想特征向量的原始定义Ax=cx, cx是方阵A对向量x 进行变换后的结果,但显然cx和x的方向相同)。

这里给出一个特征向量的简单例子,比如平面上的一个变换,把一个向量关于横轴做镜像对称变换,即保持一个向量的横坐标不变,但纵坐标取相反数,把这个变换表示为矩阵就是[1 0;0 -1](分号表示换行),显然[1 0;0 -1]*[a b]'=[a -b]'(上标'表示取转置),这正是我们想要的效果,那么现在可以猜一下了,这个矩阵的特征向量是什么?想想什么向量在这个变换下保持方向不变,显然,横轴上的向量在这个变换下保持方向不变(记住这个变换是镜像对称变换,那镜子表面上(横轴上)的向量当然不会变化),所以可以直接猜测其特征向量是[a 0]'(a不为0),还有其他的吗?有,那就是纵轴上的向量,这时经过变换后,其方向反向,但仍在同一条轴上,所以也被认为是方向没有变化,所以[0 b]'(b不为0)也是其特征向量。

特征值特征向量几何意义

特征值和特征向量是线性代数中非常重要的概念,在很多领域都有广泛的应用。

而它们的几何意义也非常重要,这有助于我们更好地理解它们的含义和应用。

特征向量是指在线性变换下方向不变的向量,特征值则是该向量在变换后的倍数。

可以将特征向量看作是线性变换后仍然指向同一个方向的向量,而特征值则表示该方向被变换了多少倍。

特征向量和特征值在几何上的理解可以通过矩阵变换来进行。

矩阵变换可以表示为将一个向量沿着特定方向拉伸或收缩,并将其旋转到新的方向。

这个变换的结果可以用矩阵乘法来表示。

当我们对一个向量进行线性变换时,如果这个向量的方向不变,那么它就是一个特征向量。

特征值则是描述这个变换在特定方向上的缩放因子。

特征向量和特征值在图像处理、信号处理、量子力学等领域都有广泛的应用。

在图像处理中,特征向量和特征值可以用于图像的降维和特征提取等方面;在信号处理中,它们可以用于信号的分析和滤波等方面;在量子力学中,它们可以用于描述量子态的演化和测量等方面。

总之,特征值和特征向量是非常重要的概念,在线性代数和其他领域中都有广泛的应用。

了解它们的几何意义可以帮助我们更好地理解它们的含义和应用。

- 1 -。

浅谈矩阵的特征向量特征值的意义

描述了矩阵的特征向量和特征值的定义,简述了矩阵的特征向量特征值在数学、物理、信息和哲学上的一些意义,对于从多角度深入理解矩阵的特征向量特征值有积极意义。

标签:线性代数;矩阵;特征向量;特征值

1 线性变换与矩阵的特征向量特征值[1]

线性变换是指一个n维列向量被左乘一个n阶矩阵后得到另一个n维列向量,它是同维向量空间中的把一个向量线性映射成了另一个向量。

即

Y=AX (Y,X∈Rn A=(aij)A=(aij)n×n)

如果对于数λ,存在一个n维零列向量X(即X∈Rn且X≠0),使得

AX=?姿X

则称数λ为矩阵A的一个特征值,X为矩阵A对应于λ的特征向量。

在线性代数中研究线性变换就是研究相应的矩阵A,矩阵A的特征向量和特征值是线性变换研究的重要内容。

2 在数学上的意义

矩阵乘法对应了一个变换,是把任意一个向量变成另一个方向或长度都大多不同的新向量。

在这个变换的过程中,原向量主要发生旋转、伸缩的变化。

如果矩阵对某一个向量或某些向量只发生伸缩变换,不对这些向量产生旋转的效果,那么这些向量就称为这个矩阵的特征向量,伸缩的比例就是特征值。

这里可以将特征值为负,特征向量旋转180度,也可看成方向不变,伸缩比为负值。

所以特征向量也叫线性不变量。

特征向量的不变性是他们变成了与其自身共线的向量,他们所在的直线在线性变换下保持不变;特征向量和他的变换后的向量们在同一根直线上,变换后的向量们或伸长或缩短,或反向伸长或反向缩短,甚至变成零向量(特征值为零时)[2]。

对对称矩阵而言,可以求得的特征向量是正交的,就是把矩阵A所代表的空间,进行正交分解,使得A的向量集合可以表示为每个向量a在各个特征向量上面的投影长度。

例如,对于x,y平面上的一个点(x,y),我对它作线性变换A,

这个线性变换相当于关于横轴x做镜像。

我们可以求出矩阵A的特征向量

有两个[1,0]和[0,1],也就是x轴和y 轴。

什么意思呢?在x轴上的投影,经过这个线性变换,没有改变。

在y轴上的投影,乘以了幅度系数-1,并没有发生旋转。

两个特征向量说明了这个线性变换矩阵对于x轴和y轴这两个正交基是线性不变的。

对于其他的线性变换矩阵,我们也可以找到类似的,N个对称轴,变换后的结果,关于这N个对称轴线性不变。

这N个对称轴就是线性变换A的N个特征向量。

谱定律告诉我们一个线性变换可表示为它的所有的特征向量的一个线性组合,其中的线性系数就是每一个向量对应的特征值。

矩阵的特征向量特征值可以研究傅立叶变换对应的频率谱、求概率分布的功率谱密度、统计上的主成分分析,微分方程的特征函数等。

3 在物理上的意义

一个物理系统,其特性可以被一个矩阵所描述,那么这个系统的物理特性就可以被这个矩阵的特征值所决定,这个矩阵能形成“频率的谱”,就是因为矩阵在特征向量所指的方向上具有对向量产生恒定的变换作用:增强(或减弱)特征向量的作用。

进一步的,如果矩阵持续地叠代作用于向量,那么特征向量的就会凸现出来。

各种不同的信号(向量)进入这个系统中后,系统输出的信号(向量)就会发生相位滞后、放大、缩小等各种纷乱的变化。

但只有特征信号(特征向量)被稳定的发生放大(或缩小)的变化。

如果把系统的输出端口接入输入端口,那么只有特征信号(特征向量)第二次被放大(或缩小)了,其他的信号如滞后的可能滞后也可能超前。

例如一个驻波通过一条绳子,绳子上面的每个点组成一个无穷维的向量,这个向量的特征向量就是特征函数sin(t),因为是时变的,就成了特征函数。

每个点特征值就是每个点在特定时刻的sin(x+t)取值。

再如,从太空中某个角度看地球自转,虽然每个景物的坐标在不断的变换,但是这种变换关于地球的自传轴有对称性,也就是关于此轴的平移和拉伸的坐标变换不敏感。

所以地球自转轴,是地球自转这种空间变换的一个特征向量。

矩阵的特征向量特征值在材料、力学、电学等方面也有重要的应用。

4 信息处理上的意义

由于这些投影的大小代表了A在特征空间各个分量的投影,那么我们可以使用最小2乘法,求出投影能量最大的那些分量,而把剩下的分量去掉,这样最大限度地保存了矩阵代表的信息,同时可以大大降低矩阵需要存储的维度,简称PCA方法。

[3]

线性变换PCA可以用来处理图像。

如2维的人像识别:我们把图像A看成矩阵,进一步看成线性变换矩阵,把这个训练图像的特征矩阵求出来(假设取了n个能量最大的特征向量)。

用A乘以这个n个特征向量,得到一个n维矢量a,也就是A在特征空间的投影。

今后在识别的时候同一类的图像(例如,来自同一个人的面部照片),认为是A的线性相关图像,它乘以这个特征向量,得到n

个数字组成的一个矢量b,也就是B在特征空间的投影。

那么a和b之间的距离就是我们判断B是不是A的准则。

又如Google公司的PageRank,也是通过计算一个用矩阵表示的图。

这个图代表了整个Web各个网页“节点”之间的关联。

用特征向量来对每一个节点打“特征值”分

5 哲学上的意义

矩阵的特征向量特征值是把向量和矩阵作为一个整体,从部分的性质出发,推到出整体的性质,再由整体的性质得到各种应用和物理上的概念。

如何知道一个矩阵的局部其实对应于另一个矩阵上不同位置的局部呢?这仍然只是一个主观的先验的直觉主义的判定!计算机不过是纸和笔的变形,它不能理解意义——即使1+1=2这样的运算结果,它本身也不能判定对錯。

如果它咨询别的计算机来判断对错呢——别的计算机又如何能自我证明对错?根本不能,必须等到一个主体的“人”来观察这个结果,这个结果才会变得有意义。

形而上学的理论,也没有超出经验主义的牢笼。

[4]

参考文献

[1]王萼芳,石生明.高等代数(第3版). 北京:高等教育出版社,2003.

[2]尤承业.解析几何[M].北京:北京大学出版社,2004.

[3]闫常浩,丁先锋,韦鑫余.人脸识别算法[J].四川兵工学报,2011,04.

[4]Stewart Shapiro.数学哲学[M].上海:复旦大学出版社,2009.。