信息论和编码理论基础第四章

- 格式:ppt

- 大小:343.00 KB

- 文档页数:15

信息论与编码理论习题答案LG GROUP system office room 【LGA16H-LGYY-LGUA8Q8-LGA162】第二章 信息量和熵八元编码系统,码长为3,第一个符号用于同步,每秒1000个码字,求它的信息速率。

解:同步信息均相同,不含信息,因此 每个码字的信息量为 2⨯8log =2⨯3=6 bit因此,信息速率为 6⨯1000=6000 bit/s掷一对无偏骰子,告诉你得到的总的点数为:(a) 7; (b) 12。

问各得到多少信息量。

解:(1) 可能的组合为 {1,6},{2,5},{3,4},{4,3},{5,2},{6,1})(a p =366=61得到的信息量 =)(1loga p =6log = bit (2) 可能的唯一,为 {6,6})(b p =361得到的信息量=)(1logb p =36log = bit 经过充分洗牌后的一副扑克(52张),问:(a) 任何一种特定的排列所给出的信息量是多少?(b) 若从中抽取13张牌,所给出的点数都不相同时得到多少信息量?解:(a) )(a p =!521信息量=)(1loga p =!52log = bit (b) ⎩⎨⎧⋯⋯⋯⋯花色任选种点数任意排列13413!13)(b p =1352134!13A ⨯=1352134C 信息量=1313524log log -C = bit 随机掷3颗骰子,X 表示第一颗骰子的结果,Y 表示第一和第二颗骰子的点数之和,Z 表示3颗骰子的点数之和,试求)|(Y Z H 、)|(Y X H 、),|(Y X Z H 、)|,(Y Z X H 、)|(X Z H 。

解:令第一第二第三颗骰子的结果分别为321,,x x x ,1x ,2x ,3x 相互独立,则1x X =,21x x Y +=,321x x x Z ++=)|(Y Z H =)(3x H =log 6= bit )|(X Z H =)(32x x H +=)(Y H=2⨯(361log 36+362log 18+363log 12+364log 9+365log 536)+366log 6= bit )|(Y X H =)(X H -);(Y X I =)(X H -[)(Y H -)|(X Y H ]而)|(X Y H =)(X H ,所以)|(Y X H = 2)(X H -)(Y H = bit或)|(Y X H =)(XY H -)(Y H =)(X H +)|(X Y H -)(Y H 而)|(X Y H =)(X H ,所以)|(Y X H =2)(X H -)(Y H = bit),|(Y X Z H =)|(Y Z H =)(X H = bit )|,(Y Z X H =)|(Y X H +)|(XY Z H =+= bit设一个系统传送10个数字,0,1,…,9。

信息论与编码第三版答案《信息论与编码》是一本非常经典的书籍,已经成为了信息科学领域中的经典教材。

本书的第三版已经出版,相比于前两版,第三版的变化不小,主要是增加了一些新内容,同时也对一些旧内容做了修改和完善。

作为一本教材,上面的题目和习题都是非常重要的,它们可以帮助读者更好地理解书中的相关概念和知识点,同时也可以帮助读者更好地掌握理论和技术。

因此,本文将介绍《信息论与编码》第三版中部分习题的答案,方便读者快速查阅和学习。

第一章:信息量和熵1.1 习题1.1Q:两个随机变量的独立性和无关性有什么区别?A:独立性和无关性是两个不同的概念。

两个随机变量是独立的,当且仅当它们的联合概率分布等于乘积形式的边缘概率分布。

两个随机变量是无关的,当且仅当它们的协方差等于0。

1.2 习题1.7Q:什么样的随机变量的熵等于0?A:当随机变量的概率分布是确定的(即只有一个概率为1,其余全为0),其熵等于0。

第二章:数据压缩2.5 习题2.9Q:为什么霍夫曼编码比熵编码更加高效?A:霍夫曼编码能够更好地利用信源的统计特征,将出现频率高的符号用较短的二进制编码表示,出现频率低的符号用较长的二进制编码表示。

这样一来,在编码过程中出现频率高的符号会占用较少的比特数,从而能够更加高效地表示信息。

而熵编码则是针对每个符号分别进行编码,没有考虑符号之间的相关性,因此相比于霍夫曼编码更加低效。

第四章:信道编码4.2 习题4.5Q:在线性块码中,什么是生成矩阵?A:在线性块码中,生成矩阵是一个包含所有二元线性组合系数的矩阵。

它可以用来生成码字,即任意输入信息序列可以通过生成矩阵与编码器进行矩阵乘法得到相应的编码输出序列。

4.3 习题4.12Q:简述CRC校验的原理。

A:CRC校验是一种基于循环冗余校验的方法,用于检测在数字通信中的数据传输错误。

其基本思想是将发送数据看作多项式系数,通过对这个多项式进行除法运算,得到余数,将余数添加到数据尾部,发送给接收方。

信息论与编码第二版答案第一章:信息论基础1.问题:信息论的基本概念是什么?答案:信息论是一种数学理论,研究的是信息的表示、传输和处理。

它的基本概念包括:信息、信息的熵和信息的编码。

2.问题:什么是信息熵?答案:信息熵是信息的度量单位,表示信息的不确定度。

它的计算公式为H(X) = -ΣP(x) * log2(P(x)),其中P(x)表示事件x发生的概率。

3.问题:信息熵有什么特性?答案:信息熵具有以下特性:•信息熵的值越大,表示信息的不确定度越高;•信息熵的值越小,表示信息的不确定度越低;•信息熵的最小值为0,表示信息是确定的。

4.问题:信息熵与概率分布有什么关系?答案:信息熵与概率分布之间存在着直接的关系。

当概率分布均匀时,信息熵达到最大值;而当概率分布不均匀时,信息熵会减小。

第二章:数据压缩1.问题:数据压缩的目的是什么?答案:数据压缩的目的是通过消除冗余和重复信息,使数据占用更少的存储空间或传输更快。

2.问题:数据压缩的两种基本方法是什么?答案:数据压缩可以通过无损压缩和有损压缩两种方法来实现。

无损压缩是指压缩后的数据可以完全还原为原始数据;而有损压缩则是指压缩后的数据不完全还原为原始数据。

3.问题:信息压缩的度量单位是什么?答案:信息压缩的度量单位是比特(bit),表示信息的数量。

4.问题:哪些方法可以用于数据压缩?答案:数据压缩可以通过以下方法来实现:•无结构压缩方法:如霍夫曼编码、算术编码等;•有结构压缩方法:如词典编码、RLE编码等;•字典方法:如LZW、LZ77等。

第三章:信道容量1.问题:什么是信道容量?答案:信道容量是指在给定信噪比的条件下,信道传输的最大数据速率。

2.问题:信道容量的计算公式是什么?答案:信道容量的计算公式为C = W * log2(1 + S/N),其中C表示信道容量,W表示信道带宽,S表示信号的平均功率,N表示噪声的平均功率。

3.问题:信道容量与信噪比有什么关系?答案:信道容量与信噪比成正比,信噪比越高,信道容量越大;反之,信噪比越低,信道容量越小。

4.5若将N 个相同的BSC 级联如题图4.5所示,各信道的转移概率矩阵为⎥⎦⎤⎢⎣⎡--p p p p 11。

令Q t =P{X t =0},t=0,1,…,N,且Q 0为已知。

题图 4.5(a)求Q t 的表达式。

(b)证明N →∞时有Q N →1/2,且与Q 0取值无关,从而证明N →∞级联信道的信道容量C N →0,P>0。

解:(a)对于满足X N 为马氏链的串联信道,他们总的信道转移概率矩阵为各个串联信道矩阵的乘积,即P(X N |X 0)= P(X 1|X 0) P(X 2|X 1)……P(X N |X N-1)由已知得,但各信道的转移概率矩阵为⎥⎦⎤⎢⎣⎡--p p p p 11 则两个信道级联的转移概率矩阵为: P 2=⎥⎦⎤⎢⎣⎡--p p p p 11⎥⎦⎤⎢⎣⎡--p p p p 11=()()()()⎥⎦⎤⎢⎣⎡-+---+2222112p 12p 1p p p p p p 三个信道级联的转移概率矩阵为: P 3=()()()()⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡-+----+33331221211221211221211-2p 2121p p p 四个信道级联的转移概率矩阵为: P 4=()()()()⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡-+----+44441221211221211221211-2p 2121p p p 以此类推:可得N 个信道级联的转移概率矩阵为:P N =()()()()⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡-+----+N N N N p p p 1221211221211221211-2p 2121 则Q t =P{X t =0}=()()()()()000121221211122121122121Q p p Q p Q p t t t t -+--=-⎥⎦⎤⎢⎣⎡--+⎥⎦⎤⎢⎣⎡-+即Q t 的表达式为:Q t =()()012122121Q p p t t -+-- t=0,1,……,N (b) 由(a)可得到:Q N =()()012122121Q p p t t -+-- 由0<p<1,则0<2p<2,-1<2p-1<1,即|2p-1|<1 则21lim =∞→N N Q ,与Q 0取值无关。

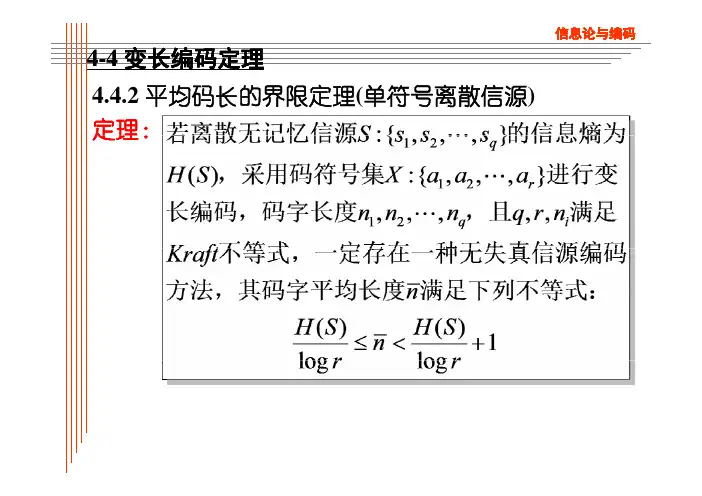

第4章无失真信源编码习题及其参考答案4-1 有一信源,它有六个可能的输出,其概率分布如下表所示,表中给出了对应的码A、B、C、D、E和F(1)求这些码中哪些是唯一可译码;(2)求哪些码是及时码;(3)对所有唯一可译码求出其平均码长l。

4-2 设信源61261126()1()()()()iis s sXp sp s p s p sP X=⎡⎤⎡⎤==⎢⎥⎢⎥⎣⎦⎣⎦∑。

对此次能源进行m元唯一可译编码,其对应的码长为(l1,l2,…,l6)=(1,1,2,3,2,3),求m值的最好下限。

(提示:用kraft不等式)4-3设信源为1234567811111111()248163264128128s s s s s s s sXp X⎡⎤⎡⎤⎢⎥=⎢⎥⎢⎥⎣⎦⎢⎥⎣⎦,编成这样的码:(000,001,010,011,100,101,110,111)。

求(1)信源的符号熵;(2)这种码的编码效率;(3)相应的仙农码和费诺码。

4-4求概率分布为11122(,,,,)3551515信源的二元霍夫曼编码。

讨论此码对于概率分布为11111(,,,,)55555的信源也是最佳二元码。

4-5有两个信源X和Y如下:121234567()0.200.190.180.170.150.100.01X s s s s s s s p X ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦123456789()0.490.140.140.070.070.040.020.020.01Y s s s s s s s s s p Y ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦(1)用二元霍夫曼编码、仙农编码以及费诺编码对信源X 和Y 进行编码,并计算其平均码长和编码效率;(2)从X ,Y 两种不同信源来比较三种编码方法的优缺点。

4-6设二元霍夫曼码为(00,01,10,11)和(0,10,110,111),求出可以编得这样 霍夫曼码的信源的所有概率分布。

4-7设信源为12345678()0.40.20.10.10.050.050.050.05X s s s s s s s s p X ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦,求其三元霍夫曼编码。