算法详解及应用

- 格式:ppt

- 大小:5.24 MB

- 文档页数:69

动态规划算法难点详解及应用技巧介绍动态规划算法(Dynamic Programming)是一种常用的算法思想,主要用于解决具有重叠子问题和最优子结构性质的问题。

在解决一些复杂的问题时,动态规划算法可以将问题分解成若干个子问题,并通过求解子问题的最优解来求解原始问题的最优解。

本文将详细介绍动态规划算法的难点以及应用技巧。

一、动态规划算法的难点1. 难点一:状态的定义在动态规划算法中,首先需要明确问题的状态。

状态是指问题在某一阶段的具体表现形式。

在进行状态定义时,需要考虑到问题的最优子结构性质。

状态的定义直接影响到问题的子问题划分和状态转移方程的建立。

2. 难点二:状态转移方程的建立动态规划算法是基于状态转移的思想,即通过求解子问题的最优解来求解原始问题的最优解。

因此,建立合理的状态转移方程是动态规划算法的关键。

在进行状态转移方程的建立时,需要考虑问题的最优子结构性质和状态之间的关系。

3. 难点三:边界条件的处理在动态规划算法中,边界条件是指问题的最简单情况,用于终止递归过程并给出递归基。

边界条件的处理需要考虑问题的具体要求和实际情况,确保问题能够得到正确的解。

二、动态规划算法的应用技巧1. 应用技巧一:最长递增子序列最长递增子序列是一类经典的动态规划问题。

其求解思路是通过定义状态和建立状态转移方程,找到问题的最优解。

在应用最长递增子序列问题时,可以使用一维数组来存储状态和记录中间结果,通过迭代计算来求解最优解。

2. 应用技巧二:背包问题背包问题是另一类常见的动态规划问题。

其求解思路是通过定义状态和建立状态转移方程,将问题转化为子问题的最优解。

在应用背包问题时,可以使用二维数组来存储状态和记录中间结果,通过迭代计算来求解最优解。

3. 应用技巧三:最短路径问题最短路径问题是动态规划算法的经典应用之一。

其求解思路是通过定义状态和建立状态转移方程,利用动态规划的思想来求解最优解。

在应用最短路径问题时,可以使用二维数组来存储状态和记录中间结果,通过迭代计算来求解最优解。

前缀和算法详解及应用1.前缀和的定义和计算方法前缀和的定义是指数组中从第一个元素开始到当前位置的所有元素的和。

用数学表达式表示为:prefix_sum[i] = sum(arr[0] + arr[1] + ... + arr[i])。

前缀和的计算方法是通过遍历数组,将当前元素与前一个元素的前缀和相加,得到当前位置的前缀和。

换句话说,prefix_sum[i] =prefix_sum[i - 1] + arr[i]。

通过这种计算方法,可以在O(n)的时间复杂度内得到整个数组的前缀和。

2.前缀和的性质和应用- prefix_sum[0] = 0,即前缀和数组的第一个元素为0。

- 如果要求解数组arr[i]到arr[j]的区间和,可以通过计算prefix_sum[j] - prefix_sum[i - 1]获得。

-子数组和的问题:通过计算前缀和数组,可以在O(1)的时间复杂度内求解数组中任意区间的和,例如最大子数组和、区间和等问题。

-寻找满足特定条件的子数组:通过计算前缀和数组,可以在O(n)的时间复杂度内找到满足其中一特定条件的子数组,例如和为k的子数组、最长连续和为0的子数组等。

3.前缀和算法的具体实现- 构建前缀和数组:首先创建一个长度为n+1的前缀和数组prefix_sum,将第一个元素设为0。

- 计算前缀和:通过遍历数组arr,将当前元素与前一个元素的前缀和相加,得到当前位置的前缀和,并将其存入prefix_sum数组中。

以下是使用前缀和算法求解最大子数组和的Python代码示例:```def max_subarray_sum(arr):n = len(arr)prefix_sum = [0] * (n + 1)for i in range(1, n + 1):prefix_sum[i] = prefix_sum[i - 1] + arr[i - 1]max_sum = float('-inf')for i in range(1, n + 1):for j in range(i, n + 1):curr_sum = prefix_sum[j] - prefix_sum[i - 1]max_sum = max(max_sum, curr_sum)return max_sum```通过使用前缀和算法,可以将最大子数组和问题的时间复杂度从O(n^2)降低到O(n),提升算法的运行效率。

弱监督学习算法详解及应用技巧在机器学习领域,监督学习是一种常见的学习方法,它通过已知的标签来训练模型。

但是在实际应用中,很多数据并没有完整的标签信息,这就需要使用一种更加灵活的学习算法来处理这种情况。

弱监督学习算法就是这样一种算法,它不需要完整的标签信息,而是能够利用部分标签或者弱标签来进行学习。

本文将对弱监督学习算法进行详细的介绍,并探讨其应用技巧。

一、弱监督学习算法简介弱监督学习算法是一种能够利用不完整标签信息进行学习的算法。

在传统的监督学习中,训练数据通常包括输入特征和对应的标签,模型通过学习这些标签来进行预测。

而在弱监督学习中,标签信息可能是不完整的,只有部分标签信息或者弱标签信息。

这就需要算法能够从这些不完整的标签信息中学习到有效的知识。

常见的弱监督学习算法包括多示例学习(MIL)、半监督学习、迁移学习等。

这些算法都能够有效地利用不完整标签信息进行学习,并在实际应用中取得了很好的效果。

二、弱监督学习算法原理弱监督学习算法的原理主要是通过利用不完整的标签信息来进行模型训练。

在多示例学习中,训练数据被分为多个示例,每个示例可能包含多个样本,但只有一个标签。

模型需要通过学习这些示例来进行预测。

在半监督学习中,只有部分数据有标签信息,而其他数据则没有标签信息,模型需要通过利用有标签数据来进行学习,并将学到的知识应用到无标签数据上。

在迁移学习中,模型需要利用从一个领域学到的知识来进行另一个领域的学习。

这些算法都能够有效地利用不完整标签信息来进行学习,并取得良好的效果。

三、弱监督学习算法应用技巧1. 数据增强在应用弱监督学习算法时,数据增强是一种常用的技巧。

通过对训练数据进行扩充,可以增加数据的多样性,提高模型的泛化能力。

数据增强的方法包括图像旋转、翻转、缩放等操作,能够有效地提高模型的性能。

2. 标签传播在半监督学习中,标签传播是一种常用的技巧。

通过利用有标签数据和无标签数据之间的相似性来进行标签传播,可以有效地利用不完整标签信息进行学习。

动态规划算法详解及经典例题⼀、基本概念(1)⼀种使⽤多阶段决策过程最优的通⽤⽅法。

(2)动态规划过程是:每次决策依赖于当前状态,⼜随即引起状态的转移。

⼀个决策序列就是在变化的状态中产⽣出来的,所以,这种多阶段最优化决策解决问题的过程就称为动态规划。

假设问题是由交叠的⼦问题所构成,我们就能够⽤动态规划技术来解决它。

⼀般来说,这种⼦问题出⾃对给定问题求解的递推关系中,这个递推关系包括了同样问题的更⼩⼦问题的解。

动态规划法建议,与其对交叠⼦问题⼀次重新的求解,不如把每⼀个较⼩⼦问题仅仅求解⼀次并把结果记录在表中(动态规划也是空间换时间的)。

这样就能够从表中得到原始问题的解。

(3)动态规划经常常使⽤于解决最优化问题,这些问题多表现为多阶段决策。

关于多阶段决策:在实际中,⼈们经常遇到这样⼀类决策问题,即因为过程的特殊性,能够将决策的全过程根据时间或空间划分若⼲个联系的阶段。

⽽在各阶段中。

⼈们都须要作出⽅案的选择。

我们称之为决策。

⽽且当⼀个阶段的决策之后,经常影响到下⼀个阶段的决策,从⽽影响整个过程的活动。

这样,各个阶段所确定的决策就构成⼀个决策序列,常称之为策略。

因为各个阶段可供选择的决策往往不⽌⼀个。

因⽽就可能有很多决策以供选择,这些可供选择的策略构成⼀个集合,我们称之为同意策略集合(简称策略集合)。

每⼀个策略都对应地确定⼀种活动的效果。

我们假定这个效果能够⽤数量来衡量。

因为不同的策略经常导致不同的效果,因此,怎样在同意策略集合中选择⼀个策略,使其在预定的标准下达到最好的效果。

经常是⼈们所关⼼的问题。

我们称这种策略为最优策略,这类问题就称为多阶段决策问题。

(4)多阶段决策问题举例:机器负荷分配问题某种机器能够在⾼低两种不同的负荷下进⾏⽣产。

在⾼负荷下⽣产时。

产品的年产量g和投⼊⽣产的机器数量x的关系为g=g(x),这时的年完善率为a,即假设年初完善机器数为x,到年终时完善的机器数为a*x(0<a<1);在低负荷下⽣产时,产品的年产量h和投⼊⽣产的机器数量y 的关系为h=h(y)。

SIFT算法详解及应用SIFT(Scale-Invariant Feature Transform)是一种图像处理算法,它能够在不同尺度、旋转、光照条件下进行特征点匹配。

SIFT算法是计算机视觉领域的一个重要算法,广泛应用于目标识别、图像拼接、图像检索等方面。

首先,尺度空间极值检测是指在不同尺度上检测图像中的极值点,即图像中的局部最大值或最小值。

这样可以使特征点能够对应不同尺度的目标,使算法对尺度变化有鲁棒性。

为了实现这一步骤,SIFT算法使用了高斯差分金字塔来检测尺度空间中的极值点。

接下来是关键点定位,即确定在尺度空间极值点的位置以及对应的尺度。

SIFT算法通过比较每个极值点与其周围点的响应值大小来判断其是否为关键点。

同时,为了提高关键点的稳定性和准确性,算法还会对关键点位置进行亚像素精确化。

然后是关键点方向的确定,即为每个关键点分配一个主方向。

SIFT算法使用图像梯度方向的直方图来确定关键点的方向。

这样可以使得特征描述子具有旋转不变性,使算法在目标旋转的情况下仍能进行匹配。

最后是关键点的描述。

SIFT算法使用局部图像的梯度信息来描述关键点,即构建关键点的特征向量。

特征向量的构建过程主要包括将关键点周围的图像划分为若干个子区域,计算每个子区域的梯度直方图,并将所有子区域的直方图拼接成一个特征向量。

这样可以使得特征向量具有局部不变性和对光照变化的鲁棒性。

SIFT算法的应用非常广泛。

首先,在目标识别领域,SIFT算法能够检测和匹配图像中的关键点,从而实现目标的识别和定位。

其次,在图像拼接方面,SIFT算法能够提取图像中的特征点,并通过匹配这些特征点来完成图像的拼接。

此外,SIFT算法还可以应用于图像检索、三维重建、行人检测等领域。

总结起来,SIFT算法是一种具有尺度不变性和旋转不变性的图像处理算法。

它通过提取图像中的关键点,并构建关键点的描述子,实现了对不同尺度、旋转、光照条件下的目标识别和图像匹配。

机器学习10⼤经典算法详解本⽂为⼤家分享了机器学习10⼤经典算法,供⼤家参考,具体内容如下1、C4.5C4.5算法是机器学习算法中的⼀种分类决策树算法,其核⼼算法是ID3算法. C4.5算法继承了ID3算法的优点,并在以下⼏⽅⾯对ID3算法进⾏了改进:1)⽤信息增益率来选择属性,克服了⽤信息增益选择属性时偏向选择取值多的属性的不⾜;2)在树构造过程中进⾏剪枝;3)能够完成对连续属性的离散化处理;4)能够对不完整数据进⾏处理。

C4.5算法有如下优点:产⽣的分类规则易于理解,准确率较⾼。

其缺点是:在构造树的过程中,需要对数据集进⾏多次的顺序扫描和排序,因⽽导致算法的低效。

2、The k-means algorithm即K-Means算法k-means algorithm算法是⼀个聚类算法,把n的对象根据他们的属性分为k个分割,k < n。

它与处理混合正态分布的最⼤期望算法很相似,因为他们都试图找到数据中⾃然聚类的中⼼。

它假设对象属性来⾃于空间向量,并且⽬标是使各个群组内部的均⽅误差总和最⼩。

3、Support vector machines⽀持向量机⽀持向量机(Support Vector Machine),简称SV机(论⽂中⼀般简称SVM)。

它是⼀种监督式学习的⽅法,它⼴泛的应⽤于统计分类以及回归分析中。

⽀持向量机将向量映射到⼀个更⾼维的空间⾥,在这个空间⾥建⽴有⼀个最⼤间隔超平⾯。

在分开数据的超平⾯的两边建有两个互相平⾏的超平⾯。

分隔超平⾯使两个平⾏超平⾯的距离最⼤化。

假定平⾏超平⾯间的距离或差距越⼤,分类器的总误差越⼩。

⼀个极好的指南是C.J.C Burges的《模式识别⽀持向量机指南》。

van der Walt和Barnard 将⽀持向量机和其他分类器进⾏了⽐较。

4、The Apriori algorithmApriori算法是⼀种最有影响的挖掘布尔关联规则频繁项集的算法。

其核⼼是基于两阶段频集思想的递推算法。

计算机算法设计五⼤常⽤算法的分析及实例摘要算法(Algorithm)是指解题⽅案的准确⽽完整的描述,是⼀系列解决问题的清晰指令,算法代表着⽤系统的⽅法描述解决问题的策略机制。

也就是说,能够对⼀定规范的输⼊,在有限时间内获得所要求的输出。

如果⼀个算法有缺陷,或不适合于某个问题,执⾏这个算法将不会解决这个问题。

不同的算法可能⽤不同的时间、空间或效率来完成同样的任务。

其中最常见的五中基本算法是递归与分治法、动态规划、贪⼼算法、回溯法、分⽀限界法。

本⽂通过这种算法的分析以及实例的讲解,让读者对算法有更深刻的认识,同时对这五种算法有更清楚认识关键词:算法,递归与分治法、动态规划、贪⼼算法、回溯法、分⽀限界法AbstractAlgorithm is the description to the problem solving scheme ,a set of clear instructions to solve the problem and represents the describe the strategy to solve the problem using the method of system mechanism . That is to say, given some confirm import,the Algorithm will find result In a limited time。

If an algorithm is defective or is not suitable for a certain job, it is invalid to execute it. Different algorithms have different need of time or space, and it's efficiency are different.There are most common algorithms: the recursive and divide and conquer、dynamic programming method、greedy algorithm、backtracking、branch and bound method.According to analyze the five algorithms and explain examples, make readers know more about algorithm , and understand the five algorithms more deeply.Keywords: Algorithm, the recursive and divide and conquer, dynamic programming method, greedy algorithm、backtracking, branch and bound method⽬录1. 前⾔ (4)1.1 论⽂背景 (4)2. 算法详解 (5)2.1 算法与程序 (5)2.2 表达算法的抽象机制 (5)2.3 算法复杂性分析 (5)3.五中常⽤算法的详解及实例 (6)3.1 递归与分治策略 (6)3.1.1 递归与分治策略基本思想 (6)3.1.2 实例——棋盘覆盖 (7)3.2 动态规划 (8)3.2.1 动态规划基本思想 (8)3.2.2 动态规划算法的基本步骤 (9)3.2.3 实例——矩阵连乘 (9)3.3 贪⼼算法 (11)3.3.1 贪⼼算法基本思想 (11)3.3.2 贪⼼算法和动态规划的区别 (12)3.3.3 ⽤贪⼼算法解背包问题的基本步骤: (12)3.4 回溯发 (13)3.4.1 回溯法基本思想 (13)3.3.2 回溯发解题基本步骤 (13)3.3.3 实例——0-1背包问题 (14)3.5 分⽀限界法 (15)3.5.1 分⽀限界法思想 (15)3.5.2 实例——装载问题 (16)总结 (18)参考⽂献 (18)1. 前⾔1.1 论⽂背景算法(Algorithm)是指解题⽅案的准确⽽完整的描述,是⼀系列解决问题的清晰指令,算法代表着⽤系统的⽅法描述解决问题的策略机制。

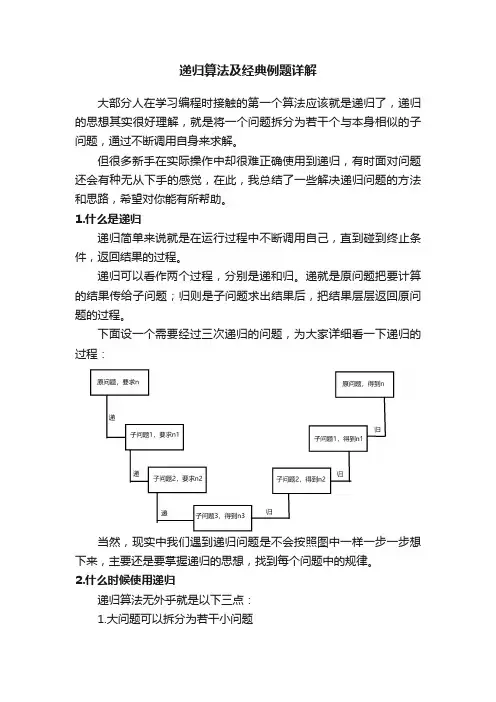

递归算法及经典例题详解大部分人在学习编程时接触的第一个算法应该就是递归了,递归的思想其实很好理解,就是将一个问题拆分为若干个与本身相似的子问题,通过不断调用自身来求解。

但很多新手在实际操作中却很难正确使用到递归,有时面对问题还会有种无从下手的感觉,在此,我总结了一些解决递归问题的方法和思路,希望对你能有所帮助。

1.什么是递归递归简单来说就是在运行过程中不断调用自己,直到碰到终止条件,返回结果的过程。

递归可以看作两个过程,分别是递和归。

递就是原问题把要计算的结果传给子问题;归则是子问题求出结果后,把结果层层返回原问题的过程。

下面设一个需要经过三次递归的问题,为大家详细看一下递归的过程:当然,现实中我们遇到递归问题是不会按照图中一样一步一步想下来,主要还是要掌握递归的思想,找到每个问题中的规律。

2.什么时候使用递归递归算法无外乎就是以下三点:1.大问题可以拆分为若干小问题2.原问题与子问题除数据规模不同,求解思路完全相同3.存在递归终止条件而在实际面对递归问题时,我们还需要考虑第四点:当不满足终止条件时,要如何缩小函数值并让其进入下一层循环中3.递归的实际运用(阶层计算)了解了大概的思路,现在就要开始实战了。

下面我们来看一道经典例题:求N的阶层。

首先按照思路分析是否可以使用递归算法:1.N!可以拆分为(N-1)!*N2.(N-1)!与N!只有数字规模不同,求解思路相同3.当N=1时,结果为1,递归终止满足条件,可以递归:public static int Factorial(int num){if(num==1){return num;}return num*Factorial(num-1);}而最后的return,便是第四步,缩小参数num的值,让递归进入下一层。

一般来说,第四步往往是最难的,需要弄清该如何缩小范围,如何操作返回的数值,这一步只能通过不断地练习提高了(当然如果你知道问题的数学规律也是可以试出来的)。

决策树算法详解及应用场景分析随着数据量的不断增大,如何从中发掘出有价值的信息成为各个领域所面临的难题。

此时,决策树算法应运而生。

决策树是一种基于树结构来进行分类和预测的机器学习算法,已被广泛应用于金融、医疗、电子商务、社交网络等领域。

本文将详细介绍决策树算法的原理、优缺点及应用场景等内容。

一、决策树算法原理决策树是一种树形结构,其中每个内部结点表示一个测试属性,每个分支表示这个属性的一个可能的值,每个叶子结点表示一个类或类分布。

该树将数据集划分为多个子集,以递归的方式进行分类,同时每次对数据集进行划分的方法旨在最大限度地减少分类的正误差。

具体步骤如下:1. 从根节点开始,选择一个最优的属性进行测试,将数据集按照该属性的不同取值分成若干个子集。

2. 对于每个子集,重复1过程,直到子集内的数据可以被完美分类或无法继续划分为止,此时生成一个叶子结点,并标记其所属类别。

3. 对新的未知数据进行预测。

将该数据从根节点开始,依次通过测试,遇到叶子结点即为其预测值。

二、决策树算法优缺点(一)优点1. 可以处理各种数据类型,包括离散型和连续型。

2. 可以自动处理数据缺失的情况,并且不会影响算法的效果。

3. 生成的决策树易于理解和解释,可以通过图形化的方式展示在界面上。

4. 对于相对于训练数据的规模而言,决策树生成的速度比较快。

(二)缺点1. 决策树容易出现过拟合的情况,从而导致对新数据的泛化能力不足。

2. 在处理高维度的数据时,效果不如其他算法,容易出现“维数灾难”现象。

3. 在处理连续值型数据时容易出现过于复杂的波浪形状,从而导致难以解释和理解。

三、决策树算法应用场景1. 监督学习场景下的分类问题。

例如:银行可以使用决策树算法将客户分为高风险和低风险,以更好地进行信贷授信。

2. 监督学习场景下的回归问题。

例如:金融业可以使用决策树算法预测股票的价格波动情况。

3. 特征选择。

决策树具有自动选择重要特征的能力,可以用于特征选择、数据降维等方面的应用。

C语言奇偶排序算法详解及实例代码奇偶排序(Odd-Even Sort)算法是一种简单的排序算法,它可以同时对数组中的奇数和偶数进行排序。

这个算法的原理比较简单,它的思想类似冒泡排序,只不过比较的对象从相邻的两个数变为了相隔一个位置的两个数。

奇偶排序算法的步骤如下:1.将数组分为两个部分,分别存放奇数和偶数。

2.在奇数部分中进行一轮冒泡排序,将较大的数往右移。

3.在偶数部分中进行一轮冒泡排序,将较小的数往左移。

4.重复执行步骤2和步骤3,直到数组完全有序。

下面我们来详细解析奇偶排序算法,并给出一个实例代码。

1. 定义一个函数 `void oddEvenSort(int arr[], int n)`,用于实现奇偶排序。

2. 在函数内部创建两个变量 `sorted` 和 `exchange`,分别表示数组是否已经完全有序和两个相邻元素是否发生交换。

3. 使用一个循环,首先将 `sorted` 和 `exchange` 初始化为`false`。

4. 使用两个嵌套循环,外层循环控制数组两个部分的排序,内层循环控制每个部分的冒泡排序。

5. 内层循环的初始条件为 `j = i % 2`,其中 `i` 表示当前循环的次数。

当 `i` 为偶数时,`j` 为 0,表示要对偶数部分排序;当`i` 为奇数时,`j` 为 1,表示要对奇数部分排序。

6. 内层循环用于对数组中的一部分进行冒泡排序,如果发生交换,则将 `exchange` 设置为 `true`。

冒泡排序的过程和一般的冒泡排序算法类似。

7. 当内层循环结束后,判断 `exchange` 是否为 `false`,如果是,则说明数组已经完全有序,将 `sorted` 设置为 `true`,并退出外层循环。

8. 最后,在函数末尾添加一个循环,用于输出排序后的数组。

下面是完整的实例代码:```c#include <stdio.h>void swap(int *a, int *b){int temp = *a;*a = *b;*b = temp;}void oddEvenSort(int arr[], int n)int sorted = 0; // 数组是否已经完全有序int exchange = 0; // 两个相邻元素是否发生交换 while (!sorted){sorted = 1;for (int i = 0; i < n - 1; i++){exchange = 0;int j = i % 2;for (; j < n - 1; j += 2){if (arr[j] > arr[j + 1]){swap(&arr[j], &arr[j + 1]);exchange = 1;sorted = 0;}}if (!exchange){break;}}}}int main(){int arr[] = {9, 2, 7, 4, 5, 6, 3, 8, 1};int n = sizeof(arr) / sizeof(arr[0]);oddEvenSort(arr, n);for (int i = 0; i < n; i++){printf("%d ", arr[i]);}return 0;}```以上是奇偶排序算法的详细解析及一个示例代码。

遗传算法的详解及应用遗传算法(Genetic Algorithm,GA)是一种模拟自然选择和遗传过程的算法。

在人工智能和优化问题中得到了广泛的应用。

本文将详细介绍遗传算法的基本原理和优化过程,并探讨它在实际应用中的价值和局限性。

一、遗传算法的基本原理遗传算法的基本原理是通过模拟生物进化的过程来寻找一个问题的最优解。

在遗传算法中,优秀的解决方案(也称为个体,Individual)在进化中拥有更高的生存几率,而劣质的解决方案则很快被淘汰。

在遗传算法的过程中,每个个体由若干个基因组成,每个基因代表某种特定的问题参数或者状态。

通过遗传算法,我们可以找到问题最优的解或者其中一个较优解。

遗传算法的基本流程如下:1. 初始化群体(Population):首先,我们需要随机生成一组初始解作为群体的个体。

这些个体被称为染色体(chromosome),每一个染色体都由一些基因(gene)组成。

所以我们可以认为群体是由很多染色体组成的。

2. 选择操作(Selection):选择运算是指从群体中选出一些个体,用来繁殖后代。

其目的是让优秀的个体留下更多的后代,提高下一代的平均适应度。

在选择操作中,我们通常采用轮盘赌选择(Roulette Wheel Selection)法、锦标赛(Tournament)法、排名选择(Ranking Selection)法等方法。

3. 交叉操作(Crossover):交叉运算是指随机地从两个个体中选出一些基因交换,生成新的染色体。

例如,我们可以将染色体A和B中的第三个基因以后的基因交换,从而产生两个新的染色体。

4. 变异操作(Mutation):变异运算是指随机改变染色体中的个别基因,以增加多样性。

例如,我们随机将染色体A的第三个基因改变,从而产生一个新的染色体A'。

5. 适应度评估(Fitness Evaluation):适应度评估是指给每一个个体一个适应度分数,该分数是问题的目标函数或者优化函数。

SIFT算法详解及应用SIFT(Scale-Invariant Feature Transform)是一种在计算机视觉中常用的特征点提取算法,由David Lowe在1999年提出,并在2004年的论文中进行了详细阐述。

SIFT算法可以在不同尺度和旋转下保持图像的特征点不变性,因此在图像拼接、目标识别、图像匹配等领域具有广泛的应用。

1.尺度空间构建:SIFT算法使用高斯差分函数来检测不同尺度下的特征点。

通过在图像中采用不同尺度的高斯滤波,构建尺度空间,从而检测到不同尺度的图像特征。

2.关键点提取:在构建的尺度空间中,SIFT算法通过在每个像素点检测局部极值点来获取关键点。

具体的做法是对每个像素点在尺度空间上进行比较,找出该点与它相邻像素点和尺度上的极值,从而得到关键点。

3. 关键点定位:在关键点提取后,SIFT算法通过利用二阶偏导数的Hessian矩阵来对关键点进行进一步定位。

Hessian矩阵可以描述图像对灰度变化的响应,通过计算关键点周围像素点的Hessian矩阵,可以对关键点进行精确定位。

4.方向分配:在关键点定位后,SIFT算法为每个关键点分配一个主导方向。

通过对关键点周围的图像梯度进行统计,找到梯度方向分布最大的方向作为主导方向,以此来保证关键点对旋转具有不变性。

5.特征描述:在分配了主导方向后,SIFT算法使用局部图像梯度的方向直方图来描述关键点的局部特征。

将关键点周围的16x16邻域划分为4x4的小格子,计算每个小格子内的梯度方向直方图,最终得到一个128维的特征向量来表示关键点的局部特征。

1.尺度不变性:SIFT算法通过在不同尺度下检测特征点,使得算法对于图像缩放具有不变性。

这一特性使得SIFT在目标识别和图像匹配等领域具有广泛应用,可以应对不同尺寸的目标和场景。

2.旋转不变性:SIFT算法通过为每个关键点分配主导方向,使得算法对于图像旋转具有不变性。

这一特性使得SIFT在图像拼接和图像匹配中能够应对图像的旋转变换。

分治算法详解及经典例题⼀、基本概念在计算机科学中,分治法是⼀种很重要的算法。

字⾯上的解释是“分⽽治之”,就是把⼀个复杂的问题分成两个或更多的相同或相似的⼦问题,再把⼦问题分成更⼩的⼦问题……直到最后⼦问题可以简单的直接求解,原问题的解即⼦问题的解的合并。

这个技巧是很多⾼效算法的基础,如排序算法(快速排序,归并排序),傅⽴叶变换(快速傅⽴叶变换)……任何⼀个可以⽤计算机求解的问题所需的计算时间都与其规模有关。

问题的规模越⼩,越容易直接求解,解题所需的计算时间也越少。

例如,对于n个元素的排序问题,当n=1时,不需任何计算。

n=2时,只要作⼀次⽐较即可排好序。

n=3时只要作3次⽐较即可,…。

⽽当n较⼤时,问题就不那么容易处理了。

要想直接解决⼀个规模较⼤的问题,有时是相当困难的。

⼆、基本思想及策略分治法的设计思想是:将⼀个难以直接解决的⼤问题,分割成⼀些规模较⼩的相同问题,以便各个击破,分⽽治之。

分治策略是:对于⼀个规模为n的问题,若该问题可以容易地解决(⽐如说规模n较⼩)则直接解决,否则将其分解为k个规模较⼩的⼦问题,这些⼦问题互相独⽴且与原问题形式相同,递归地解这些⼦问题,然后将各⼦问题的解合并得到原问题的解。

这种算法设计策略叫做分治法。

如果原问题可分割成k个⼦问题,1<k≤n,且这些⼦问题都可解并可利⽤这些⼦问题的解求出原问题的解,那么这种分治法就是可⾏的。

由分治法产⽣的⼦问题往往是原问题的较⼩模式,这就为使⽤递归技术提供了⽅便。

在这种情况下,反复应⽤分治⼿段,可以使⼦问题与原问题类型⼀致⽽其规模却不断缩⼩,最终使⼦问题缩⼩到很容易直接求出其解。

这⾃然导致递归过程的产⽣。

分治与递归像⼀对孪⽣兄弟,经常同时应⽤在算法设计之中,并由此产⽣许多⾼效算法。

三、分治法适⽤的情况分治法所能解决的问题⼀般具有以下⼏个特征:1) 该问题的规模缩⼩到⼀定的程度就可以容易地解决2) 该问题可以分解为若⼲个规模较⼩的相同问题,即该问题具有最优⼦结构性质。

SIFT算法详解及应用SIFT(Scale-Invariant Feature Transform)是一种用于图像处理和计算机视觉中的特征提取算法。

它的主要目标是提取具有尺度和旋转不变性的局部特征点。

SIFT算法的独特之处在于它不依赖于特定的图像属性,而是通过一系列处理步骤构建出具有稳定性和描述性的特征点。

1. 尺度空间极值检测(Scale Space Extrema Detection):通过在不同的尺度上使用高斯差分函数,找到图像中的极值点作为潜在特征点。

2. 关键点定位(Keypoint Localization):在尺度空间中找到极值点后,使用插值方法精确定位特征点的位置。

同时,通过计算Hessian矩阵的主曲率来排除边缘响应。

3. 方向分配(Orientation Assignment):为每个特征点分配一个主要的方向,使得后续的特征描述能够具有旋转不变性。

4. 特征描述(Feature Description):根据每个特征点的主方向,构建特征描述子。

描述子被构建为一个128维的向量,它具有对尺度、旋转和光照变化的不变性。

5. 特征匹配(Feature Matching):通过比较特征描述子,找到两幅图像中具有相似特征的匹配点。

常用的方法是计算特征向量之间的欧式距离或相似性度量。

1.目标识别:SIFT算法可以检测并描述图像中的关键点,通过与预先训练好的模板特征进行匹配,可以在输入图像中快速准确地定位和识别目标物体。

2.图像拼接:SIFT算法可以提取图像中的特征点,并通过对这些特征点进行匹配来确定它们之间的对应关系。

这样,可以将多张图像拼接在一起,生成一个大的全景图像。

3.目标跟踪:SIFT算法可以提取图像中的关键点,并构建其特征描述子。

通过与之前的图像帧进行匹配,可以实现目标的跟踪和定位。

4.三维重建:使用多个图像拍摄同一场景,并通过SIFT算法提取特征点并进行匹配,可以推断出相机的位置和场景的结构,从而实现三维重建。

机器学习中的随机森林算法详解随机森林是一种常用的机器学习算法,它是通过集成多个决策树来进行预测和分类任务的。

该算法具有高准确率、有效避免过拟合以及对大规模数据集具有良好的可扩展性等优点。

本文将详细介绍随机森林算法的原理、步骤以及应用场景。

1. 随机森林算法原理随机森林算法基于集成学习的思想,通过构建多个决策树模型,并将它们组合形成一个随机森林。

每个决策树都是通过随机选择特征子集和样本子集来生成的,从而降低了模型之间的相关性。

最终的预测结果是由所有决策树的预测结果通过投票或平均得到。

2. 随机森林算法步骤随机森林算法的主要步骤包括特征选择、随机样本选择、决策树的构建和组合等。

(1)特征选择:从训练数据集的特征集合中随机选择一定数量的特征子集,通常可以使用自助采样法(bootstrap sampling)进行选择。

这一步的目的是保留一部分相关特征,并减少决策树之间的相关性。

(2)随机样本选择:从训练数据集中随机选择一部分样本进行训练。

这一步的目的是减少决策树的训练样本数量,同时增加样本之间的差异性。

(3)决策树的构建:对于每个样本子集,使用决策树算法(如CART)来构建决策树模型。

决策树的构建过程通常是通过递归地选择最佳特征和划分点进行的,直到达到停止条件(如节点样本数量小于阈值或深度达到最大值)。

(4)组合决策树:将所有构建好的决策树组合成一个随机森林模型。

对于分类任务,可以通过投票来确定最终的预测结果;对于回归任务,可以通过平均或加权平均来预测输出。

3. 随机森林算法的优点随机森林算法具有以下几个优点:(1)准确率高:随机森林能够通过集成多个决策树的预测结果来提高模型的准确率。

(2)有效避免过拟合:随机森林通过特征选择和样本选择的随机性来降低模型的方差,有效避免过拟合的问题。

(3)对于大规模数据集具有良好的可扩展性:随机森林能够有效处理高维数据和大规模数据集,具有较好的计算效率。

(4)能够评估特征的重要性:随机森林能够通过特征选择的过程来评估特征的重要性,从而对数据集进行特征筛选。

Dijkstra算法详解Dijkstra算法是一种用于求解最短路径问题的经典算法,广泛应用在图论和网络路由等领域。

本文将详细介绍Dijkstra算法的原理、步骤以及应用。

一、介绍Dijkstra算法,由荷兰计算机科学家Edsger W. Dijkstra于1956年提出,是一种用于求解带权有向图中单源最短路径问题的贪心算法。

该算法可以找到从给定源节点到图中所有其他节点的最短路径。

二、原理Dijkstra算法采用了贪心策略,通过逐步选择未访问节点中距离最短的节点,逐步确定最短路径的节点集合。

具体步骤如下:1. 创建一个数组dist[],将所有节点的初始距离设置为无穷大,起始节点的距离设置为0。

2. 创建一个集合visited[],用于记录已经确定最短路径的节点。

3. 选择距离最小的节点u,并将其标记为visited。

4. 遍历u的所有邻居节点v,更新节点v的最短距离dist[v],如果dist[v]更新,则更新v的前驱节点为u。

5. 重复步骤3和4,直到所有节点都被访问过或没有可访问节点为止。

6. 最终得到的dist[]数组记录了起始节点到图中所有其他节点的最短距离,通过回溯前驱节点可以得到最短路径。

三、步骤解析我们通过一个简单的例子来解析Dijkstra算法的步骤。

假设我们有以下带权有向图:1. 初始化dist[]数组,所有节点的距离设置为无穷大,起始节点A 的距离设置为0。

dist[A] = 0, dist[B] = ∞, dist[C] = ∞, dist[D] = ∞, dist[E] = ∞, dist[F] = ∞。

2. 选择距离最小的节点,即起始节点A,将其标记为visited。

visited[] = [A]3. 更新节点A的邻居节点的最短距离。

节点B和节点C是节点A 的邻居节点,更新它们的最短距离。

dist[B] = 1, dist[C] = 44. 选择距离最小的节点,即节点B,将其加入visited集合。