SPSS专题2回归分析线性回归Logistic回归对数线性模型

- 格式:pptx

- 大小:594.80 KB

- 文档页数:72

我们之前讲Logistic回归模型的时候说过,分类数据在使用卡方检验的时候,当分类过多或者每个类别的水平数过多时,单元格会划分的非常细,有可能会导致大量单元格频数很小甚至为0,并且卡方检验虽然可以分析因素作用,但是无法描述作用的大小和方向,并且无法进一步考察因素间的交互作用,这些都是卡方检验的局限,实际上卡方检验更多的用于行列交叉表,也就是列联表的分析。

以上问题似乎可以使用方差分析解决,但是方差分析仅适用于连续变量,对于分类变量除了可以使用Logistic回归之外,还可以使用对数线性模型,对数线性模型的构造和方差分析模型类似,其作用也一样,可以看做是分类数据的方差分析模型,但是不同点在于,对数线性模型不区分因变量与自变量,并且假定单元格观察频数服从多项分布而不是正态分布,因此二者采用的计算方法也不相同。

对数线性模型在SPSS中有专门的过程,分为三个子过程,这三个子过程侧重不同,分别为1.常规适用于对某些特定效应进行分析,只考虑因素之间是否相关,不考虑因果2.Logit适用于已明确区分出因变量与自变量,并且因变量为二分类变量,分析的目的是因变量和自变量的关系,实际上这个结果和Logistic回归是等价的,在Logistic 回归过程中,也有选择交互作用的按钮。

3.模型选择拟合的是分层对数线性模型,适用于探索性分析,没有具体分出因变量和自变量,也没有预先对某些效应感兴趣,只是设想某些变量可能存在联系,并无明确假设,该模型输出的结果最为详细且繁杂。

下面我们分别来看这三个过程一、常规我们还是以二分类Logistic回归模型的例子来作说明分析—对数线性模型—常规二、Logit我们知道Logit过程适用于对因变量和自变量已有确定的情况,现在我们以该过程拟合上面的数据三、模型选择前面说过,模型选择过程只是设想某些变量可能存在联系,属于探索性分析,因此该过程可以利用分层对数线性模型进行模型选择。

我们知道饱和模型最为准确但结果也最为复杂,不饱和模型结果准确性降低但是模型精简,在实际应用中,准确性和模型简约程度都很重要,需要在这二者间做出权衡,而模型选择就可以帮助我们得到最佳的简约模型,它类似于逐步回归,从饱和模型入手,从高阶交互作用开始逐步排除无意义的参数,但是结果只能输出饱和模型的参数,对于精简后的模型参数,需要再另外估计。

SPSS—回归—多元线性回归结果分析(二),最近一直很忙,公司的潮起潮落,就好比人生的跌岩起伏,眼看着一步步走向衰弱,却无能为力,也许要学习“步步惊心”里面“四阿哥”的座右铭:“行到水穷处”,”坐看云起时“。

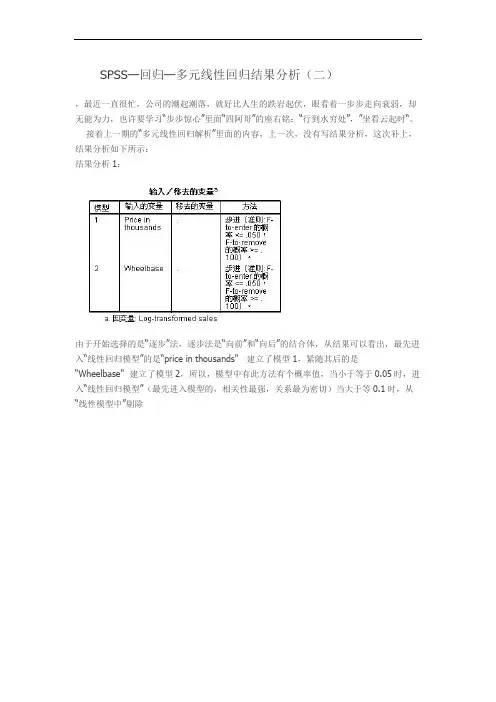

接着上一期的“多元线性回归解析”里面的内容,上一次,没有写结果分析,这次补上,结果分析如下所示:结果分析1:由于开始选择的是“逐步”法,逐步法是“向前”和“向后”的结合体,从结果可以看出,最先进入“线性回归模型”的是“price in thousands"建立了模型1,紧随其后的是“Wheelbase"建立了模型2,所以,模型中有此方法有个概率值,当小于等于0.05时,进入“线性回归模型”(最先进入模型的,相关性最强,关系最为密切)当大于等0.1时,从“线性模型中”剔除结果分析:1:从“模型汇总”中可以看出,有两个模型,(模型1和模型2)从R2 拟合优度来看,模型2的拟合优度明显比模型1要好一些(0.422>0.300)2:从“Anova"表中,可以看出“模型2”中的“回归平方和”为115.311,“残差平方和”为153.072,由于总平方和=回归平方和+残差平方和,由于残差平方和(即指随即误差,不可解释的误差)由于“回归平方和”跟“残差平方和”几乎接近,所有,此线性回归模型只解释了总平方和的一半,3:根据后面的“F统计量”的概率值为0.00,由于0.00<0.01,随着“自变量”的引入,其显著性概率值均远小于0.01,所以可以显著地拒绝总体回归系数为0的原假设,通过ANOVA方差分析表可以看出“销售量”与“价格”和“轴距”之间存在着线性关系,至于线性关系的强弱,需要进一步进行分析。

结果分析:1:从“已排除的变量”表中,可以看出:“模型2”中各变量的T检的概率值都大于“0.05”所以,不能够引入“线性回归模型”必须剔除。

从“系数a” 表中可以看出:1:多元线性回归方程应该为:销售量=-1.822-0.055*价格+0.061*轴距但是,由于常数项的sig为(0.116>0.1) 所以常数项不具备显著性,所以,我们再看后面的“标准系数”,在标准系数一列中,可以看到“常数项”没有数值,已经被剔除所以:标准化的回归方程为:销售量=-0.59*价格+0.356*轴距2:再看最后一列“共线性统计量”,其中“价格”和“轴距”两个容差和“vif都一样,而且VIF 都为1.012,且都小于5,所以两个自变量之间没有出现共线性,容忍度和膨胀因子是互为倒数关系,容忍度越小,膨胀因子越大,发生共线性的可能性也越大从“共线性诊断”表中可以看出:1:共线性诊断采用的是“特征值”的方式,特征值主要用来刻画自变量的方差,诊断自变量间是否存在较强多重共线性的另一种方法是利用主成分分析法,基本思想是:如果自变量间确实存在较强的相关关系,那么它们之间必然存在信息重叠,于是就可以从这些自变量中提取出既能反应自变量信息(方差),而且有相互独立的因素(成分)来,该方法主要从自变量间的相关系数矩阵出发,计算相关系数矩阵的特征值,得到相应的若干成分。

SPSS-回归分析回归分析(⼀元线性回归分析、多元线性回归分析、⾮线性回归分析、曲线估计、时间序列的曲线估计、含虚拟⾃变量的回归分析以及逻辑回归分析)回归分析中,⼀般⾸先绘制⾃变量和因变量间的散点图,然后通过数据在散点图中的分布特点选择所要进⾏回归分析的类型,是使⽤线性回归分析还是某种⾮线性的回归分析。

回归分析与相关分析对⽐:在回归分析中,变量y称为因变量,处于被解释的特殊地位;;⽽在相关分析中,变量y与变量x处于平等的地位。

在回归分析中,因变量y是随机变量,⾃变量x可以是随机变量,也可以是⾮随机的确定变量;⽽在相关分析中,变量x和变量y都是随机变量。

相关分析是测定变量之间的关系密切程度,所使⽤的⼯具是相关系数;⽽回归分析则是侧重于考察变量之间的数量变化规律。

统计检验概念:为了确定从样本(sample)统计结果推论⾄总体时所犯错的概率。

F值和t值就是这些统计检定值,与它们相对应的概率分布,就是F分布和t分布。

统计显著性(sig)就是出现⽬前样本这结果的机率。

标准差表⽰数据的离散程度,标准误表⽰抽样误差的⼤⼩。

统计检验的分类:拟合优度检验:检验样本数据聚集在样本回归直线周围的密集程度,从⽽判断回归⽅程对样本数据的代表程度。

回归⽅程的拟合优度检验⼀般⽤判定系数R2实现。

回归⽅程的显著性检验(F检验):是对因变量与所有⾃变量之间的线性关系是否显著的⼀种假设检验。

回归⽅程的显著性检验⼀般采⽤F 检验。

回归系数的显著性检验(t检验): 根据样本估计的结果对总体回归系数的有关假设进⾏检验。

1.⼀元线性回归分析定义:在排除其他影响因素或假定其他影响因素确定的条件下,分析某⼀个因素(⾃变量)是如何影响另⼀事物(因变量)的过程。

SPSS操作2.多元线性回归分析定义:研究在线性相关条件下,两个或两个以上⾃变量对⼀个因变量的数量变化关系。

表现这⼀数量关系的数学公式,称为多元线性回归模型。

SPSS操作3.⾮线性回归分析定义:研究在⾮线性相关条件下,⾃变量对因变量的数量变化关系⾮线性回归问题⼤多数可以化为线性回归问题来求解,也就是通过对⾮线性回归模型进⾏适当的变量变换,使其化为线性模型来求解。

线性回归是很重要的一种回归方法,但是线性回归只适用于因变量为连续型变量的情况,那如果因变量为分类变量呢?比方说我们想预测某个病人会不会痊愈,顾客会不会购买产品,等等,这时候我们就要用到logistic回归分析了。

Logistic回归主要分为三类,一种是因变量为二分类得logistic回归,这种回归叫做二项logistic回归,一种是因变量为无序多分类得logistic回归,比如倾向于选择哪种产品,这种回归叫做多项logistic回归。

还有一种是因变量为有序多分类的logistic回归,比如病重的程度是高,中,低呀等等,这种回归也叫累积logistic回归,或者序次logistic回归.二值logistic回归:选择分析—-回归——二元logistic,打开主面板,因变量勾选你的二分类变量,这个没有什么疑问,然后看下边写着一个协变量.有没有很奇怪什么叫做协变量?在二元logistic回归里边可以认为协变量类似于自变量,或者就是自变量.把你的自变量选到协变量的框框里边。

细心的朋友会发现,在指向协变量的那个箭头下边,还有一个小小的按钮,标着a*b,这个按钮的作用是用来选择交互项的。

我们知道,有时候两个变量合在一起会产生新的效应,比如年龄和结婚次数综合在一起,会对健康程度有一个新的影响,这时候,我们就认为两者有交互效应.那么我们为了模型的准确,就把这个交互效应也选到模型里去。

我们在右边的那个框框里选择变量a,按住ctrl,在选择变量b,那么我们就同时选住这两个变量了,然后点那个a*b的按钮,这样,一个新的名字很长的变量就出现在协变量的框框里了,就是我们的交互作用的变量.然后在下边有一个方法的下拉菜单。

默认的是进入,就是强迫所有选择的变量都进入到模型里边。

除去进入法以外,还有三种向前法,三种向后法.一般默认进入就可以了,如果做出来的模型有变量的p值不合格,就用其他方法在做.再下边的选择变量则是用来选择你的个案的.一般也不用管它.选好主面板以后,单击分类(右上角),打开分类对话框。

SPSS学习笔记之——二项Logistic回归分析[转载]SPSS学习笔记之——二项Logistic回归分析一、概述Logistic回归主要用于因变量为分类变量(如疾病的缓解、不缓解,评比中的好、中、差等)的回归分析,自变量可以为分类变量,也可以为连续变量。

他可以从多个自变量中选出对因变量有影响的自变量,并可以给出预测公式用于预测。

因变量为二分类的称为二项logistic回归,因变量为多分类的称为多元logistic回归。

下面学习一下Odds、OR、RR的概念:在病例对照研究中,可以画出下列的四格表:------------------------------------------------------暴露因素病例对照-----------------------------------------------------暴露 a b非暴露 c d-----------------------------------------------比值、比数,是指某事件发生的可能性(概率)与不发生的可能Odds: 称为性(概率)之比。

在病例对照研究中病例组的暴露比值为:odds1 = (a/(a+c))/(c(a+c)) = a/c,对照组的暴露比值为:odds2 = (b/(b+d))/(d/(b+d)) = b/dOR:比值比,为:病例组的暴露比值(odds1)/对照组的暴露比值(odds2) =ad/bc换一种角度,暴露组的疾病发生比值:odds1 = (a/(a+b))/(b(a+b)) = a/b非暴露组的疾病发生比值:odds2 = (c/(c+d))/(d/(c+d)) = c/dOR = odds1/odds2 = ad/bc与之前的结果一致。

OR的含义与相对危险度相同,指暴露组的疾病危险性为非暴露组的多少倍。

OR>1说明疾病的危险度因暴露而增加,暴露与疾病之间为“正”关联;OR<1说明疾病的危险度因暴露而减少,暴露与疾病之间为“负”关联。

SPSS的线性回归分析分析SPSS是一款广泛用于统计分析的软件,其中包括了许多功能强大的工具。

其中之一就是线性回归分析,它是一种常用的统计方法,用于研究一个或多个自变量对一个因变量的影响程度和方向。

线性回归分析是一种用于解释因变量与自变量之间关系的统计技术。

它主要基于最小二乘法来评估自变量与因变量之间的关系,并估计出最合适的回归系数。

在SPSS中,线性回归分析可以通过几个简单的步骤来完成。

首先,需要加载数据集。

可以选择已有的数据集,也可以导入新的数据。

在SPSS的数据视图中,可以看到所有变量的列表。

接下来,选择“回归”选项。

在“分析”菜单下,选择“回归”子菜单中的“线性”。

在弹出的对话框中,将因变量拖放到“因变量”框中。

然后,将自变量拖放到“独立变量”框中。

可以选择一个或多个自变量。

在“统计”选项中,可以选择输出哪些统计结果。

常见的选项包括回归系数、R方、调整R方、标准误差等。

在“图形”选项中,可以选择是否绘制残差图、分布图等。

点击“确定”后,SPSS将生成线性回归分析的结果。

线性回归结果包括多个重要指标,其中最重要的是回归系数和R方。

回归系数用于衡量自变量对因变量的影响程度和方向,其值表示每个自变量单位变化对因变量的估计影响量。

R方则反映了自变量对因变量变异的解释程度,其值介于0和1之间,越接近1表示自变量对因变量的解释程度越高。

除了回归系数和R方外,还有其他一些统计指标可以用于判断模型质量。

例如,标准误差可以用来衡量回归方程的精确度。

调整R方可以解决R方对自变量数量的偏向问题。

此外,SPSS还提供了多种工具来检验回归方程的显著性。

例如,可以通过F检验来判断整个回归方程是否显著。

此外,还可以使用t检验来判断每个自变量的回归系数是否显著。

在进行线性回归分析时,还需要注意一些统计前提条件。

例如,线性回归要求因变量与自变量之间的关系是线性的。

此外,还需要注意是否存在多重共线性,即自变量之间存在高度相关性。

SPSS分析技术:线性回归分析相关分析可以揭示事物之间共同变化的一致性程度,但它仅仅只是反映出了一种相关关系,并没有揭示出变量之间准确的可以运算的控制关系,也就是函数关系,不能解决针对未来的分析与预测问题。

回归分析就是分析变量之间隐藏的内在规律,并建立变量之间函数变化关系的一种分析方法,回归分析的目标就是建立由一个因变量和若干自变量构成的回归方程式,使变量之间的相互控制关系通过这个方程式描述出来。

回归方程式不仅能够解释现在个案内部隐藏的规律,明确每个自变量对因变量的作用程度。

而且,基于有效的回归方程,还能形成更有意义的数学方面的预测关系。

因此,回归分析是一种分析因素变量对因变量作用强度的归因分析,它还是预测分析的重要基础。

回归分析类型回归分析根据自变量个数,自变量幂次以及变量类型可以分为很多类型,常用的类型有:线性回归;曲线回归;二元Logistic回归技术;线性回归原理回归分析就是建立变量的数学模型,建立起衡量数据联系强度的指标,并通过指标检验其符合的程度。

线性回归分析中,如果仅有一个自变量,可以建立一元线性模型。

如果存在多个自变量,则需要建立多元线性回归模型。

线性回归的过程就是把各个自变量和因变量的个案值带入到回归方程式当中,通过逐步迭代与拟合,最终找出回归方程式中的各个系数,构造出一个能够尽可能体现自变量与因变量关系的函数式。

在一元线性回归中,回归方程的确立就是逐步确定唯一自变量的系数和常数,并使方程能够符合绝大多数个案的取值特点。

在多元线性回归中,除了要确定各个自变量的系数和常数外,还要分析方程内的每个自变量是否是真正必须的,把回归方程中的非必需自变量剔除。

名词解释线性回归方程:一次函数式,用于描述因变量与自变量之间的内在关系。

根据自变量的个数,可以分为一元线性回归方程和多元线性回归方程。

观测值:参与回归分析的因变量的实际取值。

对参与线性回归分析的多个个案来讲,它们在因变量上的取值,就是观测值。

对于分类变量,我们知道通常使用卡方检验,但卡方检验仅能分析因素的作用,无法继续分析其作用大小和方向,并且当因素水平过多时,单元格被划分的越来越细,频数有可能为0,导致结果不准确,最重要的是卡方检验不能对连续变量进行分析。

使用线性回归模型可以解决上述的部分问题,但是传统的线性模型默认因变量为连续变量,当因变量为分类变量时,传统线性回归模型的拟合方法会出现问题,因此人们继续发展出了专门针对分类变量的回归模型。

此类模型采用的基本方法是采用变量变换,使其符合传统回归模型的要求。

根据变换的方法不同也就衍生出不同的回归模型,例如采用Logit变换的Logistic回归模型,采用Probit变换的Probit回归模型等,相比之下,Logistic是使用最为广泛的针对分类数据的回归模型。

Logistic回归模型的适用条件1.因变量为二分类变量或是某事件的发生率2.自变量与Logit变换后的因变量呈线性关系3.残差合计为0,且服从二项分布4.各观测值之间独立由于Logistic回归模型的残差项服从二项分布而不是正态分布,因此不能使用最小二乘法进行参数估计,而是要使用最大似然法。

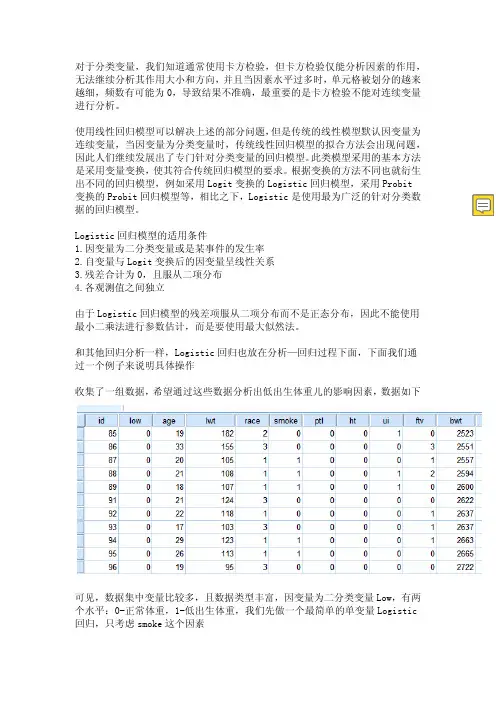

和其他回归分析一样,Logistic回归也放在分析—回归过程下面,下面我们通过一个例子来说明具体操作收集了一组数据,希望通过这些数据分析出低出生体重儿的影响因素,数据如下可见,数据集中变量比较多,且数据类型丰富,因变量为二分类变量Low,有两个水平:0-正常体重,1-低出生体重,我们先做一个最简单的单变量Logistic 回归,只考虑smoke这个因素分析—回归—二元Logistic回归前面我们只引入了一个自变量,可以看到模型的效果并不理想,而且Logistic 回归和传统回归模型一样,也可以引入多个自变量并且可以对自变量进行筛选,尽量引入对因变量存在强影响的自变量,下面我们继续加入自变量并进行筛选。

利用SPSS进行Logistic回归分析第8章利用SPSS进行Logistic回归分析现实中的很多现象可以划分为两种可能,或者归结为两种状态,这两种状态分别用0和1表示。

如果我们采用多个因素对0-1表示的某种现象进行因果关系解释,就可能应用到logistic回归。

Logistic回归分为二值logistic回归和多值logistic回归两类。

首先用实例讲述二值logistic回归,然后进一步说明多值logistic回归。

在阅读这部分内容之前,最好先看看有关SPSS软件操作技术的教科书。

§8.1 二值logistic回归8.1.1 数据准备和选项设置我们研究2005年影响中国各地区城市化水平的经济地理因素。

城市化水平用城镇人口比重表征,影响因素包括人均GDP、第二产业产值比重、第三产业产值比重以及地理位置。

地理位置为名义变量,中国各地区被分别划分到三大地带:东部地带、中部地带和西部地带。

我们用各地区的地带分类代表地理位置。

第一步:整理原始数据。

这些数据不妨录入Excel中。

数据整理内容包括两个方面:一是对各地区按照三大地带的分类结果赋值,用0、1表示,二是将城镇人口比重转换逻辑值,变量名称为“城市化”。

以各地区2005年城镇人口比重的平均值45.41%为临界值,凡是城镇人口比重大于等于45.41%的地区,逻辑值用Yes表示,否则用No表示(图8-1-1)。

图8-1-1 原始数据(Excel中,局部)将数据拷贝或者导入SPSS的数据窗口(Data View)中(图8-1-2)。

图8-1-2 中国31个地区的数据(SPSS中,局部)第二步:打开“聚类分析”对话框。

沿着主菜单的“Analyze→Regression→Binary LogisticK”的路径(图8-1-3)打开二值Logistic回归分析选项框(图8-1-4)。

图8-1-3 打开二值Logistic回归分析对话框的路径对数据进行多次拟合试验,结果表明,像二产比重、三产比重等对城市化水平影响不显著。

spss回归分析2篇篇一:SPSS回归分析简介回归分析是一种常用的统计分析方法,可以用来描述自变量和因变量之间的关系。

在社会科学研究中,回归分析通常用来预测或解释某些现象。

SPSS是一种流行的分析工具,提供了强大的回归分析功能。

本文将介绍如何使用SPSS进行回归分析,并解释如何解读回归结果。

步骤下面是使用SPSS进行回归分析的基本步骤:1. 打开SPSS并导入数据集。

2. 选择“回归”菜单中的“线性回归”选项。

3. 在对话框中,选择需要用作预测变量的自变量。

4. 指定需要预测的因变量。

5. 点击“统计”按钮,选择需要显示的统计信息,如R 方值、标准化系数等。

6. 点击“确定”按钮,SPSS将生成回归分析结果的报告。

解读结果SPSS生成的回归分析报告包含多个部分。

以下是一些主要内容:1. 描述性统计包括每个自变量和因变量的平均值、标准差和样本数量。

2. 相关系数矩阵显示每个自变量和因变量之间的相关程度,以及它们之间的相关系数。

3. 回归系数显示每个自变量对因变量的影响程度。

系数值越大,说明自变量对因变量的影响越大。

你可以根据这些系数来进行预测或解释。

4. R方值表示自变量对因变量的独立解释能力。

R方值越接近1,说明自变量对因变量的解释能力越强。

但是,R方值不表示因果关系。

5. t值和p值这些值用于测试回归系数是否显著。

t值越大,p值越小,说明回归系数越显著。

结论回归分析是一种强大的统计方法,可以用来解释或预测某些现象。

使用SPSS进行回归分析非常简单,只需按照上述步骤操作即可。

解读SPSS生成的回归分析报告可能需要一些统计知识,但是你可以根据报告中的图表和指标来进行评估。

言归正传,下面我们将介绍如何使用SPSS进行多元回归分析。

篇二:SPSS多元回归分析简介多元回归分析是一种用于探索多个自变量与因变量之间关系的统计方法。

在社会科学研究中,多元回归通常用于预测或解释某些现象。

SPSS是一种流行的分析工具,提供了强大的多元回归分析功能。

SPSS学习笔记之——二项Logistic回归分析一、概述Logistic回归主要用于因变量为分类变量(如疾病的缓解、不缓解,评比中的好、中、差等)的回归分析,自变量可以为分类变量,也可以为连续变量。

他可以从多个自变量中选出对因变量有影响的自变量,并可以给出预测公式用于预测。

因变量为二分类的称为二项logistic回归,因变量为多分类的称为多元logistic回归。

下面学习一下Odds、OR、RR的概念:在病例对照研究中,可以画出下列的四格表:------------------------------------------------------暴露因素病例对照-----------------------------------------------------暴露 a b非暴露 c d-----------------------------------------------Odds:称为比值、比数,是指某事件发生的可能性(概率)与不发生的可能性(概率)之比。

在病例对照研究中病例组的暴露比值为:odds1 = (a/(a+c))/(c(a+c)) = a/c,对照组的暴露比值为:odds2 = (b/(b+d))/(d/(b+d)) = b/dOR:比值比,为:病例组的暴露比值(odds1)/对照组的暴露比值(odds2) = ad/bc换一种角度,暴露组的疾病发生比值:odds1 = (a/(a+b))/(b(a+b)) = a/b非暴露组的疾病发生比值:odds2 = (c/(c+d))/(d/(c+d)) = c/dOR = odds1/odds2 = ad/bc与之前的结果一致。

OR的含义与相对危险度相同,指暴露组的疾病危险性为非暴露组的多少倍。

OR>1说明疾病的危险度因暴露而增加,暴露与疾病之间为“正”关联;OR<1说明疾病的危险度因暴露而减少,暴露与疾病之间为“负”关联。

如何用SPSS做logistic回归分析解读————————————————————————————————作者:————————————————————————————————日期:如何用进行二元和多元logistic回归分析一、二元logistic回归分析二元logistic回归分析的前提为因变量是可以转化为0、1的二分变量,如:死亡或者生存,男性或者女性,有或无,Yes或No,是或否的情况。

下面以医学中不同类型脑梗塞与年龄和性别之间的相互关系来进行二元logistic回归分析。

(一)数据准备和SPSS选项设置第一步,原始数据的转化:如图1-1所示,其中脑梗塞可以分为ICAS、ECAS和NCAS三种,但现在我们仅考虑性别和年龄与ICAS的关系,因此将分组数据ICAS、ECAS和NCAS转化为1、0分类,是ICAS赋值为1,否赋值为0。

年龄为数值变量,可直接输入到spss中,而性别需要转化为(1、0)分类变量输入到spss当中,假设男性为1,女性为0,但在后续分析中系统会将1,0置换(下面还会介绍),因此为方便期间我们这里先将男女赋值置换,即男性为“0”,女性为“1”。

图 1-1第二步:打开“二值Logistic 回归分析”对话框:沿着主菜单的“分析(Analyze)→回归(Regression)→二元logistic(Binary Logistic)”的路径(图1-2)打开二值Logistic 回归分析选项框(图1-3)。

如图1-3左侧对话框中有许多变量,但在单因素方差分析中与ICAS 显著相关的为性别、年龄、有无高血压,有无糖尿病等(P<),因此我们这里选择以性别和年龄为例进行分析。

在图1-3中,因为我们要分析性别和年龄与ICAS的相关程度,因此将ICAS选入因变量(Dependent)中,而将性别和年龄选入协变量(Covariates)框中,在协变量下方的“方法(Method)”一栏中,共有七个选项。

手把手教你SPSS二分类Logistic回归分析本教程手把手教您用SPSS做Logistic回归分析,目录如下:一、数据格式二、对数据的分析理解三、SPSS做Logistic回归分析操作步骤3.1 线性关系检验假设3.2 多重共线检验假设3.3 离群值、杠杆点和强影响点的识别3.4 Logistic回归分析四、SPSS计算结果的解释五、结果结论的撰写一、数据格式某研究者想了解年龄、性别、BMI和总胆固醇(TC)预测患心脏病(CVD)的能力,招募了100例研究对象,记录了年龄(age)、性别(gender)、BMI,测量血中总胆固醇水平(TC),并评估研究对象目前是否患有心脏病(CVD)。

部分数据如图1。

二、对问题分析使用Logistic模型前,需判断是否满足以下7项假设。

假设1:因变量(结局)是二分类变量。

假设2:有至少1个自变量,自变量可以是连续变量,也可以是分类变量。

假设3:每条观测间相互独立。

分类变量(包括因变量和自变量)的分类必须全面且每一个分类间互斥。

假设4:最小样本量要求为自变量数目的15倍,但一些研究者认为样本量应达到自变量数目的50倍。

假设5:连续的自变量与因变量的logit转换值之间存在线性关系。

假设6:自变量之间无多重共线性。

假设7:没有明显的离群点、杠杆点和强影响点。

假设1-4取决于研究设计和数据类型,本研究数据满足假设1-4。

那么应该如何检验假设5-7,并进行Logistic回归呢?三、SPSS操作3.1 检验假设5:连续的自变量与因变量的logit转换值之间存在线性关系。

连续的自变量与因变量的logit转换值之间是否存在线性关系,可以通过多种方法检验。

这里主要介绍Box-Tidwell方法,即将连续自变量与其自然对数值的交互项纳入回归方程。

本研究中,连续的自变量包括age、BMI、TC。

使用Box-Tidwell 方法时,需要先计算age、BMI、TC的自然对数值,并命名为ln_age、ln_BMI、ln_TC。