拟牛顿法(变尺度法)DFP算法的cc 源码

- 格式:doc

- 大小:43.50 KB

- 文档页数:11

约束变尺度法Newton 法最突出的优点是收敛速度快,在这一点上其它算法无法比拟的。

因此,建议凡是Hesse 矩阵比较容易求出的问题,尽可能使用Newton 法求解。

但是,Newton 法也有一个严重缺陷,就是每次迭代都要计算目标函数的Hesse 矩阵和它的逆矩阵,当问题的维数较大时,计算量迅速增加,从而就抵消了Newton 法的优点。

为此,人们开始寻找一种算法既可以保持Newton 法收敛速度快的优点,又可以摆脱关于Hesse 矩阵的计算,这就是变尺度算法。

变尺度法是一种非常好的方法,其中DFP 算法和BFGS 算法。

可以说,直到目前为止,在不用Hesse 矩阵的方法中是最好的算法。

一、拟Newton 法为了吸收Newton 法收敛速度快的优点,同时避免Newton 法每次迭代都要计算目标函数的Hesse 矩阵和它的逆矩阵,人们提出了具有超线性收敛的拟Newton 法。

(一)拟Newton 法的基本原理在Newton 法中的基本迭代公式kk k k P t X X +=+1,其中1=k t ,)()]([12kkk Xf Xf P ∇∇-=-令)()(2kkkkXf gXf G∇=∇=,于是有,,,,21011=-=-+k g G X X k k k k其中X0是初始点, gk 和 Gk 分别是目标函数f (X )在点 Xk 的梯度和Hesse 矩阵.为了消除这个迭代公式中的Hesse 逆矩阵G-1k ,可用某种近似矩阵Hk=Hk(Xk)来替换它,即构造一矩阵序列{Hk}去逼近Hesse 逆矩阵序列{G-1k},此时kk k k g H X X -=+1事实上,式中 Pk= -Hk gk 无非是确定了第k 次迭代的搜索方向.为了取得更大的灵活性,考虑更一般的迭代公式kk k k k g H t X X -=+1其中步长tk 通过从Xk 出发沿Pk= -Hk gk 作直线搜索来确定.此式代表很广的一类迭代公式.例如,当Hk=I (单位矩阵)时,它变为最速下降法的迭代公式。

拟牛顿算法

拟牛顿算法是一种求解现代机器学习中复杂优化问题的数值解法,又称为增量式牛顿方法或增量算法。

拟牛顿算法是一种迭代优化算法,它是由美国物理学家Isaac Newton发明的牛顿法的改进版本,并被用于优化复杂的函数。

拟牛顿算法的主要思想是使用一组特定的校正器来更新牛顿法中的参数,从而实现更高效的迭代优化。

拟牛顿算法的基本原理是:拟牛顿算法从一个初始状态开始,通过迭代的方式,不断地更新参数,使目标函数最小化。

首先,使用梯度下降法确定一个起始状态,并计算出目标函数的梯度值,即梯度偏导数。

然后,根据牛顿法构建拟牛顿算法,即在更新参数时,使用牛顿法计算出增量向量,从而实现梯度下降,使目标函数尽可能小。

拟牛顿算法可以用于大多数优化问题,如拟合数据、优化机器学习模型等。

它与牛顿法的速度相比非常快速,大大提高了收敛速度,并具有更好的收敛性能。

另外,拟牛顿算法也可以方便地适用于正则化情况,使优化效率更高。

拟牛顿算法不仅可以用于优化机器学习模型,还可以用于一些复杂的优化问题,如现实世界中的优化问题,例如非线性系统优化、智能机器人的行为优化等。

与牛顿法相比,拟牛顿算法具有空间收敛性更强、更少的迭代次数和更快的收敛速度的优势。

拟牛顿算法的缺点也是显而易见的,它的计算量比传统的牛顿法大,而且它需要一些复杂的算法来更新参数,这也是它不能广泛应用的原因之一。

总而言之,拟牛顿算法是一种求解现代机器学习中复杂优化问题的有效数值解法,它具有高效率和更快的收敛速度的优势。

但是,由于它计算量大,需要较复杂的算法,因此不能广泛应用。

牛顿法拟牛顿法牛顿法是一种求解非线性方程的方法,其原理是在迭代中使用方程的导数来近似方程的根。

虽然牛顿法非常有效,但它往往需要非常精准的初始猜测才能保证收敛性。

另一种类似于牛顿法的方法是拟牛顿法,它可以通过逐步调整矩阵B来近似牛顿法的矩阵Hessian。

本文将介绍牛顿法和拟牛顿法的原理和应用。

一、牛顿法假设有一个n维非线性方程系统f(x)=0,其中x是一个n维向量。

牛顿法中的每个迭代都是通过以下公式来更新当前估计xk的:xk+1=xk-Hk^(-1)fk其中Hk是f(x)的Hessian矩阵在xk处的值,假设Hk是可逆的。

牛顿法的优点是它快速收敛,并且可以通过适当选择初始估计来实现收敛。

另一个好处是它可以直接用于求解大型系统,因为它只涉及二次导数的计算。

然而,牛顿法的缺点是它需要计算Hessian矩阵,这通常是一个费时且复杂的任务。

另一个问题是当Hessian矩阵的条件数(即最大特征值与最小特征值之比)很大时,牛顿法的收敛可能会变得很慢。

二、拟牛顿法拟牛顿法的思想是利用一个矩阵Bk来代替牛顿法中的Hk矩阵。

Bk是一个正定对称的矩阵,其初值通常为单位矩阵In。

在每个迭代中,Bk被更新为一个近似的Hessian逆矩阵。

最常用的拟牛顿法算法之一是BFGS算法,其更新规则如下:Bk+1=Bk+(yk^Tyk)/(yk^Ts)+(BkSkS^TBk)/(sk^TBksk)其中sk=xk+1-xk,yk=g(xk+1)-g(xk),g表示f的梯度,^T表示矩阵转置。

该公式是基于以下观察得出的:Bk+1应该满足以下性质:Bk+1是正定对称的。

Bk+1应该近似于Hk+1的逆,其应该满足以下方程:Bk+1sk=yk另外,BFGS算法的收敛速度也相对比牛顿法要慢,因为BFGS算法需要逐步修正矩阵Bk,直到其逼近Hessian矩阵的逆。

三、应用牛顿法和拟牛顿法在许多实际问题中应用广泛,特别是在数学、物理、金融和工程领域。

拟牛顿法算法步骤拟牛顿法(Quasi-Newton Method)是一种用于无约束优化问题的迭代算法。

它的主要思想是利用得到的函数值和梯度信息近似估计目标函数的Hessian矩阵,并利用这个估计值来进行迭代优化。

拟牛顿法的算法步骤如下:1.初始化参数:选择初始点$x_0$作为迭代起点,设定迭代停止准则和迭代次数上限。

2. 计算目标函数的梯度:计算当前点$x_k$处的梯度向量$g_k=\nabla f(x_k)$。

3. 计算方向:使用估计的Hessian矩阵$B_k$和负梯度$g_k$来计算方向$d_k=-B_k g_k$。

4. 一维:通过线方法(如Armijo准则、Wolfe准则等)选择一个合适的步长$\alpha_k$,使得函数在方向上有明显的下降。

5. 更新参数:根据步长$\alpha_k$更新参数$x_{k+1}=x_k+\alpha_k d_k$。

6. 计算目标函数的梯度差:计算新点$x_{k+1}$处的梯度向量$g_{k+1}=\nabla f(x_{k+1})$。

7. 更新Hessian矩阵估计:根据梯度差$g_{k+1}-g_k$和参数差$\Delta x_k=x_{k+1}-x_k$,利用拟牛顿公式来更新Hessian矩阵估计$B_{k+1}=B_k+\Delta B_k$。

8.更新迭代次数:将迭代次数$k$加一:$k=k+1$。

9.判断终止:如果满足终止准则(如梯度范数小于给定阈值、目标函数值的变化小于给定阈值等),则停止迭代;否则,返回步骤310.输出结果:输出找到的近似最优解$x^*$作为优化问题的解。

拟牛顿法有许多不同的变体,最经典和最常用的是DFP算法(Davidon-Fletcher-Powell Algorithm)和BFGS算法(Broyden-Fletcher-Goldfarb-Shanno Algorithm)。

这两种算法都是基于拟牛顿公式来更新Hessian矩阵估计的,但具体的公式和更新规则略有不同,因此会产生不同的数值性能。

DFP算法(Matlab编程解决)5个月前%拟牛顿法中DFP算法求解f = x1*x1+2*x2*x2-2*x1*x2-4*x1的最小值,起始点为x0=[1 1] H0为二阶单位阵syms x1 x2 alpha;f = x1*x1+2*x2*x2-2*x1*x2-4*x1; %要最小化的函数df=jacobian(f,[x1 x2]); %函数f的偏导epsilon=1e-6; %0.000001k=1;x0=[1 1]; %起始点xk=x0;gk=subs(df,[x1 x2],xk); %起始点的梯度%gk=double(gk);H0=[1 0;0 1]; %初始矩阵为二阶单位阵while(norm(gk)>epsilon) %迭代终止条件||gk||<=epsilonif k==1pk=-H0*gk'; %负梯度方向Hk0=H0; %HK0代表HK(k-1)elsepk=-Hk*gk';Hk0=Hk; %HK0代表HK(k-1)endf_alpha=subs(f,[x1 x2],xk+alpha*pk'); %关于alpha的函数[left right] = jintuifa(f_alpha,alpha); %进退法求下单峰区间[best_alpha best_f_alpha]=golddiv(f_alpha,alpha,left,right); %黄金分割法求最优步长xk=xk+best_alpha*pk';gk0=gk;%gk0代表g(k-1)gk=subs(df,[x1 x2],xk);%gk=double(gk);yk=gk-gk0;sk=best_alpha*pk';%sk=x(k+1)-xkHk=Hk0-Hk0*yk'*yk*Hk0/(yk*Hk0*yk')+sk'*sk/(yk*sk'); %修正公式k=k+1;endbest_x=xk %最优点best_fx=subs(f,[x1 x2],best_x) %最优值函数jintuifa.m golddiv.m 另外给出(/post/2012-05-12/17991115)转自:/dgglx热度0℃。

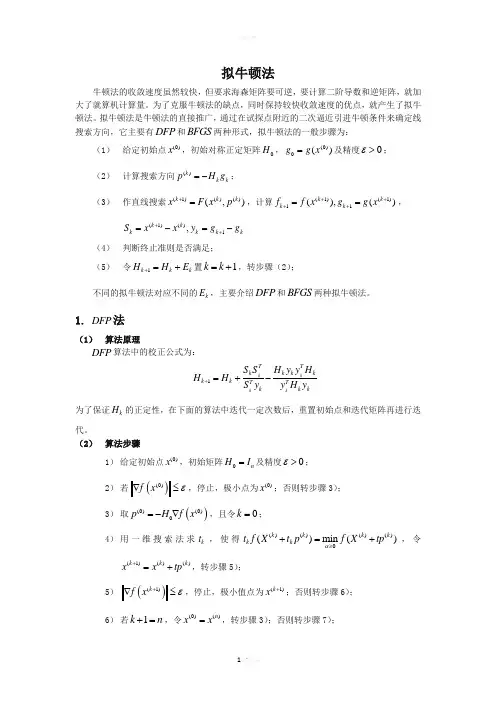

拟牛顿法牛顿法的收敛速度虽然较快,但要求海森矩阵要可逆,要计算二阶导数和逆矩阵,就加大了就算机计算量。

为了克服牛顿法的缺点,同时保持较快收敛速度的优点,就产生了拟牛顿法。

拟牛顿法是牛顿法的直接推广,通过在试探点附近的二次逼近引进牛顿条件来确定线搜索方向,它主要有DFP 和BFGS 两种形式,拟牛顿法的一般步骤为:(1) 给定初始点(0)x ,初始对称正定矩阵0H ,(0)0()g g x =及精度0ε>; (2) 计算搜索方向()k k k p H g =-;(3) 作直线搜索(1)()()(,)k k k xF x p +=,计算(1)(1)11(),()k k k k f f x g g x ++++==,(1)()1,k k k k k k S x x y g g ++=-=-(4) 判断终止准则是否满足;(5) 令1k k k H H E +=+置1k k =+,转步骤(2);不同的拟牛顿法对应不同的k E ,主要介绍DFP 和BFGS 两种拟牛顿法。

1. DFP 法(1) 算法原理DFP 算法中的校正公式为:1k kk kT T k k k kk k T T kk k S S H y y H H H S y y H y +=+-为了保证k H 的正定性,在下面的算法中迭代一定次数后,重置初始点和迭代矩阵再进行迭代。

(2) 算法步骤1) 给定初始点(0)x ,初始矩阵0n H I =及精度0ε>; 2) 若()(0)f xε∇≤,停止,极小点为(0)x ;否则转步骤3);3) 取()(0)(0)0p H f x =-∇,且令0k =; 4) 用一维搜索法求k t ,使得()()()()0()min ()k k k k k k t f Xt p f X tp α≥+=+,令(1)()()k k k x x tp +=+,转步骤5);5) ()(1)k f xε+∇≤,停止,极小值点为(1)k x +;否则转步骤6);6) 若1k n +=,令(0)()n x x =,转步骤3);否则转步骤7);7) 令()()()()()()()()()()()()()()()()()()(1)()(1)()1(1)()(1)()(1)()(1)()(1)()(1)()Tk k k k k k Tk k k k Tk k k k k kTk k k k kx x x x H H xx f x f x H f xf x f x f x H f x f x H f x f x +++++++++--=+-∇-∇∇-∇∇-∇-∇-∇∇-∇,取()()(1)1k k k p H f x ++=-∇,置1k k =+,转步骤4)。

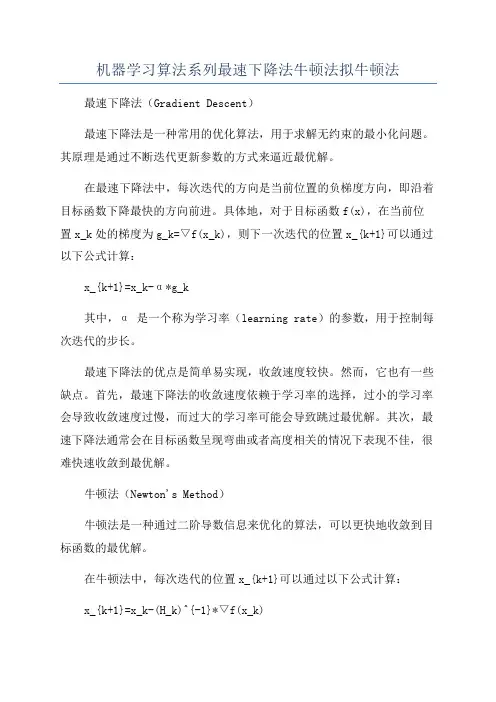

机器学习算法系列最速下降法牛顿法拟牛顿法最速下降法(Gradient Descent)最速下降法是一种常用的优化算法,用于求解无约束的最小化问题。

其原理是通过不断迭代更新参数的方式来逼近最优解。

在最速下降法中,每次迭代的方向是当前位置的负梯度方向,即沿着目标函数下降最快的方向前进。

具体地,对于目标函数f(x),在当前位置x_k处的梯度为g_k=▽f(x_k),则下一次迭代的位置x_{k+1}可以通过以下公式计算:x_{k+1}=x_k-α*g_k其中,α 是一个称为学习率(learning rate)的参数,用于控制每次迭代的步长。

最速下降法的优点是简单易实现,收敛速度较快。

然而,它也有一些缺点。

首先,最速下降法的收敛速度依赖于学习率的选择,过小的学习率会导致收敛速度过慢,而过大的学习率可能会导致跳过最优解。

其次,最速下降法通常会在目标函数呈现弯曲或者高度相关的情况下表现不佳,很难快速收敛到最优解。

牛顿法(Newton's Method)牛顿法是一种通过二阶导数信息来优化的算法,可以更快地收敛到目标函数的最优解。

在牛顿法中,每次迭代的位置x_{k+1}可以通过以下公式计算:x_{k+1}=x_k-(H_k)^{-1}*▽f(x_k)其中,H_k是目标函数f(x)在当前位置x_k处的黑塞矩阵。

黑塞矩阵描述了目标函数的二阶导数信息,可以帮助更准确地估计参数的更新方向。

牛顿法的优点是收敛速度较快,特别是对于目标函数呈现弯曲或者高度相关的情况下,相较于最速下降法可以更快地达到最优解。

然而,牛顿法也有一些缺点。

首先,计算黑塞矩阵的代价较高,尤其是当参数较多时。

其次,黑塞矩阵可能不可逆或者计算代价较大,这时可以通过使用拟牛顿法来避免。

拟牛顿法(Quasi-Newton Method)拟牛顿法是一类基于牛顿法的优化算法,通过估计黑塞矩阵的逆来逼近最优解,从而避免了计算黑塞矩阵的代价较高的问题。

在拟牛顿法中,每次迭代的位置x_{k+1}可以通过以下公式计算:x_{k+1}=x_k-B_k*▽f(x_k)其中,B_k是一个对黑塞矩阵逆的估计。

•主页•专栏作家•量化基础理论•软件使用经验•量化软件•资源导航•资料下载•量化论坛搜索搜索用户登录用户名:*密码:*登录•创建新帐号•重设密码首页拟牛顿法及相关讨论星期三, 2009-06-17 00:24 —satchel1979使用导数的最优化算法中,拟牛顿法是目前为止最为行之有效的一种算法,具有收敛速度快、算法稳定性强、编写程序容易等优点。

在现今的大型计算程序中有着广泛的应用。

本文试图介绍拟牛顿法的基础理论和若干进展。

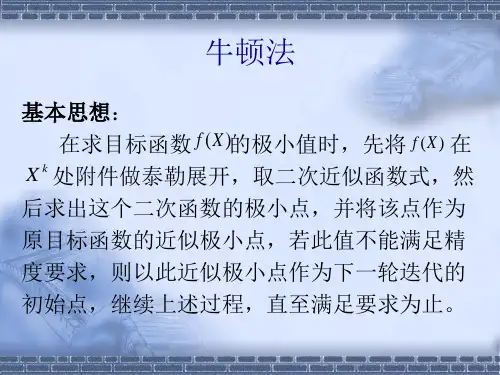

牛顿法(Newton Method)牛顿法的基本思想是在极小点附近通过对目标函数做二阶Taylor展开,进而找到的极小点的估计值[1]。

一维情况下,也即令函数为则其导数满足因此(1)将作为极小点的一个进一步的估计值。

重复上述过程,可以产生一系列的极小点估值集合。

一定条件下,这个极小点序列收敛于的极值点。

将上述讨论扩展到维空间,类似的,对于维函数有其中和分别是目标函数的的一阶和二阶导数,表现为维向量和矩阵,而后者又称为目标函数在处的Hesse矩阵。

设可逆,则可得与方程(1)类似的迭代公式:(2)这就是原始牛顿法的迭代公式。

原始牛顿法虽然具有二次终止性(即用于二次凸函数时,经有限次迭代必达极小点),但是要求初始点需要尽量靠近极小点,否则有可能不收敛。

因此人们又提出了阻尼牛顿法[1]。

这种方法在算法形式上等同于所有流行的优化方法,即确定搜索方向,再沿此方向进行一维搜索,找出该方向上的极小点,然后在该点处重新确定搜索方向,重复上述过程,直至函数梯度小于预设判据。

具体步骤列为算法1。

算法1:(1) 给定初始点,设定收敛判据,.(2) 计算和.(3) 若< ,则停止迭代,否则确定搜索方向.(4) 从出发,沿做一维搜索,令.(5) 设,转步骤(2).在一定程度上,阻尼牛顿法具有更强的稳定性。

拟牛顿法(Quasi-Newton Method)如同上一节指出,牛顿法虽然收敛速度快,但是计算过程中需要计算目标函数的二阶偏导数,难度较大。

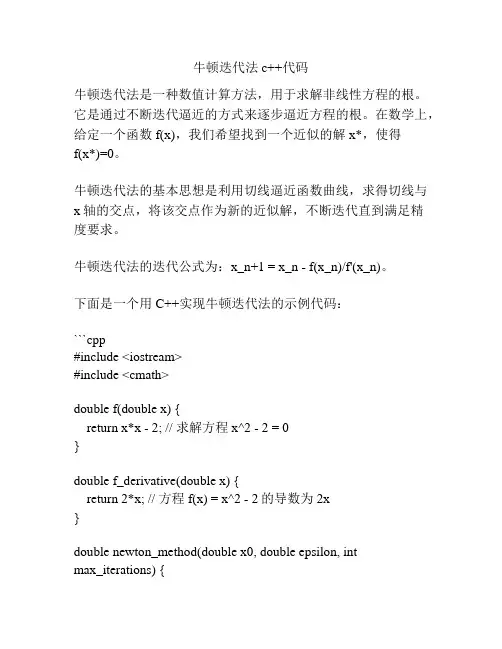

牛顿迭代法c++代码牛顿迭代法是一种数值计算方法,用于求解非线性方程的根。

它是通过不断迭代逼近的方式来逐步逼近方程的根。

在数学上,给定一个函数f(x),我们希望找到一个近似的解x*,使得f(x*)=0。

牛顿迭代法的基本思想是利用切线逼近函数曲线,求得切线与x轴的交点,将该交点作为新的近似解,不断迭代直到满足精度要求。

牛顿迭代法的迭代公式为:x_n+1 = x_n - f(x_n)/f'(x_n)。

下面是一个用C++实现牛顿迭代法的示例代码:```cpp#include <iostream>#include <cmath>double f(double x) {return x*x - 2; // 求解方程x^2 - 2 = 0}double f_derivative(double x) {return 2*x; // 方程f(x) = x^2 - 2的导数为2x}double newton_method(double x0, double epsilon, intmax_iterations) {double x = x0;int iteration = 0;while (iteration < max_iterations) {double fx = f(x);double f_derivative_x = f_derivative(x);if (std::abs(fx) < epsilon) {std::cout << "Found solution: x = " << x << std::endl;return x;}if (std::abs(f_derivative_x) < epsilon) {std::cout << "Derivative is close to zero. Exiting." << std::endl;return std::numeric_limits<double>::quiet_NaN(); // 返回NaN表示迭代失败}x = x - fx/f_derivative_x;++iteration;}std::cout << "Maximum iterations reached. Exiting." << std::endl;return std::numeric_limits<double>::quiet_NaN(); // 返回NaN 表示迭代失败}int main() {double x0 = 1.0; // 初始值double epsilon = 1e-6; // 精度要求int max_iterations = 1000; // 最大迭代次数double root = newton_method(x0, epsilon, max_iterations);return 0;}```以上代码中,我们定义了两个函数f(x)和f_derivative(x),分别表示了要求解的非线性方程和该方程的导数。

dfp变尺度法

DFP变尺度法(Davidon-Fletcher-Powell变尺度法)是一种拟牛顿优化算法,用于求解无约束极值问题它综合了梯度法和牛顿法的优点,具有较快的收敛速度和较广的应用范围DFP算法在优化领域中被认为是一种高效的方法,尤其在处理高维问题时具有显著优势。

DFP变尺度法的基本思想是在每次迭代中,用一组线性方程组来近似表示目标函数的Hessian矩阵这样,我们可以用较少的计算代价获得牛顿法类似的收敛速度变尺度法的关键在于选择合适的尺度矩阵,以保证算法的收敛性和稳定性。

DFP算法的步骤如下。

1.初始化:选择一个初始点x0.

2.计算目标函数的梯度g(x)。

f(x)=f(x0)+γ(x-x0).

其中,γ为尺度因子

3.计算Hessian矩阵的近似值H

H=I-γ²g²(x).

4.更新搜索方向。

s=-Hg(x).

5.更新x。

x=x0+αs.

其中,α为线搜索参数。

6.重复步骤2-5,直到满足终止条件(如收敛或达到迭代次数限制)。

DFP变尺度法在实际应用中通常与一维搜索技术和黄金分割法相结合,以提高收敛速度和稳定性此外,还可以根据问题特点对算法进行适当调整,如引入局部搜索、调整线搜索策略等,以适应不同问题的需求总之,DFP变尺度法是一种高效、实用的优化算法,在许多领域都得到了广泛应用。

牛顿法代码函数牛顿法(Newton's method)是一种求解函数极值(包括最大值和最小值)的数值方法。

以下是使用Python实现的牛顿法代码示例:```pythonimport numpy as npdef func(x):# 这里替换为你的目标函数,例如:f(x) = x^3 - 6x^2 + 9return x**3 - 6 * x**2 + 9def dfunc(x):# 这里替换为你的目标函数的一阶导数,例如:f'(x) = 3x^2 - 12x return 3 * x**2 - 12 * xdef newton_method(x0, tol=1e-6, max_iter=100):x = x0iteration = 0while True:iteration += 1x_new = x - func(x) / dfunc(x)if np.linalg.norm(x_new - x) < tol:breakx = x_newreturn x, iterationif __name__ == "__main__":x0 = np.array([1.0]) # 初始化参数向量tolerance = 1e-6 # 误差容限max_iter = 100 # 最大迭代次数x_opt, iterations = newton_method(x0, tolerance, max_iter)print("优化后的参数向量:", x_opt)print("迭代次数:", iterations)```在这个示例中,我们定义了一个名为`newton_method`的函数,它接受初始参数向量`x0`、误差容限`tol`和最大迭代次数`max_iter`作为输入。

该函数使用牛顿法迭代求解目标函数的极值。

在`__main__`部分,我们初始化一个示例目标函数(三次多项式)及其一阶导数,然后调用`newton_method`函数求解极值。

dfp方法DFP方法DFP方法(Dual Feasible Directions)是一种优化算法,用于求解线性规划问题。

它是一种迭代的方法,通过不断更新可行解和对偶变量来逼近最优解。

DFP方法的核心思想是在每一步迭代中,同时更新可行解和对偶变量,以找到使目标函数达到最小化的最优解。

我们需要了解线性规划问题的基本形式。

线性规划问题可以表示为:```minimize c^T xsubject to Ax ≤ bx ≥ 0```其中,c是目标函数的系数向量,x是决策变量向量,A是约束矩阵,b是约束向量。

DFP方法通过迭代更新决策变量向量x和对偶变量向量y来逼近最优解。

DFP方法的迭代步骤如下:1. 初始化决策变量向量x和对偶变量向量y;2. 计算当前迭代点的梯度向量g和对偶梯度向量h;3. 判断当前解是否满足可行性条件,即判断是否存在满足Ax ≤ b和x ≥ 0的解;4. 如果当前解满足可行性条件,则判断是否达到最优解,即判断梯度向量g是否为零向量。

如果梯度向量g为零向量,则当前解是最优解,算法终止。

如果梯度向量g不为零向量,则计算搜索方向向量d;5. 如果当前解不满足可行性条件,则计算对偶可行方向向量d;6. 更新决策变量向量x和对偶变量向量y;7. 返回第2步,继续迭代。

在DFP方法中,搜索方向向量d的计算是关键步骤。

搜索方向向量d可以通过求解一个线性方程组来得到。

线性方程组的求解可以使用各种数值方法,如LU分解、共轭梯度法等。

DFP方法的优点是收敛速度快,尤其适用于大规模线性规划问题。

它能够在有限次迭代后,找到最优解或者接近最优解。

此外,DFP 方法还可以处理具有非线性目标函数的优化问题。

然而,DFP方法也存在一些限制和局限性。

首先,DFP方法要求目标函数和约束条件都是线性的。

如果目标函数或约束条件具有非线性特性,DFP方法可能无法找到最优解。

其次,DFP方法对初始解的选择较为敏感,不同的初始解可能导致不同的结果。

拟牛顿法公式拟牛顿法是一种求解非线性方程的迭代算法,它通过逼近问题的局部线性模型来逼近方程的解。

拟牛顿法公式是该算法的核心表达式,用于更新迭代解的数值。

下面将对拟牛顿法公式进行详细介绍。

拟牛顿法公式的一般形式为:x(k+1) = x(k) - [H(k)]^(-1) * g(k)其中,x(k)表示第k次迭代的解向量,x(k+1)表示第k+1次迭代的解向量,g(k)表示第k次迭代的梯度向量,H(k)表示第k次迭代的拟牛顿矩阵。

拟牛顿法的关键是如何选择拟牛顿矩阵H。

常用的拟牛顿法有DFP 方法和BFGS方法。

这两种方法都是基于满足拟牛顿条件的逆Hessian矩阵的递推公式。

DFP方法的递推公式为:H(k+1) = H(k) + (s(k) * s(k)') / (s(k)' * y(k)) - (H(k) * y(k) * y(k)' * H(k)) / (y(k)' * H(k) * y(k))BFGS方法的递推公式为:H(k+1) = H(k) + (1 + (y(k)' * H(k) * y(k)) / (y(k)' * s(k)))* (s(k) * s(k)') / (y(k)' * s(k)) - (H(k) * y(k) * s(k)' - s(k) * y(k)' * H(k)) / (y(k)' * s(k))其中,s(k) = x(k+1) - x(k)表示迭代解的变化量,y(k) = g(k+1) - g(k)表示梯度的变化量。

通过不断迭代,拟牛顿法可以逐步逼近非线性方程的解。

每次迭代,根据拟牛顿法公式更新解向量,直到达到收敛条件为止。

收敛条件可以是解向量的变化量小于某个预设阈值,或者目标函数的梯度小于某个预设阈值。

需要注意的是,拟牛顿法并不一定能够收敛到全局最优解,而是局部最优解。

因此,在实际应用中,我们需要结合问题的特点选择合适的初值和拟牛顿矩阵的初始估计,以提高算法的收敛性和求解精度。

拟牛顿法(变尺度法)DFP算法的c/c++源码#include "iostream.h"#include "math.h"void comput_grad(double (*pf)(double *x), int n, double *point, double *grad); //计算梯度double line_search1(double (*pf)(double *x), int n, double *start, double*direction); //0.618法线搜索double line_search(double (*pf)(double *x), int n, double *start, double*direction); //解析法线搜索double DFP(double (*pf)(double *x), int n, double *min_point); //无约束变尺度法//梯度计算模块//参数:指向目标函数的指针,变量个数,求梯度的点,结果void comput_grad(double (*pf)(double *x),int n,double *point,double *grad){double h=1E-3;int i;double *temp;temp = new double[n];for(i=1;i<=n;i++){temp[i-1]=point[i-1];}for(i=1;i<=n;i++){temp[i-1]+=0.5*h;grad[i-1]=4*pf(temp)/(3*h);temp[i-1]-=h;grad[i-1]-=4*pf(temp)/(3*h);temp[i-1]+=(3*h/2);grad[i-1]-=(pf(temp)/(6*h));temp[i-1]-=(2*h);grad[i-1]+=(pf(temp)/(6*h));temp[i-1]=point[i-1];}delete[] temp;}//一维搜索模块//参数:指向目标函数的指针,变量个数,出发点,搜索方向//返回:最优步长double line_search(double (*pf)(double *x),int n,double *start,double *direction){int i;double step=0.001;double a=0,value_a,diver_a;double b,value_b,diver_b;double t,value_t,diver_t;double s,z,w;double *grad,*temp_point;grad=new double[n];temp_point=new double[n];comput_grad(pf,n,start,grad);diver_a=0;for(i=1;i<=n;i++)diver_a=diver_a+grad[i-1]*direction[i-1];do{b=a+step;for(i=1;i<=n;i++)temp_point[i-1]=start[i-1]+b*direction[i-1]; comput_grad(pf,n,temp_point,grad);diver_b=0;for(i=1;i<=n;i++)diver_b=diver_b+grad[i-1]*direction[i-1];if( fabs(diver_b)<1E-10 ){delete[] grad;delete[] temp_point;return(b);}if( diver_b<-1E-15 ){a=b;diver_a=diver_b;step=2*step;}}while( diver_b<=1E-15 );for(i=1;i<=n;i++)temp_point[i-1]=start[i-1]+a*direction[i-1];value_a=(*pf)(temp_point);for(i=1;i<=n;i++)temp_point[i-1]=start[i-1]+b*direction[i-1];value_b=(*pf)(temp_point);do{s=3*(value_b-value_a)/(b-a);z=s-diver_a-diver_b;w=sqrt( fabs(z*z-diver_a*diver_b) ); //////////////////!!!!!!!!!!!!!!!!!!!!!!t=a+(w-z-diver_a)*(b-a)/(diver_b-diver_a+2*w);value_b=(*pf)(temp_point);for(i=1;i<=n;i++)temp_point[i-1]=start[i-1]+t*direction[i-1];value_t=(*pf)(temp_point);comput_grad(pf,n,temp_point,grad);diver_t=0;for(i=1;i<=n;i++)diver_t=diver_t+grad[i-1]*direction[i-1];if(diver_t>1E-6){b=t;value_b=value_t;diver_b=diver_t;}else if(diver_t<-1E-6){a=t;value_a=value_t;diver_a=diver_t;}else break;}while( (fabs(diver_t)>=1E-6) && (fabs(b-a)>1E-6) );delete[] grad;delete[] temp_point;return(t);}//无约束变尺度法DFP函数声明////参数:pf指向目标函数的指针,n变量个数,min_point接受初始点、存放结果//返回:极小点处函数值//double DFP(double (*pf)(double *x),int n,double *min_point){int i,j;int k=0;double e=1E-5;double g_norm;double *g0=new double[n]; //梯度double *g1=new double[n];double *dg=new double[n];double *p=new double[n]; //搜索方向 =-gdouble t; //一维搜索步长double *x0=new double[n];double *x1=new double[n];double *dx=new double[n];double **H=new double*[n];for (i=0; i<n; i++) H[i] = new double[n];double **tempH=new double*[n];for (i=0; i<n; i++) tempH[i] = new double[n];double *gH=new double[n];double *Hg=new double[n];double num1;double num2;for(i=0;i<n;i++)for(j=0;j<n;j++){if(i==j) H[i][j]=1.0; // H0=Ielse H[i][j]=0.0;tempH[i][j]=0.0;}for(i=0;i<n;i++)x0[i]=min_point[i];comput_grad(pf,n,x0,g0);g_norm=0.0;for(i=0;i<n;i++) g_norm=g_norm+g0[i]*g0[i];g_norm=sqrt(g_norm);if (g_norm<e){for(i=0;i<n;i++) min_point[i]=x0[i];delete[] g0;delete[] g1;delete[] dg;delete[] p;delete[] x0;delete[] x1;delete[] dx;for (i=0; i<n; i++) delete[] H[i];delete []H;for (i=0; i<n; i++) delete[] tempH[i];delete []tempH;delete[] gH;delete[] Hg;return pf(min_point);}for(i=0;i<n;i++) p[i]=-g0[i];do{t=line_search(pf,n,x0,p); for(i=0;i<n;i++) x1[i]=x0[i]+t*p[i];comput_grad(pf,n,x1,g1);g_norm=0.0;for(i=0;i<n;i++) g_norm=g_norm+g1[i]*g1[i];g_norm=sqrt(g_norm);//cout<<k<<" "<<x0[0]<<" "<<x0[1]<<" "<<g_norm<<"\n";if (g_norm<e){for(i=0;i<n;i++) min_point[i]=x1[i];delete[] g0;delete[] g1;delete[] dg;delete[] p;delete[] x0;delete[] x1;delete[] dx;for (i=0; i<n; i++) delete[] H[i];delete []H;for (i=0; i<n; i++) delete[] tempH[i];delete []tempH;delete[] gH;delete[] Hg;return pf(min_point);}for(i=0;i<n;i++){dx[i]=x1[i]-x0[i];dg[i]=g1[i]-g0[i];}//////////////////求Hk+1的矩阵运算//g*H,H*gfor(i=0;i<n;i++){gH[i]=0.0;Hg[i]=0.0;}for(i=0;i<n;i++){for(j=0;j<n;j++){gH[i]=gH[i]+dg[j]*H[j][i];//Hg[i]=Hg[i]+H[i][j]*dg[j];Hg[i]=gH[i];}}//num1,num2num1=0.0;num2=0.0;for(i=0;i<n;i++){num1=num1+dx[i]*dg[i];num2=num2+gH[i]*dg[i];}//tempH[i][j]for(i=0;i<n;i++)for(j=0;j<n;j++)tempH[i][j]=0.0;for(i=0;i<n;i++){for(j=0;j<n;j++){tempH[i][j]=tempH[i][j]+H[i][j];tempH[i][j]=tempH[i][j]+dx[i]*dx[j]/num1; tempH[i][j]=tempH[i][j]-Hg[i]*gH[j]/num2; }}for(i=0;i<n;i++){for(j=0;j<n;j++){H[i][j]=tempH[i][j];}}///////////////////////////////Pfor(i=0;i<n;i++) p[i]=0.0;for(i=0;i<n;i++){for(j=0;j<n;j++){p[i]=p[i]-H[i][j]*g1[j];}}for(i=0;i<n;i++){g0[i]=g1[i];x0[i]=x1[i];}k=k+1;}while(g_norm>e);for(i=0;i<n;i++) min_point[i]=x1[i];delete[] g0;delete[] g1;delete[] dg;delete[] p;delete[] x0;delete[] x1;delete[] dx;for (i=0; i<n; i++) delete[] H[i];delete []H;for (i=0; i<n; i++) delete[] tempH[i];delete []tempH;delete[] gH;delete[] Hg;return pf(min_point);}/////////////double fun(double *x){return 100*( x[1]-x[0]*x[0] )*( x[1]-x[0]*x[0] ) + (1-x[0])*(1-x[0]); }void main(){int n=2;double min_point[2]={-5,10};double min_value=DFP(fun,n,min_point);cout<<min_point[0]<<" and "<<min_point[1]<<" "<<min_value;}//0.618法线搜索////参数:指向目标函数的指针,变量个数,出发点,搜索方向//返回:最优步长//double line_search1(double (*pf)(double *x),int n,double *start,double *direction){int i;int k;double l,a,b,c,u,lamda,t,e;double *xa=new double[n];double *xb=new double[n];double *xc=new double[n];double *xl=new double[n];double *xu=new double[n];//确定初始搜索区间l=0.001;a=0;k=0;do{k++;c=a+l;for(i=0;i<n;i++){xc[i]=start[i]+c*direction[i];xa[i]=start[i]+a*direction[i];}l=l/3;}while( pf(xc) >= pf(xa) ); // ???k=0;do{k++;l=2*l;b=c+l;for(i=0;i<n;i++){xc[i]=start[i]+c*direction[i]; xb[i]=start[i]+b*direction[i]; }a=c;c=b;}while( pf(xb) <= pf(xc) );a=0;b=0.1;//寻优t=0.618;e=0.000001;lamda=b-t*(b-a);u=a+t*(b-a);for(i=0;i<n;i++){xl[i]=start[i]+lamda*direction[i];xu[i]=start[i]+u*direction[i];}k=0;do{k++;if( pf(xl)<pf(xu) ){b=u;u=lamda;lamda=b-t*(b-a);}else{a=lamda;lamda=u;u=t*(b-a);}}while( b-a>=e ); lamda=(a+b)/2;delete[] xa;delete[] xb;delete[] xc;delete[] xl;delete[] xu;return lamda ;}。