第八章-特征选择与提取

- 格式:pptx

- 大小:2.42 MB

- 文档页数:73

特征的提取和选择

特征提取和选择是机器学习中非常重要的环节,它既可以减少计算量,又可以提高模型的性能。

选择较好的特征可以让模型更加简单,更加容易

和快速的训练出最佳参数,从而使得模型更加精确、效果更好。

一般来说,特征提取和选择有以下几步:

1.特征提取。

特征提取关注的是利用现有特征生成新的特征。

它可以

是特征融合(如结合多个特征生成更强大的特征),也可以是特征变换

(如离散特征变换成连续特征)。

2.无关特征删除。

把没有帮助的特征删除,有助于减少模型的运行时间,提高模型的效果。

3.有关特征选择。

把与目标值有很强关联的特征选择出来,这些特征

被称为有关特征,它们可以帮助模型训练出更好的结果。

4.特征降维。

为了减少特征之间的相关性,减少计算量,与有关特征

相关性比较低的特征可以被删除。

5.特征加权。

调整特征的权重,使得有关特征拥有更大的影响力,从

而帮助模型更好的进行预测。

通过这种特征提取和选择的过程,可以把训练集中拥有相关性比较高

的有用特征保留下来,把没用的特征抛弃,有效的提高模型的性能。

分类:根据对象的观察值确定对象的类别属性。

分类的一般过程:特征的发现与提取(特征提取的好坏将直接影响到分类的结果。

特征选取的原则包括:明显有区分意义(同一类别样本的特征值比较相近,而不同类别的样本特征值有较显著的差异);容易提取;对不相关因素变化保持稳定;对噪声不敏感等);确定决策函数特征发现:将先验知识和实验数据有机结合起来,通过对学习样本(实验数据)的分析,发现并提取有效的特征。

•根据特定的问题领域(包括实验数据)的性质,提出可能特征的假设•利用已有的实验数据,验证假设是否正确特征处理:在已经得到数据样本之后如何用数学的办法对数据进行必要的选择和变换使得特征更易于分类,求出一组对分类最有效的特征1.高维特征带来的问题实际应用中,通常发现当特征个数增加到某一个临界点后,继续增加反而会导致分类器的性能变差。

1)概率模型与实际情况不匹配2)训练样本数有限→概率分布的估计不准确3)训练样本数有限→过拟合4)训练过程中的计算复杂度、时间-空间复杂度太大。

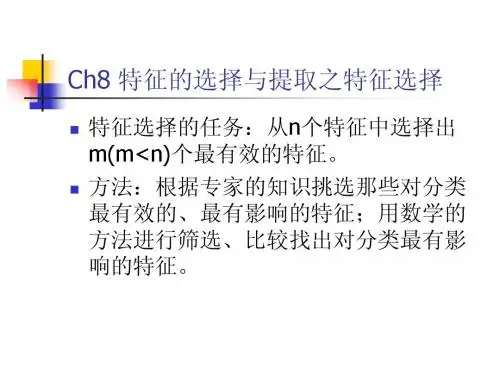

2.特征选择:1)概念:特征选择是从数量为D的原始特征中挑选出一组(d个)最有代表性,分类性能最好的特征;每个特征的状态是离散的-选与不选;从N个特征中选取k个,共C N k种组合;若不限定个数,则共2N种;这是一个典型的组合优化问题。

(思路)2)方法:Filter方法:不考虑所使用的学习算法。

通常给出一个独立于分类器的指标μ(可分离性判据)来评价所选择的特征子集S,然后在所有可能的特征子集中搜索出使得μ最大的特征子集作为最优特征子集;Wrapper方法:将特征选择和分类器结合在一起,即特征子集的好坏标准是由分类器决定的,在学习过程中表现优异的特征子集被选中;另外,按照最优特征组的构成可以分为“自下而上”法(特征数从0渐增)和“自上而下”法(特征数从D递减)。

3)可分离性判据:衡量特征对分类的有效性(关键问题)要求:A.与错误概率(或者错误概率的上界及下界)有单调关系,一般使判据取最大值时对应较小错误概率B.当特征(x1, x2, …, xd)相互独立时有可加性,即:;其中Jij是第i类和第j类的可分性准则函数。

特征提取与特征选择的区别与联系在机器学习和数据挖掘领域,特征提取和特征选择是两个重要的概念。

它们在数据预处理和模型构建中起着至关重要的作用。

本文将探讨特征提取与特征选择的区别与联系,并从理论和实践角度进行深入分析。

1. 特征提取的定义与意义首先,我们来看看特征提取的定义与意义。

特征提取是指从原始数据中提取出具有代表性的特征,以便进行后续的数据分析和建模。

在实际应用中,原始数据往往包含大量的冗余信息和噪声,特征提取的目的就是通过某种算法或方法,对原始数据进行转换或映射,得到更加有用和有效的特征表示。

这样可以提高模型的准确性和泛化能力,同时减少计算复杂度和存储空间的消耗。

特征提取的方法有很多种,比如主成分分析(PCA)、独立成分分析(ICA)、线性判别分析(LDA)等。

这些方法都是通过对原始数据进行变换,得到新的特征表示,从而达到降维、去噪或增强特征的目的。

2. 特征选择的定义与意义接下来,我们再来看看特征选择的定义与意义。

特征选择是指从原始特征中选择出最具有代表性和重要性的特征子集,以用于后续的建模和预测。

在实际应用中,原始特征往往包含很多冗余和无关的信息,特征选择的目的就是找出对目标变量影响最大的特征,从而简化模型、提高预测性能和可解释性。

特征选择的方法有很多种,比如过滤式、包裹式和嵌入式等。

过滤式方法是直接对特征进行评估和排序,选择最高分的特征子集;包裹式方法是把特征选择看作一个搜索问题,通过试验不同的特征子集来找到最佳组合;嵌入式方法则是在模型训练过程中,通过正则化或增加惩罚项的方式来选择特征。

3. 特征提取与特征选择的区别特征提取与特征选择虽然都是对原始数据或特征进行处理,但它们在目的和方法上有着明显的区别。

首先,特征提取是通过某种变换或映射,得到新的特征表示,目的是降维、去噪或增强特征;而特征选择是从原始特征中选择出最具有代表性和重要性的特征子集,目的是简化模型、提高预测性能和可解释性。

第八讲特征提取和特征选择一、基本概念1、特征的生成(1)原始特征的采集和转换通过对原始特征的信号采集,获得样本的原始表达数据,从原始数据中选择或计算出对分类任务有用的原始特征,并转换成可用的形式原始数据:像素点RGB值矩阵可用的原始特征:轮廓特征颜色特征纹理特征数学特征(2)有效特征的生成目的:降低特征维数,减少信息冗余提升特征的有效性方法:特征提取:提高特征对类别的分辨能力特征选择:寻找对分类最重要的特征 2、 特征提取通过某种变换,将原始特征从高维空间映射到低维空间。

A :X →Y ; A 为特征提取器,通常是某种正交变换。

最优特征提取:J(A*)=max J(A), J 是准则函数3、 特征选择从一组特征中挑选出一些最有效的特征,以达到降低特征空间维数的目的。

Dd d i S y y y y F x x x S i d D <=∈→;,...,2,1,},......,,{:},......,,{:2121原始特征集合S 中包含D 个特征,目标特征集合F 中包含d 个特征;最优特征选择:J(F*)=max J(F), J 是准则函数 4、 准则函数的选取(1) 准则函数的选取原则分类正确率是最佳的特征提取和特征选择准则函数,但难以计算。

实用的类别可分性准则函数应满足以下要求:与分类正确率有单调递增关系当特征独立时具有可加性:∑==dk kijd ij x J x x x J 1)()...21,,,(具有标量测度特性:⎪⎩⎪⎨⎧===≠>ji ij ij ij J J j i J j i J 时,当时,当00对特征具单调性:)...)...12121+,,,,(,,,(ddijdij xxxxJxxxJ<(2)类内类间距离是各类的先验概率。

,中的样本数,为中的样本数,为),(:值,称为类内类间距离向量之间的距离的平均离,则各类中各特征)为这两个向量间的距,(特征向量,维类中的类及分别为,类,令设一个分类问题共有定义:jijjiinknljlikci jicjjidjlikjijlikPPnnxxnnPPxJxxxxai jωωδδωω∑∑∑∑=====1111121)()()()()()()(Dc.例:∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑================⨯⨯⨯⨯⨯⨯⨯⨯========2121222221311212312121213131111111212121211111221213212123121331211212340602121k l l k k l l k k l l k k l l k n k n l j l i k i ji j jid n k n l j l i k c i ji cj jid x xP P x xP P x x P P x x P P x x n n P P x J n n P P c x x n n P P x J ijij),(+),(+),(+),(),(),()()()()()()()()()()()()()(,,.,.,)(δδδδδδ对于随机性统计分类,类内类间距离和分类错误率不相关 b.类内类间距离的分解()()()()()()()()m m m mn P m xm xn P m m m m m x m x n P x J mP m m x m i m x x x x x x i Tici ii n k i i kTii kic i in k i Ti i i kTii kici i d ci ii n k i k n i i j l i k j l i k j l i k iiii--+--=⎥⎥⎦⎤⎢⎢⎣⎡--+--===∑∑∑∑∑∑∑=======11111111111)()()()()()()(T )()()()( )( : 则总均值向量:表示所有各类样本集的用类样本集的均值向量表示第用)-()-)=(,(则有的距离,度量两个特征向量之间如采用均方欧氏距离来δ()()()()()bw b w b w d Ti ic i ib n k Tii kii kici iw J J S tr S tr S S tr x J m m m mP S m x m x n P S i+=+=+=--=--=∑∑∑===)()( )( )()(则间离散度矩阵分别为令类内离散度矩阵和类1111Jw 称为类内平均距离,Jb 称为是类间平均距离从类别可分性的要求来看,希望Jw 尽可能小, Jb 尽可能大 (3) 概率距离类间的概率距离可用分布函数之间的距离来度量完全可分:若p(x|ω1) ≠0时, p(x|ω2)=0;完全不可分:对任意x ,都有 p(x|ω1) = p(x|ω2);性的概率距离度量则可作为两类之间可分;为、当两类完全不可分是取得最大值;、当两类完全可分时;、满足以下条件:若任何函数0c b 0a ],),|(),|([)(p p p p J J J dx P P x p x p g J ≥=∙⎰2121ωω二、 使用类内类间距离进行特征提取1、 准则函数的构造:类内类间距离为:Jd=Jw+Jb =tr (Sw +Sb)其中Jw 是类内平均距离,Jb 是类间平均距离通常给定一个训练集后,Jd 是固定的,在特征提取时,需要加大Jb ,减小Jw ,来获得满意的分类效果。

第五章 特征选择与特征提取5.1 问题的提出前面主要介绍的是各种分类器的设计方法,实际上我们已经完全可以解决模式识别的问题了。

然而在实际应用中,在分类器设计之前,往往需要对抽取出的特征进行一下处理,争取尽量减小特征的维数。

在实践中我们发现,特征的维数越大,分类器设计的难度也越大,一维特征的识别问题最容易解决,我们只要找到一个阈值t ,大于t 的为一类,小于t 的为一类。

同时特征维数越大,要求的训练样本数量越多,例如在一维的情况下,10个训练样本就可以比较好的代表一个类别了,而在10维空间中,10个训练样本则是远远不够的。

这一章中我们就来介绍一下减小特征维数的方法。

一般来说模式识别系统的输入是传感器对实物或过程进行测量所得到的一些数据,其中有一些数据直接可以作为特征,有一些数据经过处理之后可以作为特征,这样的一组特征一般称为原始特征。

在原始特征中并不一定每个特征都是有用的,比如在识别苹果和橙子的系统中,我们可以抽取出的特征很多,(体积,重量,颜色,高度,宽度,最宽处高度),同样还有可能抽取出其它更多的特征。

在这些特征中对分类有用的是(颜色,高度,最宽处高度),其它特征对识别意义不大,应该去除掉。

这样的过程称为是特征选择,也可以称为是特征压缩。

特征选择可以描述成这样一个过程,原始特征为N 维特征()12,,,TN x x x =X ,从中选择出M 个特征构成新的特征矢量()11,,,MTi i i Y x x x =,M N <。

同时,特征矢量的每一个分量并不一定是独立的,它们之间可能具有一定的相关性,比如说高度和最宽处的高度,高度值越大,最宽处的高度值也越大,它们之间具有相关性,我们可以通过一定的变换消除掉这种相关性,比如取一个比值:最宽处的高度/高度。

这样的过程称为特征提取。

特征提取可以描述为这样一个过程,对特征矢量()12,,,TN x x x =X 施行变换:()i i y h =X ,1,2,,i M =,M N <,产生出降维的特征矢量()12,,,TM Y y y y =。

模式类别的可分性判据在讨论特征选择和特征压缩之前,我们先要确定一个选择和提取的原则。

对一个原始特征来说,特征选择的方案很多,从N维特征种选择出M个特征共有c M 巳中选法,其中哪一种方案最佳,M !(N _M y则需要有一个原则来进行指导。

同样,特征的压缩实际上是要找到M 个N元函数,N元函数的数量是不可数的,这也要有一个原则来指导找出M个最佳的N元函数。

我们进行特征选择和特征提取的最终目的还是要进行识别,因此应该是以对识别最有利原则,这样的原则我们称为是类别的可分性判据。

用这样的可分性判据可以度量当前特征维数下类别样本的可分性。

可分性越大,对识别越有利,可分性越小,对识别越不利。

人们对的特征的可分性判据研究很多,然而到目前为止还没有取得一个完全满意的结果,没有哪一个判据能够完全度量出类别的可分性。

下面介绍几种常用的判据,我们需要根据实际问题,从中选择出一种。

般来说,我们希望可分性判据满足以下几个条件:1.与识别的错误率由直接的联系,当判据取最大值时,识别的错误率最小;2.当特征独立时有可加性,即:NX N二' J ij X kk 二J ij 是第i 类和第j 类的可分性判据,J ij 越大,两类的可分程度越大,X i ,%,…,X N 为N 维特征; 3. 应具有某种距离的特点:J ij 0,当 i = j 时; J 。

= 0,当 i = j 时;ij Ji y4. 单调性,加入新的特征后,判据不减小:XN,X N 1 。

但是遗憾的是现在所经常使用的各种判据很难满足上述全部条件,只能满足一个或几个条件 基于矩阵形式的可分性判据1. 类内散度矩阵设有M 个类别,J ,…,宀,J 类样本集「X 1 , X 2 , X N, , J 类的散度矩阵定义为:总的类内散度矩阵为:MM1 NiTS w 八 P J S w i八 P -iX k-m iX k -m ii土i mNi k d2. 类间散度矩阵第i 个类别和第j 个类别之间的散度矩阵定义为:S B " =m ■ ii m m J总的类间散度矩阵可以定义为:/ MM, M M1 1S B ■ P 「'〔二 p s B P 'Ji 玄 p 「m - m 1 11^ - m J2 i 4 j ±2 i _ij jS w i二N iX N -J ij X ,X 21k =1M令:m 为总体均值,m P ■ \ m i,则有:i £MTS B 八 P 「”m H 「m ][m 「;-mi丄3. 总体散度矩阵总体散度矩阵可以定义为:S TM其中N 为总的样本数,NN i 。

特征提取与特征选择

1.特征提取

特征提取,通常称为特征工程,是指从数据集中提取有助于建模、分析过程和预测结果的特征,是机器学习和深度学习的基础,是实现有效机器学习和深度学习模型的关键环节。

特征提取的主要目的是从原始数据中提取出有价值的特征,从而提升模型的精确度。

特征提取的方法主要有:

1)非监督学习:非监督学习通过聚类、主成分分析(PCA)、奇异值分解、独立成分分析(ICA)等方法从原始数据中提取出有价值的特征。

2)监督学习:监督学习可以通过特征选择,递归特征消除(RFE),基于权重的统计特征选择和基于函数的特征选择等方法从原始数据中提取出有价值的特征。

2.特征选择

特征选择是指从原始数据中选择具有预测性的特征,以便提高模型有效性。

特征选择有助于减少过拟合,进而提高模型准确性。

特征选择的方法主要有:

1)特征选择:特征选择可以使用过滤法(Filter),包括单变量统计,相关性,卡方,信息增益等方法,也可以使用包裹法(Wrapper),包括递归特征消除(RFE),贪心,粒子群优化等方法,还可以使用嵌入法(Embedded),包括 L1正则化,L2正则化等方法。