信息论与编码08-信道编码的概念

- 格式:ppt

- 大小:447.50 KB

- 文档页数:30

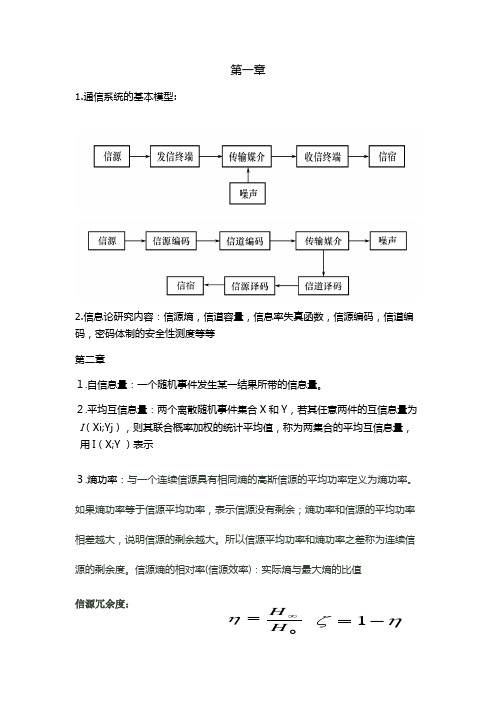

第一章1.通信系统的基本模型:2.信息论研究内容:信源熵,信道容量,信息率失真函数,信源编码,信道编码,密码体制的安全性测度等等第二章1.自信息量:一个随机事件发生某一结果所带的信息量。

2.平均互信息量:两个离散随机事件集合X 和Y ,若其任意两件的互信息量为 I (Xi;Yj ),则其联合概率加权的统计平均值,称为两集合的平均互信息量,用I (X;Y )表示3.熵功率:与一个连续信源具有相同熵的高斯信源的平均功率定义为熵功率。

如果熵功率等于信源平均功率,表示信源没有剩余;熵功率和信源的平均功率相差越大,说明信源的剩余越大。

所以信源平均功率和熵功率之差称为连续信源的剩余度。

信源熵的相对率(信源效率):实际熵与最大熵的比值信源冗余度:0H H ∞=ηηζ-=1意义:针对最大熵而言,无用信息在其中所占的比例。

3.极限熵:平均符号熵的N 取极限值,即原始信源不断发符号,符号间的统计关系延伸到无穷。

4.5.离散信源和连续信源的最大熵定理。

离散无记忆信源,等概率分布时熵最大。

连续信源,峰值功率受限时,均匀分布的熵最大。

平均功率受限时,高斯分布的熵最大。

均值受限时,指数分布的熵最大6.限平均功率的连续信源的最大熵功率:称为平均符号熵。

定义:即无记忆有记忆N X H H X H N X H X NH X H X H X H N N N N N N )()()()()()()(=≤∴≤≤若一个连续信源输出信号的平均功率被限定为p ,则其输出信号幅度的概率密度分布是高斯分布时,信源有最大的熵,其值为1log 22ep π.对于N 维连续平稳信源来说,若其输出的N 维随机序列的协方差矩阵C 被限定,则N 维随机矢量为正态分布时信源的熵最大,也就是N 维高斯信源的熵最大,其值为1log ||log 222N C e π+ 7.离散信源的无失真定长编码定理:离散信源无失真编码的基本原理原理图说明: (1) 信源发出的消息:是多符号离散信源消息,长度为L,可以用L 次扩展信源表示为: X L =(X 1X 2……X L )其中,每一位X i 都取自同一个原始信源符号集合(n 种符号): X={x 1,x 2,…x n } 则最多可以对应n L 条消息。

信道编码基础知识培训讲义信道编码,也叫差错控制编码,就是所有现代通信系统得基石。

几十年来,信道编码技术不断逼近香农极限,波澜壮阔般推动着人类通信迈过一个又一个顶峰。

5G到来,我们还能突破自我,再创通信奇迹吗?所谓信道编码,就就是在发送端对原数据添加冗余信息,这些冗余信息就是与原数据相关得,再在接收端根据这种相关性来检测与纠正传输过程产生得差错。

这些加入得冗余信息就就是纠错码,用它来对抗传输过程得干扰。

1948年,现代信息论得奠基人香农发表了《通信得数学理论》,标志着信息与编码理论这一学科得创立。

根据香农定理,要想在一个带宽确定而存在噪声得信道里可靠地传送信号,无非有两种途径:加大信噪比或在信号编码中加入附加得纠错码。

这就像在嘈杂得酒吧里,酒喝完了,您还想来一打,要想让服务员听到,您就得提高嗓门(信噪比),反复吆喝(附加得冗余信号)。

但就是,香农虽然指出了可以通过差错控制码在信息传输速率不大于信道容量得前提下实现可靠通信,但却没有给出具体实现差错控制编码得方法。

人类在信道编码上得第一次突破发生在1949年。

R、Hamming与M、Golay提出了第一个实用得差错控制编码方案。

受雇于贝尔实验室得数学家R、Hamming将输入数据每4个比特分为一组,然后通过计算这些信息比特得线性组合来得到3个校验比特,然后将得到得7个比特送入计算机。

计算机按照一定得原则读取这些码字,通过采用一定得算法,不仅能够检测到就是否有错误发生,同时还可以找到发生单个比特错误得比特得位置,该码可以纠正7个比特中所发生得单个比特错误。

这个编码方法就就是分组码得基本思想,Hamming提出得编码方案后来被命名为汉明码。

汉明码得编码效率比较低,它每4个比特编码就需要3个比特得冗余校验比特。

另外,在一个码组中只能纠正单个得比特错误。

M、Golay先生研究了汉明码得缺点,提出了Golay码。

Golay码分为二元Golay码与三元Golay码,前者将信息比特每12个分为一组,编码生成11个冗余校验比特,相应得译码算法可以纠正3个错误;后者得操作对象就是三元而非二元数字,三元Golay码将每6个三元符号分为一组,编码生成5个冗余校验三元符号,这样由11个三元符号组成得三元Golay码码字可以纠正2个错误。

信息论与编码原理

信息论与编码原理是一门研究信息传输和编码方法的学科。

在信息论中,我们关注的是如何在信息传输过程中最大限度地减少误差或失真。

在信息传输中,我们要面对的主要问题是噪声的存在。

噪声是由于信道的不完美而引起的,它会引入误差,导致信息的失真。

为了减少误差,我们需要设计一套有效的编码方案。

编码的目标是通过改变信息的表示方式,使得信息能够在信道中更好地传输。

信息的编码可以分为两个阶段:源编码和信道编码。

源编码是将输入的信息进行压缩,减少信息的冗余性,以便更有效地传输。

信道编码则是为了增强信息的可靠性,通过引入冗余来提高抗干扰能力,使得信息能够在不完美的信道中更好地传输。

在源编码中,我们常用的方法有霍夫曼编码和算术编码。

这些方法可以根据不同符号出现的概率来选择合适的编码方式,以提高传输效率。

在信道编码中,我们主要使用纠错编码,如海明编码和卷积码。

这些编码可以通过添加额外的冗余信息,使得接收端可以检测和纠正部分错误,提高传输的可靠性。

此外,在信息论中还有一个重要的概念是信息熵。

信息熵可以用来度量一个随机变量的不确定性。

通过熵的计算,我们可以了解信源输出的平均信息量,从而为编码方案的设计提供指导。

总之,信息论与编码原理是一门非常重要的学科,它不仅为我

们提供了有效的信息传输和编码方法,还给我们提供了理论基础,帮助我们理解信息的本质和传输过程中的各种问题。