第十一章 多重线性回归分析

- 格式:doc

- 大小:32.50 KB

- 文档页数:3

十一章1. 解:回归分析是确定两种或两种以上变量间相互依赖的定量关系的一种统计分析方法,运用十分广泛。

回归分析按照涉及的变量的多少,分为一元回归和多元回归分析;在线性回归中,按照因变量的多少,可分为简单回归分析和多重回归分析;按照自变量和因变量之间的关系类型,可分为线性回归分析和非线性回归分析。

如果在回归分析中,只包括一个自变量和一个因变量,且二者的关系可用一条直线近似表示,这种回归分析称为一元线性回归分析。

如果回归分析中包括两个或两个以上的自变量,且自变量之间存在线性相关,则称为多元线性回归分析。

相关分析,相关分析是研究现象之间是否存在某种依存关系,并对具体有依存关系的现象探讨其相关方向以及相关程度,是研究随机变量之间的相关关系的一种统计方法。

相关分析和回归分析是研究客观现象之间数量联系的重要统计方法。

既可以从描述统计的角度,也可以从推断统计的角度来说明。

所谓相关分析,就是用一个指标来表明现象间相互依存关系的密切程度。

所谓回归分析,就是根据相关关系的具体形态,选择一个合适的数学模型,来近似地表达变量间的平均变化关系。

它们具有共同的研究对象,在具体应用时,相关分析需要依靠回归分析来表明现象数量相关的具体形式,而回归分析则需要依靠相关分析来表明现象数量变化的相关程度。

只有当变量之间存在着高度相关时,进行回归分析寻求其相关的具体形式才有意义。

由于相关分析不能指出变量间相互关系的具体形式,所以回归分析要对具有相关关系的变量之间的数量联系进行测定,从而为估算和预测提供了一个重要的方法。

在有关管理问题的定量分析中,推断统计加具有更加广泛的应用价值。

需要指出的是,相关分析和回归分析只是定量分析的手段。

通过相关与回归分析,虽然可以从数量上反映现象之间的联系形式及其密切程度,但是现象内在联系的判断和因果关系的确定,必须以有关学科的理论为指导,结合专业知识和实际经验进行分析研究,才能正确解决。

因此,在应用时要把定性分析和定量分析结合起来,在定性分析的基础上开展定量分析。

多重线性回归分析方法多重线性回归分析是一种常用的统计方法,用于揭示自变量对因变量的影响。

它可以帮助我们理解多个自变量如何共同影响因变量,并通过建立一个数学模型来预测因变量的值。

本文将介绍多重线性回归分析的基本原理、步骤以及常见的模型评估方法。

一、基本原理多重线性回归分析是建立在线性回归模型的基础上的。

在简单线性回归模型中,只有一个自变量可以解释因变量的变化;而在多重线性回归模型中,有多个自变量同时对因变量产生影响。

其模型可表示为:Y = β0 + β1X1 + β2X2 + ... + βnXn + ε其中,Y代表因变量,X1, X2, ..., Xn代表自变量,β0, β1, β2, ..., βn代表回归系数,ε代表误差项。

二、分析步骤进行多重线性回归分析时,通常可以遵循以下步骤:1. 收集数据:首先,需要收集相关的自变量和因变量的数据,并确保数据的准确性和完整性。

2. 建立模型:根据收集到的数据,可以利用统计软件或编程工具建立多重线性回归模型。

确保选择合适的自变量,并对数据进行预处理,如去除异常值、处理缺失值等。

3. 模型拟合:利用最小二乘法或其他拟合方法,对模型进行拟合,找到最优的回归系数。

4. 模型评估:通过各种统计指标来评估模型的拟合效果,比如决定系数(R^2)、调整决定系数、F统计量等。

这些指标可以帮助我们判断模型的可靠性和解释力。

5. 解释结果:根据回归系数的正负和大小,以及显著性水平,解释不同自变量对因变量的影响。

同时,可以进行预测分析,根据模型的结果预测未来的因变量值。

三、模型评估方法在多重线性回归分析中,有多种方法可评估模型的拟合效果。

以下是几种常见的模型评估方法:1. 决定系数(R^2):决定系数是用来衡量模型拟合数据的程度,取值范围为0到1。

其值越接近1,表示模型能够较好地解释数据的变异。

2. 调整决定系数:调整决定系数是在决定系数的基础上,考虑自变量的数量和样本量后进行修正。

一章1. 解:回归分析是确定两种或两种以上变量间相互依赖的定量关系的一种统计分析方法,运用十分广泛。

回归分析按照涉及的变量的多少,分为一元回归和多元回归分析;在线性回归中,按照因变量的多少,可分为简单回归分析和多重回归分析;按照自变量和因变量之间的关系类型,可分为线性回归分析和非线性回归分析。

如果在回归分析中,只包括一个自变量和一个因变量,且二者的关系可用一条直线近似表示,这种回归分析称为一元线性回归分析。

如果回归分析中包括两个或两个以上的自变量,且自变量之间存在线性相关,则称为多元线性回归分析。

相关分析,相关分析是研究现象之间是否存在某种依存关系,并对具体有依存关系的现象探讨其相关方向以及相关程度,是研究随机变量之间的相关关系的一种统计方法。

相关分析和回归分析是研究客观现象之间数量联系的重要统计方法。

既可以从描述统计的角度,也可以从推断统计的角度来说明。

所谓相关分析,就是用一个指标来表明现象间相互依存关系的密切程度。

所谓回归分析,就是根据相关关系的具体形态,选择一个合适的数学模型,来近似地表达变量间的平均变化关系。

它们具有共同的研究对象,在具体应用时,相关分析需要依靠回归分析来表明现象数量相关的具体形式,而回归分析则需要依靠相关分析来表明现象数量变化的相关程度。

只有当变量之间存在着高度相关时,进行回归分析寻求其相关的具体形式才有意义。

由于相关分析不能指出变量间相互关系的具体形式,所以回归分析要对具有相关关系的变量之间的数量联系进行测定,从而为估算和预测提供了一个重要的方法。

在有关管理问题的定量分析中,推断统计加具有更加广泛的应用价值。

需要指出的是,相关分析和回归分析只是定量分析的手段。

通过相关与回归分析,虽然可以从数量上反映现象之间的联系形式及其密切程度,但是现象内在联系的判断和因果关系的确定,必须以有关学科的理论为指导,结合专业知识和实际经验进行分析研究,才能正确解决。

因此,在应用时要把定性分析和定量分析结合起来,在定性分析的基础上开展定量分析。

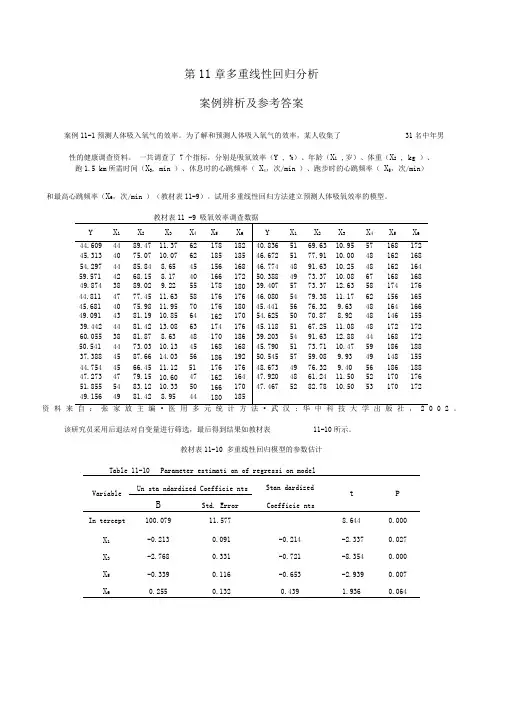

第11章多重线性回归分析案例辨析及参考答案案例11-1预测人体吸入氧气的效率。

为了解和预测人体吸入氧气的效率,某人收集了31名中年男性的健康调查资料。

一共调查了 7个指标,分别是吸氧效率(Y , %)、年龄(X1,岁)、体重(X2, kg )、跑1.5 km所需时间(X3, min )、休息时的心跳频率(X4,次/min )、跑步时的心跳频率(X5,次/min)和最高心跳频率(X6,次/min )(教材表11-9)。

试用多重线性回归方法建立预测人体吸氧效率的模型。

教材表11 -9 吸氧效率调查数据Y X1 X2X3 X4 X5 X6 Y X1 X2X3 X4 X5 X644.609 44 89.47 11.37 62 178 182 40.836 51 69.63 10.95 57 168 17245.313 40 75.07 10.07 62 185 185 46.672 51 77.91 10.00 48 162 16854.297 44 85.84 8.65 45 156 168 46.774 48 91.63 10.25 48 162 16459.571 42 68.15 8.17 40 166 172 50.388 49 73.37 10.08 67 168 16849.874 38 89.02 9.22 55 178 180 39.407 57 73.37 12.63 58 174 17644.811 47 77.45 11.63 58 176 176 46.080 54 79.38 11.17 62 156 16545.681 40 75.98 11.95 70 176 180 45.441 56 76.32 9.63 48 164 16649.091 43 81.19 10.85 64 162 170 54.625 50 70.87 8.92 48 146 15539.442 44 81.42 13.08 63 174 176 45.118 51 67.25 11.08 48 172 17260.055 38 81.87 8.63 48 170 186 39.203 54 91.63 12.88 44 168 17250.541 44 73.03 10.13 45 168 168 45.790 51 73.71 10.47 59 186 18837.388 45 87.66 14.03 56 186 192 50.545 57 59.08 9.93 49 148 15544.754 45 66.45 11.12 51 176 176 48.673 49 76.32 9.40 56 186 18847.273 47 79.15 10.60 47 162 164 47.920 48 61.24 11.50 52 170 17651.855 54 83.12 10.33 50 166 170 47.467 52 82.78 10.50 53 170 17249.156 49 81.42 8.95 44 180 185资料来自:张家放主编•医用多元统计方法•武汉:华中科技大学出版社,2002。

多重线性回归的主要原理多重线性回归是一种统计分析方法,用于研究多个自变量与一个因变量之间的关系。

该方法基于最小二乘法,在给定一组自变量的情况下,通过建立一个线性模型来估计因变量的值。

在多重线性回归中,变量可以分为两类:因变量和自变量。

因变量是我们希望预测或者解释的变量,而自变量是用来解释因变量的变量。

多重线性回归可以用以下方程表示:Y = β0 + β1X1 + β2X2 + ... + βnXn + ε其中,Y表示因变量的值,X1、X2、...、Xn是自变量的值,β0、β1、β2、...、βn是对应的回归系数,ε是误差项。

回归系数表示自变量对因变量的影响程度,误差项表示模型无法解释的部分。

多重线性回归的主要原理是基于最小二乘法来求解回归系数。

最小二乘法的目标是最小化残差平方和,即找到一组回归系数,使得模型预测值与实际观测值之间的差异最小化。

具体而言,多重线性回归的求解过程可以分为以下几步:1. 数据准备:收集自变量和因变量的数据,并进行数据清洗和预处理,包括处理缺失值、异常值和离群值等。

2. 模型建立:根据问题背景和数据特点,确定多重线性回归模型的自变量和因变量,并设置回归方程。

3. 参数估计:使用最小二乘法对回归系数进行估计。

最小二乘法通过最小化实际观测值和模型预测值之间的残差平方和来确定回归系数。

具体计算方法是通过求解方程组来获取回归系数的值。

4. 模型拟合:将估计得到的回归系数代入回归方程,得到多重线性回归模型。

模型能够通过给定自变量值来预测因变量的值。

5. 模型评估:对多重线性回归模型进行评估,包括评价模型的拟合程度和回归系数的显著性等。

常用的指标有R方值、调整R方值和显著性检验等。

6. 模型应用:使用经过验证和评估的多重线性回归模型进行预测、推断和解释。

可以通过改变自变量的值来预测因变量的变化,并对因变量的影响进行解释。

多重线性回归有几个重要的假设前提需要满足。

首先,自变量和因变量之间应该存在线性关系。

一、作业

教材P214 三。

二、自我练习

(一)教材P213 一。

(二)是非题

1.当一组资料的自变量为分类变量时,对这组资料不能做多重线性回归分析。

( )

2.若多重线性方程模型有意义.则各个偏回归系数也均有统计学意义。

〔)

3.回归模型变量的正确选择在根本上依赖于所研究问题本身的专业知识。

()

4.从各自变量偏回归系数的大小.可以反映出各自变量对应变量单位变化贡献的大小。

( )

5.在多元回归中,若对某个自变量的值都增加一个常数,则相应的偏回归系数不变。

( )

(三)选择题

1. 多重线性回归分析中,共线性是指(),导致的某一自变量对Y的作用可以由其他自变量的线性函数表示。

A. 自变量相互之间存在高度相关关系

B. 因变量与各个自变量的相关系数相同

C. 因变量与自变量间有较高的复相关关系

D. 因变量与各个自变量之间的回归系数相同

2. 多重线性回归和Logistic 回归都可应用于()。

A. 预测自变量

B. 预测因变量Y 取某个值的概率π

C. 预测风险函数h

D. 筛选影响因素(自变量)

3.在多重回归中,若对某个自变量的值都增加一个常数,则相应的偏回归系数:

A.不变

B.增加相同的常数

C.减少相同的常数

D.增加但数值不定

4.在多元回归中,若对某个自变量的值都乘以一个相同的常数k,则:

A.该偏回归系数不变

B.该偏回归系数变为原来的 1/k倍

C.所有偏回归系数均发生改变

D.该偏回归系数改变,但数值不定

5.作多重线性回归分析时,若降低进入的F 界值,则进入方程的变量一般会:

A.增多 B.减少 C.不变 D.可增多也可减少(四)筒答题

1.为什么要做多重线性回归分析?

2.多重线性模型中,标准化偏回归系数的解释意义是什么?

3.简述确定系数的定义及意义。

4.多重线性回归中自变量的筛选共有哪几种方法.请比较它们的优缺点?

5.何谓多重共线性,多重共线性对资料分析有何影响?。