最优化方法-共轭方向和共轭梯度法

- 格式:ppt

- 大小:770.00 KB

- 文档页数:34

共轭梯度法的迭代方向一、引言共轭梯度法是一种优化算法,用于解决线性方程组和最小化二次函数。

它基于共轭方向的概念,可以在相对较少的迭代次数内找到精确解。

二、共轭方向的概念在求解线性方程组Ax=b时,我们可以使用梯度下降法来最小化误差。

但是,梯度下降法可能会出现收敛速度缓慢的问题。

这是因为当我们按照负梯度方向进行迭代时,可能会遇到一个局部极小值点,并且在该点附近来回震荡。

为了解决这个问题,我们可以使用共轭方向。

如果两个向量a和b满足aTAb=0,则称它们是关于A共轭的。

也就是说,如果a和b都是A矩阵的特征向量,则它们是关于A共轭的。

三、CG方法CG方法(Conjugate Gradient)就是利用共轭方向来优化线性系统Ax=b的算法。

具体步骤如下:1. 初始化x0和r0=b-Ax0;2. 设置p0=r0;3. 对于k=0,1,2,...,直到收敛为止:a. 计算αk=rTk/rkTArk;b. 更新xk+1=xk+αkp;c. 更新rk+1=rk-αkAp;d. 计算βk+1=rTk+1/rkT+1;e. 更新pk+1=rk+1+βkp;其中,rk表示第k次迭代的残差,pk表示第k次迭代的搜索方向,αk是步长,βk是更新搜索方向时的系数。

四、共轭梯度法的迭代方向共轭梯度法中的搜索方向pk是关于A矩阵共轭的。

也就是说,对于任意两个不同的搜索方向pi和pj,它们满足piTApj=0。

为了证明这个结论,我们可以使用归纳法。

假设前i-1个搜索方向都满足共轭条件,则:piTApj=(ri-αiAi)TA(rj-αjAj)=riTA(rj-αjAj)-αiAiTA(rj-αjAj)=riTArj-αiAiTAjTArj其中,第一个等式使用了ri和rj关于A共轭的事实;第二个等式使用了公式rk+1=rk-αkAp;第三个等式使用了Ai和Aj关于A共轭的事实。

由于riTArj=0(因为ri和rj是关于A共轭的),所以我们得到piTApj=-αiAiTAjTArj=0。

共轭梯度法在优化问题中的应用共轭梯度法是一种高效的优化算法,在许多优化问题中都得到了广泛的应用。

它是一种迭代方法,用于解决最小化二次函数的优化问题。

在本文中,我将介绍共轭梯度法的原理和算法,并探讨它在优化问题中的应用。

一、共轭梯度法的原理共轭梯度法的核心思想是通过迭代的方式,找到一个与之前迭代步骤方向相互垂直的搜索方向,以加快收敛速度。

在每一次迭代中,共轭梯度法根据当前的搜索方向更新搜索点,直到找到最优解或达到预定的收敛标准。

具体来说,共轭梯度法从一个初始搜索点开始,计算对应的梯度,并沿着负梯度方向进行搜索。

通过一定的方法找到一个与之前搜索方向相互垂直的新搜索方向,并以一定步长更新搜索点。

迭代过程将重复进行,直到满足收敛标准或达到最大迭代次数。

二、共轭梯度法的算法共轭梯度法的算法包括以下几个步骤:1. 初始化搜索点x0和梯度g0,设置迭代次数k=0。

2. 计算当前搜索方向d_k=-g_k(k为当前迭代次数)。

3. 通过一维搜索方法找到最佳步长α_k。

4. 更新搜索点x_k+1 = x_k + α_k * d_k。

5. 计算更新后的梯度g_k+1。

6. 判断是否满足收敛标准,若满足则算法停止,否则转到步骤7。

7. 计算新的搜索方向β_k+1。

8. 将迭代次数k更新为k+1,转到步骤3。

这个算法保证了每一次迭代中的搜索方向都是彼此相互垂直的,从而加快了收敛速度。

三、共轭梯度法的应用共轭梯度法在优化问题中有广泛的应用,特别是在二次规划、线性规划和非线性规划等领域。

在二次规划问题中,共轭梯度法可以高效地求解线性系统Ax=b,其中A是一个对称正定的矩阵。

由于共轭梯度法的特性,它只需要进行n 次迭代,其中n是问题的维度,就能得到精确的解。

这使得共轭梯度法在大规模线性系统求解中具有重要的应用价值。

在线性规划问题中,共轭梯度法可以用于求解带有线性约束的最小二乘问题。

共轭梯度法通过将线性约束转化为一系列的正交子空间,从而在求解最小二乘问题时能够更快地收敛。

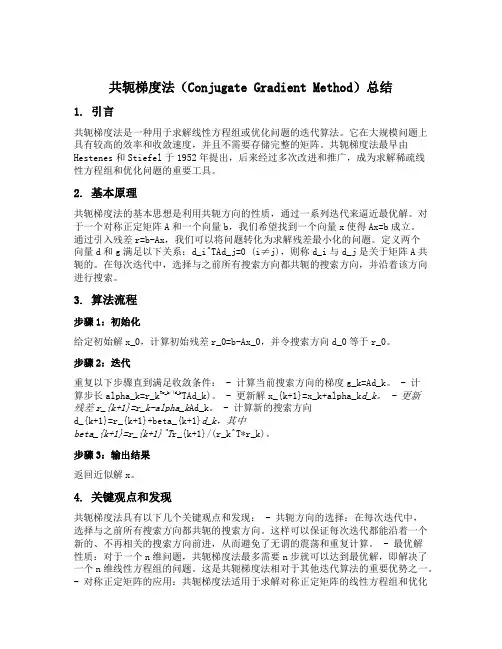

共轭梯度法(Conjugate Gradient Method)总结1. 引言共轭梯度法是一种用于求解线性方程组或优化问题的迭代算法。

它在大规模问题上具有较高的效率和收敛速度,并且不需要存储完整的矩阵。

共轭梯度法最早由Hestenes和Stiefel于1952年提出,后来经过多次改进和推广,成为求解稀疏线性方程组和优化问题的重要工具。

2. 基本原理共轭梯度法的基本思想是利用共轭方向的性质,通过一系列迭代来逼近最优解。

对于一个对称正定矩阵A和一个向量b,我们希望找到一个向量x使得Ax=b成立。

通过引入残差r=b-Ax,我们可以将问题转化为求解残差最小化的问题。

定义两个向量d和g满足以下关系:d_i^TAd_j=0 (i≠j),则称d_i与d_j是关于矩阵A共轭的。

在每次迭代中,选择与之前所有搜索方向都共轭的搜索方向,并沿着该方向进行搜索。

3. 算法流程步骤1:初始化给定初始解x_0,计算初始残差r_0=b-Ax_0,并令搜索方向d_0等于r_0。

步骤2:迭代重复以下步骤直到满足收敛条件: - 计算当前搜索方向的梯度g_k=Ad_k。

- 计算步长alpha_k=r_k Tr_k/(d_k TAd_k)。

- 更新解x_{k+1}=x_k+alpha_k d_k。

- 更新残差r_{k+1}=r_k-alpha_k Ad_k。

- 计算新的搜索方向d_{k+1}=r_{k+1}+beta_{k+1}d_k,其中beta_{k+1}=r_{k+1}^T r_{k+1}/(r_k^T*r_k)。

步骤3:输出结果返回近似解x。

4. 关键观点和发现共轭梯度法具有以下几个关键观点和发现: - 共轭方向的选择:在每次迭代中,选择与之前所有搜索方向都共轭的搜索方向。

这样可以保证每次迭代都能沿着一个新的、不再相关的搜索方向前进,从而避免了无谓的震荡和重复计算。

- 最优解性质:对于一个n维问题,共轭梯度法最多需要n步就可以达到最优解,即解决了一个n维线性方程组的问题。

共轭梯度法的基本思路共轭梯度法是一种优化算法,用于求解解析式的极小值。

这种算法成功的理论和实践应用广泛,是一种效率高的算法。

它的基本思路是利用迭代的方式,不断的寻找最小值,直到收敛。

共轭梯度法不同于其他优化算法的地方在于,它利用了向量之间的共轭关系,以一种不同于其他优化算法的方式计算最小化结果。

它的初始值是一个任意的向量值。

这个向量随着迭代的进行,会不断地被更新。

每一步迭代都会朝着更小的函数值的方向移动,这个方向就是梯度的反方向。

在共轭梯度法中,每一个迭代步骤都与前一个迭代步骤保持共轭。

这意味着在这个方向上的优化将只改变尚未被改变的维度,而沿着已经优化的方向不会再次搜索。

这种方式可以减少搜索空间和时间复杂度,从而使得算法更加高效。

此外,在共轭方向上,梯度的大小也逐渐减小,这也是共轭梯度法收敛速度更快的原因。

共轭梯度法最适用于大规模计算机系统上的大规模处理任务。

它通常用于解决线性方程组,如图像处理、信号处理、网络规划等。

它可以很好的解决非对称和非正定的问题。

需要指出的是,共轭梯度法很难用来寻找全局最小值,因为它只搜索梯度反方向上的最小值。

如果初值选的不好,可能会过早陷入局部最小值。

因此,对于一些特定的问题,如非线性规划等,可能需要考虑使用其他的优化算法。

总之,共轭梯度法是一种非常有用的工具,可以帮助我们快速地解决许多优化问题。

但是,它的成功与否也与问题本身和初值的选择有很大的关系,因此在实际应用中,我们需要根据具体情况进行合理的选择和调整。

最优化问题共轭梯度法法代码x本文介绍了最优化问题共轭梯度法法的代码实现,以及如何使用代码解决最优化问题。

一、共轭梯度法简介共轭梯度法是一种常用的最优化算法,它是一种经典的迭代方法,用于求解凸函数的极值问题。

其基本思想是:在每一步,沿着梯度下降的方向迭代,直到梯度为零就停止迭代。

共轭梯度法的迭代公式为:$$x_{k+1}=x_k+alpha_k p_k$$其中,$alpha_k$ 是步长参数,$p_k$ 是当前搜索方向,$x_k$ 是当前点的位置。

二、代码实现1.函数定义```python# 共轭梯度法# 入参:函数func,梯度函数grad,初始点x0,步长参数alpha,精度epsilon# 出参:求解的最优点xdef conjugate_gradient_method(func, grad, x0, alpha, epsilon):```2.初始化搜索方向```python# 初始化搜索方向p_k = -grad(x_k)```3.更新迭代点```python# 更新迭代点x_k = x_k + alpha * p_k```4.更新搜索方向```python# 更新搜索方向beta_k = (grad(x_k) * grad(x_k)) / (grad(x_k_prev) * grad(x_k_prev))p_k = -grad(x_k) + beta_k * p_k_prev```5.检查终止条件```python# 检查终止条件if np.linalg.norm(grad(x_k)) < epsilon:break```6.完整代码```python# 共轭梯度法# 入参:函数func,梯度函数grad,初始点x0,步长参数alpha,精度epsilon# 出参:求解的最优点xdef conjugate_gradient_method(func, grad, x0, alpha, epsilon):x_k = x0p_k = -grad(x_k)while np.linalg.norm(grad(x_k)) > epsilon:x_k_prev = x_kp_k_prev = p_kline_search = line_search_method(func, grad, p_k, x_k, alpha)x_k = x_k + line_search * p_kbeta_k = (grad(x_k) * grad(x_k)) / (grad(x_k_prev) * grad(x_k_prev))p_k = -grad(x_k) + beta_k * p_k_prevreturn x_k```三、如何使用代码解决最优化问题1.确定问题首先,我们需要确定最优化问题,即构造一个函数,其中包含我们想要优化的目标函数以及约束条件。

共轭梯度法最简明解释

嘿,你知道啥是共轭梯度法不?这玩意儿可神奇啦!就好比你在一

个迷宫里找出口,有好多条路可以走。

共轭梯度法呢,就是一种找到最优解的方法。

想象一下,你要去山

顶看最美的风景,但是山有很多坡,你得选择最合适的路往上爬。

比

如说你一开始随便选了一条路走,走着走着发现不太对,那咋办?这

时候共轭梯度法就发挥作用啦!它会帮你调整方向,让你更接近山顶。

我给你举个例子哈,就像你要减肥,你试过各种方法,节食啦,运

动啦。

那共轭梯度法就像是有个智慧的教练在旁边,告诉你啥时候该

多吃点,啥时候该加大运动量,让你能最快地达到减肥的目标。

它不是那种死板的方法,而是很灵活的。

比如说在解决一个复杂的

问题时,它会根据实际情况不断调整策略。

这多厉害呀!

咱再想想,要是没有共轭梯度法,那得多费劲呀!就像你在黑夜里

没有手电筒,摸黑走路,多容易摔跤呀!

共轭梯度法真的是数学和科学领域的一个大宝贝!它能让很多难题

变得简单起来,能帮我们更快地找到答案。

我觉得吧,共轭梯度法就像是一把神奇的钥匙,能打开很多知识和

技术的大门,让我们看到更广阔的世界!你说是不是?。

共轭梯度法简介共轭梯度法是一种迭代的最优化算法,用于求解线性方程组或求解非线性优化问题。

它在解决大规模线性方程组时表现出色,尤其适用于对称正定矩阵的问题。

共轭梯度法结合了最速下降法和共轭方向法的优点,能够在有限次数的迭代中快速收敛到最优解。

背景在数值计算和优化问题中,线性方程组的求解是一个常见且重要的问题。

例如,在图像处理、数据分析和机器学习等领域,我们经常需要求解一个大规模的线性方程组。

然而,传统的直接方法,如高斯消元法或LU分解,对于大规模问题往往计算量巨大,耗时较长。

因此,我们需要寻找一种高效的迭代方法来解决这些问题。

共轭梯度法的核心思想是通过一系列共轭的搜索方向来逼近最优解。

具体来说,对于一个对称正定的线性方程组Ax=b,共轭梯度法的步骤如下:1.初始化解向量x0和残差x0=x−xx0。

2.计算初始搜索方向x0=x0。

3.进行共轭梯度迭代:重复以下步骤n次或直到收敛为止。

a.计算步长$\\alpha_k=\\frac{r_k^Tr_k}{d_k^TAd_k}$。

b.更新解向量$x_{k+1}=x_k+\\alpha_kd_k$。

c.更新残差$r_{k+1}=r_k-\\alpha_kAd_k$。

d.计算新的搜索方向$d_{k+1}=r_{k+1}+\\frac{r_{k+1}^Tr_{k+1}}{r_k^Tr_k}d_k$。

共轭梯度法与其他迭代方法相比有以下特点:1.高效性:共轭梯度法能够在有限次数的迭代中收敛到最优解,尤其适用于对称正定矩阵。

相比于直接方法,其计算量较小,具有更高的计算效率。

2.无需存储完整矩阵:共轭梯度法只需知道矩阵A的乘法运算结果,不需要存储完整的矩阵。

这对于大规模问题是一个很大的优势。

3.不需要计算矩阵的特征值:相比于其他迭代方法,共轭梯度法不需要计算矩阵的特征值,因此在实际问题中更加实用。

算法应用共轭梯度法广泛应用于各个领域的优化问题和线性方程组求解问题,包括:1.图像处理:共轭梯度法用于图像恢复、图像去噪和图像分割等问题。

第四章 共轭梯度法§ 共轭方向法共轭方向法是无约束最优化问题的一类重要算法。

它一方面克服了最速下降法中,迭代点列呈锯齿形前进,收敛慢的缺点,同时又不像牛顿法中计算牛顿方向花费大量的工作量,尤其是共轭方向法具有所谓二次收敛性质,即当将其用于二次函数时,具有有限终止性质。

一、共轭方向概念 设G 是n n ⨯对称正定矩阵,1d ,2d 是n 维非零向量,假设120T d Gd = ()那么称1d ,2d 是G -共轭的。

类似地,设1,,m d d 是n R 中一组非零向量。

假设0T i j d Gd =()i j ≠ ()那么称向量组1,,m d d 是G -共轭的。

注:(1) 当G I =时,共轭性就变成正交性,故共轭是正交概念的推行。

(2) 若1,,m d d G -共轭,那么它们必线性无关。

二、共轭方向法共轭方向法确实是依照一组彼此共轭方向依次搜索。

模式算法:1)给出初始点0x ,计算00()g g x =,计算0d ,使000Td g <,:0k = (初始共轭方向); 2)计算k α和1k x +,使得0()min ()k k k k k f x d f x d ααα≥+=+,令1k k k k x x d α+=+;3)计算1k d +,使10Tk j d Gd +=,0,1,,j k =,令:1k k =+,转2)。

三、共轭方向法的大体定理共轭方向法最重要的性质确实是:当算法用于正定二次函数时,能够在有限多次迭代后终止,取得最优解(固然要执行精准一维搜索)。

定理 关于正定二次函数,共轭方向法最多通过n 步精准搜索终止;且对每一个1i x +,都是()f x 在线性流形00,i j j j j x x x d αα=⎧⎫⎪⎪=+∀⎨⎬⎪⎪⎩⎭∑中的极小点。

证明:首先证明对所有的1i n ≤-,都有10T i j g d +=,0,1,,j i =(即每一个迭代点处的梯度与以前的搜索方向均正交)事实上,由于目标函数是二次函数,因此有()11k k k k k k g g G x x Gd α++-=-=1)当j i <时, ()1111iTTT i j j j k k j k j g d gd g g d +++=+=+-∑110iT T j j kkj k j gd dGd α+=+=+=∑2)当j i =时,由精准搜索性质知:10T i j g d +=综上所述,有 10T i j g d += (0,1,,)j i =。

极值点偏移三种常见解法

在数学和优化问题中,寻找函数的极值点是一个常见的任务。

以下是三种常见的偏移极值点的解法:

1. 梯度下降法(Gradient Descent):梯度下降法是一种迭代的优化算法,用于找到函数的局部极小值点。

该方法通过计算函数在当前点的梯度(即函数变化最快的方向),然后向梯度的相反方向更新当前点,直到达到收敛条件或最小化目标函数。

2. 牛顿法(Newton's Method):牛顿法是一种迭代的优化算法,用于寻找函数的极值点。

该方法通过使用函数的一阶和二阶导数信息来更新当前点的位置。

它利用二阶导数(海森矩阵)提供更准确的方向和步长,因此在某些情况下可以更快地收敛到极值点。

3. 共轭梯度法(Conjugate Gradient):共轭梯度法是一种迭代的优化算法,特别适用于解决具有对称正定矩阵的线性方程组的问题。

然而,它也可以用于求解无约束优化问题中的极值点。

该方法通过迭代计算共轭方向和步长,以逐步逼近极值点。

这些方法在寻找函数的极值点时都有各自的优势和适用范围。

选择合适的方法取决于具体的问题和函数特性。

共轭梯度法原理共轭梯度法是一种用于解决大规模线性方程组或非线性优化问题的迭代算法。

它的原理基于寻找一个向量的共轭方向,以便在每一步迭代中最大限度地减少误差。

在本文中,我们将详细介绍共轭梯度法的原理及其应用。

首先,让我们来了解一下共轭梯度法的基本原理。

在解决线性方程组Ax=b时,共轭梯度法的核心思想是通过寻找一组共轭的搜索方向来逐步逼近最优解。

这些共轭方向是相互正交的,这意味着它们不会在同一个方向上重复搜索,从而有效地加速了收敛速度。

在每一步迭代中,共轭梯度法都会沿着一个共轭方向进行搜索,以找到一个最优的步长,使得误差函数能够得到最大程度的减少。

通过不断地迭代,我们可以逐渐逼近最优解。

这种方法在解决大规模线性方程组时非常高效,尤其是在稀疏矩阵和对称正定矩阵的情况下效果更佳。

除了解决线性方程组外,共轭梯度法还被广泛应用于非线性优化问题。

在这种情况下,我们需要通过最小化一个目标函数来寻找最优解。

共轭梯度法同样可以通过寻找共轭方向来逐步逼近最优解,从而在非线性优化问题中取得良好的效果。

总的来说,共轭梯度法是一种非常高效的优化算法,它通过寻找共轭方向来逐步逼近最优解,特别适用于解决大规模线性方程组和非线性优化问题。

它的原理简单而又高效,因此在实际应用中得到了广泛的应用。

在实际应用中,共轭梯度法还有许多改进的版本,例如预处理共轭梯度法、共轭梯度法的共轭梯度法等,这些改进版本都在一定程度上提高了算法的收敛速度和稳定性,使其更加适用于不同类型的问题。

综上所述,共轭梯度法是一种非常重要的优化算法,它通过寻找共轭方向来逐步逼近最优解,特别适用于解决大规模线性方程组和非线性优化问题。

在实际应用中,它的高效性和稳定性使其成为了解决实际问题的重要工具。

希望本文对共轭梯度法的原理有所帮助,谢谢阅读!。