(完整word版)基本粒子群算法的原理和matlab程序

- 格式:pdf

- 大小:59.79 KB

- 文档页数:6

matlab粒子群优化算法Matlab粒子群优化算法(Particle Swarm Optimization,简称PSO)是一种模拟鸟群觅食行为的优化算法,它通过模拟粒子在解空间中搜索最优解的过程,来解决各种优化问题。

本文将介绍PSO 算法的原理和应用,以及如何在Matlab中实现PSO算法。

PSO算法的原理基于群体智能的思想,它模拟了鸟群觅食的行为。

在PSO算法中,解空间被表示为一群粒子,每个粒子代表一个解,其位置和速度决定了粒子在解空间中的搜索行为。

每个粒子通过与当前最优解和全局最优解的比较,来更新自己的速度和位置,从而逐渐靠近最优解。

PSO算法的基本流程如下:1. 初始化粒子群的位置和速度;2. 计算每个粒子的适应度值;3. 更新每个粒子的速度和位置,同时更新当前最优解和全局最优解;4. 判断终止条件是否满足,如果满足则结束,否则返回步骤2。

PSO算法的核心是速度和位置的更新。

速度的更新公式为:v_i(t+1) = w * v_i(t) + c1 * rand() * (pbest_i - x_i(t)) + c2 * rand() * (gbest - x_i(t))其中,v_i(t+1)是粒子i在时间t+1时的速度,w是惯性权重,c1和c2分别是个体和社会学习因子,rand()是一个0-1之间的随机数,pbest_i是粒子i的个体最优解,x_i(t)是粒子i在时间t时的位置,gbest是全局最优解。

位置的更新公式为:x_i(t+1) = x_i(t) + v_i(t+1)PSO算法的优点是简单易用、全局搜索能力强、收敛速度快等。

它广泛应用于函数优化、神经网络训练、机器学习等领域。

在Matlab 中,可以使用内置的pso函数来实现PSO算法。

下面以一个函数优化问题为例,演示如何在Matlab中使用PSO算法。

假设我们要优化的目标函数是f(x) = x^2,其中x的取值范围是[-5, 5]。

粒子群改进算法matlab-概述说明以及解释1.引言概述部分的内容可如下编写:1.1 概述粒子群算法(Particle Swarm Optimization, PSO)是一种基于群体智能的优化算法,通过模拟鸟群或鱼群等自然界中群体行为的方式,来寻找最优解。

它最初由Russell Eberhart和James Kennedy于1995年提出,并在之后的发展中得到了广泛应用。

PSO算法的核心思想是将待求解问题的可能解看作是群体中的粒子,并通过模拟粒子间的交流和协作来不断优化解空间,在寻找最优解的过程中逐步收敛。

每个粒子通过记忆自己的历史最优解和整个群体中的全局最优解来进行自我调整和更新。

在每一次迭代中,粒子根据自身的记忆和全局信息进行位置的更新,直到达到预设的停止条件。

PSO算法具有简单、易于实现和快速收敛等特点,广泛应用于函数优化、组合优化、机器学习等领域。

然而,传统的PSO算法也存在着较为明显的局限性,如易陷入局部最优解、对参数设置较为敏感等问题。

为了克服传统PSO算法的局限性,研究者们提出了各种改进的方法,从算法思想到参数设置进行了深入研究。

本文旨在介绍粒子群改进算法在Matlab环境下的实现。

首先对传统的粒子群算法进行了详细的介绍,包括其原理、算法步骤、优缺点以及应用领域。

然后,进一步介绍了粒子群改进算法的各种改进方法,其中包括改进方法1、改进方法2、改进方法3和改进方法4等。

最后,通过Matlab环境的配置和实验结果与分析来展示粒子群改进算法在实际应用中的性能和效果。

本文的结论部分总结了主要发现、研究的局限性,并展望了未来的研究方向。

综上所述,本文将全面介绍粒子群改进算法的原理、算法步骤、实现过程和实验结果,旨在为读者提供一个详细的了解和研究该算法的指南。

1.2文章结构1.2 文章结构:本文主要包括以下几个部分的内容:第一部分为引言,介绍了本文的背景和目的,概述了即将介绍的粒子群改进算法的原理和优缺点。

粒子群优化算法(Particle Swarm Optimization,PSO)是一种基于群体智能的优化

算法,它模拟了鸟群或鱼群等生物群体的行为,通过个体之间的协作和信息共享来寻找问题的最优解。

在 MATLAB 中,可以使用 PSO 工具箱来实现粒子群优化算法。

以下是在 MATLAB 中使用 PSO 工具箱实现粒子群优化算法的基本步骤:

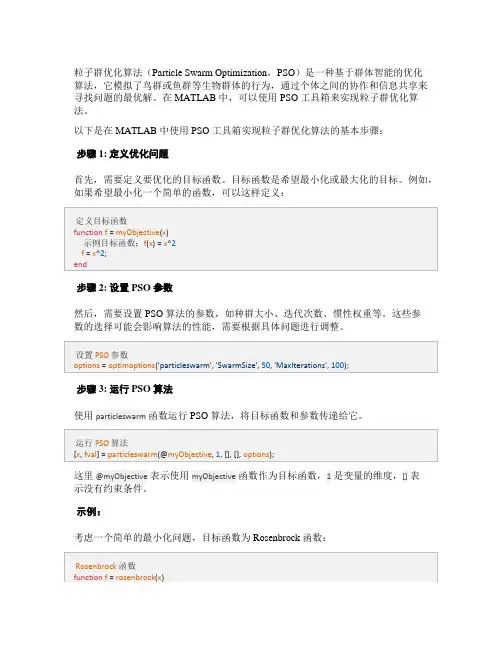

步骤1: 定义优化问题

首先,需要定义要优化的目标函数。

目标函数是希望最小化或最大化的目标。

例如,如果希望最小化一个简单的函数,可以这样定义:

步骤2: 设置 PSO 参数

然后,需要设置 PSO 算法的参数,如种群大小、迭代次数、惯性权重等。

这些参

数的选择可能会影响算法的性能,需要根据具体问题进行调整。

步骤3: 运行 PSO 算法

使用particleswarm函数运行 PSO 算法,将目标函数和参数传递给它。

这里@myObjective表示使用myObjective函数作为目标函数,1是变量的维度,[]表

示没有约束条件。

示例:

考虑一个简单的最小化问题,目标函数为 Rosenbrock 函数:

设置 PSO 参数:

运行 PSO 算法:

在这个示例中,rosenbrock函数是一个二维的 Rosenbrock 函数,PSO 算法将寻找使得该函数最小化的变量值。

请注意,实际应用中,需要根据具体问题调整目标函数、约束条件和 PSO 参数。

MATLAB 的文档和示例代码提供了更多关于 PSO 工具箱的详细信息。

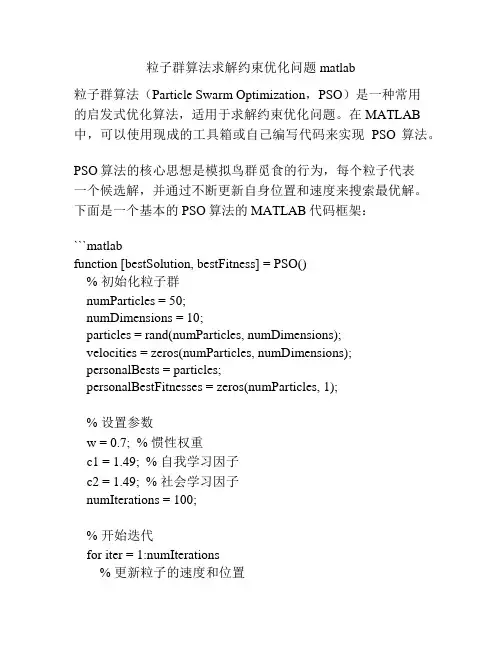

粒子群算法求解约束优化问题matlab粒子群算法(Particle Swarm Optimization,PSO)是一种常用的启发式优化算法,适用于求解约束优化问题。

在MATLAB 中,可以使用现成的工具箱或自己编写代码来实现PSO算法。

PSO算法的核心思想是模拟鸟群觅食的行为,每个粒子代表一个候选解,并通过不断更新自身位置和速度来搜索最优解。

下面是一个基本的PSO算法的MATLAB代码框架:```matlabfunction [bestSolution, bestFitness] = PSO()% 初始化粒子群numParticles = 50;numDimensions = 10;particles = rand(numParticles, numDimensions);velocities = zeros(numParticles, numDimensions);personalBests = particles;personalBestFitnesses = zeros(numParticles, 1);% 设置参数w = 0.7; % 惯性权重c1 = 1.49; % 自我学习因子c2 = 1.49; % 社会学习因子numIterations = 100;% 开始迭代for iter = 1:numIterations% 更新粒子的速度和位置for i = 1:numParticlesr1 = rand(1, numDimensions);r2 = rand(1, numDimensions);velocities(i,:) = w*velocities(i,:) +c1*r1.*(personalBests(i,:) - particles(i,:)) + c2*r2.*(globalBest - particles(i,:));particles(i,:) = particles(i,:) + velocities(i,:);end% 更新个体最优解和适应度for i = 1:numParticlesfitness = evaluateFitness(particles(i,:));if fitness < personalBestFitnesses(i)personalBests(i,:) = particles(i,:);personalBestFitnesses(i) = fitness;endend% 更新全局最优解和适应度[bestFitness, bestIndex] = min(personalBestFitnesses);bestSolution = personalBests(bestIndex,:);% 输出当前迭代的结果fprintf('Iteration %d: Best fitness = %f\n', iter, bestFitness); endend```以上多个代码块来自上面的核心框架。

粒子群算法matlab本文旨在介绍粒子群算法Matlab。

粒子群算法是一种全局搜索和优化技术,它的目的是通过可重复的迭代搜索来找到搜索空间中的最优解。

本文详细阐述了粒子群算法的基本原理,讨论了它的设计思想和参数设置,以及如何将粒子群算法应用于Matlab中。

最后,本文介绍了若干数值实例,来验证粒子群算法的可行性。

关键词:子群算法;Matlab;全局优化;迭代搜索1.论粒子群算法(Particle Swarm Optimization,PSO)是一种动态优化算法,它能自动识别全局最优解。

它结合了群众智慧和机器学习,是一种运用群体智能手段实现全局优化的有效方法。

由于其计算代价低廉,计算时间短,解决问题效果良好,因此得到了广泛的应用。

Matlab是屡获殊荣的数值计算软件,它能够对各类数据进行可视化分析和仿真模拟。

由于Matlab具有丰富的工具箱,可以快速准确地解决复杂的科学问题,因此它已经成为科学计算的标准软件。

本文将主要介绍如何将粒子群算法应用于Matlab中。

2.法原理粒子群算法是由Kennedy和Eberhart在1995年提出的,它也被称为Zebra算法,是建立在群体智能概念上的,由群体中全局优化算法之一。

粒子群算法以群体中的每个个体的最优位置和最优速度为基础,通过可重复的迭代搜索来找到搜索空间中的最优解。

算法的设计基本思想是:建立一组虚拟粒子,每个粒子代表一个可能的解决方案,每个粒子有一个位置和一个速度。

算法通过不断迭代,让这些粒子像鱼群一样游动,从而找到最优解。

3.法设计粒子群算法由三个参数组成:全局最优系数(cg)、社会系数(cs)和惯性权重(w)。

cg和cs是粒子群算法的两个基本系数,它们分别代表了粒子群对全局最优和社会最优的响应程度。

w是惯性权重,它代表了粒子群对历史最优位置的惯性搜索能力。

通常情况下,系数cg和w会在一定范围内不断变化,使得算法能够更快地找到最优解。

4. Matlab实现为了在Matlab中实现粒子群算法,需要对Matlab的调用进行必要的设置。

粒子群算法求解约束优化问题matlab粒子群算法(Particle Swarm Optimization, PSO)是一种基于群体智能的优化算法,旨在寻找最佳解决方案。

PSO算法源自对鸟群或鱼群等动物群体协作行为的模拟,通过不断地迭代更新粒子的位置和速度来搜索最优解。

在实际问题中,许多优化问题都包含约束条件,例如工程设计中的材料成本、生产效率、能源消耗等,或者在金融领域的资产配置、风险控制等。

而粒子群算法正是为了解决这类具有约束的优化问题而设计的。

让我们先来深入了解一下粒子群算法的原理和基本思想。

PSO算法中,每个粒子代表了一个潜在的解,这个解在解空间中的位置由粒子的位置向量表示。

为了评价这个解的好坏,需要定义一个适应度函数,它代表了解的质量。

对于约束优化问题,适应度函数不仅考虑了目标函数的值,还要考虑约束条件是否满足。

粒子不断地在解空间中搜索,通过跟踪全局最优和个体最优来调整自身的位置和速度,从而朝着更优的解前进。

在使用Matlab进行粒子群算法的求解时,我们首先需要定义目标函数和约束条件,这样才能够进行算法的优化过程。

在定义目标函数时,需要考虑问题的具体情况,包括优化的目标和约束条件的具体形式。

对于约束优化问题,一般会将问题转化为带有罚函数的无约束优化问题,或者使用遗传算法等其他优化方法进行求解。

当然,在使用粒子群算法求解约束优化问题时,也需要考虑一些参数的设置,例如粒子群的数量、最大迭代次数、惯性权重等。

这些参数的设置会对算法的收敛速度和最优解的寻找起到重要的影响。

在使用Matlab进行PSO算法求解时,需要根据具体问题进行参数的调整和优化。

粒子群算法作为一种群体智能算法,在求解约束优化问题方面具有很好的效果。

通过在解空间中不断搜索和迭代更新粒子状态,PSO算法能够有效地找到最优解。

在使用Matlab进行PSO算法求解约束优化问题时,需要注意合理地定义目标函数和约束条件,以及进行参数的调整。

pso算法 matlab程序PSO算法,即粒子群优化算法(Particle Swarm Optimization),是一种启发式优化算法,常用于解决搜索和优化问题。

在Matlab中实现PSO算法可以通过以下步骤:步骤1,初始化粒子群。

首先,需要初始化一群粒子,每个粒子都代表了搜索空间中的一个候选解。

每个粒子都有自己的位置和速度。

可以使用随机数函数在搜索空间内随机生成粒子的初始位置和速度。

步骤2,计算适应度。

接下来,需要计算每个粒子的适应度,适应度函数根据具体问题而定。

适应度函数可以是需要最小化或最大化的目标函数。

步骤3,更新粒子的速度和位置。

根据PSO算法的原理,需要根据当前位置和速度以及个体最优位置和全局最优位置来更新粒子的速度和位置。

这个过程可以通过一些数学公式来实现,通常包括学习因子、惯性权重等参数。

步骤4,更新个体和全局最优位置。

在更新粒子的过程中,需要不断更新个体最优位置和全局最优位置。

如果某个粒子找到了比之前更好的位置,就需要更新个体最优位置;如果整个粒子群中出现了更好的位置,就需要更新全局最优位置。

步骤5,重复迭代。

以上步骤需要进行多次迭代,直到满足停止迭代的条件。

通常可以设置迭代次数或者适应度达到某个阈值时停止迭代。

在Matlab中,可以使用循环结构来实现迭代过程,同时根据上述步骤编写相应的代码来实现PSO算法。

常用的Matlab函数和工具包如“fmincon”、“Global Optimization Toolbox”等也可以用来实现PSO算法。

总结来说,实现PSO算法的关键在于理解其基本原理,正确地编写粒子的更新规则和适应度函数,并进行合适的迭代和终止条件设置。

希望这些信息能帮助你在Matlab中实现PSO算法。

Matlab技术粒子群优化算法解析在现代科技和工业领域中,优化问题一直是一个非常重要的领域。

优化问题的求解能有效提高生产效率、降低成本、改善产品质量等等。

而针对优化问题,粒子群优化算法(Particle Swarm Optimization, PSO)是一种常用且有效的算法方法。

而Matlab作为一款著名的数学建模软件,其内置了丰富的工具箱,其中也包含了用于实现粒子群优化算法的函数。

本文将详细解析Matlab技术中的粒子群优化算法,从算法原理、实现步骤到优化效果的评估,帮助读者全面了解这一重要的优化算法。

1. 粒子群优化算法原理粒子群优化算法是一种模拟鸟群觅食行为的优化算法。

在算法中,候鸟们根据个体和整体的信息来决定自己的移动方向。

同样地,粒子群优化算法中的粒子也通过学习并社交来寻找全局最优解。

算法的基本原理是,每一个粒子都有自己的位置和速度。

它们根据自己的历史最优位置和整体最优位置进行更新,从而逐渐朝着全局最优位置移动。

通过不断迭代更新粒子的位置和速度,最终找到一个接近最优解的解。

2. 粒子群优化算法在Matlab中的实现步骤Matlab提供了一系列函数来实现粒子群优化算法,下面是该算法在Matlab中的实现步骤:(1)初始化粒子群的位置和速度。

首先,确定粒子群的数量N,以及每个粒子位置的维度。

然后,根据问题的特点来设定粒子的初始位置和速度范围。

(2)对于每个粒子,计算其适应度值。

根据问题的具体情况,需要构建适应度函数来评估粒子的位置和速度对问题的解的贡献。

(3)更新粒子的速度和位置。

根据粒子的历史最优位置和整体最优位置,以及一定的随机因子,计算粒子的速度和位置的更新值。

(4)判断算法的终止条件。

通常情况下,可以预设一个最大迭代次数,当达到最大次数或满足其他停止条件时,停止算法的迭代。

(5)如果未满足终止条件,则回到(2)步骤,继续迭代更新粒子的速度和位置。

3. 粒子群优化算法的优化效果评估粒子群优化算法的优化效果可以通过多个指标来进行评估。

有约束多目标粒子群算法matlab程序【实用版】目录一、多目标粒子群算法的概念和原理二、MATLAB 实现多目标粒子群优化算法的步骤三、多目标粒子群算法在配电网储能选址定容中的应用四、多目标粒子群优化算法的优缺点五、总结与展望正文一、多目标粒子群算法的概念和原理多目标粒子群算法(Multi-objective Particle Swarm Optimization,MOPSO)是一种基于启发式的多目标全局优化算法。

它起源于鸟群觅食的自然现象,通过模拟鸟群中个体的觅食行为,寻找全局最优解。

与传统的单目标粒子群算法不同,MOPSO 需要处理多个目标函数,因此需要在算法中加入目标函数权重的概念,以确定每个目标函数在优化过程中的重要性。

二、MATLAB 实现多目标粒子群优化算法的步骤1.确定优化问题:首先,需要明确优化问题的具体内容,包括目标函数、约束条件和搜索空间等。

2.初始化粒子群:根据搜索空间的大小和目标函数的个数,生成一定数量的粒子,并随机分配它们在搜索空间中的位置和速度。

3.更新粒子速度和位置:根据粒子群算法的更新规则,结合目标函数的梯度和约束条件,更新每个粒子的速度和位置。

4.评估适应度:根据目标函数的值,计算每个粒子的适应度,并选择最优的粒子作为全局最优解。

5.结束条件:当达到预设的最大迭代次数或全局最优解的适应度满足预设的标准时,结束优化过程。

6.输出结果:输出全局最优解及其对应的适应度。

三、多目标粒子群算法在配电网储能选址定容中的应用多目标粒子群算法在配电网储能选址定容问题中具有很好的应用前景。

该问题涉及到多个目标函数,如储能设备的投资成本、运行维护费用、电网的运行安全性等。

MOPSO 可以通过调整目标函数权重,很好地平衡这些目标之间的关系,从而找到最优的储能设备容量和位置。

四、多目标粒子群优化算法的优缺点MOPSO 的优点在于其全局搜索能力,能够处理多个目标函数,并在搜索过程中自动平衡各目标之间的关系。

粒子群算法原理及其在函数优化中的应用1 粒子群优化(PSO )算法基本原理1.1 标准粒子群算法假设在一个D 维的目标搜索空间中,有m 个代表问题潜在解的粒子组成一个种群12[,,...,]m =x x x x ,第i 个粒子的信息可用D 维向量表示为12[,,...,]T i i i iD x x x =x ,其速度为12[,,...,]T i i i iD v v v =v 。

算法首先初始化m 个随机粒子,然后通过迭代找到最优解。

每一次迭代中,粒子通过跟踪2个极值进行信息交流,一个是第i 个粒子本身找到的最优解,称之为个体极值,即12[,,...,]T i i i iD p p p =p ;另一个是所有粒子目前找到的最优解,称之为群体极值,即12[,,...,]T g g g gD p p p =p 。

粒子在更新上述2个极值后,根据式(1)和式(2)更新自己的速度和位置。

11122()()t t t t t t i i i i g i w c r c r +=+-+-v v p x p x(1)11t t t i i i ++=+x x v (2)式中,t 代表当前迭代次数,12,r r 是在[0,1]之间服从均匀分布的随机数,12,c c 称为学习因子,分别调节粒子向个体极值和群体极值方向飞行的步长,w 为惯性权重,一般在0.1~0.9之间取值。

在标准的PSO 算法中,惯性权重w 被设为常数,通常取0.5w =。

在实际应用中,x 需保证在一定的范围内,即x 的每一维的变化范围均为min max [,]X X ,这在函数优化问题中相当于自变量的定义域。

1.2 算法实现步骤步骤1:表示出PSO 算法中的适应度函数()fitness x ;(编程时最好以函数的形式保存,便于多次调用。

)步骤2:初始化PSO 算法中各个参数(如粒子个数,惯性权重,学习因子,最大迭代次数等),在自变量x 定义域内随机初始化x ,代入()fitness x 求得适应度值,通过比较确定起始个体极值i p 和全局极值g p 。

Matlab技术粒子群算法随着科学技术的快速发展,计算机已经成为了解决各种各样问题的强大工具。

在计算机科学领域中,有许多热门的算法被广泛应用于解决不同类型的问题。

其中,粒子群算法(Particle Swarm Optimization,PSO)是一种模拟鸟群或鱼群等生物群体行为的优化算法,广泛用于解决许多实际问题。

Matlab是一个功能强大的数值计算与科学数据可视化环境,被广泛用于工程、科学计算、数据分析等领域。

利用Matlab语言编写的程序,可以高效地实现各种算法并对其进行测试和优化。

在解决优化问题时,结合使用Matlab和PSO算法能够提供一种高效、准确的解决方案。

粒子群算法的基本思想是通过模仿鸟群或鱼群等生物群体中个体的行为特征,寻找问题的最优解。

在PSO算法中,候选解被看作是个体,称之为粒子。

每个粒子的位置代表候选解在搜索空间中的位置,速度则代表其搜索方向和速度。

通过不断的迭代更新粒子的位置和速度,使得每个粒子逐渐接近全局最优解,从而找到问题的最优解。

Matlab提供了一套完整的粒子群算法工具箱,可以方便地实现PSO算法,并对其进行测试和优化。

通过使用Matlab中的函数和工具,用户可以根据自己的需求,灵活地定义问题的目标函数、约束条件和搜索空间。

在实际应用中,通过调节PSO算法中的参数,如粒子数量、迭代次数、惯性权重等,可以进一步调优算法性能,提高求解效率。

除了标准的粒子群算法,Matlab还提供了一系列针对特定问题的改进算法,如多目标粒子群优化算法、离散粒子群算法等。

这些改进算法的引入,使得PSO算法在各个领域的实际问题中都能得到有效运用。

粒子群算法在许多领域都有广泛的应用。

例如,在工程领域中,PSO算法被用于电力系统优化、电机设计、机器人路径规划等问题的求解。

在经济领域中,PSO算法被用于股票交易策略优化、投资组合优化等。

在生物学和医学领域中,PSO算法被用于分子结构预测、药物分子筛选等。

粒子裙优化(Particle Swarm Optimization, PSO)是一种常见的启发式算法,广泛应用于解决优化问题。

随机森林(Random Forest, RF)则是一种强大的集成学习方法,能够有效地处理分类和回归问题。

本文将结合粒子裙优化和随机森林,利用Matlab进行实现和案例分析。

一、粒子裙优化(PSO)简介1. PSO的基本原理粒子裙优化是一种模拟裙体智能的算法,其基本原理源自鸟裙觅食的行为。

算法中的每个个体都被称为“粒子”,粒子在解空间中搜索最优解,通过不断地调整自身位置和速度来不断优化解。

PSO算法由Kennedy和Eberhart于1995年提出,经过多年的发展已成为一种成熟的优化算法。

2. PSO的优点和缺点PSO算法具有较好的全局寻优能力和较快的收敛速度,尤其适合于连续优化问题。

然而,PSO算法对于高维问题和局部最优解的跳出存在一定的挑战,需要结合其他算法进行改进和优化。

二、随机森林(RF)简介1. RF的基本原理随机森林是一种集成学习方法,它通过构建多个决策树模型并集成它们的预测结果来达到更好的分类和回归效果。

RF算法由Leo Breiman和Adele Cutler于2001年提出,它在训练每棵树时采用自助采样和随机特征选择,以增加模型的多样性和鲁棒性。

2. RF的优点和缺点随机森林拥有良好的鲁棒性、较强的抗过拟合能力和较好的可解释性,常用于处理高维数据和特征选择。

然而,随机森林也存在一定的计算成本和模型解释能力不足的问题,需要根据具体情况进行权衡和选择。

三、粒子裙优化与随机森林的结合1. 优化随机森林的参数粒子裙优化可以用于优化随机森林的参数,如决策树数量、最大深度、最小叶子节点数等。

通过PSO算法对这些参数进行搜索和调整,可以得到更好的模型性能和泛化能力。

2. 选择最优特征子集在随机森林建模过程中,可以利用粒子裙优化算法选择最优的特征子集,从而提高模型的预测精度和降低计算成本。

基于MATLAB的粒子群优化算法程序设计一、概述粒子群优化(Particle Swarm Optimization,PSO)算法是一种基于群体智能的优化搜索技术,它通过模拟鸟群、鱼群等动物群体的社会行为,利用群体中的个体信息共享机制,引导粒子在解空间中搜索最优解。

自1995年由Eberhart博士和Kennedy博士提出以来,PSO 算法因其简单、高效的特点,在函数优化、神经网络训练、模糊系统控制等多个领域得到了广泛的应用。

在MATLAB环境中实现粒子群优化算法,可以充分利用MATLAB强大的数值计算能力和高效的编程环境,实现算法的快速开发和优化。

MATLAB具有简单易用的语法和丰富的函数库,使得开发者能够快速地构建算法模型,进行仿真实验,并对算法性能进行分析和评估。

基于MATLAB的粒子群优化算法程序设计,旨在提供一个完整的算法实现框架,帮助读者理解PSO算法的基本原理和实现细节。

通过该程序设计,读者可以掌握如何在MATLAB中构建粒子群优化算法,如何设置算法参数,如何进行仿真实验,并如何分析和评估算法性能。

该程序设计还可以作为进一步研究和开发粒子群优化算法的基础,为实际应用提供有力的技术支持。

1. 粒子群优化算法(PSO)简介粒子群优化算法(Particle Swarm Optimization, PSO)是一种群体智能优化技术,起源于对鸟群觅食行为的社会心理学模拟。

该算法通过模拟鸟群中的信息共享机制,使得每个个体(粒子)能够在解空间中不断更新自己的位置和速度,从而寻找到问题的最优解。

PSO 算法以其简单、易实现和高效的特点,在函数优化、神经网络训练、模糊系统控制等多个领域得到了广泛应用。

在PSO算法中,每个粒子都代表着问题解空间中的一个候选解,它们根据自己的飞行经验以及群体中最优粒子的飞行经验来调整自己的飞行轨迹。

粒子的位置信息对应着问题的解,而粒子的速度则决定了其搜索解空间的方向和步长。

粒子群算法原理粒子群算法(Particle Swarm Optimization, PSO)是一种基于群体智能的优化算法,最早由Kennedy和Eberhart于1995年提出。

它是一种模拟鸟群觅食行为的优化算法,通过模拟鸟群中个体之间的信息共享和协作来寻找最优解。

粒子群算法在优化问题中具有较高的效率和鲁棒性,被广泛应用于工程优化、机器学习、神经网络训练等领域。

粒子群算法的原理基于群体智能的思想,通过模拟群体中个体之间的信息交流和协作来寻找最优解。

在粒子群算法中,每个解被称为一个粒子,粒子具有位置和速度两个属性。

在搜索过程中,每个粒子根据自身的经验和群体的经验来调整自己的位置和速度,以寻找最优解。

粒子群算法的基本原理可以概括为以下几个步骤:1. 初始化粒子群,首先随机生成一定数量的粒子,并为每个粒子随机赋予初始位置和速度。

2. 评估粒子适应度,根据问题的优化目标,计算每个粒子的适应度值,即目标函数的取值。

适应度值越高表示粒子的解越优秀。

3. 更新粒子的速度和位置,根据粒子群算法的更新规则,更新每个粒子的速度和位置。

通常情况下,粒子的速度和位置会受到个体最优解和群体最优解的影响。

4. 更新个体最优解和群体最优解,根据每个粒子的适应度值,更新个体最优解和群体最优解。

个体最优解是粒子自身搜索过程中找到的最优解,而群体最优解是所有粒子中适应度值最高的解。

5. 终止条件判断,在满足一定条件下,如达到最大迭代次数或者适应度值满足一定要求时,终止算法并输出最优解。

粒子群算法的优势在于其简单、易于实现、对参数不敏感等特点。

此外,粒子群算法还具有较好的全局搜索能力和收敛速度,能够有效地应用于多种优化问题中。

总之,粒子群算法是一种基于群体智能的优化算法,通过模拟个体之间的信息共享和协作来寻找最优解。

它具有较高的效率和鲁棒性,被广泛应用于工程优化、机器学习、神经网络训练等领域。

希望通过本文的介绍,读者能对粒子群算法有一个更深入的了解,并能够在实际问题中灵活运用。

粒子群优化算法matlab 和python[粒子群优化算法matlab 和python]【引言】粒子群优化算法(Particle Swarm Optimization,PSO)是一种仿生智能算法,模拟了鸟群觅食行为中的集体智慧。

其简单易实现、全局优化能力强的特点使得它在工程优化问题中得到了广泛应用。

本文将以Matlab 和Python作为开发环境,详细介绍粒子群优化算法实现的步骤。

【PSO的基本原理】粒子群优化算法源于对鸟群觅食行为的研究,其中的个体被称为粒子。

每个粒子的位置表示一个待优化问题的解,在解空间中搜索最优解。

粒子具有速度和位置两个属性,速度决定了粒子在解空间中的搜索方向和距离。

在每一代迭代中,粒子根据自身的历史最优解和全局最优解来更新自己的速度和位置。

具体更新的公式如下:v_i ←w * v_i + c1 * r1 * (pbest_i - x_i) + c2 * r2 * (gbest - x_i)x_i ←x_i + v_i其中,v_i表示粒子i的速度,x_i表示粒子i的位置,pbest_i表示粒子i 的历史最优解,gbest表示全局最优解,w、c1、c2分别为权重,r1和r2为随机数。

【Matlab实现步骤】1. 初始化粒子群:给定粒子的个数、速度范围、位置范围,随机初始化粒子的位置和速度。

2. 计算适应度值:根据问题的具体定义,计算每个粒子的适应度值。

3. 更新速度和位置:根据PSO的公式,更新每个粒子的速度和位置。

4. 更新个体最优解和全局最优解:根据适应度值,更新每个粒子的个体最优解和全局最优解。

5. 判断停止条件:当达到预定的迭代次数或满足特定的停止准则时,结束优化过程。

6. 输出结果:根据实际需求,输出最优解或其他相关结果。

【Python实现步骤】1. 导入所需库:在Python中,首先需要导入相应的库(例如numpy、random等)来辅助实现PSO算法。

2. 定义问题函数:根据具体问题的定义,编写函数计算适应度值。

一、粒子群算法概述粒子群优化算法(PSO)是一种进化计算技术(evolutionarycomputation),1995年由Eberhart博士和kennedy博士提出,源于对鸟群捕食的行为研究。

该算法最初是受到飞鸟集群活动的规律性启发,进而利用群体智能建立的一个简化模型。

粒子群算法在对动物集群活动行为观察基础上,利用群体中的个体对信息的共享使整个群体的运动在问题求解空间中产生从无序到有序的演化过程,从而获得最优解。

?PSO中,每个优化问题的解都是搜索空间中的一只鸟。

我们称之为“粒子”。

所有的粒子都有一个由被优化的函数决定的适应值(fitnessvalue),每个粒子还有一个速度决定他们飞翔的方向和距离。

然后粒子们就追随当前的最优粒子在解空间中搜索。

?PSO初始化为一群随机粒子(随机解)。

然后通过迭代找到最优解。

在每一次迭代中,粒子通过跟踪两个”极值”来更新自己。

第一个就是粒子本身所找到的最优解,这个解叫做个体极值pBest。

另一个极值是整个种群目前找到的最优解,这个极值是全局极值gBest。

另外也可以不用整个种群而只是用其中一部分作为粒子的邻居,那么在所有邻居中的极值就是局部极值。

二、算法原理粒子群算法采用常数学习因子,及惯性权重,粒子根据如下的公式更新自己的速度和位置。

?V ki=ωk V i?1i+c1r1(Q bi?Q k?1i)+c2r2(Q bg?Q k?1i)Q ki=Q k?1i+V ki三、算法步骤1、随机初始化种群中各微粒的位置和速度;?2、评价个粒子的适应度,将各粒子的位置和适应度储存在各微粒的pbest(Qbi)中,将所有pbest中适应度最优的个体的位置和适应度存储在gbest(Qbg)中。

?3、更新粒子的速度和位移。

?Vki=ωkVi?1i+c1r1(Qbi?Qk?1i)+c2r2(Qbg?Qk?1i)Qki=Qk?1i+Vki4、对每个微粒,与其前一个最优位置比较,如果较好,则将其作为当前的最优位置。

基本粒子群算法的原理和matlab程序

作者——niewei120(nuaa)

一、粒子群算法的基本原理

粒子群优化算法源自对鸟群捕食行为的研究,最初由Kennedy和Eberhart提出,是一种通

用的启发式搜索技术。一群鸟在区域中随机搜索食物,所有鸟知道自己当前位置离食物多远,

那么搜索的最简单有效的策略就是搜寻目前离食物最近的鸟的周围区域。PSO 算法利用这

种模型得到启示并应用于解决优化问题。PSO 算法中,每个优化问题的解都是粒子在搜索

空间中的位置,所有的粒子都有一个被优化的目标函数所决定的适应值,粒子还有一个速度

值决定它们飞翔的方向和距离,然后粒子群就追随当前的最优粒子在解空间中搜索。

PSO 算法首先在给定的解空间中随机初始化粒子群,待优化问题的变量数决定了解空间的

维数。每个粒子有了初始位置与初始速度。然后通过迭代寻优。在每一次迭代中,每个粒子

通过跟踪两个“极值”来更新自己在解空间中的空间位置与飞翔速度。第一个极值就是单个

粒子本身在迭代过程中找到的最优解粒子,这个粒子叫做个体极值。另一个极值是种群所

有粒子在迭代过程中所找到的最优解粒子,这个粒子是全局极值。上述的方法叫全局粒子群

算法。如果不用种群所有粒子而只用其中一部分作为该粒子的邻居粒子,那么在所有邻居粒

子中的极值就是局部极值,该方法称为局部PSO 算法。

速度、位置的更新方程表示为:

每个粒子自身搜索到的历史最优值p

i ,pi=(pi1,pi2,....,piQ

),i=1,2,3,....,n。所有粒子搜索

到的最优值p

g,pg=(pg1,pg2,....,pgQ),注意这里的pg

只有一个。

是保持原来速度的系数,所以叫做惯性权重。

是粒子跟踪自己历史最优值的权重系数,它表示粒子自身的认识,所以叫“认知”。通常

设置为2。

是粒子跟踪群体最优值的权重系数,它表示粒子对整个群体知识的认识,所以叫做“社会

知识”,经常叫做“社会”。通常设置为2。

是[0,1]区间内均匀分布的随机数。

是对位置更新的时候,在速度前面加的一个系数,这个系数我们叫做约束因子。通常设

置为1

。