幂法及反幂法

- 格式:doc

- 大小:115.00 KB

- 文档页数:5

数值分析幂法和反幂法数值分析中的幂法和反幂法是求解矩阵最大特征值和最小特征值的常用方法。

这两种方法在许多数值计算问题中都有着广泛的应用,包括图像压缩、数据降维、谱聚类等。

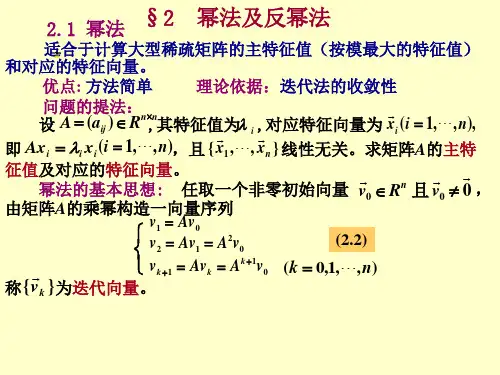

幂法(Power Method)是一种迭代算法,通过不断迭代矩阵与一个向量的乘积,来逼近原矩阵的最大特征值和对应的特征向量。

其基本思想是,对于一个矩阵A和一维向量x,可以通过不断迭代计算Ax,Ax,Ax...,来使得向量x逼近最大特征值对应的特征向量。

具体的迭代过程如下:1.初始化一个向量x0(可以是单位向量或任意非零向量)2.令x1=Ax0,对向量进行归一化(即除以向量的范数)得到x13.重复步骤2,即令x2=Ax1,x3=Ax2...,直到收敛(即相邻迭代向量的差的范数小于一些阈值)为止4. 最终得到的向量xn就是A的最大特征值对应的特征向量在实际求解时,我们可以将迭代过程中的向量进行归一化,以防止数值溢出或下溢。

此外,为了提高迭代速度,我们可以选择使得xn与xn-1的内积大于0的方向作为迭代方向,这样可以使得特征值的模快速收敛到最大特征值。

幂法的收敛性是保证的,但收敛速度可能较慢,尤其是当最大特征值与其他特征值非常接近时。

此时可能需要使用一些改进的方法来加速收敛,例如Rayleigh商或位移策略。

相反,反幂法(Inverse Power Method)是求解矩阵的最小特征值和对应的特征向量的方法。

它的基本思想和幂法类似,但在每次迭代中,需要计算A和依其逆矩阵A-1的乘积。

迭代过程如下:1.初始化一个向量x0(可以是单位向量或任意非零向量)2.令x1=A-1x0,对向量进行归一化(即除以向量的范数)得到x13.重复步骤2,即令x2=A-1x1,x3=A-1x2...4. 最终得到的向量xn就是A的最小特征值对应的特征向量反幂法和幂法的区别在于迭代过程中乘以了A的逆矩阵,从而可以利用矩阵的特殊结构或性质来提高迭代速度。

同时,在实际求解时,可能需要将矩阵进行一些变换,以确保A-1存在或数值稳定性。

幂的运算所有法则和逆运算法则幂的运算法则包括乘法法则、除法法则和幂的指数法则。

逆运算法则包括开平方运算和对数运算。

下面将详细介绍这些法则。

一、幂的乘法法则:对于任意实数a和正整数n,有:a^n*a^m=a^(n+m)这条乘法法则表明,当两个幂具有相同的底数时,可以将底数保持不变,指数相加得到新的指数。

二、幂的除法法则:对于任意实数a和正整数n,有:a^n/a^m=a^(n-m)这条除法法则表明,当两个幂具有相同的底数时,可以将底数保持不变,指数相减得到新的指数。

三、幂的指数法则:1.幂的幂法则:对于任意实数a和正整数n、m,有:(a^n)^m=a^(n*m)这条指数法则表明,当一个幂的指数再次被指数化时,可以将指数相乘得到新的指数。

2.幂的乘法法则的推广:对于任意实数a和正整数n_1,n_2,...,n_k,有:a^(n_1)*a^(n_2)*...*a^(n_k)=a^(n_1+n_2+...+n_k)这条指数法则表示,当一个底数出现多次相乘时,可以将所有指数相加得到新的指数。

3.幂的除法法则的推广:对于任意实数a和正整数n_1,n_2,...,n_k,有:a^(n_1)/a^(n_2)/.../a^(n_k)=a^(n_1-n_2-...-n_k)这条指数法则表示,当一个底数出现多次相除时,可以将所有指数相减得到新的指数。

四、逆运算法则:1.幂的开平方运算:对于任意非负实数a和正整数n(a^(1/n))^n=a这条逆运算法则表示,当一个数的n次幂再开n次方时,可以得到该数本身。

2.幂的对数运算:对于任意正实数a、b和正整数n,有:log(base a)(a^n) = n这条逆运算法则表示,当一个数的n次幂再以底数a进行对数运算时,可以得到n。

总结:幂的运算法则包括乘法法则、除法法则和幂的指数法则。

乘法法则指出当两个幂具有相同底数时,可以将指数相加;除法法则指出当两个幂具有相同底数时,可以将指数相减;指数法则包括幂的幂法则和幂的乘法法则的推广,指数可以相乘得到新的指数。

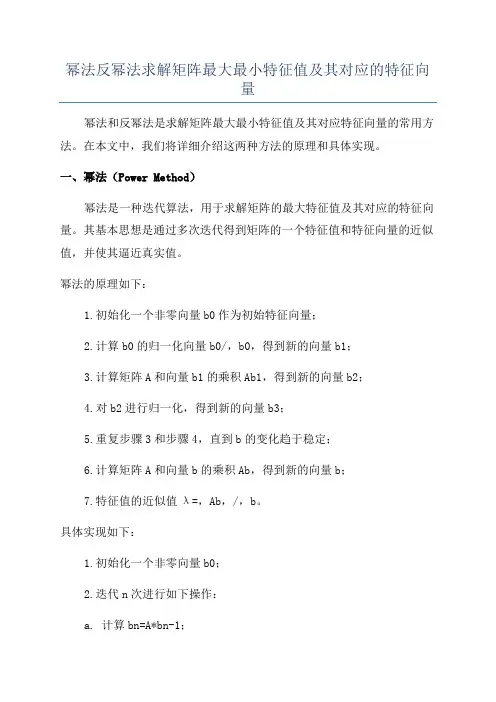

幂法反幂法求解矩阵最大最小特征值及其对应的特征向量幂法和反幂法是求解矩阵最大最小特征值及其对应特征向量的常用方法。

在本文中,我们将详细介绍这两种方法的原理和具体实现。

一、幂法(Power Method)幂法是一种迭代算法,用于求解矩阵的最大特征值及其对应的特征向量。

其基本思想是通过多次迭代得到矩阵的一个特征值和特征向量的近似值,并使其逼近真实值。

幂法的原理如下:1.初始化一个非零向量b0作为初始特征向量;2.计算b0的归一化向量b0/,b0,得到新的向量b1;3.计算矩阵A和向量b1的乘积Ab1,得到新的向量b2;4.对b2进行归一化,得到新的向量b3;5.重复步骤3和步骤4,直到b的变化趋于稳定;6.计算矩阵A和向量b的乘积Ab,得到新的向量b;7.特征值的近似值λ=,Ab,/,b。

具体实现如下:1.初始化一个非零向量b0;2.迭代n次进行如下操作:a. 计算bn=A*bn-1;b. 将bn进行归一化,得到bn=bn/,bn;3. 计算特征值的近似值lambda=,A*bn,/,bn;4. 特征向量的近似值vbn=bn。

幂法的优点是计算简单、迭代次数少,但对于含有多个特征值接近的矩阵,可能会收敛到次大特征值。

二、反幂法(Inverse Power Method)反幂法是幂法的拓展,用于求解矩阵的最小特征值及其对应的特征向量。

其基本思想是通过多次迭代得到矩阵的一个特征值和特征向量的近似值,并使其逼近真实值。

反幂法的原理如下:1.初始化一个非零向量b0作为初始特征向量;2.计算b0的归一化向量b0/,b0,得到新的向量b1;3.计算矩阵A的逆矩阵Ai和向量b1的乘积Ai*b1,得到新的向量b2;4.对b2进行归一化,得到新的向量b3;5.重复步骤3和步骤4,直到b的变化趋于稳定;6.计算矩阵A的逆矩阵Ai和向量b的乘积Ai*b,得到新的向量b;7.特征值的近似值λ=,Ai*b,/,b。

具体实现如下:1.初始化一个非零向量b0;2.迭代n次进行如下操作:a. 计算bn=inv(A)*bn-1;b. 将bn进行归一化,得到bn=bn/,bn;3. 计算特征值的近似值lambda=,inv(A)*bn,/,bn;4. 特征向量的近似值vbn=bn。

矩阵特征值快速求法矩阵特征值是矩阵分析中十分重要的概念。

它在物理、工程、数学等许多领域都有着广泛的应用。

矩阵特征值是指矩阵运动时特殊的运动状态,是一种宏观量度矩阵运动的指标。

求解矩阵特征值是一项复杂的任务,通常需要使用高级算法来完成。

本文将介绍几种常用的求解矩阵特征值的算法,其中包括幂法、反幂法、QR算法、分裂Broyden算法等。

一、幂法幂法是求解矩阵特征值的一种基础算法,其基本思想是通过迭代来逐步逼近矩阵的最大特征值。

幂法的核心公式如下:x_(k+1)=A*x_k/||A*x_k||其中,x_k表示第k次迭代中得到的特征向量,A表示原始矩阵。

幂法通过不断的迭代来逼近A的最大特征值,当迭代次数趋近于无限大时,得到的特征向量就是A的最大特征值所对应的特征向量。

幂法的运算量较小,适用于比较简单的矩阵。

反幂法与幂法类似,不同之处在于每次迭代时采用的是A的逆矩阵来进行计算。

其核心公式如下:x_(k+1)=(A-λI)^(-1)*x_k其中,λ表示要求解的特征值。

反幂法能够求解非常接近于特征值λ的特征向量,并且对于奇异矩阵同样适用。

需要注意的是,在实际计算中,如果A-λI的秩不满,那么反幂法就无法使用。

三、QR算法1. 将原矩阵A进行QR分解,得到A=Q*R。

2. 计算A的近似特征矩阵A1=R*Q。

5. 重复步骤3-4,直到A的对角线元素全部趋近于所求特征值为止。

QR算法的计算量较大,但其具有收敛速度快、精度高等优点,广泛应用于科学计算中。

四、分裂Broyden算法分裂Broyden算法是QR算法的一种改进算法,其基本思想是将矩阵分解成上下三角形式,然后再对其进行QR分解,以减少QR算法中的乘法运算量。

具体实现过程如下:2. 构造一个倒数矩阵B=U^(-1)*L^(-1)。

4. 计算A的近似特征矩阵A1=Q^(-1)*L^(-1)*A*R^(-1)*U^(-1)*Q。

分裂Broyden算法的计算量较小,能够有效地解决QR算法中的乘法运算量过大的问题。

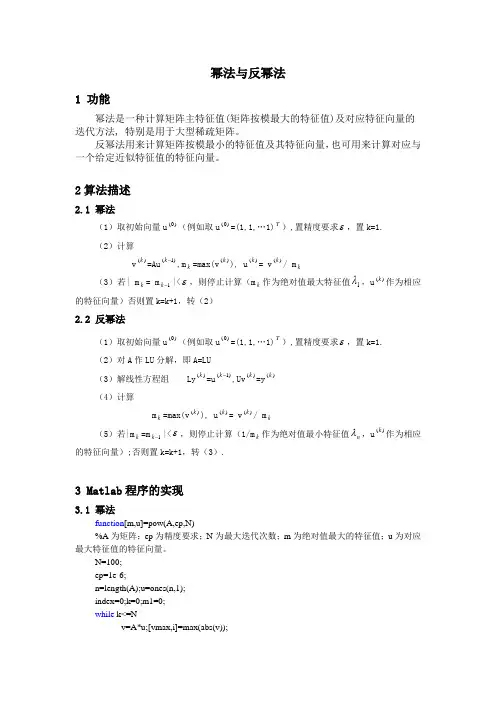

幂法与反幂法1 功能 幂法是一种计算矩阵主特征值(矩阵按模最大的特征值)及对应特征向量的迭代方法, 特别是用于大型稀疏矩阵。

反幂法用来计算矩阵按模最小的特征值及其特征向量,也可用来计算对应与一个给定近似特征值的特征向量。

2算法描述2.1 幂法(1)取初始向量u)0((例如取u )0(=(1,1,…1)T ),置精度要求ε,置k=1. (2)计算v )(k =Au )1(-k ,m k =max(v )(k ), u )(k = v )(k / m k(3)若| m k = m 1-k |<ε,则停止计算(m k 作为绝对值最大特征值1λ,u)(k 作为相应的特征向量)否则置k=k+1,转(2) 2.2 反幂法(1)取初始向量u )0((例如取u )0(=(1,1,…1)T),置精度要求ε,置k=1. (2)对A 作LU 分解,即A=LU(3)解线性方程组 Ly)(k =u )1(-k ,Uv )(k =y )(k (4)计算m k =max(v )(k ), u )(k = v )(k / m k(5)若|m k =m 1-k |<ε,则停止计算(1/m k 作为绝对值最小特征值n λ,u)(k 作为相应的特征向量);否则置k=k+1,转(3).3 Matlab 程序的实现3.1 幂法function [m,u]=pow(A,ep,N)%A 为矩阵;ep 为精度要求;N 为最大迭代次数;m 为绝对值最大的特征值;u 为对应最大特征值的特征向量。

N=100;ep=1e-6;n=length(A);u=ones(n,1);index=0;k=0;m1=0;while k<=Nv=A*u;[vmax,i]=max(abs(v));m=v(i);u=v/m;if abs(m-m1)<epindex=1;break;endm1=m;k=k+1;end输入:A=[7 3 -2;3 4 -1;-2 -1 3];[m,u]=pow(A,1e-6) Enter结果:m = 9.6056u =1.00000.6056-0.39444.2 反幂法function[m ,u]=pow_inv(A,ep,N)%A为矩阵;ep为精度要求;N为最大迭代次数;m为绝对值最大的特征值;u为对应最大特征值的特征向量。

数值分析幂法和反幂法数值分析中,幂法(Power method)和反幂法(Inverse Power method)是求解矩阵的特征值和特征向量的两种常用方法。

它们都是通过迭代过程逼近特征值和特征向量。

1.幂法:幂法是求解矩阵的最大特征值和对应的特征向量的一种迭代方法。

幂法的原理是通过迭代过程,将一个任意选择的初始向量不断与矩阵相乘,使其逼近对应最大特征值的特征向量。

幂法的迭代公式为:$x^{(k+1)} = \frac{Ax^{(k)}}{\,Ax^{(k)}\,}$幂法的迭代过程是不断对向量进行归一化,使其逐渐逼近最大特征值对应的特征向量。

当迭代次数足够多时,可以得到非常接近最大特征值的估计。

2.反幂法:反幂法是幂法的一种变形,用于求解矩阵的最小特征值和对应的特征向量。

反幂法的原理是通过迭代过程,将一个任意选择的初始向量不断与矩阵的逆相乘,使其逼近对应最小特征值的特征向量。

反幂法的迭代公式为:$x^{(k+1)} = \frac{A^{-1}x^{(k)}}{\,A^{-1}x^{(k)}\,}$反幂法的迭代过程同样是不断对向量进行归一化,使其逐渐逼近最小特征值对应的特征向量。

当迭代次数足够多时,可以得到非常接近最小特征值的估计。

3.收敛性分析:幂法和反幂法的收敛性分析与矩阵的特征值分布有关。

对于幂法而言,如果矩阵$A$的最大特征值是唯一的,并且其他特征值的绝对值小于最大特征值的绝对值,那么幂法是收敛的,而且收敛速度是指数级的。

对于反幂法而言,如果矩阵$A$的最小特征值是唯一的,并且其他特征值的绝对值大于最小特征值的绝对值,那么反幂法是收敛的,而且同样是指数级的收敛速度。

4.实际应用:幂法和反幂法在实际中广泛应用于各个领域,例如物理、工程、计算机科学等。

比如在结构力学中,幂法可以用来求解结构的自振频率和相应的振型;在电力系统中,反幂法可以用来求解电力系统决定性特征值,例如功率稳定性的最小特征值。

幂法,反幂法求解矩阵最大最小特征值及其对应的特征向量数值计算解矩阵的按模最大最小特征值及对应的特征向量一.幂法1. 幂法简介:当矩阵A满足一定条件时,在工程中可用幂法计算其主特征值(按模最大) 及其特征向量。

矩阵A需要满足的条件为:|,|,|,|,...,|,|,0,,为A的特征值(1) 12nix,x,...,x(2) 存在n个线性无关的特征向量,设为 12n1.1计算过程:n(0)(0)对任意向量x,有x,,u,,不全为0,则有 ,iii,1i(k,1)(k)k,1(0),,,xAx...Axnn11k,k,,,Aαuαλu,,iiiii11i,i,,,,, k,1k,1k,1n2,,,,,λu()au?()au11122nn,,,,11,,k,1,,,u111,2||可见,当越小时,收敛越快;且当k充分大时,有,111(k,)k,1(k,),,,xu,x,111(k,1),,,,x1,对应的特征向量即是。

)(k)(kkx,xu,,,111,2 算法实现,(1).输入矩阵A,初始向量x,误差限,最大迭代次数N(k)x(k),(2).k,1,,0;y,(k)max(abs(x),(3).计算x,Ay,,max(x);,,,,(4).若|,|,,输出,y,否则,转(5)(5).若 k,N, 置k,k,1,,,,,转3 ,否则输出失败信息,停机.3 matlab程序代码function [t,y]=lpowerA,x0,eps,N) % t 为所求特征值,y是对应特征向量k=1;, z=0; % z 相当于y=x0./max(abs(x0)); % 规范化初始向量x=A*y; % 迭代格式b=max(x); % b 相当于 ,if abs(z-b)<eps % 判断第一次迭代后是否满足要求t=max(x);return;endwhile abs(z-b)>eps && k<Nk=k+1;z=b;y=x./max(abs(x));x=A*y;b=max(x);end[m,index]=max(abs(x)); % 这两步保证取出来的按模最大特征值t=x(index); % 是原值,而非其绝对值。

幂法反幂法求解矩阵最大最小特征值及其对应的特征向量幂法是一种迭代算法,用于求解矩阵的最大特征值及其对应的特征向量。

反幂法是幂法的一种变体,用于求解矩阵的最小特征值及其对应的特征向量。

两种方法在求解特征值问题时有相似的步骤,但反幂法需要对矩阵进行一定的变换。

幂法的基本思想是通过不断迭代的方式逼近矩阵的最大特征值及其对应的特征向量。

求解的过程如下:1.随机选择一个初始向量x0,并进行归一化,即使其模长为12. 根据公式计算新的向量xk+1 = Axk,其中A为待求解特征值的矩阵。

3. 对xk+1进行归一化。

4. 计算矩阵A关于xk+1的雷神特征值λk+1 = (Axk+1)·xk+1 / xk+1·xk+1,其中·表示向量的内积。

5.重复步骤2至4,直到满足收敛条件。

幂法的收敛条件一般是设置一个精度,当迭代的过程中特征向量的变化小于该精度时,认为结果已经收敛。

最终得到的特征值就是矩阵A的最大特征值,对应的特征向量为收敛时的xk+1反幂法是对幂法的一种改进,用于求解矩阵的最小特征值及其对应的特征向量。

反幂法的基本思想是通过将矩阵A的特征值问题转化为矩阵B=(A-μI)^-1的特征值问题来求解,其中μ为一个非常接近待求解特征值的数。

求解的过程如下:1.随机选择一个初始向量x0,并进行归一化,即使其模长为12. 根据公式求解新的向量xk+1 = (A-μI)^-1xk,其中A为待求解特征值的矩阵,μ为一个非常接近待求解特征值的数。

3. 对xk+1进行归一化。

4. 计算矩阵B关于xk+1的雷神特征值λk+1 = (Bxk+1)·xk+1 / xk+1·xk+1,其中·表示向量的内积。

5.重复步骤2至4,直到满足收敛条件。

反幂法的收敛条件与幂法相似,一般也是设置一个精度。

最终得到的特征值就是矩阵A的最小特征值,对应的特征向量为收敛时的xk+1总结:幂法和反幂法是求解矩阵最大最小特征值的常用迭代算法。

随机产生一对称矩阵,对不同的原点位移和初值(至少取3个)分别使用幂法求计算矩阵的主特征值及主特征向量,用反幂法求计算矩阵的按模最小特征值及特征向量。

要求

1)比较不同的原点位移和初值说明收敛性 2)给出迭代结果,生成DOC 文件。

3)程序清单,生成M 文件。

解答:

>> A=rand(5) %随机产生5*5矩阵 求随机矩阵 A =

0.7094 0.1626 0.5853 0.6991 0.1493 0.7547 0.1190 0.2238 0.8909 0.2575 0.2760 0.4984 0.7513 0.9593 0.8407 0.6797 0.9597 0.2551 0.5472 0.2543 0.6551 0.3404 0.5060 0.1386 0.8143 >> B=A+A' %A 矩阵和A 的转置相加,得到随机对称矩阵B B =

1.4187 0.9173 0.8613 1.3788 0.8044 0.9173 0.2380 0.7222 1.8506 0.5979 0.8613 0.7222 1.5025 1.2144 1.3467 1.3788 1.8506 1.2144 1.0944 0.3929 0.8044 0.5979 1.3467 0.3929 1.6286

B=⎥⎥⎥

⎥⎥⎥⎦

⎤⎢⎢⎢

⎢⎢

⎢⎣⎡6286.13929.03467.15979.08044.03929.00944.12144.18506.13788.13467.12144.15025.17222.08613.05979.08506.17222.02380.09173.08044.03788.18613.09173.04187.1

编写幂法、反幂法程序:

function [m,u,index,k]=pow(A,u,ep,it_max)

% 求矩阵最大特征值的幂法,其中

% A为矩阵;

% ep为精度要求,缺省为1e-5;

% it_max为最大迭代次数,缺省为100;

% m为绝对值最大的特征值;

% u为对应最大特征值的特征向量;

% index,当index=1时,迭代成功,当index=0时,迭代失败if nargin<4

it_max=100;

end

if nargin<3

ep=1e-5;

end

n=length(A);

index=0;

k=0;

m1=0;

m0=0.01;

% 修改移位参数,原点移位法加速收敛,为0时,即为幂法

I=eye(n)

T=A-m0*I

while k<=it_max

v=T*u;

[vmax,i]=max(abs(v));

m=v(i);

u=v/m;

if abs(m-m1)<ep;

index=1;

break;

end

m=m+m0;

m1=m;

k=k+1;

end

function[m,u,index,k]=pow_inv(A,u,ep,it_max)

% 求矩阵最大特征值的反幂法,其中

% A为矩阵;

% ep为精度要求,缺省为1e-5;

% it_max为最大迭代次数,缺省为100;

% m为绝对值最大的特征值;

% u为对应最大特征值的特征向量;

% index,当index=1时,迭代成功,当index=0时,迭代失败if nargin<4

it_max=100;

end

if nargin<3

ep=1e-5;

end

n=length(A);

index=0;

k=0;

m1=0;

m0=0;

% 修改移位参数,原点移位法加速收敛,为0时,即为反幂法I=eye(n);

T=A-m0*I;

invT=inv(T);

while k<=it_max

v=invT*u;

[vmax,i]=max(abs(v));

m=v(i);

u=v/m;

if abs(m-m1)<ep

index=1;

break;

end

m1=m;

k=k+1;

end

m=1/m;

m=m+m0;

修改输入的m0的值,所得结果:

⎢⎣15

⎦。