第24卷第10期

Vol.24No.10

控 制 与 决 策

Cont rol

and

Decision

2009年10月

Oct.2009

收稿日期:2008210213;修回日期:2009203211.

基金项目:国家863计划项目(2007AA04Z226);北京市教委科技计划项目(KM200810005016).

作者简介:于乃功(1966—),男,山东潍坊人,教授,博士,从事机器人控制、机器视觉等研究;秦永钢(1984—

),男,山东临沂人,硕士,从事计算机视觉、立体视觉等研究.

文章编号:100120920(2009)1021568205

机械臂视觉伺服系统中的高精度实时特征提取

于乃功,秦永钢,阮晓钢

(北京工业大学电子信息与控制工程学院,北京100124)

摘 要:以机械臂视觉伺服系统为背景,立体视觉所需要的特征点为目标,提出一种基于颜色块的实时特征提取方法.特征点的定位分为粗定位和精定位两个过程,粗定位用来跟踪目标颜色块,精定位在粗定位的基础上,切出小图像并提取目标轮廓,利用K 2L 变换对轮廓点进行分类,并通过最小二乘法对边缘点进行拟合.根据直线方程计算顶点的亚像素精度坐标,为下一步的目标位姿测量提供基础.实验结果验证了该方法的有效性.关键词:视觉伺服;颜色块;目标跟踪;特征提取中图分类号:TP391.41 文献标识码:A

High accurate and real 2time feature extraction in visu al servoing

systems for robotic arms

YU N ai 2gong ,Q I N Yong 2gan g ,R UA N X i ao 2g ang

(Electronic Information and Control Engineering College ,Beijing University of Technology ,Beijing 100124,China.Correspondent :YU Nai 2gong ,E 2mail :yunaigong @https://www.doczj.com/doc/bc4538218.html, )

Abstract :With the background of visual servoing for robotic arms and with the aim of features required by stereo vision ,a method for real 2time feature extraction based on the block of color is presented.The localization of feature includes coarse location and fine location.The coarse location is used to track the object.On the basis of coarse location ,the fine location cuts a small image f rom the origin image ,extracts the contour of the object f rom the small image and classifies the contour by K 2L transform ,then fits the edge points by using lease square error method.The sub 2pixel coordinates of the feature points are calculated by the equations of lines ,which provides foundation for the measurement of object ’s pose and position.The experimental results show the effectivenees of the method.K ey w ords :Visual servoing ;Block of color ;Object tracking ;Feature extracting

1 引 言

机械臂视觉伺服系统在机器人领域具有重要的作用.传统的工业机械臂系统,一般采用示教或离线编程的方式对加工任务进行路径规划和运动编程,加工过程只是简单地重复预先编程设计的动作.当加工对象或者工作环境发生变化时,需要重新设计程序.而利用视觉系统,可以实时检测加工对象的信息,并对这些信息应用人工智能的理论和方法进行处理,从而提高机器人的智能化水平.借助机械臂视觉伺服系统不需要预先对机械臂的运动进行编程,可节约大量的编程时间,提高生产效率,进一步提高产品的加工质量.研究机械臂的实时视觉测量与控制系统,对于提高机械臂的加工质量和加工效率及拓展机械臂的应用范围具有十分重要的意义[1].

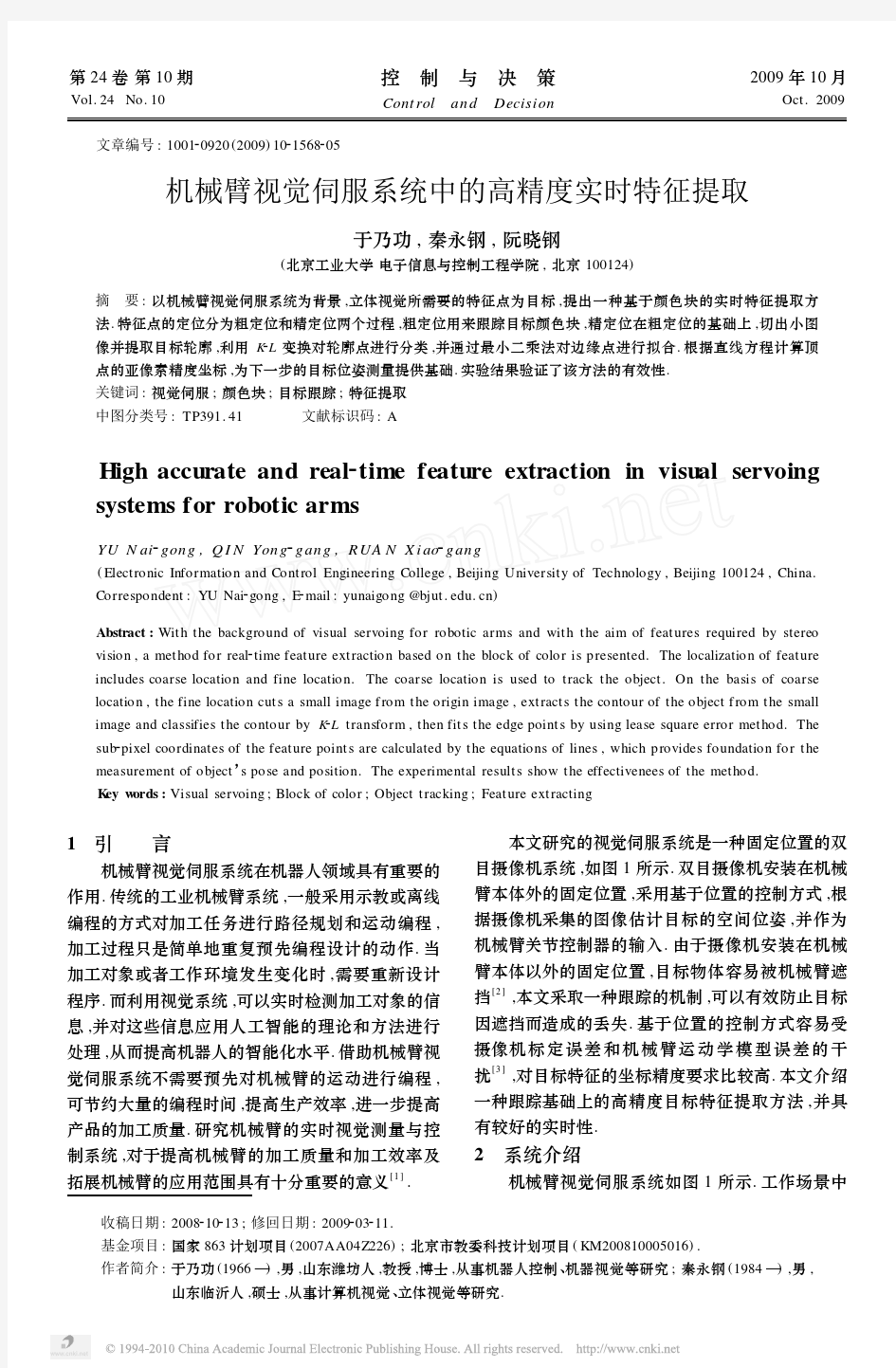

本文研究的视觉伺服系统是一种固定位置的双目摄像机系统,如图1所示.双目摄像机安装在机械臂本体外的固定位置,采用基于位置的控制方式,根据摄像机采集的图像估计目标的空间位姿,并作为机械臂关节控制器的输入.由于摄像机安装在机械臂本体以外的固定位置,目标物体容易被机械臂遮挡[2],本文采取一种跟踪的机制,可以有效防止目标因遮挡而造成的丢失.基于位置的控制方式容易受摄像机标定误差和机械臂运动学模型误差的干扰[3],对目标特征的坐标精度要求比较高.本文介绍一种跟踪基础上的高精度目标特征提取方法,并具有较好的实时性.

2 系统介绍

机械臂视觉伺服系统如图1所示.工作场景中

第10期于乃功等:机械臂视觉伺服系统中的高精度实时特征提取

有机械臂、带有矩形蓝色色标的目标物体及双目立体摄像机,其中摄像机的位置与机械臂基座的位置相对固定.假设世界坐标系为s w ,机械臂基座坐标系为s r ,摄像机坐标系为s c ,目标物体坐标系为s o ,色块坐标系为s k .根据标定原理,可以标定出s c 相对于靶标的转换矩阵,机械臂各关节的转换矩阵是已知的,因此可以标定出s r 相对于靶标的转换矩阵,利用矩阵变换可以计算出机械臂基座坐标系s r 与摄像机坐标系s c 的转换矩阵为r T c .色块根据目标特征的需要任意安装在目标物体上,可以借助第3方的三维测量工具,如激光测距仪、高精度的双目摄像机等,分别计算目标物体和色块在第3方测量工具坐标系中的位姿,利用矩阵变换获得目标物体坐标系与色块坐标系的转换矩阵为k T o

.

图1 机械臂视觉伺服系统

如图1所示,目标物体在场景中,视觉系统的作用是计算目标物体在摄像机坐标系中的位姿.由于色标的特征比较明显,测量色标在摄像机坐标系中的坐标较为方便.在此系统中,视觉系统的作用是计算色标在摄像机坐标系中的位姿,假设测得色标相对于摄像机坐标系的位姿为c P k .

根据上面信息,可以得到目标物体相对于机械

臂基座坐标系的位姿为r P o =r T c ?c P k ?k

T o ,其中r P o 为机械臂关节控制器的输入.

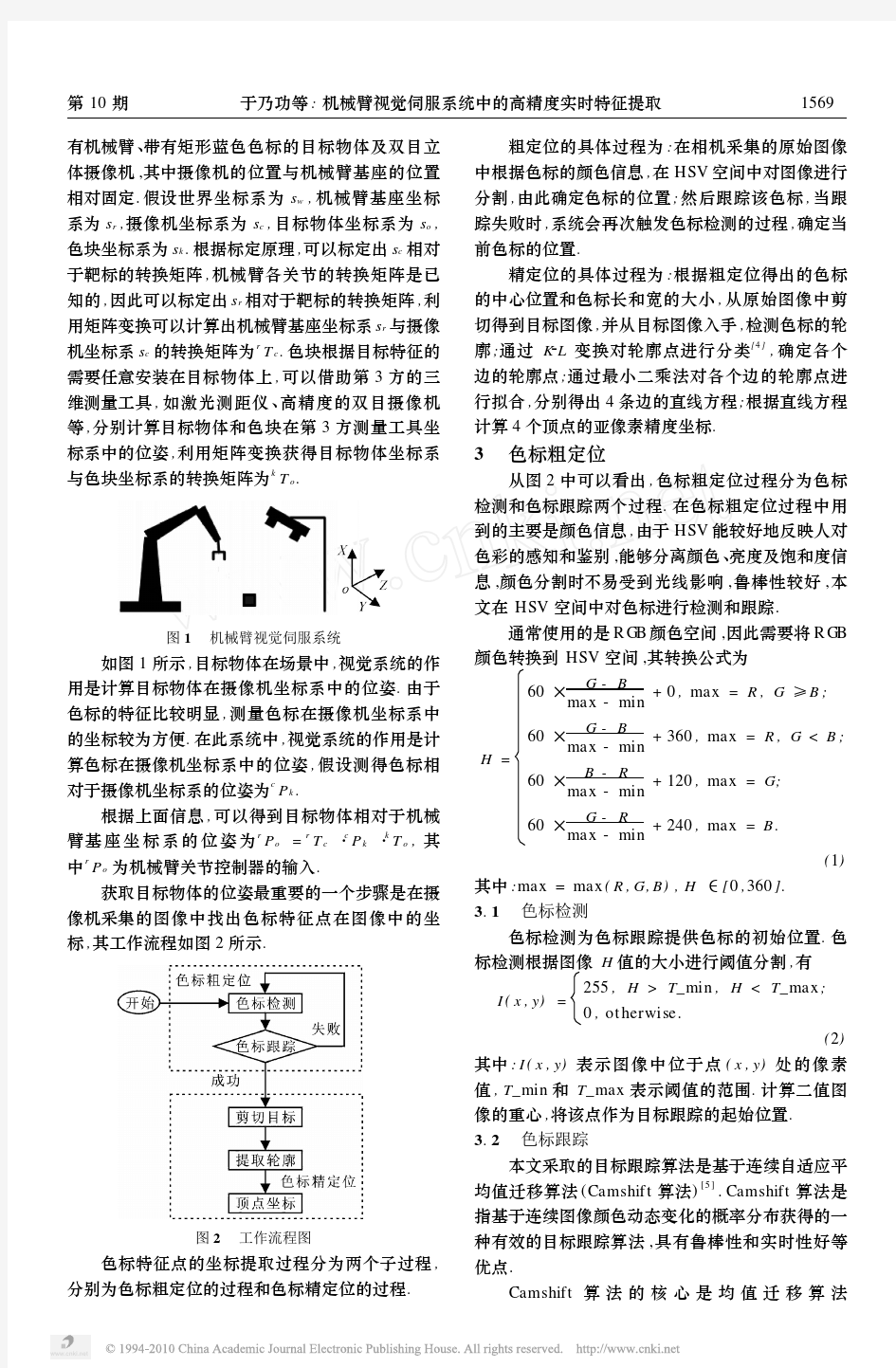

获取目标物体的位姿最重要的一个步骤是在摄像机采集的图像中找出色标特征点在图像中的坐标,其工作流程如图2所示

.

图2 工作流程图

色标特征点的坐标提取过程分为两个子过程,分别为色标粗定位的过程和色标精定位的过程.

粗定位的具体过程为:在相机采集的原始图像中根据色标的颜色信息,在HSV 空间中对图像进行分割,由此确定色标的位置;然后跟踪该色标,当跟踪失败时,系统会再次触发色标检测的过程,确定当前色标的位置.

精定位的具体过程为:根据粗定位得出的色标的中心位置和色标长和宽的大小,从原始图像中剪切得到目标图像,并从目标图像入手,检测色标的轮廓;通过K 2L 变换对轮廓点进行分类[4],确定各个边的轮廓点;通过最小二乘法对各个边的轮廓点进行拟合,分别得出4条边的直线方程;根据直线方程计算4个顶点的亚像素精度坐标.

3 色标粗定位

从图2中可以看出,色标粗定位过程分为色标检测和色标跟踪两个过程.在色标粗定位过程中用到的主要是颜色信息,由于HSV 能较好地反映人对色彩的感知和鉴别,能够分离颜色、亮度及饱和度信息,颜色分割时不易受到光线影响,鲁棒性较好,本文在HSV 空间中对色标进行检测和跟踪.

通常使用的是R G B 颜色空间,因此需要将R G B 颜色转换到HSV 空间,其转换公式为

H =

60×G -B

max -min +0,max =R ,G ≥B ;

60×G -B max -min +360,max =R ,G

60×B -R max -min +120,max =G;

60×G -R max -min

+240,max =B.

(1)

其中:max =max (R ,G,B ),H ∈[0,360].3.1 色标检测

色标检测为色标跟踪提供色标的初始位置.色标检测根据图像H 值的大小进行阈值分割,有

I (x ,y )=

255,H >T _min ,H 0,ot herwise. (2) 其中:I (x ,y )表示图像中位于点(x ,y )处的像素值,T _min 和T _max 表示阈值的范围.计算二值图像的重心,将该点作为目标跟踪的起始位置.3.2 色标跟踪 本文采取的目标跟踪算法是基于连续自适应平均值迁移算法(Camshift 算法)[5].Camshift 算法是指基于连续图像颜色动态变化的概率分布获得的一种有效的目标跟踪算法,具有鲁棒性和实时性好等优点. Camshift 算法的核心是均值迁移算法 9 651 控 制 与 决 策 第24卷 (Meanshift 算法),该算法是一种迭代算法,即先计 算出当前点的偏移均值,移动该点到其偏移均值;然后以此为新的起始点,继续移动,直到满足一定的条件结束.具体的算法过程如下: Step1:设定一个搜索窗口的大小;Step2:确定搜索窗口的初始位置;Step3:计算搜索窗口的质心; Step4:将新的搜索窗口的中心置于Step3得出 的质心位置; Step5:重复Step3和Step4,直至收敛. 在Step3中,对于颜色概率分布图像,搜索窗的质心计算过程如下: M 00=∑x ∑y I (x ,y ); (3) M 10=∑x ∑y x I (x ,y ), M 01= ∑x ∑ y y I (x ,y );(4)x c =M 10/M 00,y c =M 01/M 00. (5) 其中:M 00为零阶矩,M 10和M 01分别为X 和Y 的一 阶矩,x c 和y c 为搜索区域的质心,I (x ,y )为图像中位于点(x ,y )处的像素值,x 和y 在整个搜索窗口范围内取值. Camshift 算法根据需要寻找的目标颜色,得出图像的颜色概率分布图,然后在其搜索窗内使用Meanshift 算法,其算法流程如下: Step1:选择初始搜索窗的位置; Step2:使用Meanshift 算法进行迭代并保存窗 口零阶矩的大小; Step3:设置搜索窗的大小为Step2中零阶矩的一个函数; Step4:重复Step2和Step3,直至收敛. 当均值平移算法收敛时,计算跟踪色块的位置以及长和宽的大小,位置即为(x c ,y c ),长和宽为 M 20=∑x ∑ y x 2 I (x ,y ), M 02= ∑x ∑ y y 2 I (x ,y ); (6) a =M 20/M 00-x 2 c ,c =M 02/M 00-y 2 c ,b =2(M 11/M 00-x c y c );(7)l =((a +c )+b 2+(a -c )2 )/2;(8)w = ((a +c )-b 2+(a -c )2 )/2. (9) 4 色标精定位 精定位的过程主要利用色标的轮廓或者边缘信息,提取矩形色标的顶点坐标.结合区域分割得出的轮廓和边缘检测的轮廓,得到一个精度高的轮廓信息;然后对各条边的点进行直线拟合,利用直线方程 计算得到亚像素精度的顶点坐标.4.1 剪切目标图像 根据图像跟踪模块得出的目标的中心位置和目标长和宽的大小,确定所要剪切的图像的大小和位置,为保证能将目标完整切割出来,本文切割一个以 (x c ,y c )为中心,边长为3 (l/ 2)2+(w/2)2的正方 形图片,如图3所示.下面对切割出来的目标图像进行处理. 图3 目标图像 4.2 提取轮廓 在HSV 空间中,根据式(2)对目标图像进行阈值分割,处理后二值图像的一个全局特征是目标(即蓝色色标)所在区域是图像中最大的白色区域.对此二值图像进行区域标记,寻找所有独立的白色区域中面积最大的区域,即为蓝色色块所在的区域,消除此区域之外的所有独立目标. 计算目标图像中目标的外轮廓线,然后使用Canny 算法对图3的目标图像进行处理, 得到边缘 检测图.以二值图像中白色区域的轮廓点所在的坐 标为起始点,在Canny 边缘检测图中寻找最近的边缘点,对所有的轮廓点依次进行处理,即可从Canny 边缘检测图中摘出蓝色色标准确的边缘线,如图4中轮廓线所示. 图4 边缘检测 4.3 确定顶点坐标 从Canny 边缘检测图中得出了色标的准确边缘信息,但是这些边缘线是不连续的,尤其是在顶点的位置.先将轮廓图上的点区分为各条边上的点,然后对各个边的点进行直线拟合,根据直线方程计算顶点的坐标. 如图4所示,在图像平面建立坐标系xoy ,x 轴沿水平方向,y 轴沿竖直方向.将边缘点的图像坐标看作是一个二维向量,以x 和y 的坐标值作为向量 751 第10期于乃功等:机械臂视觉伺服系统中的高精度实时特征提取 的两个分量,即 p i =(x i ,y i )T ,i =1,2,…,n. 令p 0=( x , y )T ,其中: x =Ex , y =Ey ,p 0为图像重 心点. 对于各条边缘线上的点,其x 和y 坐标值间存在明显的线性相关性,即y 坐标值随着x 标值的增加相应地增加或者减少.通过K 2L 变换[7],可以消除x 和y 坐标值之间的线性相关性.e 1和e 2分别代表向量p i (i =1,2,…,n )的协方差矩阵特征向量的方向,向量的方向分别与四方形轮廓的长边和短边的方向接近.做K 2L 变换有p ′i =T (p i -p 0),其中 T =(e 1,e 2)T .变换结果如图5所示 . 图5 K 2L 变换 K 2L 变换建立了一个新的坐标系x ′o ′y ′,原点 在o ′,坐标轴x ′和y ′的方向分别与四边形轮廓的长 边和短边的方向基本相同.根据下式寻找4个顶点A ,B ,C ,D ,并由此判断各条边的点: A ∶max (-x ′i -y ′i ),B ∶max (x ′i -y ′i ), C ∶max (-x ′i +y ′i ), D ∶max (x ′i +y ′i ). (10)根据4条边AB ,B C ,CD ,A D 的点分别进行最小二乘法直线拟合,得出4条直线方程为l k ∶a k x +b k y +c k =0,k =1,2,3,4. 根据直线方程便可计算得到顶点A ,B ,C ,D 的 坐标,分别为 x i ,j = c i b j -c j b i a j b i -a i b j ,y i ,j =a j c i -a i c j a i b j -a j b i , i =1,2,3,4,j =1,2,3,4.(11) 5 实验结果 利用上述方法,对立体摄像机中左摄像机拍摄的色标图像进行跟踪和特征点提取的实验.图6(a )为左摄像机原始采集的图像,图像的原始大小为640pixel ×480pixel ,色标检测对图像进行阈值处理之后,图片的重心位置为[367,240].目标作一个大致的矩形运动,跟踪得出的目标的中心轨迹如图6(b )所示,跟踪算法可以使目标锁定在当前物体,而不受场景中同颜色物体影响.实验表明,当场景中出现同样颜色物体以及对目标形成遮挡时,不影响目标的跟踪效果.对色标进行跟踪之后切割出来的图像的大小为143pixel ×144pixel ,如图6(c )所示.图6(d )为对图像进行阈值处理之后的效果图.图6(e )为对二值图像进行区域标记去除噪音之后的效果.图6(f )为根据区域检测得出的轮廓图,此轮廓图精度不高.图6(g )为对目标图像进行Canny 边缘检测之后的效果图.图6(h )为根据图6(f )和图6(g )寻找出来的边缘轮廓图.图6(i )为对图6(h )的边缘点进行K 2L 变换之后的效果.图6(j )为曲线拟合得出的直线. 计算所得的4条直线方程如图6(k )所示,分别为 l AD ∶y -66.5556=36.4017(x -34.5556),l CD ∶y -92.3803=0.1329(x -70.8082),l BC ∶y -77.5263=-49.7464(x -109.868),l AB ∶y -52.6667=0.1277(x -74.7179). 计算所得的4 个顶点坐标为 图6 实验结果 1 751 控 制 与 决 策第24卷 A(34.0313,47.4718),B(110.2769,57.2069), C(35.1344,87.6259),D(109.4662,97.5339). 目标图像放大7倍,根据上面的结果,查看A点 的坐标在图像中的位置.如图7中圈点所示,可以看 出,通过直线拟合,能够得到准确的特征点坐标 . 图7 结果演示图 6 结 论 本文针对机械臂的视觉伺服系统,提出了一种实时的目标跟踪和特征提取方法.通过为目标物体添加色标,分别利用色标的颜色信息和边缘信息,实现目标的粗定位和精定位.粗定位是一个检测和跟踪的过程,使用Camshift跟踪算法可以实时跟踪目标,同时又可以避免同场景中颜色相近物体的干扰,提高了目标定位的鲁棒性.精定位结合区域检测得出轮廓和Canny边缘检测图,并得出目标的精确轮廓.最小二乘法对各条边的边缘点进行直线拟合,通过直线方程得出顶点的亚像素精度坐标. 本文在大图像上使用了实时性高的Camshift 算法,既跟踪了目标又提高了运算速度;然后对小图片进行边缘和顶点的计算,既节省了计算量,又避免了噪音的影响.实验结果表明,这是一种有效的目标跟踪和特征提取方法,此方法为立体摄像机计算目标的位姿,实现机械臂的视觉伺服奠定了基础.参考文献(R eferences) [1]徐德,谭民,李原.机器人视觉测量与控制[M].北京: 国防工业出版社,2008. (Xu D,Tan M,Li Y.Visual measurement and control for robots[M].Beijing:National Defense Industry Press,2008.) [2]赵清杰,连广宇,孙增圻.机器人视觉伺服综述[J].控 制与决策,2001,16(6):8492853. (Zhao Q J,Lian G Y,Sun Z Q.Survey of robot visual servoing[J].Control and Decision,2001,16(6):8492 853.) [3]王麟琨,徐德,谭民.机器人视觉伺服研究进展[J].机 器人,2004,26(3):2772282. (Wang L K,Xu D,Tan M.Survey of research on robotic visual servoing[J].Robot,2004,26(3):2772 282.) [4]沈扬,徐德,谭民.仿人形机器人火炬传递中的高精度 目标特征提取[J].传感技术学报,2005,18(4):8222 827. (Shen Y,Xu D,Tan M.Study on high accurate feature extraction in the process of transferring touch with humanoid robots[J].Chinese J of Sensors and Actuators,2005,18(4):8222827.) [5]G ary R Bradski,Santa https://www.doczj.com/doc/bc4538218.html,puter vision face tracking for use in a perceptual user interface[J]. Inteligent Technology J,1998,2(2):2142219. [6]阮秋琦.数字图像处理[M].北京:电子工业出版社, 2003. (Ruan Q Q.Digital image processing[M].Beijing: Publishing House of Electronics Industry,2003.) [7]章毓晋.图像工程(上册)———图像处理[M].北京:清 华大学出版社,2006. (Zhang Y J.Image engineering—Image processing [M].Beijing:Tsinghua University Press,2006.) (上接第1567页) [6]Vijayan T,Kumaran M.Inventory models with a mixture of backorders and lost sales under fuzzy cost[J]. European J of Operational Research,2008,189(1): 1052119.[7]Zeng L.Expected value method for f uzzy multiple attribute decision making[J].Tsinghua Science and Technology,2006,11(1):1022106. 2751 闭环伺服系统稳定性研究 摘要:在数控机床中,伺服系统是数控装置和机床的中间联接环节,是数控系统的重要组成部分、伺服系统接受来自伺服控制器的进给脉冲,经变换和放大后转化为机床工作台的位移,使工作台跟随指令脉冲移动、本文讨论了伺服数控系统的数学模型,对闭环伺服系统的稳态性能进行了详细分析、同时给出了实验结果,设计了实物样机,该研究结果为伺服系统的稳定性能分析提供理论基础、 关键词:伺服;数控机床;伺服电机;稳定性能 0 引言 从控制论观点出发,对数控系统的技术要求可归纳为:①滚珠丝杠机械平台的精度要求具有摩擦阻力小、传动效率高、运动灵敏、无爬行现象,可进行预紧使其具备无间隙运动,传动刚度高,反向时无空程死区等特点、②由于数控机床的速度和精度等技术指标,在很大程度上由伺服系统的性能所决定、因此,研究伺服系统的稳态性能十分重要、 从控制论可知,高阶系统过渡过程的数学表达式是由一些指数项和衰减正弦项组成、如果在这些表达式中,有一些项的影响很小,可以将其忽略,则这个系统就可以用一个低阶系统来近似、在工程上,通常把高阶系统近似于一阶系统或二阶系统,我们把数控机床位置伺服系统简化为典型的二阶系统、本文将应用控制系统的分析方法来讨论数控机床位置伺服系统的稳态性能指标、 1 伺服数控系统的数学描述 对伺服系统的数学描述,实际上就是首先建立系统中各个环节的传递函数,然后求出整个系统的传递函数、这里以伺服控制数控机床为例,推导出其机械结构传递函数、 图1为数控机床的结构简图,输入为电机的转角θ,输出为工作台的位移L X 、图中1J 、2J 和1K 、2K 分别为电机轴及丝杠轴上的转动 惯量和扭转刚度;m 为工作台质量、f 为导轨运动的粘性阻尼系数、0K 为丝杠螺母副的综合拉压刚度;i 是齿轮减速比,1>i 、 图1 数控机床的结构简图 在综合考虑传递链的刚性和阻尼后,可得到如下输入、输出的微分方程式: θπL K i s X K dt dX f dt X d J L L L L L L ?=++22 (1) 式中:L J ——折算到丝杠轴上的总惯量; L f ——折算到丝杠轴上的导轨粘性阻尼系数; L K ——折算到丝杠轴上的机械传递装置总刚度; S ——丝杠导程、 设机械传动装置的传递函数为)(s G L , 河北工业大学 院系:河北工业大学机械工程学院 班级:机研155班 姓名:翟云飞 学号: 201531204037 题目:机器视觉技术及其应用 目录 1.机器视觉的发展现状 2.机器视觉系统组成 2.1机器视觉系统的工作原理 3.机器视觉的应用 3.1基于机器视觉的FPC嵌入式检测系统检测系统 3.2基于机器视觉的柔性制造岛在线零件识别系统 3.3基于机器视觉的PCB光板缺陷检测技术 3.4新兴行业 4.机器视觉发展趋势 5.中国机器视觉产业的发展现状 5.1、随着产业化的发展对机器视觉的需求将呈上升趋势 5.2、统一开放的标准是机器视觉发展的原动力 5.3、基于嵌入式的产品将取代板卡式产品 5.4、标准化、一体化解决方案也将是机器视觉的必经之路 6.参考文献 1.中国机器视觉的发展趋势 近年来,机器视觉已经发展成为光电子的一个应用分支,广泛应用于微电子、PCB生产、自动驾驶、印刷、科学研究和军事等领域。机器视觉在中国的蓬勃发展,使从事机器视觉的公司和人员大量涌现。首先概述了机器视觉技术的基本原理并分析了机器视觉系统的构建;接着论述了机器视觉技术的当前主要应用领域与情况;最后分析了现阶段机器视觉技术存在的问题。 2.机器视觉系统组成及其工作原理 简言之,机器视觉就是用机器代替人眼来做测量和判断。机器视觉系统是指通过机器视觉产品(即图像摄取装置,分CMOS和CCD两种)将被摄取目标转换成图像信号,传送给专用的图像处理系统,根据像素分布和亮度、颜色等信息,转变成数字化信号;图像系统对这些信号进行各种运算来抽取目标的特征,进而根据判别的结果来控制现场的设备动作。 从原理上机器视觉系统主要由三部分组成:图像的采集、图像的处理和分析、输出或显示。—个典型的机器视觉系统应该包括光源、光学系统、图像捕捉系统、图像数字化模块、数字图像处理模块、智能判断决策模块和机械控制执行模块,如图1所示。 (19)中华人民共和国国家知识产权局 (12)发明专利申请 (10)申请公布号 (43)申请公布日 (21)申请号 201910335507.5 (22)申请日 2019.04.24 (71)申请人 中山大学 地址 510275 广东省广州市海珠区新港西 路135号 (72)发明人 成慧 蔡俊浩 苏竟成 (74)专利代理机构 广州粤高专利商标代理有限 公司 44102 代理人 陈伟斌 (51)Int.Cl. B25J 9/16(2006.01) (54)发明名称 一种基于视觉的机械臂自主抓取方法 (57)摘要 本发明涉及机器人技术领域,更具体地,涉 及一种基于视觉的机械臂自主抓取方法。提出了 基于对抗抓取规则的纠正抓取策略,利用该策略 可以实现在仿真平台进行试错抓取得到符合该 规则的抓取样本。利用该方法采集的样本清晰的 表达了对抗抓取规则的抓取模式,有利于模型的 学习。整个数据采集过程无需人工干预,也无需 任何真实数据,避免了真实数据采集可能带来的 问题。只需要少量该方法采集的仿真数据,训练 后的模型可以直接应用到不同的真实的抓取场 景中。整个训练过程无需域自适应和域随机化操 作, 且准确率和鲁棒性高。权利要求书3页 说明书7页 附图2页CN 110238840 A 2019.09.17 C N 110238840 A 1.一种基于视觉的机械臂自主抓取方法,其特征在于,包括以下步骤: S1.在仿真环境中,搭建一个类似于现实场景的环境,并采集全局图像; S2.对数据进行处理,预处理后的数据包括:包含整个工作空间信息的全局图像、物体掩膜以及与全局图像相同尺度的标签图;处理过程包括:首先根据图像中物体所在像素的位置集合生成物体掩膜,再根据物体掩膜、抓取像素位置和抓取标签生成标签掩膜,以及用抓取位置和抓取标签生成标签图;然后根据抓取问题定义,对抓取角度进行离散化; S3.训练深度神经网络: (1)将输入RGB图进行归一化,然后合成一个批; (2)将该批数据传入全卷积神经网络,得到输出值; (3)根据结合标签掩膜的交叉熵误差,计算预测值与标签的误差,通过如下损失函数计 算: 其中Y为标签图,M为标签掩膜,表示最后一层卷积层的输出特征图;S4.将训练好的模型应用到真实抓取环境中。 2.根据权利要求1所述的一种基于视觉的机械臂自主抓取方法,其特征在于,所述的S1步骤具体包括: S11.在仿真环境的工作空间放置一个背景纹理、带夹持器的机械臂、摄像头和待抓取物体; S12.将物体放置在工作空间中,利用摄像头选择一个存在物体的位置,记录图像信息、抓取点对应的像素位置、图像中物体的掩膜和抓取角度,然后随机选择一个角度让机械臂进行试错抓取; S13.判断是否抓取成功,如果抓取失败,则直接保存图像信息I、图像中物体所在像素的位置集合C、抓取点对应的像素位置p、抓取角度ψ以及抓取失败的标签l;若抓取成功,则重新记录全局图像I ′以及对应的图像中物体所在像素的位置集合C ′,然后将图像信息I ′、图像中物体所在像素的位置集合C ′、抓取点对应的像素位置p、抓取角度ψ以及抓取成功的标签l保存下来。 3.根据权利要求2所述的一种基于视觉的机械臂自主抓取方法,其特征在于,所述的抓取问题定义包括:定义垂直平面抓取为g=(p,ω,η),其中p=(x,y,z)表示笛卡尔坐标下抓取点的位置,ω∈[0,2π)表示终端的旋转角度, 是一个3维的一位有效编码,用来表示抓取功能;抓取功能共分为可抓取、不可抓取和背景三种;当投影到图像空间中,抓取在 图像I可以表示为 其中表示图像中的抓取位置,表示离散抓取角度;图像中的每一个像素都可以定义抓取功能,所以整个抓取功能图可以表示为: 其中为给定第i个角度下图像的抓取功能图;该图中3个通道分别表示可抓取、不可抓取和背景三种类别;从每个抓取功能图 C i 中抽出第一个通道 并结合在一起组成4.根据权利要求3所述的一种基于视觉的机械臂自主抓取方法,其特征在于,最鲁棒的 权 利 要 求 书1/3页2CN 110238840 A 一、相关概念 伺服系统(servomechanism)又称随动系统,是用来精确地跟随或复现某个过程的反馈控制系统。伺服系统使物体的位置、方位、状态等输出被控量能够跟随输入目标(或给定值)的任意变化的自动控制系统。它的主要任务是按控制命令的要求、对功率进行放大、变换与调控等处理,使驱动装置输出的力矩、速度和位置控制非常灵活方便。 在机器人中,伺服驱动器控制电机的运转。驱动器采用速度环,位置环,电流环三环闭环电路,内部还设有错误检出和保护电路。驱动器通过通信连接器,控制连接器,编码连接器跟外部输入信号和输出信号相连。通信连接器主要用于跟电脑或控制器通信。控制连接器用于跟伺服控制器联接,驱动器所需的输入信号、输出信号、控制信号和一些方式选择信号都通过该控制连接器传输,它是驱动器最为关键的连接器。编码连接器跟电机编码器连接,用于接收编码器闭环反馈信号,即速度反馈和换向信号。 伺服电机主要用于驱动机器人的关节。关节越多,机器人的柔性和精准度越高,所需要使用的伺服电机的数量就越多。机器人对伺服电机的要求非常高,必须满足快速响应、高起动转矩、动转矩惯量比大、调速范围宽,要适应机器人的形体做到体积小、重量轻,还必须经受频繁的正反向和加减速运行等苛刻的条件,做到高可靠性和稳定性。伺服电机分为直流、交流和步进,工业机器人用的较多的是交流。 机器人用伺服电机 二、伺服系统的技术现状 2.1视觉伺服系统 随着机器人技术的迅猛发展,机器人承担的任务更加复杂多样,传统的检测手段往往面临着检测范围的局限性和检测手段的单一性.视觉伺服控制利用视觉信息作为反馈,对环境进行非接触式的测量,具有更大的信息量,提高了机器人系统的灵活性和精确性,在机器人控制中具有不可替代的作用。 视觉系统由图像获取和视觉处理两部分组成,图像的获取是利用相机模型将三维空间投影到二维图像空间的过程,而视觉处理则是利用获取的图像信息得到视觉反馈的过程。基本的相机模型主要包括针孔模型和球面投影模型,统一化模型是对球面模型的推广,将各种相机的图像映射到归一化的球面上。视觉伺服中的视觉反馈主要有基于位置、图像特征和多视图几何的方法。 其中,基于位置的方法将视觉系统动态隐含在了目标识别和定位中,从而简化了控制器的设计,但是一般需要已知目标物体的模型,且对图像噪声和相机标定误差较为敏感。基于图像特征的视觉反馈构造方法,其中基于特征点的方法在以往的视觉伺服中应用较为广泛,研究较为成熟,但是容易受到图像噪声和物体遮挡的影响,并且现有的特征提取方法在发生尺度和旋转变化时的重复性和精度都不是太好,在实际应用中存在较大的问题。因此,学者们提出了基于全局图像特征的视觉反馈方法,利用更多的图像信息对任务进行描述,从而增强视觉系统的鲁棒性,但是模型较为复杂,控制器的设计较为困难,且可能陷入局部极小点。目前针对这一类系统的控制器设计的研究还比较少,一般利用局部线性化模型进行控制,只能保证局部的稳定性。多视图几何描述了物体多幅图像之间的关系,间接反映了相机之间的几何关系。相比于基于图像特征的方法,多视图几何与笛卡尔空间的关系较为直接,简化了控制器的设计。常用的多视图几何包括单应性、对极几何以及三焦张量。 2.2伺服系统控制技术 现代的机器人伺服系统多采用交流伺服驱动系统,而且正在逐渐向数字化方向转变。数字控制技术已经五孔不入,如信号处理技术中的数字滤波、数字控制器,把功能更加强大的控制器芯片已经各种智能处理模块应用到工业机器人交流伺服系统中,可以实现更好的控制性能。 最近几十年,由于微电子技术的进步,各种方便用户开发的微控制器与数字信号处理器件大量涌现市场,为各种先进的智能控制算法在控制系统中的应用提供了可能。如今,各种新型的伺服控制策略大量涌现,大有与传统控制策略一较高低的趋势下面简单介绍几种: 1)矢量控制矢量控制技术的提出,为交流伺服驱动系统的快速进步提供了理论支持。矢量控制技术的主要原理为:以转子旋转磁场作为参考系,将电动机定子矢量电流经过两次坐标变换分解为直轴电流和交轴电流分量,且使两电流分量相互正交,同时对交直轴电流分量的 基于图像的机器人视觉伺服系统研究 班级:自121 姓名:成佳宇 学号:3120413006 基于图像的机器人视觉伺服系统 摘要本文采用基于图像的眼在手(eye in hand)视觉伺服结构,通过计算图像雅克比矩阵实现机械手的定位任务。本文采用应用最广泛的机器人工具箱(Robotics Toolbox for Matlab),在该工具箱的基础上,运用Sub-system实现Matlab和Simulink的有机结合,建立基于图像反馈的六自由度PUMA560机器人视觉伺服系统Simulink模型,仿真验证该模型的有效性。 关键字:puma560机器人;视觉伺服;图像的雅可比矩阵Abstract:In this paper,we use Image-based visual servoing control system, via image jacobin matrix function the positioning of the manipulator by calculation task. on the basis of Robotics Toolbox for Matlab, and using Sub - system to realize the organic combination of Matlab and Simulink, based on the image feedback Simulink model of six degrees of freedom PUMA560 robot visual servoing system, the simulation verify the validity of the model. Keyword:PUMA560robot;IBVS;Image jacobin 引言: 机器人视觉伺服己成为机器人领域重要的研究内容之一,但是机器人视觉伺服系统是一个十分复杂的非线性系统。视觉是一种复杂的感官,视觉信息中包含有大量的数据,要从 中提取特征信息,需要复杂的算法及耗费大量的运算时间, 基于机器视觉与运动控制的蓝光激光头全自动倾斜调整系统的设计 蓝光激光头精细位置调节存有问题,论文为解决上述问题,首先使用机器视觉技术,捕捉到蓝光光斑区域,针对光斑及水平间差距做出分析,在精确且具体的2轴运动控制协助下,达到激光头平面水平放置的效果;紧接着明确光斑焦距,并分析所在区域,考虑到3轴精细运动联动实际情况,找到激光头空间区域,同时还包括焦距所处区域,继而全自动倾斜调整蓝光激光头,改良了蓝光激光头模块产品,达标率超过98%。 【Abstract】There is a problem in blue ray laser head fine position adjustment,to solve the above problem,the paper firstly uses machine vision technology to capture the blue light spot area,analyzes the spot and horizontal gap,it achieved laser head level laying in horizontal placement with the control assistance of accurate and specific 2-axis motion,clear spot focal length,and analyze the area,taking into account the actual situation of 3-axis fine motion linkage,find the laser head space area,also include the area of focal length,then automatically tilt adjust blu-ray laser head,to improve blu-ray laser head module products,the compliance rate is more than 98%. 标签:机器视觉;运动控制;蓝光激光头 1 引言 光碟生产商Singulus2013年9月13日宣称:“用于存储4K内容、容量为100GB的蓝光光碟已经问世”。数字式光盘的优点突出,存储容量大,速度快,且生命周期长,改变了以往包括硬盘及磁带等为存储记录的媒体形式,得到大范围应用。对于信息其是借助光学激光头来开展写入及读出工作的,其中,蓝光光学头构成了高清信息读取不可缺少的部件,其性能所起作用较大,较大程度上影响了光盘存储器性能优劣。在蓝光光学头性能许多调整及检测工作中,尤以倾斜调整检测最为突出,确保了光盘信号的读取无误,国内生产着世界范围内最大量的光盘产品,光盘产业构成了我国信息产业十分必要的环节[1]。上述倾斜调整检查设备的研发商均是外国厂家,成本价格较贵,对国内光盘产业整体发展无益,使得光学头生产企业受制于国外技术设备,所以,考虑到上述情况,进行本次研究,旨在分析基于机器视觉与运动控制的蓝光激光头全自动倾斜调整系统的设计。 2 总体设计基于机器视觉与运动控制的蓝光激光头全自动倾斜调整系统 蓝光激光头全自动倾斜调整系统研发涵盖了多个层面内容,包括CCD机器视觉光斑定位与焦距调节设计及多轴运动控制伺服系统等,这种检测设备具有全自动化且精细的特点[2]。这种系统硬件以机械机构及计算机为主要构成部分,机械机构组成部分包括电机、传感器及气动装置等;计算机处置机器视觉图像,精细化调控多轴运动,且对焊接装置及气动装置实施调控。 机器人视觉伺服系统综述 摘要:对机器人视觉伺服系统进行阐述,介绍了机器人视觉伺服系统的概念、发展历程以及研究背景;并从不同的角度对机器人视觉伺服系统进行了分类。最后介绍了该领域的研究现状、所取得的成就,以及今后的发展趋势。 关键词:机器人;视觉伺服;综述 Survey of robot visual servoing system Abstract:: In this paper,the survey of robot visual servoing system are introduced.The paper reviews the concept and history background of robot visual servoing system.This article also classify the robot visual servo system from different aspects. Finally, it introduce the research status quo, achievements and future trends in the field. Key words:robot, visual servoing, summary 1.引言 随着先进科学技术的不断发展,机器人已经在生产和生活中起到了越来越重要的作用,因次人们不断对机器人技术提出更高的要求。为了使机器人能够完成更加复杂的工作,适应更加复杂的环境,机器人不仅需要更加完善的控制统,还需要能够更多的感知环境的变化。而影响其发展的一个重要原因就是机器人缺少像人一样的感知能力,在人们为机器人添加各种外部传感器的过程中,机器人视觉以其信息大、信息完整成为最重要的机器人感知功能[1]。 机器人的视觉伺服系统是机器人的视觉和机器人控制的相结合的复杂系统。其内容包括了图像的采集与处理、运动学和动力学、自动控制理论及其系统数据实时分析等领域于一体的新兴交叉学科。随着摄像技术和计算机技术的发展,以及相关理论的日益完善和实践的不断检验,视觉伺服已具备了在实际中应用的条件;而随着机器人应用领域的不断扩展,重要性也不断提高,与其相关技术问题已经成为了当前的研究热点[2]。所以实现机器人视觉伺服控制有相当的难度,是机器人研究领域中具有挑战性的课题。 2.机器人视觉伺服系统 2.1机器人视觉伺服系统的定义 有约束的无标定模型预测控制 在视觉伺服控制器的设计中,图像雅可比矩阵是建立运动学模型的关键。经典的IBVS采用比例控制律,它利用图像雅可比矩阵的逆(或伪逆)。然而,比 例控制器可能存在局部极小问题。也就是说,如果视觉特征数大于3,则图像雅可比矩阵不是满秩的,图像误差可能存在于图像雅可比矩阵的逆(或伪逆)的零空间中,从而导致局部收敛,使得最终的图像特征远离期望的图像特征。另外,系统约束处理困难,尤其是可见性约束。当相机的初始位置和所需位置之间的距离较大时,图像特征将不可见。在视觉伺服控制过程中,可能会违反关节的物理限制和机器人的工作空间。此外,比例控制器的主要缺点是需要知道摄像机内参数、摄像机外参数和特征点的深度参数,而这些特征点的精确值很难获得。 为了避免使用图像雅可比矩阵中元素的精确值,人们对图像雅可比矩阵的数值估计进行了广泛的研究,如神经网络、迭代学习、拟牛顿方法和模糊控 制。文献提出了许多基于深度无关交互(或图像雅可比)矩阵的自适应 控制器,以克服深度限制问题。文献首次针对摄像机参数未知且深度随时间 变化的固定摄像机构型,提出了与深度无关的交互矩阵。文献提出了眼在手 和固定眼构型的自适应视觉跟踪控制的统一设计方法。然而,这些方案没有明确考虑系统约束,而这些约束对于视觉伺服控制器的设计是至关重要的。 已经提出了许多方法来处理有约束的视觉伺服任务。例如路径规划、非线性反馈等,但大多需要给定摄像机的外部参数,并且假定摄像机的内部参数和深度信息是已知的。在IBVS中,通常采用模型预测控制(Model Predictive Control,MPC)来处理系统约束,且MPC控制器具有在未知影响和模型误差的情况下对 系统进行控制的能力。因此,MPC算法可以用来设计无标定环境下的视觉伺服控制器。本章主要提出了一种新的基于MPC的IBVS设计方法,该方法明确地考虑了系统的约束条件,能够有效地处理未知的摄像机参数和深度参数。通过模型预测控制获得控制输入,通过参数估计算法在线更新预测模型的未知参数,完成视觉伺服任务。 有约束和无标定视觉伺服的预测模型 模型预测控制被用来处理未标定环境中眼在手上和眼在手外摄像机构型的IBVS系统的控制约束。在无标定的环境中,摄像机的内外参数和特征的三维坐标是未知的。为了通过MPC获得最优控制输入,需要找到一个预测模型来描述系统的动态行为。介绍了基于深度无关交互矩阵的预测模型。在透视投影模型下,特征点的图像坐标可以描述为: s m (t) c 基于STM32的机械臂运动控制与结构设计 开题报告 班级(学号):机械1104(2011010093)姓名:文伟松 指导教师:王科社 选题背景 机器人技术是一种新兴技术,它涉及多种学科,综合了计算机、机械学、信号处理和传感技术、控制论、仿生学和人工智能等多学科。机器人按照用途可分为工业机器人、服务机器人和特种机器人,其中工业机器人是目前应用最多、技术上发展最成熟的一种机器人。随着我国经济的快速发展和科学技术的突飞猛进,使得机器人在货物搬运与物流、喷涂、焊接、测量等行业有着相当广泛的应用。码垛机器人是实现物流和包装自动化的关键装备,可以实现高速、自动、连续、准确的码垛操任务。人工码垛是强度大、重复性高的劳动,特别是高粉尘、有毒、有害等物料,基本不适合人工码垛,因此有必要研发一种码垛机器人,减低生产过程中对工人身心伤害。 进入 20 世纪 80 年代,随着计算机技术、控制技术以及自动化技术的发展和成熟,工业发达国家如日本、美国、瑞典、意大利、德国等都在相应的研制出了自己的码垛机器人。如德国的 KUKA 系列,日本的 FANUC 系列,瑞典的 ABB 系列等。国外发达国家研制的码垛机器人多为四轴空间的关节机器人,一般由机械本体、拉制器和末端执行机构组成,其中机械本都是有底座,腰部连杆,大小臂连杆和末端执行器(腕部)构成。如图 1.1。 德国KUKA 瑞典ABB机器人 日本不二(FUJI)日本OKURA 图1.1 发达国家研制的主要工业机器人 基于串联式码垛机器人,本文设计一种类似结构的机械臂。针对毕业论文题目“基于STM32的机械臂运动控制与结构设计”,首先对国内外高校,研究院,企业等对码垛机器人研究及其发展状况进行调研;其次对设计的机械臂作运动学分析以及控制系统设计等。 1.1.1主要研究内容 本文针对串联关节型码垛机器人,设计了一种新型4DOF机械臂;此机械臂主要连杆机构与串联关节型码垛机器人类似;在不大幅度增加系统转动惯量前提下,增加一个自由度实现末端执行器翻转,改进末端视觉传感器测量角度和带宽。首先充分调研国内外各种码垛机器人发展状况并分析;通过Solidworks建立三维模型并对末端轨迹和各运动参数进行虚拟仿真,获取机械臂工作空间大小。通过MATLAB精确计算机械臂末端工作空间。第二通过D-H 法对机械臂建立码垛机器人连杆坐标系,基坐标和末端坐标之间的变换矩阵,获取机械臂运动学正解和运动学反解。对机械臂关键零件做力学校核。第三设计加工基于PVC材料的小型机械臂,并装配。第四设计基于ARM Contex3内核的STM32处理器的机械臂控制系统,实现输入机械臂末端执行器空间坐标和速度,机械臂定位到预期点。 最后通过MDK5编写程序并通过JLINK调试机械臂;提出机械臂末端误差消除方法,并考虑分析小型机械臂在教具和科技展览利用前景。 1.1.2 课题研究意义 本文中设计的新型机械臂可用于教学教具用,训练学生对基本机械结构的认识;新型机械臂相对于普通码垛机器人来说具有惯量小,视觉传感器传感范围大等特点;此新型机械臂可用于小型机器人作执行机构,具有较好运用前景;同时本文对此新型机械臂运动学分析和动力学分析做了研究,对此新型机械臂进一步研究具有重要意义。 1.2码垛机器人分类 现今码垛机器人按驱动结构不同分有串联式,并联式和混联式。 机器人视觉伺服系统的控制结构 机器人视觉伺服系统的控制结构 1 前言 对机器人视觉伺服系统的研究是机器人领域中的重要内容之一,其研究成果可直接用于机器人手—眼系统、移动机器人的自动避障及对周围环境的自适应、轨线跟踪等问题中。通常所说的机器视觉是指:自动获取并分析图像,以得到一组可对景物描述的数据或控制某种动作的数据。而视觉伺服则不同于机器视觉,它利用机器视觉的原理对图像进行自动获取与分析,以实现对机器人的某项控制为目的。正是由于系统以实现某种控制为目的,所以视觉伺服系统中的图像处理过程必须快速准确。 视觉伺服系统采用视觉反馈环形成闭环,在视觉反馈环中抽取某种图像特征。图像特征可以是点、曲线、图像上的某一区域等,比如,它可以是点在图像平面的坐标位置,或投影面的形心及其惯量的高次幂。 2 视觉伺服系统的分类 视觉伺服的控制策略主要基于以下两个问题: 1)是否采用分层控制结构?即机器人是否需要闭环关节控制器?进一步说,就是系统的视觉反馈是为机器人的关节控制闭环提供输入量,还是由视觉控制器直接控制机器人各关节。 2)误差输入量是以机器人所在空间的三维坐标表示,还是以图像特征? 按控制策略2)区分,视觉伺服系统分为两类:基于位置的控制系统(position-based control,又称3D视觉伺服,3Dvisualservoing),基于图像的控制系统(image-base control,或称2D视觉伺服,2Dvisualservoing)。由于基于位置和基于图像的视觉伺服各有其优缺点,于是近年有学者综合上述两类视觉伺服系统的优点,设计出2-1/2D视觉伺服系统。 按控制策略1)区分,视觉伺服系统可分为动态观察—移动系统和直接视觉伺服。前者采用机器人关节反馈内环稳定机械臂,由图像处理模块计算出摄像机应具有的速度或位置增量,反馈至机器人关节控制器;后者则由图像处理模块直接计算机械壁各关节运动的控制量。 3 视觉伺服系统的控制结构 3.1 基于位置的视觉伺服控制结构 视觉伺服控制算法优化综述 摘要:系统论述了视觉伺服控制的应用现状。重点介绍了针对不同的实际情况,提出优化的基于位置的视觉伺服系统和基于图像的视觉伺服系统的控制算法。优化后的算法效率高,具有很强的有效性和可行性。优化后的控制系统功能更强,更精确有效。 关键词:视觉伺服;优化;算法 Survey of Visual Servoing control algorithm Abstract:The application status of the visual servo control are reviewed . For different realities , we put fortward an improved position-based visual servo systems and image -based visual servo control algorithm of the system. High efficiency of the improved algorithm has strong effectiveness and feasibility. The improved control system functions stronger, and become more precise and effective. Keywords:Visual Servoing;improve;Algorithm 1 引言 随着科技的快速发展,在现代工业自动化生产过程中,机器视觉正成为一种提高生产效率和保证产品质量的关键技术,如机械零件的自动检测、智能机器人控制及生产线的自动监控等。 基于视觉的伺服策略是采用相机所观察的特征来控制机器人移动的一种灵活有效的方法。视觉伺服主要分为3种:基于位置的视觉伺服(PBVS)、基于图像的视觉伺服(IBVS)和混合控制视觉伺服。早期的研究主要是基于位置的视觉伺服研究,近年来主要是基于图像的视觉伺服研究。 PBVS的反馈偏差在3D笛卡尔空间进行计算,IBVS的反馈偏差在2D图像平面空间进行计算。PBVS 的控制方式直接在笛卡尔空间下进行位姿估计和运动控制,具有很好的直观性和简单有效性。IBVS的控制方式其期望给定值直接以图像特征信息表示,所以不需要将特征信息投影逆变换到工作空间的过程,因此基于图像的控制方式对标定误差和空间模型误差不敏感,具有更高地定位精度,为多数的视觉伺服系统所采用。 2 视觉伺服控制算法 在进行任何一个基于伺服控制的控制系统的分析、综合或设计时,首先应建立该系统的数学模型,确定其控制算法。它反映了系统输入、内部状态和输出之间的数量和逻辑关系,这些关系式为计算机进行运算处理提供了依据。控制算法的正确与否直接影响控制系统的品质,甚至决定整个系统的成败。 2.1 基于位置的视觉伺服算法的优化 对于不同的功能要求,采用传统的基于位置的视觉伺服控制算法,常常造成稳定性不够、精度不够、准确性不足等问题,我们需要对算法进行优化处理,来满足要求。 例如,针对家庭环境中服务机器人物品的抓取问题,提出一种改进的基于位置的视觉伺服抓取算法。该算法主要包括4个部分: 1.基于Naomark 标签的物体识别,根据Naomark的ID确定抓取方式,并利用世界单应分解算法对目标物位姿进行估计。 通过在具有不同形状和特征的各类物品上布置Naomark 标签的方式,可以实现被操作物的快速识别与定位,从而解决家庭环境中物品种类多、操作方式复杂带来的困难。 利用Hough 变换和边缘检测可以得到Naomark 的各特征点。 2.对NAO机器人的五自由度手臂进行运动学建模,计算出运动学正解和逆解。 ?关键词:伺服系统位置检测元件感应同步器 ?摘要:位置伺服系统的位置控制是将插补计算的理论位置与实际反馈位置相比较,用其差值去控制进给电机。而实际反馈位置的采集,则是由一些位置检测装置来完成。这些检测装置有旋转变压器、感应同步器、脉冲编码器、光栅、磁栅等。 1.位置检测元件的要求和种类 位置伺服系统的位置控制是将插补计算的理论位置与实际反馈位置相比较,用其差值去控制进给电机。而实际反馈位置的采集,则是由一些位置检测装置来完成。这些检测装置有旋转变压器、感应同步器、脉冲编码器、光栅、磁栅等。 对于采用半闭环控制的位置伺服系统,其闭环路内不包括机械传动环节,它的位置检测装置一般采用旋转变压器,或高分辨率的脉冲编码器,装在进给电机或者丝杠的端头,旋转变压器(或脉冲编码器)每旋转一个角度,都严格对应着运动机构移动的一定距离。测量了电机或丝杠的角位移,也就是间接测量了运动机构的直线位移。 对于采用闭环控制系统的位置伺服系统,应该直接测量工作台的直线位移,可采用感应同步器、光栅、磁栅等测量装置。由工作台直接带动感应同步器的滑动尺度的同时,与装在机床床身上的定尺配合,测量出工作台的实际位置。 可见,位置测量装置是位置伺服系统的重要组成部分。它的作用是测量位移和速度,发送反馈信号,构成闭环或半闭环控制。数控机床的加工精度主要由检测系统的精度决定。 位移检测系统能够测量的最小位移量称为分辨率。分辨率不仅取决于检钡4元件本身,也取决于测量线路。位置伺服系统对检测装置的主要要求如下: (1)高可靠性和高抗干扰性. (2)满足精度和速度要求. (3)使用维护方便,适合机床运行环境. (4)成本低。 2. 感应同步器 感应同步器是利用两个平面形绕组的互感随位置不同而变化的原理组成的。可用来测量直线或转角位移。测量直线位移的称长感应同步器,测量转角位移的称圆感应同步器。 长感应同步器由定尺和滑尺组成,如图10.10所示。圆感应同步器由转子和定子组成。这两类感应同步器是采用同一的工艺方法制造的。一般情况下。首先用绝缘粘贴剂把钢箔粘牢在金属(或玻璃)基板上,然后按设计要求腐蚀成不同曲折形状的平面绕组。这种绕组称为印制电路绕组。定尺和滑尺、转子和定子上的绕组分布是不相同的。在定尺和转子上的是连续绕组,在滑尺和定子上的则是分段绕组。分段绕组分为两组,布置成在空间相差90。相角,又称为正、余弦绕组。感应同步器的分段绕组和连续绕组相当于变压器的一次侧和二次侧线圈,利用交变电磁场和互感原理工作。 安装时,定尺和滑尺、转子和定子上的平面绕组面对面地放置。由于其阔气隙的变化要影响到电磁耦合度的变化,因此气隙一般必须保持在(0.25~0.05)mm的范围内。工作时,如果在其中一种绕组上通以交流激励电压,由于电磁耦合,在另一种绕组上就产生感应电动势,该电动势随定尺与滑尺(或转子与定子)的相对位置不同呈正弦、余弦函数 机器人视觉伺服技术发展概况综述 目前,在全世界的制造业中,工业机器人已经在生产中起到了越来越重要的作用。为了使机器人能够胜任更复杂的工作,机器人不但要有更好的控制系统,还需要更多地感知环境的变化。其中机器人视觉以其信息量大、信息完整成为最重要的机器人感知功能。 机器人视觉伺服系统是机器视觉和机器人控制的有机结合,是一个非线性、强耦合的复杂系统,其内容涉及图象处理、机器人运动学和动力学、控制理论等研究领域。随着摄像设备性能价格比和计算机信息处理速度的提高,以及有关理论的日益完善,视觉伺服已具备实际应用的技术条件,相关的技术问题也成为当前研究的热点。 本文对机器人视觉伺服技术进行了综述,介绍了机器人视觉伺服系统的概念及发展历程和分类,重点介绍了基于位置的视觉伺服系统和基于图像的视觉伺服系统。对机器人视觉所涉及的前沿问题做了概括,并指出了目前研究中所存在的问题及今后发展方向。 机器人视觉伺服系统 视觉伺服的定义: 人类对于外部的信息获取大部分是通过眼睛获得的,千百年来人类一直梦想着能够制造出智能机器,这种智能机器首先具有人眼的功能,可以对外部世界进行认识和理解。人脑中有很多组织参与了视觉信息的处理,因而能够轻易的处理许多视觉问题,可是视觉认知作为一个过程,人类却知道的很少,从而造成了对智能机器的梦想一直难以实现。随着照相机技术的发展和计算机技术的出现,具有视觉功能的智能机器开始被人类制造出来,逐步形成了机器视觉学科和产业。所谓机器视觉,美国制造工程师协会(sme society of manufacturing engineers)机器视觉分会和美国机器人工业协会(ria robotic industries association) 的自动化视觉分会给出的定义是: “机器视觉是通过光学的装置和非接触的传感器自动地接收和处理一个真实物体的图像,以获得所需信息或用于控制机器人运动的装置。” 全闭环交流伺服驱动技术成为运动控制新技术 在机电一体化技术迅速发展的同时,运动控制技术作为其关键组成部分,也得到前所未有的大发展,国内外各个厂家相继推出运动控制的新技术、新产品。本文主要介绍了全闭环交流伺服驱动技术(Full Closed AC Servo)、直线电机驱动技术(Linear Motor Driving)、可编程序计算机控制器(Programmable Computer Controller,PCC)和运动控制卡(Motion Controlling Board)等几项具有代表性的新技术。 随着计算机技术、电子电力技术和传感器技术的发展,各先进国家的机电一体化产品层出不穷。机床、汽车、仪表、家用电器、轻工机械、纺织机械、包装机械、印刷机械、冶金机械、化工机械以及工业机器人、智能机器人等许多门类产品每年都有新的进展。机电一体化技术已越来越受到各方面的关注,它在改善人民生活、提高工作效率、节约能源、降低材料消耗、增强企业竞争力等方面起着极大的作用。 在一些定位精度或动态响应要求比较高的机电一体化产品中,交流伺服系统的应用越来越广泛,其中数字式交流伺服系统更符合数字化控制模式的潮流,而且调试、使用十分简单,因而被受青睐。这种伺服系统的驱动器采用了先进的数字信号处理器(Digital Signal Processor, DSP),可以对电机轴后端部的光电编码器进行位置采样,在驱动器和电机之间构成位置和速度的闭环控制系统,并充分发挥DSP的高速运算能力,自动完成整个伺 服系统的增益调节,甚至可以跟踪负载变化,实时调节系统增益;有的驱动器还具有快速傅立叶变换(FFT)的功能,测算出设备的机械共振点,并通过陷波滤波方式消除机械共振。 一般情况下,这种数字式交流伺服系统大多工作在半闭环的控制方式,即伺服电机上的编码器反馈既作速度环,也作位置环。这种控制方式对于传动链上的间隙及误差不能克服或补偿。为了获得更高的控制精度,应在最终的运动部分安装高精度的检测元件(如:光栅尺、光电编码器等),即实现全闭环控制。比较传统的全闭环控制方法是:伺服系统只接受速度指令,完成速度环的控制,位置环的控制由上位控制器来完成(大多数全闭环的机床数控系统就是这样)。这样大大增加了上位控制器的难度,也限制了伺服系统的推广。目前,国外已出现了一种更完善、可以实现更高精度的全闭环数字式伺服系统,使得高精度自动化设备的实现更为容易。其控制原理如图1所示。 该系统克服了上述半闭环控制系统的缺陷,伺服驱动器可以直接采样装在最后一级机械运动部件上的位置反馈元件(如光栅尺、磁栅尺、旋转编码器等),作为位置环,而电机上的编码器反馈此时仅作为速度环。这样伺服系统就可以消除机械传动上存在的间隙(如齿轮间隙、丝杠间隙等),补偿机械传动件的制造误差(如丝杠螺距误差等),实现真正的全闭环位置控制功能,获得较高的定位精度。而且这种全闭环控制均由伺服驱动器来完成,无需增加上位控制器的负担,因而越来越多的行业在其自动 机器视觉技术与运动控制技术相结合解析方案 开发视觉导引运动系统概述 过去几年里,运动控制系统已经把机器视觉作为其关键部分。越来越多的工程师和科研人员认识到当前的机器视觉技术和运动控制技术相结合对于解决复杂应用问题有相当大的帮助。软硬件技术的发展也促进了运动控制和机器视觉系统的结合,并降低了它们的开发难度和开发成本。在设计这种系统时,了解目前的技术发展、方法以及开发工具会对您的工作提供很大的帮助。 当您开发一个视觉导引运动控制系统时,有很多方面需要考虑。其中重要的一点就是如何建立该系统。比如一个视觉导引运动控制系统用于在移动电话上安装机盖,每次电话的位置和方向可能有所不同。为了使问题变得简单,假定移动电话放置在X-Y-Theta工作台来校正位置以及方向。视觉系统用来定位机盖并测量电话移动到正确位置运动系统需要移动的方向和距离。开发这样的系统也有很多的问题必须考虑到,例如视觉单元如何和运动单元关联来保证把部件移动到位。在运动和视觉单元之间建立通信需要校准。如图1所示,在校准一个视觉导引运动控制系统时,需要按照以下几个步骤进行:首先,您需要校正图像系统的所有失真,它们有可能导致错误的测量距离被传递到运动控制系统上; 然后,您需要把图像测量的距离(通常用像素表达)和工作台或电机测量的距离(通常用步进的次数或计数值)联系起来;最后,您需要把运动控制系统与视觉坐标系统相关联,从而校正两个系统的偏移。这种图像测量距离到运动控制距离的转换依赖于很多的参数,其中包括相机和被测物体间的距离以及镜头的类型。相机焦距的改变会使得物体成像的大小有所不同,因此测量的结果也会与相机移动之前有所不同。一个简单的视觉和运动控制系统框图如图1所示。 简述机器视觉在自动驾驶中的应用 机器视觉是人类认知世界最重要的功能手段,生物学研究表明,人类获取外界信息75%依靠视觉系统,而在驾驶环境中这一比例甚至高达90%。 如果能够将人类视觉系统应用到自动驾驶领域,无疑将会大幅度提高自动驾驶的准确性,而这正是当前计算机科学和自动驾驶领域最热门的研究方向之一,它就是机器视觉技术。 机器视觉技术发展至今已有二十多年的历史,而真正发生革命性进步的则是莫尔视觉计算理论的提出,通过实现神经网络相关算法使机器拥有同人类视觉系统同样的功能提供了可能。一般来说,机器视觉系统包含有镜头、摄像系统和图像处理系统,而其核心则是专用高速图像处理单元,也就是把存入的大量数字化信息与模板库信息进行比较处理,并快速得出结论,其运算速度和准确率是关键指标。这主要通过高效合理的算法和处理能力强大的芯片来实现。 目前,市场上已有多种高效视觉专用硬件处理器及芯片等电子器件,并且随着计算机技术的进步,更先进的算法被相继发明,如采用网格分布式处理系统能够有效的提高运算的效率。今后机器视觉的核心问题将是对图像的深入理解。 机器视觉在自动驾驶中的应用主要有以下两个方面: 一、障碍物检测 准确率是车辆自动驾驶过程中安全性的重要保证。在行驶过程中,障碍物的出现是不可预知的,也就无法根据现有的电子地图避开障碍物,只能在车辆行驶过程中及时发现,并加以处理。当前,由于自动驾驶环境的不成熟,关于障碍物的定义尚没有统一的标准。因此,可以认为一切可能妨碍车辆正常行驶的物体和影响车辆通行的异常地形都是车辆行驶过程中的障碍物。目前来看,算法主要有以下三种:1. 基于特征的;2. 基于光流场的;3. 基于立体视觉的。在三种算法中,基于立体视觉的因为既不需要障碍物的先验知识,对障碍物是否运动也无限制,还能直接得到障碍物的实际位置而成为主流研究方向。但其对摄像机标定要求较高。而在车辆行驶过程中,摄像机定标参数会发生漂移,需要对摄像机进行动态标定。 二、道路检测 自动导航是自动驾驶的必要条件,自动驾驶过程中,道路检测主要是为了确定车辆在道路中的位置和方向,以便控制车辆按照正确的路线行驶。另外,它还为后续的确定搜索范围,以及缩小的搜索空间,降低算法复杂度和误识率。然而由于现实中的道路多种多样,在加上光照、气候等各种环境因素的影响,道路检测是一个十分复杂的问题。至今仍无一个通用的算法,现有算法基本上都对道路做了一定的假设。通常采用的假设有:1特定兴趣区域假设;2道路等宽假设;3道路平坦假设。另外,道路平坦假设也为障碍物定义提供参考。闭环伺服系统稳定性研究

机器视觉的现状及其应用

【CN110238840A】一种基于视觉的机械臂自主抓取方法【专利】

伺服系统介绍.doc

基于图像的视觉伺服系统

基于机器视觉与运动控制的蓝光激光头全自动倾斜调整系统的设计

机器人视觉伺服系统综述

视觉伺服控制

(完整word版)基于STM32的机械臂运动控制与结构设计开题报告

机器人视觉伺服系统的控制结构

视觉伺服控制算法优化综述

伺服系统中的位置检测元件

机器人视觉伺服技术发展概况综述

全闭环交流伺服驱动技术成为运动控制新技术

机器视觉技术与运动控制技术相结合解析方案

简述机器视觉在自动驾驶中的应用