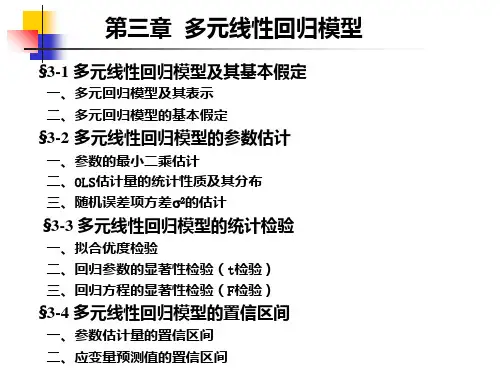

§3.2-多元线性回归模型的参数估计

- 格式:pdf

- 大小:587.48 KB

- 文档页数:23

第三章多元线性回归模型的参数估计多元线性回归模型的参数估计是指通过给定的数据样本,使用其中一种方法来计算出回归模型的参数值。

在多元线性回归模型中,我们有多个自变量与一个因变量之间的关系,因此需要估计出每个自变量的系数。

参数估计是回归模型的核心内容之一,它能够通过对样本数据的分析和处理,得到模型中的参数值,从而建立起模型与实际数据之间的映射关系。

常用的多元线性回归模型的参数估计方法有最小二乘法和最大似然估计法。

最小二乘法是一种最常用的参数估计方法。

它的基本思想是通过最小化因变量的观测值与模型预测值之间的平方误差,来确定模型参数的最佳估计值。

最小二乘法的优点是数学上简单且易于计算,但对于异常值的敏感性较强。

最大似然估计法是另一种常用的参数估计方法。

它的基本思想是找到最能使观测数据发生的概率最大的模型参数,从而得到最优的参数估计值。

最大似然估计法具有较好的统计性质,但它的计算复杂度较高,需要对似然函数进行极大化求解。

在实际应用中,我们需要根据实际情况选择合适的参数估计方法。

通常情况下,最小二乘法是首选的方法,因为它具有简单和直观的优点,适用于大多数情况。

但当样本数据存在异常值或者数据分布不符合正态分布假设时,最大似然估计法可能是更好的选择。

无论是最小二乘法还是最大似然估计法,其核心问题都是通过最优化方法找到使得模型和观测数据之间的误差最小的参数值。

这一过程需要使用数学工具和计算方法进行求解,可以使用迭代算法,如牛顿法或梯度下降法,来逐步逼近最优解。

参数估计的结果可以告诉我们每个自变量对因变量的贡献程度。

因此,一个良好的参数估计能够帮助我们更好地理解数据,预测因变量,以及识别自变量之间是否存在相互影响。

总而言之,多元线性回归模型的参数估计是通过最小化模型与观测数据之间的误差,找到最佳的模型参数值的过程。

合理选择参数估计方法,并进行有效的数学计算,能够为我们提供有关数据和模型之间的重要信息,并为进一步的分析和应用提供基础。

23多元线性回归模型的参数估计多元线性回归是一种机器学习算法,用于预测因变量与多个自变量之间的关系。

其数学模型可表示为:y = β0 + β1*x1 + β2*x2 + ... + βn*xn + ε其中,y是因变量,x1, x2, ..., xn是自变量,β0, β1,β2, ..., βn为待估计的参数,ε为误差项。

参数估计是指通过样本数据,求解出最佳参数值的过程,常用的方法有最小二乘法。

最小二乘法的基本思想是使残差平方和最小化,即求解出使误差平方和最小的参数估计。

具体的参数估计方法有多种,下面介绍常用的两种方法:普通最小二乘法和梯度下降法。

1.普通最小二乘法:普通最小二乘法是最常用的参数估计方法,通过最小化残差平方和来估计参数。

其基本思想是求解出使误差平方和最小的参数估计。

数学上,可以通过最小化误差平方和的一阶导数为0来求解最佳参数估计。

2.梯度下降法:梯度下降法是一种优化算法,通过迭代的方式逐步更新参数值,使损失函数逐渐趋于最小值。

参数的更新是根据误差和参数的梯度进行的,即参数的更新方向是误差下降最快的方向。

模型参数估计的步骤如下:1.收集样本数据:收集包含自变量和因变量的样本数据。

2.设定初值:为模型中的参数设定初值。

3.定义损失函数:根据模型定义损失函数,即误差平方和。

4.选择优化算法:选择合适的优化算法进行参数估计,如最小二乘法或梯度下降法。

5.迭代计算:通过迭代计算的方式更新参数值,使误差逐渐减小。

6.收敛判断:判断模型是否已经收敛,即误差是否足够小。

7.输出参数估计值:当模型收敛后,输出最佳参数估计值。

总结:多元线性回归模型的参数估计是通过最小化误差平方和的方法求解最佳参数估计。

常用的方法有普通最小二乘法和梯度下降法。

参数估计的步骤包括收集样本数据、设定初值、定义损失函数、选择优化算法、迭代计算、收敛判断和输出参数估计值。