- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

影

响最大的是1943年心理学家McCulloch和数学家Pitts在分析总结神经元基本特

性的基础上首先提出的M-P模型,它是大多数神经网络模型的基础。

n

Yj(t ) f ( wjixij)

(1.1)

i1

式(1.1)中, j为神经元单元的偏置(阈值) ,wji为连接权系数(对于激发状态,

wji

取正值,对于抑制状态,

2 BP神经网络原理

2.1基本BP算法公式推导

基本BP算法包括两个方面:信号的前向 播和 差的反向 播。即 算 出 按从 入到 出的方向 行,而 和 的修正从 出到 入的方向 行。

1

a1

x1

o1

⋯

⋯

⋯

输

输

i

ak

出

入

xj

ok变

变

wij

wki⋯

量

量

⋯

aL

⋯

q

xM

oL

输入层

隐含层

输出层

2-1 BP网 构

Fig.2-1 Structure of BP network中:xj表示 入 第j个 点的 入,j=1,⋯,M;

wji取负值),n为输入信号数目,

Yj为神经元输出,

t为时间,f()为输出变换函数,有时叫做激发或激励函数,往往采用

0和

1二值

函数或S形函数。

1.3人工神经网络的基本特性

人工神经网络由神经元模型构成; 这种由许多神经元组成的信息处理网络具有并行分布结构。 每个神经元具有单一输出, 并且能够与其它神经元连接; 存在许多(多重)输出连接方法,每种连接方法对应一个连接权系数。严格地说,人工神经网络是一种具有下列特性的有向图:

(2)无师学习无师学习算法不需要知道期望输出。在训练过程中,只要向神

网 提供 入模式, 神 网 就能 自 地适 接 , 以便按相似特征把 入模式分 聚集。 无 学 算法的例子包括Kohonen算法和Carpenter-Grossberg自适 共振理 (ART)等。

(3) 化学 如前所述, 化学 是有 学 的特例。它不需要老 出目 出。 化学 算法采用一个“ ”来 价与 定 入相 的神。

netk

所以最后得到以下公式:

P

wki

yi

ak)

wki(

wijxj

i)ak

i 1

i

1

j 1

(3-4)

(2)误差的反向传播过程

误差的反向传播, 即首先由输出层开始逐层计算各层神经元的输出误差, 然后根据误差梯度下降法来调节各层的权值和阈值, 使修改后的网络的最终输出能接近期望值。

对于每一个样本p的二次型误差准则函数为

Ep:

Ep

1

L

ok)

输出层权值调整公式:

wki

E

E

netk

E

ok

netk

wki

netk

wki

ok

netk

wki

(3-8)

输出层阈值调整公式:

ak

E

E

netk

E

ok

netk

ak

netk

ak

ok

netk

ak

(3-9)

隐含层权值调整公式:

E

E

neti

E

yi

neti

wij

neti

wij

yi

neti

wij

wij

(3-10)

隐含层阈百度文库调整公式:

BP神经网络原理及应用

1人工神经网络简介

1.1生物神经元模型

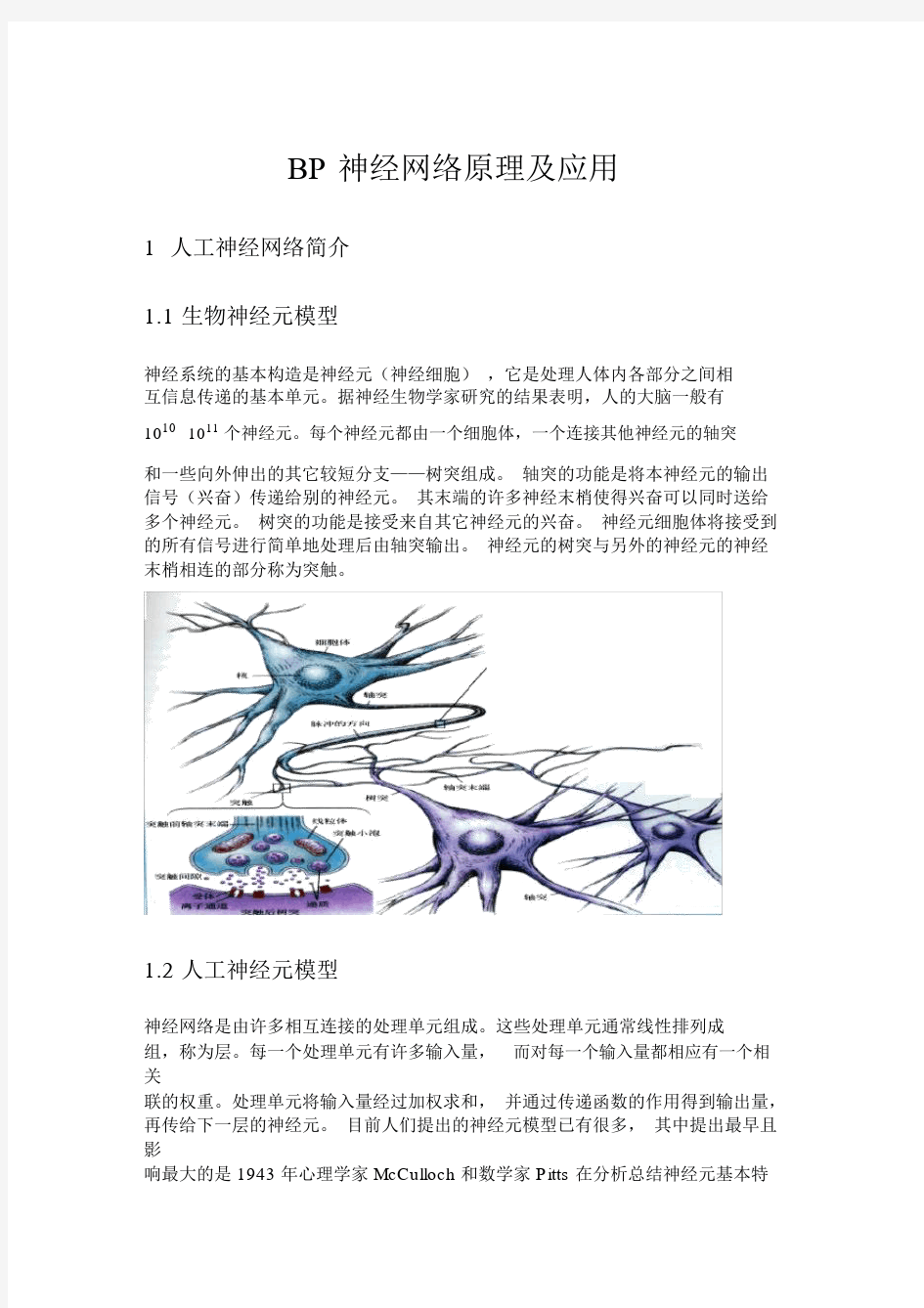

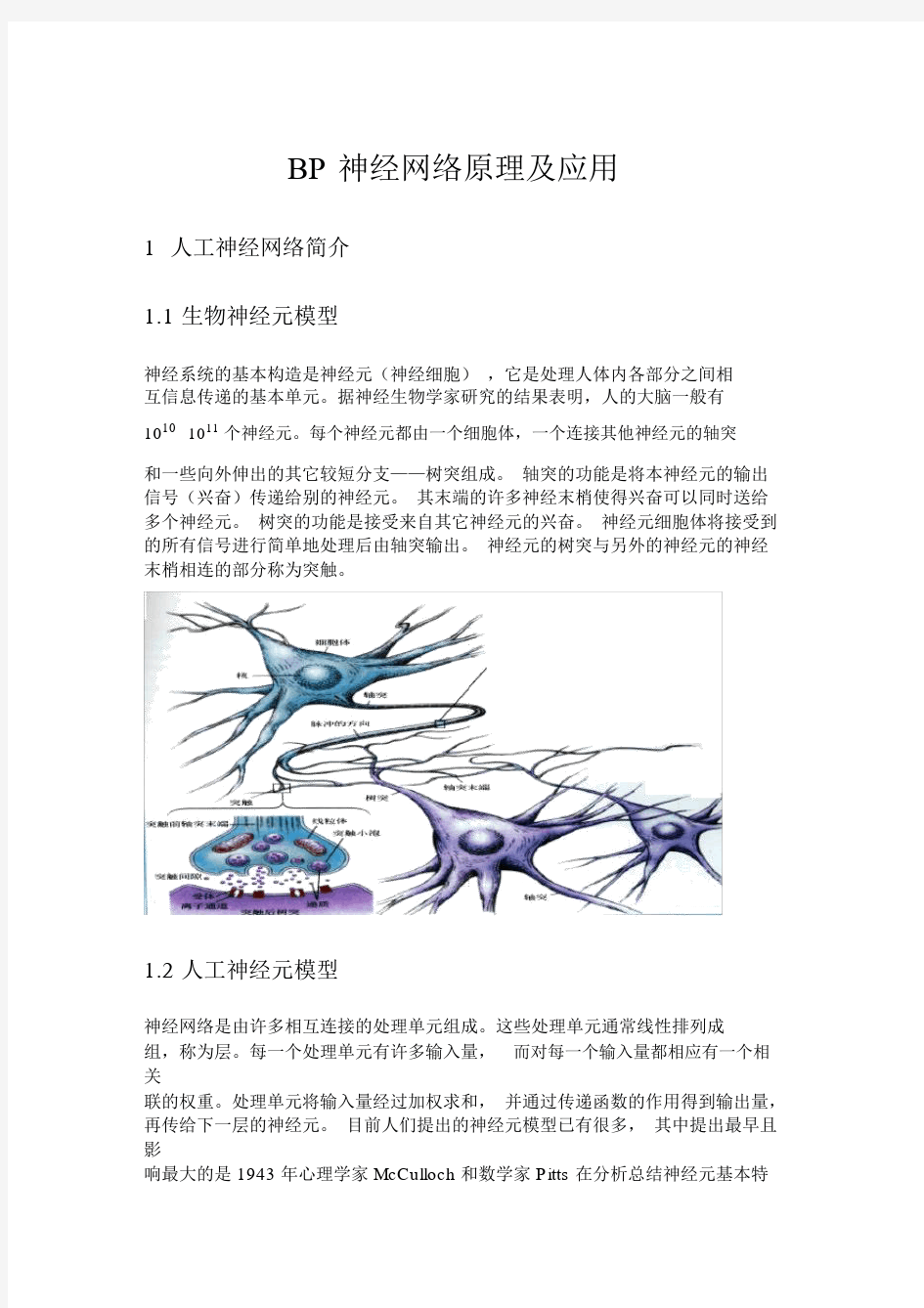

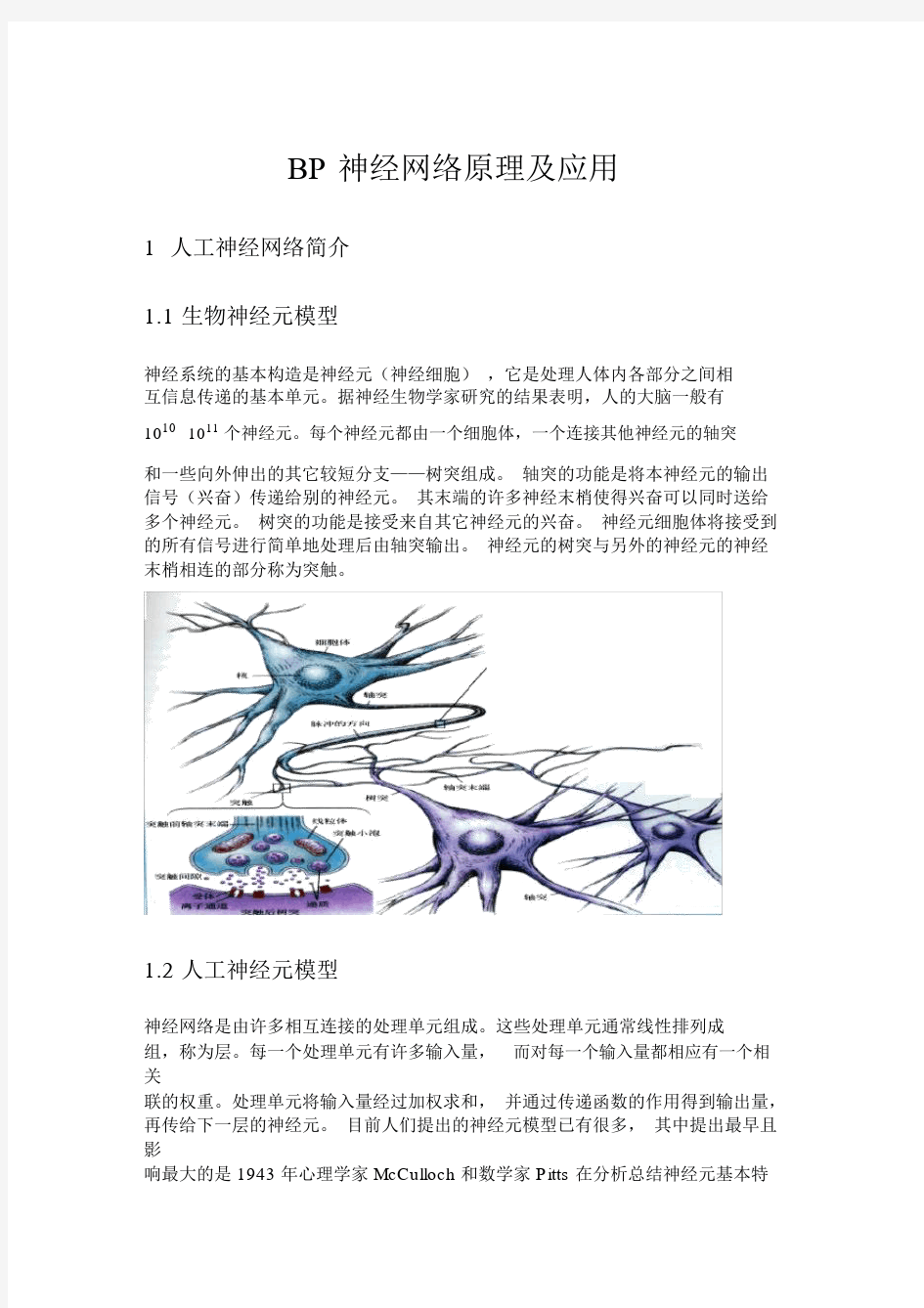

神经系统的基本构造是神经元(神经细胞) ,它是处理人体内各部分之间相互信息传递的基本单元。据神经生物学家研究的结果表明,人的大脑一般有

10101011个神经元。每个神经元都由一个细胞体,一个连接其他神经元的轴突

和一些向外伸出的其它较短分支——树突组成。 轴突的功能是将本神经元的输出信号(兴奋)传递给别的神经元。 其末端的许多神经末梢使得兴奋可以同时送给多个神经元。 树突的功能是接受来自其它神经元的兴奋。 神经元细胞体将接受到的所有信号进行简单地处理后由轴突输出。 神经元的树突与另外的神经元的神经末梢相连的部分称为突触。

2

(Tk

2k 1

(3-5)

系统对P个训练样本的总误差准则函数为:

E

1

P L

p

p

2

2p 1 k 1

(Tk

ok)

(3-6)

根据误差梯度下降法依次修正输出层权值的修正量

wki,输出层阈值的修正量

k

ij

,隐含层阈值的修正量

i。

a,隐含层权值的修正量

w

E

ak

E

wij

E

E

wki

wij;

i

wki;

ak;

i

(3-7)

i

又因为:

netk

wki

E

E

neti

E

yi

neti

i

neti

i

yi

neti

i

E

P

L

(Tkp

okp)

ok

p

1 k

1

yi

netk

1

neti

neti

1

ak

wij

xj

,

,

,

i

E

P

L

(Tkp

okp)

'(netk)

wki

yi

p 1

k 1

(3-11)

(3-12)

(3-13)

(3-14)

yi

( neti)

neti

ok'(netk)

wij表示 含 第i个 点到 入 第j个 点之 的 ;

i表示 含 第i个 点的 ;

( x)表示 含 的激励函数;

wki表示 出 第k个 点到 含 第i个 点之 的 ,i=1,⋯,q;ak表示 出 第k个 点的,k=1,⋯,L;

x表示 出 的激励函数;

ok表示输出层第k个节点的输出。

(1)信号的前向传播过程

式(无师)学习算法。此外,还存在第三种学习算法,即强化学习算法;可把它

看做有师学习的一种特例。

(1)有师学习有师学习算法能够根据期望的和实际的网络输出(对应于给定输

入)间的差来调整神经元间连接的强度或权。因此,有师学习需要有个老师或导

师来提供期望或目标输出信号。有师学习算法的例子包括规则、广义规

则或反向传播算法以及LVQ算法等。

(1)对于每个节点存在一个状态变量xi;

(2)从节点i至节点j,存在一个连接权系数wji;

(3)对于每个节点,存在一个阈值j;

(4)对于每个节点,定义一个变换函数fj( xi, wji,j), ij,对于最一般的情况,

此函数取fj( wjixi

j)形式。

i

1.4人工神经网络的主要学习算法

神经网络主要通过两种学习算法进行训练,即指导式(有师)学习算法和非指导

1.2人工神经元模型

神经网络是由许多相互连接的处理单元组成。这些处理单元通常线性排列成

组,称为层。每一个处理单元有许多输入量,而对每一个输入量都相应有一个相

关

联的权重。处理单元将输入量经过加权求和, 并通过传递函数的作用得到输出量,再传给下一层的神经元。 目前人们提出的神经元模型已有很多, 其中提出最早且

隐含层第i个节点的输入neti:

M

neti

j 1

wijxj

i

(3-1)

隐含层第i个节点的输出yi:

M

yi

(neti)

(

wijxj

i)

j 1

(3-2)

输出层第k个节点的输入netk:

q

q

M

netk

wkiyi

ak

wki(

wijxj

i)

ak

i 1

i 1

j

1

(3-3)

输出层第k个节点的输出ok:

q

q

M

ok(netk)(