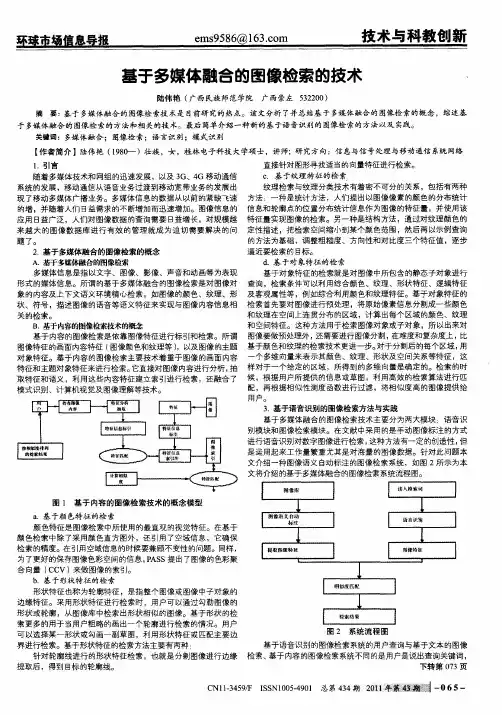

图像语义自动标注介绍

- 格式:ppt

- 大小:2.74 MB

- 文档页数:25

《数据标注研究综述》篇一一、引言随着人工智能()和机器学习(ML)技术的快速发展,数据标注作为训练高精度、高效率的模型的关键环节,日益受到学术界和工业界的广泛关注。

数据标注是通过将原始数据转换为有标签的数据集,为算法提供训练所需的特征表示。

本文将对近年来数据标注的相关研究进行全面的综述,以展现该领域的最新进展与未来发展方向。

二、数据标注的重要性与基本原理数据标注是构建人工智能系统的核心步骤之一。

其基本原理在于通过为原始数据添加相关的标签或特征,使得模型能够理解并学习数据的特性。

数据标注广泛应用于图像识别、自然语言处理、语音识别等各个领域,对提升模型的性能具有重要作用。

三、数据标注的研究现状(一)研究领域目前,数据标注的研究领域主要包括图像标注、文本标注、语音标注等。

其中,图像标注研究旨在通过添加对象标签、属性标签等方式为图像提供语义信息;文本标注研究主要涉及情感分析、关键词提取等方面;语音标注则致力于通过语种、口音等因素提升语音识别率。

(二)研究方法在数据标注的研究方法上,学者们主要采用自动化标注和人工标注两种方式。

自动化标注利用算法自动为数据添加标签,具有速度快、成本低的优势;而人工标注则依赖于专业人员对数据进行手动标注,其准确性较高,但成本相对较高。

此外,还有半自动化标注和混合标注等方法,旨在结合两种方法的优点。

四、数据标注的挑战与机遇(一)挑战当前,数据标注面临的主要挑战包括:1. 数据质量与准确性问题;2. 人工成本高昂;3. 缺乏标准化和规范化的标注流程;4. 面对海量数据的处理能力不足等。

这些挑战限制了数据标注的效率和准确性,影响了模型的性能。

(二)机遇随着技术的发展,数据标注也面临着诸多机遇:1. 自动化标注技术的不断提升,提高标注效率和准确性;2. 大数据技术的快速发展为处理海量数据提供了可能;3. 深度学习技术的广泛应用为跨领域、跨模态的数据标注提供了新思路;4. 数据标准化和规范化有望推动产业协同创新发展等。

视觉和文本领域的跨模态算法全文共四篇示例,供读者参考第一篇示例:视觉和文本领域的跨模态算法是近年来人工智能领域中备受关注的一个课题。

随着计算机视觉和自然语言处理技术的不断发展,研究者们开始探索将这两个领域结合起来,通过跨模态算法实现视觉与文本之间的有效交互与融合。

跨模态算法的发展为许多领域提供了新的可能性,如图像标注、图像检索、视频内容分析等。

在本文中,我们将详细介绍视觉和文本领域的跨模态算法的原理、方法和应用。

一、跨模态算法的基本概念跨模态算法是指将不同领域的信息进行融合和交互,实现跨模态数据之间的有效转换和学习。

在视觉和文本领域中,跨模态算法可以实现图像和文本之间的相互关联和推理,从而为未来智能系统的发展提供技术支持。

在跨模态算法中,通常会涉及到视觉和文本之间的特征提取、表示学习、匹配与融合等过程。

1. 特征提取:在跨模态算法中,视觉和文本数据通常会通过特征提取的方式将数据转换为机器可识别的表示形式。

对于视觉数据,可以通过卷积神经网络(CNN)等深度学习方法提取图像的特征;对于文本数据,可以采用词袋模型(Bag of Words)等方法进行文本特征的提取。

2. 表示学习:得到数据的特征表示后,跨模态算法会尝试学习不同数据模态之间的关联和共享信息。

通过表示学习的过程,算法可以发现图像和文本之间的相关性和相似性,为后续的任务提供支持。

3. 匹配与融合:跨模态算法会通过匹配与融合的方式将不同数据模态之间的信息进行整合。

通过匹配和融合的过程,算法可以实现视觉与文本之间的内容对齐、情感融合等任务,为图像标注、图像检索等应用提供支持。

二、视觉和文本领域的跨模态算法1. 图像标注:图像标注是指通过文本描述的方式为图像内容添加语义标签。

跨模态算法可以将图像的视觉信息与文本的语义信息进行融合,实现图像标注的自动化过程。

在图像标注任务中,跨模态算法可以通过图像特征与文本特征的匹配与融合,将图像与对应的语义标签进行关联。

如何应对计算机视觉中的语义分析与语义理解问题计算机视觉中的语义分析与语义理解是近年来人工智能领域的热门课题之一。

通过对图像或视频进行深度学习和自然语言处理等技术的应用,计算机能够理解并解释出图像中所包含的语义信息。

在实际应用中,这种能力可以帮助计算机实现自动化的图像识别、场景分析和智能决策等功能。

本文将从语义分析和语义理解两个方面入手,介绍如何应对计算机视觉中的语义分析与语义理解问题。

一、语义分析在计算机视觉中,语义分析的目标是从图像中提取出包含诸如物体、场景、行为等语义内容的信息。

通常情况下,语义分析可以分为以下几个步骤:1. 物体识别:通过训练深度神经网络模型,将图像分成若干个区域,然后对每个区域进行物体识别。

这一步骤需要使用大量标注好的图像数据进行训练,以提高算法的准确性和鲁棒性。

2. 场景理解:通过对图像中包含的各种物体进行分析和推理,识别出图像所展示的场景信息。

场景理解可以帮助计算机更好地理解并处理复杂的现实场景,从而提供更准确的分析结果。

3. 行为分析:通过对图像中人体或其他物体的姿态、动作等特征进行分析,推测出其所代表的行为。

行为分析在安防监控、视频分析等领域有着广泛的应用,可以提供实时的行为检测和警报功能。

针对计算机视觉中的语义分析问题,我们可以采取以下策略:1. 数据标注与模型训练:为了获取高质量的语义信息,需要构建标注好的图像数据集,并基于这些数据集训练优秀的深度学习模型。

数据的质量和数量对于模型的准确性至关重要,因此需要花费充分的时间和人力资源来完成这一步骤。

2. 特征提取与表达:在语义分析过程中,如何提取出关键的特征并进行有效的表示是一个关键问题。

可以通过使用卷积神经网络(CNN)等技术,从原始图像中提取出物体检测和场景理解等方面所需要的特征。

3. 深度学习与模型优化:采用深度学习技术来实现语义分析是目前最为常见的方法。

在模型训练过程中,可以通过调整网络结构、优化算法和增加训练数据来提高模型的准确性和泛化能力。

目标识别语义分割变化检测场景分类逻辑回归-概述说明以及解释1.引言1.1 概述目标识别、语义分割、变化检测、场景分类以及逻辑回归是计算机视觉领域中重要的研究方向。

随着人工智能的快速发展,这些技术在图像处理、视频分析以及自动驾驶等应用中发挥着关键作用。

目标识别是指通过图像或视频中的特征提取和模式匹配技术,将感兴趣的目标从背景中准确定位和识别出来。

它在实时监控、人脸识别和图像检索等领域中有着广泛的应用。

语义分割是将图像分割成语义上有意义的区域,即将每个像素点分配给特定的类别。

通过语义分割,我们可以更好地理解图像中的场景以及不同目标的位置与形状,在自动驾驶、医学影像分析等领域具有很高的研究价值。

变化检测是指通过比较图像序列之间的差异,来检测图像中发生的变化。

变化检测在遥感图像分析、环境监测以及视频监控中具有重要意义,它可以帮助我们及时发现异常情况和变化事件。

场景分类是将图像或视频分为不同的场景类别,例如室内、室外、山地、海滩等。

场景分类在图像检索、智能监控和图像自动标注等方面有广泛的应用,通过对图像的场景分类可以更好地理解图像的语义和内容。

逻辑回归是一种常用的分类算法,通过建立逻辑回归模型,将输入样本映射为一个概率值,并根据概率值进行分类决策。

逻辑回归在广告推荐、信用风险评估以及医疗诊断等领域有着广泛的应用。

本篇文章将重点介绍目标识别、语义分割、变化检测、场景分类和逻辑回归这几个研究方向的要点和方法,并对其在实际应用中的挑战和发展前景进行讨论。

通过对这些技术的深入了解,我们可以更好地理解计算机视觉领域的最新研究动态,并为相关实际问题提供有效的解决方案。

1.2 文章结构文章结构部分的内容可以是对整篇文章的组织和结构进行介绍和概述。

以下是一个可能的编写内容:文章结构本文主要围绕目标识别、语义分割、变化检测、场景分类和逻辑回归这五个主题展开深入研究和讨论。

为了更好地分析和理解这些主题,文章按照以下结构进行组织和呈现。

人工智能初级工数据标注知识点一、数据标注的定义和意义数据标注是指对原始数据进行标记和注释,以便于机器学习算法能够理解和处理这些数据。

数据标注在人工智能领域中起着至关重要的作用,它为机器学习提供了有标签的训练数据,使得模型能够通过学习这些数据来进行预测和决策。

二、数据标注的常见任务数据标注涵盖了多个任务,常见的包括:1. 分类标注分类标注是将数据分为不同的类别或类别集合,例如将一组图片标注为猫、狗和鸟等。

2. 实体标注实体标注是在文本中标注出特定的实体,例如人名、地名、组织机构等。

3. 关系标注关系标注是在数据中标注出不同实体之间的关系,例如人物之间的亲属关系、产品之间的竞争关系等。

4. 语义标注语义标注是对数据进行语义解析和标注,例如将自然语言文本转换成语义表示形式。

5. 图像标注图像标注是对图像中的不同部分进行标注,例如标注出图像中的物体、场景和动作等。

三、数据标注的流程数据标注通常包括以下几个步骤:1. 数据准备在数据标注之前,需要对原始数据进行清洗和预处理,包括去除噪声、处理缺失值等。

2. 标注方案设计根据任务需求,设计标注方案,明确需要标注的内容和标注方式。

3. 标注工具选择选择适合的标注工具,常见的标注工具包括LabelImg、RectLabel、VGG Image Annotator等。

4. 标注过程根据标注方案,使用标注工具对数据进行标注,确保标注的准确性和一致性。

5. 质量控制对已标注的数据进行质量控制,包括人工复核和自动化检查等,确保标注的质量和准确性。

6. 数据集划分将标注好的数据集划分为训练集、验证集和测试集,用于机器学习模型的训练和评估。

四、数据标注的挑战和注意事项数据标注虽然重要,但也面临一些挑战和注意事项:1. 主观性数据标注往往涉及主观判断,不同标注人员可能有不同的看法和标准,需要进行统一的标注规范和培训。

2. 标注错误标注过程中可能会出现错误,例如标注遗漏、错误标注等,需要进行质量控制和纠正。

基于DBNMI模型的海洋遥感影像自动标注方法黄冬梅;许琼琼;杜艳玲;贺琪【期刊名称】《中国科学技术大学学报》【年(卷),期】2017(047)007【摘要】研究大规模海洋遥感影像管理的关键是缩小影像低层视觉特征与高层语义之间的鸿沟.针对海洋遥感影像中不同区域对语义相似性度量的贡献程度不同,提出一种基于深度信念网络多示例(deep belief networks multi-instance,DBNMI)的遥感影像语义自动标注模型.模型对初始输入遥感影像进行自适应分割,粗粒度划分海洋遥感影像背景区域和对象区域;对影像对象区域的低层视觉特征和高层语义概念间关系,利用深度信念网络模型进行自动建模;定量计算标注词间共现和对立的语义关系,改善图像标注结果.在公开遥感影像数据集上进行验证,实验表明所提出方法在标注精度上取得了较好效果.%Bridge the semantic gap between low-level visual feature and high-level semantic concepts has been the subject of intensive investigation on large scale remote sensing image management for years in order to improve the accuracy of automatic image annotation.An ocean remote sensing image auto-annotation method based on DBNMI model was proposed for contributions of semantic similarity about different regions of ocean remote sensing images.Initial remote sensing images were adaptively segmented, ocean remote sensing images were divided into background and the object region by means of a coarse-grained method,the relationship between low-level visual feature and high-level semantics label of the object region was modeledautomatically, using DBN model, and the co-occurrence relations and adversarial relations between semantic concepts for improving image annotation results were calculated. The proposed approach is evaluated on a public remote sensing image dataset.The experimental results show a satisfactory improvement on accuracy.【总页数】6页(P541-546)【作者】黄冬梅;许琼琼;杜艳玲;贺琪【作者单位】上海海洋大学信息学院,上海 201306;上海海洋大学信息学院,上海201306;上海海洋大学信息学院,上海 201306;上海海洋大学信息学院,上海201306【正文语种】中文【中图分类】TP391【相关文献】1.基于扩展生成语言模型的图像自动标注方法 [J], 王梅;周向东;张军旗;许红涛;施伯乐2.基于自适应高斯混合模型的遥感影像分类方法研究——以武汉地区遥感影像分类为例 [J], 李登朝;吴健;许凯3.基于高斯混合模型的现代汉语构式成分自动标注方法 [J], 黄海斌;常宝宝;詹卫东4.一种基于多模态主题模型的图像自动标注方法 [J], 田璟;郭智;黄宇;黄廷磊;付琨5.基于异构描述子的新型高斯混合模型图像自动标注方法 [J], 陈利琴;金聪因版权原因,仅展示原文概要,查看原文内容请购买。