概率独立性

- 格式:ppt

- 大小:376.00 KB

- 文档页数:13

知识点概率与统计中的事件独立性知识点:概率与统计中的事件独立性事件独立性是概率与统计中的一个重要概念,指的是两个或多个事件之间的发生与否互不影响、相互独立的性质。

在实际问题中,对事件独立性的判断和运用是非常常见的。

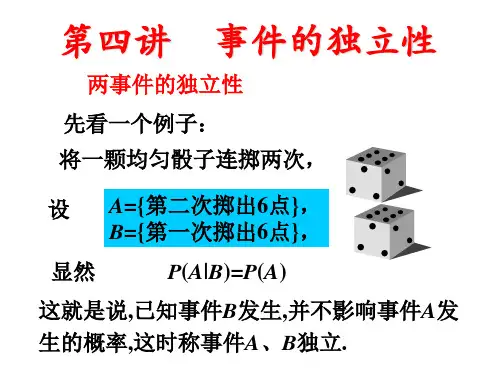

一、事件独立性的定义和性质在概率与统计中,如果两个事件A和B满足以下条件,即当事件A 发生与否并不影响事件B的概率时,称事件A与B是独立事件。

具体而言,事件A与B的独立性可表述为:P(A∩B) = P(A) × P(B)其中,P(A)表示事件A发生的概率,P(B)表示事件B发生的概率,P(A∩B)表示事件A与事件B同时发生的概率。

根据事件独立性的定义,可以得出以下性质:1. 事件A与自身是独立的,即P(A∩A) = P(A) × P(A),即事件A发生与否不影响事件A本身的概率。

2. 如果事件A与事件B独立,那么事件A的补事件与事件B也是独立的,即P(A'∩B) = P(A') × P(B)。

3. 如果事件A与事件B独立,那么事件A与事件B的补事件也独立,即P(A∩B') = P(A) × P(B')。

二、事件独立性的判断在实际问题中,如何判断两个事件是否独立是一个重要的问题。

通常可以通过以下两种方式进行判断。

1. 通过已知概率判断:如果已知事件A和事件B的概率,可以通过计算P(A∩B)和P(A) × P(B)来判断两者是否相等。

如果相等,则事件A与事件B是独立的;如果不相等,则事件A与事件B不是独立的。

2. 通过条件概率判断:根据条件概率的定义,如果已知事件A和事件B的条件概率P(A|B)和P(B|A),可以通过比较P(A|B)和P(A)以及P(B|A)和P(B)的大小关系来判断事件A与事件B的独立性。

如果条件概率与边际概率相等,则事件A与事件B是独立的;如果条件概率与边际概率不相等,则事件A与事件B不是独立的。

概率与统计中的事件独立性事件独立性是概率论和统计学中一个基本概念,用于描述两个或多个事件之间是否相互独立发生的性质。

在概率论和统计学中,研究事件独立性对于理解随机性事件的关系和推断未知信息具有重要意义。

本文将介绍概率与统计中的事件独立性的定义、性质和应用。

一、定义在概率论中,两个事件A和B是相互独立的,当且仅当事件A的发生与B的发生是相互无关的,即事件A的发生不会影响事件B的发生概率,记作P(A∩B) = P(A)P(B)。

其中,P(A)和P(B)分别表示事件A 和事件B发生的概率,P(A∩B)表示事件A和B同时发生的概率。

如果P(A∩B) ≠ P(A)P(B),则事件A和B是不独立的。

二、性质事件独立性具有以下性质:1. 互逆性:若事件A和B独立,则事件B和A也独立。

2. 自反性:事件A与自身独立,即P(A∩A) = P(A)P(A) = P(A)。

3. 不交性:对于任意事件A和B,若A与B互不相容(即A∩B=∅),则A和B不独立。

4. 幂等性:若事件A和事件B独立,那么事件A和事件B的补集(A'和B')也独立。

三、应用事件独立性在概率论和统计学中有广泛的应用,例如:1. 加法法则与乘法定理:事件独立性是加法法则和乘法定理的重要前提。

根据加法法则,对于互不相容的事件A和B,其联合概率可以表示为P(A∪B) = P(A) + P(B)。

而乘法定理则利用了独立事件的特性,通过P(A∩B) = P(A)P(B)计算联合概率。

2. 条件独立性:条件独立性指的是在给定某一事件的条件下,其他事件之间是否独立。

例如,对于事件A、B和C,若事件A和B独立,且事件C与A的发生与否无关,那么事件C与B也独立。

3. 贝叶斯定理:贝叶斯定理利用了事件独立性的概念,通过P(A|B) = P(B|A)P(A) / P(B)计算后验概率。

其中,P(A|B)表示在事件B发生的条件下,事件A发生的概率。

4. 统计推断:在统计学中,独立性的概念也广泛应用于构建统计模型和进行推断。

高中数学概率计算中的条件概率与独立性判定概率是数学中一个重要的概念,它描述了某个事件发生的可能性大小。

在概率计算中,条件概率与独立性判定是两个重要的考点,它们在解题过程中起着至关重要的作用。

本文将围绕这两个概念展开讨论,并通过具体题目的举例,说明其考点和解题技巧。

一、条件概率的概念和计算方法条件概率是指在已知某个条件下,另一个事件发生的概率。

常用的计算公式为:P(A|B) = P(A∩B) / P(B),其中P(A|B)表示在事件B发生的条件下,事件A发生的概率,P(A∩B)表示事件A与事件B同时发生的概率,P(B)表示事件B发生的概率。

例如,某班学生中有30%的人会打篮球,其中男生占总人数的40%,女生占总人数的60%。

现在从该班级中随机抽取一个学生,已知这个学生会打篮球,求这个学生是男生的概率。

解题思路:设事件A表示所抽取的学生是男生,事件B表示所抽取的学生会打篮球。

根据已知条件可知,P(A) = 40%,P(B) = 30%,P(A∩B) = P(B|A) * P(A) = 0.3 * 0.4 = 0.12。

根据条件概率的计算公式可得到所求概率:P(A|B) = P(A∩B) / P(B) = 0.12 / 0.3 = 0.4。

通过这个例子,我们可以看出条件概率在解题中的重要性。

在实际应用中,条件概率常常用于处理复杂的情况,如疾病的诊断、市场调研等领域。

二、独立性判定的概念和判定方法独立性是指两个事件之间的发生与否不相互影响。

如果事件A和事件B是独立的,那么P(A∩B) = P(A) * P(B)。

否则,事件A和事件B是相关的。

例如,某班学生中有80%的人喜欢音乐,70%的人喜欢阅读,已知喜欢音乐的学生中有60%的人也喜欢阅读。

问喜欢音乐和喜欢阅读这两个事件是否独立?解题思路:设事件A表示喜欢音乐,事件B表示喜欢阅读。

根据已知条件可知,P(A) = 80%,P(B) = 70%,P(A∩B) = 60%。

条件概率与事件的独立性例题和知识点总结在概率论中,条件概率和事件的独立性是两个非常重要的概念。

理解它们对于解决各种概率问题至关重要。

下面,我们将通过一些具体的例题来深入探讨这两个概念,并对相关知识点进行总结。

一、条件概率条件概率是指在已知某个事件发生的条件下,另一个事件发生的概率。

其定义为:设 A、B 是两个事件,且 P(A)>0,在事件 A 发生的条件下,事件 B 发生的条件概率记为 P(B|A),且 P(B|A) = P(AB) /P(A) 。

例 1:一个盒子里有 5 个红球和 3 个白球。

从中随机取出一个球,已知取出的是红球,求它是第二个红球的概率。

解:设 A 表示“第一次取出红球”,B 表示“第二次取出红球”。

则P(A) = 5/8 。

P(AB) 表示“第一次和第二次都取出红球”,其概率为 5/8 × 4/7 = 5/14 。

所以 P(B|A) = P(AB) / P(A) =(5/14) /(5/8) =4/7 。

例 2:某班级学生的数学成绩及格率为 80%,英语成绩及格率为70%,已知某学生数学成绩及格,求他英语成绩也及格的概率。

解:设 A 表示“数学成绩及格”,B 表示“英语成绩及格”。

P(A) =08 ,P(AB) 表示“数学和英语成绩都及格”,假设两者相互独立,则P(AB) = 08 × 07 = 056 。

所以 P(B|A) = P(AB) / P(A) = 056 / 08 =07 。

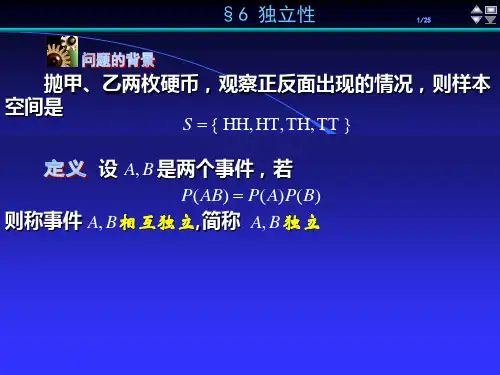

二、事件的独立性如果事件 A 的发生不影响事件 B 发生的概率,事件 B 的发生也不影响事件 A 发生的概率,那么称事件 A 和事件 B 相互独立。

即 P(B|A) = P(B) 且 P(A|B) = P(A) ,等价于 P(AB) = P(A)P(B) 。

例 3:抛掷两枚均匀的硬币,设事件 A 为“第一枚硬币正面朝上”,事件 B 为“第二枚硬币正面朝上”,判断 A、B 是否独立。

概率独立性与相关性的判断概率独立性和相关性是概率论中的两个重要概念,它们在统计学和数据分析中具有广泛的应用。

本文将深入探讨概率独立性和相关性的判断方法及其在实际问题中的应用。

一、概率独立性的判断概率独立性是指两个事件的发生与否互相不影响,即事件A的发生与否对事件B的发生概率没有影响,反之亦然。

在判断概率独立性时,我们可以根据联合概率和边缘概率之间的关系进行分析。

对于两个事件A和B,若它们为独立事件,则有以下条件成立:P(A∩B) = P(A) * P(B)其中,P(A∩B)表示事件A和事件B同时发生的概率,P(A)表示事件A发生的概率,P(B)表示事件B发生的概率。

通过计算上述等式两边的数值来判断两个事件是否独立。

若等式成立,则说明两个事件独立;若等式不成立,则说明两个事件不独立。

举例来说,假设有一枚公正的硬币,事件A表示抛掷硬币正面朝上,事件B表示抛掷硬币反面朝上。

根据硬币的性质,我们知道事件A和事件B是独立的,因为抛掷硬币的结果不受之前的结果影响,每一次抛掷硬币的概率都是1/2。

二、相关性的判断相关性是指两个变量之间的关联程度。

在统计学中,用协方差和相关系数来衡量两个随机变量之间的相关性。

1. 协方差协方差是衡量两个变量关系强弱和方向的统计量,用Cov(X,Y)表示,其中X和Y为两个随机变量。

协方差的计算公式如下:Cov(X, Y) = E[(X-E(X))(Y-E(Y))]其中E表示期望值。

协方差为正值时,表示X和Y呈正相关;协方差为负值时,表示X和Y呈负相关;协方差为零时,表示X和Y不相关。

2. 相关系数相关系数是在协方差的基础上进行标准化的统计量,用ρ(X,Y)表示,取值范围为[-1,1]。

相关系数的计算公式如下:ρ(X, Y)= Cov(X, Y) / σ(X)σ(Y)其中σ(X)和σ(Y)分别表示X和Y的标准差。

相关系数接近于1时,表示X和Y呈正相关;相关系数接近于-1时,表示X和Y呈负相关;相关系数接近于0时,表示X和Y不相关。

大学数学易考知识点概率论的条件概率与独立性大学数学易考知识点:概率论中的条件概率与独立性概率论是数学中一个重要的分支,研究事物发生的可能性。

在大学数学的学习中,概率论是一个比较常见的考点。

其中,条件概率与独立性是概率论中的两个基本概念。

本文将详细介绍条件概率与独立性的概念、性质以及应用。

一、条件概率条件概率是指在已知事件B发生的条件下,事件A发生的概率。

其计算公式为:P(A|B) = P(A∩B) / P(B)其中,P(A|B)表示事件B发生的条件下,事件A发生的概率;P(A∩B)表示事件A与事件B同时发生的概率;P(B)表示事件B发生的概率。

条件概率的计算可以通过实际问题的转化来帮助理解。

例如,某班级有60%的男生和40%的女生,已知班级中80%的学生喜欢数学。

现在要求已知一位学生是男生的条件下,他也喜欢数学的概率。

根据条件概率的计算公式,我们可以得到:P(喜欢数学|男生) = P(喜欢数学∩男生) / P(男生)由于已知喜欢数学的学生占总人数的80%,而男生占总人数的60%,则有:P(喜欢数学|男生) = (0.8*0.6) / 0.6 = 0.8所以,在已知一位学生是男生的条件下,他也喜欢数学的概率为0.8。

条件概率的计算方法对于实际问题的解决非常有用。

通过合理的条件划分,我们可以计算出各种条件下的概率,从而更好地理解和解决问题。

二、独立性在概率论中,独立性是指两个事件的发生与否互相不影响。

具体而言,事件A与事件B相互独立的条件为:P(A|B) = P(A)P(B|A) = P(B)即事件A发生的概率与事件B发生与否无关,事件B发生的概率与事件A发生与否无关。

两个独立事件的条件概率相等于事件的边际概率。

例如,某扑克牌中共有52张牌,我们从牌中随机抽取一张,记录下此牌的花色,然后将此牌放回。

再次从牌中随机抽取一张,记录下此牌为红桃。

问第一次所抽取的牌为红色的概率是多少?根据题意,第一次所抽取的牌为红色的概率为1/2,因为扑克牌中共有52张牌,其中红色牌有26张。

条件概率与独立性1、条件概率:一般地,若有两个事件A和B,在已知事件B发生的条件下考虑事件A发生的概率,则称此概率为B 已发生的条件下A的条件概率。

记作:P(A|B)。

2、事件的积的概率:两个事件A、B同时发生时,其概率通常称为事件A与事件B的积的概率。

记作:P(A∩B)或P(AB)。

3、条件概率的有关计算:P(A|B)=P(A B)/ P(B);P(AB)=P(A|B)·P(B)=P(B|A)·P(A)。

4、事件的独立性:若事件A、B满足P(A|B)=P(A),即事件B的发生不影响事件A发生的概率(同样,事件A发生也不影响事件B发生的概率,即P(B|A)=P(B)),则称事件A、B互相独立。

5、当事件A、B 互相独立时,P(AB)=P(A)·P(B)。

若有n个事件(n>2)互相独立,则有P(A1A2……A n)=P(A1)·P(A2)·……·P(A n)。

例1:将一枚硬币抛掷两次,事件A表示两次正面向上,事件B表示至少有一次正面向上,求P(A)、P(B)、P(A B)、P(A|B)、P(B|A)。

例2:抛掷一颗质地均匀的骰子所得点数的样本空间记为S={1,2,3,4,5,6},令事件A={2,3,4},B={1,2,4,6},求P(A)、P(A B)、P(A|B)。

例3:如图一所示的正方形被平均分成A、B、C、D、E、F、G、H、I九个部分,向大正方形区域随机投掷一个点(每次均能投中),若投中左侧3个小正方形区域(即A、B、C)的事件记作M,投中最上面三个小正方形及正中间的一个小正方形事件(即A、D、G、E),记作N,求P(MN)、P(M|N) 。

例4:在一个盒子中有大小相同的10个红球和10个白球,求第一个人摸出一个红球(不放回),第 2 个人摸出一个白球的概率。

例5:连续抛掷一枚硬币n次(n>2),若前n-1次均为正面,求第n次出现反面的概率。

概率事件的独立性是一个核心概念,在概率论和统计学中有广泛应用。

理解独立事件有助于我们更准确地分析复杂系统中的不确定性。

本文将详细探讨概率事件的独立性,包括其定义、性质、应用,以及在现实世界中的意义和局限性。

一、独立性的定义两个事件A和B如果满足以下条件,则称它们是独立的:P(A ∩ B) = P(A) × P(B)其中,P(A ∩ B)表示事件A和B同时发生的概率,P(A)和P(B)分别表示事件A和B发生的概率。

这个定义直观的表达了独立性的含义:一个事件的发生不影响另一个事件的概率。

二、独立性的性质1. 交换性:如果A和B是独立的,那么B和A也是独立的。

这符合我们对独立性的直观理解,即独立关系不具有方向性。

2. 对称性:如果A和B是独立的,那么对于任何事件C,A和C独立的概率等于B和C独立的概率。

这意味着在独立关系中,一个事件与其他事件的独立性不依赖于其他特定事件。

3. 传递性:如果A和B独立,B和C独立,那么A和C也是独立的。

这个性质表明,独立性可以在事件之间传递,使得我们可以更方便地分析多个事件之间的独立关系。

三、独立性的应用1. 赌博游戏:在许多赌博游戏中,如掷骰子或抽取扑克牌,每次抽取都是独立的。

这意味着前一次的结果不会影响下一次的结果,从而保证了游戏的公平性。

2. 可靠性工程:在可靠性工程中,独立性概念用于评估系统的整体可靠性。

如果系统中的各个组件故障是相互独立的,那么整个系统的可靠性可以通过单个组件的可靠性来计算。

3. 统计分析:在统计分析中,独立性假设是许多统计模型的基础。

例如,在回归分析中,我们假设自变量和因变量之间的关系是独立的,以便更准确地预测因变量的值。

四、独立性与条件独立性条件独立性是两个事件在给定第三个事件的情况下相互独立。

即如果已知事件C发生,那么事件A和B的发生是独立的。

条件独立性的概念扩展了独立性的定义,使我们能够在更复杂的情境中分析事件之间的关系。

例如,在天气预报中,给定某个大气条件C(如高压系统),某地区明天是否下雨A和后天是否下雨B可能是条件独立的,即明天的雨水不会影响后天是否下雨,在给定的大气条件下。

随机变量的独立性和条件概率分布是概率论中的重要概念,在很多领域都有广泛的应用。

独立性的概念是指两个或多个事件之间的关系,而条件概率分布则是指随机变量在给定一些条件下的概率分布。

首先来看独立性。

在数学上,独立性通常指的是两个随机变量之间的关系。

如果两个随机变量X和Y是独立的,那么它们可以分别考虑,而且它们之间的任何影响都不会相互影响。

具体来说,如果两个随机变量X和Y是独立的,那么它们的联合概率分布可以拆分成它们各自的概率分布的乘积。

即,P(X=x, Y=y) = P(X=x) * P(Y=y)。

举个例子,假设我们有两个骰子,我们把它们连续掷两次。

我们可以定义随机变量X为第一次掷出的点数,随机变量Y为第二次掷出的点数。

如果我们假设这两个骰子是六面的,并且它们是公平的,那么每个点数出现的概率都是1/6。

因此,我们可以计算出X和Y的概率分布,分别为P(X=1)=P(X=2)=P(X=3)=P(X=4)=P(X=5)=P(X=6)=1/6和P(Y=1)=P(Y=2)=P(Y=3)=P(Y=4)=P(Y=5)=P(Y=6)=1/6。

现在,假设我们想知道掷出的两个点数是相等的这个事件的概率。

我们可以用独立性来计算。

因为X和Y是独立的,所以P(X=x, Y=y) =P(X=x) * P(Y=y),因此,P(X=Y) = ΣP(X=x, Y=x) = ΣP(X=x) *P(Y=x) = 1/6 * 1/6 + 1/6 * 1/6 +...+1/6 * 1/6 = 1/6。

接下来看条件概率分布。

条件概率分布是指,在给定一些条件下,随机变量的概率分布。

具体来说,如果我们知道了一些关于随机变量的信息,那么我们可以通过条件概率分布来计算在这些信息下随机变量的取值的概率。

条件概率分布通常用P(X|Y)表示,表示给定Y的条件下,X的概率分布。

它可以通过原始的概率分布计算得到。

具体来说,如果我们知道了Y的取值,那么我们可以将联合概率分布进行归一化,得到在Y取值的条件下,X取值的概率分布。