基于机器视觉的驾驶疲劳检测方法

- 格式:pdf

- 大小:187.82 KB

- 文档页数:4

基于视觉的全天候驾驶员疲劳与精神分散状态监测方法随着社会经济的不断发展,各国汽车保有量的迅速增加,交通事故发生率也居高不下,交通安全问题日益突出,研究表明驾驶疲劳与精神分散是引发交通事故的重要原因之一。

因此,对驾驶员全天候的疲劳和精神分散状态监测的研究有着重大的意义。

本文通过机器视觉方法对白天和夜间的驾驶员面部特征进行实时监测,当驾驶员发生疲劳与精神分散时给予警示,从而为减少交通事故的发生提供了技术上的支持。

根据红外光谱和夜间驾驶员红外人脸图像的特点,对夜间红外图像进行预处理和人脸图像分割,定位驾驶员的人脸区域。

在此基础上建立眼睛感兴趣区域,利用形态学滤波方法、连通区域标示和椭圆拟合等算法定位眼睛区域,并对人脸区域及眼睛区域进行实时跟踪。

根据夜间驾驶员眼睛的瞳孔红外反射特性,对瞳孔和普尔钦光斑的进行检测,利用两者的位置关系判断驾驶员的视线方向,并分析视线方向的精度。

白天人脸图像检测利用局部SMQT方法提取面部特征,通过SNoW分类器对驾驶员面部进行定位。

由于白天光照不均,采用图像增强算法对白天驾驶员图像进行预处理,进行阈值分割后,利用眼睛的约束条件得到眼睛区域的准确定位。

最后对白天和夜间驾驶员的疲劳与精神分散的状态监测进行了研究,提出了基于贝叶斯网络融合的方法对夜间驾驶员疲劳状态进行检测以及基于视线方向估计的方法对夜间驾驶员精神分散状态进行检测。

提出了采用PERCLOS方法对白天驾驶员疲劳状态进行检测和基于面部横摆角的驾驶员精神分散检测方法。

并对上述算法进行了实验验证。

同主题文章[1].周鹏,王明时,孙红霞. 基于USB2.0的红外图像数据采集系统' [J]. 河北工业科技. 2005.(02)[2].孙红霞,王明时,王学民. USB2.0在红外图像采集中的应用' [J]. 仪器仪表学报. 2004.(S1)[3].江涛. 运用红外图像特定火源的高精度监视、灭火系统' [J]. 红外. 2000.(01)[4].周培德,付梦印,张长江. 红外图像边缘提取的随机阈值方法' [J]. 兵工学报. 2005.(02)[5].江涛. 红外图像领域市场扩大' [J]. 红外. 1999.(06)[6].王自勇,廖朝佩. 红外图像自动目标识别技术进展' [J]. 飞航导弹.1996.(07)[7].周建勋,王利平,刘滨. 红外图像非均匀性产生原因分析' [J]. 红外与激光工程. 1997.(03)[8].史彩成,赵保军,韩月秋,毛二可. 基于模糊理论的红外图像滤波' [J]. 激光与红外. 2001.(02)[9].王丽英. IR-Fusion技术使可见光和红外图像能在热像仪内融合并进行分析' [J]. 今日电子. 2006.(09)[10].刘劲松,闫剑峰,徐军,邵晓鹏,张建奇. 红外图像数据库的研建' [J]. 红外与激光工程. 1999.(06)【关键词相关文档搜索】:载运工具运用工程; 机器视觉; 疲劳与精神分散; 近红外图像; 视线估计; 贝叶斯网络【作者相关信息搜索】:吉林大学;载运工具运用工程;王荣本;邸巍;。

《基于机器视觉的驾驶员疲劳状态检测系统研究》一、引言驾驶员疲劳是引发交通事故的重要因素之一。

在道路交通安全中,对于驾驶员的疲劳状态检测至关重要。

近年来,随着机器视觉技术的不断发展,基于机器视觉的驾驶员疲劳状态检测系统逐渐成为研究的热点。

本文旨在研究基于机器视觉的驾驶员疲劳状态检测系统,以提高道路交通安全性。

二、机器视觉技术概述机器视觉技术是通过模拟人眼和大脑的视觉功能,利用计算机和图像处理技术对图像进行捕捉、处理、分析和理解的技术。

在驾驶员疲劳状态检测中,机器视觉技术可以通过对驾驶员的面部特征进行捕捉和分析,判断其是否处于疲劳状态。

三、驾驶员疲劳状态检测系统研究基于机器视觉的驾驶员疲劳状态检测系统主要包括图像采集、预处理、特征提取和状态识别等步骤。

1. 图像采集图像采集是驾驶员疲劳状态检测的第一步。

通过在车辆内部安装摄像头,实时捕捉驾驶员的面部图像。

为了保证图像的清晰度和准确性,需要选择合适的摄像头和照明条件。

2. 图像预处理图像预处理是对采集到的图像进行去噪、增强和二值化等处理,以提高图像的质量和对比度,便于后续的特征提取。

常用的预处理方法包括灰度化、直方图均衡化、滤波等。

3. 特征提取特征提取是驾驶员疲劳状态检测的关键步骤。

通过对预处理后的图像进行特征提取,可以获取到驾驶员的面部特征,如眼睛、嘴巴等。

常用的特征提取方法包括基于模板匹配的方法、基于机器学习的方法等。

4. 状态识别状态识别是通过将提取的特征与预设的疲劳状态模型进行比对,判断驾驶员是否处于疲劳状态。

常用的方法包括基于规则的方法、基于统计的方法和基于深度学习的方法等。

其中,基于深度学习的方法可以自动学习和提取特征,具有较高的准确性和鲁棒性。

四、系统实现与应用基于机器视觉的驾驶员疲劳状态检测系统可以通过嵌入式系统或云计算平台实现。

在嵌入式系统中,可以通过FPGA或ASIC等技术对图像进行快速处理,实现实时监测。

在云计算平台中,可以通过云计算技术对大量数据进行处理和分析,提高系统的准确性和可靠性。

基于机器视觉的驾驶员疲劳检测方法作者:洪志阳王猛飞侯东强杨国亮来源:《物联网技术》2018年第07期摘要:针对疲劳驾驶的问题,文中提出了一种新型检测方法。

使用Adaboost算法对人脸进行检测,对检测到的人脸区域中的眼睛和嘴巴进行定位和状态分析,在决策阶段采用信息融合的方法对疲劳状态进行判定。

结果表明,该方法在多种情况下均能精确检测眼睛和嘴巴的状态,有效检测驾驶员是否疲劳驾驶。

关键词:疲劳检测;人脸检测;Adaboost算法;信息融合中图分类号:TP391.41 文献标识码:A 文章编号:2095-1302(2018)07-00-020 引言虽然汽车在日常生活中带给人们诸多便利,但也带来了越来越多的交通事故,使得广大家庭和社会遭受巨大的伤害和损失。

事故中,由疲劳驾驶所引发的事故数量占绝大多数,因此研发一款用来监测驾驶人员有无疲劳的系统具有重大意义。

目前,检测疲劳驾驶的方法主要分为如下三类:(1)生理信号法:借助医疗仪表和设备生理指标对疲劳状况进行分析[1]。

(2)利用传感器监测车辆运行状态参数来判断其是否正常行驶,并分析驾驶员是否疲劳。

(3)针对驾驶人员的反应特征,采用图像检测与分割算法找到嘴巴和眼睛等器官[2,3],根据嘴巴和眼睛识别人体疲劳状态的反应特征[4,5],并通过这些反应特征判断驾驶员是否疲劳驾驶。

本文提出了一种基于人脸特征的驾驶员疲劳检测算法,采用Adaboost级联分类器对人脸进行检测,在提取的人脸图像基础上再进行人眼和嘴巴定位,并对其状态进行检测,将睁闭眼和嘴巴张合度进行信息融合,精确判断驾驶人员有无疲劳驾驶情况。

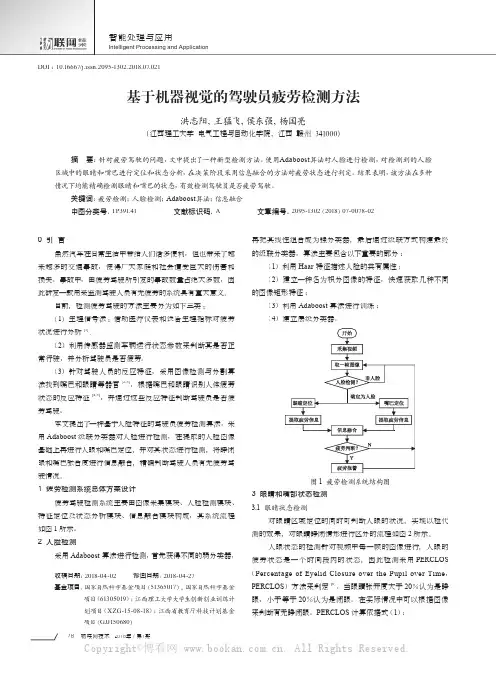

1 疲劳检测系统总体方案设计疲劳驾驶检测系统主要由图像采集模块、人脸检测模块、特征定位及状态分析模块、信息融合模块构成,其系统流程如图1所示。

2 人脸检测采用Adaboost算法进行检测,首先获得不同的弱分类器,再把其线性组合成为强分类器,最后通过级联方式构建最终的级联分类器,算法主要包含以下重要的部分:(1)利用Haar特征描述人脸的共有属性;(2)建立一种名为积分图像的特征,快速获取几种不同的图像矩形特征;(3)利用Adaboost 算法进行训练;(4)建立层级分类器。

《基于机器视觉的驾驶员疲劳状态检测系统研究》一、引言随着现代社会对交通安全要求的不断提高,驾驶员的疲劳状态成为了交通安全领域重要的研究课题。

基于机器视觉的驾驶员疲劳状态检测系统成为了研究的热点,旨在通过计算机视觉技术实时监控驾驶员的状态,进而预测和评估其疲劳程度,提高道路交通安全。

本文旨在探讨基于机器视觉的驾驶员疲劳状态检测系统的研究,以期为相关研究与应用提供理论依据。

二、系统概述基于机器视觉的驾驶员疲劳状态检测系统主要通过图像处理技术和模式识别算法,对驾驶员的面部特征和行驶状态进行实时监控,进而判断其是否处于疲劳状态。

该系统主要由图像采集、预处理、特征提取、状态识别和报警反馈等模块组成。

三、图像采集与预处理图像采集是该系统的第一步,主要通过高清摄像头实时捕捉驾驶员的面部图像。

预处理阶段则是对采集到的图像进行去噪、增强等处理,以便后续的特征提取和状态识别。

此外,预处理还包括对图像进行归一化处理,以适应不同光照条件和摄像头角度的变化。

四、特征提取与状态识别特征提取是该系统的关键环节,主要通过对预处理后的图像进行面部特征点定位,如眼睛、嘴巴等关键部位的定位。

通过分析这些特征的变化,如眼睛的闭合程度、嘴巴的张合情况等,来判断驾驶员是否处于疲劳状态。

状态识别则是对提取的特征进行模式识别和机器学习算法的处理,进一步判断驾驶员的疲劳程度。

五、报警反馈与系统优化当系统判断驾驶员处于疲劳状态时,将通过声光报警等方式提醒驾驶员注意休息。

同时,系统还将记录驾驶员的行驶数据和疲劳状态信息,为后续的数据分析和系统优化提供支持。

此外,系统还可根据实际需求进行参数调整和算法优化,以提高检测的准确性和实时性。

六、研究现状与挑战目前,基于机器视觉的驾驶员疲劳状态检测系统已经取得了显著的成果。

然而,在实际应用中仍面临诸多挑战。

首先,由于光照条件、摄像头角度等因素的影响,图像的预处理和特征提取仍存在一定难度。

其次,对于不同个体和驾驶环境,系统的误报和漏报率仍有待降低。

第13卷㊀第6期Vol.13No.6㊀㊀智㊀能㊀计㊀算㊀机㊀与㊀应㊀用IntelligentComputerandApplications㊀㊀2023年6月㊀Jun.2023㊀㊀㊀㊀㊀㊀文章编号:2095-2163(2023)06-0130-03中图分类号:TM732文献标志码:A基于机器视觉的疲劳驾驶检测算法研究王彦博,张剑书,孙新元(南京工程学院计算机工程学院,南京211167)摘㊀要:本文基于机器视觉技术设计疲劳检测算法,利用部署在车内的小型监控摄像头实现对驾驶人状态的实时监控;通过分析驾驶人的眼部㊁嘴部状态和头部动作,综合判断驾驶人的疲劳状态,实现实时的疲劳驾驶检测和预警,有助于规避驾驶过程中内部与外部的不安全因素,保障驾驶安全㊂关键词:机器视觉;疲劳检测;实时监控;驾驶安全FatiguedrivingdetectionalgorithmbasedoncomputervisionWANGYanbo,ZHANGJianshu,SUNXinyuan(SchoolofComputerEngineering,NanjingInstituteofTechnology,Nanjing211167,China)ʌAbstractɔInthispaper,afatiguedetectionalgorithmisdesignedbasedoncomputerversiontechnology.Asurveillancecameradeployedinthevehicleisusedtorealizethereal-timemonitoringofthedriverᶄsstatus.Byanalyzingthedriverᶄseyes,mouthandheadmovements,thedriverᶄsfatiguestatusiscomprehensivelyjudged,andreal-timefatiguedrivingdetectionandearlywarningarerealized.Thisalgorithmhelpstoavoidinternalandexternalunsafefactorsduringdrivingandensuresdriver ssafetyduringdriving.ʌKeywordsɔcomputervision;fatiguedetection;real-timemonitoring;drivingsafety基金项目:江苏省高等学校大学生创新创业训练计划项目(202211276081Y)㊂作者简介:王彦博(1999-),男,学士,主要研究方向:数据分析;张剑书(1992-),男,硕士,实验师,主要研究方向:视频图像处理;孙新元(2002-),男,本科生,主要研究方向:深度学习㊂通讯作者:张剑书㊀㊀Email:jianshu.zhang@formail.com收稿日期:2022-07-070㊀引㊀言疲劳驾驶行为是造成交通事故的主要因素之一,交通事故常常会造成巨大的经济损失,甚至威胁到驾乘人的生命安全[1]㊂据交通部统计,中国每年因疲劳驾驶导致的交通事故约占所有交通事故的20%,在特大交通事故中占比40%,且其发生数量呈现出逐年升高的趋势[2]㊂因此,通过各项技术手段实现对驾驶员的疲劳检测,并及时给予提醒是必要的㊂近年来,随着机器视觉技术和机器学习的兴起,人脸检测和面部信息提取技术得到了进一步的发展,在人工智能等领域发挥着举足轻重的作用,基于驾驶员的面部图像数据分析面部状态,以实现对驾驶员疲劳检测与预警,在驾驶安全领域具有重要的实用价值和研究意义[3]㊂Hernandez等[4]提出了以驾驶员脑电信号为基础的疲劳检测方法;在针对图像数据的疲劳检测方面,MajdiMS等[5]提出了一种基于卷积神经网络和随机决策森林的驾驶员注意力分散检测方法,其分类准确率能达到95%㊂本文提出了一种基于机器视觉的驾驶人疲劳检测算法,针对车内监控设备采集的司机面部图像进行预处理,提取出面部关键点信息;融合眼部㊁嘴部和头部姿势3个特征,分别检测驾驶员的眨眼㊁打哈欠和点头行为,从而综合评价驾驶人的疲劳状态㊂1㊀疲劳特征提取疲劳特征提取是实现疲劳检测算法的前提㊂与正常状态相比,人在疲劳时,嘴巴㊁眼睛和头部姿势会表现出较大差异㊂因此,基于机器视觉的疲劳检测需要先提取被检测目标的相关面部和头部运动特征㊂本文基于Dlib(一个包含机器学习算法和工具的C++工具包)中的人脸关键点检测技术实现面部特征提取,Dlib提供的人脸检测模型能够快速获取到包括面部㊁眼睛㊁鼻子㊁嘴巴等部位轮廓的68个关键点,如图1所示㊂㊀㊀在检测出这些关键点之后,可以通过计算眼睛和嘴巴纵向与横向的比例,来判断其张开与闭合程度,也可以将这68个关键点间的信息,投射在3D模型上,获得面部的朝向与姿势,计算头部旋转的欧拉角,获得头部的姿态与动作㊂图1㊀面部68个关键点位置Fig.1㊀Thelocationofthe68keypointsontheface1.1㊀基于纵横比的眨眼特征提取从检测到的68个关键点中提取出左右眼睛的轮廓坐标,并计算眼部纵横比EAR(EyeAspectRatio),可以估计驾驶人眼睛的张开或闭合程度,眼睛关键点位示意如图2所示㊂图2㊀眼部关键点Fig.2㊀Keypointsofeyes㊀㊀EAR1与EAR2分别表示左眼与右眼的纵横比,Pn表示关键点坐标(xn,yn),左眼关键点序号为37 42,右眼关键点序号为43 48,取上述关键点对双眼纵横比进行计算,公式(1)和公式(2):EAR1=P38-P42+P39-P41P37-P40(1)EAR2=P44-P48+P45-P47P43-P46(2)取EAR1与EAR2均值作为驾驶人当前状态的EAR值㊂1.2㊀基于纵横比的张嘴特征提取将纵横比公式运用在嘴部横纵比MAR(MouthAspectRatio)提取时,为了准确计算嘴巴的张开程度,主要提取序号为51㊁59㊁53㊁57的关键点和序号为49㊁55的关键点的横坐标进行纵横比的判断,嘴部关键点示意图如图3所示㊂图3㊀嘴部关键点Fig.3㊀Keypointsofmouth㊀㊀MAR计算公式(3)如下:MAR=P51-P59+P53-P572P49-P55(3)1.3㊀基于HPE算法的头部姿势特征提取利用HPE(HeadPoseEstimation,HPE)算法进行头部姿势预测㊂首先需要获得2D人脸关键点坐标,并将2D坐标分别与3D人脸模型进行匹配,计算3D与2D关键点之间的转换关系,根据旋转矩阵求解欧拉角㊂转换时需要使用到世界坐标系(UVW)㊁相机坐标系(XYZ)㊁图像中心坐标系(uv)和像素坐标系(xy)㊂世界坐标系转换到相机坐标系,公式(4):XYZæèçççöø÷÷÷=RUVWæèçççöø÷÷÷+T=R,T[]UVW1æèççççöø÷÷÷÷(4)㊀㊀相机坐标系转换到像素坐标系,公式(5):sxy1æèçççöø÷÷÷=fx0cx0fycy001æèçççöø÷÷÷XYZæèçççöø÷÷÷(5)㊀㊀像素坐标系转换到世界坐标系,公式(6):sxy1æèçççöø÷÷÷=fx0cx0fycy001æèçççöø÷÷÷R,T[]UVW1æèççççöø÷÷÷÷(6)㊀㊀图像中心坐标系转换到像素坐标系,公式(7):sxyæèçöø÷=fx0cx0fycyæèçöø÷uv1æèçççöø÷÷÷(7)㊀㊀由公式(4) 公式(7)可以获得旋转矩阵,基于此可以求出欧拉角,公式(8):=cosϕcosφ+sinϕsinθsinφsinϕcosθ-cosϕsinφ+sinϕsinθcosφ-sinϕcosφ+cosϕsinθsinφcosϕcosθsinϕsinφ+cosϕsinθcosφcosθsinφ-sinθcosθcosφæèçççöø÷÷÷(8)㊀㊀其中,θ㊁ϕ和φ分别为章动角㊁旋进角和自转角,三者共同构成欧拉角㊂131第6期王彦博,等:基于机器视觉的疲劳驾驶检测算法研究将2D人脸关键点与3D人脸模型进行映射匹配,根据旋转矩阵计算头部旋转欧拉角,便可以获得头部姿势和运动状态㊂2㊀驾驶人疲劳检测结果驾驶人疲劳检测算法通过融合EAR㊁MAR和HPE算法提取的眼部㊁嘴部和头部姿势3个特征,实现对驾驶员面部状态的实时检测㊂为了获得更加合理的检测阈值,本文在模拟疲劳驾驶的视频数据集YawDD上对算法和数值变化进行了实验与测试㊂YawDD数据集中包含29位志愿者在静止车辆中模拟长时间驾驶后的疲劳状态录制的正面视频,视频中志愿者的行为包括眨眼㊁打哈欠㊁注意力分散㊁交谈等行为,视频样例如图4所示㊂图4㊀YawDD数据集样例Fig.4㊀ExampleofYawDDdataset㊀㊀通过眨眼㊁张嘴和头部姿势特征提取方法对YawDD数据集中志愿者的视频进行测试,得到的EAR和MAR数据变化趋势曲线如图5所示㊂从图5可以发现,驾驶员在眼睛睁开时,对应的EAR值在0.3 0.4区间波动;而在出现眨眼或闭眼动作时,EAR值则会瞬间下降至0.2以下,并趋于0㊂因此,可以设置判断眨眼的阈值为EAR<0.2且保持2帧㊂另外,驾驶员在正常状态下,MAR值较小,交谈时MAR值在0.3 0.5之间上下波动;而在打哈欠时,MAR值将迅速增大至0.6及以上,并会持续一段时间㊂因此,在进行打哈欠检测时将MAR阈值设置为0.6,当MAR>0.6并保持12帧之后,则计算为打哈欠一次㊂此外,驾驶员平视前方时,视线水平角度约为0ʎ,当低头打瞌睡时,平视角度将会下降,因此可以将低头检测的阈值设置为0.3,即在一段时间内,低头欧拉角大于20ʎ或平视角度变换比例超过0.3时,则认为低头或点头一次㊂㊀㊀经过统计分析,驾驶人在疲劳驾驶状态下的每分钟平均眨眼次数超过20次,打哈欠次数超过5次,并且会存在头部角度较低,以此作为该段时间内疲劳判断的标准,疲劳检测的结果如图6所示㊂0.400.350.300.250.200.15100200300400500S a m eE A R(a)EAR变化趋势1.00.90.80.70.60.50.40.30.2025050075010001250150017502000S a m eE A R(b)MAR变化趋势图5㊀YawDD数据集中EAR、MAR变化曲线示例Fig.5㊀VariationcurveofEARandMARunderfatiguestateofvolunteersinYawDDdataset图6㊀疲劳检测结果Fig.6㊀Resultsoffatiguedetection3㊀结束语本文提出了一种基于机器视觉的疲劳驾驶检测方法,通过Dlib完成了驾驶人面部关键点的检测,并从中提取驾驶人疲劳状态相关的特征,基于此实现对驾驶人疲劳状态的实时检测㊂该方法仅需在车内部署一个小型监控摄像头,而不需要复杂的脑电设备或可穿戴设备,因此不会对驾驶人的动作或行为造成任何影响,具有一定的实际应用价值㊂参考文献[1]OSSENBRUGGENPJ,PENDHARKARJ,IVANJ.Roadwaysafetyinruralandsmallurbanizedareas[J].AccidentAnalysis&Prevention,2001,33(4):485-498.[2]丁红威.驾驶安全辅助系统中关键技术的研究[D].北京:北京交通大学,2019.[3]姜绍寅.关于驾驶员疲劳驾驶对安全行车的危害研究[J].时代汽车,2016(11):33-34.[4]LALSKL,CRAIGA,BOORDP,etal.DevelopmentofanalgorithmforanEEG-baseddriverfatiguecountermeasure[J].JournalofSafetyResearch,2003,34(3):321-328.[5]MAJDIMS,RAMS,GILLJT,etal.Drive-net:Convolutionalnetworkfordriverdistractiondetection[C]//2018IEEESouthwestSymposiumonImageAnalysisandInterpretation(SSIAI).IEEE,2018:1.231智㊀能㊀计㊀算㊀机㊀与㊀应㊀用㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀㊀第13卷㊀。