应用回归分析,第5章课后习题参考答案

- 格式:doc

- 大小:101.50 KB

- 文档页数:6

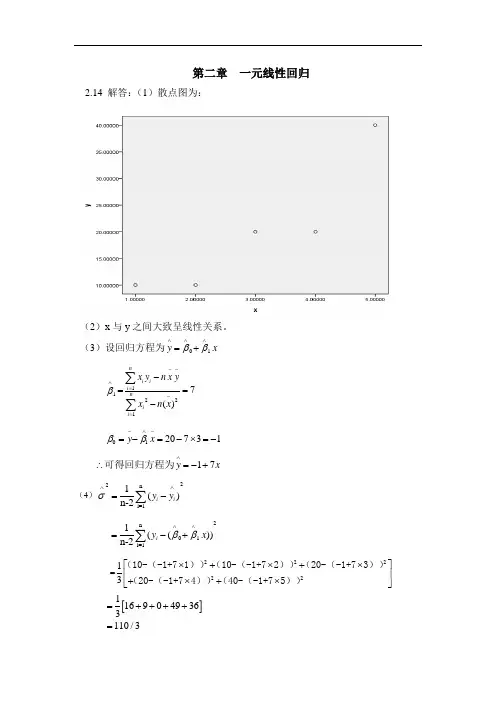

第二章 一元线性回归2.14 解答:(1)散点图为:(2)x 与y 之间大致呈线性关系。

(3)设回归方程为01y x ββ∧∧∧=+1β∧=12217()ni ii nii x y n x yxn x --=-=-=-∑∑0120731y x ββ-∧-=-=-⨯=-17y x ∧∴=-+可得回归方程为(4)22ni=11()n-2i i y y σ∧∧=-∑ 2n 01i=11(())n-2i y x ββ∧∧=-+∑=2222213⎡⎤⨯+⨯+⨯⎢⎥+⨯+⨯⎣⎦(10-(-1+71))(10-(-1+72))(20-(-1+73))(20-(-1+74))(40-(-1+75)) []1169049363110/3=++++=6.1σ∧=(5)由于211(,)xxN L σββ∧t σ∧==服从自由度为n-2的t 分布。

因而/2||(2)1P t n αασ⎡⎤⎢⎥<-=-⎢⎥⎣⎦也即:1/211/2(p t t ααβββ∧∧∧∧-<<+=1α-可得195%β∧的置信度为的置信区间为(7-2.3537+2.353 即为:(2.49,11.5)2201()(,())xxx Nn L ββσ-∧+t ∧∧==服从自由度为n-2的t 分布。

因而/2|(2)1P t n αα∧⎡⎤⎢⎥⎢⎥<-=-⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦即0/200/2()1p βσββσα∧∧∧∧-<<+=- 可得195%7.77,5.77β∧-的置信度为的置信区间为()(6)x 与y 的决定系数22121()490/6000.817()ni i nii y y r y y ∧-=-=-==≈-∑∑(7)由于(1,3)F F α>,拒绝0H ,说明回归方程显著,x 与y 有显著的线性关系。

(8)t σ∧==其中2221111()22n ni i i i i e y y n n σ∧∧====---∑∑ 7 3.661==≈/2 2.353t α= /23.66t t α=>∴接受原假设01:0,H β=认为1β显著不为0,因变量y 对自变量x 的一元线性回归成立。

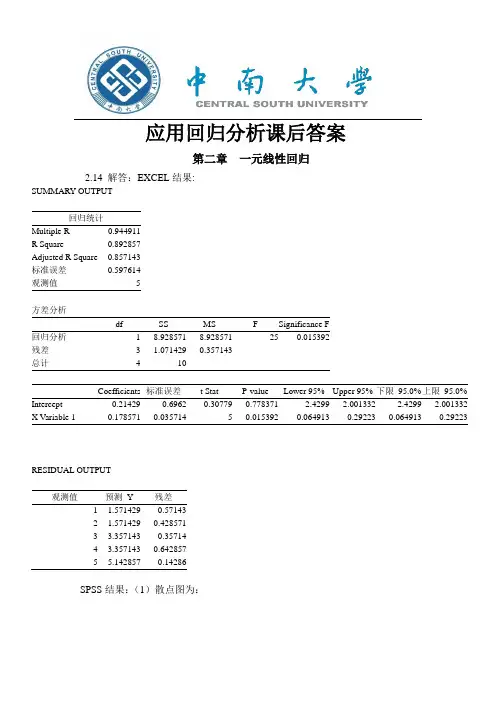

应用回归分析课后答案第二章一元线性回归2.14 解答:EXCEL结果:SUMMARY OUTPUT回归统计Multiple R0.944911R Square0.892857Adjusted R Square0.857143标准误差0.597614观测值5方差分析df SS MS F Significance F回归分析18.9285718.928571250.015392残差3 1.0714290.357143总计410Coefficients标准误差t Stat P-value Lower 95%Upper 95%下限95.0%上限95.0% Intercept-0.214290.6962-0.307790.778371-2.4299 2.001332-2.4299 2.001332 X Variable 10.1785710.03571450.0153920.0649130.292230.0649130.29223RESIDUAL OUTPUT观测值预测Y残差1 1.571429-0.571432 1.5714290.4285713 3.357143-0.357144 3.3571430.6428575 5.142857-0.14286SPSS结果:(1)散点图为:(2)x 与y 之间大致呈线性关系。

(3)设回归方程为01y x ββ∧∧∧=+1β∧=12217()ni ii nii x y n x yxn x --=-=-=-∑∑0120731y x ββ-∧-=-=-⨯=-17y x ∧∴=-+可得回归方程为(4)22ni=11()n-2i i y y σ∧∧=-∑ 2n 01i=11(())n-2i y x ββ∧∧=-+∑=2222213⎡⎤⨯+⨯+⨯⎢⎥+⨯+⨯⎣⎦(10-(-1+71))(10-(-1+72))(20-(-1+73))(20-(-1+74))(40-(-1+75)) []1169049363110/3=++++=1330 6.13σ∧=≈ (5)由于211(,)xxN L σββ∧1112()/xxxxL t L ββσσ∧∧-==服从自由度为n-2的t 分布。

应用回归分析第四版答案【篇一:应用回归分析人大版前四章课后习题答案详解】应用回归分析(1-4章习题详解)(21世纪统计学系列教材,第二(三)版,何晓群,刘文卿编著中国人民大学出版社)目录1 回归分析概述 ....................................................................................................... (6)1.1 变量间统计关系和函数关系的区别是什么? (6)1.2 回归分析与相关分析的区别与联系是什么? (7)1.3回归模型中随机误差项?的意义是什么? (7)1.4线性回归模型的基本假设是什么? (7)1.5 回归模型的设置理论根据是什么?在回归变量设置中应该注意哪些问题? (8)1.6收集,整理数据包括哪些内容? (8)1.7构造回归理论模型的基本根据是什么? (9)1.8为什么要对回归模型进行检验? (9)1.9回归模型有哪几个方面的应用? (10)1.10为什么强调运用回归分析研究经济问题要定性分析和定量分析相结合? (10)2 一元线性回归 ....................................................................................................... . (10)2.1一元线性回归模型有哪些基本假定? (10)2.2考虑过原点的线性回归模型足基本假定,求ny??*x??i1ii,i?1,2,...n 误差?1,?2,...?n仍满?1的最小二乘估计。

.............................................................................. 11 n2.3证明?e?o,?xe?0. .................................................................................. . (11)i?1ii?1ii2.4回归方程e(y)????x的参数?,?o101的最小二乘估计与最大似然估计在什么条件下等价?给出理由? (12)2.5证明??0是??0的无偏估计。

第二章 一元线性回归分析思考与练习参考答案2.1 一元线性回归有哪些基本假定?答: 假设1、解释变量X 是确定性变量,Y 是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性: E(εi )=0 i=1,2, …,n Var (εi )=σ2 i=1,2, …,n Cov(εi, εj )=0 i≠j i,j= 1,2, …,n 假设3、随机误差项ε与解释变量X 之间不相关: Cov(X i , εi )=0 i=1,2, …,n假设4、ε服从零均值、同方差、零协方差的正态分布 εi ~N(0, σ2 ) i=1,2, …,n 2.2 考虑过原点的线性回归模型 Y i =β1X i +εi i=1,2, …,n误差εi (i=1,2, …,n )仍满足基本假定。

求β1的最小二乘估计 解: 得:2.3 证明(2.27式),∑e i =0 ,∑e i X i =0 。

证明:∑∑+-=-=nii i ni X Y Y Y Q 121021))ˆˆ(()ˆ(ββ其中:即: ∑e i =0 ,∑e i X i =021112)ˆ()ˆ(ini i ni i i e X Y Y Y Q β∑∑==-=-=0)ˆ(2ˆ111=--=∂∂∑=ii ni i eX X Y Q ββ)()(ˆ1211∑∑===ni i ni ii X Y X β01ˆˆˆˆi ii i iY X e Y Y ββ=+=-0100ˆˆQQββ∂∂==∂∂2.4回归方程E (Y )=β0+β1X 的参数β0,β1的最小二乘估计与最大似然估计在什么条件下等价?给出证明。

答:由于εi ~N(0, σ2 ) i=1,2, …,n所以Y i =β0 + β1X i + εi ~N (β0+β1X i , σ2 ) 最大似然函数:使得Ln (L )最大的0ˆβ,1ˆβ就是β0,β1的最大似然估计值。

同时发现使得Ln (L )最大就是使得下式最小,∑∑+-=-=nii i n i X Y Y Y Q 121021))ˆˆ(()ˆ(ββ上式恰好就是最小二乘估计的目标函数相同。

第二章 一元线性回归分析思考与练习参考答案2.1 一元线性回归有哪些基本假定?答: 假设1、解释变量X 是确定性变量,Y 是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性: E(εi )=0 i=1,2, …,n Var (εi )=σ2 i=1,2, …,n Cov(εi, εj )=0 i≠j i,j= 1,2, …,n 假设3、随机误差项ε与解释变量X 之间不相关: Cov(X i , εi )=0 i=1,2, …,n 假设4、ε服从零均值、同方差、零协方差的正态分布 εi ~N(0, σ2 ) i=1,2, …,n 2.2 考虑过原点的线性回归模型 Y i =β1X i +εi i=1,2, …,n误差εi (i=1,2, …,n)仍满足基本假定。

求β1的最小二乘估计 解: 得:2.3 证明(2.27式),∑e i =0 ,∑e i X i =0 。

证明:其中:即: ∑e i =0 ,∑e i X i =0∑∑+-=-=nii i ni X Y Y Y Q 121021))ˆˆ(()ˆ(ββ21112)ˆ()ˆ(ini i ni i i e X Y Y Y Q β∑∑==-=-=01ˆˆˆˆi ii i iY X e Y Y ββ=+=-0100ˆˆQQββ∂∂==∂∂2.4回归方程E (Y )=β0+β1X 的参数β0,β1的最小二乘估计与最大似然估计在什么条件下等价?给出证明。

答:由于εi ~N(0, σ2 ) i=1,2, …,n所以Y i =β0 + β1X i + εi ~N (β0+β1X i , σ2 ) 最大似然函数:使得Ln (L )最大的0ˆβ,1ˆβ就是β0,β1的最大似然估计值。

同时发现使得Ln (L )最大就是使得下式最小,上式恰好就是最小二乘估计的目标函数相同。

值得注意的是:最大似然估计是在εi ~N (0, σ2 )的假设下求得,最小二乘估计则不要求分布假设。

![《应用回归分析》课后题答案[整理版]](https://uimg.taocdn.com/603529c1f242336c1eb95eca.webp)

《应用回归分析》课后题答案[整理版] 《应用回归分析》部分课后习题答案第一章回归分析概述 1.1 变量间统计关系和函数关系的区别是什么, 答:变量间的统计关系是指变量间具有密切关联而又不能由某一个或某一些变量唯一确定另外一个变量的关系,而变量间的函数关系是指由一个变量唯一确定另外一个变量的确定关系。

1.2 回归分析与相关分析的联系与区别是什么, 答:联系有回归分析和相关分析都是研究变量间关系的统计学课题。

区别有a.在回归分析中,变量y称为因变量,处在被解释的特殊地位。

在相关分析中,变量x和变量y处于平等的地位,即研究变量y与变量x的密切程度与研究变量x与变量y的密切程度是一回事。

b.相关分析中所涉及的变量y与变量x全是随机变量。

而在回归分析中,因变量y是随机变量,自变量x可以是随机变量也可以是非随机的确定变量。

C.相关分析的研究主要是为了刻画两类变量间线性相关的密切程度。

而回归分析不仅可以揭示变量x 对变量y的影响大小,还可以由回归方程进行预测和控制。

1.3 回归模型中随机误差项ε的意义是什么, 答:ε为随机误差项,正是由于随机误差项的引入,才将变量间的关系描述为一个随机方程,使得我们可以借助随机数学方法研究y与x1,x2…..xp的关系,由于客观经济现象是错综复杂的,一种经济现象很难用有限个因素来准确说明,随机误差项可以概括表示由于人们的认识以及其他客观原因的局限而没有考虑的种种偶然因素。

1.4 线性回归模型的基本假设是什么,答:线性回归模型的基本假设有:1.解释变量x1.x2….xp是非随机的,观测值xi1.xi2…..xip是常数。

2.等方差及不相关的假定条件为{E(εi)=0 i=1,2….Cov(εi,εj)=,σ^23.正态分布的假定条件为相互独立。

4.样本容量的个数要多于解释变量的个数,即n>p.1.5 回归变量的设置理论根据是什么,在回归变量设置时应注意哪些问题,答:理论判断某个变量应该作为解释变量,即便是不显著的,如果理论上无法判断那么可以采用统计方法来判断,解释变量和被解释变量存在统计关系。

第二章 一元线性回归分析思考与练习参考答案2.1 一元线性回归有哪些基本假定答: 假设1、解释变量X 是确定性变量,Y 是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性: E(εi )=0 i=1,2, …,n Var (εi )=?2 i=1,2, …,n Cov(εi, εj )=0 i≠j i,j= 1,2, …,n 假设3、随机误差项ε与解释变量X 之间不相关: Cov(X i , εi )=0 i=1,2, …,n假设4、ε服从零均值、同方差、零协方差的正态分布 εi ~N(0, ?2 ) i=1,2, …,n 2.2 考虑过原点的线性回归模型 Y i =β1X i +εi i=1,2, …,n误差εi (i=1,2, …,n )仍满足基本假定。

求β1的最小二乘估计 解: 得:2.3 证明(2.27式),?e i =0 ,?e i X i =0 。

证明:∑∑+-=-=nii i ni X Y Y Y Q 121021))ˆˆ(()ˆ(ββ其中: 即: ?e i =0 ,?e i X i =02.4回归方程E (Y )=β0+β1X 的参数β0,β1的最小二乘估计与最大似然估计在什么条件下等价给出证明。

答:由于εi ~N(0, ?2 ) i=1,2, …,n所以Y i =β0 + β1X i + εi ~N (β0+β1X i , ?2 ) 最大似然函数:21112)ˆ()ˆ(ini i ni i i e X Y Y Y Q β∑∑==-=-=01ˆˆˆˆi ii i iY X e Y Y ββ=+=-0100ˆˆQQββ∂∂==∂∂使得Ln (L )最大的0ˆβ,1ˆβ就是β0,β1的最大似然估计值。

同时发现使得Ln (L )最大就是使得下式最小,上式恰好就是最小二乘估计的目标函数相同。

值得注意的是:最大似然估计是在εi ~N (0, ?2 )的假设下求得,最小二乘估计则不要求分布假设。

第5章自变量选择与逐步回归思考与练习参考答案5.1 自变量选择对回归参数的估计有何影响?答:回归自变量的选择是建立回归模型得一个极为重要的问题。

如果模型中丢掉了重要的自变量, 出现模型的设定偏误,这样模型容易出现异方差或自相关性,影响回归的效果;如果模型中增加了不必要的自变量, 或者数据质量很差的自变量, 不仅使得建模计算量增大, 自变量之间信息有重叠,而且得到的模型稳定性较差,影响回归模型的应用。

5.2自变量选择对回归预测有何影响?答:当全模型〔m元〕正确采用选模型〔p元〕时,我们舍弃了m-p个自变量,回归系数的最小二乘估计是全模型相应参数的有偏估计,使得用选模型的预测是有偏的,但由于选模型的参数估计、预测残差和预测均方误差具有较小的方差,所以全模型正确而误用选模型有利有弊。

当选模型〔p元〕正确采用全模型〔m 元〕时,全模型回归系数的最小二乘估计是相应参数的有偏估计,使得用模型的预测是有偏的,并且全模型的参数估计、预测残差和预测均方误差的方差都比选模型的大,所以回归自变量的选择应少而精。

5.3 如果所建模型主要用于预测,应该用哪个准则来衡量回归方程的优劣?C统计量达到最小的准则来衡量回答:如果所建模型主要用于预测,则应使用p归方程的优劣。

5.4 试述前进法的思想方法。

答:前进法的基本思想方法是:首先因变量Y对全部的自变量x1,x2,...,xm建立m个一元线性回归方程, 并计算F检验值,选择偏回归平方和显著的变量〔F值最大且大于临界值〕进入回归方程。

每一步只引入一个变量,同时建立m-1个二元线性回归方程,计算它们的F检验值,选择偏回归平方和显著的两变量变量〔F值最大且大于临界值〕进入回归方程。

在确定引入的两个自变量以后,再引入一个变量,建立m-2个三元线性回归方程,计算它们的F检验值,选择偏回归平方和显著的三个变量〔F值最大〕进入回归方程。

不断重复这一过程,直到无法再引入新的自变量时,即所有未被引入的自变量的F检验值均小于F检验临界值Fα(1,n-p-1),回归过程结束。

应用回归分析第四版答案【篇一:应用回归分析人大版前四章课后习题答案详解】应用回归分析(1-4章习题详解)(21世纪统计学系列教材,第二(三)版,何晓群,刘文卿编著中国人民大学出版社)目录1 回归分析概述 ....................................................................................................... (6)1.1 变量间统计关系和函数关系的区别是什么? (6)1.2 回归分析与相关分析的区别与联系是什么? (7)1.3回归模型中随机误差项?的意义是什么? (7)1.4线性回归模型的基本假设是什么? (7)1.5 回归模型的设置理论根据是什么?在回归变量设置中应该注意哪些问题? (8)1.6收集,整理数据包括哪些内容? (8)1.7构造回归理论模型的基本根据是什么? (9)1.8为什么要对回归模型进行检验? (9)1.9回归模型有哪几个方面的应用? (10)1.10为什么强调运用回归分析研究经济问题要定性分析和定量分析相结合? (10)2 一元线性回归 ....................................................................................................... . (10)2.1一元线性回归模型有哪些基本假定? (10)2.2考虑过原点的线性回归模型足基本假定,求ny??*x??i1ii,i?1,2,...n 误差?1,?2,...?n仍满?1的最小二乘估计。

.............................................................................. 11 n2.3证明?e?o,?xe?0. .................................................................................. . (11)i?1ii?1ii2.4回归方程e(y)????x的参数?,?o101的最小二乘估计与最大似然估计在什么条件下等价?给出理由? (12)2.5证明??0是??0的无偏估计。

所属章节:第五章相关分析与回归分析1■在线性相关中,若两个变量的变动方向相反,一个变量的数值增加,另一个变量数值随之减少,或一个变量的数值减少,另一个变量的数值随之增加,则称为()。

答案:负相关。

干扰项:正相关。

干扰项:完全相关。

干扰项:非线性相关。

提示与解答:本题的正确答案为:负相关。

2■在线性相关中,若两个变量的变动方向相同,一个变量的数值增加,另一个变量数值随之增加,或一个变量的数值减少,另一个变量的数值随之减少,则称为()。

答案:正相关。

干扰项:负相关。

干扰项:完全相关。

干扰项:非线性相关。

提示与解答:本题的正确答案为:正相关。

3■下面的陈述中哪一个是错误的()。

答案:相关系数不会取负值。

干扰项:相关系数是度量两个变量之间线性关系强度的统计量。

干扰项:相关系数是一个随机变量。

干扰项:相关系数的绝对值不会大于1。

提示与解答:本题的正确答案为:相关系数不会取负值。

4■下面的陈述中哪一个是错误的()。

答案:回归分析中回归系数的显著性检验的原假设是:所检验的回归系数的真值不为0。

干扰项:相关系数显著性检验的原假设是:总体中两个变量不存在相关关系。

干扰项:回归分析中回归系数的显著性检验的原假设是:所检验的回归系数的真值为0。

干扰项:回归分析中多元线性回归方程的整体显著性检验的原假设是:自变量前的偏回归系数的真值同时为0。

提示与解答:本题的正确答案为:回归分析中回归系数的显著性检验的原假设是:所检验的回归系数的真值不为0。

5■根据你的判断,下面的相关系数值哪一个是错误的()。

答案:1.25。

干扰项:-0.86。

干扰项:0.78。

干扰项:0。

提示与解答:本题的正确答案为:1.25。

6■下面关于相关系数的陈述中哪一个是错误的()。

答案:数值越大说明两个变量之间的关系越强,数值越小说明两个变量之间的关系越弱。

干扰项:仅仅是两个变量之间线性关系的一个度量,不能直接用于描述非线性关系。

干扰项:只是两个变量之间线性关系的一个度量,不一定意味着两个变量之间存在因果关系。

第二章 一元线性回归2.14 解答:(1)散点图为:(2)x 与y 之间大致呈线性关系。

(3)设回归方程为01y x ββ∧∧∧=+1β∧=12217()ni ii nii x y n x yxn x --=-=-=-∑∑0120731y x ββ-∧-=-=-⨯=-17y x ∧∴=-+可得回归方程为(4)22ni=11()n-2i i y y σ∧∧=-∑ 2n 01i=11(())n-2i y x ββ∧∧=-+∑=2222213⎡⎤⨯+⨯+⨯⎢⎥+⨯+⨯⎣⎦(10-(-1+71))(10-(-1+72))(20-(-1+73))(20-(-1+74))(40-(-1+75)) []1169049363110/3=++++=1330 6.13σ∧=≈ (5)由于211(,)xxN L σββ∧1112()/xxxxL t L ββσσ∧∧-==服从自由度为n-2的t 分布。

因而1/2()|(2)1xx L P t n αββασ∧⎡⎤-⎢⎥<-=-⎢⎥⎣⎦也即:1/211/2(xxxxp t t L L ααβββ∧∧∧∧-<<+=1α-可得11195%333333β∧的置信度为的置信区间为(7-2.353,7+2.353)即为:(2.49,11.5)2201()(,())xxx N n L ββσ-∧+00002221()1()()xxxxt x x n L n L σσ∧∧--∧∧==++服从自由度为n-2的t 分布。

因而00/22(2)11()xx P t n x n L αασ∧-∧⎡⎤⎢⎥⎢⎥<-=-⎢⎥⎢⎥⎢⎥+⎢⎥⎣⎦即220/200/21()1()()1xxxxx x p t t n L n L βσββσα--∧∧∧∧-+<<++=- 可得195%7.77,5.77β∧-的置信度为的置信区间为()(6)x 与y 的决定系数22121()490/6000.817()nii nii y y r y y ∧-=-=-==≈-∑∑(7)ANOV Ax平方和df均方 F 显著性组间(组合) 9.000 2 4.500 9.000 .100 线性项加权的 8.167 1 8.167 16.333 .056 偏差.833 1 .833 1.667.326组内 1.000 2 .500总数10.0004由于(1,3)F F α>,拒绝0H ,说明回归方程显著,x 与y 有显著的线性关系。

第二章 一元线性回归2.14 解答:(1)散点图为:(2)x 与y 之间大致呈线性关系。

(3)设回归方程为01y x ββ∧∧∧=+1β∧=12217()ni ii nii x y n x yxn x --=-=-=-∑∑0120731y x ββ-∧-=-=-⨯=-17y x ∧∴=-+可得回归方程为(4)22ni=11()n-2i i y y σ∧∧=-∑2n01i=11(())n-2i y x ββ∧∧=-+∑=2222213⎡⎤⨯+⨯+⨯⎢⎥+⨯+⨯⎣⎦(10-(-1+71))(10-(-1+72))(20-(-1+73))(20-(-1+74))(40-(-1+75))[]1169049363110/3=++++=6.1σ∧= (5)由于211(,)xxN L σββ∧t σ∧==服从自由度为n-2的t 分布。

因而/2||(2)1P t n αασ⎡⎤⎢⎥<-=-⎢⎥⎣⎦也即:1/211/2(p t t ααβββ∧∧∧∧-<<+=1α-可得195%β∧的置信度为的置信区间为(7-2.3537+2.353 即为:(2.49,11.5)22001()(,())xxx N n L ββσ-∧+t ∧∧==服从自由度为n-2的t 分布。

因而/2|(2)1P t n αα∧⎡⎤⎢⎥⎢⎥<-=-⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦即0/200/2()1p βσββσα∧∧∧∧-<<+=- 可得195%7.77,5.77β∧-的置信度为的置信区间为()(6)x 与y 的决定系数22121()490/6000.817()nii nii y y r y y ∧-=-=-==≈-∑∑(7)由于(1,3)F F α>,拒绝0H ,说明回归方程显著,x 与y 有显著的线性关系。

(8)t σ∧==其中2221111()22n ni i i i i e y y n n σ∧∧====---∑∑ 7 3.661==≈/2 2.353t α= /23.66t t α=>∴接受原假设01:0,H β=认为1β显著不为0,因变量y 对自变量x 的一元线性回归成立。

实用回归分析第四版第一章回归分析概述1.3回归模型中随机误差项ε的意义是什么?答:ε为随机误差项,正是由于随机误差项的引入,才将变量间的关系描述为一个随机方程,使得我们可以借助随机数学方法研究y与x1,x2…..xp的关系,由于客观经济现象是错综复杂的,一种经济现象很难用有限个因素来准确说明,随机误差项可以概括表示由于人们的认识以及其他客观原因的局限而没有考虑的种种偶然因素。

1.4 线性回归模型的基本假设是什么?答:线性回归模型的基本假设有:1.解释变量x1.x2….xp是非随机的,观测值xi1.xi2…..xip是常数。

2.等方差及不相关的假定条件为{E(εi)=0 i=1,2…. Cov(εi,εj)={σ^23.正态分布的假定条件为相互独立。

4.样本容量的个数要多于解释变量的个数,即n>p.第二章一元线性回归分析思考与练习参考答案2.1一元线性回归有哪些基本假定?答:假设1、解释变量X是确定性变量,Y是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性:E(εi)=0 i=1,2, …,nVar (εi)=σ2i=1,2, …,nCov(εi,εj)=0 i≠j i,j= 1,2, …,n假设3、随机误差项ε与解释变量X之间不相关:Cov(X i, εi)=0 i=1,2, …,n假设4、ε服从零均值、同方差、零协方差的正态分布εi~N(0, σ2) i=1,2, …,n2.3 证明(2.27式),∑e i =0 ,∑e i X i=0 。

证明:∑∑+-=-=niiiniXYYYQ12121))ˆˆ(()ˆ(ββ其中:即: ∑e i =0 ,∑e i X i =02.5 证明0ˆβ是β0的无偏估计。

证明:)1[)ˆ()ˆ(1110∑∑==--=-=ni i xxi n i i Y L X X X Y n E X Y E E ββ )] )(1([])1([1011i i xx i n i i xx i ni X L X X X n E Y L X X X n E εββ++--=--=∑∑==1010)()1(])1([βεβεβ=--+=--+=∑∑==i xx i ni i xx i ni E L X X X nL X X X n E 2.6 证明 证明:)] ()1([])1([)ˆ(102110i i xxi ni ixx i ni X Var L X X X n Y L X X X n Var Var εβββ++--=--=∑∑== 222212]1[])(2)1[(σσxx xx i xx i ni L X n L X X X nL X X X n +=-+--=∑=2.7 证明平方和分解公式:SST=SSE+SSR证明:2.8 验证三种检验的关系,即验证: (1)21)2(r r n t --=;(2)2221ˆˆ)2/(1/t L n SSE SSR F xx ==-=σβ 01ˆˆˆˆi i i i iY X e Y Y ββ=+=-())1()1()ˆ(222122xx ni iL X n X XX nVar +=-+=∑=σσβ()()∑∑==-+-=-=n i ii i n i i Y Y Y Y Y Y SST 1212]ˆ()ˆ[()()()∑∑∑===-+--+-=ni ii ni i i i ni iY Y Y Y Y Y Y Y 12112)ˆˆ)(ˆ2ˆ()()SSESSR )Y ˆY Y Y ˆn1i 2ii n1i 2i +=-+-=∑∑==0100ˆˆQQββ∂∂==∂∂证明:(1)ˆt======(2)2222201111 1111ˆˆˆˆˆˆ()()(())(()) n n n ni i i i xxi i i iSSR y y x y y x x y x x Lβββββ=====-=+-=+--=-=∑∑∑∑2212ˆ/1ˆ/(2)xxLSSRF tSSE nβσ∴===-2.9 验证(2.63)式:2211σ)L)xx(n()e(Varxxii---=证明:0112222222ˆˆˆvar()var()var()var()2cov(,)ˆˆˆvar()var()2cov(,())()()11[]2[]()1[1]i i i i i i ii i i ii ixx xxixxe y y y y y yy x y y x xx x x xn L n Lx xn Lβββσσσσ=-=+-=++-+---=++-+-=--其中:222221111))(1()(1))(,()()1,())(ˆ,(),())(ˆ,(σσσββxxixxiniixxiiiniiiiiiiiLxxnLxxnyLxxyCovxxynyCovxxyCovyyCovxxyyCov-+=-+=--+=-+=-+∑∑==2.10 用第9题证明是σ2的无偏估计量证明:2221122112211ˆˆ()()()22()111var()[1]221(2)2n ni ii in niii i xxE E y y E en nx xen n n Lnnσσσσ=====-=---==----=-=-∑∑∑∑第三章2ˆ22-=∑neiσ1.一个回归方程的复相关系数R=0.99,样本决定系数R 2=0.9801,我们能判断这个回归方程就很理想吗? 答:不能断定这个回归方程理想。

第二章 一元线性回归2.14 解答:(1)散点图为:(2)x 与y 之间大致呈线性关系。

(3)设回归方程为01y x ββ∧∧∧=+1β∧=12217()ni ii nii x y n x yxn x --=-=-=-∑∑0120731y x ββ-∧-=-=-⨯=-17y x ∧∴=-+可得回归方程为(4)22ni=11()n-2i i y y σ∧∧=-∑ 2n 01i=11(())n-2i y x ββ∧∧=-+∑=2222213⎡⎤⨯+⨯+⨯⎢⎥+⨯+⨯⎣⎦(10-(-1+71))(10-(-1+72))(20-(-1+73))(20-(-1+74))(40-(-1+75)) []1169049363110/3=++++=6.1σ∧=≈ (5)由于211(,)xxN L σββ∧t σ∧==服从自由度为n-2的t 分布。

因而/2|(2)1P t n αασ⎡⎤⎢⎥<-=-⎢⎥⎣⎦也即:1/211/2(p t t ααβββ∧∧∧∧-<<+=1α-可得195%β∧的置信度为的置信区间为(7-2.3537+2.353 即为:(2.49,11.5)2201()(,())xxx Nn L ββσ-∧+t ∧∧==服从自由度为n-2的t 分布。

因而/2(2)1P t n αα∧⎡⎤⎢⎥⎢⎥<-=-⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦即0/200/2()1p βσββσα∧∧∧∧-<<+=- 可得195%7.77,5.77β∧-的置信度为的置信区间为()(6)x 与y 的决定系数22121()490/6000.817()nii nii y y r y y ∧-=-=-==≈-∑∑(7)由于(1,3)F F α>,拒绝0H ,说明回归方程显著,x 与y 有显著的线性关系。

(8)t σ∧==其中2221111()22n ni i i i i e y y n n σ∧∧====---∑∑ 7 3.661==≈ /2 2.353t α= /23.66t t α=>∴接受原假设01:0,H β=认为1β显著不为0,因变量y 对自变量x 的一元线性回归成立。

第5章自变量选择与逐步回归

思考与练习参考答案

自变量选择对回归参数的估计有何影响

答:回归自变量的选择是建立回归模型得一个极为重要的问题。

如果模型中丢掉了重要的自变量, 出现模型的设定偏误,这样模型容易出现异方差或自相关性,影响回归的效果;如果模型中增加了不必要的自变量, 或者数据质量很差的自变量, 不仅使得建模计算量增大, 自变量之间信息有重叠,而且得到的模型稳定性较差,影响回归模型的应用。

自变量选择对回归预测有何影响

答:当全模型(m元)正确采用选模型(p元)时,我们舍弃了m-p个自变量,回归系数的最小二乘估计是全模型相应参数的有偏估计,使得用选模型的预测是有偏的,但由于选模型的参数估计、预测残差和预测均方误差具有较小的方差,所以全模型正确而误用选模型有利有弊。

当选模型(p元)正确采用全模型(m 元)时,全模型回归系数的最小二乘估计是相应参数的有偏估计,使得用模型的预测是有偏的,并且全模型的参数估计、预测残差和预测均方误差的方差都比选模型的大,所以回归自变量的选择应少而精。

如果所建模型主要用于预测,应该用哪个准则来衡量回归方程的优劣

C统计量达到最小的准则来衡量回答:如果所建模型主要用于预测,则应使用

p

归方程的优劣。

试述前进法的思想方法。

答:前进法的基本思想方法是:首先因变量Y对全部的自变量x1,x2,...,xm建立m 个一元线性回归方程, 并计算F检验值,选择偏回归平方和显着的变量(F值最大且大于临界值)进入回归方程。

每一步只引入一个变量,同时建立m-1个二元线性回归方程,计算它们的F检验值,选择偏回归平方和显着的两变量变量(F 值最大且大于临界值)进入回归方程。

在确定引入的两个自变量以后,再引入一个变量,建立m-2个三元线性回归方程,计算它们的F检验值,选择偏回归平方和显着的三个变量(F值最大)进入回归方程。

不断重复这一过程,直到无法再引入新的自变量时,即所有未被引入的自变量的F检验值均小于F检验临界值

Fα(1,n-p-1),回归过程结束。

试述后退法的思想方法。

答:后退法的基本思想是:首先因变量Y对全部的自变量x1,x2,...,xm建立一个m 元线性回归方程, 并计算t检验值和F检验值,选择最不显着(P值最大且大于临界值)的偏回归系数的自变量剔除出回归方程。

每一步只剔除一个变量,再建立m-1元线性回归方程,计算t检验值和F检验值,剔除偏回归系数的t检验值最小(P值最大)的自变量,再建立新的回归方程。

不断重复这一过程,直到无法剔除自变量时,即所有剩余p个自变量的F检验值均大于F检验临界值Fα(1,n-p-1),回归过程结束。

前进法、后退法各有哪些优缺点

答:前进法的优点是能够将对因变量有影响的自变量按显着性一一选入,计算量小。

前进法的缺点是不能反映引进新变量后的变化,而且选入的变量就算不显着也不能删除。

后退法的优点是是能够将对因变量没有显着影响的自变量按不显着性一一剔除,保留的自变量都是显着的。

后退法的缺点是开始计算量大,当减少一个自变量时,它再也没机会进入了。

如果碰到自变量间有相关关系时,前进法和后退法所作的回归方程均会出现不同程度的问题。

试述逐步回归法的思想方法。

答:逐步回归的基本思想是有进有出。

具体做法是将变量一个一个的引入,当每引入一个自变量后,对已选入的变量要进行逐个检验,当原引入变量由于后面变量的应纳入而变得不再显着时,要将其剔除。

引入一个变量或从回归防方程中剔除一个变量,为逐步回归的一步,每一步都要进行F检验,以确保每次引入新的变量之前回归方程中只包含显着的变量。

这个过程反复进行,直到无显着变量引入回归方程,也无不显着变量从回归方程中剔除为止。

这样就避免了前进法和后退法各自的缺陷,保证了最后得到的回归子集是最优回归子集。

在运用逐步回归法时,α进和α出的赋值原则是什么如果希望回归方程中多保留一些自变量,α

进

应如何赋值

答:原则是要求引入自变量的显着水平α

进小于剔除自变量的显着性水平α

出

,否

则可能出现死循环;若想回归方程多保留自变量,可以增大α

进

的值,使得更多

自变量的P值在α

进的范围内,但要注意,α

进

的值不得超过α

出

的值。

在研究国家财政收入时,我们把财政收入按收入形式分为:各项税收收入、企业收入、债务收入、国家能源交通重点建设收入、基本建设贷款归还收入、国家预算调节基金收入、其他收入等。

为了建立国家财政收入回归模型,我们以财政收入y(亿元)为因变量,自变量如下:x1为农业增加值(亿元),x2为工业增加值(亿元),x3为建筑业增加值(亿元),x4为人口数(万人),x5为社会消费总额(亿元),x6为受灾面积(万公顷)。

据《中国统计年鉴》获得1978—1998年共21个年份的统计数据,见表(P167)。

由定性分析知,所有自变量都与y有较强的相关性,分别用后退法和逐步回归法作自变量选元。

解:后退法SPSS输出结果:

逐步回归法

Coe fficients

a 715.30990.574

7.898.000.179.004.99440.739.0001010.840136.027

7.431.000.308.048 1.706 6.367.000-.405.152-.714-2.665.016865.929103.725

8.348.000.639.086 3.5417.439.000-.601.119-1.059-5.057.000-.361.086

-1.493

-4.216.001

(Constant)x5

(Constant)x5x1

(Constant)x5x1x2

Model

12

3

B Std. E rror Unstandardized Coefficients Beta

Standardized

Coefficients

t

Sig.Dependent Variable: y

a.

二者结果相同,回归方程为:

y=—-+

但是回归系数的解释不合理。

表的数据是1968-1983年期间与电话线制造有关的数据,各变量的含义如下:

x 1——年份;

x 2——国民生产总值(10亿美元); x 3——新房动工数(单位:1000); x 4——失业率(%);

x 5——滞后6个月的最惠利率; x 6——用户用线增量(%); y ——年电话销量(百万尺双线)。

(1)建立y 对x2~x6的线性回归方程。

SPSS 输出结果如下:

回归方程为:

y =+x 2+x 3

x 4

x 5

x 6

其中x 2、 x 5的系数未通过检验。

(2)用后退法选择自变量。

后退法剔除P值最大的剔除x5,模型的参数均通过显着性检验。

(显着性水平α=),得回归方程为:

y=+x2+x3x4x6模型表明年电话销量(y)与国民生产总值、新房动工数、失业率、用户用线增量有显着的线性关系。

(3)用逐步回归法选择自变量

逐步回归法引入x3,x5,x4进入回归模型,没有剔除变量,保留x3,x5,x4作为最终模型。

回归方程为:

y=+—+

模型表明年电话销量(y)与新房动工费、失业率、滞后6个月的最惠利率有显

着的线性关系。

(4)根据以上计算结果分析后退法和逐步回归法的差异

答:两个方法得到的最终模型是不同的,后退法首先剔除了x5,而逐步回归法在第二步引入了x5,说明两种方法对自变量选取的方法是不同的,这与自变量之间的相关性有关。

相比之下,后退法首先做全模型的回归,每个自变量都有机会展示自己的作用,所得结果更值得信服。

从本例看,x5是滞后6个月的最惠利率,对因变量的影响似乎不大。