火车头采集器教程演示文稿

- 格式:ppt

- 大小:2.02 MB

- 文档页数:31

以采集示例详解部分功能今天要给大家做示例的网站是163的娱乐频道这个应该是个比较通用和实用的规则,下面开始。

如果您是火车采集器的老手,那么您可以参考下,因为我要讲解的会有违传统的思维;如我您是新手那么您最好能仔细看下,因为这将加快您的入门,同时在以后给您节省很多时间。

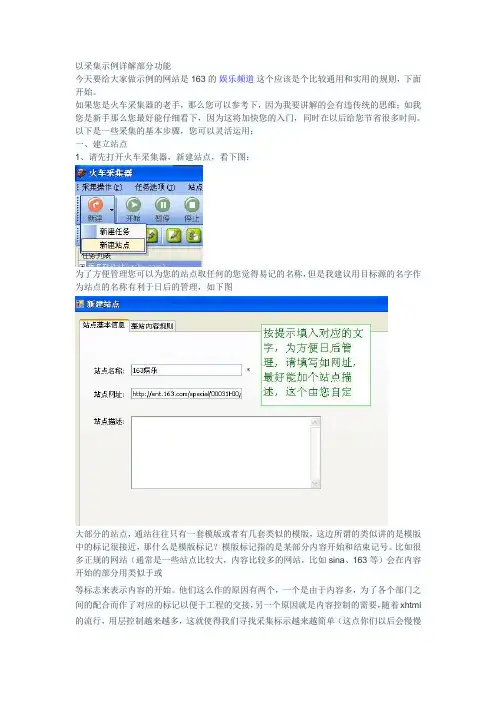

以下是一些采集的基本步骤,您可以灵活运用:一、建立站点1、请先打开火车采集器,新建站点,看下图:为了方便管理您可以为您的站点取任何的您觉得易记的名称,但是我建议用目标源的名字作为站点的名称有利于日后的管理,如下图大部分的站点,通站往往只有一套模版或者有几套类似的模版,这边所谓的类似讲的是模版中的标记很接近,那什么是模版标记?模版标记指的是某部分内容开始和结束记号。

比如很多正规的网站(通常是一些站点比较大,内容比较多的网站,比如sina、163等)会在内容开始的部分用类似于或等标志来表示内容的开始。

他们这么作的原因有两个,一个是由于内容多,为了各个部门之间的配合而作了对应的标记以便于工程的交接,另一个原因就是内容控制的需要,随着xhtml 的流行,用层控制越来越多,这就使得我们寻找采集标示越来越简单(这点你们以后会慢慢理解的)。

上面给各位讲这些是因为接下来要我们要讲解的是整站内容规则。

2、标题标签讲解。

对应的页面在这:/06/1029/11/2UJNHOS3000322EL.html首先从“站点基本信息”切换到“整站内容规则”,然后把要采集的内容页面的网址拷贝到“典型页面”接着点击“测试”读取源码。

先从标题标签开始,我们发现按默认标签采集回来的标题多了“_网易娱乐”,请双击标题标签或者选种标题标签在点击修改,把“_网易娱乐”添加到排除内容框里,标题标签完成。

如图:3、内容标签讲解。

制作采集规则(任务)的任何一个标签最重要的就在于寻找开始也结束的标志。

目前大部分的采集器要求开始和结束的标志必须是整个源代码的唯一标志,也就是所有的html源码里只能找到一个开始或结束的标志。

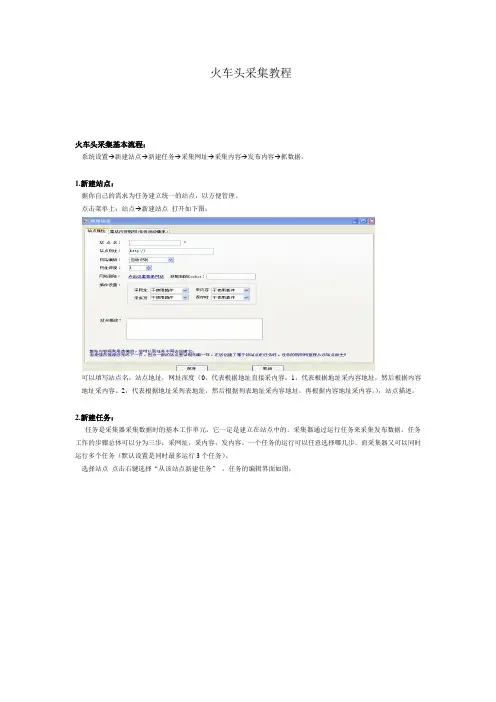

火车头采集教程火车头采集基本流程:系统设置→新建站点→新建任务→采集网址→采集内容→发布内容→抓数据。

1.新建站点:据你自己的需求为任务建立统一的站点,以方便管理。

点击菜单上:站点→新建站点打开如下图:可以填写站点名,站点地址,网址深度(0,代表根据地址直接采内容。

1,代表根据地址采内容地址,然后根据内容地址采内容。

2,代表根据地址采列表地址,然后根据列表地址采内容地址,再根据内容地址采内容。

),站点描述。

2.新建任务:任务是采集器采集数据时的基本工作单元,它一定是建立在站点中的。

采集器通过运行任务来采集发布数据。

任务工作的步骤总体可以分为三步:采网址,采内容,发内容。

一个任务的运行可以任意选择哪几步。

而采集器又可以同时运行多个任务(默认设置是同时最多运行3个任务)。

选择站点点击右键选择“从该站点新建任务”。

任务的编辑界面如图:采集器的使用最主要的就是对任务的设置。

而采集数据可以分为两步,第一步是:采网址,第二步:采内容。

3.采集网址:采网址,就是从列表页中提取出内容页的地址。

从页面自动分析得到地址连接:以/book/01.45.52_P1.html页面为例。

我们来采集这个网址上的书信息。

这个页面中有很多书信息的链接,要采集每个链接中书内容.首先需要将每个书信息的链接地址抓取到也就是抓取内容页的地址。

先将该列表页地址添加到采集器里。

点击“<<向导添加”后弹出“添加开始采集地址”对话框。

我们选择“单条网址”如图:点击添加把/book/01.45.52_P1.html地址添加到下面框中,点击完成即实现增加列表地址。

如果我们选择“批量/多页”,如图:可用通配符:(*)可以代替页码变化时的地址之间的差异。

数字变化可以设置你要爬取该列表页多少页。

间隔倍数可以数字页码变化的倍数。

你也可以设置字母变化。

设置完之后点击添加按钮把列表地址添加到下框中,点击完成即可完成列表地址设置。

你也可以选择文本导入和正则提取在这里就不一一讲了,因为这二种基本用的很少。

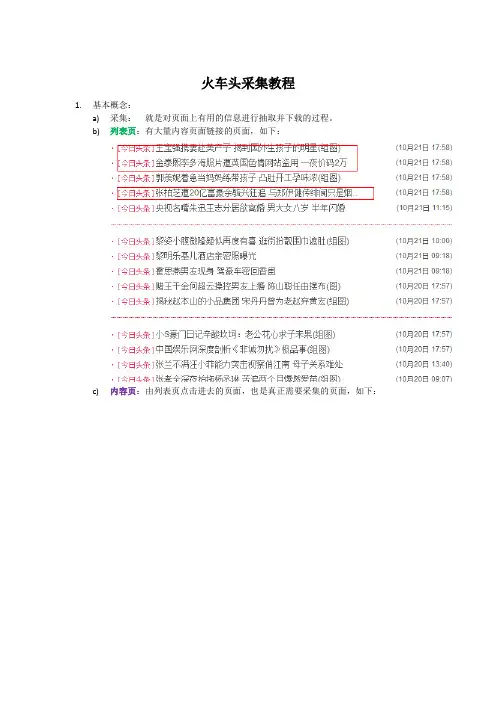

火车头采集教程1.基本概念:a)采集:就是对页面上有用的信息进行抽取并下载的过程。

b)列表页:有大量内容页面链接的页面,如下:c)内容页:由列表页点击进去的页面,也是真正需要采集的页面,如下:内容页抽取的过程实质上也就是在源代码中找到需要的内容的开始和结束的字符串,系统进行自动匹配的过程,比如上图中”王宝强携….” 这个标题,在源代码中的格式是这样的因此,只需要把上图中的开始和结束字符串拷贝到软件中就可以了(详情见下)2.基本步骤:a)确定需要采集的网站b)观察网站结构,找到列表页,做以下工作i.观察列表页中需要的内容页的链接样式ii.观察列表页第一页、第二页等等的链接样式。

c)对内容页进行模板编写d)开始采集任务。

3.详细实例:下面通过一个具体的例子来具体讲解火车头采集器的工作过程这个例子尝试抓取/NewsList-Front.aspx 这个页面的前5页的内容a)打开程序打开后如下图:b)在站点任务列表树那里右键-》新建站点类似下图c)主界面中出现的标签,在这个标签上右键选择新建站点,如下:出图如下:点击向导添加,对列表页的链接地址进行描述,弹出窗口如下:为了确定在这里填写什么,我们先到需要抓取的列表看看,也就是/NewsList-Front.aspx然后鼠标在页面上浮动,观察它的链接样式,如下图第一页第二页看到这里,我们可以发现,这里的列表页的规则是/NewsList-Front.aspx?page=0/NewsList-Front.aspx?page=1…即:链接前面是不变的,只有后面的页码改变,因此现在我们可以知道上面的表单怎么填了,如下图:这里的(*)代表通配符,系统会自动按照你的规则对这个字符进行替换。

比如,现在的规则是数字变化从0到4,间隔为1,因此,系统自动生成了如预览中的列表样式出来了。

预览中的链接样式确定没有问题后,点击添加。

然后点击完成。

d)现在又回到了这个页现在来观察我们需要的列表中的链接的样式,如下图:从上面我们可以看到,所有的新闻的链接都类似于:/files/2011/10/21/285866.shtml这个链接中/files/这个部分是不变的,后面的可能会根据年月日,标签而改变,还记得我们之前讲的(*)的作用么,没错,这里我们可以这样描述它:/files/(*)/(*)/(*)/(*).shtml把这个填到上图中的文章内容页面的地址比如包含中去吧你一定注意到了,这个表单还有个页面内选定区域采集网址应该怎么填呢。

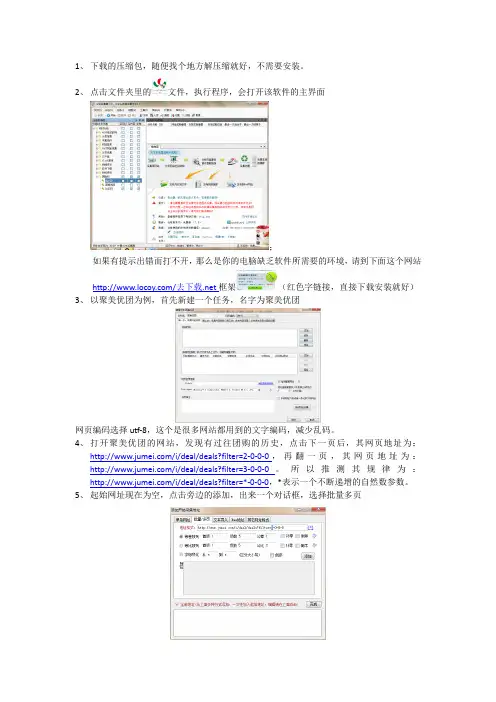

1、下载的压缩包,随便找个地方解压缩就好,不需要安装。

2、点击文件夹里的文件,执行程序,会打开该软件的主界面;如果有提示出错而打不开,那么是你的电脑缺乏软件所需要的环境,请到下面这个网站/去下载.net框架(红色字链接,直接下载安装就好)3、以聚美优团为例,首先新建一个任务,名字为聚美优团网页编码选择utf-8,这个是很多网站都用到的文字编码,减少乱码。

4、打开聚美优团的网站,发现有过往团购的历史,点击下一页后,其网页地址为:/i/deal/deals?filter=2-0-0-0,再翻一页,其网页地址为:/i/deal/deals?filter=3-0-0-0。

所以推测其规律为:/i/deal/deals?filter=*-0-0-0,*表示一个不断递增的自然数参数。

5、起始网址现在为空,点击旁边的添加,出来一个对话框,选择批量多页选择页数的那个数字,选中它后,然后点击右边的蓝色*符号,于是这个网址变成:大家注意看,输入框内的*符号变成绿色粗体的了,而且下面出现了按照这个规律递增的5个网址。

这里作为实例,我们就选一个比较小的数字,而实际爬取的时候,根据实际情况修改选项中的起止数字。

6、点击网址旁边的“添加”按钮,然后在下面会出现一个表达式,这个是自动生成的,不用修改。

然后点击完成,返回编辑任务对话框。

7、点击第二步,进入采集信息设置的地方,在这里需要确定我们在这个页面上要采集哪些数据我们回到聚美优网上,看看我们需要什么数据:有时间、原价、折扣、现价、节省,虽然没有明确的团购人数,但是有个收货短评和口碑报告,我们这里就来看看怎么采集这些信息吧。

在网页上点击右键,查看源代码,会看到很多html格式的源代码,我们找到表示这个商品的地方然后我们来看:是时间是收货短评这些就是我们需要的信息在代码里的情况,我们把这些前后字符串一一设置到软件里。

8、设置信息的前后代码符号(刚开始的时候,这个表格是空白的)点击添加,出现这样的对话框:我们要做的就是填写标签名,选择循环匹配,然后把想要信息的前后字符分别粘贴到开始字符串和结束字符串两个框框里,然后点确定。

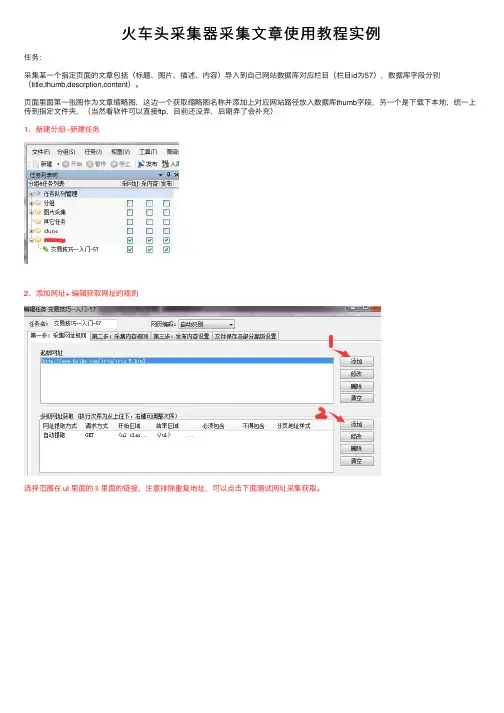

⽕车头采集器采集⽂章使⽤教程实例任务:采集某⼀个指定页⾯的⽂章包括(标题、图⽚、描述、内容)导⼊到⾃⼰⽹站数据库对应栏⽬(栏⽬id为57),数据库字段分别(title,thumb,descrption,content)。

页⾯⾥⾯第⼀张图作为⽂章缩略图,这边⼀个获取缩略图名称并添加上对应⽹站路径放⼊数据库thumb字段,另⼀个是下载下本地,统⼀上传到指定⽂件夹,(当然看软件可以直接ftp,⽬前还没弄,后期弄了会补充)1、新建分组--新建任务2、添加⽹址+ 编辑获取⽹址的规则选择范围在 ul ⾥⾯的 li ⾥⾯的链接,注意排除重复地址,可以点击下⾯测试⽹址采集获取。

可以看到有采集到的⽂章链接了。

3、采集内容规则我这边需要采集下⾯图上展⽰数据(catid是栏⽬id,可以将采集到的数据放⼊对应栏⽬,设置固定值就好)着重说下内容和图⽚的采集,标题和描述同理内容采集内容采集:打开⼀个采集的⽂章页⾯,查看源代码(禁了右键的f11 或者在⽹址前⾯加上 view-source: ⼀样可以查看):选中⽂章开头⼀个位置,截取⼀段在ctrl+f 搜下是否唯⼀⼀段,若是就可以放在位置下图1处,结尾同开头⼀样。

我截取内容不想⾥⾯还带有链接图⽚可以数据处理,添加--html标签排除--选好确定--确定还有需要下载页⾯图⽚,勾选和填写下⾯选项图⽚采集:(1)选中范围和内容⼀样(⽂章内图⽚)(2)数据处理选提取第⼀张图⽚内容是:/2017/33/aa.jpg(3)只要aa.jpg,正则过滤 ,获取内容:aa.jpg (4)数据库存储有前缀,添加上, upload/xxxxx/找⼀个页⾯测试⼀下,可以看到对应项⽬都获取到了。

4、发布内容设置,这⾥以⽅式三发布到数据库为例⼦,编辑后回到这边勾选刚定义的模块就好:5、我需要保存图⽚到本地,要设置下保存⽂件的路径(ftp后续会试着使⽤)。

6、保存,查看刚新建的任务,右键开始任务运⾏,这边就可以看到⽂字和图⽚都下载下来了,数据库⾥⾯也可以看到了。

火车采集器采集原理,流程介绍先说一下,什么是数据采集呢?我们可以这样理解,我们打开一个网站,看到有一篇文章很不错,于是我们就将文章的标题和内容复制了一下,将这篇文章转到我们的网站上.我们的这个过程,就可以称作一个采集,将别人网站上对自己有用的信息转到自己网站上.采集器也是这样,不过整个过程是由软件完成的.我们可以这样理解,我们复制文章的标题和内容,是我们可以知道什么地方是内容,什么地方是标题, 但是软件是不知道的,所以我们要告诉软件,要怎么采,这就是写规则的过程..我们复制完了,打开我们网站,比如论坛发帖的地方,然后粘帖发表,对软件来说,就是模仿我们发表帖子的过程,去发表文章,怎么发布,这就是发布模块的事了..火车采集器就是一款用来采集数据的软件,它是目前网络上最强大的采集器.它几乎可以采到你所见到的任何网页内容。

火车采集器数据抓取原理:火车采集器如何去抓取数据,取决于您的规则。

您要获取一个栏目的网页里的所有内容,需要先将这个网页的网址采下来,这就是采网址。

程序按您的规则抓取列表页面,从中分析出网址,然后再去抓取获得网址的网页里的内容。

再根据您的采集规则,对下载到的网页分析,将标题内容等信息分离开来并保存下来。

如果您选择了下载图片等网络资源,程序会对采集到的数据进行分析,找出文章下载地址并下载到本地。

火车采集器数据发布原理:在我们将数据采集下来后数据默认是保存在本地的,我们可以使用以下几种方式对种据进行处理。

1.不做任何处理。

因为数据本身是保存在数据库的(access或是db3),您如果只是想看一下,直接用相关软件查看就可以了。

2.web发布到网站。

程序会模仿浏览器向您的网站发送数据,可以实现您手工发布的效果。

3.直接入数据库。

您只需写几个SQL语句,程序会将数据按您的SQL语句导入到数据库中。

4.保存为本地文件。

程序会读取数据库里的数据,按一定格式保存为本地sql或是文本文件。

火车采集器工作流程:火车头采集是可以分成两个步骤的,一是采集数据,二是发布数据。

火车采集器V2010SP3版(实现内容自动更新的采集软件)前提:本软件要求电脑安装net framework2.0或2.0以上框架支持。

一、火车采集器V2010SP3版,可供下载地址:/Down/LocoySpider/LocoySpider2010SP3.html二、net framework2.0,可供下载地址:/download/-Fra mework-2.0-For-Win98SE-ME-2000-XP/火车采集器和net framework2.0安装好后,可进行如下操作,操作步骤为:一、1.在一堆文件中,找到如下图标(画有红方框、状似火车头的),并双击打开。

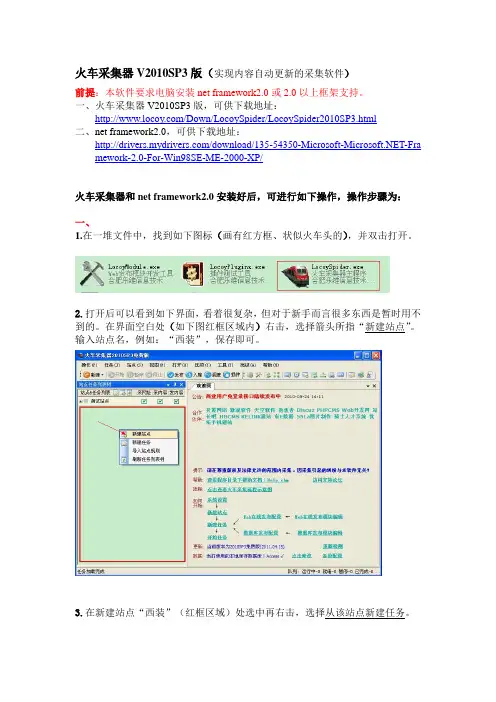

2.打开后可以看到如下界面,看着很复杂,但对于新手而言很多东西是暂时用不到的。

在界面空白处(如下图红框区域内)右击,选择箭头所指“新建站点”。

输入站点名,例如:“西装”,保存即可。

3.在新建站点“西装”(红框区域)处选中再右击,选择从该站点新建任务。

二、第一步:采集网址规则1.先要找到自动更新的内容来源:如经常更新关注度较高的博客、专业网站等,这里我们就拿淘宝论坛举个例子。

找到开始采集地址栏右侧,点击向导添加。

2.添加开始采集地址中的多页类似地址形式前,要分析一下它的类似形式,例:我们在淘宝论坛中搜索“西服”相关内容,然后任意翻阅不同的页数查看它的网页地址。

第一页地址、第二页地址、第三页地址分别为:以此类推,分析出其不同点在于上图红框处的数字变化,因此:假如我们只采集论坛的第一页,就在多页类似地址形式栏粘贴第一页的网址,按一下(*)将选中的数字1替换成(*),再将数字变化改为相应页数:1, 然后点击添加、完成。

3.接着,找到如下图的相应位置分析规则并分别输入:必须包含“thread”,不得包含“post|pc”,任务名:这里设为“第一页”。

【可以点击开始测试网址采集,检测一下是否将网页都采集过来了。

若要返回到刚才上一级页面,点击返回修改设置即可。

火车头——2010SP3——网站采集教程下载地址:/Down/我们下载免费版。

注意:想用火车,就必须得安装.NET FrameWork 2.0框架或更高版本.net framework 2.0下载地址: /那么,火车我们也下载到本地了,。

net框架,我们也安装了。

那么,我们把新下载的火车采集软件,解压下。

看到一些密密麻麻乱七八糟的东西及文件。

那么。

上图中,用红线圈住的LocoySpider.exe 是主程序,我们双击打开。

ps:这里说下,上图中,有好多任务是我自己用的。

新程序,并没有那么多。

我们会看到火车的界面,看起来非常复杂,是吧?呵呵,其实并没有那么复杂,对于新手,有好多东西是用不到的。

下边会一一的讲解。

我们先补习一下,火车头采集软件的工作原理。

因为我们浏览到的网页,最后都是通过html输出的,那么意味着,我们可以查看到html的源码,那么火车头为什么会采集到内容呢?我们看下网站的基本结构。

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN""/TR/xhtml1/DTD/xhtml1-transitional.dtd"><html xmlns="/1999/xhtml"><head><meta http-equiv="Content-Type" content="text/html; charset=utf-8" /> -------这些蓝色的东西,对于新手,我们不需要知道!<title>网页的标题</title> ----红色的是网页的标题。

如下图(1)</head><body>内容在这个<body>和</body>之间的,是网站的内容部分。

火车头采集器教程演示文稿一、介绍你好,大家好!今天我非常荣幸给大家介绍一个非常实用的工具,火车头采集器。

它是一款强大的网络数据采集工具,可以帮助我们快速获取互联网上的各种信息。

二、功能1.数据采集:可以采集各种网站上的数据,如商品信息、新闻、评论等。

2.数据筛选:可以根据指定的条件对采集到的数据进行筛选和整理,提高数据的质量。

3. 数据导出:可以将采集到的数据导出为Excel、CSV等格式,方便进行后续分析和处理。

4.定时采集:可以设置定时任务,实现自动采集数据功能。

5.模拟登录:可以模拟用户的登录操作,以获得更多的数据。

6.反爬虫模式:可以通过一系列的反爬虫策略,规避网站的反爬虫机制,提高数据采集的成功率。

三、操作步骤下面我将为大家演示如何使用火车头采集器进行数据采集。

1.打开火车头采集器软件,点击左上角的“新建任务”按钮。

2.在弹出的窗口中,输入任务名称和要采集的网站URL,点击确定。

5.等待采集完成后,点击“导出数据”按钮,选择导出格式和保存路径,并点击确定。

6.打开导出的文件,即可查看采集到的数据。

四、常见问题及解决方法1.采集速度较慢:可以尝试调整线程数和延时时间,以提高采集速度。

2.采集到的数据不完整:可以检查采集器的配置是否正确,并尝试使用正则表达式提取所需数据。

3.被网站反爬虫封IP:可以使用代理IP或者设置访问频率来规避网站的反爬虫机制。

4.无法模拟登录:可以检查登录账号和密码是否正确,并确保网站的登录接口没有变动。

5.无法启动采集器:可以检查网络连接是否正常,并尝试重新安装软件。

五、总结火车头采集器是一款功能强大、易于操作的网络数据采集工具,可以帮助我们快速获取互联网上的各种信息。

通过本次演示,我相信大家已经对火车头采集器的使用有了初步的了解。

希望大家能够通过学习和实践,更好地应用这个工具,在数据采集和处理方面取得更好的成果。

谢谢大家!。

火车头采集器使用教程本文将以火车头采集器为例,介绍如何使用火车头采集器进行数据采集。

第一步:安装火车头采集器第二步:打开火车头采集器安装完成后,可以在桌面或开始菜单中找到火车头采集器的图标,双击图标打开火车头采集器。

第三步:设置采集任务在火车头采集器中,可以点击左上角的“新建任务”按钮,进入任务设置界面。

在任务设置界面中,可以设置任务的名称、采集URL、采集深度等。

任务名称:在任务名称中,可以自定义一个任务的名称,以便于区分不同的任务。

采集URL:在采集URL中,输入需要采集的网页地址。

可以是单个页面地址,也可以是一个网站的首页地址。

如需采集多个页面,可以使用正则表达式进行匹配。

采集深度:设置采集的深度,即采集页面时要访问的页面层数。

可选择采集每个页面的链接,并设置最大采集页面数量。

第四步:配置数据采集规则在任务设置界面中,可以选择“设置规则”选项卡,配置数据采集规则。

火车头采集器通过选择页面上的元素,并设置相关规则来进行数据采集。

选择元素:点击“选择元素”按钮,鼠标变为十字形状,将鼠标移动到需要采集的元素上,点击元素即可选择。

可以选择文本、链接、图片、表格等各种类型的页面元素。

设置规则:在选择元素后,可以设置采集规则。

规则包括提取文本、提取链接、提取图片、提取HTML等。

可以选择提取的方式,并设置相应的规则。

点击“确定”按钮后,数据采集规则即配置完成。

第五步:开始采集数据在任务设置界面中,可以点击“开始”按钮,开始采集数据。

火车头采集器将自动按照设置的规则,采集页面上的数据。

在采集过程中,可以在任务设置界面的“日志”选项卡中查看运行日志,了解数据采集的进程和结果。

第六步:保存数据数据采集完成后,可以点击任务设置界面中的“保存数据”按钮,保存采集到的数据。

可以选择保存为Excel、CSV等格式,也可以选择保存到数据库或云端服务器中。

第七步:数据清洗和分析采集到的原始数据可能存在一些噪声或冗余,需要进行数据清洗和分析。

1、火车头介绍2、什么是信息采集3、什么是火车头4、火车头是干啥的5、火车头规则定制6、规则编写流程7、采网址详解8、采内容详解9、注意事项什么是火车头?我们打开一个网站,看到有一篇文章很不错,于是我们就将文章的标题和内容复制了一下,将这篇文章转到我们的网站上.我们的这个过程,就可以称作一个采集,将别人网站上对自己有用的信息转到自己网站上;互联网上的内容,大多数都是通过复制-修改-黏贴的过程产生的,所以信息采集很重要,也很普遍,我们平台发到网站上的文章,多数也是这样的一个过程;为什么很多人感觉新闻更新很麻烦,因为这个工作是重复的,枯燥乏味的,浪费时间的;火车头是目前国内使用人数最多、功能最完善、网站程序支持最全面、数据库支持最丰富的软件产品;现在是大数据时代,它可以快速、批量、海量的获取到互联网上的数据,并按照我们需要的格式存储起来;说的简单一点,对我们来说有什么用?我们需要更新新闻,需要发商机,如果让你准备1000篇文章,你要用多久?5个小时?在有规则的情况下,火车头只需要5分钟!前提是有规则,所以我们要先学写规则,写规则如果数量的话,一个规则几分钟就好了,但刚开始学的时候会比较慢;名称解释与规则编写流程以火车头8.6版本为准第1步:打开—登录第2步:新建分组第3步:右击分组,新建任务,填写任务名;第4步:写采集网址规则(起始网址和多级网址获取)第5步:写采集内容规则(如标题、内容)第6步:发布内容设置勾选启用方式二(1)保存格式:一条记录保存为一个txt;(2)保存位置自定义;(3)文件模板不用动;(4)文件名格式:点右边的倒立笔型选[标签:标题];(5)文件编码可以先选utf-8,如果测试时数据正常,但保存下来的数据有乱码则选gb2312;第7步:采集设置,都选100;a.单任务采集内容线程个数:同时可以采集几个网址;b.采集内容间隔时间毫秒数:两个任务的间隔时间;c.单任务发布内容线程个数:一次保存多少条数据;d.发布内容间隔时间毫秒数:两次保存数据的时间间隔;附注:如果网站有防屏蔽采集机制(如数据很多但只能采集一部分下来,或提示多久才能打开一次页面),则适当调小a值和调大b的值;第8步:保存、勾选并开始任务(如果是同一分组的,可以在分组上批量选中)以前的方式:比如我要准备n篇文章,要先找到这个文章是在哪个网站上的(如是采集同行A还是同行B),是在其哪个栏目下的(如是产品信息还是新闻信息),在这个栏目下有n条信息,我要选哪一条,然后进去后把标题复制下来,把内容复制下来再进到另一个页面把标题内容复制下来,以此类推,然后同样的流程我要执行n遍;怎么转换:怎么把这个流程转化为软件操作呢?我要准备n篇新闻,这就表明要n个标题+对应的内容,要n个新闻链接,这n个新闻链接是从一个网站的新闻栏目上找的,而这个网站的新闻栏目有可能是很多页,比如10页,这个时候再从同行A的网站—栏目—内页;即先找到要采集的网站,打开这个网站的栏目页(确定好是采集新闻还是产品),写网址规则采集栏目下的所有新闻链接,然后写内容规则采集所有新闻链接中的标题和内容,最后保存下来;采网址详解-具体操作找到要采集网址的栏目页,如新闻栏目复制栏目的第一页链接url,起始网址右侧中点添加,在单条网址中黏贴栏目的第一页链接后点添加,如用右边的(*)代替,因为第1页已经添加了,还剩9页,这时在等差数列那一行把项数改成9,首项是2(因为第2页的链接是,然后点添加-完成;1、点对应右侧的添加,然后如下图所示是示例,右侧大图是说明;2、点击保存后点右下角的看看是否能采集到新闻网址,如果能采集到则正确,双击一个新闻网址进到下一步;如果采集到的不正确,返回修改直到成功;网址过滤可以自己观察其对应的规律;1、到采集内容规则这里后,把作者、时间、出处都选中后删掉,如右面第一张图,因为这些标签正常情况下都用不到;2、选中标题标签点修改,或直接双击该标签,进入编辑界面;3、进入后标签名的“标题”别改,改过后是要改对应的模板的;4、下面的数据提取方式:前后截取和开始结束字符串,也尽量用默认的,在不熟练的情况下不要改;5、点击下面数据处理的添加—内容替换,如右图;6、内容替换将标题后面的都替换为空,如果不替换的话采集的是页面title,这时需要打开两个新闻页面,看看这两个新闻页面的公共部分是什么,把公共部分替换掉例:如下面两个标题,“- 顶尖SEO团队”是公共部分,即把其替换为“空”;【图文】你知道螺旋加料机的加工方法吗螺旋加料机原理你了解吗【图文】气动式加料机的优点是什么你知道粉末加料机工作原理吗例:如下面的则需要把“-健康网”替换成“空”;例:如下面的则需要把“-健康网”替换成“空”;我喜欢吃西瓜-健康网苹果好吃吗?-健康网1、选中内容点编辑,或直接双击进入到内容标签编辑界面,标签名千万别改;2、写开始和结束字符串,就是找能把所有新闻都包裹起来的,在所有新在所有新闻页面中都是闻页面中都有的,且是唯一的一段字符串;即这个页面模板中的唯一代码串;举例:采集内容的时候,需要选择内容区域,因为要采集的可能是n篇,如100篇,这个时候就需要想法怎么能写一个采集到全部的,方法就是打开两个新闻链接如,查看第一篇新闻的源文件,找到新闻正文,然后向上找离新闻第一句话最近的,在这个页面中是唯一的一段代码(如果不唯一,软件能知道从第几个开始吗?),但又不是新闻中的内容,如<div id=“zoom”>,复制后在第二篇新闻页面源文件中搜一下看看有没有,如果有,则可采用;同理找到新闻最后一句话,向下找离其最近的页面中唯一的一段代码,复制后在第二篇新闻页面源文件中搜一下看看有没有,如果有,则可采用;数据处理:因为采集的是其他网站的信息,里面有可能有其他网站的资料,如公司名、联系方式、品牌等信息,也可能有其他网站的超链接等信息,这个时候就需要对信息进行过滤处理;数据处理—添加—下面对应的参数HTML标签过滤:滚动轴横向拉到最后,在所有标签前面打钩后点确定;内容替换:将这个网站的信息替换成自己的,原则是先整后拆,有公司名、电话号(拆分)、手机号(拆分)、邮箱、公司地址(拆分)、品牌名、网址(拆分);其中拆分的意思是对这个数据进行拆解替换,这个时候就需要做如下替换:因为在新闻中,,这是时候就需要对其拆解替换才能替换干净,可以多看一下他的新闻中,可能会用什么样的格式;注:数据处理还有很多技巧,需要自己在使用的过程中琢磨,更是采集的核心,如果处理不好,有可能是为他人做嫁衣,所以一定要仔细观察,考虑全面,如果处理好了,采集下来的文章甚至可以直接就发布(非自己企业站)注意事项1、右击分组:会出现如下图菜单,正常都能用到;新建任务:在此分组上新建任务;运行该分组下所有任务:顾名思义;新建任务:在该分组下再建分组;编辑/删除分组:编辑/删除当前分组;导入/导出分组规则:可以导出当前分组下的所有任务,并导入到同版本火车头上;导入任务至该分组:将导出的单个任务导入到该分组下面;黏贴任务到该分组下:要复制过任务后此项才出现,可以黏贴多个同样的任务,然后再黏贴后的任务上进行编辑即可;开始任务:和菜单栏上的开始一样;编辑任务:编辑已经写好的任务;导出任务:可以将当前规则导出,在其他同版本工具上导入,但导入数据时需重复上面的第6步-发布内容设置,必须要重新选/填一遍;复制任务到黏贴板:复制后,选择一个任务分组并右击,可以黏贴不同数量的任务到那个分组中,这样就避免同一个任务多次编写了;清空任务所有采集数据:新如果之前采集过任务想重新采集的,则需求先清空;3、其他设置:顶部菜单栏中点击工具—选项,配置全局选项和默认选项;全局选项:可以调整下同时运行任务最大个数,正常是5即可,可不调;默认选项:是否忽略大小写点是;。