第5章 贝叶斯网络和主观贝叶斯方法

- 格式:ppt

- 大小:331.00 KB

- 文档页数:58

3.5 贝叶斯网络贝叶斯网络是一系列变量的联合概率分布的图形表示。

一般包含两个部分,一个就是贝叶斯网络结构图,这是一个有向无环图(DAG),其中图中的每个节点代表相应的变量,节点之间的连接关系代表了贝叶斯网络的条件独立语义。

另一部分,就是节点和节点之间的条件概率表(CPT),也就是一系列的概率值。

如果一个贝叶斯网络提供了足够的条件概率值,足以计算任何给定的联合概率,我们就称,它是可计算的,即可推理的。

3.5.1 贝叶斯网络基础首先从一个具体的实例(医疗诊断的例子)来说明贝叶斯网络的构造。

假设:命题S(moker):该患者是一个吸烟者命题C(oal Miner):该患者是一个煤矿矿井工人命题L(ung Cancer):他患了肺癌命题E(mphysema):他患了肺气肿命题S对命题L和命题E有因果影响,而C对E也有因果影响.命题之间的关系可以描绘成如右图所示的因果关系网.因此,贝叶斯网有时也叫因果网,因为可以将连接结点的弧认为是表达了直接的因果关系。

图3-5 贝叶斯网络的实例图中表达了贝叶斯网的两个要素:其一为贝叶斯网的结构,也就是各节点的继承关系,其二就是条件概率表CPT。

若一个贝叶斯网可计算,则这两个条件缺一不可。

贝叶斯网由一个有向无环图(DAG)及描述顶点之间的概率表组成.其中每个顶点对应一个随机变量。

这个图表达了分布的一系列有条件独立属性:在给定了父亲节点的状态后,每个变量与它在图中的非继承节点在概率上是独立的。

该图抓住了概率分布的定性结构,并被开发来做高效推理和决策。

贝叶斯网络能表示任意概率分布的同时,它们为这些能用简单结构表示的分布提供了可计算优势.假设对于顶点xi,其双亲节点集为Pai,每个变量xi的条件概率P(xi|Pai)。

则顶点集合X={x1,x2,…,xn}的联合概率分布可如下计算:。

双亲结点。

该结点得上一代结点。

该等式暗示了早先给定的图结构有条件独立语义。

它说明贝叶斯网络所表示的联合分布作为一些单独的局部交互作用模型的结果具有因式分解的表示形式。

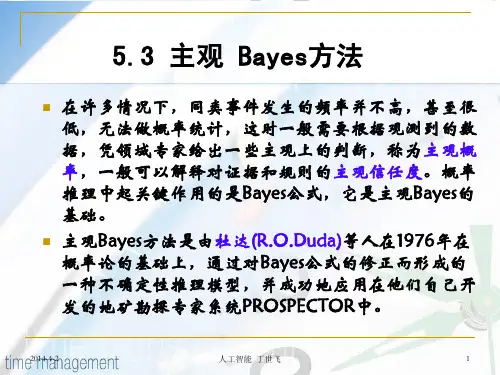

第2章主观贝叶斯方法/~wjluo/aai/中国科大计算机学院内容•规则的不确定性•证据的不确定性•推理计算主观贝叶斯方法•R. O. Duda等人于1976年提出的一种不确定性推理模型。

–在这个模型中,他们称推理方法为主观Bayes方法。

–成功地应用于地矿勘探系统PROSPECTOR中。

•在这种方法中,引入了两个数值(LS,LN)。

•IF A THEN (LS, LN) B–LS体现规则成立的充分性,–LN体现规则成立的必要性。

–这种表示既考虑了事件A的出现对其结果B的支持,又考虑了A的不出现对B的影响。

内容•规则的不确定性•证据的不确定性•推理计算几率函数•几率函数O(X):)(1)()(X P X P X O −=•O(X)表示证据X 的出现概率和不出现的概率之比。

•显然O(X)是P(X)的增函数。

∞====)(,1)(1500)(0)(X O X P , O(X)=.P(X)=X O X P ,•几率函数实际上表示了证据X 的不确定性。

规则的不确定性•对规则A →B 的不确定性度量f(B, A)以因子(LS ,LN )来描述。

•充分性因子LS :表示A 真时对B 的影响,即规则成立的充分性。

•必要性因子LN :表示A 假时对B 的影响,即规则成立的必要性。

•实际应用中,概率值不可能求出,所以采用的都是专家给定的LS, LN 值,而不是依LS ,LN 的定义来计算的。

)|~()|(B A P B A P LS =)|~(~)|(~B A P B A P LN =•因此,LS 表征的是A 的发生对B 发生的影响程度。

•若LS 为无穷大,则P(~B|A)=0,即P(B|A)=1,说明证据A 对于得出B 为真的逻辑是充分的。

•LS 也称为充分似然性因子。

得由)(~)()|(~)|~(,)()()|()|(B P A P A B P B A P B P A P A B P B A P ==)()|()(~)()|(~)|()|~()|(B O A B O B P B P A B P A B P B A P B A P LS ===•因此,LN 表征的是A 不发生对B 发生的影响程度。

贝叶斯一、贝叶斯公式贝叶斯定理是以英国数学家贝叶斯命名,用来解决两个条件概率之间的关系问题。

已知某条件概率,如何得到两个事件交换后的概率,也就是在已知P(A|B)的情况下如何求得P(B|A)。

这里先解释什么是条件概率:P(B|A)表示事件B已经发生的前提下,事件A发生的概率,叫做事件B发生下事件A的条件概率。

其基本求解公式为:。

贝叶斯定理之所以有用,是因为我们在生活中经常遇到这种情况:我们可以很容易直接得出P (A|B),P(B|A)则很难直接得出,但我们更关心P(B|A),贝叶斯定理就为我们打通从P(A|B)获得P(B|A)的道路.贝叶斯定理:P(A)、P(B)是”先验概率”(Prior probability).先验概率是指我们主观通过事件发生次数对概率的判断。

P(A|B)是已知B发生后A的条件概率,叫做似然函数(likelihood)。

似然函数是通过事件已经发生的概率推算事件可能性的概率。

P(B|A)是已知A发生后B的条件概率,是我们要求的值,叫做后验概率。

P(A|B)/P(A)是调整因子:调整因子是似然函数与先验概率的比值,这个比值相当于一个权重,用来调整后验概率的值,使后验概率更接近真实概率.因此,贝叶斯定理可以理解为通过先验概率和调整因子来获得后验概率二、分类问题已知集合:和,确定映射规则y=f(x),使得任意x i有且仅有一个y j使得y j=f(x i)成立.其中C叫做类别集合,其中每一个元素是一个类别,而I叫做项集合,其中每一个元素是一个待分类项,f叫做分类器.分类算法的任务就是构造分类器f.这里要着重强调,分类问题往往采用经验性方法构造映射规则,即一般情况下的分类问题缺少足够的信息来构造100%正确的映射规则,而是通过对经验数据的学习从而实现一定概率意义上正确的分类,因此所训练出的分类器并不是一定能将每个待分类项准确映射到其分类,分类器的质量与分类器构造方法、待分类数据的特性以及训练样本数量等诸多因素有关。

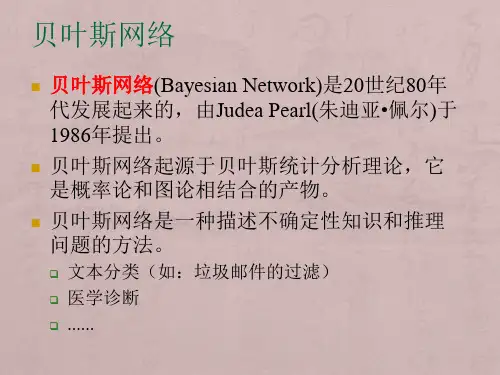

贝叶斯网络的构建方法贝叶斯网络(Bayesian Network)是一种概率图模型,用于描述变量之间的依赖关系,并在不确定条件下进行推理和决策。

它是由一组节点和有向边组成的有向无环图,其中节点表示随机变量,边表示变量间的依赖关系。

贝叶斯网络在人工智能、医学诊断、风险评估等领域有着广泛的应用。

在本文中,将介绍贝叶斯网络的构建方法。

贝叶斯网络的构建包括两个关键步骤:选择变量和建立依赖关系。

首先,需要选择与问题相关的随机变量。

这些变量可以是连续的,也可以是离散的。

在选择变量时,需要考虑问题的领域知识和实际需求,确保所选变量能够全面反映问题的特性。

其次,需要建立变量间的依赖关系。

依赖关系可以通过领域知识、数据分析或专家经验来确定。

通常情况下,可以使用条件概率表(Conditional Probability Table,CPT)来表示变量间的依赖关系。

CPT是一种用于描述变量间条件概率的表格,可通过数据分析或专家评估来确定。

贝叶斯网络的构建方法可以分为定性建模和定量建模两个阶段。

在定性建模阶段,需要确定变量间的依赖关系。

这可以通过观察变量间的相关性、专家咨询或领域知识来实现。

在确定依赖关系时,需要考虑变量之间的直接因果关系和间接影响。

在定性建模阶段,还需要确定每个节点的父节点,即直接影响该节点的变量。

通过这一步骤,可以构建出贝叶斯网络的结构。

在定量建模阶段,需要确定每个节点的条件概率表。

条件概率表用于描述给定父节点条件下,每个节点可能取值的概率分布。

确定条件概率表通常需要利用领域知识或数据分析方法。

在数据分析方法中,可以利用统计学和机器学习技术来从数据中学习变量间的依赖关系和概率分布。

通过这一步骤,可以完成贝叶斯网络的构建。

贝叶斯网络的构建还可以结合专家知识和数据分析方法。

在利用专家知识进行建模时,需要充分利用领域专家的经验和知识,确定变量间的依赖关系和条件概率表。

在利用数据分析方法进行建模时,可以利用统计学和机器学习技术,从数据中学习变量间的依赖关系和概率分布。

⾮常全⾯的贝叶斯⽹络介绍⾮常多的例⼦说明这是⼀篇关于贝叶斯⽅法的科普⽂,我会尽量少⽤公式,多⽤平⽩的语⾔叙述,多举实际例⼦。

更严格的公式和计算我会在相应的地⽅注明参考资料。

贝叶斯⽅法被证明是⾮常 general 且强⼤的推理框架,⽂中你会看到很多有趣的应⽤。

1. 历史托马斯·贝叶斯(Thomas Bayes)同学的详细⽣平在。

以下摘⼀段 wikipedia 上的简介:所谓的贝叶斯⽅法源于他⽣前为解决⼀个“逆概”问题写的⼀篇⽂章,⽽这篇⽂章是在他死后才由他的⼀位朋友发表出来的。

在贝叶斯写这篇⽂章之前,⼈们已经能够计算“正向概率”,如“假设袋⼦⾥⾯有N个⽩球,M个⿊球,你伸⼿进去摸⼀把,摸出⿊球的概率是多⼤”。

⽽⼀个⾃然⽽然的问题是反过来:“如果我们事先并不知道袋⼦⾥⾯⿊⽩球的⽐例,⽽是闭着眼睛摸出⼀个(或好⼏个)球,观察这些取出来的球的颜⾊之后,那么我们可以就此对袋⼦⾥⾯的⿊⽩球的⽐例作出什么样的推测”。

这个问题,就是所谓的逆概问题。

实际上,贝叶斯当时的论⽂只是对这个问题的⼀个直接的求解尝试,并不清楚他当时是不是已经意识到这⾥⾯包含着的深刻的思想。

然⽽后来,贝叶斯⽅法席卷了概率论,并将应⽤延伸到各个问题领域,所有需要作出概率预测的地⽅都可以见到贝叶斯⽅法的影⼦,特别地,贝叶斯是机器学习的核⼼⽅法之⼀。

这背后的深刻原因在于,现实世界本⾝就是不确定的,⼈类的观察能⼒是有局限性的(否则有很⼤⼀部分科学就没有必要做了——设想我们能够直接观察到电⼦的运⾏,还需要对原⼦模型争吵不休吗?),我们⽇常所观察到的只是事物表⾯上的结果,沿⽤刚才那个袋⼦⾥⾯取球的⽐⽅,我们往往只能知道从⾥⾯取出来的球是什么颜⾊,⽽并不能直接看到袋⼦⾥⾯实际的情况。

这个时候,我们就需要提供⼀个猜测(hypothesis,更为严格的说法是“假设”,这⾥⽤“猜测”更通俗易懂⼀点),所谓猜测,当然就是不确定的(很可能有好多种乃⾄⽆数种猜测都能满⾜⽬前的观测),但也绝对不是两眼⼀抹⿊瞎蒙——具体地说,我们需要做两件事情:1. 算出各种不同猜测的可能性⼤⼩。