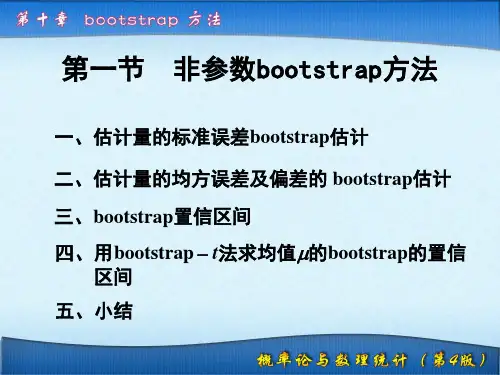

10.1 非参数bootstrap方法

- 格式:ppt

- 大小:1.93 MB

- 文档页数:39

非参数bootstrap方法

非参数bootstrap方法是一种统计学中的重采样技术,用于估计参数的分布或统计量的抽样分布。

它可以应用于各种统计学方法,包括回归分析、假设检验和置信区间估计等。

这种方法的基本思想是通过反复地从原始数据集中抽取子样本,并基于这些子样本来估计参数或统计量的分布。

每个子样本可以有放回地抽样或无放回地抽样,然后利用这些子样本来计算参数或统计量的估计值。

通过对多个子样本进行抽样和计算,可以得到参数估计值或统计量的抽样分布,从而得到参数的置信区间或进行假设检验。

非参数bootstrap方法的优点在于它不需要对数据的分布做出假设,因此适用于各种类型的数据。

它还可以提供对参数估计值或统计量的稳健性评估,可以帮助减少估计误差和提高结果的可靠性。

但是,非参数bootstrap方法的计算成本较高,尤其是对于大规模数据集来说,需要大量的计算资源和时间。

非参数统计中的Bootstrap方法详解引言非参数统计是指不对总体分布进行任何假设的统计方法,它主要用于处理那些数据不服从特定分布的情况。

Bootstrap方法是非参数统计中一种重要的方法,它能够通过对样本数据的重抽样来进行参数估计和推断,具有较高的灵活性和鲁棒性。

本文将对Bootstrap方法进行详细的介绍和解析。

Bootstrap方法的基本原理Bootstrap方法是由Bradley Efron在1979年提出的,它的基本原理是通过对样本数据的重抽样来估计总体分布的参数以及参数的置信区间。

具体来说,Bootstrap方法包括以下几个步骤:1. 从原始样本中有放回地抽取n个样本数据,构成一个新的Bootstrap样本。

2. 对Bootstrap样本进行统计量的计算,例如均值、标准差等。

3. 重复上述步骤B次(通常取B=1000),得到B个统计量的值。

4. 利用这B个统计量的值来估计总体参数的分布,并计算参数的置信区间。

Bootstrap方法的优势和适用范围相比于传统的参数估计方法,Bootstrap方法具有以下几个优势:1. 不需要对总体分布进行假设,适用范围更广。

2. 对于小样本和非正态分布的数据具有较好的效果。

3. 能够通过置信区间的构造来评估参数估计的精度。

Bootstrap方法在各种统计学问题中都得到了广泛的应用,例如在回归分析、假设检验、时间序列分析等领域都有着重要的作用。

Bootstrap方法的实际应用下面我们将通过一个具体的例子来介绍Bootstrap方法在实际应用中的使用。

假设我们有一组观测数据x1, x2, ..., xn,我们希望估计这组数据的均值以及均值的置信区间。

传统的做法是利用t分布来进行参数估计,但是在这里我们将采用Bootstrap方法来进行估计。

首先,我们从原始样本中有放回地抽取n个样本数据,构成一个新的Bootstrap样本。

然后对Bootstrap样本进行均值的计算,重复这个过程B次,得到B个均值的值。

bootstrap检验法Bootstrap检验法1. 前言假设你有一个样本数据集合,你想要知道这个数据集的某些特征(比如均值、中位数、标准差、相关系数等)是否显著不同于其它数据集的这些特征,那么你可以使用假设检验。

经典的假设检验(如t检验、ANOVA、卡方检验等)需要满足一些假设前提条件,比如正态分布、方差齐性等。

如果这些前提条件得不到满足,则假设检验的结果可能会出现误差。

Bootstrap检验法是一种非参数检验方法,不需要满足前提条件,因此可以在不确定数据分布的情况下,对统计量进行检验,从而得出更加鲁棒的结果。

本文将介绍Bootstrap检验法的原理、应用场景以及示例代码,帮助读者更好地理解和应用该检验方法。

2. 原理Bootstrap检验法基于自助法(Bootstrap)的思想。

自助法是一种经验估计的方法,它通过从原始数据集中有放回地抽取n个样本,生成一个新的数据集,重复抽样m次得到m个样本,再对这m个样本进行统计量的计算,形成该统计量分布的样本估计。

Bootstrap检验法则是基于自助法生成的m个样本估计,对所感兴趣的两个样本进行比较的非参数检验。

通常使用百分位数法进行Bootstrap检验。

该方法将两个样本生成的m 个统计量分布进行合并,计算出合并后的统计量分布的百分位数,得到该百分位数两侧的统计量分布,以此作为假设检验的P值。

3. 应用场景Bootstrap检验法可用于比较两个数据集随机变量的各种统计量,比如均值、中位数、标准差、相关系数等。

适用于以下场景:1)样本量较小的情况。

2)数据集分布无法确定的情况。

3)数据集不满足方差齐性等前提条件的情况。

4. 示例代码以下代码演示如何使用Python的Scipy库进行Bootstrap检验:```pythonfrom scipy import statsimport numpy as np# 生成两个不同分布的样本数据集data1 = stats.norm.rvs(loc=2, scale=1, size=100)data2 = stats.norm.rvs(loc=3, scale=1, size=50)# 计算两个样本的均值差值diff_mean = np.mean(data1) - np.mean(data2)# 执行自助抽样n=10000次num_samples = 10000diff_mean_samples = np.empty(num_samples)for i in range(num_samples):bootstrap1 = np.random.choice(data1, size=100, replace=True)bootstrap2 = np.random.choice(data2, size=50, replace=True)diff_mean_samples[i] = np.mean(bootstrap1) - np.mean(bootstrap2)# 计算Bootstrap检验的p值p_value = (np.sum(diff_mean_samples >= diff_mean) +np.sum(diff_mean_samples <= -diff_mean)) / num_samplesprint('Bootstrap检验的p值为:', p_value)```上述代码中,首先生成了两个不同的数据集`data1`和`data2`,分别对应了两个分布。

python建模非参数bootstrap方法非参数bootstrap方法是一种基于重采样的统计方法,可以用于估计统计量的置信区间以及假设检验。

在Python中,可以使用scikit-learn和statsmodels等库来实现非参数bootstrap方法。

首先,我们需要导入必要的库和数据集。

下面是一个示例数据集,用于说明如何使用非参数bootstrap方法:```pythonimport numpy as npimport seaborn as sns# 生成示例数据np.random.seed(42)x = np.random.normal(loc=0, scale=1, size=100)```接下来,我们可以使用scikit-learn库中的`bootstrap`函数进行bootstrap重采样。

`bootstrap`函数的第一个参数是要重采样的数据,第二个参数是重采样的次数,可以通过`n_iter`参数指定。

以下是示例代码:```pythonfrom sklearn.utils import resample# 定义bootstrap函数def bootstrap(data, n_iter):bootstrap_resample = resample(data, replace=True,n_samples=n_iter)return bootstrap_resample```在进行统计量的估计时,一种常见的方法是计算重采样样本的均值或中位数。

以下是一个示例,展示了如何使用`bootstrap`函数来计算数据集重采样的均值:```python# 计算重采样样本的均值boot_means = [bootstrap(x, 100).mean() for _ in range(1000)]# 绘制均值的直方图sns.histplot(boot_means, kde=True)```另一种常见的应用是计算统计量的置信区间。

Bootstrap方法是一种常用的非参数统计方法,它的原理和应用十分广泛。

在本文中,我们将详细介绍Bootstrap方法的原理和应用,以帮助读者更好地理解和运用这一方法。

Bootstrap方法的核心思想是通过重复抽样的方式,利用样本数据来估计总体参数或统计量的抽样分布。

它的应用领域非常广泛,可以用于估计总体参数的置信区间、假设检验、回归分析等统计问题。

Bootstrap方法的优点在于不需要对总体分布进行严格的假设,适用于各种类型的数据。

首先,我们来看看Bootstrap方法的原理。

假设我们有一个样本数据集,我们希望估计其中的某个参数的抽样分布。

传统的方法是基于总体分布的假设,使用统计理论进行推导。

而Bootstrap方法则是通过重复抽样的方式,从样本数据中生成一系列的“虚拟样本”,然后利用这些虚拟样本来估计参数的抽样分布。

具体来说,Bootstrap方法包括以下几个步骤:1. 从原始样本中有放回地抽取若干个数据点,构成一个新的虚拟样本。

2. 利用这个虚拟样本来计算参数或统计量的值。

3. 重复上述步骤很多次,得到一系列参数或统计量的值。

4. 根据这些值来估计参数或统计量的抽样分布。

通过这种方法,我们可以得到总体参数或统计量的抽样分布,从而进行置信区间估计、假设检验等统计推断。

接下来,我们来看看Bootstrap方法的应用。

首先,Bootstrap方法可以用于估计总体参数的置信区间。

假设我们需要估计总体均值的置信区间,传统的方法是基于总体分布的假设,使用t分布进行推断。

而Bootstrap方法则是通过生成虚拟样本来估计均值的抽样分布,从而得到置信区间。

这种方法在样本容量较小或总体分布非正态的情况下特别有用。

此外,Bootstrap方法还可以用于假设检验。

假设我们需要检验两个总体均值是否相等,传统的方法是使用t检验。

而Bootstrap方法则是通过生成虚拟样本来估计两个均值的差异,从而进行假设检验。

这种方法在总体分布非正态或方差不齐的情况下特别有用。

Bootstrap 方法简介1 Bootstrap 抽样方法Bootstrap 方法是Efron 在 1977 年提出的一种数据处理方法,其本质上是对已知数据的再抽样。

Bootstrap 的数学原理大致如下:1(,,)n T T T =是来自总体分布函数为()F T 的独立同分布随机样本。

()n F T 是由样本T 得到的分布函数(在产品可靠性分析中,()n F T 一般是指数函数或多参数weibull 函数),由()n F T 得到的参数估计ˆˆ()F θθ=,它可以作为样本参数θ的准确值。

再从新总体()nF T 中抽取与样本T 相同的伪样本1(,,)m m T T T =,一般取m n =。

用伪样本m T 求出参数θ的估计值。

重复操作M 次(一般取1000M =)可得到M 个基于伪样本m T 而得到的θ估计值[4]。

Bootstrap 方法在应用中,重复抽样带来的误差不可避免。

误差主要来源于样本数据的抽样误差和从样本分布中的再抽样误差。

对于再抽样误差,只要 Bootstrap 再抽样样本数充分大,由样本分布所得的再抽样误差就会趋于消失,Bootstrap 估计的所有误差就会接近于抽样误差[5] 。

Bootstrap 方法根据抽样方式的不同可分为参数和非参数两种。

非参数方法主要用于在不知道抽样函数服从什么分布情况下,对经验分布不做过多的假设,把试验数据按从小到大排序获得经验分布,然后从中抽取伪样本的一种方法;参数方法主要用于经验分布已知情况下,当试验数据分布明确时,运用参数方法比运用非参数方法效率更高[6]。

由于多方面的原因,使得收集到的故障间隔时间数据中常含有分离群数据,这些数据会导致估计精度降低。

但是,对于高可靠度的现代机电产品来说收集到的每一个数据都来之不易,所以不易轻易舍去。

因此,可以应用改进的参数 Bootstrap 方法,具体过程如下:(1) 将试验样本数据12(,,,)n X X X X =从小到大排序,每次从中去掉一个样本 i X ,剩下1n -个样本用传统方法建模,得出样本分布函数(1)()n i F T -的估计参数值ˆm 和ˆη。

非参数统计中的Bootstrap方法详解引言统计学是一门研究数据收集、分析、解释和呈现的学科,而非参数统计学是统计学中的一个重要分支,它主要研究与总体分布函数的形式无关的统计方法。

Bootstrap方法是非参数统计学中的一种重要方法,它通过对原始数据的重抽样来估计总体参数的分布,为我们提供了一种全新的统计推断方法。

本文将详细介绍Bootstrap方法的原理、应用和局限性。

Bootstrap方法的原理Bootstrap方法是由Bradley Efron在1979年引入统计学领域的,它的核心思想是基于原始样本数据进行重抽样,从而得到大量的样本数据集,然后利用这些重抽样样本数据集来估计总体参数的分布。

具体而言,假设我们有一个包含n个观测值的样本数据集X={x1,x2,...,xn},我们希望估计总体参数θ的分布。

Bootstrap方法的原理如下:1. 从样本数据集X中有放回地抽取n个观测值,组成一个新的重抽样样本数据集X*;2. 利用重抽样样本数据集X*来估计总体参数θ;3. 重复步骤1和步骤2,得到B个重抽样样本数据集X*1,X*2,...,X*B;4. 根据B个重抽样样本数据集X*1,X*2,...,X*B的估计结果,得到总体参数θ的分布。

Bootstrap方法的应用Bootstrap方法在统计学中有着广泛的应用,特别是在参数估计、假设检验和置信区间估计等方面。

下面我们将详细介绍Bootstrap方法在这些方面的应用。

1. 参数估计在传统的参数估计方法中,我们通常会假设总体的分布形式,并根据假设的分布形式来估计总体参数。

然而,在实际应用中,我们往往并不清楚总体的分布形式,这时就可以利用Bootstrap方法来进行参数估计。

通过对重抽样样本数据集的估计结果,我们可以得到总体参数的估计值和标准误差,从而更加准确地估计总体参数。

2. 假设检验假设检验是统计学中常用的推断方法之一,它用于检验样本数据是否来自某个特定的总体分布。

python建模非参数bootstrap方法Python建模非参数Bootstrap方法引言在统计学和机器学习领域中,Bootstrap方法是一种常用的非参数统计方法,它通过从原始数据集中有放回地抽取样本,生成大量的重抽样数据集,用于估计参数的分布、解释模型和评估预测的不确定性。

Python提供了许多库和工具,可以方便地实现Bootstrap方法。

Bootstrap方法的基本思想Bootstrap方法的基本思想是通过重采样的方法构建大量的样本,以模拟从总体中独立抽取样本的过程。

具体而言,Bootstrap方法有以下几个步骤:1.从原始数据集中有放回地抽取样本,形成一个新的样本,大小与原始数据集相同。

2.重复第一步的操作,生成大量的重采样数据集。

3.使用每个重采样数据集进行建模、预测或评估。

4.对于得到的多个结果,可以计算均值、方差或置信区间等统计量,用于对参数估计、模型解释和预测不确定性进行推断。

Python库中的Bootstrap方法实现在Python中,有几个常用的库和工具可以用于实现Bootstrap方法,下面介绍其中的几个:1. NumPyNumPy是Python中一个重要的科学计算库,它可以用于数组操作、线性代数和随机数生成等。

使用NumPy可以方便地实现Bootstrap方法的抽样步骤,例如使用()函数实现有放回抽样。

2. Scikit-learnScikit-learn是一个强大的机器学习库,提供了许多常用的机器学习算法和模型评估方法。

Scikit-learn中的BaggingRegressor和BaggingClassifier类实现了基于Bootstrap方法的模型集成算法,可以用于回归和分类问题。

3. StatsmodelsStatsmodels是一个统计分析库,提供了许多统计模型和方法的实现。

Statsmodels中的bootstrapped()函数可以用于执行Bootstrap方法,例如可以使用该函数计算线性回归模型的置信区间。

非参数统计中的Bootstrap方法详解随着数据科学和统计学的发展,非参数统计方法在实际应用中越来越受到重视。

Bootstrap方法作为一种非参数统计方法,被广泛应用于参数估计、假设检验、置信区间估计等领域。

本文将详细介绍Bootstrap方法的原理、应用和局限性。

1. Bootstrap方法的原理Bootstrap方法是由美国统计学家Bradley Efron在20世纪70年代提出的。

它的基本思想是通过重复抽样的方法,利用原始样本数据来估计总体的统计特征。

具体而言,Bootstrap方法分为两个步骤:第一步是重复抽样。

假设我们有一个包含n个样本的总体数据集,我们可以通过有放回地随机抽取n个样本,形成一个新的样本数据集。

重复这个过程B次,我们就可以得到B个样本数据集。

第二步是利用重复抽样得到的样本数据集进行统计推断。

对于每一个新的样本数据集,我们可以计算出所关心的统计量,如均值、方差、中位数等。

然后,利用这B个统计量构成的样本分布,来估计总体的统计特征,如总体均值、总体方差等。

通过这种方法,Bootstrap可以在不假设总体分布形式的情况下,对总体的统计特征进行估计和推断。

2. Bootstrap方法的应用Bootstrap方法在统计学中有着广泛的应用,尤其在参数估计和置信区间估计方面。

以参数估计为例,假设我们想要估计总体的均值。

通过Bootstrap方法,我们可以利用重复抽样得到的样本数据集,计算出每个样本数据集的均值,并利用这些均值构成的样本分布,来估计总体的均值及其置信区间。

此外,Bootstrap方法还可以应用于假设检验、回归分析等领域。

在实际应用中,由于Bootstrap方法的灵活性和无需假设总体分布的特点,越来越受到数据科学家和统计学家的青睐。

3. Bootstrap方法的局限性尽管Bootstrap方法在非参数统计中有着广泛的应用,但它也存在一些局限性。

首先,Bootstrap方法对原始样本数据的质量要求较高,如果原始样本数据存在较大的偏差或异常值,可能会影响Bootstrap方法的估计结果。

在统计学中,Bootstrap方法是一种用于估计统计量的非参数统计方法。

它的提出和发展为统计学领域带来了重大的影响,成为了一种常用的统计分析工具。

本文将详细介绍Bootstrap方法的原理、应用和相关概念,以及在实际问题中的应用。

Bootstrap方法最早由Bradley Efron于1979年提出,它的核心思想是通过对样本数据的重抽样,来估计总体的分布以及统计量的性质。

这种方法的优势在于不需要对总体分布做出假设,尤其适用于小样本情况下的统计推断。

通过不断地重抽样和计算得到的统计量,可以得到统计量的抽样分布,从而对总体分布和统计量进行估计和推断。

在Bootstrap方法中,首先需要从原始样本中进行有放回的重抽样,得到和原始样本大小相同的重抽样集合。

然后利用这些重抽样数据集合来估计统计量,例如均值、方差等。

通过重复这一过程,可以得到大量的估计值,从而得到统计量的抽样分布。

最终可以利用这些抽样分布对总体分布的性质进行估计,以及对统计量的置信区间和假设检验进行推断。

Bootstrap方法在实际应用中有着广泛的应用。

例如在金融领域,利用Bootstrap方法可以对股票收益率的分布进行估计,从而对风险进行评估。

在医学研究中,Bootstrap方法可以用来对患者的生存时间进行推断。

在工程领域,Bootstrap方法可以用来对数据的不确定性进行分析。

总之,Bootstrap方法在各个领域都有着重要的应用价值,成为了一种强大的统计分析工具。

除了介绍Bootstrap方法的原理和应用,我们还需要了解一些相关的概念。

首先是自助样本(bootstrap sample),即通过有放回的重抽样得到的新样本。

其次是统计量(statistic),即对样本数据进行运算得到的数值,例如样本均值、样本方差等。

另外还有抽样分布(sampling distribution),即统计量在不同抽样情况下的分布。

了解这些相关概念,对深入理解Bootstrap方法的原理与应用至关重要。

python建模非参数bootstrap方法【原创版4篇】目录(篇1)1.引言2.Python 建模概述3.非参数 bootstrap 方法原理4.非参数 bootstrap 方法在 Python 建模中的应用5.总结正文(篇1)1.引言在数据分析和建模领域,Python 作为一门广泛使用的编程语言,其各种强大的库和工具受到了广大数据分析师和建模者的喜爱。

Python 建模主要是利用 Python 的相关库和工具进行数据分析、数据可视化以及建立模型等,以便对数据进行更好地理解和预测。

本文将介绍 Python 建模中的非参数 bootstrap 方法。

2.Python 建模概述Python 建模是通过 Python 编程语言,利用其丰富的库和工具,如NumPy、Pandas、Scikit-learn 等,对数据进行处理、分析和建立模型,从而对数据进行预测和解释。

Python 建模主要包括数据预处理、数据可视化、特征工程、模型选择和评估、模型优化等步骤。

3.非参数 bootstrap 方法原理非参数 bootstrap 方法是一种基于样本数据本身的统计方法,它不需要对数据分布进行任何假设,也不需要知道具体的参数形式。

其主要思想是在原始数据集的基础上,通过重复抽样和计算,得到一系列的样本统计量,然后对这些统计量进行统计推断,从而得到对总体参数的估计。

非参数 bootstrap 方法主要包括三种:自助法、替换法和 Mallows 法。

4.非参数 bootstrap 方法在 Python 建模中的应用在 Python 建模中,非参数 bootstrap 方法可以应用于各种数据分布的假设检验和参数估计。

具体操作主要通过 Scipy.stats 库和statsmodels.formula.api 库进行。

例如,在假设检验中,可以使用非参数 bootstrap 方法进行 Kolmogorov-Smirnov 检验和 Shapiro-Wilk 检验等。

Bootstrap方法是一种用于估计统计量抽样分布的非参数统计方法。

它是由Bradley Efron在1979年提出的,被广泛应用在统计学、计量经济学、金融学等领域。

Bootstrap方法的原理和应用十分复杂,本文将对Bootstrap方法进行详细的解析。

Bootstrap方法的基本原理是通过重抽样的方法来估计统计量的抽样分布。

传统的统计方法通常基于对总体分布的假设,如正态分布、均匀分布等,然后利用这个假设对抽样分布进行估计。

而Bootstrap方法则不依赖于总体分布的假设,而是直接利用样本数据进行分析。

在Bootstrap方法中,我们首先从原始样本数据中随机抽取一定数量的样本,然后对这些抽样数据进行统计量的计算。

这个过程被称为“重抽样”。

重抽样的次数通常大于等于1000次,以确保估计的准确性。

通过对重抽样得到的统计量进行排序,我们可以得到统计量的抽样分布,从而进行置信区间估计、假设检验等统计推断。

Bootstrap方法的一个重要特点是对原始样本数据的利用效率非常高。

传统的参数统计方法通常需要对总体分布作出假设,并且需要满足一定的分布形式和参数条件。

而Bootstrap方法则可以直接利用样本数据进行分析,不需要对总体分布作出过多的假设。

另一个重要特点是Bootstrap方法对于各种统计量的估计都是一致的。

无论是均值、方差、中位数、相关系数等统计量,都可以通过Bootstrap方法进行估计。

这使得Bootstrap方法在实际应用中具有非常广泛的适用性。

除了对统计量的估计,Bootstrap方法还可以用于模型选择、预测等领域。

在模型选择中,我们可以通过Bootstrap方法对不同模型的性能进行比较,从而选择最优的模型。

在预测中,Bootstrap方法可以通过对样本数据的重抽样来估计预测误差的分布,从而提高预测的准确性。

然而,虽然Bootstrap方法具有诸多优点,但也存在一定的局限性。

首先,在样本量较小的情况下,Bootstrap方法的估计可能不够稳健。

bootstrap法Bootstrap法,也称为自助法,是一种统计学方法,用于估计样本数据的统计量和置信区间。

它的主要思想是通过从样本中重复抽取数据来创建新的样本集,从而获得对总体的估计。

Bootstrap法最早由布莱曼(Bradley Efron)在1979年提出,是一种非参数统计方法。

它的优点是可以用于任何类型的数据,包括连续型、离散型、偏态分布等。

由于它的普适性和易于实现,Bootstrap 法已经成为了统计学中常用的方法之一。

Bootstrap法的基本思想是:根据已有的样本数据,进行有放回的抽样,得到与原始样本数据大小相等的新样本。

这个过程重复进行n次,得到n个新样本。

对于每个新样本,我们可以计算出所关心的统计量(如均值、方差、中位数等)的值,从而得到n个统计量。

这些统计量的分布就是原始样本数据中该统计量的抽样分布,可以用于估计总体的统计量。

Bootstrap法的具体步骤如下:1. 从原始样本中有放回地抽取n个样本,得到新样本集。

2. 对新样本集进行统计分析,得到所关心的统计量的值。

3. 重复步骤1和2,得到n个统计量的值。

4. 根据n个统计量的值,计算出该统计量的抽样分布,从而得到估计值和置信区间。

Bootstrap法的优点在于,它不需要假设数据服从特定的分布,也不需要对数据进行任何假设检验。

它可以处理大部分数据类型,包括缺失数据和异常值。

此外,Bootstrap法还可以用于估计参数的标准误差、评估模型的预测误差等。

但是,Bootstrap法也存在一些限制。

由于需要进行大量的重复抽样,计算量较大,需要较长的计算时间。

此外,当样本数据较少时,Bootstrap法可能会出现样本抽取中的偏差,导致估计结果不准确。

总之,Bootstrap法是一种简单、直观、普适性强的统计学方法,可以用于估计总体的各种统计量,并提供置信区间。

在实际应用中,Bootstrap法已经被广泛应用于生物统计、金融风险管理、质量控制等领域。

非参数百分位 bootstrap 法引言:统计学中经常需要对数据进行分析和推断,而百分位数是其中一个重要的统计量。

然而,当数据并不满足某种特定的分布假设时,传统的参数方法可能不再适用。

在这种情况下,非参数方法成为了一种有效的解决方案。

本文将介绍一种常用的非参数方法——百分位bootstrap 法,并讨论其原理和应用。

一、百分位 bootstrap 法的原理百分位bootstrap 法是一种用于估计百分位数的统计方法。

它通过对原始数据进行重复抽样来模拟总体分布,进而得到百分位数的估计值。

具体而言,百分位 bootstrap 法的步骤如下:1. 从原始数据中有放回地随机抽取一部分样本;2. 计算抽取样本的百分位数;3. 重复步骤1和2多次,得到一系列百分位数的估计值;4. 根据这些估计值计算百分位数的置信区间。

二、百分位 bootstrap 法的应用百分位bootstrap 法在统计学中有广泛的应用。

下面我们以一个实例来说明其具体应用。

假设我们有一组数据,表示某个城市每天的气温。

我们想要估计这个城市的第90百分位数,即90%的日子里气温低于多少度。

传统的参数方法在这里可能不适用,因为气温的分布往往不满足正态分布假设。

我们从原始数据中随机抽取一部分样本,假设抽取了100个样本。

然后,我们计算这100个样本的第90百分位数。

重复这个过程多次,比如重复1000次,我们就得到了1000个第90百分位数的估计值。

接下来,我们可以使用这些估计值来计算百分位数的置信区间。

常见的方法是使用百分位法,即按照一定的置信水平,比如95%,确定上下两个百分位数,这样得到的区间就是我们所要求的置信区间。

三、百分位 bootstrap 法的优势百分位 bootstrap 法相较于传统的参数方法具有一些优势。

百分位bootstrap 法不需要对数据的分布做出具体的假设,因此更加灵活。

在实际应用中,很多数据并不满足正态分布等常见的假设,而百分位 bootstrap 法能够很好地应对这种情况。

Bootstrap方法的原理Bootstrap方法是一种统计学中常用的非参数统计方法,用于估计统计量的抽样分布。

它的原理是通过从原始样本中有放回地抽取大量的重复样本,然后利用这些重复样本进行统计推断。

Bootstrap方法的原理可以分为以下几个步骤:1. 抽样:从原始样本中有放回地抽取大量的重复样本。

假设原始样本有n个观测值,每次抽样时,从n个观测值中随机选择一个观测值,并将其放回原始样本中,使得下一次抽样时该观测值仍有可能被选中。

2. 统计量计算:对于每个重复样本,计算所关心的统计量。

统计量可以是均值、中位数、方差等,具体根据问题的需求而定。

3. 重复抽样:重复步骤1和步骤2,得到大量的重复样本和对应的统计量。

4. 统计推断:利用重复样本得到的统计量进行统计推断。

可以计算统计量的置信区间、假设检验等。

Bootstrap方法的原理基于以下两个假设:1. 原始样本是总体的一个无偏样本。

这意味着原始样本是从总体中随机抽取的,且样本的分布与总体的分布相同。

2. 重复样本是总体的一个无偏样本。

这意味着重复样本是从总体中随机抽取的,且样本的分布与总体的分布相同。

Bootstrap方法的优点是可以在不知道总体分布的情况下进行统计推断。

它不依赖于总体分布的假设,而是通过重复抽样来模拟总体分布。

因此,Bootstrap方法在小样本情况下尤为有用,可以提供更准确的统计推断结果。

然而,Bootstrap方法也有一些限制和注意事项:1. 样本量的选择:Bootstrap方法对样本量要求较高,通常要求样本量较大才能得到可靠的结果。

当样本量较小时,Bootstrap方法可能会产生较大的估计误差。

2. 依赖于原始样本:Bootstrap方法的结果依赖于原始样本的分布。

如果原始样本不具有代表性或存在较大的偏差,那么Bootstrap 方法的结果可能会失真。

3. 计算复杂度:由于需要进行大量的重复抽样和统计量计算,Bootstrap方法的计算复杂度较高。