平均互信息量和各种熵关系

- 格式:ppt

- 大小:214.00 KB

- 文档页数:24

第一章绪论1、什么是信息?香农对于信息是如何定义的。

答:信息是事物运动状态或存在方式的不确定性的描述(Informationisameasureofone'sfreedomofchoicewhenoneselectsamessage )。

2、简述通信系统模型的组成及各部分的含义。

第二章信息的度量2.1自信息和互信息1、自信息(量):(1)、定义:一个事件(消息)本身所包含的信息量,它是由事件的不确定性决定的。

某个消息i x出现的不确定()()()i i i x p x p x I 1loglog =-=性的大小定义为自信息,用这个消息出现的概率的对数的负值来表示: (2)、性质:①、()i x I是()i x p 的严格递减函数。

当()()21x p x p <时()()21x I x I >概率越小,事件发生的不确定性越大,事件发生以后所包含的自信息量越大。

②、极限情况下,当()0=i x p 时()∞→i x I ;当()1=i x p 时,()0→i x I 。

(8)、上凸性: 3、联合熵:联合自信息的 数学期望。

它是二维随机 变量XY 的不确定性的度量。

4、条件熵:5、各类熵之间的关系: 21111()()()()log ()n m n mi j i j i j i j i j i j H XY p x y I x y p x y p x y ======-∑∑∑∑22(/)(/)X Y (/X)()log(/) (X /)()log (/)i i i ijj i i j i j ijijx H Y x H Y x H Y p x y p y x H Y p x y p x y =-=-∑∑∑∑由于不同的,是变化的,对的所有可能值进行统计平均,就得出给定时,的条件熵122()n n n n1212[(1)]()(1)()f x x f x f x λλλλ+-≥+-(1)、联合熵与信息熵、条件熵之间的关系:)/()()(X Y H X H XY H +=。

熵,条件熵,相对熵,互信息的相关定义及公式推导

熵,条件熵,相对熵,互信息的相关定义及公式推导

熵是随机变量不确定性的度量,不确定性越⼤,熵值越⼤,若随机变量退化成定值,熵为0,均匀分布是最不确定的分布。

熵其实定义了⼀个函数(概率分布函数)到⼀个值(信息熵)的映射。

熵的定义公式如下:

在经典熵的定义中,底数是2,此时熵的单位是bit,若底数是e,则熵的单位是nat(奈特)

两个随机变量X, Y的联合分布,可以形成联合熵Joint Entropy,⽤H(X,Y)表⽰,那么我们不禁要问:H(X,Y) - H(Y)代表什么呢?

事实上,(X,Y)发⽣所包含的熵,减去Y单独发⽣包含的熵,在Y发⽣的前提下,X发⽣的新带来的熵。

于是有了条件熵:H(X|Y)的定义:

下⾯是条件熵的推导公式:

相对熵,⼜称为互熵,交叉熵,鉴别信息,KL散度,假设p(x), q(x)是X中取值的两个概率分布,则p对q的相对熵是:

对于相对熵,可以度量两个随机变量的距离,⼀般的p对q的相对熵和q对p的相对熵不相等。

对于已知的随机变量p,要使得相对简单的随机变量q,尽量接近p,那么我们可以采⽤相对熵进⾏求解:

假定使⽤KL(Q||P),为了让距离最⼩,则要求在P为0的地⽅,Q尽量为0。

会得到⽐较“窄”的分布曲线;

假定使⽤KL(P||Q),为了让距离最⼩,则要求在P不为0的地⽅,Q也尽量不为0。

会得到⽐较“宽”的分布曲线;

互信息

两个随机变量X,Y的互信息,定义为X,Y的联合分布和独⽴分布乘积的相对熵。

对于互信息,我们可以有如下的推导公式:。

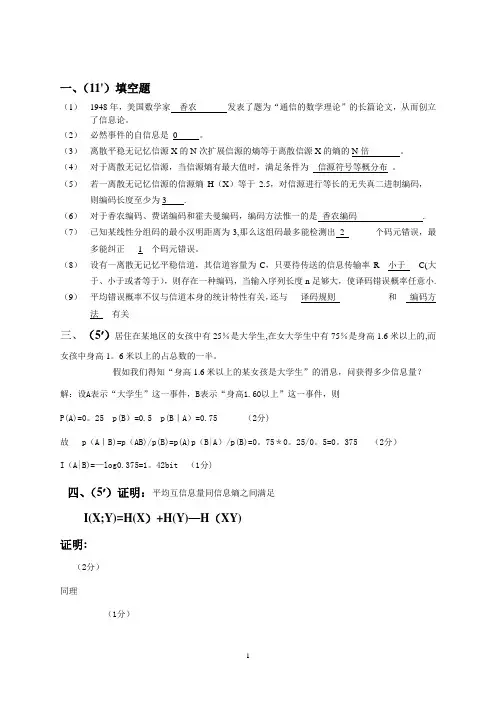

一、(11')填空题(1)1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

(2)必然事件的自信息是0 。

(3)离散平稳无记忆信源X的N次扩展信源的熵等于离散信源X的熵的N倍。

(4)对于离散无记忆信源,当信源熵有最大值时,满足条件为__信源符号等概分布_。

(5)若一离散无记忆信源的信源熵H(X)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为3 .(6)对于香农编码、费诺编码和霍夫曼编码,编码方法惟一的是香农编码. (7)已知某线性分组码的最小汉明距离为3,那么这组码最多能检测出_2_______个码元错误,最多能纠正___1__个码元错误。

(8)设有一离散无记忆平稳信道,其信道容量为C,只要待传送的信息传输率R__小于___C(大于、小于或者等于),则存在一种编码,当输入序列长度n足够大,使译码错误概率任意小. (9)平均错误概率不仅与信道本身的统计特性有关,还与___译码规则____________和___编码方法___有关三、(5')居住在某地区的女孩中有25%是大学生,在女大学生中有75%是身高1.6米以上的,而女孩中身高1。

6米以上的占总数的一半。

假如我们得知“身高1.6米以上的某女孩是大学生”的消息,问获得多少信息量?解:设A表示“大学生”这一事件,B表示“身高1.60以上”这一事件,则P(A)=0。

25 p(B)=0.5 p(B|A)=0.75 (2分)故 p(A|B)=p(AB)/p(B)=p(A)p(B|A)/p(B)=0。

75*0。

25/0。

5=0。

375 (2分)I(A|B)=—log0.375=1。

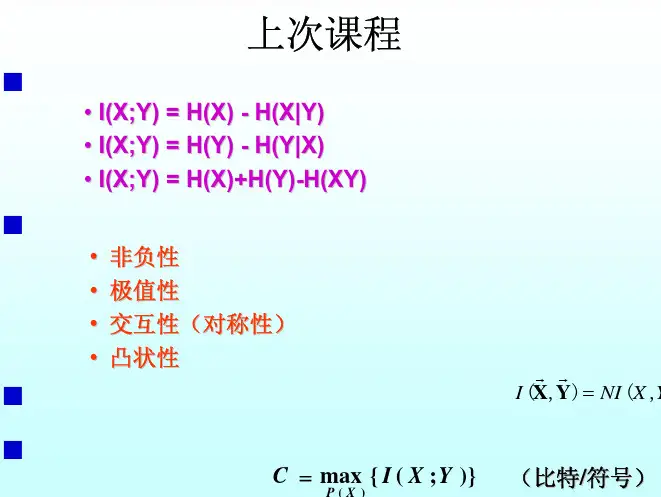

42bit (1分)四、(5')证明:平均互信息量同信息熵之间满足I(X;Y)=H(X)+H(Y)—H(XY)证明:(2分)同理(1分)则因为(1分)故即(1分)五、(18’)。

黑白气象传真图的消息只有黑色和白色两种,求:1)黑色出现的概率为0。

一、填空题1.设信源X 包含4个不同离散消息,当且仅当X 中各个消息出现的概率为___Pi=1/4___时,信源熵达到最大值,为__2bit_,此时各个消息的自信息量为____2bit_______。

2.如某线性分组码的最小汉明距dmin=4,则该码最多能检测出___3_____个随机错,最多能 纠正___INT(1.5)__个随机错。

3.克劳夫特不等式是唯一可译码___存在___的充要条件。

4.平均互信息量I(X;Y)与信源熵和条件熵之间的关系是_I (X :Y )=H (X )-H (X/Y )5.__信源__编码的目的是提高通信的有效性,_信道_编码的目的是提高通信的可靠性,__加密__编码的目的是保证通信的安全性。

6.信源编码的目的是提高通信的 有效性 ,信道编码的目的是提高通信的 可靠性 ,加密编码的目的是保证通信的 安全性 。

7.设信源X 包含8个不同离散消息,当且仅当X 中各个消息出现的概率为__1/8_____时,信 源熵达到最大值,为___3bit/符号_________。

8.自信息量表征信源中各个符号的不确定度,信源符号的概率越大,其自信息量越__小____。

9.信源的冗余度来自两个方面,一是信源符号之间的_相关性__,二是信源符号分布的 __不均匀性___。

10.最大后验概率译码指的是 译码器要在已知r 的条件下找到可能性最大的发码Ci 作为移码估值 。

11.常用的检纠错方法有__前向纠错__、反馈重发和混合纠错三种。

二、单项选择题1.下面表达式中正确的是( A )。

A.∑=ji j x y p 1)/( B.∑=ii j x y p 1)/(C.∑=jj j i y y x p )(),(ω D.∑=ii j i x q y x p )(),(2.彩色电视显像管的屏幕上有5×105个像元,设每个像元有64种彩色度,每种彩度又有16种不同的亮度层次,如果所有的彩色品种和亮度层次的组合均以等概率出现,并且各个组合之间相互独立。

第3章 信道模型和信道容量3.1 基本要求通过本章学习,了解信道的模型和分类,掌握信道容量的定义,掌握无噪信道、对称信道的信道容量的计算,了解准对称信道信道容量的计算,了解一般离散无记忆信道(DMC )达到信道容量的充要条件,掌握DMC 扩展信道的信道容量计算,了解加性高斯噪声信道的信道容量的结论,掌握香农信道容量公式。

3.2 学习要点3.2.1 信道的分类信道是信息传输的通道。

研究信道的目的,主要是为了描述和分析各种不同类型信道的特性,度量其信息的极限传输能力。

信息理论中常用的信道分类方法如下。

(1)根据信道输入/输出信号在时间和幅值上的取值是离散或连续来划分,可分为4类,如表3.1所示。

(2)根据信道的记忆特性划分,可分为2类:无记忆信道:信道当前的输出只与当前的输入有关。

有记忆信道:信道当前的输出不但与当前的输入有关,还与当前时刻以前的输入有关。

(3)根据信道的输入/输出关系是确定关系还是统计依存关系划分,可分为2类: 无噪声信道:信道的输入/输出关系是确定关系。

有噪声信道:信道的输入/输出关系是统计依存关系。

3.2.2 信道的数学模型3.2.2.1 离散无记忆信道(DMC )的数学模型离散无记忆信道(DMC )的数学模型如图3.1所示,记为|{,,}Y X X P Y 。

信道的输入X 取值于集合12{,,,}r A a aa = ,输出Y 取值于集合12{,,,}s Bb b b = 。

|{(|)|1,2,,;1,2,,}Y X j i P P b a i r j s === (3.1) 为分析计算方便,常常把所有转移概率排成矩阵:图3.1 离散无记忆信道(DMC )模型示意图噪声干扰12112111122222|12(|)(|)(|)(|)(|)(|)[](|)(|)(|)ss s Y X r r s r rb b b P b a P b a P b a a P b a P b a P b a a P P b a P b a P b a a ⎡⎤⎢⎥⎢⎥=⎢⎥⎢⎥⎢⎥⎣⎦(3.2) 转移矩阵中各行s 个转移概率自身是完备的:1(|)1,1,2,,sji j P ba i r ===∑ (3.3)3.2.2.2 扩展信道的数学模型图3.2所示的是N 次扩展信道的模型,其输入和输出均为N 元随机变量序列。