最小二乘法

- 格式:doc

- 大小:657.50 KB

- 文档页数:15

最小二乘法定义最小二乘法(Least Squares Method,简称LS)是指在数学中一种最常见的数据拟合方法,它是一种统计学意义上的估计方法,用来找出未知变量和已知变量之间的关系,其中模型参数是通过最小化数据集误差的平方和来估计的。

一、定义:最小二乘法(Least Squares Method)是指在数学中最常见的数据拟合方法,它是一种统计学意义上的估计方法,用来确定未知变量与已知变量之间的关系,其中模型参数是通过最小化数据集误差的平方和来估计的。

二、基本原理:最小二乘法的基本原理是利用数据点与一个被称为“模型函数”的预设函数之间的差异,来从中估计出模型函数的参数。

具体来说,这一差异可以以误差的平方和来衡量,最小二乘法就是最小这一平方和的方法。

三、步骤:1. 构造未知变量的模型函数,其中当需要拟合的参数数目大于等于给定数据点的个数时,就会导致一定的形式多项式模型函数有正解;2. 求解模型函数的最小平方误差的最优解,即求解参数的数值;3. 根据最优解找出最小平方误差的值;4. 对模型函数进行评价,判断是否尽可能地满足数据点;5. 若满足,则用找出的模型函数来预报未来的参数变化情况。

四、应用:1. 拟合统计图形:通过最小二乘法,可以得到曲线拟合的参数,绘制出统计图形的曲线,用来剖析统计数据;2. 回归分析:可以用最小二乘法预测变量和另一变量之间的关系,如:股票收益与股价价格之间的关系,从而得到有用的分析结果;3. 模型拟合:最小二乘法可以估计精确数据模型参数,这些模型参数可与实验数据相同;4. 图像分析:最小二乘法可用于分析图像特征,如:平面图像的特征提取与比较,目标图像分类,等;5. 信号处理:最小二乘法的应用也可扩展到信号处理领域,用该方法对信号和噪声之间的关系进行拟合,来消除信号中的噪声。

最小二乘法1. 概念定义最小二乘法(Least Squares Method)是一种数学优化方法,用于找到一组参数,使得观测数据与模型预测值之间的平方误差最小。

它通过对误差的平方和进行最小化来估计未知参数的值。

在最小二乘法中,我们假设存在一个线性模型来描述观测数据与未知参数之间的关系。

给定n个观测数据点(xi, yi),其中xi是自变量,yi是因变量,我们可以将线性模型表示为:yi = β0 + β1 * xi + εi其中β0和β1是待估计的未知参数,εi是服从正态分布的随机误差。

我们的目标是找到最佳拟合线,使得所有数据点到该线的距离之和最小。

2. 重要性最小二乘法在统计学和数据分析中具有广泛应用,并且具有以下重要性:2.1 参数估计通过最小二乘法可以估计出线性回归模型中的未知参数。

这些参数对于理解和解释观测数据与自变量之间关系非常重要。

例如,在经济学中,可以使用最小二乘法来估计供需曲线、收入弹性等经济模型中的参数。

2.2 模型拟合最小二乘法可以用于拟合数据,并找到最佳拟合线或曲线。

通过最小化误差平方和,我们可以找到与观测数据最接近的模型。

这对于预测和预测未来数据点非常有用。

2.3 假设检验在统计推断中,最小二乘法还可以用于假设检验。

我们可以利用最小二乘估计的参数进行假设检验,以确定自变量与因变量之间是否存在显著关系。

2.4 模型诊断除了参数估计和模型拟合外,最小二乘法还可以用于诊断模型的适应性和有效性。

通过分析残差(观测值与预测值之间的差异),我们可以检查模型是否满足所假设的条件,并进行必要的修正。

3. 应用最小二乘法广泛应用于各个领域,包括但不限于以下几个方面:3.1 线性回归分析线性回归是最常见的应用之一。

通过将观测数据与线性模型进行拟合,我们可以估计出自变量与因变量之间的关系。

线性回归可以用于预测、关联分析和因果推断等。

3.2 时间序列分析时间序列分析是对随时间变化的数据进行建模和预测的方法。

最小二乘法知识最小二乘法是一种最优化方法,经常用于拟合数据和解决回归问题。

它的目标是通过调整模型参数,使得模型的预测值与观测值之间的差异最小。

最小二乘法的核心思想是最小化误差的平方和。

对于给定的数据集,假设有一个线性模型y = β₀ + β₁x₁ + β₂x₂ + ... +βₙxₙ,其中β₀, β₁, β₂, ... , βₙ 是需要求解的未知参数,x₁, x₂, ... , xₙ 是自变量,y 是因变量。

那么对于每个样本点 (xᵢ, yᵢ),可以计算其预测值ŷᵢ = β₀ + β₁x₁ + β₂x₂ + ... + βₙxₙ,然后计算预测值与实际值之间的差异 eᵢ = yᵢ - ŷᵢ。

最小二乘法的目标是使得误差的平方和最小化,即最小化目标函数 E = ∑(yᵢ - ŷᵢ)²。

对于简单的线性回归问题,即只有一个自变量的情况下,最小二乘法可以通过解析方法求解参数的闭合解。

我们可以通过求偏导数,令目标函数对参数的偏导数等于零,求解出参数的最优解。

然而,对于复杂的非线性回归问题,解析方法通常不可行。

在实际应用中,最小二乘法通常使用迭代方法进行求解。

一种常用的迭代方法是梯度下降法。

梯度下降法通过反复进行参数更新的方式逐步降低目标函数的值,直到收敛到最优解。

具体而言,梯度下降法首先随机初始化参数的值,然后计算目标函数对于每个参数的偏导数,根据偏导数的方向更新参数的值。

迭代更新的过程可以通过下式表示:βₙ = βₙ - α(∂E/∂βₙ)其中,α 是学习率参数,控制每次更新参数的步长。

学习率需要适当选择,过小会导致收敛过慢,过大会导致震荡甚至不收敛。

最小二乘法除了可以用于线性回归问题,还可以用于其他类型的回归问题,比如多项式回归。

在多项式回归中,我们可以通过增加高次项来拟合非线性关系。

同样地,最小二乘法可以通过调整多项式的系数来使得拟合曲线与实际数据更加接近。

除了回归问题,最小二乘法还可以应用于其他领域,比如数据压缩、信号处理和统计建模等。

最小二乘法实现公式最小二乘法是一种常用的回归分析方法,用于估计线性模型中的参数。

它通过最小化观测值与预测值之间的误差平方和,来确定最优的参数估计值。

下面将详细介绍最小二乘法的原理和应用。

一、最小二乘法原理最小二乘法的基本思想是,通过找到一条线(或曲线),使得该线与观测数据点之间的误差最小化。

具体来说,对于一个线性模型 y = β0 + β1x + ε,其中 y 是因变量,x 是自变量,β0 和β1 是待估计的参数,ε 是误差项。

最小二乘法的目标是找到最优的参数估计值β0* 和β1*,使得观测值与预测值之间的误差平方和最小化。

为了实现最小二乘法,需要定义一个衡量误差的函数,通常选择误差的平方和作为目标函数。

即最小化目标函数:min Σ(yi - (β0 + β1xi))^2通过对目标函数求导,可以得到参数估计值的解析解。

令目标函数的导数等于零,可以得到以下两个方程:Σyi - nβ0 - β1Σxi = 0Σxiyi - β0Σxi - β1Σxi^2 = 0解这个方程组,可以求得最优的参数估计值β0* 和β1*。

最小二乘法的核心思想就是通过最小化误差平方和来确定最优的参数估计值。

二、最小二乘法的应用最小二乘法广泛应用于各个领域的回归分析中。

下面将介绍最小二乘法在经济学、统计学和工程学中的应用。

1. 经济学中的应用最小二乘法在经济学中被广泛应用于建立经济模型和估计经济参数。

经济学家可以利用最小二乘法来估计需求函数、供给函数和生产函数等。

通过回归分析,经济学家可以研究各种经济变量之间的关系,并对经济现象进行解释和预测。

2. 统计学中的应用最小二乘法是统计学中最常用的参数估计方法之一。

通过最小二乘法,统计学家可以估计线性回归模型中的参数,并进行统计推断。

最小二乘法还可以用于解决多重共线性、异方差性和自相关等统计问题。

3. 工程学中的应用最小二乘法在工程学中有着广泛的应用。

例如,在信号处理中,最小二乘法可以用于信号滤波和信号重构。

最小二乘方法:原理、应用与实现一、引言最小二乘方法是数学优化中的一种重要技术,广泛应用于各种实际问题中。

它的基本原理是通过最小化误差的平方和来估计未知参数,从而实现数据拟合、线性回归等目标。

本文将对最小二乘方法的原理、应用与实现进行详细介绍,并探讨其在实际问题中的应用。

二、最小二乘方法的原理最小二乘方法的基本原理可以概括为:对于一组观测数据,通过最小化误差的平方和来估计未知参数。

具体而言,设我们有一组观测数据{(xi, yi)},其中xi是自变量,yi是因变量。

我们希望找到一个函数f(x),使得f(xi)与yi之间的差距尽可能小。

为了量化这种差距,我们采用误差的平方和作为目标函数,即:J = Σ(f(xi) - yi)²我们的目标是找到一组参数,使得J达到最小值。

这样的问题称为最小二乘问题。

在实际应用中,我们通常采用线性函数作为拟合函数,即:f(x) = a + bx其中a和b是待估计的参数。

此时,最小二乘问题转化为求解a 和b的问题。

通过求解目标函数J关于a和b的偏导数,并令其为零,我们可以得到a和b的最优解。

这种方法称为最小二乘法。

三、最小二乘方法的应用数据拟合:最小二乘方法在数据拟合中有广泛应用。

例如,在物理实验中,我们经常需要通过一组观测数据来估计某个物理量的值。

通过采用最小二乘方法,我们可以找到一条最佳拟合曲线,从而得到物理量的估计值。

这种方法在化学、生物学、医学等领域也有广泛应用。

线性回归:线性回归是一种用于预测因变量与自变量之间关系的统计方法。

在回归分析中,我们经常需要估计回归系数,即因变量与自变量之间的相关程度。

通过采用最小二乘方法,我们可以得到回归系数的最优估计值,从而建立回归方程。

这种方法在经济学、金融学、社会科学等领域有广泛应用。

图像处理:在图像处理中,最小二乘方法常用于图像恢复、图像去噪等问题。

例如,对于一幅受到噪声污染的图像,我们可以采用最小二乘方法对图像进行恢复,从而得到更清晰、更真实的图像。

最小二乘法名词解释

最小二乘法是一种数学优化方法,用于通过对观测数据进行拟合来求解线性回归问题。

它的基本原理是通过最小化观测数据与模型预测值之间的平方误差和,来确定最优的模型参数。

在最小二乘法中,有一些关键的术语和概念需要解释。

1. 观测数据:观测数据是在实际测量或观察中收集到的一系列数值。

在最小二乘法中,这些观测数据通常由两个向量表示,一个是自变量向量X,另一个是因变量向量Y。

2. 模型参数:模型参数是用于预测因变量的线性回归模型中的常数项和各个自变量的系数。

在最小二乘法中,我们通过最小化残差的平方和来确定最优的模型参数。

3. 残差:残差是观测数据的真实值与模型预测值之间的差异。

在最小二乘法中,我们希望通过调整模型参数使得残差的平方和最小化。

4. 残差平方和:残差平方和是残差的平方值的总和,用于衡量模型预测结果与观测数据之间的总体误差。

最小二乘法的目标就是通过最小化残差平方和来求解最优的模型参数。

5. 矩阵表示:最小二乘法可以利用矩阵运算来进行求解,这样可以简化计算并提高效率。

通常,自变量矩阵X、因变量矩阵Y、模型参数向量β和残差向量ε都是以矩阵形式表示。

6. 最优解:在最小二乘法中,我们寻找的是使得残差平方和最小的模型参数向量。

这个最优解可以通过数学推导或迭代算法来求解。

最小二乘法是一种常用且有效的回归分析方法,它在统计学、经济学、工程学等多个领域都有广泛的应用。

通过最小二乘法,我们可以利用已知的观测数据来估计未知的模型参数,从而进行预测、分析和决策。

最小二乘法(least sqauremethod)专栏文章汇总文章结构如下:1:最小二乘法的原理与要解决的问题2 :最小二乘法的矩阵法解法3:最小二乘法的几何解释4:最小二乘法的局限性和适用场景5:案例python实现6:参考文献1:最小二乘法的原理与要解决的问题最小二乘法是由勒让德在19世纪发现的,形式如下式:标函数 = \sum(观测值-理论值)^2\\观测值就是我们的多组样本,理论值就是我们的假设拟合函数。

目标函数也就是在机器学习中常说的损失函数,我们的目标是得到使目标函数最小化时候的拟合函数的模型。

举一个最简单的线性回归的简单例子,比如我们有 m 个只有一个特征的样本: (x_i, y_i)(i=1, 2, 3...,m)样本采用一般的 h_{\theta}(x) 为 n 次的多项式拟合,h_{\theta}(x)=\theta_0+\theta_1x+\theta_2x^2+...\theta_nx^n,\theta(\theta_0,\theta_1,\theta_2,...,\theta_n) 为参数最小二乘法就是要找到一组\theta(\theta_0,\theta_1,\theta_2,...,\theta_n) 使得\sum_{i=1}^n(h_{\theta}(x_i)-y_i)^2 (残差平方和) 最小,即,求 min\sum_{i=1}^n(h_{\theta}(x_i)-y_i)^22 :最小二乘法的矩阵法解法最小二乘法的代数法解法就是对 \theta_i 求偏导数,令偏导数为0,再解方程组,得到 \theta_i 。

矩阵法比代数法要简洁,下面主要讲解下矩阵法解法,这里用多元线性回归例子来描:假设函数h_{\theta}(x_1,x_2,...x_n)=\theta_0+\theta_1x_1+...+\t heta_nx_n 的矩阵表达方式为:h_{\theta}(\mathbf{x})=\mathbf{X}\theta\\其中,假设函数 h_{\theta}(\mathbf{x})=\mathbf{X}\theta 为 m\times1 的向量, \theta 为 n\times1 的向量,里面有 n 个代数法的模型参数。

最小二乘法一、最小二乘法概述最小二乘法是1795年高斯在预测星体运行轨道最先提出的,它奠定了最小二乘估计理论的基础.到了20世纪60年代瑞典学者Austron 把这个方法用于动态系统的辨识中,在这种辨识方法中,首先给出模型类型,在该类型下确定系统模型的最优参数。

我们可以将所研究的对象按照对其了解的程度分成白箱、灰箱和黑箱。

于其内部结构、 机制只了解一部分,对于其内部运行规律并不十分清楚,这样的研究对象通常称之为 “灰箱”;如果我们对于研究对象的内部结构、 内部机制及运行规律均一无所知的话,则把这样的研究对象称之为“黑箱”。

研究灰箱和黑箱时,将研究的对象看作是一个系统,通过建立该系统的模型,对模型参数进行辨识来确定该系统的运行规律。

对于动态系统辨识的方法有很多,但其中应用最广泛,辨识效果良好的就是最小二乘辨识方法,研究最小二乘法在系统辨识中的应用具有现实的、广泛的意义。

应用最小二乘法对系统模型参数进行辨识的方法有离线辨识和在线辨识两种离线辨识是在采集到系统模型所需全部输入输出数据后,用最小二乘法对数据进行集中处理,从而获得模型参数的估计值;而在线辨识是一种在系统运行过程中进行的递推辨识方法,所应用的数据是实时采集的系统输入输出数据,应用递推算法对参数估计值进行不断修正,以取得更为准确的参数估计值。

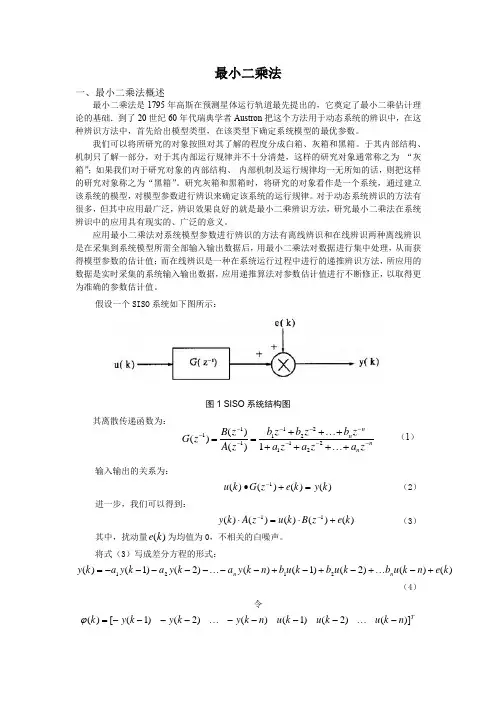

假设一个SISO 系统如下图所示:图1 SISO 系统结构图其离散传递函数为:(1)输入输出的关系为:)()()()(1k y k e z G k u =+•- (2)进一步,我们可以得到:)()()()()(11k e z B k u z A k y +⋅=⋅-- (3)其中,扰动量)(k e 为均值为0,不相关的白噪声。

将式(3)写成差分方程的形式:)()()2()1()()2()1()(2121k e n k u b k u b k u b n k y a k y a k y a k y n n +-⋯+-+-+--⋯-----=(4)令T n k u k u k u n k y k y k y k ])()2()1()()2()1([)(-⋯----⋯----=ϕnn n n z a z a z a z b z b z b z A z B z G ---------+⋯++++⋯++==221122111111)()()(][2121n nb b b a a a ⋯⋯=θ则式(4)可以写为:)()()(k e k k y T+=θϕ (5)将上述式子扩展到N 个输入、输出观测值{)(),(k y k u },k=1,2,…,N+n 。

最小二乘法截距公式

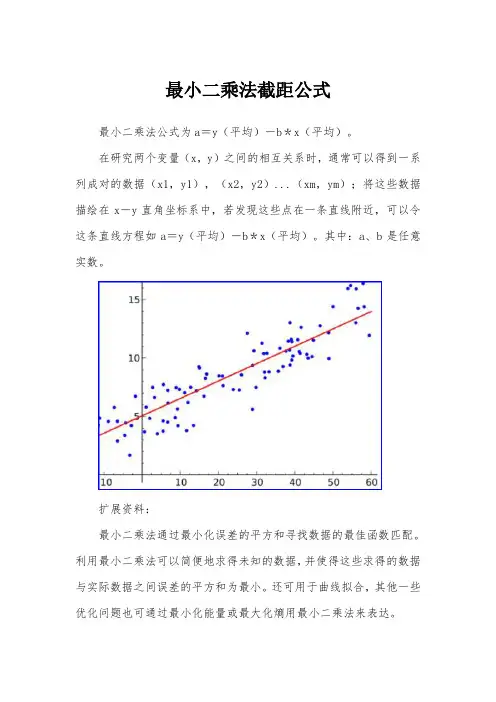

最小二乘法公式为a=y(平均)-b*x(平均)。

在研究两个变量(x,y)之间的相互关系时,通常可以得到一系列成对的数据(x1,y1),(x2,y2)...(xm,ym);将这些数据描绘在x-y直角坐标系中,若发现这些点在一条直线附近,可以令这条直线方程如a=y(平均)-b*x(平均)。

其中:a、b是任意实数。

扩展资料:

最小二乘法通过最小化误差的平方和寻找数据的最佳函数匹配。

利用最小二乘法可以简便地求得未知的数据,并使得这些求得的数据与实际数据之间误差的平方和为最小。

还可用于曲线拟合,其他一些优化问题也可通过最小化能量或最大化熵用最小二乘法来表达。

根据样本数据,采用最小二乘估计式可以得到简单线性回归模型参数的估计量。

但是估计量参数与总体真实参数的接近程度如何,是否存在更好的其它估计式,这就涉及到最小二乘估计式或估计量的最小方差(或最佳)性、线性及无偏性。

第七章 最小二乘法最小二乘法是实验数据处理的一种基本方法。

它给出了数据处理的一条准则,即在最小二乘以一下获得的最佳结果(或最可信赖值)应使残差平方和最小。

基于这一准则所建立的一整套的理论和方法,为随机数据的处理提供了行之有效的手段,成为实验数据处理中应用十分广泛的基础内容之一。

自1805年勒让得(Legendre )提出最小二乘法以来,这一方法得到了迅速发展,并不断完善,成为回归分析、数理统计等方面的理论基础之一,广泛地应用于天文测量,大地测量及其他科学实验的数据处理中。

现代,矩阵理论的发展及电子计算机的广泛应用,为这一方法提供了新的理论工具和得力的数据处理手段。

随着计量技术及其他现代科学技术的迅速发展,最小二乘法在各学科领域将获得更为广泛的应用。

本章仅涉及独立的测量数据的最小二乘法处理。

以等精度线性参数的最小二乘法为中心,叙述最小二乘法原理,正规方程和正规方程的解,以及最小二乘估计的精度估计。

最后给出测量数据最小二乘法处理的几个例子。

7 .1 最小二乘法原理县考察下面的例子。

设有一金属尺,在温度()C t ︒条件下的长度可表示)1(0t y y t α+=式中 y 0——温度为0°C 时的金属尺的长度;α——金属材料的线膨胀系数; t ——测量尺长时的温度。

现要求给出y 0与α的数值。

为此,可在t 1与t 2两个温度条件下分别测得尺的长度l 1与l 2,得方程组()()⎭⎬⎫+=+=20210111t y l t y l αα由此可解得y 0与α。

事实上,由于测量结果l 1与l 2含有测量误差,所得到的y 0与α的值也含有误差。

显而易见,为减小所得y 0与α值的误差,应增加y t 的测量次数,以便利用抵偿性减小测量误差的影响。

设在n t t t ,,,21 温度条件下分别测得金属尺的长度n l l l ,,,21 共n 个结果,可列出方程组⎪⎪⎭⎪⎪⎬⎫+=+=+=)1()1()1(0202101n n t y l t y l t y l ααα)1(0t y y t α+=但由于方程式的数目n 多于待求量的数目,所以无法直接利用代数法求解上述方程组。

数值分析作业最小二乘法最小二乘法是提供“观测组合”的主要工具之一,它依据对某事件的大量观测而获得最佳”结果或最可能”表现形式。

如已知两变量为线性关系y= a+ bx,对其进行n(n> 2)次观测而获得n对数据。

若将这n对数据代入方程求解a,b之值则无确定解。

最小二乘法提供了一个求解方法,其基本思想就是寻找最接近”这n 个观测点的直线。

最小二乘法不仅是19世纪最重要的统计方法,而且还可以称为数理统计学之灵魂。

相关回归分析、方差分析和线性模型理论等数理统计学的几大分支都以最小二乘法为理论基础。

作为其进一步发展或纠正其不足而采取的对策,不少近现代的数理统计学分支也是在最小二乘法基础上衍生出来的。

正如美国统计学家斯蒂格勒(S.M. Stigler)所说,最小二乘法之于数理统计学犹如微积分之于数学”最小二乘法创立的历史过程充满着丰富的科学思想,这些对今日的数学创造仍有着重要的启示意义。

本文旨在全面认识最小二乘法的历史系统发育过程以及创立者的思路。

一先驱者的相关研究天文学和测地学的发展促进了数理统计学及其他相关科学的发展。

丹麦统计史家哈尔德曾指出天文学在数理统计学发展中所起的作用。

“天文学自古代至18 世纪是应用数学中最发达的领域。

观测和数学天文学给出了建立数学模型及数据拟合的最初例子,在此种意义下,天文学家就是最初的数理统计学家。

天文学的问题逐渐引导到算术平均,以及参数模型中的种种估计方法,以最小二乘法为顶峰。

” 这也说明了最小二乘法的显著地位。

有关统计计算思想记载的著作要首推天文学家罗杰柯茨的遗作,即1715年其所发论文中所蕴含的统计方法,亦即对各种观测值赋予加权后求其加权平均。

尽管当时得到认可,然而事实证明如此计算的结果不太精确。

1749年,欧拉(L. Euler,1707—1783)在研究木星和土星之间相互吸引力作用对各自轨道影响时,最后得到一个含8个未知量75个方程的线性方程组。

欧拉的求解方法繁杂而奇特,只能看作是一次尝试。

最小二乘法计算例题最小二乘法是数学统计学上十分常见的一种拟合方法,它可以用来在数据中拟合出一条曲线,使得一组数据集合最佳地拟合出一条曲线或多条曲线。

最小二乘法是统计方法中最常用的拟合方法,它的原理是根据给定的多个数据点,寻找最佳拟合的曲线,使得拟合曲线与所有已知数据点之间的距离最小。

最小二乘法最容易计算的曲线就是一元多项式曲线,它是任意数据点之间拟合出的参数曲线。

本文将介绍小二乘法的计算步骤和过程,以及一个示例,以帮助大家更加熟练地掌握这一知识点。

一、最小二乘法的概念最小二乘法是数学中一种常用的拟合方法,也叫参数估计法,它可以用来拟合给定的数据点,使得这个数据集合的距离最小。

最小二乘法的原理是尽可能最大地减少直线与数据点之间的距离,以期搜索到最佳拟合的曲线。

二、最小二乘法的计算步骤1.确定样本数据:首先要确定给定的样本数据,这些样本数据将用来计算最小二乘法获得最优拟合曲线。

2.计算最小二乘法残差:根据给定的数据点,可以计算出残差,残差就是拟合曲线与样本数据点之间的差值。

3.求解最小二乘公式:最小二乘法求解公式是用来获得拟合曲线中参数的最优值的公式。

4.使用极点最小二乘法:最小二乘法的极点求解法是求解最优拟合曲线的另一种方法,它的步骤与最小二乘法的求解步骤一样,但是使用了不同的数学方法。

三、最小二乘法计算例题下面我们来看一个具体的拟合曲线计算例题,此例题中要使用到最小二乘法,拟合给定的数据点。

所需数据: y=(3,2,1,0,-1)x=(1,2,3,4,5)要求:拟合出一条一元多项式曲线解法:1.计算残差:根据数据点求出残差,残差的计算公式为yi-ai-bxi,在此例题中,可以求出:3-a-b=12-a-2b=11-a-3b=20-a-4b=-1-1-a-5b=-32.求解最小二乘公式:根据求出的残差,可以求出最小二乘求解公式,公式为:b=(nΣxiyi-ΣxiΣyi) / (nΣx2i-(Σxi)2)a=(Σyi-bΣxi) / n在此例题中,可以求出:b= ( 5*6-15*-3) / (5*30-225) = 0.4a= (-3-0.4*15) / 5 = -2.23.使用极点最小二乘法:最后,我们可以使用极点最小二乘法,计算出最优的拟合曲线,其结果为:y=-2.2+0.4x因此,我们可以得出本例题的答案:y=-2.2+0.4x。

最小二乘法中文名称:最小二乘法英文名称:least square method定义:在残差满足VPV为最小的条件下解算测量估值或参数估值并进行精度估算的方法。

其中V为残差向量,P为其权矩阵。

应用学科:测绘学(一级学科);大地测量学(二级学科)最小二乘法(又称最小平方法)是一种数学优化技术。

它通过最小化误差的平方和寻找数据的最佳函数匹配。

利用最小二乘法可以简便地求得未知的数据,并使得这些求得的数据与实际数据之间误差的平方和为最小。

最小二乘法还可用于曲线拟合。

其他一些优化问题也可通过最小化能量或最大化熵用最小二乘法来表达。

最小二乘法最小二乘法(least square)历史简介1801年,意大利天文学家朱赛普·皮亚齐发现了第一颗小行星谷神星。

经过40天的跟踪观测后,由于谷神星运行至太阳背后,使得皮亚齐失去了谷神星的位置。

随后全世界的科学家利用皮亚齐的观测数据开始寻找谷神星,但是根据大多数人计算的结果来寻找谷神星都没有结果。

时年24岁的高斯也计算了谷神星的轨道。

奥地利天文学家海因里希·奥尔伯斯根据高斯计算出来的轨道重新发现了谷神星。

高斯使用的最小二乘法的方法发表于1809年他的著作《天体运动论》中。

法国科学家勒让德于1806年独立发现“最小二乘法”,但因不为世人所知而默默无闻。

勒让德曾与高斯为谁最早创立最小二乘法原理发生争执。

1829年,高斯提供了最小二乘法的优化效果强于其他方法的证明,因此被称为高斯-莫卡夫定理。

(来自于wikipedia)最小二乘法公式最小二乘法公式∑(X--X平)(Y--Y平)=∑(XY--X平Y--XY平+X平Y平)=∑XY--X平∑Y--Y平∑X+nX平Y平=∑XY--nX平Y平--nX平Y平+nX平Y平=∑XY--nX平Y平∑(X --X平)^2=∑(X^2--2XX平+X平^2)=∑X^2--2nX平^2+nX平^2=∑X^2--nX平^2Y=kX+b: k=((XY)平--X平*Y平)/(X^2--(X平)^2 ;b=Y平--kX平X平=1/n∑X i;(XY)平=1/n∑X i Y i最小二乘法原理用各个离差的平方和M=Σ(i=1到n)[y i-(ax i+b)]^2最小来保证每个离差的绝对值都很小。

题目

最小二乘法计算公式是什么?

答案解析

最小二乘法公式是一个数学的公式,在数学上称为曲线拟合,此处所讲最小二乘法,专指线性回归方程!最小二乘法公式为a=y(平均)-b*x(平均)。

最小二乘法((又称最小平方法)是一种数学优化技术。

它通过最小化误差的平方和寻找数据的最佳函数匹配。

利用最小二乘法可以简便地求得未知的数据,并使得这些求得的数据与实际数据之间误差的平方和为最小。

扩展资料:

普通最小二乘估计量具有上述三特性:

1、线性特性

所谓线性特性,是指估计量分别是样本观测值的线性函数,亦即估计量和观测值的线性组合。

2、无偏性

无偏性,是指参数估计量的期望值分别等于总体真实参数。

3、最小方差性

所谓最小方差性,是指估计量与用其它方法求得的估计量比较,其方差最小,即最佳。

最小方差性又称有效性。

这一性质就是著名的高斯一马尔可夫((Gauss-Markov)定理。

这个定理阐明了普通最小二乘估计量与用其它方法求得的任何线性无偏估计量相比,它是最佳的。

第3章 线性动态模型参数辨识-最小二乘法3.1 辨识方法分类根据不同的辨识原理,参数模型辨识方法可归纳成三类: ① 最小二乘类参数辨识方法,其基本思想是通过极小化如下准则函数来估计模型参数:min )()ˆ(ˆ==∑=θθLk k J 12ε 其中)(k ε代表模型输出与系统输出的偏差。

典型的方法有最小二乘法、增广最小二乘法、辅助变量法、广义最小二乘法等。

② 梯度校正参数辨识方法,其基本思想是沿着准则函数负梯度方向逐步修正模型参数,使准则函数达到最小,如随机逼近法。

③ 概率密度逼近参数辨识方法,其基本思想是使输出z 的条件概率密度)|(θz p 最大限度地逼近条件0θ下的概率密度)|(0θz p ,即)|()ˆ|(0m a x θθz p z p −−→−。

典型的方法是极大似然法。

3.2 最小二乘法的基本概念● 两种算法形式 ① 批处理算法:利用一批观测数据,一次计算或经反复迭代,以获得模型参数的估计值。

② 递推算法:在上次模型参数估计值)(ˆ1-k θ的基础上,根据当前获得的数据提出修正,进而获得本次模型参数估计值)(ˆk θ,广泛采用的递推算法形式为() ()()()~()θθk k k k d z k =-+-1K h其中)(ˆk θ表示k 时刻的模型参数估计值,K (k )为算法的增益,h (k -d ) 是由观测数据组成的输入数据向量,d 为整数,)(~k z 表示新息。

● 最小二乘原理定义:设一个随机序列)},,,(),({L k k z 21∈的均值是参数θ 的线性函数E{()}()T z k k θ=h其中h (k )是可测的数据向量,那么利用随机序列的一个实现,使准则函数21()[()()]LT k J z k k θθ==-∑h达到极小的参数估计值θˆ称作θ的最小二乘估计。

● 最小二乘原理表明,未知参数估计问题,就是求参数估计值θˆ,使序列的估计值尽可能地接近实际序列,两者的接近程度用实际序列与序列估计值之差的平方和来度量。

● 如果系统的输入输出关系可以描述成如下的最小二乘格式()()()T z k k e k θ=+h 式中z (k )为模型输出变量,h (k )为输入数据向量,θ为模型参数向量,e (k )为零均值随机噪声。

为了求此模型的参数估计值,可以利用上述最小二乘原理。

根据观测到的已知数据序列)}({k z 和)}({k h ,极小化下列准则函数21()[()()]LT k J z k k θθ==-∑h即可求得模型参数的最小二乘估计值θˆ。

● 最小二乘估计值应在观测值与估计值之累次误差的平方和达到最小值处,所得到的模型输出能最好地逼近实际系统的输出。

3.3 最小二乘问题的描述 (1) 考虑模型)()()()()(11k e k u z B k z z A +=--式中u (k )和z (k ) 分别为过程的输入和输出变量,e (k )是均值为零、方差为2nσ的随机噪声,)(1-z A 和)(1-z B 为迟延算子多项式,写成A z a z a z a zB z b z b z b z n nn n a a b b ()()--------=++++=+++⎧⎨⎪⎩⎪11122111221(2) 假定模型阶次n a 和n b 为已知,且有b a n n ≥,也可设n n n b a ==,并定义1212()[(1),,(),(1),,()][,,,,,,,]a b Ta b Tn n k z k z k n u k u k n a a a b b b θ⎧=------⎪⎨=⎪⎩h (3) 将模型写成最小二乘格式()()()T z k k e k θ=+h对于L k ,,, 21= (L 为数据长度),可以构成如下线性方程组L L L θ=+e z H 式中T T T [(1),(2),,()](0)(1)(0)(1)(1)(1)(2)(1)(2)(2)(1)()(1)()()[(1),(2),,()]T L a b a b L a b TLz z z L z z n u u n z z n u u n z L z L n u L u L n L n n n L ⎧=⎪----⎡⎤⎡⎤⎪⎢⎥⎢⎥⎪----⎪⎢⎥⎢⎥==⎨⎢⎥⎢⎥⎪⎢⎥⎢⎥⎪------⎣⎦⎣⎦⎪=⎪⎩z h h H h e(4) 噪声的统计性质{}{}{}E 0,cov E L T L L L e ===∑e e e e (5) 噪声与输入不相关{}E ()()0,,e k e k l k l -=∀ (6) 数据长度L 充分大3.4 最小二乘问题的解 ● 考虑模型11()()()()()A z z k B z u k e k --=+● 准则函数取2()()[()()]LT k 1J k z k k θθ==Λ-∑h其中)(k Λ为加权因子,对所有的k ,)(k Λ都必须大于零。

● 准则函数又可写成()()()T L L L L L J θθθ=-Λ-z H z H式中L Λ为加权矩阵,它是正定的对角阵,由加权因子)(k Λ构成ΛL =⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡)()()(L ΛΛΛ 0020001 ● 该准则函数)(θJ 可用以衡量模型输出与实际系统输出的接近情况.极小化这个准则函数,即可求得模型的参数估计值,使模型的输出能最好地预报系统的输出。

● 当TL L L ΛH H 是正则矩阵时,模型的加权最小二乘解为1WLSˆ()T T LLLLL Lθ-=ΛΛH H H z ● 通过极小化准则函数)(θJ 求得模型参数估计值WLS θˆ的方法称作加权最小二乘法,记作WLS (Weighted Least Squares algorithm),对应的WLS θˆ称为加权最小二乘估计值。

● 如果加权矩阵取单位阵,即I =L Λ,则加权最小二乘解退化成普通最小二乘解1LS ˆ()T T L L L Lθ-=H H H z 这时的LS θˆ称之为最小二乘估计值,对应的估计方法称作最小二乘法,记作LS(Least Squares algorithm)。

最小二乘法是加权最小二乘法的一种特例。

3.5 最小二乘估计的可辨识性 ● 基于参数模型的辨识问题实际上可以归结为模型参数的最优化问题。

当给定输入输出数据时,对假定的模型结构是否能唯一地确定模型的参数,这就是可辨识问题。

● 可控性、可观性和可辨识性之间的关系● 可辨识性和输入信号的关系:过程的所有模态都必须被输入信号持续激励。

● 常用的输入信号:随机序列、伪随机序列、离散序列● 最小二乘估计的可辨识条件为矩阵L L L H H Λτ必须是非奇异的。

● 这一要求与数据集是“提供信息”的或辨识输入信号是“持续激励”的概念密切相关。

例3.3 考虑仿真对象)()2(5.0)1()2(7.0)1(5.1)(k v k u k u k z k z k z +-+-=-+-- (3.41) 其中,)(k v 是服从正态分布的白噪声N )1,0(。

输入信号采用4阶M 序列,幅度为1。

选择如下形式的辨识模型)()2()1()2()1()(2121k v k u b k u b k z a k z a k z +-+-=-+-+ (3.42)设输入信号的取值是从k =1到k =16的M 序列,则待辨识参数LSθˆ为LS θˆ=L τL 1L τL z H )H H -(。

其中,被辨识参数LSθˆ、观测矩阵z L 、H L 的表达式为 ⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=2121ˆb b a a LSθ , ⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=)16()4()3(z z z L z , ⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡------=)14()2()1()15()3()2()14()2()1()15()3()2(u u u u u u z z z z z z L H (3.43) 程序框图如图3.2所示。

Matlab6.0仿真程序如下:%二阶系统的最小二乘一次完成算法辨识程序u=[-1,1,-1,1,1,1,1,-1,-1,-1,1,-1,-1,1,1]; %系统辨识的输入信号为一个周期的M序列z=zeros(1,16); %定义输出观测值的长度for k=3:16z(k)=1.5*z(k-1)-0.7*z(k-2)+u(k-1)+0.5*u(k-2); %用理想输出值作为观测值endsubplot(3,1,1) %画三行一列图形窗口中的第一个图形stem(u) %画输入信号u的径线图形subplot(3,1,2) %画三行一列图形窗口中的第二个图形i=1:1:16; %横坐标范围是1到16,步长为1plot(i,z) %图形的横坐标是采样时刻i, 纵坐标是输出观测值z, 图形格式为连续曲线subplot(3,1,3) %画三行一列图形窗口中的第三个图形stem(z),grid on %画出输出观测值z的径线图形,并显示坐标网格u,z %显示输入信号和输出观测信号%L=14 %数据长度HL=[-z(2) -z(1) u(2) u(1);-z(3) -z(2) u(3) u(2);-z(4) -z(3) u(4) u(3);-z(5) -z(4) u(5) u(4);-z(6) -z(5) u(6) u(5);-z(7) -z(6) u(7) u(6);-z(8) -z(7) u(8) u(7);-z(9)-z(8) u(9) u(8);-z(10) -z(9) u(10) u(9);-z(11) -z(10) u(11) u(10);-z(12) -z(11)u(12) u(11);-z(13) -z(12) u(13) u(12);-z(14) -z(13) u(14) u(13);-z(15) -z(14)u(15) u(14)] %给样本矩阵H L赋值ZL=[z(3);z(4);z(5);z(6);z(7);z(8);z(9);z(10);z(11);z(12);z(13);z(14);z(15);z(16)] % 给样本矩阵z L赋值%Calculating Parametersc1=HL'*HL; c2=inv(c1); c3=HL'*ZL; c=c2*c3 %计算并显示θˆLS%Display Parametersa1=c(1), a2=c(2), b1=c(3),b2=c(4) %从θˆ中分离出并显示a1、a2、b1、b2LS%End程序运行结果:>>u =[ -1,1,-1,1,1,1,1,-1,-1,-1,1,-1,-1,1,1]z =[ 0,0,0.5000,0.2500,0.5250,2.1125,4.3012,6.4731,6.1988,3.2670,-0.9386,-3.1949,-4.6352,6.2165,-5.5800,-2.5185]HL =0 0 1.0000 -1.0000-0.5000 0 -1.0000 1.0000-0.2500 -0.5000 1.0000 -1.0000-0.5250 -0.2500 1.0000 1.0000-2.1125 -0.5250 1.0000 1.0000-4.3012 -2.1125 1.0000 1.0000-6.4731 -4.3012 -1.0000 1.0000-6.1988 -6.4731 -1.0000 -1.0000-3.2670 -6.1988 -1.0000 -1.00000.9386 -3.2670 1.0000 -1.00003.1949 0.9386 -1.0000 1.00004.6352 3.1949 -1.0000 -1.00006.2165 4.6352 1.0000 -1.00005.58006.2165 1.0000 1.0000ZL =[ 0.5000,0.2500,0.5250,2.1125,4.3012,6.4731,6.1988,3.2670,-0.9386,-3.1949,-4.6352,-6.2165,-5.5800,-2.5185]Tc =[ -1.5000,0.7000,1.0000,0.5000]Ta1 = -1.5000a2 = 0.7000b1 = 1.0000b2 =0.5000>>-101-10010-10010何噪声成分,所以辨识结果也无任何误差。