多项式回归分析

- 格式:ppt

- 大小:331.00 KB

- 文档页数:8

回归分析公式深入研究回归分析的数学公式回归分析是一种统计方法,用于研究变量之间的相互关系。

在回归分析中,数学公式是非常重要的,它们描述了变量之间的关系,并提供了预测和解释的基础。

本文将深入研究回归分析的数学公式,帮助读者更好地理解和应用这一方法。

一、简单线性回归分析公式简单线性回归分析是回归分析中最基本的形式,用于研究一个自变量和一个因变量之间的线性关系。

其数学公式可以表示为:Y = α + βX + ε其中,Y代表因变量,X代表自变量,α代表截距,β代表斜率,ε代表误差项。

在简单线性回归分析中,我们的目标是通过最小二乘法估计α和β的值,使得拟合线尽可能地接近实际观测值。

通过求导等数学方法,我们可以得到最小二乘估计公式:β = Σ((X-Ȳ)(Y-Ȳ))/(Σ(X-Ȳ)²)α = Ȳ - βXȲ其中,Ȳ代表因变量Y的平均值,XȲ代表自变量X与因变量Y的平均值的乘积。

二、多元线性回归分析公式当我们研究的问题涉及到多个自变量时,可以使用多元线性回归分析。

其数学公式可以表示为:Y = α + β₁X₁ + β₂X₂ + ... + βₚXₚ + ε其中,p代表自变量的个数。

在多元线性回归分析中,我们的目标是通过最小二乘法估计α和β的值,使得拟合线尽可能地接近实际观测值。

通过求导等数学方法,我们可以得到最小二乘估计公式:β = (X'X)⁻¹X'Yα = Ȳ - β₁X₁Ȳ - β₂X₂Ȳ - ... - βₚXₚȲ其中,X代表自变量矩阵,X'代表X的转置,Y代表因变量向量,(X'X)⁻¹代表X'X的逆矩阵。

三、多项式回归分析公式简单线性回归和多元线性回归都是基于线性关系的回归分析方法。

然而,有时候变量之间的关系并不是线性的,而是呈现出曲线的趋势。

这时我们可以使用多项式回归分析来建模。

多项式回归分析的数学公式可以表示为:Y = α + β₁X + β₂X² + ... + βₚXᵩ+ ε其中,ᵩ代表多项式的阶数。

多项式回归分析的例子例如, 不能用变量代换的方法将其转换为可按线性模型方式分析的模型, 需要使用多项式回归分析方法, 令, , , 则模型变换为, 即可按线性模型方式进行分析。

若回归方程是下面这样拟合的非线性方程:, (1)其中所有的都是自变量的已知函数而不包括任何未知参数, 若令,,…………………,则式(1)可写成,从而可按多元线性回归方式进行分析处理。

多项式回归在回归问题中占特殊的地位, 因为任何函数至少在一个比较小的邻域内可用多项式任意逼近, 因此通常在比较复杂的实际问题中, 可以不问与诸因素的确切关系如何, 而用多项式回归(当然首先应试用最简单的一次多项式即线性回归)进行分析和计算。

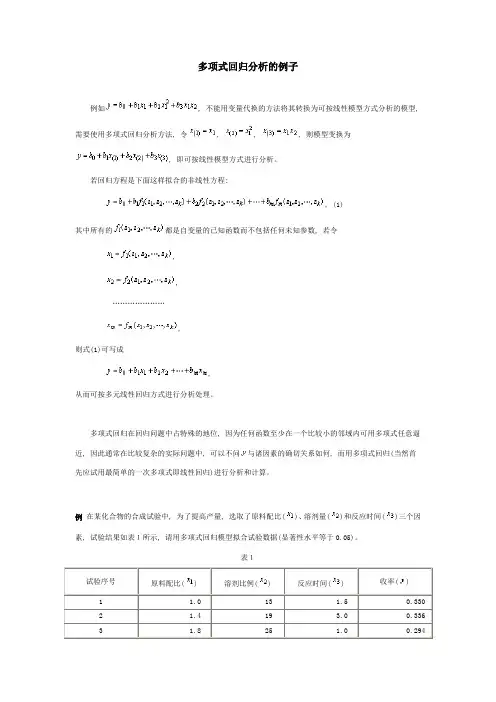

例在某化合物的合成试验中, 为了提高产量, 选取了原料配比()、溶剂量()和反应时间()三个因素, 试验结果如表1所示, 请用多项式回归模型拟合试验数据(显著性水平等于0.05)。

表1(若收率()与原料配比()、溶剂量()和反应时间()三个因素之间的函数关系近似满足二次回归模型: , (其中溶剂用量对作用很小, 建模时可以不考虑), 按表2数据进行数据输入:表2)^2()本软件给出的回归分析有关的结果如下(与回归分析无关的内容未列出):指标名称: 收率单位: ?因素1名称: 时间单位: ?因素2名称: 时间^2 单位: ?因素3名称: 配比×时间单位: ?------------------- 多元回归分析 -------------------回归分析采用全回归法, 显著性水平α=0.05拟建立回归方程:y = b(0) + b(1)*X(1) + b(2)*X(2) + b(3)*X(3)回归系数 b(i):b(0)= 5.79e-2b(1)= 0.252b(2)=-6.48e-2b(3)= 2.83e-2标准回归系数 B(i):B(1)= 2.62B(2)=-2.76B(3)= 1.02复相关系数R=0.9838决定系数R^2=0.9679修正的决定系数R^2a=0.9518回归方程显著性检验:变量分析表样本容量N=7, 显著性水平α=0.05, 检验值Ft=30.14, 临界值F(0.05,3,3)=9.277, Ft>F(0.05,3,3), 回归方程显著。

多项式回归分析多项式回归分析是一种有效的统计学方法,它能够根据试验数据拟合一个函数,以从该函数中推断和预测未知变量的取值。

它可以用来预测定量和定性的变量,可以处理更复杂的数据集,并且可以在时间序列中进行预测,使数据处理更加自动化和高效。

在讨论多项式回归分析之前,有必要了解其开发背景。

一般来说,多项式回归分析是基于一些统计学和数学概念开发而来的,其主要目的是尝试根据观察到的数据拟合一个有意义的函数,以便更好的研究和推断数据之间的关系。

多项式回归分析的主要思想是建立一个函数,使得函数的参数能够拟合数据,并且预测未知变量的变化。

多项式回归分析通常使用多项式函数,将不同的维度拟合成一个函数,使得函数能够代表多维度数据之间的关系,从而进行变量预测和分析。

多项式回归分析可以分为多种类型,主要有简单多项式、季节性和冬季多项式回归分析。

在简单多项式回归分析中,数据由定性变量和定量变量组成,函数的参数可以通过拟合方法计算出来,从而使多项式回归分析在简单的数据集上更加有效。

季节性多项式回归分析和冬季多项式回归分析是在简单多项式回归分析的基础上进行改进,以及增加时间序列参量,从而使得它更能拟合复杂的数据集。

多项式回归分析的应用广泛,可以用来分析股票价格数据,预测某种商品的需求,估算某一条线路的交通流量,分析气象参数数据等等。

它的有效性和高效性使其在实践中得到了广泛的应用。

拟合有效的多项式函数有助于研究和推断数据之间的关系,而多项式回归分析就是一种有效的方法。

它可以处理时间序列数据,多维度数据、定性和定量变量,并且能够有效地预测未知变量,使得实际应用更加方便。

多项式回归分析不仅拥有多种应用,而且能够发现数据之间的有趣关系,实现更好的预测效果,这也使它在实践中受到越来越多的重视。

12个变量的多项式回归12个变量的多项式回归是一种常见的统计分析方法,可以用来建立变量之间的非线性关系模型。

在实际应用中,多项式回归可以用于预测和分析各种现象,如经济增长、气候变化、市场需求等。

本文将介绍多项式回归的基本概念、建模方法和实际应用。

多项式回归是回归分析的一种扩展形式,它可以考虑更多的自变量和非线性关系。

一般来说,多项式回归模型可以表示为:Y = β0 + β1X1 + β2X2 + ... + βnXn + β12X1^2 + β22X2^2 + ... + βn2Xn^2 + ε其中,Y是因变量,X1、X2、...、Xn是自变量,β0、β1、β2、...、βn、β12、β22、...、βn2是模型的参数,ε是随机误差。

多项式回归的建模方法和线性回归类似,可以使用最小二乘法来估计参数的值。

通过最小化观测值与模型预测值之间的差异,可以得到最佳拟合的多项式回归模型。

在实际应用中,多项式回归可以用来分析各种现象和问题。

例如,在经济学中,可以使用多项式回归来研究经济增长和收入分配的关系。

通过将GDP作为因变量,人均收入、教育水平和就业率等作为自变量,可以建立一个多项式回归模型,来预测经济增长的趋势和影响因素。

在气候学中,多项式回归可以用来分析气温和降雨量的关系。

通过将气温作为因变量,降雨量和季节等作为自变量,可以建立一个多项式回归模型,来研究气候变化的规律和影响因素。

在市场营销中,多项式回归可以用来分析市场需求和销售额的关系。

通过将销售额作为因变量,广告投入、产品价格和竞争对手数量等作为自变量,可以建立一个多项式回归模型,来预测市场需求的变化和优化营销策略。

多项式回归是一种强大的统计分析方法,可以用来建立变量之间的非线性关系模型。

通过多项式回归,可以更好地理解和预测各种现象和问题。

无论是经济增长、气候变化还是市场需求,多项式回归都可以提供有价值的分析和预测结果,帮助我们做出更准确的决策。

数据分析技术中常用的多元回归分析方法简介多元回归分析是一种常用的数据分析技术,用于建立解释一个或多个自变量与一个或多个因变量之间关系的数学模型。

在实际应用中,多元回归分析可以帮助我们理解和预测因变量的变化情况,同时揭示自变量对因变量的影响程度和方向。

在多元回归分析中,我们通常会考虑多个自变量对一个因变量的影响。

这些自变量可以是连续变量,也可以是分类变量。

为了进行多元回归分析,我们需要收集包含自变量和因变量数据的样本,并建立一个数学模型来描述它们之间的关系。

常用的多元回归分析方法有以下几种:1. 线性回归分析:线性回归是最基本的多元回归分析方法之一。

它假设自变量和因变量之间的关系是线性的,即可以通过一条直线来描述。

线性回归可以用于预测新的因变量值或者探究自变量对因变量的影响程度和方向。

2. 多项式回归分析:多项式回归是线性回归的扩展形式,它允许通过非线性方程来描述自变量和因变量之间的关系。

多项式回归可以用于处理具有非线性关系的数据,通过增加自变量的幂次项,可以更好地拟合数据。

3. 逐步回归分析:逐步回归是一种渐进式的回归分析方法,它通过不断添加或删除自变量来选择最优的模型。

逐步回归可以帮助我们识别对因变量影响最显著的自变量,并且去除对模型没有贡献的自变量,以减少复杂度和提高预测准确性。

4. 岭回归分析:岭回归是一种用于处理共线性问题的回归方法。

共线性指的是自变量之间存在高度相关性,这会导致模型参数估计不稳定。

岭回归通过添加一个正则化项来缩小模型参数的值,从而减少共线性的影响。

5. 主成分回归分析:主成分回归结合了主成分分析和回归分析的方法,用于处理多重共线性问题。

主成分分析通过将自变量转换为一组无关的主成分来降维,然后进行回归分析。

这样可以减少自变量之间的相关性,并提高模型的解释力。

6. 逻辑回归分析:逻辑回归是一种广义线性回归,常用于处理二分类问题。

它通过对因变量进行逻辑变换,将线性回归的结果映射到一个[0, 1]的区间,表示某事件发生的概率。

回归分析方法总结全面回归分析是一种常用的统计分析方法,用于建立一个或多个自变量与因变量之间的关系模型,并进行预测和解释。

在许多研究领域和实际应用中,回归分析被广泛使用。

下面是对回归分析方法的全面总结。

1.简单线性回归分析:简单线性回归分析是最基本的回归分析方法之一,用于建立一个自变量和一个因变量之间的线性关系模型。

它的方程为Y=a+bX,其中Y是因变量,X是自变量,a是截距,b是斜率。

通过最小二乘法估计参数a和b,可以用于预测因变量的值。

2. 多元线性回归分析:多元线性回归分析是在简单线性回归的基础上扩展的方法,用于建立多个自变量和一个因变量之间的线性关系模型。

它的方程为Y = a + b1X1 + b2X2 + ... + bnXn,其中n是自变量的个数。

通过最小二乘法估计参数a和bi,可以用于预测因变量的值。

3.对数线性回归分析:对数线性回归分析是在简单线性回归或多元线性回归的基础上,将自变量或因变量取对数后建立的模型。

这种方法适用于因变量和自变量之间呈现指数关系的情况。

对数线性回归分析可以通过最小二乘法进行参数估计,并用于预测因变量的对数。

4.多项式回归分析:多项式回归分析是在多元线性回归的基础上,将自变量进行多项式变换后建立的模型。

它可以用于捕捉自变量和因变量之间的非线性关系。

多项式回归分析可以通过最小二乘法估计参数,并进行预测。

5.非线性回归分析:非线性回归分析是一种更一般的回归分析方法,用于建立自变量和因变量之间的非线性关系模型。

这种方法可以适用于任意形式的非线性关系。

非线性回归分析可以通过最小二乘法或其他拟合方法进行参数估计,用于预测因变量的值。

6.逐步回归分析:逐步回归分析是一种变量选择方法,用于确定最重要的自变量对因变量的解释程度。

它可以帮助选择最佳的自变量组合,建立最合适的回归模型。

逐步回归分析可以根据其中一种准则(如逐步回归F检验、最大似然比等)逐步添加或删除自变量,直到最佳模型被找到为止。

回归分析方法及其应用中的例子回归分析是一种统计分析方法,用于研究自变量与因变量之间的关系。

它可以通过建立一个数学模型来描述自变量与因变量之间的函数关系,并根据已有的数据对模型进行估计、预测和推断。

回归分析可以帮助我们了解变量之间的相关性、预测未来的结果以及找出主要影响因素等。

在实际应用中,回归分析有许多种方法和技术,下面将介绍其中的几种常见方法及其应用的例子。

1.简单线性回归:简单线性回归是一种最基本的回归分析方法,用于研究两个变量之间的关系。

它的数学模型可以表示为y=β0+β1x,其中y是因变量,x是自变量,β0和β1是常数。

简单线性回归可以用于预测一个变量对另一个变量的影响,例如预测销售额对广告投入的影响。

2.多元线性回归:多元线性回归是在简单线性回归的基础上引入多个自变量的模型。

它可以用于分析多个因素对一个因变量的影响,并以此预测因变量的取值。

例如,可以使用多元线性回归分析房屋价格与大小、位置、年龄等因素之间的关系。

3.逻辑回归:逻辑回归是一种用于预测二元结果的回归方法。

它可以将自变量与因变量之间的关系转化为一个概率模型,用于预测一些事件发生的概率。

逻辑回归常常应用于生物医学研究中,如预测疾病的发生概率或患者的生存率等。

4.多项式回归:多项式回归是一种使用多项式函数来拟合数据的方法。

它可以用于解决非线性关系的回归问题,例如拟合二次曲线或曲线拟合。

多项式回归可以应用于多个领域,如工程学中的曲线拟合、经济学中的生产函数拟合等。

5.线性混合效应模型:线性混合效应模型是一种用于分析包含随机效应的回归模型。

它可以同时考虑个体之间和个体内的变异,并在模型中引入随机效应来解释这种变异。

线性混合效应模型常被用于分析面板数据、重复测量数据等,例如研究不同学生在不同学校的学习成绩。

以上只是回归分析的一些常见方法及其应用的例子,实际上回归分析方法和应用还有很多其他的变种和扩展,可以根据具体问题和数据的特点选择适合的回归模型。

多项式回归研究一个因变量与一个或多个自变量间多项式的回归分析方法,称为多项式回归(Polynomial Regression )。

如果自变量只有一个时,称为一元多项式回归;如果自变量有多个时,称为多元多项式回归。

一元m 次多项式回归方程为:2012ˆ m m yb b x b x b x =++++ 二元二次多项式回归方程为:22011223142512ˆ yb b x b x b x b x b x x =+++++ 在一元回归分析中,如果依变量y 与自变量x 的关系为非线性的,但是又找不到适当的函数曲线来拟合,则可以采用一元多项式回归。

多项式回归的最大优点就是可以通过增加x 的高次项对实测点进行逼近,直至满意为止。

事实上,多项式回归可以处理相当一类非线性问题,它在回归分析中占有重要的地位,因为任一函数都可以分段用多项式来逼近。

因此,在通常的实际问题中,不论依变量与其他自变量的关系如何,我们总可以用多项式回归来进行分析。

§9.5.1多项式回归分析的一般方法多项式回归问题可以通过变量转换化为多元线性回归问题来解决。

对于一元m 次多项式回归方程,令212,,,m m x x x x x x === ,则该一元m 次多项式就转化为m 元线性回归方程01122ˆm m yb b x b x b x =++++因此用多元线性函数的回归方法就可解决多项式回归问题。

需要指出的是,在多项式回归分析中,检验回归系数i b 是否显著,实质上就是判断自变量x 的i 次方项i x 对依变量y 的影响是否显著。

对于二元二次多项式回归方程,令2211223142512,,,,z x z x z x z x z x x =====则该二元二次多项式函数就转化为五元线性回归方程01122334455ˆyb b z b z b z b z b z =+++++ 但随着自变量个数的增加,多元多项式回归分析的计算量急剧增加。

多项式回归方法一、多项式回归方法的概述多项式回归方法是一种用于建立非线性模型的回归分析方法,它通过将自变量的高次幂加入到线性回归模型中,来拟合非线性关系。

多项式回归方法可以处理单变量和多变量情况,可以适用于各种形状的数据集。

二、单变量多项式回归方法1. 数据准备首先需要准备一个单变量数据集,包含自变量和因变量。

可以使用Python中的numpy库生成随机数据。

2. 模型建立使用sklearn库中的PolynomialFeatures类对数据进行预处理,将自变量转化为高次幂,并拟合线性模型。

代码如下:```from sklearn.preprocessing import PolynomialFeaturesfrom sklearn.linear_model import LinearRegression# 生成随机数据import numpy as npx = np.linspace(-5, 5, 100)y = x**2 - 2*x + np.random.randn(100)*10# 将自变量转化为高次幂,并拟合线性模型poly = PolynomialFeatures(degree=2)X_poly = poly.fit_transform(x.reshape(-1,1))lin_reg = LinearRegression()lin_reg.fit(X_poly, y)```3. 模型评估使用R方值和均方误差(MSE)来评估模型的预测能力。

代码如下:```from sklearn.metrics import r2_score, mean_squared_error# 预测y_pred = lin_reg.predict(X_poly)# 评估r2 = r2_score(y, y_pred)mse = mean_squared_error(y, y_pred)print("R方值:", r2)print("均方误差:", mse)```三、多变量多项式回归方法1. 数据准备需要准备一个多变量数据集,包含自变量和因变量。

回归分析方法总结全面回归分析是一种统计分析方法,用于研究自变量与因变量之间的关系。

它可以帮助我们了解自变量对因变量的影响程度,以及预测因变量的值。

回归分析有多种方法和技术,本文将对几种常用的回归分析方法进行总结和介绍。

1. 简单线性回归分析简单线性回归分析是回归分析的最基本形式,用于研究单个自变量与因变量之间的关系。

它假设自变量与因变量之间存在线性关系,并且通过拟合一条直线来描述这种关系。

简单线性回归分析使用最小二乘法来估计直线的参数,最小化观测值与模型预测值之间的差异。

2. 多元线性回归分析多元线性回归分析是回归分析的一种拓展形式,用于研究多个自变量与因变量之间的关系。

它假设各个自变量与因变量之间存在线性关系,并通过拟合一个多元线性模型来描述这种关系。

多元线性回归分析使用最小二乘法来估计模型的参数。

3. 逻辑回归分析逻辑回归分析是回归分析的一种特殊形式,用于研究二分类变量与一系列自变量之间的关系。

它通过拟合一个Logistic函数来描述二分类变量与自变量之间的概率关系。

逻辑回归分析可以用于预测二分类变量的概率或进行分类。

4. 多项式回归分析多项式回归分析是回归分析的一种变体,用于研究自变量与因变量之间的非线性关系。

它通过引入自变量的高次项来拟合一个多项式模型,以描述非线性关系。

多项式回归分析可以帮助我们探索自变量与因变量之间的复杂关系。

5. 非线性回归分析非线性回归分析是回归分析的一种广义形式,用于研究自变量与因变量之间的非线性关系。

它通过拟合一个非线性模型来描述这种关系。

非线性回归分析可以用于分析复杂的现象或数据,但需要更复杂的参数估计方法。

6. 岭回归分析岭回归分析是回归分析的一种正则化方法,用于处理自变量之间存在共线性的情况。

共线性会导致参数估计不稳定或不准确,岭回归通过加入一个正则化项来缩小参数估计的方差。

岭回归分析可以帮助我们在共线性存在的情况下得到更可靠的结果。

7. 主成分回归分析主成分回归分析是回归分析的一种降维方法,用于处理高维数据或自变量之间存在相关性的情况。

多项式回归的用途

多项式回归是一种统计方法,用于探索变量之间的关系,并建立预测模型。

它在许多领域都有广泛的应用,包括但不限于以下几个方面:

1. 预测和决策制定:通过多项式回归分析,可以预测未来的趋势或结果,从而做出更好的决策。

例如,在金融领域,可以使用多项式回归来预测股票价格或利率变动;在市场营销中,可以用来预测产品需求或客户行为。

2. 质量控制和过程控制:多项式回归可以用于分析制造过程中产生的数据,帮助检测并控制质量。

例如,通过分析制造过程中的各种参数,可以预测产品的质量,从而及时调整生产过程。

3. 生物统计和医学研究:在生物统计和医学研究中,多项式回归被广泛用于分析数据,例如疾病发病率、药物效果等。

通过多项式回归分析,可以揭示变量之间的关系,从而为疾病预防和治疗提供依据。

4. 环境科学:在环境科学领域,多项式回归可以用于分析环境因素与生态系统之间的关系。

例如,通过分析气候、土壤和其他环境因素,可以预测生态系统的变化趋势,从而更好地保护和管理环境资源。

5. 社会科学:在社会科学领域,多项式回归被用于研究社会现象和人类行为。

例如,在心理学中,可以使用多项式回归分析人类情绪、认知和行为之间的关系;在经济学中,可以用来分析经济增长、贫困和收入分配等经济现象。

总的来说,多项式回归是一种强大的工具,可以帮助我们更好地理解数据和现象之间的关系,从而做出更明智的决策。

你应该要掌握的7种回归分析方法回归分析是一种常用的数据分析方法,用于研究自变量与因变量之间的关系。

在实际应用中,有许多不同的回归分析方法可供选择。

以下是应该掌握的7种回归分析方法:1. 简单线性回归分析(Simple Linear Regression):简单线性回归是回归分析中最简单的方法之一、它是一种用于研究两个变量之间关系的方法,其中一个变量是自变量,另一个变量是因变量。

简单线性回归可以用来预测因变量的值,基于自变量的值。

2. 多元线性回归分析(Multiple Linear Regression):多元线性回归是在简单线性回归的基础上发展起来的一种方法。

它可以用来研究多个自变量与一个因变量之间的关系。

多元线性回归分析可以帮助我们确定哪些自变量对于因变量的解释最为重要。

3. 逻辑回归(Logistic Regression):逻辑回归是一种用于预测二分类变量的回归分析方法。

逻辑回归可以用来预测一个事件发生的概率。

它的输出是一个介于0和1之间的概率值,可以使用阈值来进行分类。

4. 多项式回归(Polynomial Regression):多项式回归是回归分析的一种扩展方法。

它可以用来研究变量之间的非线性关系。

多项式回归可以将自变量的幂次作为额外的变量添加到回归模型中。

5. 岭回归(Ridge Regression):岭回归是一种用于处理多重共线性问题的回归分析方法。

多重共线性是指自变量之间存在高度相关性的情况。

岭回归通过对回归系数进行惩罚来减少共线性的影响。

6. Lasso回归(Lasso Regression):Lasso回归是另一种可以处理多重共线性问题的回归分析方法。

与岭回归不同的是,Lasso回归通过对回归系数进行惩罚,并使用L1正则化来选择最重要的自变量。

7. Elastic Net回归(Elastic Net Regression):Elastic Net回归是岭回归和Lasso回归的结合方法。

多项式回归结果解读

嘿,朋友们!今天咱就来唠唠多项式回归结果解读。

这可不是啥高深莫测的玩意儿,咱就接地气儿地说说哈。

比如说,你想想看,多项式回归就像是给数据搭了个特别的房子。

你放进去一堆数字,它就给你变出个形状来。

咱生活里不也这样嘛,你给各种食材丢进锅里,就能做出不同味道的菜。

那这些结果咋解读呢?哎呀呀,这可太重要了!好比说,你看到结果里某个系数很大,那就像菜里的盐放多了,特别显眼呗!这意味着啥呢?它可能就是影响结果的关键因素呀!嘿,这不是很有趣嘛!你再看那些小的系数,也许就像菜里的一点点调料,作用不大,但也不能少呀!

我之前就遇到过一个例子,分析一组销售数据的多项式回归结果。

哇,那结果出来,有些项的系数大得吓人!就好像一个大喊大叫的人,让你没法不注意它。

这不就说明这些因素对销售的影响大得很嘛!然后我们就顺着这个线索去深挖,果然找到了问题所在呢!

还有哦,有时候结果里会有些奇怪的波动,就像你走路突然被小石子绊了一下。

那咱就得小心瞧瞧,是不是有啥特别的情况影响了。

总之呢,解读多项式回归结果就跟解谜一样刺激!你要仔细观察,用心思考,把那些隐藏的信息都给挖出来。

不要怕麻烦,不要嫌复杂,因为这里面藏着的可都是宝贝呀!

咱的观点就是,多项式回归结果解读绝对是个好玩的事儿,只要你用心去感受,就能发现其中的奇妙之处。

别把它想得太高大上,咱普通人也能玩得转!。

多项式回归分析及其在科学领域的应用多项式回归分析是一种数据建模方法,它以多项式函数来拟合给定的数据集,从而得出函数的系数以及函数的特征。

多项式回归分析在科学领域有广泛的应用,可以用于研究复杂的数据集和模型。

多项式回归分析的基本原理多项式回归分析是一种线性回归的扩展形式,它在原有的线性模型中加入了多项式函数,从而引入了非线性项。

多项式回归分析的目标是通过最小二乘法来寻找一个多项式函数f(x) = a0 + a1*x + a2*x^2 +···+am*x^m 来拟合数据集,其中a0, a1, ..., am是多项式函数f(x)的系数,而m是多项式的最高次数。

在多项式回归分析中,最小二乘法的思想是通过找到最小化残差平方和的系数来确定多项式函数的参数。

残差指的是数据点的实际值和拟合函数值之间的差别。

通过最小化残差平方和来确定系数,可以保证拟合函数与实际数据的误差最小。

多项式回归分析的应用多项式回归分析在科学领域有广泛的应用,可以用于研究复杂的数据集和模型。

下面是一些具体的应用。

1. 地球科学地球物理学家使用多项式回归分析来研究地球上的地震数据。

这些数据通常很复杂,需要建立一个复杂模型来解释它们。

多项式回归分析可以产生一个符合地震数据的预测模型,从而更好地研究地球上的活动。

2. 计算生物学计算生物学家使用多项式回归分析来研究基因表达数据。

基因表达数据通常很复杂,需要建立一个复杂的模型来解释它们。

多项式回归分析可以产生一个符合基因表达数据的预测模型,从而更好地研究基因表达和生物学系统。

3. 医学医学研究人员使用多项式回归分析来研究病人的生理数据。

这些数据通常很复杂,但是医生需要了解病人病情的程度。

多项式回归分析可以产生一个符合病人生理数据的模型,从而帮助医生更好地评估病情。

4. 经济学经济学家使用多项式回归分析来研究经济数据。

这些数据通常不是很清晰,但是经济学家需要分析市场走势以及产品的表现。

多项式拟合与回归分析的应用1.多项式拟合的原理y = a0 + a1*x + a2*x^2 + ... + an*x^n其中,x是自变量,y是因变量,a0, a1, ..., an是多项式系数。

通过求解最小二乘法,可以得到最佳拟合多项式函数的系数值。

2.多项式拟合的应用-经济学:多项式拟合可以用来分析经济数据,如GDP的增长趋势、消费者物价指数的变化等,从而预测未来的经济走势。

-基因表达:多项式拟合可以用来分析基因表达数据,从而研究基因表达的变化趋势,识别关键的基因调控因子。

-金融市场:多项式拟合可以用来分析金融市场的变化趋势,如股票价格的波动,从而预测未来的股票走势。

-自然科学:多项式拟合可以用来分析实验数据,如物理实验中的数据变化趋势,生物实验中的生长曲线等,从而揭示数据背后的规律。

3.回归分析的原理回归分析是一种统计分析方法,用于研究因变量和自变量之间的关系。

它通过建立回归模型,确定自变量对因变量的影响程度。

最常用的是线性回归分析,即考虑一个自变量和一个因变量之间的线性关系。

线性回归模型可以表示为:y = b0 + b1*x + b2*x2 + ... + bn*xn其中,x是自变量,y是因变量,b0, b1, ..., bn是线性回归系数。

通过最小二乘法,可以求解出最佳的回归系数。

回归分析是一种广泛应用于各个领域的统计分析方法,具有很大的实用价值。

以下是一些典型的应用案例:-市场营销:回归分析可以用来研究广告投入和销售额之间的关系,从而优化市场营销策略。

-医学研究:回归分析可以用来研究患者的疾病风险和影响因素之间的关系,从而推断出预防措施和治疗方案。

-教育评估:回归分析可以用来研究学生的学习成绩和影响因素之间的关系,从而改善教学方法和学习环境。

-经济预测:回归分析可以用来研究经济数据之间的关系,如通货膨胀率和失业率之间的关系,从而预测未来的经济走势。

5.多项式拟合与回归分析的比较此外,多项式拟合更加灵活,可以通过调整多项式的次数来适应不同的数据变化趋势,而回归分析则更加简单和直观,适用于线性的因变量和自变量之间的关系。

多项性回归算法描述多项式回归是统计分析中的一种经典模型,它可以用来构建拟合现有数据的模型,从而帮助我们分析数据之间存在的相互关系。

它是由多项式组成的,也就是说,它假设变量之间存在一个多项式关系。

它能够预测未来的数据,并识别数据之间存在的不同模式。

多项式回归分析主要用于拟合数据,这通常是一个非线性关系,不能直接通过线性回归来拟合。

它可以用来加入变量的多项式甚至高次方程,以获得更好的拟合效果。

多项式回归不仅能够有效地对数据进行拟合,而且可以得出一系列高次方程的拟合参数,这些参数反映出变量间存在的相互关系,有助于改善预测结果准确性。

回归分析之前,首先要做好准备工作,主要包括理解数据的内涵,分析数据的可用性,以及根据目标功能进行回归模型的构建和选择。

在进行多项式回归分析之前,还要根据实际情况来确定最佳的多项式回归模型,以便获得较好的拟合效果。

多项式回归的主要技术方法有以下几种:1.小二乘法(Least Squares):这是一种最常用的方法,它把多项式回归模型优化到最小平方误差,来实现拟合效果。

2.叶斯估计和贝叶斯先验:这是一种基于概率论的统计学方法,它可以得出一系列参数的估计值,有助于更准确地拟合数据。

3. L1 L2罚:这是一种正则化方法,它可以有效抑制过拟合,并减少模型参数数量,同时改善预测结果的准确性。

多项式回归分析具有较高的效率和准确性,它可以用于预测数据范围内未知的数据,并可以通过多项式回归拟合参数来识别数据之间存在的不同模式。

然而,多项式回归也有一些不足之处,比如它可能会导致模型的过拟合,同时也存在估计参数的难度。

因此,使用多项式回归分析时,要注意有效地确定拟合模型,同时也要采取有效的措施来抑制过拟合,以便获得更准确的预测结果。

总之,多项式回归是统计分析中的一种非常有用的技术工具,可以有效地拟合复杂的数据,并利用模型参数识别数据之间存在的不同规律,提高预测准确性。

多项式回归的实现步骤

多项式回归是一种回归分析方法,用于建立自变量与因变量之间的非线性关系。

以下是多项式回归的实现步骤:

1.数据准备:收集或准备需要进行回归分析的数据,包括自

变量(X)和因变量(Y)的数据。

2.数据预处理:对数据进行预处理,包括缺失值处理、异常

值处理、数据标准化等。

3.确定多项式次数:根据实际情况和问题需求,选择合适的

多项式次数。

可以通过可视化和统计检验等方法来确定最

佳的多项式次数。

4.特征变换:将自变量X进行特征变换,将其转换为多项式

特征。

可以使用多项式特征转换函数,将原始的自变量X

转换为多维的多项式特征矩阵。

5.模型拟合:使用线性回归模型或多项式回归模型,将特征

变换后的自变量X和因变量Y进行拟合,得到模型参数。

6.模型评估:对拟合模型进行评估,检查模型的拟合效果和

统计指标,如均方误差(MSE)、决定系数(R²)等。

7.预测:使用拟合的多项式回归模型,对新的自变量数据进

行预测,得到预测值。

需要注意的是,多项式回归容易出现过拟合问题,即模型过于复杂,对训练数据过度拟合,使得在新数据上的预测效果变差。

在实际应用中,需要根据数据的特点和问题的要求,合理选择

多项式次数以避免过拟合问题。

此外,还可以使用正则化技术(如岭回归、Lasso回归)等方法来控制模型的复杂度和提高预测性能。