3第3章信息论课件

- 格式:ppt

- 大小:6.30 MB

- 文档页数:4

2006-11-61信息理论基础第8讲北京航空航天大学201教研室陈杰2006-11-62当前状态u l =(a l1, a l2, a l3, …, a lm )当前输出X l =a l1.信源状态S={S 1, S 2 ,…S J }, J =q m⎧⎪⎪⎨⎪⎪⎩()12|m q i j S S S p S S ⎡⎤⎢⎥⎢⎥⎣⎦()112|m mi i i i p a a a a + 状态转移概率p (S i |S j )由条件符号概率确定u lu l+1X l =a l新状态u l+1=(a l2, a l3, …, a lm ,a l )2.状态空间2006-11-633.极限熵当时间足够长时,遍历的m 阶马尔可夫信源可视为平稳信源()121lim |N N N H H X X X X ∞−→∞= ()112|m m H X X X X += 1m H +=()()|jj j s p S H X S =∑H (X|S j )是信源处于状态S j 时的条件熵()()()||log |jj i j i j S H X S p a S p a S =∑()()|log |ji j i j S p S S p S S =∑2006-11-64例3.7一阶马尔可夫信源的状态如例题图所示,信源X 的符号集为{0,1,2}。

(1)求平稳后的信源的概率分布;(2)求信源熵H ∞(3)求当p =0或p =1时信源的熵12pppppp2006-11-65解(1)状态转移矩阵令信源的平稳分布为则0 00 p p p p p p ⎡⎤⎢⎥=⎢⎥⎢⎥⎣⎦P []012 W W W =W 0011120121W pW pW W pW pW W W W =+⎧⎪=+⎨⎪++=⎩2006-11-66整理得,平稳后信源的概率分布(2)求信源熵H ∞。

根据平稳分布01213W W W ===()()jj k j s H p S H a S ∞=∑1113[lo g lo g ]3p p p p =×+11log logp p p p=+2006-11-67(3)p =0时p =1时∞→→=+=−=0311lim [loglog]lim ()log 0p p H p p ppp e∞→→=+=−=0311lim [loglog]lim ()log 0P P H p p ppp e3.5.3 马尔可夫信源解释:•信源熵表示的是信源的平均不确定性。

信息论基础知识主要内容:信源的数学模型 信源编码定理 信源编码算法 信道容量 通信的容限第 1 页 2011-2-21引言一、信息论的研究范畴 信息论是研究信息的基本性质及度量方法,研究信息的获取、传输、存储和处理的一般规律的科学。

狭义信息论:通信的数学理论,主要研究信息的度量方 法,各种信源、信道的描述和信源、信道的编码定理。

实用信息论:信息传输和处理问题,也就是狭义信息 论方法在调制解调、编码译码以及检测理论等领域的应用。

广义信息论,包括信息论在自然和社会中的新的应用, 如模式识别、机器翻译、自学习自组织系统、心理学、生物 学、经济学、社会学等一切与信息问题有关的领域。

第 2 页 2011-2-21二、信息论回答的问题通信信道中,信息能够可靠传 输的最高速率是多少?噪声信道编码定理 噪声信道编码定理信息进行压缩后,依然可以从已压 缩信息中以无差错或低差错恢复的 最低速率是多少?香农信源编码理论 香农信源编码理论最佳系统的复杂度是多少?第 3 页2011-2-21三、香农的贡献香农(Claude Elwood Shannon,1916~2001年), 美国数学家,信息论的创始人。

创造性的采用概率论的方法来研究通信中的问题,并且对 信息给予了科学的定量描述,第一次提出了信息熵的概念。

1948年,《通信的数学理论》(A mathematical theory of communication ) 以及1949年,《噪声下的通信》标志了信息论的创立。

1949年,《保密通信的信息理论》,用信息论的观点对信息保密问题做了 全面的论述,奠定了密码学的基础。

1959年,《保真度准则下的离散信源编码定理》,它是数据压缩的数学基 础,为信源编码的研究奠定了基础。

1961年发表“双路通信信道”,开拓了多用户信息理论(网络信息论)的研 究;第 4 页 2011-2-21四、信息论发展历史1924年 奈奎斯特(Nyquist,H.)总结了信号带宽和信息速率之 间的关系。

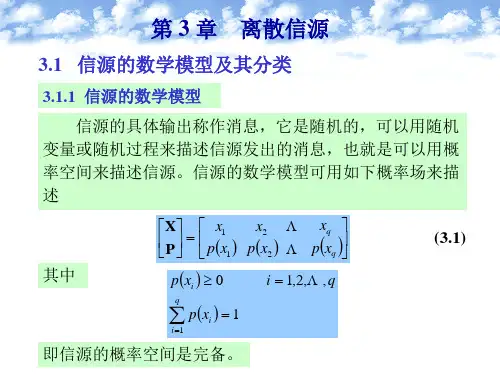

设信源输出符号集合,每次信源输

9

是⼀一个离散⽆无记忆信源,其概率空间为

其中

信源X的符号集合为

N次扩展信源X N符号集合为

15

的有记忆平稳信源(⼆二维平稳信源)输

23

当且仅当X 1和X 2统计独⽴立时等号成⽴立,此时信源相当于⼆二次⽆无记忆扩展;

当X 1和X 2之间相关时,联合熵⼩小于信息熵之和,即⼩小于单个消息符号X 熵的 2 倍。

由于

25

例:设某⼆二维离散信源X =的原始信源X 的信源模型为

中前后两个符号的条件概率

7/92/901/83/41/80

2/11

9/11

(1)若该信源为⼆二维⽆无记忆扩展信源,求信源的熵。

(2)若该信源为⼆二维平稳信源,如表,求信源的熵。

26

原始信源的熵为:

由条件概率确定的条件熵为:

由于符号之间的依赖性,条件熵⽐比信源熵减少了0.672bit

⼆二维离散⽆无记忆扩展信源的熵为:2H(X)=2*1.542=3.084(bit )7/92/901/83/4

1/8

2/119/11

27

信源X=

平均每发⼀一个消息所能提供的信息量,即联合熵

则每⼀一个信源符号所提供的平均信息量

⼩小于信源X所提供的平均信息量H(X)=1.542bit,这是

由于符号之间的统计相关性所引起的。

28

维平稳信源输出序列每N个符号⼀一组;各

30

则有:

时:

随N的增加是⾮非递增的;

给定时,平均符号熵≥条件熵;

–平均符号熵随N增加是⾮非递增的;

34

解:

35

1,2,......,J 某时刻随机

……

43

44。

摘要:信息是自从人类出现以来就存在于这个世界上了,天地万物,飞禽走兽,以及人类的生存方式都离不开信息的产生和传播。

人类每时每刻都在不停的接受信息,传播信息,以及利用信息。

而信息理论的提出却远远落后于信息的出现,它是在近代才被提出来而形成一套完整的理论体系。

信息论是信息科学的主要理论基础之一,它是在长期通信工程实践和理论基础上发展起来的。

是应用概率论、随机过程和数理统计和近代代数等方法,来研究信息的存储、传输和处理中一般规律的学科。

信息论的主要基本理论包括:信息的定义和度量;各类离散信源和连续信源的信息熵;有记忆、无记忆离散和连续信道的信道容量;无失真信源编码定理。

它的主要目的是提高通信系统的可靠性、有效性和安全性,以便达到系统的最优化。

编码理论与信息论紧密关联,它以信息论基本原理为理论依据,研究编码和译码的理论知识和实现方法。

关键字:信息信息论主要基本理论信息度量编码信息论是运用概率论与数理统计的方法研究信息、信息熵、通信系统、数据传输、密码学、数据压缩等问题的应用数学科学,是将信息的传递作为一种统计现象,同时它也给出了估算通信信道容量的方法。

它从诞生到今天,已经五十多年的历史了,是29世纪40年代后期从长期通讯实践中经过抽象、概括、提高而逐步总结出来的,现在已经成为一门独立的理论科学。

本书系统地介绍了香农信息论的基本内容及其应用,即信息的度量、信道容量以及信源和信道编码理论等问题。

全书共分九章,其中第1章主要介绍了信息的概念,信息论研究的对象、目的和内容,信息论的形成及发展。

第2章详细地介绍了各类离散信源的信息度量、信源熵及其性质。

第3章主要介绍了离散信源输出信息的有效表示问题,即离散信源的无失真编码问题,主要包括离散无记忆信源的等长和变长编码定理,离散平稳信源和马尔可夫信源的编码定理以及典型的变长码的编码方法。

第4章主要介绍了信道的数学模型和分类、信道传输的平均互信息、信道容量的概念及其各种计算方法。