信息论与编码基础-香浓三大定理

- 格式:pdf

- 大小:350.49 KB

- 文档页数:45

谈香农定理克劳德.香农,1916年4月30日出生于美国密歇根州的加洛德,他是信息时代的奠基人。

他这一生的两大贡献之一便就是信息论,信息熵的概念提出和香农公式。

信息传输给出基本数学模型的核心人物是香农。

1948年香农长达数十页的论文“通信的数学理论”成了信息论正式诞生的里程碑。

在他的通信数学模型中,清楚地提出信息的度量问题,他把哈特利的公式扩大到概率pi不同的情况,得到了著名的计算信息熵H的公式:H=∑-pi log pi如果计算中的对数log是以2为底的,那么计算出来的信息熵就以比特(bit)为单位。

今天在计算机和通信中广泛使用的字节 (Byte)、KB、MB、GB等词都是从比特演化而来。

“比特”的出现标志着人类知道了如何计量信息量。

香农的信息论为明确什么是信息量概念作出决定性的贡献。

香农在进行信息的定量计算的时候,明确地把信息量定义为随机不定性程度的减少。

这就表明了他对信息的理解:信息是用来减少随机不定性的东西。

或香农逆定义:信息是确定性的增加。

事实上,香农最初的动机是把电话中的噪音除掉,他给出通信速率的上限,这个结论首先用在电话上,后来用到光纤,现在又用在无线通信上。

我们今天能够清晰地打越洋电话或卫星电话,都与通信信道质量的改善密切相关。

香农定理:香农定理描述了有限带宽、有随机热噪声信道的最大传输速率与信道带宽、信号噪声功率比之间的关系.在有随机热噪声的信道上传输数据信号时,数据传输率Rmax与信道带宽B,信噪比S/N关系为: Rmax=B*Log2(1+S/N)。

在信号处理和信息理论的相关领域中,通过研究信号在经过一段距离后如何衰减以及一个给定信号能加载多少数据后得到了一个著名的公式,叫做香农(Shannon)定理。

它以比特每秒(bps)的形式给出一个链路速度的上限,表示为链路信噪比的一个函数,链路信噪比用分贝(dB)衡量。

因此我们可以用香农定理来检测电话线的数据速率。

香农定理由如下的公式给出: C=B*log2(1+S/N) 其中C是可得到的链路速度也就是信道容量,B是链路的带宽,S是平均信号功率,N是平均噪声功率,信噪比(S/N)通常用分贝(dB)表示,分贝数=10×log10(S/N)。

香农定理到底有什么含义?能通俗地解释一下么?香农定理是信息论的主要内容。

香农定理实际上是多个定理构成,国内似乎比较常用“香农三定理”的提法,而在国外资料很少这么提. 信息论和香农定理信息论研究信息的量化,存储和传播。

最初由克劳德·香农于1948年提出,他在具有里程碑意义的题为《通讯的数学原理》的论文中阐述了信号处理和通信操作(如数据压缩)的基本限制。

信息论的基本的应用主题包括无损数据压缩(例如ZIP文件),有损数据压缩(例如MP3和JPEG)和信道编码(例如用于DSL)。

信息论的一个关键量是“熵”。

熵是不确定性的定量描述。

例如,掷骰子的可能性。

信息论中还讨论的其他一些重要的量包括:互信息、信道容量、误差指数和相对熵等等。

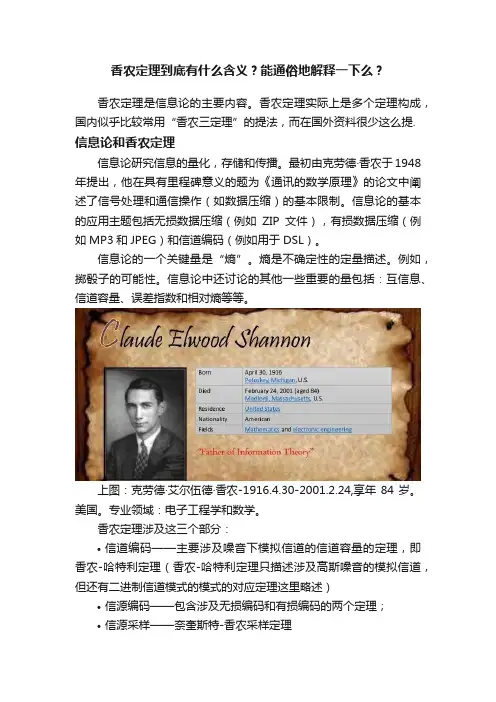

上图:克劳德·艾尔伍德·香农-1916.4.30-2001.2.24,享年84岁。

美国。

专业领域:电子工程学和数学。

香农定理涉及这三个部分:•信道编码——主要涉及噪音下模拟信道的信道容量的定理,即香农-哈特利定理(香农-哈特利定理只描述涉及高斯噪音的模拟信道,但还有二进制信道模式的模式的对应定理这里略述)•信源编码——包含涉及无损编码和有损编码的两个定理;•信源采样——奈奎斯特-香农采样定理但国内资料常说的“香农三定理”是指前两个部分所涉及的的三个定理,下面主要详述这三个定理:有噪音的模拟信道编码定理(国外资料一般称“香农-哈特利定理”)注意:这个定理在国外资料中才通常被简称为“香农定理”这个定理通俗地说,就是首先表明了如果传输信息的信道存在噪音,但是也可以实现信息的传递,然后可以根据带宽等参数计算出信息传递的最大的有效速率。

这可以通俗地类比我们熟悉的语音通话,虽然在电话里面有很多电流噪音或者环境噪音,但是我们仍然可以听懂对方讲的话。

因为我们用语音和语言对信息进行了双重的编码,“语音”这种编码可以在大量噪音干扰的情况下仍然能够工作,那是因为我们的声音通常有一个带宽,但噪音往往只是某一个频率的声音,不一定能够覆盖我们嗓音的全频段。

香农第一、二、三定理

第一定理:

将原始信源符号转化为新的码符号,使码符号尽量服从等概分布,从而每个码符号所携带的信息量达到最大,进而可以用尽量少的码符号传输信源信息

第二定理:

当信道的信息传输率不超过信道容量时,采用合适的信道编码方法可以实现任意高的传输可靠性,但若信息传输率超过了信道容量,就不可能实现可靠的传输。

第三定理:

只要码长足够长,总可以找到一种信源编码,使编码后的信息传输率略大于率失真函数,而码的平均失真度不大于给定的允许失真度,即D'<=D。

简述香农定理

香农定理,也称信源编码定理,是由美国科学家克劳德·香农

于1948年提出的。

该定理主要是基于信息论的原理,用于描

述信息压缩的极限。

根据香农定理,一个离散的信息源可以通过编码的方式实现数据压缩,使得所生成的编码的平均码长接近于信息源的信息熵,即信息源的平均自信息量的下界。

信息熵表示了一个信息源所包含的平均信息量,是信息的不确定性的量化指标。

香农定理除了提供了数据压缩的极限,还有效地揭示了信息传输的容量限制。

根据定理,一个通信信道的容量可以通过信道的带宽和信噪比来衡量,且信道的传输速率可以无限地接近其容量。

在实际应用中,香农定理为数据压缩、通信理论、计算机科学等领域提供了基本原理和指导。

它对于信息的编码和传输的优化起到了重要的作用。

信息论与编码模量信息论与编码是现代通信领域中的重要理论基础。

信息论研究信息的传输、存储和处理,而编码则是将信息转换为数字信号以便于传输和存储。

模量则是在数字信号中表示信息的一种方式。

在信息论中,信息的度量单位是比特(bit),表示信息的最小单位。

信息的传输速率可以用比特率(bit rate)来衡量,即每秒传输的比特数。

而信道容量(channel capacity)则是指在给定的信道条件下,能够传输的最大比特率。

信息论中的香农定理(Shannon's theorem)给出了信道容量的计算公式,即C=B*log2(1+S/N),其中B是信道的带宽,S是信号的平均功率,N是噪声的功率。

编码是将信息转换为数字信号的过程。

常见的编码方式包括带宽有限编码(Bandwidth-limited coding)、误差控制编码(Error-control coding)和压缩编码(Compression coding)等。

带宽有限编码是指在有限的带宽内尽可能地传输更多的信息,常见的带宽有限编码方式包括调制(Modulation)和多路复用(Multiplexing)等。

误差控制编码则是在传输过程中对信号进行纠错,以保证信息的正确传输。

常见的误差控制编码方式包括海明编码(Hamming coding)和卷积码(Convolutional coding)等。

压缩编码则是将信息压缩成更小的数据量,以便于存储和传输。

常见的压缩编码方式包括无损压缩(Lossless compression)和有损压缩(Lossy compression)等。

模量是在数字信号中表示信息的一种方式。

常见的模量方式包括振幅调制(Amplitude Modulation)、频率调制(Frequency Modulation)和相位调制(Phase Modulation)等。

振幅调制是指通过改变信号的振幅来表示信息,常见的振幅调制方式包括调幅(Amplitude Modulation)和振幅移位键控(Amplitude Shift Keying)等。

shannon第三编码定理-回复中括号内的内容是"shannon第三编码定理"。

下面是一篇关于Shannon 第三编码定理的1500-2000字的文章。

Shannon 第三编码定理是信息论中一个重要的定理,它揭示了信息传输的极限。

香农第三编码定理同时具有实际应用性和理论深度,为我们理解信息传输的效率和可靠性提供了重要的指导。

首先,我们需要了解一下信息论的基本概念。

信息论是研究信息量、信息传输和信息储存的一门学科。

它的核心概念是“信息熵”,它度量了信息系统的不确定性。

信息熵越大,信息系统的不确定性就越高,反之亦然。

然后,我们来介绍一下Shannon 第三编码定理。

这个定理是由克劳德·香农在1948年提出的,它给出了一种理论上的极限,即信息传输的最高速率。

具体而言,Shannon 第三编码定理指出,对于一个离散无记忆信源产生的信号流,它的最高传输速率取决于信道的带宽和信噪比之积。

通俗地讲,如果带宽越大或者信噪比越高,那么最高传输速率就越高。

这个定理为我们设计和优化信息传输系统提供了重要的指导。

接下来,让我们更详细地解释Shannon 第三编码定理的原理。

首先,我们需要明确信道的带宽和信噪比的概念。

信道的带宽是指信道所能传输的最高频率的范围。

信噪比是指信号的功率与噪声的功率之比。

在传输过程中,信号会受到噪声的干扰,信噪比越高,信号的清晰度就越高,传输质量就越好。

在这个基础上,Shannon第三编码定理的关键在于信息传输速率的计算。

信息传输速率的计算公式为:C = B * log2(1+S/N)其中,C表示信息传输速率,B表示信道的带宽,S/N表示信噪比。

从上面的公式可以看出,当信噪比越大时,信息传输速率也会随之增加。

这是因为信噪比的增加意味着信号受到噪声的干扰越小,传输质量越好,信息传输速率也就越高。

而带宽的增加也会提高信息传输速率。

这个定理的意义在于它告诉我们,为了提高信息传输速率,我们可以从两个方面入手。

香农编码定理香农编码定理是一种信息论中的定理,它描述了在给定一系列符号和它们出现的概率的情况下,如何设计一个最优的编码方案。

这个定理由克劳德·香农在1948年提出,并被认为是信息论的基石之一。

在现代通信中,信息的传输、存储和处理是非常重要的。

编码是其中的一个关键环节,而编码的目的是将信息转化为二进制(或其他进制)形式的数据。

例如,将人类语言转化为可以被计算机理解的形式,或者将数字音乐文件压缩为更小的文件格式。

香农编码定理的核心思想是用更少的比特数来代表一个出现频率较高的符号,用更多的比特数来代表一个出现较低的符号。

这样做能够达到节省存储和传输空间的目的。

这个编码方案是通过构建一颗二叉树来实现的。

在这个二叉树中,每一个叶子节点代表一个符号,而从根节点到叶子节点路径上的编码实际就是用0和1来表示符号出现的频率。

假设有n个符号,每一种符号的出现概率分别为p1、p2、p3......pn。

通过香农编码定理,可以得到一个最优的编码方案,使得整个编码的长度最短。

这个最优的编码方案可以表示为H(S)≤L(S)≤H(S)+1,其中H(S)是符号熵,L(S)是这个编码的平均长度。

符号熵(也称为信息熵)指的是每一个符号所能够传递的信息的平均值,它可以用公式E=-Σi=1 to np(i) log2p(i)来计算,其中p(i)代表第i种符号的概率。

符号熵是香农编码定理的核心概念,它表示了一个平均的信息量,即需要多少比特来表示一个符号的信息。

通过香农编码定理,我们可以得出一个最优的编码方案,即每一个符号的编码长度都是整数位的比特数。

这个编码方案可以用于压缩数据,使得数据传输的速度更快,同时也可以节省存储空间。

总之,香农编码定理在现代通信和计算机科学中具有非常重要的作用,它为我们提供了一种最优的编码方案,使得数据能够被更加高效地传输和处理。

现代通信与香农三大定理姓名:杨伟章学号:201110404234摘要:当我们提起信息论,就不得不把香农和信息论联系在一起,因为正是香农为通信理论的发展所做出的划时代贡献,宣告了一门崭新的学科——信息论的诞生。

从此,在香农信息论的指导下,为了提高通信系统信息传输的有效性和可靠性,人们在信源编码和信道编码两个领域进行了卓有成效的研究,取得了丰硕的成果。

其实,信息论是人们在长期通信实践活动中,由通信技术与概率论、随机过程、数理统计等学科相互结合而逐步发展起来的一门新兴交叉学科。

关键词:信息论基础现代通信系统香农三大定理上个世纪四十年代,半导体三极管还未发明,电子计算机也尚在襁褓之中。

但是通信技术已经有了相当的发展。

从十九世纪中叶,电报就已经很普遍了。

电报所用的摩斯码(Morse Code),就是通信技术的一项杰作。

摩斯码用点和线(不同长度的电脉冲)来代表字母,而用空格来代表字母的边界。

但是每个字母的码不是一样长的。

常用的字母E只有一个点。

而不常用的Z有两划两点。

这样,在传送英语时,平均每个字母的码数就减少了。

事实上,摩斯码与现代理论指导下的编码相比,传送速度只差15%。

这在一百五十多年前,是相当了不起了。

在二次世界大战时,雷达和无线电在军事上广泛应用。

无线电受各种噪声的干扰很厉害,这也给通讯技术提出了新的课题。

各种不同的调制方式也纷纷问世。

于是就出现了这样一个问题:给定信道条件,有没有最好的调制方式,来达到最高的传送速率?“传输速率是波特率与每波特所含比特数的乘积。

波特率受频宽的限制,而每波特所含比特数受噪声的限制。

”前一个限制,由那奎斯特(Harry Nyquist)在1928年漂亮地解决了。

而后一个问题则更复杂。

1928年,哈特利(R. V. L. Hartley)首先提出了信息量的概念,并指出编码(如摩斯码)在提高传送速度中的重要作用。

但是他未能完整定量地解决这个问题。

二战期间,维纳(Norbert Wiener)发展了在接收器上对付噪声的最优方法。

现代通信与香农的三大定理LT至此,香农开创性地引入了“信息量”的概念,从而把传送信息所需要的比特数与信号源本身的统计特性联系起来。

这个工作的意义甚至超越了通信领域,而成为信息储存,数据压缩等技术的基础。

解决了信号源的数据量问题后,我们就可以来看信道了。

信道(channel)的作用是把信号从一地传到另一地。

在香农以前,那奎斯特已经证明了:信道每秒能传送的符号数是其频宽的一半。

但问题是,即使这些符号,也不是总能正确地到达目的地的。

在有噪声的情况下,信道传送的信号会发生畸变,而使得接收者不能正确地判断是哪个符号被发送了。

对付噪声的办法是减少每个符号所带的比特数:“而每个波特所含的比特数,则是受噪声环境的限制。

这是因为当每个波特所含的比特数增加时,它的可能值的数目也增加。

这样代表不同数据的信号就会比较接近。

例如,假定信号允许的电压值在正负1伏之间。

如果每个波特含一个比特,那么可能的值是0或1。

这样我们可以用-1伏代表0,用1伏代表1。

而假如每波特含两个比特,那么可能的值就是0,1,2,3。

我们需要用-1伏,-0.33伏,0.33伏,1伏来代表着四个可能值。

这样,如果噪声造成的误差是0.5伏的话,那么在前一种情况不会造成解读的错误(例如把-1V 错成了-0.5伏,它仍然代表0)。

而在后一种情况则会造成错误(例如把-1V错成了-0.5伏,它就不代表0,而代表1了)。

所以,每个波特所含的比特数也是不能随便增加的。

以上两个因素合起来,就构成了对于数据传输速率的限制。

”其实,除此之外,还有一个对付噪声的办法,就是在所有可能的符号序列中只选用一些来代表信息。

例如,如果符号值是0和1,那么三个符号组成的序列就有8个:000,001,010,011,100,101,110,111。

我们现在只用其中两个来代表信息:000和111。

这样,如果噪声造成了一个符号的错误,比如000变成了010,那我们还是知道发送的是000而不是111。

香农信息论中的三大极限定理

香农信息论中有三个重要的极限定理,它们对于信息的传输和压缩有着深远的影响。

第一个定理是信道容量定理,它指出在给定的信道和噪声条件下,信息的传输速率存

在一个上限,即信道的容量。

这个定理的核心思想是,对于给定的信噪比,存在一个最大

的传输速率,如果超过这个速率,信息的错误率将会变得不可接受,而如果低于这个速率,信道的资源没有得到最充分的利用。

第二个定理是无损压缩定理,它指出在给定的信息源下,存在一个理论上的最小压缩比,即无损压缩的极限。

这个定理说明了无论采用何种无损压缩算法,都无法将压缩后的

信息大小减小到小于其信息熵的大小。

信息熵是在给定的信息源下,所包含的平均信息量

的度量,它表示了信息源的不确定性。

第三个定理是有损压缩定理,它指出在给定的信息源下,存在一个理论上的最高压缩比,即有损压缩的极限。

与无损压缩不同,有损压缩允许在压缩过程中丢失一定量的信息,以达到更高的压缩比。

根据有损压缩定理,无论采用何种有损压缩算法,压缩后的信息大

小将永远大于其信息熵。

这意味着,虽然有损压缩可以实现更高的压缩比,但也会导致信

息的质量损失。

这三个极限定理在信息论中具有重要的理论和实际意义。

它们为信息的传输和压缩提

供了指导原则,帮助人们理解信息的本质和限制,同时也为信息技术的发展提供了理论基础。

一:数据处理定理:(1):I(X;Z)<=I(X;Y)表明从Z所得到的关于X的信息量小于等于从Y得到的关于X的信息量。

如果把Y-->Z看作数据处理系统,那么通过数据处理后,虽然可以满足我们的某种要求,但是从信息量来看,处理后会损失一部分信息,最多保持原有的信息,也就是说,对接收到的数据Y进行处理后,绝不会减少关于X的不确定性。

这个定理称为数据处理定理。

二:即时码,唯一可译码(充要条件)(1):一个唯一可译码成为即时码的充要条件是时钟任何一个码字都不是其他码字的前缀。

这个很好理解,因为如果没有一个码字是其他码字的前缀,则在接受到一个相当于一个完整码字的符号序列后便可以立即译码,而无须考虑其后的码符号。

反过来说,如果有一个码字是其他码字的前缀,假设Wj是Wj的前缀,则在接收到相当于Wj的码符号序列后还不能立即判使之定它是一个完整的码字,若想正确译码,还必须参考后续后续的码符号,这与即时码的定义相矛盾,所以即时码的必要条件是其中任何一个码字都不是其他的码字的前缀。

三:香农定理:(1)第一定理:要做到无失真信源编码,每个信源符号平均所需最少得的r元码符号数就是信源的熵值(以r进制单位为信息量单位)(2)第二定理:设有一个离散无记忆平稳信道,其信道容量为C。

当信息传输率R<C时,只要码长n足够长,则总存在一种编码,可以使译码错误概率PE任意小。

否则,如果R>C,则无论取多大,也找不到一种编码,使译码错误概率PE任意小。

四:差错控制和译码规则(1)选择译码函数F(yi)=x*,使之满足条件p(x*/yi)>=p(xi/yi)称为最大后验概率译码规则,又称为最小错误概率准则,最优译码,最佳译码。

(2)选择译码函数F(yi)=x*,使之满足条件p(yi/x*)>=p(yi/x*)称为似然译码规则。

五:掌握信息的基本特点:(1):信息是可以度量,而且它具有不确定性。

六:了解信息论的发展及最新成果:(1):信息论创立的标志是1948年香农发表的论文。

香农定理及其相关一、香农第一、二和三编码定理香农第一定理和香农第二定理指明:无论是无噪声信道,还是有噪声信道,只要信道的信息传输率小于信道容量,总能找到一种编码,在信道上以任意小的错误概率和任意接近信道容量的信息传输率传输信息。

反之,若信道信息传输率大于信道容量,一定不能使传输错误概率任意小,传输必然失真。

信息率失真函数R(D)是满足保真度准则(D)时所必须具有的最小信息率,在进行信源压缩之类的处理时,R(D)就成为一个界限,不能让实际的信息率低于R(D),即限失真信源编码定理,也就是通常所说的香农第三编码定理。

二、无失真信源编码和限失真信源编码• 1.无失真信源编码:适用:离散信源或数字信号不适用:连续信源或模拟信号。

• 2.限失真信源编码:连续信源的每个样值所能载荷的信息量是无限大,对连续信源不引入失真是不可能的.连续信号所对应的信宿一般是人,当失真在某一限度以下时是不易被感觉到的,因此是容许的.三、香农编码定理→信源编码方法1. 无记忆信源•理论:条件熵必然不大于无条件熵,而且常远小于后者.•编码方法:解除符号间的相关性可进一步压缩码率.2.有记忆信源•编码方法:多个符号合成为一个新符号,并设新符号组成的序列是独立序列,这样就可用上述方法进行编码.•缺陷:合并的符号数少时,新符号间的相关性不能解除;合并符号数多时,复杂性将大为提高,而且对实时处理十分不利.•改进:预测编码和变换编码•预测编码:利用前几个符号来预测后一个符号的值,预测值与实际值之差,亦即预测误差作为待编码的符号,这些符号间的相关性就大为减弱,这样可提高压缩比。

•变换编码:样值空间的变换,例如从时域变到频域,在某些情况下,可减弱相关性,取得良好的压缩比.四、理论→实践•在实际生活中,通常只是要求在保证一定质量的前提下在信宿近似地再现信源输出的信息,或者说在保真度准则下,允许信源输出的信息到达信宿时有一定的失真。

•限失真信源编码的信息率失真理论是信号量化、模数转换、频带压缩和数据压缩的理论基础,在图像处理、数字通信等领域得到广泛的应用。

shannon第三编码定理-回复什么是Shannon第三编码定理?Shannon第三编码定理是由美国数学家克劳德·E·香农于1948年提出的一项重要定理,也被称为数据压缩定理或信息论中的定理。

该定理阐述了在具有随机性的数据中,编码后的平均编码长度与数据的熵之间的关系。

香农第三编码定理的公式可以表示为:H(X) ≤L(X) < H(X) + 1其中,H(X)代表数据的熵,L(X)代表编码后数据的平均编码长度。

为什么需要数据压缩?数据压缩是信息技术中非常重要的一部分。

在我们日常的生活、工作和学习中,我们的电脑、手机等设备都需要存储和传输大量的数据。

然而,存储和传输大量的数据所需的时间、空间和成本都非常高昂。

因此,对数据进行压缩可以帮助我们节省存储空间、提高数据传输速度,并降低相关的成本。

此外,数据压缩在网络传输和存储过程中也起到了重要的作用。

尤其在互联网时代,我们需要轻松快捷地共享和传输各种类型的数据。

因此,数据压缩技术成为必不可少的工具。

如何理解Shannon第三编码定理?Shannon第三编码定理揭示了数据压缩的基本原理。

从定理中可以看出,任何具有随机性的数据都可以通过编码来减少存储空间和传输成本。

定理中的L(X)表示编码后数据的平均编码长度,而H(X)表示数据的熵,也就是数据中所包含的信息的量。

定理表明,编码后的平均编码长度L(X)必然大于等于数据的熵H(X),但是小于熵加一。

也就是说,通过合理的编码方法,我们可以将数据的平均编码长度控制在非常接近熵的范围内,从而实现高效的压缩效果。

举例来说,假设我们有一个具有随机性的二进制数据,其中0和1的出现频率大致相等。

根据Shannon第三编码定理,我们可以将每个0和每个1分别编码为不等长的比特串,使得整个数据的平均编码长度尽可能接近熵。

这样就可以实现对原始数据的高效压缩。

Shannon第三编码定理的应用Shannon第三编码定理的应用非常广泛。