STDP 学习机制

- 格式:doc

- 大小:1.02 MB

- 文档页数:3

精益LPTPS生产管理培训精益生产是一种管理方法,旨在通过消除浪费和优化价值流程,提高生产效率和质量。

在LPTPS(Lean Production and Total Productive System)生产管理培训中,培训师通常会分享以下几个关键概念和工具,帮助企业实施精益生产管理:1. 消除浪费:浪费是生产过程中不必要的步骤、材料或资源的浪费。

培训将教授参与者如何识别和消除不必要的浪费,例如过度生产、库存过剩、无效运输等。

通过消除浪费,企业能够减少成本并提高生产效率。

2. 价值流分析:通过价值流分析,企业能够理解产品或服务的价值流,从而识别出生产过程中的瓶颈和改进机会。

培训将介绍如何使用价值流分析工具,如价值流图和价值流量图,以帮助参与者分析和改进生产过程。

3. 5S工作场所组织:5S是指整理、整顿、清扫、清洁和素养的日本管理方法。

培训将教授参与者如何实施5S方法,使工作环境整洁、安全和有序。

这有助于提高工作效率和员工满意度。

4. SMED(单分钟交换模具):SMED是一种减少设备停机时间的方法。

培训将向参与者展示如何分析设备换模过程,并在最小时间内进行改进。

减少设备停机时间可提高生产效率和灵活性。

5. Kaizen(改善):Kaizen是一种持续改进的方法,鼓励员工不断提出改进建议和解决问题。

培训将讨论如何创建一个鼓励员工参与和提出改进意见的文化,并介绍Kaizen事件的策划和执行方法。

除了以上的关键概念和工具,培训还可能包括实际案例研究、团队协作练习和现场参观等,帮助参与者将所学应用到实际工作中。

通过精益LPTPS生产管理培训,企业可以提高生产效率、降低成本、改善产品质量和员工参与度。

这种培训为企业提供了一个有效的方法来推动生产管理的持续改进,使企业能够在竞争激烈的市场中保持竞争力。

精益生产是一种以客户需求和价值为导向的生产管理方法。

通过精益生产的实施,企业能够提高效率、降低成本,并为客户提供更高质量的产品和服务。

脉冲神经网络研究进展综述一、本文概述随着和机器学习的飞速发展,神经网络作为其中的核心组件,已经得到了广泛的研究和应用。

然而,传统的神经网络模型在处理复杂、动态和实时的任务时,由于其计算复杂度高、能耗大等问题,面临着巨大的挑战。

脉冲神经网络(Spiking Neural Networks,SNNs)作为一种新型的神经网络模型,以其独特的脉冲编码和传输机制,为解决这些问题提供了新的思路。

本文旨在全面综述脉冲神经网络的研究进展,包括其基本原理、模型设计、训练方法以及应用领域等方面。

我们将详细介绍脉冲神经网络的基本概念和脉冲编码机制,阐述其与传统神经网络的主要区别和优势。

然后,我们将回顾脉冲神经网络模型的发展历程,分析各种模型的特点和应用场景。

接着,我们将探讨脉冲神经网络的训练方法和学习机制,包括监督学习、无监督学习和强化学习等。

我们将展示脉冲神经网络在各个领域的应用实例,如图像识别、语音识别、机器人控制等,并展望其未来的发展方向。

通过本文的综述,我们希望能够为研究者提供一个清晰、全面的脉络,以了解脉冲神经网络的研究现状和发展趋势,为未来的研究提供有益的参考和启示。

我们也期望能够激发更多研究者对脉冲神经网络的兴趣和热情,共同推动这一领域的发展。

二、脉冲神经网络的基本原理脉冲神经网络(Spiking Neural Networks,SNNs)是一种模拟生物神经网络中神经元脉冲发放行为的计算模型。

与传统的人工神经网络(Artificial Neural Networks,ANNs)不同,SNNs的神经元通过产生和传递脉冲(或称为动作电位)来进行信息的编码和传输。

这种模型更接近生物神经元的实际运作机制,因此具有更强的生物可解释性和更高的计算效率。

在SNNs中,神经元的状态通常由膜电位(Membrane Potential)来表示。

当膜电位达到某个阈值时,神经元会发放一个脉冲,并将膜电位重置为静息状态。

脉冲的发放时间和频率都可以作为信息的编码方式。

格式塔学习理论格式塔学习理论是由美国心理学家贝尔(Bruner)提出的一种学习理论,于1960年首次提出,它提倡从“高层次”到“低层次”的教学方式,每个层次都有其自身的目标,有利于学习者更好地理解和掌握知识。

格式塔学习理论强调教师针对学生能力水平,从上至下从高层次到低层次授课,让学生按照从简单到复杂的步骤来学习,使学习的过程更加有效。

根据格式塔学习理论,教师应该通过“抽象”、“综合”、“操作”、“应用”四个层次来实施课堂教学,这些层次的具体内容如下:1、抽象层次:这一层次的教学内容是抽象概念,以及课程中可能用到的术语和定义;2、综合层次:在这一层,教师要把课程中所涉及到的理论融入实际,使学生在认知和情感上有深刻的体验;3、操作层次:教师要让学生在该层次上实践,让学生对课程中的技能有更深的理解;4、应用层次:学生需要灵活地将所学知识运用到实际中,来解决问题。

格式塔学习理论认为,每一层都是前一层的延伸,教学内容也从上到下扩大、拓宽,用层次最能反映学生的学习成果,也是教师最关注的层次。

格式塔学习理论强调学习者从简单入手,在每一层次上都有其固定的学习目标,在每一层次学习的内容都不一样,学生通过有节奏的、有系统的学习和练习,不断提高学习效率,掌握学习内容。

此外,格式塔学习也有其局限性,它是针对能力水平较低的学生而设计,如果对学生的学习能力水平没有恰当的估计和了解,就很容易忽略学生的实际能力,无法让学生发挥出应有的作用和学习能力。

总而言之,格式塔学习理论是一种有效的学习理论,能够有效地提高学习效率,提高学习效果,是一种有价值的教学理论。

但是,教师在按照格式塔学习理论实施课堂教学时,也要根据学生的能力水平,恰当调整教学内容,以保证学生可以更好地掌握知识,实现更好的学习效果。

“STD课堂教学模式”的探索与研究时间:2012-07-22 12:37来源:《教育艺术》作者:陈树平点击: 195 次“STD 课堂教学模式”是借用了“教学相长”的涵义,意为学生和教师在合作学习中同时得到发展、提高。

包括两层涵义:一是指课堂中教师与学生共同学习、共同提高;二是指“教”与“学”既是教师亦教亦学的两个方面,也是学生亦学亦教的两个方面。

但是把学生S(student)放在教师T(teacher)的前面是为了突出学生的主体地位,D是发展(develop)。

旨在建构一种高效课堂教学模式,即以学生自主先学为先导,以合作研讨、多向互动为主要学习方式,以当堂训练、即时反馈为效能保障的崭新课堂教学模式。

一、三个理论依据1.“小组合作学习”理论。

小组合作学习(又称合作学习)于20 世纪70 年代率先兴起于美国,并且已被广泛应用于中小学教学实践。

2.“最近发展区”理论。

前苏联著名心理学家维果茨基就教学与发展问题,提出了“最近发展区”之说,即儿童发展可能性的思想,归结为“教学应当走在发展的前面”。

教师“后教”,即是让学习者通过自身独立的“自主先学”及互助的“合作讨论”后发觉依然不能解决的任务,教师这才加以适当而不过分的点拨或指导,就是走在学习者发展的前面的教学,是依据“最近发展区”的教学。

3.“学习金字塔”理论。

“学习金字塔”理论是一种现代学习方式的理论,最早是由美国学者、著名的学习专家埃德加•戴尔在1946 年发现并提出的。

它用数字形式形象显示了采用不同的学习方式,学习者在两周以后还能记住内容的多少。

二、四个教学原则1. 坚持先学后教、以学定教、善学促教为核心的原则。

2. 坚持师亦生、生亦师、师生共研、教学相长的原则。

教师创设适宜的问题环境,充分发挥学生的主体地位,让学生的“活”、师生的“动”有序进行。

3. 坚持“三讲三不讲”的原则。

讲学生提出的问题,讲学生不理解的,讲知识缺陷和易混易错知识;学生自己已经学会了的不讲,学生自己能够学会的不讲,老师讲了学生也学不会的不讲。

C语言技巧:stdin,stdout,stderr详解NAMEsetbuf, setbuffer, setlinebuf, setvbuf - 流缓冲操作SYNOPSIS 览#include <stdio.h>void setbuf(FILE *stream, char *buf);void setbuffer(FILE *stream, char *buf, size_t size);void setlinebuf(FILE *stream);int setvbuf(FILE *stream, char *buf, int mode , size_t size);DESCRIPTION 述有三种类型的缓冲策略,它们是无缓冲,块缓冲和行缓冲。

当输出流无缓冲时,信息在写的同时出现于目标文件或终端上;当是块缓冲时,字符被暂存,然后一起写入;当是行缓冲时,字符被暂存,直到要输出一个新行符,或者从任何与终端设备连接的流中(典型的是stdin)读取输入时才输出。

函数fflush(3)可以用来强制提前输出。

(参见 fclose(3)) 通常所有文件都是块缓冲的。

当文件I/O操作在文件上发生时,将调用 malloc(3),获得一个缓冲。

如果流指向一个终端 (通常 stdout都是这样),那么它是行缓冲的。

标准错误流 stderr 默认总是无缓冲的。

函数setvbuf 可以用在任何打开的流上,改变它的缓冲。

参数mode必须是下列三个宏之一:_IONBF 无缓冲_IOLBF 行缓冲_IOFBF 完全缓冲除非是无缓冲的文件,否则参数buf 应当指向一个长度至少为size字节的缓冲;这个缓冲将取代当前的缓冲。

如果参数 buf 是NULL,只有这个模式会受到影响;下次 read 或 write操作还将分配一个新的缓冲。

函数setvbuf只能在打开一个流,还未对它进行任何其他操作之前使用。

其他三个函数调用是函数setvbuf的别名,函数setbuf与使用下列语句完全等价:setvbuf(stream, buf, buf ? _IOFBF : _IONBF, BUFSIZ);函数 setbuffer 与此相同,但是缓冲的长度由用户决定,而不是由默认值 BUF-SIZ 决定。

STL (Standard Template Library)是 C++ 标准库中提供泛型容器和算法的集合。

它使用模板化编程,可以创建编译时确定类型和行为的数据结构和算法。

STL 原理STL 由以下关键思想组成:•泛型编程: STL 容器和算法使用模板创建,这意味着它们可以处理不同类型的对象,而无需创建特定类型版本的容器或算法。

•容器: STL 提供各种容器,例如向量、列表、集合和映射,用于存储和组织数据。

容器提供了基于索引的访问、插入、删除和遍历等常用操作。

•迭代器: STL 使用迭代器来遍历容器。

迭代器指向容器中的元素,并提供对该元素及其邻居的访问。

•算法: STL 提供了大量的算法,用于执行常见的操作,例如排序、搜索、转换和修改容器中的数据。

算法独立于容器类型,并使用迭代器来遍历数据。

STL 组件STL 主要由以下组件组成:•容器: vector、list、deque、set、map、multiset、multimap•迭代器: input iterator、output iterator、forward iterator、bidirectional iterator、random access iterator•算法: find、sort、transform、copy•函数对象: less、greater、equal_toSTL 的优点•可重用性: STL 容器和算法是可重用的组件,可以节省开发时间和精力。

•类型安全: STL 使用模板来确保类型安全性,这意味着编译器会在编译时检查类型错误。

•效率: STL 算法针对性能进行了优化,并使用高效的数据结构。

•标准化: STL 是 C++ 标准的一部分,这意味着所有 C++ 编译器都支持它。

使用 STL 的步骤要使用 STL,请执行以下步骤:1.包含必要的头文件。

2.创建包含数据类型的容器对象。

3.使用迭代器遍历容器并执行操作。

4.使用算法对容器中的数据执行操作。

stdp规则

STD(Spike-Timing-Dependent)P规则是一种突触可塑性算法,它描述了当来自一个突触的突触后电位和信号输入到突触的相对时间差值很小时,突触强度的增加以及相反的情况。

这种规则是神经科学领域的一个重要研究方向,最早由Gerstner、Kempter等学者提出。

STD P规则是基于神经元在突触后电位(Post-Synaptic Potential,PSP)上不同于平衡值的偏移响应的时间相关增强(LTP)或时间相关抑制(LTD)。

这种游离钙离子的增加或减少可以在合适的神经元膜电位情况下改变突触的强度。

在神经元之间的连接中,这种差异附加了有效的模式识别能力,因为突触的强度会反映出神经元的性质。

STD P规则和Hebb学习规则有些相似,但STD规则引入了来自突触后电位和突触的相对时间差的影响。

这种规则的优势在于它能够顾及到突触后电位和突触的相对时间差,使得它可以对“警报”信号的强度进行自适应调整,从而改变神经元膜电位的偏置。

不仅如此,STD P 规则还能够适应单个突触的PSP偏移的大范围变化,从而优化了突触调整过程的规则。

总之,STD P规则是神经科学领域的一个重要研究方向。

它描述了当突触后电位和信号输入到突触的相对时间差小的时候,突触强度会增

加,反之则会减少。

这种规则在神经元之间的连接中起到了有效的模

式识别能力。

相比其他的学习规则,这种规则是一种更为有效的自适

应调整规则,因为它顾及到了突触后电位和突触的相对时间差。

同时,STD P规则能够适应突触的PSP偏移变化,优化了突触调整过程的规则。

因此,这种规则具有广泛的应用前景,值得进一步研究和探讨。

脉冲神经网络的监督学习算法研究综述一、本文概述随着的快速发展,脉冲神经网络(Spiking Neural Networks,SNNs)作为一种更接近生物神经系统的计算模型,正逐渐引起研究者的广泛关注。

脉冲神经网络以脉冲序列作为信息编码和传递的基本方式,不仅具有生物神经元的动态特性和时间编码机制,而且能够在硬件实现上更高效地模拟和处理大规模神经网络。

近年来,脉冲神经网络的监督学习算法研究取得了显著的进展,这些算法在模式识别、图像处理、语音识别等领域的应用中展现出了独特的优势。

本文旨在全面综述脉冲神经网络的监督学习算法的研究现状和发展趋势。

我们将首先介绍脉冲神经网络的基本原理和模型,包括神经元的脉冲发放模型、网络的拓扑结构和学习机制等。

接着,我们将重点综述几种典型的脉冲神经网络监督学习算法,包括基于脉冲时间依赖性的学习算法、基于突触权重的学习算法以及混合学习算法等。

我们还将讨论这些算法在不同应用场景中的性能表现,以及它们各自的优势和局限性。

我们将对脉冲神经网络的监督学习算法的未来发展方向进行展望,包括算法的优化和改进、新型脉冲神经网络模型的设计、以及与其他计算模型的融合等。

通过本文的综述,我们希望能够为脉冲神经网络的研究者提供一个清晰的研究脉络和有价值的参考,同时也为脉冲神经网络在实际应用中的推广和发展提供有力的支持。

二、脉冲神经网络基础知识脉冲神经网络(Spiking Neural Networks, SNNs)是一种模拟生物神经系统中脉冲信号传递方式的计算模型。

与传统的人工神经网络(Artificial Neural Networks, ANNs)不同,SNNs中的神经元通过发放脉冲(或称为动作电位)来进行信息的传递和处理,而不是通过连续的激活函数。

这种脉冲传递方式使得SNNs在模拟生物神经系统时具有更高的生物真实性。

在SNNs中,神经元通常被抽象为脉冲发生器模型,如Hodgkin-Huxley模型、Leaky Integrate-and-Fire(LIF)模型等。

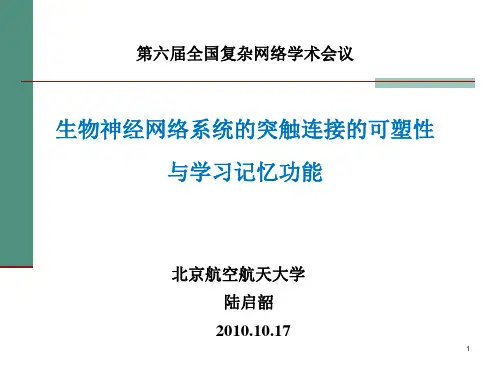

STDP 学习机制在神经科学中,神经突触可塑性是指两个神经元连接能力或突触在强度上的变化。

生理书:突触可塑性:指突触的形态和功能可发生较为持久的改变的特性或现象一.提出(从Hebb规则到STDP)根据1943年Hebbian提出的学习规则,如果突触能够持续引起突触后靶神经元产生动作电位,该突触的突触效能会增加。

Henry Markram提出的Spike Timing Dependent Plasticity学习方法-——-STDP,它根据神经元学习的先后顺序,调整神经元之间连接的强弱。

STDP可以说是Hebb学习的一种延伸,Hebb学习提出如果两个神经元常常一起活动,则二者之间的连接会增强。

STDP则是进一步提出,两个神经元之间的活动,如果其他神经元的信息在本身活动产生之前,则两神经元之间的连接会增强。

如果神经元本身产生活动之后才接受其他神经元传来的信息,则两神经元之间的额连接会减弱。

具体而言,对于一个神经元i:1。

如果在其他神经元j传递信息之后,它才产生反应,那么类似于因果关系,它和传递信息的神经元之间连接G(j→i)会加强;2.如果它产生反应之后,其他神经元j才传递信息来,那么这个信息就有可能被忽略,即该神经元与传递信息的神经元间的连接G(j→i)会减弱二、数学描述当突触前神经元的峰电位先于突触后神经元峰电位几毫秒产生,即 t j pre< t i post,则连接两个神经元间的突触权值变大; 反之,当t j pre〉 t i post,则连接两个神经元间的突触权值变小.STDP 函数是突触前后神经元产生峰电位的时间相关性的函数,其表达式为 )(,2a t pre post - t<0=)(w t)(,2a t post pre t 〉0是突触前峰电位到达时刻与突触后峰电位到达时刻的差值。

STDP 函数的波形如图 1 所示.三、STDP 、LTP 、LTD当突触前脉冲先于突触后脉冲到达时(pre-post spiking ),能够引起长时程增强(LTP )当突触后脉冲先于突触前脉冲到达时(post —pre spiking ),能够引起长时程抑制(LTD )。

基于STDP规则的忆阻神经网络作者:李丰泽来源:《信息记录材料》2019年第01期【摘要】1971年蔡少棠教授推测到忆阻器的存在,到2008年惠普实验室成功制造出人类第一个忆阻器,这期间人们对于忆阻器的理论建立越来越完备,而忆阻器本身所具有的特性是其他几种基本电路元器件所不能够比拟的,因此人们对于忆阻器的研究愈发的深入。

而本文则也对其进行了一定的研究,通过研究忆阻器的基本理论和性质,结合惠普忆阻器的物理模型和数学建模,分析得出忆阻器在当今社会的应用领域及基于STDP规则忆阻图像存储,最后提出展望。

【关键词】忆阻器;惠普;电路元器件;忆阻图像存储【中图分类号】TP30 【文献标识码】A 【文章编号】1009-5624(2019)01-0060-031 引言时代在进步,计算机芯片的体积和功耗逐渐变小,功能却越发完善,处理速度也与日俱增。

但是随着信息时代的来临,身处信息爆炸时期的我们对信息的需求愈来愈强烈。

可是冯·诺依曼计算机体系中计算结构本身也存在一定的缺点,而这也阻滞了计算机性能得到进一步的提升。

冯·诺依曼计算机体系存取分离,遵循串行的处理机制,正因这样计算机在每次处理数据时,都得先逐个逐个的计算,处理,最后再输出。

极大地降低了计算机操作指令的运行速率,将时间几乎都花费在了数据处理上而这种处理方式,虽然简化的电路,但是会对计算机进行数据分析与处理时造成一定的延迟,这是人们所不愿见到的,也正因如此计算机的发展速度有稍微的滞缓。

这就是冯·诺依曼体系的缺陷之处,因此如果要使计算机的处理速度得到进一步提升就得改进这种处理方式,即改进为类似于并联的处理方式,即将数据的储存读取和运算处理两大部分不再分离独立运行,使其协同工作,成为一种像流水线样的处理方式,这会极大的提升计算机指令的运行速率。

现有的学习规则不足以满足这种学习机制,对于符合复杂处理系统的新型处理单元的需求与日俱增。

满足复杂神经系统的STDP记忆可塑性规则的新型电路原器件--忆阻器的诞生,为新型计算机的诞生提供了可能。

STDP学习规则在脑机接口系统中的应用研究引言随着神经科学和工程学的迅速发展,脑机接口(Brain-Computer Interface,BCI)系统已成为一种在联接大脑与外部设备之间进行信息交流的有效方法。

基于BCI技术的发展,人们已经能够通过脑电图(Electroencephalogram,EEG)、脑磁图(Magnetoencepha logram,MEG)以及脑电波(Electrocorticogram,ECoG)等技术,实现将脑电信号转化为机器指令或者用于直接控制外部设备的信号。

然而,脑机接口系统中还需要面临许多挑战,其中之一是如何提高系统的精度和速度。

在脑机接口系统中,学习规则的选择对于系统的性能至关重要。

本文将重点介绍STDP学习规则在脑机接口系统中的应用研究,并讨论其潜在的优势以及可能的局限性。

STDP学习规则的概述STDP(Spike-Timing-Dependent Plasticity,时钟依赖的突触可塑性)学习规则是一种通过突触间的时间差异调整突触强度的机制。

该学习规则源自对神经元间连接的模拟研究,旨在描述突触对于突触前神经元和突触后神经元之间同步放电活动的响应。

STDP学习规则是一种正交化激活/抑制模式,它假定神经元之间的突触连接是基于同步放电活动的。

当某个突触输入的突触前神经元之间存在时间差异时,突触连接强度将会发生变化。

具体来说,如果突触前神经元的活动在突触后神经元的活动之前发生,则突触强度将增强,而反之则减弱。

STDP学习规则在脑机接口系统中的应用脑机接口系统中,STDP学习规则被广泛研究和应用,以提高系统的性能和适应性。

以下是STDP学习规则在脑机接口系统中的一些常见应用:1. 增强联想记忆:脑机接口系统可以通过将特定的刺激与神经元放电模式相关联,来增强人类的联想记忆。

利用STDP学习规则,系统可以根据脑电信号的时间差异来调整脑机接口的刺激模式,从而增强人类的记忆表征能力。

基于STDP和水库计算的脉冲神经网络算法研究共3篇基于STDP和水库计算的脉冲神经网络算法研究1随着神经科学研究的深入,越来越多的生物启发式神经网络算法被提出。

其中,基于突触可塑性STDP(Spike-Timing-Dependent Plasticity)和水库计算(Reservoir Computing)的脉冲神经网络算法备受关注。

本文将对该算法进行研究与探讨。

一、STDP的原理与应用STDP是指神经元之间的突触可塑性,其塑形依赖于神经元之间的突触前后神经脉冲的相对时间差(Δt)。

具体来说,当后突触前于前突触刺激神经元发放动作电位时,产生的突触后电位将持续较长的时间,从而增强突触强度;反之,后突触后于前突触刺激神经元发放动作电位时,突触后电位将持续相对短的时间,从而减弱突触强度。

STDP的应用在于实现对神经网络的学习和记忆。

在神经网络中,突触可塑性可以帮助模型自适应地调整各个神经元之间连接强度,以实现学习和记忆功能。

尤其是在具有时序特征的任务中,STDP可以自然地实现时序记忆和特征提取。

二、水库计算的原理与应用水库计算是指一种具有随机性的神经网络算法,该算法基于神经网络reservoir的内部动力学,利用输入信号在reservoir中产生的演化来实现非线性映射。

水库计算中,输入信号被通过固定权重链接到随机的reservoir神经元,reservoir内神经元间通过不同的、随机的权值相互连接。

输入信号通过神经元间的相互作用和非线性变换而演化,最终在reservoir的输出神经元中被解码。

水库计算的应用非常广泛,可以用于信号处理、分类、回归、控制等多个领域。

和传统神经网络相比,水库计算具有更好的非线性性、更佳的容错性以及更高的计算效率。

三、基于STDP和水库计算的脉冲神经网络算法基于STDP和水库计算的脉冲神经网络算法将两种算法结合起来,构建了一个具有随机稀疏连接的脉冲神经网络。

该网络包括一个输入层、一个reservoir层和一个输出层。

std原则稳定依赖原则

std原则,即稳定依赖原则,是软件工程中的一个基本原则,也被称为稳定性依赖原则或稳定倚赖原则。

它是指高层模块(稳定的模块)应该依赖于低层模块(不稳定的模块),而不是相反。

根据std原则,软件的稳定性应该通过高层模块对底层模块的依赖来实现。

这意味着高层模块应该是相对稳定的,不容易受到变化的影响,而低层模块则可以更灵活地进行修改和调整。

高层模块依赖于低层模块,可以提供一种稳定的接口,确保系统的可维护性和扩展性。

遵循std原则可以带来以下好处:

1. 降低软件系统的耦合度:高层模块对低层模块的依赖可以减少模块之间的直接耦合,使得系统的各个模块更加独立和可复用。

2. 提高系统的可维护性:当需要对系统进行修改或更新时,只需要关注低层模块的变化,而不必修改高层模块的代码,从而降低了维护的复杂性。

3. 增强系统的灵活性:由于高层模块较为稳定,低层模块可以更灵活地进行修改和替换,从而提供系统的可扩展性和适应性。

总之,std原则是一种设计原则,通过正确的模块依赖关系来实现软件系统的稳定性和可维护性。

遵循std原则可以帮助开发人员构建更加灵活、可维护和可扩展的软件系统。

脉冲神经网络中STDP学习算法的稳定性阮承妹;刘持标;邱锦明【摘要】脉冲时间突触可塑性(STDP)被普遍认为是大脑学习和记忆的主要机制.抑制性STDP对兴奋性神经元的活动起到调节和控制作用,构造了一种简单前馈脉冲神经网络,利用抑制性的STDP来研究兴奋性STDP的稳定性,实验结果表明,抑制性STDP对兴奋性STDP起到稳定作用.【期刊名称】《榆林学院学报》【年(卷),期】2017(027)006【总页数】4页(P95-98)【关键词】STDP;兴奋性;抑制性;稳定性【作者】阮承妹;刘持标;邱锦明【作者单位】三明学院信息工程学院,福建三明365004;福建省农业物联网应用重点实验室,福建三明365004;三明学院信息工程学院,福建三明365004;福建省农业物联网应用重点实验室,福建三明365004;三明学院信息工程学院,福建三明365004;福建省农业物联网应用重点实验室,福建三明365004【正文语种】中文【中图分类】TP187大脑的学习和记忆机制的研究一直以来是脑科学领域的热点问题。

大脑学习和记忆功能被普遍认为主要取决于脑神经元之间突触连接的改变机制。

近年来,研究表明脉冲时间突触可塑性STDP(Spike TimingDependent Plasticity)是突触改变的重要机制[1]。

不同种类的突触会导致不同的STDP学习机制,根据神经递质的不同可以将突触分为以谷氨盐酸为神经递质的兴奋性突触和由伽马氨基丁酸为神经递质的抑制性突触,因而可将STDP分为兴奋性STDP和抑制性STDP。

兴奋性STDP学习机制是目前发现的比较普遍的STDP学习机制,典型的兴奋性STDP为文献[1]中作者在培养海马体神经元中发现的非对称Hebbian学习机制。

已有研究将这种学习机制应用在图像边缘提取[2-4]、图像存储[5]和电子系统的电磁仿生防护[6]等研究中。

这种学习机制会使相关性强的输入的突触会得到增强,而突触的过分增强会使得脑神经回路中兴奋性电流过大,从而导致神经元状态失衡。

stdp的训练方式神经科学研究中,突触可塑性是指突触连接强度在学习和记忆过程中发生变化的能力。

其中,STDP(Spike-Timing Dependent Plasticity)是一种重要的突触可塑性机制,它依赖于突触前后神经元之间的时间差,通过调整突触的连接权重来实现学习和记忆的功能。

STDP的训练方式基于神经元之间的时间相关性。

具体而言,当一个突触前神经元在一个时间窗口内发放动作电位时,如果与其连接的突触后神经元在此之前发放了动作电位,那么这个突触的连接权重将会增强;反之,如果突触后神经元在此之后发放了动作电位,那么这个突触的连接权重将会减弱。

这种依赖于时间差的突触可塑性机制使得神经元之间的连接权重能够根据它们之间的活动顺序进行调整,从而实现学习和记忆的功能。

STDP的训练过程可以分为两个阶段:长时程增强(LTP)和长时程抑制(LTD)。

在LTP阶段,如果突触前神经元在突触后神经元发放动作电位之前发放了动作电位,这个突触的连接权重将会增强。

这是因为突触前神经元的动作电位释放了神经递质,使得突触后神经元的膜电位增加,从而增强了突触的连接强度。

而在LTD阶段,如果突触前神经元在突触后神经元发放动作电位之后发放了动作电位,这个突触的连接权重将会减弱。

这是因为突触前神经元的动作电位释放了一种特定的信号分子,使得突触后神经元的膜电位减小,从而削弱了突触的连接强度。

STDP的训练方式被广泛应用于神经网络的学习和记忆任务中。

在神经网络中,每个突触都对应着一个连接权重,该权重决定了神经元之间的连接强度。

在训练过程中,通过不断调整突触的连接权重,使得神经网络能够逐渐学习到输入模式之间的关联性和特征表示。

具体而言,当神经网络接收到某个输入模式时,其中的神经元会被激活并发放动作电位,这些动作电位会通过突触传递到下一层神经元,从而激活下一层的神经元。

在此过程中,STDP机制会根据神经元之间的时间差来调整突触的连接权重,从而改变神经网络的连接模式。

STDP 学习机制

在神经科学中,神经突触可塑性是指两个神经元连接能力或突触在强度上的变化。

生理书:

突触可塑性:指突触的形态和功能可发生较为持久的改变的特性或现象

一.提出(从Hebb规则到STDP)

根据1943年Hebbian提出的学习规则,如果突触能够持续引起突触后靶神经元产生动作电位,该突触的突触效能会增加。

Henry Markram提出的Spike Timing Dependent Plasticity学习方法

----STDP,它根据神经元学习的先后顺序,调整神经元之间连接的强弱。

STDP可以说是Hebb学习的一种延伸,Hebb学习提出如果两个神经元常常一起活动,则二者之间的连接会增强。

STDP则是进一步提出,两个神经元之间的活动,如果其他神经元的信息在本身活动产生之前,则两神经元之间的连接会增强。

如果神经元本身产生活动之后才接受其他神经元传来的信息,则两神经元之间的额连接会减弱。

具体而言,对于一个神经元i:

1.如果在其他神经元j传递信息之后,它才产生反应,那么类似于因果关系,它和传递信息的神经元之间连接G(j→i)会加强;

2.如果它产生反应之后,其他神经元j才传递信息来,那么这个信息就有可能被忽略,即该神经元与传递信息的神经元间的连接G(j→i)

会减弱

二、数学描述

当突触前神经元的峰电位先于突触后神经元峰电

位几毫秒产生,即 t j pre < t i post ,则连接两个神经元间的突触权值变大; 反之,当 t j pre > t i post ,则连接两个神经元间的突触权值变小。

STDP 函数是突触前后神经元产生峰电位的时间相关性的函数,其表达式为 )(,2a t pre post - t<0

=)(w t

)(,2a t post pre t>0

是突触前峰电位到达时刻与突触后峰电位到达时刻的差值。

STDP 函数的波形如图 1 所示。

三、STDP、LTP 、LTD

当突触前脉冲先于突触后脉冲到达时(pre-post spiking),能够引起长时程增强(LTP)

当突触后脉冲先于突触前脉冲到达时(post-pre spiking),能够引起长时程抑制(LTD)。