信息论习题

- 格式:doc

- 大小:59.00 KB

- 文档页数:2

一、单项选择题1.信息就是 ( C ) A.消息 B.数字、数据、图形C.通信过程中,接受者所不知的知识(即不确定性)D.能量2. 下列关于交互信息量();i j I x y 的陈述中错误的是 (C ) A.();i j I x y 表示在接收端收到j y 后获得的关于i x 的信息量 B.();i j I x y 表示在发送端发送i x 后获得的关于j y 的信息量 C.();0i j I x y ≥D.当i x 和j y 统计独立时();0i j I x y =3. 设X 和Y 是两个信源,则下列关系式中正确的是 (C ) A.()()()H XY H X H X Y =- B.()()()H XY H X H X Y =+ C.()()()H XY H Y H X Y =+D.()()()H XY H Y H X Y =-4. 一个正常的骰子,也就是各面呈现的概率都是16,则“5出现”这件事件的自信息量为 (C ) A.16比特 B.6 比特 C.2log 6比特 D.2log 6-比特 5. 关于预测编码的描述错误的是 ( ) A.通过解除相关性压缩码率 B.通过对差值编码压缩码率 C.通过概率匹配压缩码率 D.不适用于独立信源 6. 设信源1212n n x x x X p p p P ⎛⎫⎛⎫= ⎪⎪⎝⎭⎝⎭,其中:0i p ≥,i ∀,11n i i p ==∑,则下列关于熵()H X 的 描述错误的是 ( D ) A.熵的取值为一个非负数 B.熵表示信源的平均不确定度 C.()log H X n ≤,当且仅当1i p n=,i ∀成立时等号成立 D.熵的取值小于等于信源的平均自信息量7. 算术编码将信源符号序列映射成哪个区间上的小数 ( C )A. [0,1]B. [0,2]C. [1,2] D . [1,3]8. 非奇异码 ( C ) A.唯一可译 B.每个信源符号都有唯一的码字与之对应C.每个码符号序列都有唯一信源符号序列与之对应D.收到完整的码字后可即时译码9. 狭义信息论的创始人是 ( D )A.HartlyB.NquistonD.C.E. Shannon10.单符号离散信源1212n n x x x X p p p P ⎛⎫⎛⎫= ⎪⎪⎝⎭⎝⎭的平均信息量为 (A ) A.1()log()niii H x p p ==-∑B.1()log()niii H x p p ==∑C.11()log()ni i i H x p p ==∑D. 11()log()ni i iH x p p ==∑ 11. 若信源X 中的某一符号出现的概率1i p =,则其()H X = ( B ) A.1B.0C.0.5D.0.712. 当(;)0I X Y =时,()H XY 应为 (B ) A.()()H X H Y =B.()()()H XY H X H Y =+C.(|)(|)H Y X H X Y =D.()()()H XY H X H Y <+13. 离散无记忆信道的概率转移矩阵的行和等于 (C )A.2B.3C.1D.不确定14. 下列关于信息率失真函数()R D 的叙述错误的为 ( )A. ()R D 为关于D 的严格递减函数 B.()R D 为关于D 的严格递增函数 C.()R D 为关于D 的下凸函数 D.当max D D > 时()0R D = 15. 设信源符号集{}123,,X x x x =,每一个符号发生的概率分别为()112p x =,()214p x =, ()314p x =,则信源熵为 ( A ) A.1.5 比特/符号 B.1.5 奈特/符号 C.1.5 哈特/符号 D.1.0比特/符号16. 设信源符号集{}1234,,,X x x x x =,每一个符号发生的概率分别为()1p x ,()2p x ,()3p x ,()4p x ,则信源熵的最大值为( A )A.2 比特/符号B.2 奈特/符号C.2 哈特/符号D.4比特/符号17. 下列关于联合熵()H XY 的陈述中错误的是 ( D ) A.当X 和Y 统计独立时,()()()H XY H X H Y =+ B.()()H XY H X ≥ C.()()H XY H Y ≥D.()()()H XY H X H X Y =+ 18. 设信源1212n n x x x X p p p P ⎛⎫⎛⎫= ⎪⎪⎝⎭⎝⎭,其中:i ∀,0i p ≥,11n i i p ==∑,则下列关于熵()H X 的 描述错误的是 ( D ) A.()0H X ≥ B.()1,0,0,,00H =C.()log H X n ≤,当且仅当1i p n=,i ∀成立时等号成立 D.设另外有一组概率矢量,()n q q q Q ,,,21 =,则 ()1log n i i i H X p q =≥-∑19. 在哈夫曼编码方法中 ( B ) A.概率大的信源符号给长码 B.概率小的信源符号给长码 C.自信息量大的信源符号给短码 D.根据信源的具体情况确定20. 二元离散信源{}0,1,以什么概率发每一个符号提供的平均信息量为最大 ( B )A.{}0.4,0.6B.{}0.5,0.5C.{}0.99,0.01D.{}0.7,0.321. 若某字符离散信道的输入、输出符号集分别为{}12:,,,n X a a a 和{}12:,,,n Y b b b ,则其交互信息量(;)i j I a b 应为 ( A ) A.(|)log()i j i p a b p aB.(|)log()i j i p a b p a -C.1log(|)i j p a bD.log ()i p a -22. 唯一可译码和即时码具有哪种关系 (B ) A.唯一可译码就是即时码 B.即时码是唯一可译码的子集 C.唯一可译码是即时码的子集D.唯一可译码就是即时码与非奇异码之和23. 用哈夫曼码方法得到的码及其平均码长具有如下性质 (C ) A.不是唯一的,且其平均码长不相同 B.是唯一的,且平均码长也一样 C.不是唯一的,但平均码长相同 D.不能确定24. 设二进制对称信道的误传概率为p ,则下列陈述中错误的是 (C ) A.当输入等概分布时达到其信道容量 B.当输出等概分布时达到其信道容量 C.当0p =时,其信道容量为0 D.当12p =时,其信道容量为0 25. 对于离散对称信道,其输入、输出符号集分别为X 和Y ,下列叙述中错误的是(D ) A.当输入等概分布时达到信道容量 B.当输出等概分布时达到信道容量C.对称信道的条件熵()H Y X 与信道输入符号的概率分布无关D.何时达到对称信道的信道容量要根据具体信道具体确定26. 下述叙述错误的是 ( A ) A.非奇异码唯一可译 B.只有分组码才有对应的码表 C.即时码唯一可译 D.非延长码收到完整的码字后可即时译码 27. 哈夫曼编码属于哪一类编码 ( A ) A.统计 B.变换 C.预测 D.非分组 28.设信源{}621,,x x x X =,对信源X 进行二进制编码,根据Kraft 不等式,下列码中不是唯一可译码的是 ( D ) A .000, 001, 010, 011, 100, 101 B. 0, 01, 011, 0111, 01111, 011111 C .0, 10, 110, 1110, 11110, 111110 D. 0, 10, 110, 1110, 1011, 110129.若有一个二元序列为 000011011100000,可写成的游程序列是 ( A ) A.4 2 1 3 5 B.5 3 1 2 4 C.2 2 2 1 3 2 3 D.4 3 3 430. 在信道输出端接收到输出随机变量Y 后,对输入端的随机变量X 尚存在的平均不确定性表示为 ( B )A .()X HB.()Y X H / C .()Y HD.()X Y H /二、简答及名词解释1.名词解释:自信息量、熵、 2.简要描述离散信源熵的极值性 3.名词解释:离散无记忆信源4.写出冗余度的表达式并简述信源冗余度的来源 5. 简要描述平均互信息);(Y X I 的凸状性6.名词解释:对称离散信道试问:①码字中哪些是唯一可译码?②哪些是非延长码(即时码)? ③哪些是奇异码;那些是非奇异码? 8.名词解释:唯一可译码、即时码9.写出香农公式,解释其中各变量的含义 10.简述信源编码的两个基本途径 11. 伴随式 12. 对偶码 13. 试验信道三、计算1. 信源符号X 有6种字母,概率为(0.32, 0.22, 0.18, 0.16, 0.08, 0.04)。

2-1 同时掷两个正常的骰子,也就是各面呈现的概率都是1/6,求: (1)“3和5同时出现” 这事件的自信息量。

(2)“两个1同时出现” 这事件的自信息量。

(3)两个点数的各种组合(无序对)的熵或平均信息量。

(4)两个点数之和(即2,3,…,12构成的子集)的熵。

(5)两个点数中至少有一个是1的自信息。

解:(1)设X 为‘3和5同时出现’这一事件,则P (X )=1/18,因此 17.418log)(log)(22==-=x p X I (比特)(2)设‘两个1同时出现’这一事件为X ,则P (X )=1/36,因此 17.536log)(log)(22==-=x p X I (比特)(3 ) “两个相同点数出现”这一事件的概率为1/36,其他事件的概率为1/18,则 337.418log181536log366)(22=+=X H (比特/组合)(4)222222111111()[log 36log 18()log 12()log 936181836181811136111()log ]2()log 6 3.44(/)1818365181818H X =++++++++⨯+++=比特两个点数之和(5)两个点数至少有一个为1的概率为P (X )= 11/36 71.13611log)(2=-=X I (比特)2-6设有一离散无记忆信源,其概率空间为⎪⎪⎭⎫⎝⎛=====⎪⎪⎭⎫⎝⎛8/134/124/118/304321x x x x PX该信源发出的信息符号序列为(202 120 130 213 001 203 210 110 321 010 021 032 011 223 210),求:(1) 此信息的自信息量是多少?(2) 在此信息中平均每个符号携带的信息量是多少? 解:(1)由无记忆性,可得序列)(比特/18.87)3(6)2(12)1(13)0(14=+++=I I I I(2)符号)(比特/91.145/==I H 2-9在一个袋中放有5个黑球、10个白球,以摸一个球为一次实验,摸出的球不再放进去。

信息论习题集第一章、判断题1、信息论主要研究目的是找到信息传输过程的共同规律,提高信息传输的可靠性、有效性、保密性和认证性,以达到信息传输系统的最优化。

(√)2、同一信息,可以采用不同的信号形式来载荷;同一信号形式可以表达不同形式的信息。

(√)3、通信中的可靠性是指使信源发出的消息准确不失真地在信道中传输;(√)4、有效性是指用尽量短的时间和尽量少的设备来传送一定量的信息。

(√)5、保密性是指隐蔽和保护通信系统中传送的消息,使它只能被授权接收者获取,而不能被未授权者接收和理解。

(√)6、认证性是指接收者能正确判断所接收的消息的正确性,验证消息的完整性,而不是伪造的和被窜改的。

(√)7、在香农信息的定义中,信息的大小与事件发生的概率成正比,概率越大事件所包含的信息量越大。

(×)第二章一、判断题1、通信中获得的信息量等于通信过程中不确定性的消除或者减少量。

(√)2、离散信道的信道容量与信源的概率分布有关,与信道的统计特性也有关。

(×)3、连续信道的信道容量与信道带宽成正比,带宽越宽,信道容量越大。

(×)4、信源熵是信号符号集合中,所有符号的自信息的算术平均值。

(×)5、信源熵具有极值性,是信源概率分布P的下凸函数,当信源概率分布为等概率分布时取得最大值。

(×)6、离散无记忆信源的N次扩展信源,其熵值为扩展前信源熵值的N倍。

(√)7、互信息的统计平均为平均互信息量,都具有非负性。

(×)8、信源剩余度越大,通信效率越高,抗干扰能力越强。

(×)9、信道剩余度越大,信道利用率越低,信道的信息传输速率越低。

(×)10、信道输入与输出之间的平均互信息是输入概率分布的下凸函数。

(×)11、在信息处理过程中,熵是不会增加的。

(√)12、熵函数是严格上凸的。

(√)13、信道疑义度永远是非负的。

(√)14、对于离散平稳信源,其极限熵等于最小平均符号熵。

信息论智力题目

这是一道关于信息论的智力题目:

在某个地区,有三种体型的人群:胖子、不胖不瘦的人和瘦子。

他们得高血压的概率也不同。

现在的问题是,如果我们知道某人是高血压患者,那么这句话包含了多少关于这个人身体状况的信息?

假设胖子得高血压的概率为15%,不胖不瘦者得高血压的概率为10%,瘦

子得高血压的概率为5%。

胖子占该地区的10%,不胖不瘦者占80%,瘦

子占10%。

我们需要计算这句话“该地区的某一位高血压者是胖子”包含了多少信息量。

根据信息论,信息量是衡量不确定性的减少程度。

如果某事件的发生概率很高,那么该事件的信息量就较小;如果某事件的发生概率很低,那么该事件的信息量就较大。

首先,我们要计算在不知道某人是胖子的情况下,他是高血压患者的信息量。

这等于总的得高血压的概率(也就是胖子、不胖不瘦者和瘦子的得高血压概率之和)。

然后,我们要计算在知道某人是胖子的情况下,他是高血压患者的信息量。

这等于胖子得高血压的概率。

最后,通过这两个信息量的差值,我们可以得到“该地区的某一位高血压者是胖子”这句话的信息量。

这个差值就是我们要找的答案。

一、简答题1、什么是平均自信息量与平均互信息,比较一下这两个概念的异同?2、解释信息传输率、信道容量、最佳输入分布的概念,说明平均互信息与信源的概率分布、信道的传递概率间分别是什么关系?3、简述最大离散熵定理。

二、判断题1、只要码字传输的信息量大于新源序列携带的信息量,就能实现几乎无失真编码。

2、当信源与信道连接时,若信息传输率达到了信道容量,则称此信源与信道达到匹配。

3、唯一可译码一定是即时码,即时码不一定是唯一可译码。

4、信道容量只是信道矩阵的参数。

5、若信源符号集中增加了若干符号,当这些符号出现的概率很小几乎趋于0时,信源的熵增加。

三、计算题(每小题10分,共40分)1、某二元无记忆信源,有()()170,188P P==,求:(1)某一信源序列由50个二元符号组成,其中有m个“1”,求此序列的自信息量。

(2)求100个符号构成的信源序列的熵。

2、求以下2个信道的信道容量:122p pPp pεεεεεε--⎡⎤--⎢⎥=⎢⎥--⎣⎦,21111363611116363P⎡⎤⎢⎥=⎢⎥⎢⎥⎢⎥⎣⎦第 1 页共3页第 2 页 共3 页3、有一信源有6个可能的输出,其概率分布如下表所示,表中给出了对应的码A 、B 、C 、D 、E 。

求⑴ 这些码中哪些是唯一可译码。

⑵ 哪些是即时码1123456()0.50001100.20010101100.1010000000111000.081000001000111100.071010010010110110.05110001111011101p a A B CD a a a a a a ⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦消息4、信源空间为⎥⎦⎤⎢⎣⎡=⎥⎦⎤⎢⎣⎡05.005.005.005.01.01.02.04.0)(87654321s s s s s s s s s P S ,试构造二元霍夫曼码,并计算其平均码长和编码效率。

第 3 页共3页。

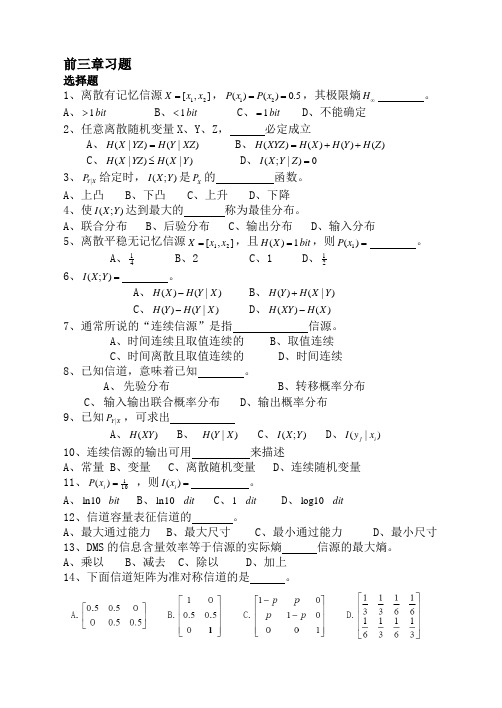

前三章习题选择题1、离散有记忆信源],[21x x X =,12()()0.5P x P x ==,其极限熵H ∞ 。

A 、1bit >B 、1bit <C 、1bit =D 、不能确定2、任意离散随机变量X 、Y 、Z , 必定成立A 、)|()|(XZ Y H YZ X H =B 、)()()()(Z H Y H X H XYZ H ++=C 、)|()|(Y X H YZ X H ≤D 、0)|;(=Z Y X I3、|Y X P 给定时,(;)I X Y 是X P 的 函数。

A 、上凸B 、下凸C 、上升D 、下降4、使(;)I X Y 达到最大的 称为最佳分布。

A 、联合分布B 、后验分布C 、输出分布D 、输入分布5、离散平稳无记忆信源],[21x x X =,且bit X H 1)(=,则=)(1x P 。

A 、41B 、2C 、1D 、21 6、=);(Y X I 。

A 、)|()(X Y H X H -B 、)|()(Y X H Y H +C 、)|()(X Y H Y H -D 、)()(X H XY H -7、通常所说的“连续信源”是指 信源。

A 、时间连续且取值连续的B 、取值连续C 、时间离散且取值连续的D 、时间连续8、已知信道,意味着已知 。

A 、 先验分布B 、转移概率分布C 、 输入输出联合概率分布D 、输出概率分布9、已知X Y P |,可求出A 、)(XY HB 、 )|(X Y HC 、);(Y X ID 、)|(i j x y I10、连续信源的输出可用 来描述A 、常量B 、变量C 、离散随机变量D 、连续随机变量11、101)(=i x P ,则=)(i x I 。

A 、bit 10lnB 、dit 10lnC 、dit 1D 、dit 10log12、信道容量表征信道的 。

A 、最大通过能力B 、最大尺寸C 、最小通过能力D 、最小尺寸13、DMS 的信息含量效率等于信源的实际熵 信源的最大熵。

信息论习题集第二章2.1同时掷2颗骰子,事件A、B、C分别表示:(A)仅有一个骰子是3; ( B)至少有一个骰子是4;(C)骰子上点数的总和为偶数。

试计算A、B、C发生后所提供的信息量。

2.3 —信源有4种输出符号X,i =0,1,2, 3,且p(Xj=1/4。

设信源向信宿发出X3,但由于传输中的干扰,接收者收到X3后,认为其可信度为0.9。

于是信源再次向信宿发送该符号 (X3 ),信宿准确无误收到。

问信源在两次发送中发送的信息量各是多少?信宿在两次接收中得到的信息量又各是多少?2.5 一信源有6种输出状态,概率分别为p(A) =0.5,p(B)=0.25,p(C)=0.125,p(D)= p(E)=0.05,p(F)=0.025试计算H(X)。

然后求消息ABABBA和FDDFDF的信息量(设信源先后发出的符号相互独立) ,并将之与长度为6的消息序列信息量的期望值相比较。

2.6中国国家标准局所规定的二级汉字共6763个。

设每字使用的频度相等,求一个汉字所含的信息量。

设每个汉字用一个16 16的二元点阵显示,试计算显示方阵所能表示的最大信息量。

显示方阵的利用率是多少?2.7已知信源发出6和a2两种消息,且p(aj = p(a2)=1/2。

此消息在二进制对称信道上传输,信道传输特性为p(bi |aj = p(b2 la?) =1 - ;,p(b | a?) = p(b21 aj =;。

求互信息量I 佝4)和I 佝;b?)。

2.8已知二维随机变量XY的联合概率分布p(X i y j)为:p(0,0) = p(1,1)=1/8,p(0,1) =p(1,0) -3/8,求H (X |Y)。

2.13有两个二元随机变量X和Y,它们的联合概率分布如表 2.5所列,同时定义另一随机变量Z二X|_Y (一般乘积)。

试计算:(1)熵H(X),H(Y),H(Z), H(XZ),H(YZ), H(XYZ);(2)条件熵H(X |Y),H(Y|X),H(X |Z),H(Z|X),H(Y|Z), H(Z|Y), H(X|YZ), H (Y | XZ)和H(Z | XY);(3)互信息I (X;Y), I (X;Z), I (Y; Z), I(X;Y| Z),I(Y;Z| X)和I (X ;Z |Y)。

第一章作业题1. 设二元对称信道的传递矩阵为⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡32313132(1) 若P(0) = 3/4, P(1) = 1/4,求H (X ), H(X /Y ), H(Y /X )和I(X ;Y );(2) 求该信道的信道容量及其达到信道容量时的输入概率分布; 解:(1)symbolbit Y X H X H Y X I symbol bit X Y H Y H X H Y X H X Y H Y H Y X H X H Y X I symbolbit y p Y H x y p x p x y p x p y x p y x p y p x y p x p x y p x p y x p y x p y p symbolbit x y p x y p x p X Y H symbolbit x p X H jj iji j i j i i i / 062.0749.0811.0)/()();(/ 749.0918.0980.0811.0)/()()()/()/()()/()();(/ 980.0)4167.0log 4167.05833.0log 5833.0()()(4167.032413143)/()()/()()()()(5833.031413243)/()()/()()()()(/ 918.0 10log )32lg 324131lg 314131lg 314332lg 3243( )/(log )/()()/(/ 811.0)41log 4143log 43()()(222221212221221211112111222=-==-==+-=+-=-=-==⨯+⨯-=-==⨯+⨯=+=+==⨯+⨯=+=+==⨯⨯+⨯+⨯+⨯-=-==⨯+⨯-=-=∑∑∑∑2)21)(/ 082.010log )32lg 3231lg 31(2log log );(max 222==⨯++=-==i mi x p symbolbit H m Y X I C2. 设有一批电阻,按阻值分70%是2K Ω,30%是5 K Ω;按瓦分64%是0.125W ,其余是0.25W 。

信息论习题集信息论习题集⼀、填空题1、⼈们研究信息论的⽬的是为了⾼效、可靠安全地交换和利⽤各种各样的信息。

2、单符号离散信源输出的消息⼀般⽤随机变量描述,⽽符号序列离散信源输出的消息⼀般⽤随机⽮量描述。

3、两个相互独⽴的随机变量的联合⾃信息量等于两个⾃信息量之和。

4、连续信源或模拟信号的信源编码的理论基础是限失真信源编码定理。

5、必然事件的⾃信息是 0 ,不可能事件的⾃信息量是 00 。

6、信道的输出仅与信道当前的输⼊有关,⽽与过去输⼊⽆关的信道称为⽆记忆信道。

7、若纠错码的最⼩距离为min d ,则可以纠正任意⼩于等于t= 个差错。

8、必然事件的⾃信息量是 0 ,不可能事件的⾃信息量是 00 。

9、⼀信源有五种符号{a , b , c , d , e},先验概率分别为 a P =0.5, b P =0.25, c P =0.125,d P =e P =0.0625。

符号“a ”的⾃信息量为____1____bit ,此信源的熵为____1.875____bit/符号。

10、已知某线性分组码的最⼩汉明距离为3,那么这组码最多能检测出 2 个码元错误,最多能纠正 1 个码元错误。

11、克劳夫特不等式是唯⼀可译码存在与否的充要条件。

{00,01,10,11}是否是唯⼀可译码?。

12、离散平稳⽆记忆信源X 的N 次扩展信源的熵等于离散信源X 的熵的 N 倍。

13、对于离散⽆记忆信源,当信源熵有最⼤值时,满⾜条件为信源符号等概分布_ 。

⼆、选择题1、下⾯哪⼀项不属于最简单的通信系统模型:( B )A .信源B .加密C .信道D .信宿 2、信道编码的⽬的是( A )。

A 提⾼通信系统的可靠性B 提⾼通信系统的有效性C 提⾼通信系统的保密性D 提⾼通信系统的实时性3、给定x i 条件下随机事件y j 所包含的不确定度和条件⾃信息量I (y j /x i ),(C )A 数量上不等,含义不同B 数量上不等,含义相同C 数量上相等,含义不同D 数量上相等,含义相同4、下⾯哪⼀项不是增加信道容量的途径:(C )A 减⼩信道噪声功率B 增⼤信号功率C 增加码长D 增加带宽5、平均互信息量 I(X;Y)与信源熵和条件熵之间的关系是( A )。

信息论第一章习题

1-1 设某班学生在一次考试中获优(A )、良(B )、中(C )、及格(D )和不及格(E )的人数相等。

当教师通知某甲:“你没有不及格”,甲获得了多少比特信息?为确定自己的成绩,甲还需要多少信息?

1-2 一个号码锁有3个数字,每个数字可设置为0~99(含0和99)中的任何一个整数值。

试计算打开该锁所需的信息。

1-3 中国国家标准局所规定的二级汉字共6763个。

设每字使用的频度相等,求一个汉字所含的信息量。

设每个汉字用一个1616⨯的二元点阵显示,试计算显示方阵所能表示的最大信息。

显示方阵的利用率是多少?

1-4 一信源有4种输出数符:3,2,1,0 ,==i i X i ,且4/1=i X P 。

设信源向信宿发

出3X ,但由于传输中的干扰,接收者收到3X 后,认为其可信度为0.9。

于是信源再次向信宿发送该数符(3X ),信宿无误收到。

问信源在两次发送中发出的信息量各是多少?信宿在两次接收中得到的信息量又各是多少?(提示:先计算第二次传输中收、发的信息量。

)

1-5 一信源有6种输出状态,概率分别为

5.0=A P 25.0=B P 125.0=C P 05.0==E D P P 025.0=F P 试计算)(X H 。

然后求消息ABABBA 和FDDFDF 中的信息量(设信源先后发出的符号相互独立),并将之与6位消息的信息量期望值相比较。

1-6 重做1-5题,但取

4.0=A P 2.0=B P 12.0=C P 1.0==E D P P 08.0=F P 。

1-7 两个信源1S 和2S 均有两种输出:1 ,0=X 和1 ,0=Y ,概率分别为

2/110==X X P P ,4/10=Y P ,4/31

=Y P 。

试计算)(X H 和)(Y H 。

设1S 发出序列0101,2S 发出0111,如传输过程无误,第一个字符传送结束后,相应的两个信宿分别收到多少信息量?当整个序列传送结束后,收到的总信息量

及平均每次发送的信息量又各是多少?(设信源先后发出的数字相互独立。

)1-8从普通的52张扑克牌中随机地抽出一张

(a)当告知你抽到的那张牌是:红桃;人头;红桃人头时,你所得的信息各

是多少?

(b) 如果已知那张牌是红人头,为确切地知道是哪张牌,还需要多少信息?1-9若以5作为信息量对数的底,试求该信息量单位与比特(bit)和奈特(nat)的换算关系。

1-10掷2颗均匀的骰子。

当和为2、7、11时,所含的信息量各是多少?

1-11掷5次均匀的钱币。

当结果是“正反正反反”和“两正三反”时,信息量各是多少?。