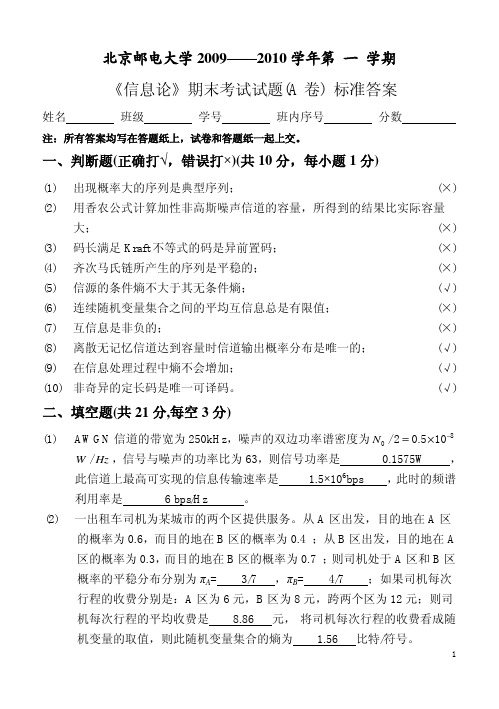

信息论试卷题目及标准答案

- 格式:doc

- 大小:268.50 KB

- 文档页数:7

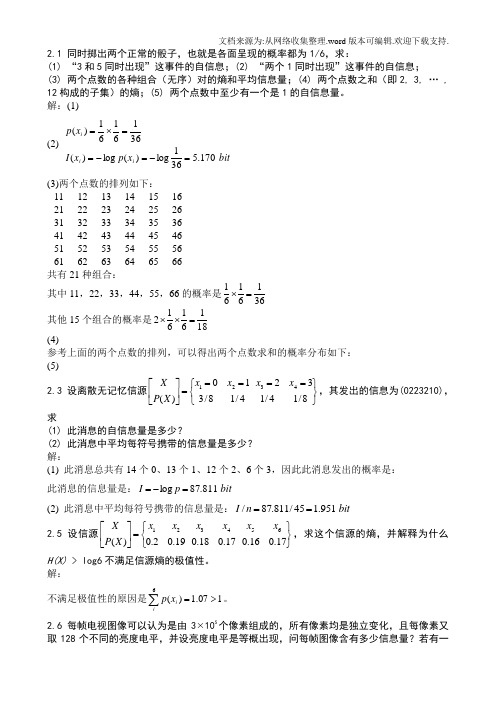

1.有二元对称信道编码:1)已知信源X,41,4310==p p ,求H(X),H(X|Y),I(X,Y)。

2)求信道容量C 。

解:由题意可知,(X,Y )服从如下的联合分布Y,X0101/21/1211/41/6X 的边际分布是(3/4,1/4),Y 的边际分布是(7/12,5/12))(811.03log 432)41log 4143log 43(log )(210bit p p X H i i i =-=+-=-=∑=)bit (749.07log 1275log 1253log 433252,53(125)71,76(127)|()()|(22210=++--=+====∑=H H i Y X H i Y p Y X H i )bit (062.07log 1275log 12538)|()(),(22=--=-=Y X H X H Y X I )(082.03log 35)31(1)(12bit H p H C =-=-=-=2.最小熵。

求出)(),...,,(21p H p p p H n =最小值是多少,因为p 的范围是在n 维概率向量集合上的最小值是多少?找到所有达到这个最小值时的p。

解:我们希望找到所有的概率向量),...,,(21n p p p p =,让∑-=i ii p p p H log )(达到最小,现在有时等式成立或当且仅当10,0log =≥-i i i p p p ,因此,唯一可能使得H(p)最小化的概率向量是对于某些i 和j 满足.,0,1i j p p j i ≠==这里有n 个这样的向量,比如)1,...,0,0(),0,...,1,0(),0,...,0,1(,此时H(p)的最小值为0。

3.赫夫曼码。

考虑随机变量⎪⎪⎭⎫ ⎝⎛=02.003.004.004.012.026.049.07654321x x x x x x x X (a)求X 的二元赫夫曼码。

《信息论基础》参考答案一、填空题(共15分,每空1分)1、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。

2、信源的剩余度主要来自两个方面,一是信源符号间的相关性,二是信源符号的统计不均匀性。

3、三进制信源的最小熵为0,最大熵为32log bit/符号。

4、无失真信源编码的平均码长最小理论极限制为信源熵(或H(S)/logr= H r (S))。

5、当R=C 或(信道剩余度为0)时,信源与信道达到匹配。

6、根据信道特性是否随时间变化,信道可以分为恒参信道和随参信道。

7、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。

8、若连续信源输出信号的平均功率为2σ,则输出信号幅度的概率密度是高斯分布或正态分布或()222x f x σ-=时,信源具有最大熵,其值为值21log 22e πσ。

9、在下面空格中选择填入数学符号“,,,=≥≤〉”或“〈”(1)当X 和Y 相互独立时,H (XY )=H(X)+H(X/Y)=H(Y)+H(X)。

(2)()()1222H X X H X =≥()()12333H X X X H X = (3)假设信道输入用X 表示,信道输出用Y 表示。

在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y)<H(X)。

二、(6分)若连续信源输出的幅度被限定在【2,6】区域内,当输出信号的概率密度是均匀分布时,计算该信源的相对熵,并说明该信源的绝对熵为多少。

()1,2640,x f x ⎧≤≤⎪=⎨⎪⎩Q 其它()()()62log f x f x dx ∴=-⎰相对熵h x=2bit/自由度该信源的绝对熵为无穷大。

三、(16分)已知信源1234560.20.20.20.20.10.1S s s s s s s P ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦(1)用霍夫曼编码法编成二进制变长码;(6分) (2)计算平均码长L ;(4分)(3)计算编码信息率R ';(2分)(4)计算编码后信息传输率R ;(2分) (5)计算编码效率η。

一、设X 、Y 就是两个相互统计独立的二元随机变量,其取-1或1的概率相等。

定义另一个二元随机变量Z,取Z=YX(一般乘积)。

试计算:1、H(Y)、H(Z);2、H(YZ);3、I(X;Y)、I(Y;Z); 二、如图所示为一个三状态马尔科夫信源的转移概率矩阵1. 绘制状态转移图; 2、 求该马尔科夫信源的稳态分布;3、 求极限熵;三、在干扰离散对称信道上传输符号1与0,已知P(0)=1/4,P(1)=3/4,试求:1. 信道转移概率矩阵P 2、信道疑义度 3、信道容量以及其输入概率分布 四、某信道的转移矩阵⎥⎦⎤⎢⎣⎡=1.006.03.001.03.06.0P ,求信道容量,最佳输入概率分布。

五、求下列各离散信道的容量(其条件概率P(Y/X)如下:)六、求以下各信道矩阵代表的信道的容量答案一、设X 、Y 就是两个相互统计独立的二元随机变量,其取-1或1的概率相等。

定义另一个二元随机变量Z,取Z=YX(一般乘积)。

试计算:1、H(Y)、H(Z);2、H(XY)、H(YZ);3、I(X;Y)、I(Y;Z); 解:1、 2i 11111H Y P y logP y log log 2222i i =⎡⎤=-+⎢⎥⎣⎦∑()=-()()=1bit/符号 Z=YX 而且X 与Y 相互独立∴ 1(1)(1)(1)PP X P Y P X ⋅=+=-⋅=-(Z =1)=P(Y=1)= 1111122222⨯+⨯= 2(1)(1)(1)P P X P Y P X ⋅=-+=-⋅=(Z =-1)=P(Y=1)= 1111122222⨯+⨯=故H(Z)= i2i1(z )log (z )i P P =-∑=1bit/符号2、从上式可以瞧出:Y 与X 的联合概率分布为:H(YZ)=H(X)+H(Y)=1+1=2bit/符号 3、X 与Y 相互独立,故H(X|Y)=H(X)=1bit/符号∴I(X;Y)=H(X)-H(X|Y)=1-1=0bit/符号I(Y;Z)=H(Y)-H(Y|Z)=H(Y)-[H(YZ)-H(Z)]=0 bit/符号 二、如图所示为一个三状态马尔科夫信源的转移概率矩阵2. 绘制状态转移图; 2、 求该马尔科夫信源的稳态分布; 3、 求极限熵;解:1、状态转移图如右图 2、由公式31()()(|)j iji i p E P E P EE ==∑,可得其三个状态的稳态概率为:1123223313123111()()()()22411()()()2211()()()24()()()1P E P E P E P E P E P E P E P E P E P E P E P E P E ⎧=++⎪⎪⎪=+⎪⎨⎪=+⎪⎪⎪++=⎩1233()72()72()7P E P E P E ⎧=⎪⎪⎪⇒=⎨⎪⎪=⎪⎩ 3、其极限熵:3i i 13112112111H = -|E =0+0+72272274243228=1+1+ 1.5=bit/7777i P H H H H ∞=⨯⨯⨯⨯⨯⨯∑(E )(X )(,,)(,,)(,,)符号三、在干扰离散对称信道上传输符号1与0,已知P(0)=1/4,P(1)=3/4,试求:2. 信道转移概率矩阵P 2、信道疑义度 3、信道容量以及其输入概率分布解:1、该转移概率矩阵为 P=0.90.10.10.9⎡⎤⎢⎥⎣⎦2、根据P(XY)=P(Y|X)⋅P(X),可得联合概率由P(X|Y)=P(X|Y)/P(Y)可得H(X|Y)=-i jiji j(x y )log x |y =0.09+0.12+0.15+0.035=0.4bit/P P∑,()符号 3、该信道就是对称信道,其容量为:C=logs-H=log2-H(0、9,0、1)=1-0、469=0、531bit/符号这时,输入符号服从等概率分布,即0111()22X P X ⎡⎤⎡⎤⎢⎥=⎢⎥⎢⎥⎣⎦⎣⎦四、某信道的转移矩阵⎥⎦⎤⎢⎣⎡=1.006.03.001.03.06.0P ,求信道容量,最佳输入概率分布。

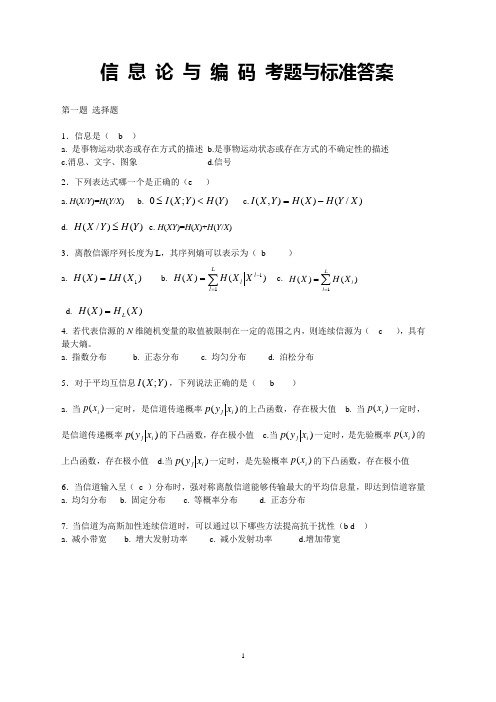

信 息 论 与 编 码 考题与标准答案第一题 选择题1.信息是( b )a. 是事物运动状态或存在方式的描述b.是事物运动状态或存在方式的不确定性的描述c.消息、文字、图象d.信号 2.下列表达式哪一个是正确的(e )a. H (X /Y )=H (Y /X )b. )();(0Y H Y X I <≤c.)/()(),(X Y H X H Y X I -=d. )()/(Y H Y X H ≤e. H (XY )=H (X )+H (Y /X )3.离散信源序列长度为L ,其序列熵可以表示为( b )a. )()(1X LH X H =b.c. ∑==Ll lXH X H 1)()(d. )()(X H X H L =4.若代表信源的N 维随机变量的取值被限制在一定的范围之内,则连续信源为( c ),具有最大熵。

a. 指数分布b. 正态分布c. 均匀分布d. 泊松分布 5.对于平均互信息);(Y X I ,下列说法正确的是( b )a. 当)(i x p 一定时,是信道传递概率)(i j x y p 的上凸函数,存在极大值b. 当)(i x p 一定时,是信道传递概率)(i j x y p 的下凸函数,存在极小值c.当)(i j x y p 一定时,是先验概率)(i x p 的上凸函数,存在极小值d.当)(i j x y p 一定时,是先验概率)(i x p 的下凸函数,存在极小值 6.当信道输入呈( c )分布时,强对称离散信道能够传输最大的平均信息量,即达到信道容量 a. 均匀分布 b. 固定分布 c. 等概率分布 d. 正态分布7.当信道为高斯加性连续信道时,可以通过以下哪些方法提高抗干扰性(b d ) a. 减小带宽 b. 增大发射功率 c. 减小发射功率 d.增加带宽第二题 设信源 ⎥⎦⎤⎢⎣⎡=⎥⎦⎤⎢⎣⎡6.04.0)(21x x X p X 通过一干扰信道,接收符号为Y={y 1,y 2},信道传递矩阵为⎥⎦⎤⎢⎣⎡43416165 求:(1) 信源 X 中事件 x 1 和 x 2 分别含有的自信息量。

《信息论基础》试卷答案一、填空题(共25分,每空1分)1、连续信源的绝对熵为 无穷大。

(或()()lg lim lg p x p x dx +∞-∞∆→∞--∆⎰) 2、离散无记忆信源在进行无失真变长信源编码时,编码效率最大可以达到 1 。

3、无记忆信源是指 信源先后发生的符号彼此统计独立 。

4、离散无记忆信源在进行无失真变长编码时,码字长度是变化的。

根据信源符号的统计特性,对概率大的符号用 短 码,对概率小的符号用 长 码,这样平均码长就可以降低,从而提高 有效性(传输速率或编码效率) 。

5、为了提高系统的有效性可以采用 信源编码 ,为了提高系统的可靠性可以采用 信道编码 。

6、八进制信源的最小熵为 0 ,最大熵为 3bit/符号 。

7、若连续信源输出信号的平均功率为1瓦特,则输出信号幅度的概率密度函数为 高斯分布(或()0,1x N 22x-)时,信源具有最大熵,其值为 0.6155hart(或1.625bit 或1lg 22e π)。

8、即时码是指 任一码字都不是其它码字的前缀 。

9、无失真信源编码定理指出平均码长的理论极限值为 信源熵(或H r (S)或()lg H s r),此时编码效率为 1 ,编码后的信息传输率为 lg r bit/码元 。

10、一个事件发生的概率为0.125,则自信息量为 3bit/符号 。

11、信源的剩余度主要来自两个方面,一是 信源符号间的相关性 ,二是 信源符号概率分布的不均匀性 。

12、m 阶马尔可夫信源的记忆长度为 m+1 ,信源可以有 q m 个不同的状态。

13、同时扔出一对均匀的骰子,当得知“两骰子面朝上点数之和为2”所获得的信息量为 lg36=5.17 比特,当得知“面朝上点数之和为8”所获得的信息量为 lg36/5=2.85 比特。

14.在下面空格中选择填入的数学符号“=,≥,≤,>”或“<” H(XY) = H(Y)+H(X ∣Y) ≤ H(Y)+H(X)二、(5分)已知信源的概率密度函数为()10a x b p x b a ⎧≤≤⎪=-⎨⎪⎩其他,计算信源的相对熵。

一、(25分)如果X 和Y 相互独立,证明X 和Y 的熵满足可加性,即 H(Y)H(X)Y)H(X,+= 证明:设P(x,y)=P(x)P(y),则有1H(X,Y)()()logP()()11()()log()()log ()()11()log()log ()()()()xyxyxy xy P x P y x P y P x P y P x P y P x P y P x P y P x P y H X H Y ==+=+=+∑∑∑∑∑二、(50分)联合总体X ,Y 具有如下联合分布。

XY分别计算(1) 联合熵H(X,Y)是多少? (2)边缘熵H(X)和H(Y)是多少?(3)对于每一个y 值,条件熵H(X ︱y)是多少? (4)条件熵H(X ︱Y)是多少? (5)X 和Y 之间的互信息是多少? 解答:(1) H(X,Y)=3.375(2) H(X)=2, H(Y)=1.75(3) H(X|y=1)=2,H(X|y=1)=1.875,H(X|y=1)=1.875, H(X|y=4)=0.5(4)H(X|Y)=1.1264(5)I(X;Y)=H(X)-H(X|Y)=2-1.1264=0.8736 三、(25分)考虑一个差错概率为f=0.15的二进制对称信道。

输入总体为x Ω:{0P =0.9,1p =0.1},假设观察到y=1,请计算(1|1)P x y ==? 解:(1|1)P x y ===(1|1)(1)(1|)()xP y x P x P y x P x ===∑==9.015.01.085.01.085.0⨯+⨯⨯=22.0085.0=0.39一、(25分)如果X 和Y 相互独立,证明X 和Y 的熵满足可加性,即 H(Y)H(X)Y)H(X,+=二、(50分)联合总体X ,Y 具有如下联合分布。

XY分别计算(1) 联合熵H(X,Y)是多少? (2)边缘熵H(X)和H(Y)是多少?(3)对于每一个y 值,条件熵H(X ︱y)是多少? (4)条件熵H(X ︱Y)是多少? (5)X 和Y 之间的互信息是多少?三、(25分)考虑一个差错概率为f=0.15的二进制对称信道。

《信息论基础》试卷第1页《信息论基础》试卷答案一、填空题(共25分,每空1分)1、连续信源的绝对熵为无穷大。

(或()()lg lim lg p x p x dx +¥-¥D ®¥--D ò)2、离散无记忆信源在进行无失真变长信源编码时,编码效率最大可以达到、离散无记忆信源在进行无失真变长信源编码时,编码效率最大可以达到 1 1 1 。

3、无记忆信源是指信源先后发生的符号彼此统计独立。

4、离散无记忆信源在进行无失真变长编码时,码字长度是变化的。

根据信源符号的统计特性,对概率大的符号用短码,对概率小的符号用长码,这样平均码长就可以降低,从而提高有效性有效性((传输速率或编码效率传输速率或编码效率) ) ) 。

5、为了提高系统的有效性可以采用信源编码,为了提高系统的可靠性可以采用信道编码。

6、八进制信源的最小熵为、八进制信源的最小熵为 0 0 0 ,最大熵为,最大熵为,最大熵为 3bit/ 3bit/ 3bit/符号符号。

7、若连续信源输出信号的平均功率为1瓦特,则输出信号幅度的概率密度函数为高斯分布高斯分布((或()0,1x N 或2212x ep-)时,信源具有最大熵,其值为其值为 0.6155hart( 0.6155hart( 0.6155hart(或或1.625bit 或1lg 22e p )。

8、即时码是指任一码字都不是其它码字的前缀。

9、无失真信源编码定理指出平均码长的理论极限值为信源熵信源熵((或H r (S)(S)或或()lg H s r),此时编码效率为时编码效率为 1 1 1 ,编码后的信息传输率为,编码后的信息传输率为,编码后的信息传输率为 lg lg r bit/ bit/码元码元。

1010、一个事件发生的概率为、一个事件发生的概率为0.1250.125,则自信息量为,则自信息量为,则自信息量为 3bit/ 3bit/ 3bit/符号符号。

信息论试卷题目及答案

————————————————————————————————作者:————————————————————————————————日期:

2

中国海洋大学2008—2009学年第一学期

一、填空题(每空2分,共20分)

1、1948年,美国数学家 香农 发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

2、信源编码的目的是提高通信的有效性。

信道编码的最终目的是提高信号传输的可靠性。

3、离散平稳无记忆信源X 的N 次扩展信源的熵等于离散信源X 的熵的N 倍。

4、对于香农编码、费诺编码和哈夫曼编码,编码方法惟一的是香农编码。

5、信道输入与输出间的平均互信息是信道转移概率的 下凸 函数,是输入概率的 上凸 函数。

6、信道矩阵⎥⎦⎤⎢⎣⎡10002/12/1代表的信道的信道容量C=符号/1bit ,达到信道容量的条件是输入符号等概分布。

7、 设某二进制码{00011,10110,01101,11000,10010,10001},则码的最小距离是2 ,假设码字等概分布,则该码的码率为 0.517比特/符号 ,这时若通过二元对称信道接收码字为01100和00110时,应译为01101 , 10110 。

二、判断题(每题2分,共10分)

1、必然事件和不可能事件的自信息量都是0 。

(错)

2、最大后验概率准则与最大似然准则是等价的。

(错)

3、如果信息传输速率大于信道容量,就不存在使传输差错率任意小的信道编码。

(对)

4、连续信源和离散信源的熵都具有非负性。

(错)

5、相同功率的噪声中,高斯噪声使信道容量最小。

(对) 三、简答题(第1、2题各6分,第三题10分,共22分)

1、简述最大离散熵定理。

对于一个有m 个符号的离散信源,其最大熵是什么? 答:最大离散熵定理为:离散无记忆信源,等概率分布时熵最大。

(3分) 最大熵值为

m

H 2max log = (3分)

2、对于任意概率事件集X 、Y 、Z ,证明下述三角不等式成立()()()Z X H Z Y H Y X H ≥+ 证:因为)|()|(Y X H YZ X H ≤ ,(3分) 所以:

)

|()|()|()

|,()

|()|()|()|(Z Y H XZ Y H Z Y H Z Y X I YZ X H Z X H Y X H Z X H ≤-==-≤-(3分)

所以原命题得证。

3、什么是保真度准则?对二元信源()⎥⎦⎤⎢⎣⎡-=⎥⎦⎤⎢⎣⎡ωω110u p u ,其失真矩阵⎥

⎦⎤

⎢⎣⎡=00ααD ,求0>α时率失真函数的min D 和max D ?

答:1)保真度准则为:平均失真度不大于允许的失真度。

(3分)

2)因为失真矩阵中每行都有一个0,所以有0min =D (2分),

而(){}()⎪⎩

⎪⎨⎧<

≥-=-=21

211,1min max

ωωαωαωωααωD 。

(5分)

四、计算题(第1、2、3题每题15分,第4题10分,共55分)

1、黑白气象传真图的消息只有黑色和白色两种,求:(1)黑色出现的概率为0.3,白色出现的概率为0.7。

给出这个只有两个符号的信源X 的数学模型,假设图上黑白消息出现前后没有关联,求熵

()X H ;(2)假设黑白消息出现前后有关联,其依赖关系为:P(白/白)=0.9,P(黑/白)=0.1,P(白/

黑)=0.2,P(黑/黑)=0.8,求其熵()X H 2。

答:(1)信源模型为()⎥⎦⎤

⎢⎣⎡===⎥

⎦⎤⎢⎣⎡7.03

.021白黑x x x p X (5分) ()()()符号/881.07.0log 7.03.0log 3.0log 2

1bit x p x p X H i i i =--=-=∑=(5分)

(2)由()()()()()⎪⎩⎪⎨⎧

=+=∑=1

21

2

1

x P x P x x P x P x P j j i j i (2,1=i )(3分) 可得()()()()()()()()⎪⎩⎪⎨⎧=++=+=1

9.02.01.08.021212211x P x P x P x P x P x P x P x P 得⎪⎪⎩

⎪⎪⎨⎧====32)(3

1)(11白黑x P x P (3分)

则()()()

[][]符号

/5533.09.0log 9.01.0log 1.032

1.0log 1.08.0log 8.031log )(2212

1

2bit x x P x x P x P X H i j i j i j i =⨯+⨯⨯-⨯+⨯⨯-=-=∑∑== (4分)

2、设有一离散信道,其信道矩阵为⎥

⎦

⎤

⎢⎣⎡=7.01.02.02.01.07.0p ,求(1)最佳概率分布?(2)当()7.01=x P ,()3.02=x P 时,求平均互信息()Y X I ;和信道疑义度()Y X H /;(3)输入为等概分布时,试写出一译码

规则,使平均译码错误率E p 最小,并求此E p 。

答:(1)是准对称信道,因此其最佳输入概率分布为()()5.021==x p x p (2分) (2)由已知的输入概率空间和信道转移概率,可求得输出概率

()()()∑==2

1i i j i j x y p x p y p (2分)

()()()55.02.03.07.07.021

11=⨯+⨯==∑=i i i x y p x p y p

()()()1

.01.03.01.07.02

122=⨯+⨯==∑=i i i x y p x p y p

()()()35

.07.03.02.07.02

1

33=⨯+⨯==∑=i i i x y p x p y p

(2分)

()()()

符号/3367.135.0log 35.01.0log 1.055.0log 55.0log 3

1

bit y p y p Y H j j j =⨯-⨯-⨯-=-=∑=(2分)

()()()()

()

()符号

/1569.17.0log 7.01.0log 1.02.0log 2.03.02.0log 2.01.0log 1.07.0log 7.07.0log 3

1

2

1

bit x y p x y p x p X Y H j i i i i i i =⨯+⨯+⨯⨯-⨯+⨯+⨯⨯-=-=∑∑==(2分)

平均互信息()()()符号/1798.01569.13367.1;bit X Y H Y H Y X I =-=-=(2分)

()()()符号/8813.07.0log 7.03.0log 3.0log 2

1bit x p x p X H i i i =⨯-⨯-=-=∑=(2分)

信道疑义度()()()符号/7015.01798.08813.0;bit Y X I X H Y X H =-=-=(2分) (3)此时可用最大似然译码准则,译码规则为

()11x y F =,()212x x y F 或=,()23x y F = (2分)

平均译码错误率

()[]

()()25.02.01.02.02

1

18,=++⨯==

=∑-a X Y i j j E a b p r y e p E p (2分) 3、(共20分)某离散无记忆信源符号集为 ,所对应的概率分别为:0.4,0.2,0.1,0.1,

0.07,0.05,0.05,0.02,0.01,码符号集为{0,1,2,3}。

1) 求信源的熵H (X )及信源剩余度 ;(2+2=4分)

信源的熵:

(2分)信源剩余度:(2分)

2)对其进行四元Huffman编码;(5分)

,其中,若取,可得大于9但与9最接近的正整数10,因此在Huffman 编码是加入一个零概率符号。

编码为332;编码为331;编码为330;编码为32;编码为31;编码为30;编码为2;

编码为1;编码为0

3)求平均码长,编码效率及编码器输出的信息传输率(码率)R。

平均码长:

码元/信息符号(2分)编码效率:0.9194(2分)

信息传输速率: 1.8388比特/符号(2分)

4、已知加性高斯白噪声(AWGN,Add itiveWhite Gaussian Noise)信道,信号的带宽范围为300~3400Hz,信号与噪声功率比为26 dB,(1)计算该信道的最大信息传输速率;(2)若信号与噪声功率比降到10dB,且保持信道最大信息传输速率不变,则信道带宽应该变为多少?

解:(1)计算该信道的最大信息传输速率;(5分)

W=3400-300=3100Hz

SNR=26dB=398

(2)若信号与噪声功率比降到10dB,且保持信道最大信息传输速率不变,则信道带宽应该变为多少?(5分)

SNR=10dB=10。