- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

例如,语音信号{X(t)} 、热噪声信号{n(t)}

离散无记忆平稳信源

离散平稳信源的特例,信源发出的符号都相互统计独 立,即各随机变量Xi (i=1,2,…,N)之间统计独立 性质:

独立->p (X )= p (X1, X2, …,XN)= p1(X1) · 2(X2)· · N(XN) p ·p

的取值A:{a1, a2,…, aq}是有限的或可数的,可用 一维离散型随机变量X来描述。 例:投硬币、书信、电报符号等等。

数学模型:设每个信源符号ai出现的(先验)概率

p(ai) (i=1,2,…,q) 满足:

p(a ) 1

i 1 i

q

a2 a3 ... ... aq X a1 p(a ) p(a ) p(a ) ... ... p(a ) 2 3 q p ( x) 1 概率空间能表征离散信源的统计特性,因此又称 概率空间为信源空间。

当记忆信源的记忆长度为m+1时,称这种有记忆 信源为m阶马尔可夫信源 若上述条件概率与时间起点 i 无关,信源输出的 符号序列可看成为时齐马尔可夫链,则此信源称 为时齐马尔可夫信源

更一般情况:随机波形信源

实际信源输出的消息常常是时间和取值都是连续的。 这类信源称为随机波形信源。

随机波形信源在某一固定时间 t0 的可能取值是连续 和随机的。对于这种信源输出的消息,可用随机过 程来描述。 例:语音信号X(t)、热噪声信号n(t)、电视图像信号 X(r(t),g(t),b(t))等时间连续函数。

平稳-> p1 (Xi) = p2 (Xi)=· · pN (Xi) -> p (Xi) ·=

p( X) p( X 1 X 2 X N ) p( X i )

i 1 N

设各随机变量Xi取值同一符号集A:{a1,a2,…,aq},则

p(x i ) p(ai1ai 2 ,..., aiN ) p(aik ), ik (1, 2,..., q)

I (ai ) f [ p(ai )]

I(ai)代表两种含义: (1)当事件ai发生之前,表示事件ai发生的不确定性

(2)当事件ai发生之后,表示事件ai所提供的信息量

某事件发生所含有的信息量应该是该事件发生的先验概率 的函数。即:

I (ai) = f [ p(ai)]

根据客观事实和人们的习惯概念,函数 f [ p(ai)] 应满足以 下条件:

满足

或

或

a

b

p( x)dx 1

p( x)dx 1

R

平稳随机序列信源

总体特点:

信源输出的消息由一系列符号序列所组成,可用N 维随机矢量 X=(X1,X2,…,XN)描述,且随机矢量X 的各维概率分布都与时间起点无关----平稳!

离散平稳信源:每个随机变量Xi (i=1,2,…,N) 都是离散型随机变量 例如,投掷硬币 连续平稳信源:每个随机变量Xi (i=1,2,…,N) 都是取值连续的随机变量

1/2

x2(阴)

1/4

x3(雨)

1/8

x4(雪)

1/8

解:据表所示,求出各事件发生所带来的自信息量有:

I ( x1 ) log 2 p( x1 ) 1(bit ) I ( x3 ) log 2 p( x3 ) 3(bit ) I ( x2 ) log 2 p( x2 ) 2(bit ) I ( x4 ) log 2 p( x4 ) 3(bit )

logb X loga X logb a

1 nat = 1.44bit , 1 hat = 3.32 bit;

一般计算都采用以“2”为底的对数,为了书写简洁, 常把底数“2”略去不写。

[例2.2.2] 某地某月份的气象资料如下表所示,求 相应事件的发生所带来的自信息量。

xi

p(xi)

x1(晴)

连续信源(单符号)

特点:

输出是单个符号(代码)的消息,输出

消息的符号集A的取值是连续的,可用一维的连 续型随机变量X 来描述。

例:语音信号、热噪声信号、测控系统中有关电压、 温度、压力等测得的连续数据等等。

R p (x)

数学模型: 连续型的概率空间。即:

X ( a , b ) p ( x) p ( x)

如果被告知摸出的是红球,那么获得的信息量是:

I (a1) =-log p(a1) =-log0.8= 0.32 (比特)

如被告知摸出来的是白球,所获得的信息量应为:

I (a2) = -log p(a2) = -log0.2 = 2.32 (比特)

平均摸取一次所能获得的信息量为 :

H(X)= p(a1) I (a1) + p(a2) I (a2) =0.72(比特/符号)

熵的含义

熵----考虑的是整个集合的统计特性,它从平均意义上来 表征信源的总体特征。 在信源输出前,信息熵H(X) 表示信源的平均不确定性; 在信源输出后,信息熵H(X)表示每个消息提供的平均信 息量; 信息熵H(X) 表征了变量X的随机特性。 例如,有两信源X、Y,其概率空间分别为:

k 1 N

N维随机矢量的一个取值, i=(ai1 ai2…aiN)

p(aik )是符号集A的 一维概率分布

X a1 若信源空间: p( x) p(a1 )

a2 p(a2 )

aq p(a3 ) ... ... p(aq ) a3 ... ...

对数函数满足上述条件:

1 I (ai ) f [ p(ai )] log r p(ai )

一点说明

计算自信息量时要注意有关事件发生概率的计算; 自信息量的单位取决于对数的底;

底为2,单位为“比特(bit, binary unit)”; 底为e,单位为“奈特(nat, nature unit)”; 底为10,单位为“哈特(hat, Hartley)”; 由换底公式:

该例说明,一个随机事件发生的概率越小,它的不 确定性就越大,那么当它发生时对外提供的自信息量 也就越大。

在一般情况下,收到某消息获得的信息量(即收到某消息 后获得关于某事件发生的信息量) =不确定性减少的量 =(收到此消息前关于某事件发生的不确定性)

- (收到此消息后关于某事件发生的不确定性)

对无噪声信道,收到某消息获得的信息量

例:汉字组成的中文序列中,只有根据中文的语法、

习惯用语、修辞制约和表达实际意义的制约所构成的中 文序列才是有意义的中文句子或文章。

所以,在汉字序列中前后文字的出现是有依赖的,不能 认为是彼此不相关的。其他自然语言如英文,德文等都 是如此.

m阶马尔可夫信源

不同时刻发出的符号间的依赖关系

p( xi | xi 2 xi 1 xi 1 xi 2 xi m x1 ) p( xi | xi 1 xi 2 xi m ) (i 1, 2, , N )

推论:

一. 自信息

设离散信源X的概率空间为:

X a1 p ( x) p (a ) 1

a2 p(a2 )

aq q p(ai ) 1 p(a3 ) ... ... p(aq ) i 1 a3 ... ...

称事件ai发生所含有的信息量为 ai 的自信息量。 定义为:

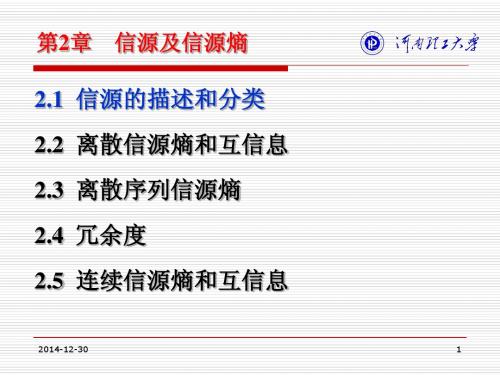

所组成,可用N维随机矢量 X=(X1,X2,…,XN)描述,且随机 矢量X 的各维概率分布都与时间起点无关----平稳!! 离散平稳信源 连续平稳信源 无记忆(独立)离散平稳信源 有记忆信源 m阶马尔可夫信源随机波形ຫໍສະໝຸດ 源离散信源(单符号)

特点:输出是单个符号(代码)的消息,符号集

描述的信源X的各输出Xi间统计独立、且取值同一 例如:A={1,2,3},N=2。则XN为: 符号集A,则X为离散无记忆信源,称该信源输出 {11,12,13,21,22,23,31,32,33 } 的N维随机矢量X 为离散无记忆信源X的N次扩展 信源

若X 取值为符号集i =(ai1ai2…aiN), 其中(i1 , i2 ,…,iN =1,2 , …,q),则离散无记忆信源的N次扩展信源的 数学模型是X信源空间的N重空间:

一个随机过程{x(t)}

一个样本{xi(t)} (一个自由度)

信源的分类及其数学模型

2.2

离散信源的信息熵其性质

讨论基本的离散信源(即输出为单个符号的消 息,且这些消息间两两互不相关)

基本的离散信源可用一维随机变量X来描述信 源的输出,信源的数学模型可抽象为: a2 a3 ... ... aq q X a1 p( x) p(a ) p(a ) p(a ) ... ... p(a ) p(ai ) 1 2 3 q i 1 1

=收到此消息前关于某事件发生的不确定性

=信源输出的某消息中所含有的自信息量

二. 信息熵

对一个信源发出不同的消息所含有的信息量也不同, 不能用它来作为整个信源的信息度量。

定义自信息的数学期望为平均自信息量Hr(X),称为 信息熵:

q 1 p(ai ) logr p(ai ) H r ( X ) E logr p(ai ) i 1 q 1 p(ai ) log p(ai ) 当r=2时: H ( X ) E log p(ai ) i 1

X N 1 p( i ) p(1 )