SPSS_第07章 回归分析

- 格式:ppt

- 大小:176.00 KB

- 文档页数:115

SPSS回归分析SPSS(统计包统计软件,Statistical Package for the Social Sciences)是一种强大的统计分析软件,广泛应用于各个领域的数据分析。

在SPSS中,回归分析是最常用的方法之一,用于研究和预测变量之间的关系。

接下来,我将详细介绍SPSS回归分析的步骤和意义。

一、回归分析的定义和意义回归分析是一种对于因变量和自变量之间关系的统计方法,通过建立一个回归方程,可以对未来的数据进行预测和预估。

在实际应用中,回归分析广泛应用于经济学、社会科学、医学、市场营销等领域,帮助研究人员发现变量之间的关联、预测和解释未来的趋势。

二、SPSS回归分析的步骤1. 导入数据:首先,需要将需要进行回归分析的数据导入SPSS软件中。

数据可以以Excel、CSV等格式准备好,然后使用SPSS的数据导入功能将数据导入软件。

2. 变量选择:选择需要作为自变量和因变量的变量。

自变量是被用来预测或解释因变量的变量,而因变量是我们希望研究或预测的变量。

可以通过点击"Variable View"选项卡来定义变量的属性。

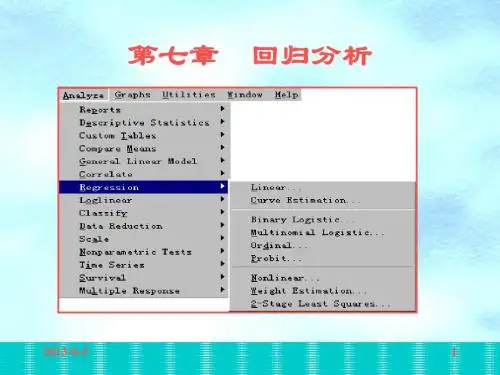

3. 回归分析:选择菜单栏中的"Analyze" -> "Regression" -> "Linear"。

然后将因变量和自变量添加到正确的框中。

4.回归模型选择:选择回归方法和模型。

SPSS提供了多种回归方法,通常使用最小二乘法进行回归分析。

然后,选择要放入回归模型的自变量。

可以进行逐步回归或者全模型回归。

6.残差分析:通过检查残差(因变量和回归方程预测值之间的差异)来评估回归模型的拟合程度。

可以使用SPSS的统计模块来生成残差,并进行残差分析。

7.结果解释:最后,对回归结果进行解释,并提出对于研究问题的结论。

要注意的是,回归分析只能描述变量之间的关系,不能说明因果关系。

因此,在解释回归结果时要慎重。

第7章 岭回归思考与练习参考答案7.1 岭回归估计是在什么情况下提出的?答:当自变量间存在复共线性时,|X’X |≈0,回归系数估计的方差就很大, 估计值就很不稳定,为解决多重共线性,并使回归得到合理的结果,70年代提出了岭回归(Ridge Regression,简记为RR)。

7.2岭回归的定义及统计思想是什么?答:岭回归法就是以引入偏误为代价减小参数估计量的方差的一种回归方法,其统计思想是对于(X ’X )-1为奇异时,给X’X 加上一个正常数矩阵D, 那么X’X+D接近奇异的程度就会比X ′X 接近奇异的程度小得多,从而完成回归。

但是这样的回归必定丢失了信息,不满足blue 。

但这样的代价有时是值得的,因为这样可以获得与专业知识相一致的结果。

7.3 选择岭参数k 有哪几种方法?答:最优k 是依赖于未知参数β和2σ的,几种常见的选择方法是: ○1岭迹法:选择0k 的点能使各岭估计基本稳定,岭估计符号合理,回归系数没有不合乎经济意义的绝对值,且残差平方和增大不太多; ○2方差扩大因子法:11()()()c k X X kI X X X X kI --'''=++,其对角线元()jj c k 是岭估计的方差扩大因子。

要让()10jj c k ≤;○3残差平方和:满足()SSE k cSSE <成立的最大的k 值。

7.4 用岭回归方法选择自变量应遵循哪些基本原则? 答:岭回归选择变量通常的原则是:1. 在岭回归的计算中,我们通常假定涉及矩阵已经中心化和标准化了,这样可以直接比较标准化岭回归系数的大小。

我们可以剔除掉标准化岭回归系数比较稳定且绝对值很小的自变量;2. 当k 值较小时,标准化岭回归系数的绝对值并不很小,但是不稳定,随着k 的增加迅速趋近于零。

像这样岭回归系数不稳定、震动趋于零的自变量,我们也可以予以剔除;3. 去掉标准化岭回归系数很不稳定的自变量。

如果有若干个岭回归系数不稳定,究竟去掉几个,去掉那几个,要根据去掉某个变量后重新进行岭回归分析的效果来确定。

SPSS回归分析过程详解一、相关分析在医学中经常要遇到分析两个或多个变量间关系的的密切程度,需要用相关分析实现。

SPSS的相关分析功能被集中在Statistics 菜单的Correlate子菜单中,包括以下三个过程:Bivariate 过程此过程用于进行两个/多个变量间的参数/非参数相关分析,如果是多个变量,则给出两两相关的分析结果。

这是Correlate 子菜单中最为常用的一个过程,实际上我们对他的使用可能占到相关分析的95%以上。

下面的讲述也以该过程为主。

Partial过程如果需要进行相关分析的两个变量其取值均受到其他变量的影响,就可以利用偏相关分析对其他变量进行控制,输出控制其他变量影响后的相关系数,这种分析思想和协方差分析非常类似。

Partial过程就是专门进行偏相关分析的。

Distances过程调用此过程可对同一变量内部各观察单位间的数值或各个不同变量间进行距离相关分析,前者可用于检测观测值的接近程度,后者则常用于考察预测值对实际值的拟合优度。

该过程在实际应用中用的非常少。

Bivariate 过程一、界面说明[Variables 框】用于选入需要进行相关分析的变量,至少需要选入两个。

【Correlatio n Coefficie nts 复选框组】用于选择需要计算的相关分析指标,有:Pearson 复选框选择进行积距相关分析,即最常用的参数相关分析Kendall's tau-b 复选框计算Kendall's 等级相关系数Spearman复选框计算Spearman相关系数,即最常用的非参数相关分析(秩相关)【Test of Significance 单选框组】用于确定是进行相关系数的单侧( One-tailed )或双侧( Two-tailed )检验,一般选双侧检验。

【Flag significant correlations 】用于确定是否在结果中用星号标记有统计学意义的相关系数,一般选中。

第七章回归分析OUTLINE一元线性回归01多元归回02一元线性回归一元线性回归操作过程在SPSS中单击主菜单“Analyze→Regression→Linear…”,进入设置对话框。

从左边变量表列中把因变量学生数学学业成绩(MATH)选入到因变量(Dependent)框中,把自变量学生家庭社会经济地(ESCS)选入到自变量(Independent)框中。

一元线性回归操作过程单击“Statistics…”按钮,可以选择需要输出的一些统计量。

如Regression Coefficients(回归系数)中的Estimates,可以输出回归系数及相关统计量,包括回归系数B、标准误、标准化回归系数BETA、t值及显著性p值等;另外还可以通过勾选“Confidence intervals”得到回归系数置信区间的结果。

“Model fit”项可输出相关系数R,测定系数R2,调整系数,估计标准误及方差分析表。

上述两项为默认选项,请注意保持选中。

此处还可以勾选“Residuals”(残差)下的“Durbin-Watson”检验,可以检验残差与自变量之间是否相互独立;以及对数据中的异常值进行诊断。

一元线性回归操作过程单击“Options…”按钮,打开它的对话框,可以看到中间有一项Include constant in equation可选项。

选中该项可输出对常数的检验。

在“Options”对话框中,还可以定义处理缺失值的方法和设置多元逐步回归中变量进入和排除方程的准则,这里我们采用系统的默认设置,设置完成后点击“Continue”返回主对话框。

一元线性回归的结果输出模型中包含的自变量及进入方式一元线性回归的结果输出模型拟合概述一元线性回归的结果输出回归方程检验方差分析表一元线性回归的结果输出回归系数估计及其检验表多元回归多元回归操作过程(标准多元回归)多元线性回归所用命令语句与一元线性回归相同,同样可以通过单击主菜单“Analyze→Regression→Linear…”,进入设置对话框,如图所示。

SPSS回归分析SPSS(Statistical Package for the Social Sciences)是一种用来进行统计分析的软件,其中包括回归分析。

回归分析是一种用来找出因变量与自变量之间关系的统计方法。

在回归分析中,我们可以通过控制自变量,预测因变量的值。

SPSS中的回归分析提供了多种模型,其中最常用的是线性回归分析。

线性回归分析模型假设因变量与自变量之间存在线性关系。

在执行回归分析前,需要明确因变量和自变量的选择。

通常,因变量是我们要预测或解释的变量,而自变量是用来解释或预测因变量的变量。

首先,我们需要导入数据到SPSS。

在导入数据前,要确保数据的结构合适,缺失值得到正确处理。

然后,在SPSS中打开回归分析对话框,选择线性回归模型。

接下来,我们需要指定因变量和自变量。

在指定因变量和自变量后,SPSS会自动计算回归模型的系数和统计指标。

其中,回归系数表示自变量的影响程度,统计指标(如R方)可以衡量模型的拟合程度。

在执行回归分析后,我们可以进一步分析回归模型的显著性。

一种常用的方法是检查回归系数的显著性。

SPSS会为每个回归系数提供一个t检验和相应的p值。

p值小于其中一显著性水平(通常是0.05)可以认为回归系数是显著的,即自变量对因变量的影响是有意义的。

此外,我们还可以通过分析残差来检查模型的适当性。

残差是观测值与回归模型预测值之间的差异。

如果残差分布服从正态分布,并且没有明显的模式(如异方差性、非线性),则我们可以认为模型是适当的。

最后,我们可以使用SPSS的图表功能来可视化回归模型。

比如,我们可以绘制散点图来展示自变量和因变量之间的关系,或者绘制残差图来检查模型的适当性。

总之,SPSS提供了强大的回归分析功能,可以帮助我们探索变量之间的关系并预测因变量的值。

通过进行回归分析,我们可以得到有关自变量对因变量的影响的信息,并评估模型的拟合程度和适用性。