人工智能 第5章 不确定性推理

- 格式:ppt

- 大小:4.39 MB

- 文档页数:102

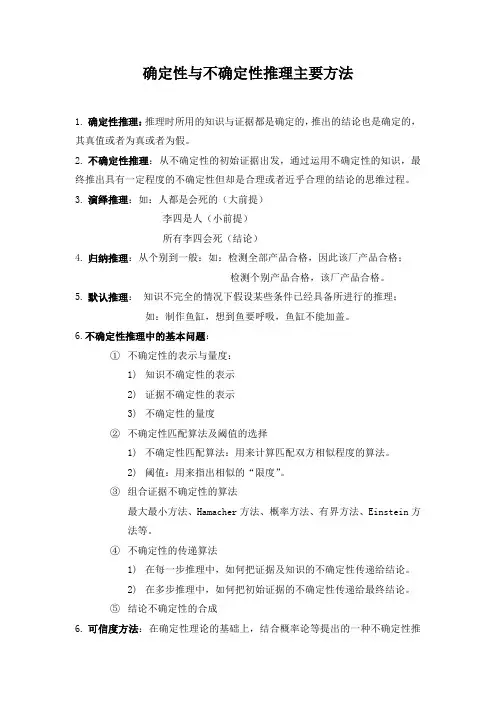

确定性与不确定性推理主要方法1.确定性推理:推理时所用的知识与证据都是确定的,推出的结论也是确定的,其真值或者为真或者为假。

2.不确定性推理:从不确定性的初始证据出发,通过运用不确定性的知识,最终推出具有一定程度的不确定性但却是合理或者近乎合理的结论的思维过程。

3.演绎推理:如:人都是会死的(大前提)李四是人(小前提)所有李四会死(结论)4.归纳推理:从个别到一般:如:检测全部产品合格,因此该厂产品合格;检测个别产品合格,该厂产品合格。

5.默认推理:知识不完全的情况下假设某些条件已经具备所进行的推理;如:制作鱼缸,想到鱼要呼吸,鱼缸不能加盖。

6.不确定性推理中的基本问题:①不确定性的表示与量度:1)知识不确定性的表示2)证据不确定性的表示3)不确定性的量度②不确定性匹配算法及阈值的选择1)不确定性匹配算法:用来计算匹配双方相似程度的算法。

2)阈值:用来指出相似的“限度”。

③组合证据不确定性的算法最大最小方法、Hamacher方法、概率方法、有界方法、Einstein方法等。

④不确定性的传递算法1)在每一步推理中,如何把证据及知识的不确定性传递给结论。

2)在多步推理中,如何把初始证据的不确定性传递给最终结论。

⑤结论不确定性的合成6.可信度方法:在确定性理论的基础上,结合概率论等提出的一种不确定性推理方法。

其优点是:直观、简单,且效果好。

可信度:根据经验对一个事物或现象为真的相信程度。

可信度带有较大的主观性和经验性,其准确性难以把握。

C-F模型:基于可信度表示的不确定性推理的基本方法。

CF(H,E)的取值范围: [-1,1]。

若由于相应证据的出现增加结论 H 为真的可信度,则 CF(H,E)> 0,证据的出现越是支持 H 为真,就使CF(H,E) 的值越大。

反之,CF(H,E)< 0,证据的出现越是支持 H 为假,CF(H,E)的值就越小。

若证据的出现与否与 H 无关,则 CF(H,E)= 0。

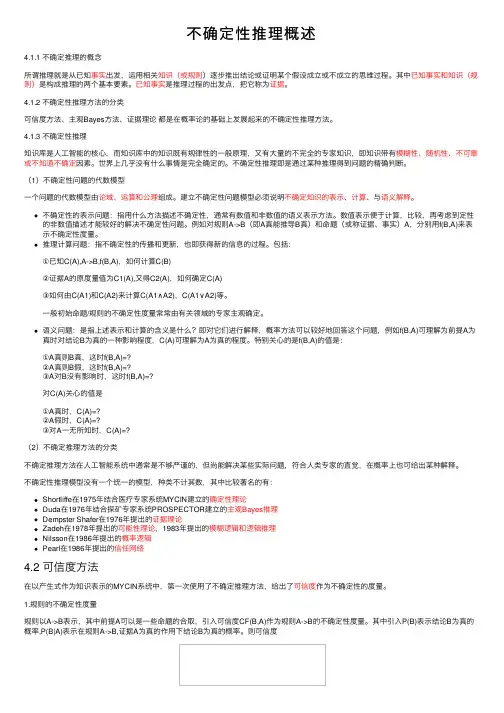

不确定性推理概述4.1.1 不确定推理的概念所谓推理就是从已知事实出发,运⽤相关知识(或规则)逐步推出结论或证明某个假设成⽴或不成⽴的思维过程。

其中已知事实和知识(规则)是构成推理的两个基本要素。

已知事实是推理过程的出发点,把它称为证据。

4.1.2 不确定性推理⽅法的分类可信度⽅法、主观Bayes⽅法、证据理论都是在概率论的基础上发展起来的不确定性推理⽅法。

4.1.3 不确定性推理知识库是⼈⼯智能的核⼼,⽽知识库中的知识既有规律性的⼀般原理,⼜有⼤量的不完全的专家知识,即知识带有模糊性、随机性、不可靠或不知道不确定因素。

世界上⼏乎没有什么事情是完全确定的。

不确定性推理即是通过某种推理得到问题的精确判断。

(1)不确定性问题的代数模型⼀个问题的代数模型由论域、运算和公理组成。

建⽴不确定性问题模型必须说明不确定知识的表⽰、计算、与语义解释。

不确定性的表⽰问题:指⽤什么⽅法描述不确定性,通常有数值和⾮数值的语义表⽰⽅法。

数值表⽰便于计算,⽐较,再考虑到定性的⾮数值描述才能较好的解决不确定性问题。

例如对规则A->B(即A真能推导B真)和命题(或称证据、事实)A,分别⽤f(B,A)来表⽰不确定性度量。

推理计算问题:指不确定性的传播和更新,也即获得新的信息的过程。

包括:①已知C(A),A->B,f(B,A),如何计算C(B)②证据A的原度量值为C1(A),⼜得C2(A),如何确定C(A)③如何由C(A1)和C(A2)来计算C(A1∧A2),C(A1∨A2)等。

⼀般初始命题/规则的不确定性度量常常由有关领域的专家主观确定。

语义问题:是指上述表⽰和计算的含义是什么?即对它们进⾏解释,概率⽅法可以较好地回答这个问题,例如f(B,A)可理解为前提A为真时对结论B为真的⼀种影响程度,C(A)可理解为A为真的程度。

特别关⼼的是f(B,A)的值是:①A真则B真,这时f(B,A)=?②A真则B假,这时f(B,A)=?③A对B没有影响时,这时f(B,A)=?对C(A)关⼼的值是①A真时,C(A)=?②A假时,C(A)=?③对A⼀⽆所知时,C(A)=?(2)不确定推理⽅法的分类不确定推理⽅法在⼈⼯智能系统中通常是不够严谨的,但尚能解决某些实际问题,符合⼈类专家的直觉,在概率上也可给出某种解释。

《人工智能》课程习题与部分解答第1章 绪论什么是人工智能 它的研究目标是什么什么是图灵测试简述图灵测试的基本过程及其重要特征. 在人工智能的发展过程中,有哪些思想和思潮起了重要作用 在人工智能的发展过程中,有哪些思想和思潮起了重要作用人工智能的主要研究和应用领域是什么其中,哪些是新的研究热点第2章 知识表示方法什么是知识分类情况如何什么是知识表示不同的知识表示方法各有什么优缺点 人工智能对知识表示有什么要求 用谓词公式表示下列规则性知识:自然数都是大于零的整数。

任何人都会死的。

[解] 定义谓词如下:N(x): “x 是自然数”, I(x): “x 是整数”, L(x): “x 大于0”, D(x): “x 会死的”, M(x): “x 是人”,则上述知识可用谓词分别表示为: )]()()()[(x I x L x N x ∨→∀ )]()()[(x D x M x →∀用谓词公式表示下列事实性知识:小明是计算机系的学生,但他不喜欢编程。

李晓新比他父亲长得高。

产生式系统由哪几个部分组成 它们各自的作用是什么可以从哪些角度对产生式系统进行分类 阐述各类产生式系统的特点。

简述产生式系统的优缺点。

简述框架表示的基本构成,并给出框架的一般结构 框架表示法有什么特点试构造一个描述你的卧室的框架系统。

试描述一个具体的大学教师的框架系统。

[解] 一个具体大学教师的框架系统为: 框架名:<教师-1> 类属:<大学教师>姓名:张宇 性别:男年龄:32职业:<教师>职称:副教授部门:计算机系研究方向:计算机软件与理论工作:参加时间:2000年7月工龄:当前年份-2000工资:<工资单>把下列命题用一个语义网络表示出来(1)树和草都是植物;(2)树和草都是有根有叶的;(3)水草是草,且生长在水中;(4)果树是树,且会结果;(5)苹果树是果树的一种,它结苹果。

[解]在基于语义网络的推理系统中,一般有几种推理方法,简述它们的推理过程。

《人工智能》课程习题与部分解答第1章 绪论什么是人工智能? 它的研究目标是什么?什么是图灵测试?简述图灵测试的基本过程及其重要特征. 在人工智能的发展过程中,有哪些思想和思潮起了重要作用? 在人工智能的发展过程中,有哪些思想和思潮起了重要作用? 人工智能的主要研究和应用领域是什么?其中,哪些是新的研究热点?第2章 知识表示方法什么是知识?分类情况如何?什么是知识表示?不同的知识表示方法各有什么优缺点? 人工智能对知识表示有什么要求? 用谓词公式表示下列规则性知识:自然数都是大于零的整数。

任何人都会死的。

[解] 定义谓词如下:N(x): “x 是自然数”, I(x): “x 是整数”, L(x): “x 大于0”, D(x): “x 会死的”, M(x): “x 是人”,则上述知识可用谓词分别表示为: )]()()()[(x I x L x N x ∨→∀ )]()()[(x D x M x →∀用谓词公式表示下列事实性知识:小明是计算机系的学生,但他不喜欢编程。

李晓新比他父亲长得高。

产生式系统由哪几个部分组成? 它们各自的作用是什么?可以从哪些角度对产生式系统进行分类? 阐述各类产生式系统的特点。

简述产生式系统的优缺点。

简述框架表示的基本构成,并给出框架的一般结构框架表示法有什么特点?试构造一个描述你的卧室的框架系统。

试描述一个具体的大学教师的框架系统。

[解] 一个具体大学教师的框架系统为:框架名:<教师-1>类属:<大学教师>姓名:张宇性别:男年龄:32职业:<教师>职称:副教授部门:计算机系研究方向:计算机软件与理论工作:参加时间:2000年7月工龄:当前年份-2000工资:<工资单>把下列命题用一个语义网络表示出来(1)树和草都是植物;(2)树和草都是有根有叶的;(3)水草是草,且生长在水中;(4)果树是树,且会结果;(5)苹果树是果树的一种,它结苹果。

不确定性推理部分参考答案1.设有如下一组推理规则:r1: IF E1THEN E2 (0.6)r2: IF E2AND E3THEN E4 (0.7)r3: IF E4THEN H (0.8)r4: IF E5THEN H (0.9)且已知CF(E1)=0.5, CF(E3)=0.6, CF(E5)=0.7。

求CF(H)=?解:(1) 先由r1求CF(E2)CF(E2)=0.6 × max{0,CF(E1)}=0.6 × max{0,0.5}=0.3(2) 再由r2求CF(E4)CF(E4)=0.7 × max{0, min{CF(E2 ), CF(E3 )}}=0.7 × max{0, min{0.3, 0.6}}=0.21(3) 再由r3求CF1(H)CF1(H)= 0.8 × max{0,CF(E4)}=0.8 × max{0, 0.21)}=0.168(4) 再由r4求CF2(H)CF2(H)= 0.9 ×max{0,CF(E5)}=0.9 ×max{0, 0.7)}=0.63(5) 最后对CF1(H )和CF2(H)进行合成,求出CF(H)CF(H)= CF1(H)+CF2(H)+ CF1(H) × CF2(H)=0.6922 设有如下推理规则r1: IF E1THEN (2, 0.00001) H1r2: IF E2THEN (100, 0.0001) H1r3: IF E3THEN (200, 0.001) H2r4: IF H1THEN (50, 0.1) H2且已知P(E1)= P(E2)= P(H3)=0.6, P(H1)=0.091, P(H2)=0.01, 又由用户告知:P(E1| S1)=0.84, P(E2|S2)=0.68, P(E3|S3)=0.36请用主观Bayes方法求P(H2|S1, S2, S3)=?解:(1) 由r1计算O(H1| S1)先把H1的先验概率更新为在E1下的后验概率P(H1| E1)P(H1| E1)=(LS1× P(H1)) / ((LS1-1) × P(H1)+1)=(2 × 0.091) / ((2 -1) × 0.091 +1)=0.16682由于P(E1|S1)=0.84 > P(E1),使用P(H | S)公式的后半部分,得到在当前观察S1下的后验概率P(H1| S1)和后验几率O(H1| S1)P(H1| S1) = P(H1) + ((P(H1| E1) – P(H1)) / (1 - P(E1))) × (P(E1| S1) – P(E1))= 0.091 + (0.16682 –0.091) / (1 – 0.6)) × (0.84 – 0.6)=0.091 + 0.18955 × 0.24 = 0.136492O(H1| S1) = P(H1| S1) / (1 - P(H1| S1))= 0.15807(2) 由r2计算O(H1| S2)先把H1的先验概率更新为在E2下的后验概率P(H1| E2)P(H1| E2)=(LS2×P(H1)) / ((LS2-1) × P(H1)+1)=(100 × 0.091) / ((100 -1) × 0.091 +1)=0.90918由于P(E2|S2)=0.68 > P(E2),使用P(H | S)公式的后半部分,得到在当前观察S2下的后验概率P(H1| S2)和后验几率O(H1| S2)P(H1| S2) = P(H1) + ((P(H1| E2) – P(H1)) / (1 - P(E2))) × (P(E2| S2) – P(E2))= 0.091 + (0.90918 –0.091) / (1 – 0.6)) × (0.68 – 0.6)=0.25464O(H1| S2) = P(H1| S2) / (1 - P(H1| S2))=0.34163(3) 计算O(H1| S1,S2)和P(H1| S1,S2)先将H1的先验概率转换为先验几率O(H1) = P(H1) / (1 - P(H1)) = 0.091/(1-0.091)=0.10011再根据合成公式计算H1的后验几率O(H1| S1,S2)= (O(H1| S1) / O(H1)) × (O(H1| S2) / O(H1)) × O(H1)= (0.15807 / 0.10011) × (0.34163) / 0.10011) × 0.10011= 0.53942再将该后验几率转换为后验概率P(H1| S1,S2) = O(H1| S1,S2) / (1+ O(H1| S1,S2))= 0.35040(4) 由r3计算O(H2| S3)先把H2的先验概率更新为在E3下的后验概率P(H2| E3)P(H2| E3)=(LS3× P(H2)) / ((LS3-1) × P(H2)+1)=(200 × 0.01) / ((200 -1) × 0.01 +1)=0.09569由于P(E3|S3)=0.36 < P(E3),使用P(H | S)公式的前半部分,得到在当前观察S3下的后验概率P(H2| S3)和后验几率O(H2| S3)P(H2| S3) = P(H2 | ¬ E3) + (P(H2) – P(H2| ¬E3)) / P(E3)) × P(E3| S3)由当E3肯定不存在时有P(H2 | ¬ E3) = LN3× P(H2) / ((LN3-1) × P(H2) +1)= 0.001 × 0.01 / ((0.001 - 1) × 0.01 + 1)= 0.00001因此有P(H2| S3) = P(H2 | ¬ E3) + (P(H2) – P(H2| ¬E3)) / P(E3)) × P(E3| S3)=0.00001+((0.01-0.00001) / 0.6) × 0.36=0.00600O(H2| S3) = P(H2| S3) / (1 - P(H2| S3))=0.00604(5) 由r4计算O(H2| H1)先把H2的先验概率更新为在H1下的后验概率P(H2| H1)P(H2| H1)=(LS4× P(H2)) / ((LS4-1) × P(H2)+1)=(50 × 0.01) / ((50 -1) × 0.01 +1)=0.33557由于P(H1| S1,S2)=0.35040 > P(H1),使用P(H | S)公式的后半部分,得到在当前观察S1,S2下H2的后验概率P(H2| S1,S2)和后验几率O(H2| S1,S2)P(H2| S1,S2) = P(H2) + ((P(H2| H1) – P(H2)) / (1 - P(H1))) × (P(H1| S1,S2) – P(H1))= 0.01 + (0.33557 –0.01) / (1 – 0.091)) × (0.35040 – 0.091)=0.10291O(H2| S1,S2) = P(H2| S1, S2) / (1 - P(H2| S1, S2))=0.10291/ (1 - 0.10291) = 0.11472(6) 计算O(H2| S1,S2,S3)和P(H2| S1,S2,S3)先将H2的先验概率转换为先验几率O(H2) = P(H2) / (1 - P(H2) )= 0.01 / (1-0.01)=0.01010再根据合成公式计算H1的后验几率O(H2| S1,S2,S3)= (O(H2| S1,S2) / O(H2)) × (O(H2| S3) / O(H2)) ×O(H2)= (0.11472 / 0.01010) × (0.00604) / 0.01010) × 0.01010=0.06832再将该后验几率转换为后验概率P(H2| S1,S2,S3) = O(H1| S1,S2,S3) / (1+ O(H1| S1,S2,S3))= 0.06832 / (1+ 0.06832) = 0.06395可见,H2原来的概率是0.01,经过上述推理后得到的后验概率是0.06395,它相当于先验概率的6倍多。