人工神经网络的模型

- 格式:doc

- 大小:840.88 KB

- 文档页数:9

人工神经元的m-p模型公式

人工神经元的M-P(McCulloch-Pitts)模型是早期神经网络模型的一种简化形式。

它描述了神经元的输入-输出关系,并被用来理解和模拟神经元的计算过程。

M-P模型的公式如下:

输入权重和输入值的加权和,以及阈值的组合称为神经元的输入电流:

I = ∑(w * x) - θ

其中:

•I 是神经元的输入电流。

•∑ 表示求和操作。

•w 是输入的权重。

•x 是对应输入的值。

•θ 是神经元的阈值。

神经元的输出可以根据以下规则确定:

如果输入电流大于或等于阈值(I ≥ θ)时,神经元的输出(y)等于1。

如果输入电流小于阈值(I < θ)时,神经元的输出(y)等于0。

这个简单的模型基于斯坦福大学的Warren McCulloch和Walter Pitts在1943年的工作,为神经元的计算过程提供了初步的数学描述。

虽然M-P模型是一个最早的神经元模型,并且较为简化,但它为后来更复杂的神经网络模型奠定了基础,并为理解神经

元的计算和信息处理提供了重要的启示。

后续发展的模型,如感知机、多层感知机和深度神经网络等,进一步扩展和改进了神经网络模型的能力。

人工神经网络模型及应用领域分析人工神经网络(Artificial Neural Network)是一种模拟生物神经网络的智能系统。

它由一系列处理单元,即神经元所组成,能够学习、适应和模拟复杂的非线性关系,具有很强的特征提取与分类能力。

其主要应用于机器学习、人工智能等领域,并在图像识别、预测控制、金融风险分析、医学诊断等方面得到广泛应用。

本文将从人工神经网络模型的原理、种类和应用领域三个方面进行探讨。

一、人工神经网络模型的原理人工神经网络模型由模拟人类神经元构成,其基本结构包括输入层、隐藏层和输出层。

其中输入层接受外部输入信息,隐层是神经网络的核心,通过将输入信息转换为内部状态进行处理,并将处理结果传递给输出层。

输出层将最终结果输出给用户。

举个例子,我们可以将输入层视为人类的五官,隐藏层类比于大脑,而输出层则类比人体的手脚。

人工神经网络各层间的信息传递包括两个过程,即正向传递和反向传递。

正向传递过程是指输入信息从输入层流向输出层的过程,即信息的传递方向是输入层-隐藏层-输出层。

反向传递过程是指通过反向误差传递算法计算并更新神经网络中每个权重的值,从而优化神经网络的过程。

二、人工神经网络的种类人工神经网络主要分为三类,分别是前馈神经网络、递归神经网络和自适应神经网络。

一、前馈神经网络(FNN)前馈神经网络是人工神经网络中最为常见的一类,也是最简单的神经网络类型之一。

其功能类似于单向传导信息的系统,例如生物的视网膜和传感器等。

前馈神经网络只有正向传递过程,而没有反向传递过程。

前馈神经网络常用于分类、识别和预测等领域。

二、递归神经网络(RNN)递归神经网络包括输入层、隐藏层和输出层,但隐藏层的神经元可以连接到之前的神经元,使信息得以传递。

与前馈神经网络不同,递归神经网络可以处理时序性数据、自然语言等。

递归神经网络的应用领域主要是非线性有限时序预测、文本分类、语音识别、图像处理、自然语言处理等。

三、自适应神经网络(ANN)自适应神经网络是一种可以自动调整结构和参数的神经网络,包括自组织神经网络和归纳神经网络。

五大神经网络模型解析近年来,人工智能的快速发展使得深度学习成为了热门话题。

而深度学习的核心就在于神经网络,它是一种能够模拟人脑神经系统的计算模型。

今天,我们就来一起解析五大神经网络模型。

1.前馈神经网络(Feedforward Neural Network)前馈神经网络是最基本的神经网络模型之一。

在前馈神经网络中,信息是单向传输的,即神经元的输出只会被后续神经元接收,不会造成回流。

前馈神经网络能够拟合线性和非线性函数,因此在分类、预测等问题的解决中被广泛应用。

前馈神经网络的一大优势在于简单易用,但同时也存在一些缺点。

例如,神经网络的训练难度大、泛化能力差等问题,需要不断探索解决之道。

2.循环神经网络(Recurrent Neural Network)与前馈神经网络不同,循环神经网络的信息是可以进行回流的。

这意味着神经元的输出不仅会传向后续神经元,还会传回到之前的神经元中。

循环神经网络在时间序列数据的处理中更为常见,如自然语言处理、语音识别等。

循环神经网络的优点在于增强了神经网络处理序列数据的能力,但是它也存在着梯度消失、梯度爆炸等问题。

为了解决这些问题,一些变种的循环神经网络模型应运而生,如长短期记忆网络(LSTM)、门控循环单元(GRU)等。

3.卷积神经网络(Convolutional Neural Network)卷积神经网络是一种类似于图像处理中的卷积操作的神经网络模型。

卷积神经网络通过卷积神经层和池化层的堆叠来对输入数据进行分层提取特征,从而进一步提高分类性能。

卷积神经网络在图像、视频、语音等领域的应用非常广泛。

卷积神经网络的优点在于对于图像等数据具有先天的特征提取能力,可以自动识别边缘、角点等特征。

但是,卷积神经网络也存在着过拟合、泛化能力欠佳等问题。

4.生成对抗网络(Generative Adversarial Network)生成对抗网络可以说是最近几年最热门的神经网络模型之一。

它基于博弈论中的对抗训练模型,由两个神经网络构成:生成器和判别器。

习题2.1什么是感知机?感知机的基本结构是什么样的?解答:感知机是Frank Rosenblatt在1957年就职于Cornell航空实验室时发明的一种人工神经网络。

它可以被视为一种最简单形式的前馈人工神经网络,是一种二元线性分类器。

感知机结构:2.2单层感知机与多层感知机之间的差异是什么?请举例说明。

解答:单层感知机与多层感知机的区别:1. 单层感知机只有输入层和输出层,多层感知机在输入与输出层之间还有若干隐藏层;2. 单层感知机只能解决线性可分问题,多层感知机还可以解决非线性可分问题。

2.3证明定理:样本集线性可分的充分必要条件是正实例点集所构成的凸壳与负实例点集构成的凸壳互不相交.解答:首先给出凸壳与线性可分的定义凸壳定义1:设集合S⊂R n,是由R n中的k个点所组成的集合,即S={x1,x2,⋯,x k}。

定义S的凸壳为conv(S)为:conv(S)={x=∑λi x iki=1|∑λi=1,λi≥0,i=1,2,⋯,k ki=1}线性可分定义2:给定一个数据集T={(x1,y1),(x2,y2),⋯,(x n,y n)}其中x i∈X=R n , y i∈Y={+1,−1} , i=1,2,⋯,n ,如果存在在某个超平面S:w∙x+b=0能够将数据集的正实例点和负实例点完全正确地划分到超平面的两侧,即对所有的正例点即y i=+1的实例i,有w∙x+b>0,对所有负实例点即y i=−1的实例i,有w∙x+b<0,则称数据集T为线性可分数据集;否则,称数据集T线性不可分。

必要性:线性可分→凸壳不相交设数据集T中的正例点集为S+,S+的凸壳为conv(S+),负实例点集为S−,S−的凸壳为conv(S−),若T是线性可分的,则存在一个超平面:w ∙x +b =0能够将S +和S −完全分离。

假设对于所有的正例点x i ,有:w ∙x i +b =εi易知εi >0,i =1,2,⋯,|S +|。

人工智能开发技术中的神经网络模型介绍人工智能开发中的神经网络模型介绍一、引言在如今快速发展的人工智能领域,神经网络模型起着重要的作用。

神经网络是一种模拟人脑神经元网络的计算模型,其广泛应用于图像识别、自然语言处理、智能机器人等领域。

本文将介绍几种常见的神经网络模型,探讨其原理和应用。

二、前馈神经网络(FNN)前馈神经网络是一种最基本的神经网络模型,其由输入层、隐藏层、输出层组成,信息流只能从输入层经过隐藏层最终到达输出层。

在前馈神经网络中,信息只能前向传播,没有反馈回路。

这种结构使前馈神经网络适用于分类、回归等任务。

三、卷积神经网络(CNN)卷积神经网络是一种专门用于处理具有网格结构数据的神经网络模型。

与前馈神经网络不同,卷积神经网络在隐藏层中引入了卷积运算和池化操作,可以有效地提取输入数据中的局部特征。

因此,卷积神经网络在图像识别、目标检测等领域取得了巨大成功。

四、循环神经网络(RNN)循环神经网络是一种在时间序列数据上展开的神经网络模型。

在隐藏层中,循环神经网络引入了循环连接,使网络能够处理序列数据之间的依赖关系。

与前馈神经网络和卷积神经网络不同,循环神经网络可以通过时间反向传播,从而能够处理具有动态变化的数据,如语音识别、机器翻译等任务。

五、深度神经网络(DNN)深度神经网络是指具有多个隐藏层的神经网络模型。

深度神经网络的优势在于可以从数据中学习更高级的特征表示,从而提高模型的性能。

深度神经网络的训练常常使用反向传播算法,通过最小化损失函数来优化网络参数。

近年来,深度神经网络在计算机视觉、自然语言处理等领域取得了令人瞩目的成果。

六、生成对抗网络(GAN)生成对抗网络是由生成器网络和判别器网络组成的两个对抗性的神经网络模型。

生成器网络试图生成逼真的样本,而判别器网络则试图区分真实样本和生成样本。

生成器和判别器网络通过交替训练,不断提高自己的能力。

生成对抗网络在图像生成、文本生成等任务上取得了令人惊艳的成果。

人工神经网络的模型:人工神经元的模型、常用的激活转移函数、MP模型神经元人工神经元的主要结构单元是信号的输入、综合处理和输出人工神经元之间通过互相联接形成网络,称为人工神经网络神经元之间相互联接的方式称为联接模式。

相互之间的联接强度由联接权值体现。

在人工神经网络中,改变信息处理及能力的过程,就是修改网络权值的过程.人工神经网络的构造大体上都采用如下的一些原则:由一定数量的基本神经元分层联接;每个神经元的输入、输出信号以及综合处理内容都比较简单;网络的学习和知识存储体现在各神经元之间的联接强度上。

神经网络解决问题的能力与功效除了与网络结构有关外,在很大程度上取决于网络激活函数。

人工神经网络是对人类神经系统的一种模拟。

尽管人类神经系统规模宏大、结构复杂、功能神奇,但其最基本的处理单元却只有神经元。

人工神经系统的功能实际上是通过大量神经元的广泛互连,以规模宏伟的并行运算来实现的。

人工神经网络模型至少有几十种,其分类方法也有多种。

例如,若按网络拓扑结构,可分为无反馈网络与有反馈网络;若按网络的学习方法,可分为有教师的学习网络和无教师的学习网络;若按网络的性能,可分为连续型网络与离散型网络,或分为确定性网络与随机型网络;若按突触连接的性质,可分为一阶线性关联网络与高阶非线性关联网络。

人工神经网络的局限性:(1) 受到脑科学研究的限制:由于生理实验的困难性,因此目前人类对思维和记忆机制的认识还很肤浅,还有很多问题需要解决;(2) 还没有完整成熟的理论体系;(3)还带有浓厚的策略和经验色彩;(4)与传统技术的接口不成熟。

如果将大量功能简单的形式神经元通过一定的拓扑结构组织起来,构成群体并行分布式处理的计算结构,那么这种结构就是人工神经网络,在不引起混淆的情况下,统称为神经网络。

根据神经元之间连接的拓扑结构上的不同,可将神经网络结构分为两大类:分层网络相互连接型网络分层网络可以细分为三种互连形式: 简单的前向网络; 具有反馈的前向网络; 层内有相互连接的前向网络.神经网络的学习分为三种类型:有导师学习、强化学习无导师学习有导师学习:必须预先知道学习的期望结果-—教师信 息,并依此按照某一学习规则来修 正权值。

基于人工神经网络的预测模型随着计算机技术的不断进步,人工神经网络得到了广泛的应用。

人工神经网络是一种模拟人类神经系统的计算模型,它通过学习和适应来实现对数据的预测和分类。

其中,基于人工神经网络的预测模型具有重要的应用价值。

本文将围绕基于人工神经网络的预测模型展开探讨。

一、人工神经网络的基本概念人工神经网络是由神经元和它们之间的联系构成的一种网络结构。

它采用一种类似于大脑神经元之间相互联系的方式,对输入信号进行加工处理,产生相应的输出信号。

它的结构大致分为输入层、隐含层和输出层三部分,其中隐含层是神经网络最核心的部分,在这里所有的计算、加工都以神经元为基本单元,最终得到预测值或者分类结果。

二、基于人工神经网络的预测模型基于人工神经网络的预测模型是一种利用神经网络来对未来事件的趋势进行预测的方法。

其基本思想是将历史数据作为神经网络的输入数据,在神经网络中进行训练和学习,并生成一组能够对未来事件进行预测的参数。

基于这些参数,可以通过将未来事件的输入数据带入到神经网络中进行预测,得到预测结果。

通常,基于人工神经网络的预测模型分为两种类型:前向神经网络和逆向神经网络。

前向神经网络是把输入信号从输入层传输到输出层。

在此过程中,训练样本经过多次迭代调整,使得网络产生最佳的连接权重,然后通过输入未来事件,得到预测结果。

而逆向神经网络则是对输出信号进行学习和训练,从时间维度反推输入信号,从而实现预测。

在实际应用中,基于人工神经网络的预测模型的预测效果较好,而且可以适用于很多领域,如股票走势预测、交通流量预测等。

在金融领域中,基于人工神经网络的预测模型可以用来预测股票市场走势,帮助投资者做出正确的决策。

在交通领域中,监测地区的路况和交通流量,以提供数据支持给政府进行城市规划。

三、基于人工神经网络的预测模型的优缺点优点:第一,基于人工神经网络的预测模型可以快速地学习和处理大量的数据,使其适用于多种领域的应用。

第二,基于人工神经网络的预测模型能够自适应地进行学习,具有强大的自学习能力,同时还能够随着输入数据量的增加不断地提高预测准确率。

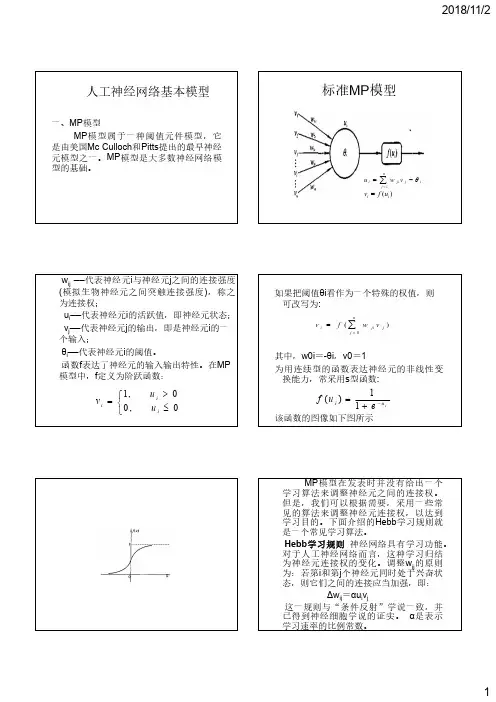

人工神经网络基本模型一、MP 模型MP 模型属于一种阈值元件模型,它是由美国Mc Culloch 和Pitts 提出的最早神经元模型之一。

MP 模型是大多数神经网络模型的基础。

标准MP 模型nj ij ji i v w u 1)(i i u f v w ij ——代表神经元i 与神经元j 之间的连接强度(模拟生物神经元之间突触连接强度),称之为连接权;u i ——代表神经元i 的活跃值,即神经元状态;v j ——代表神经元j 的输出,即是神经元i 的一个输入;θi ——代表神经元i 的阈值。

函数f 表达了神经元的输入输出特性。

在MP 模型中,f 定义为阶跃函数:,00,1i i iu u v 如果把阈值θi 看作为一个特殊的权值,则可改写为:其中,w0i =-θi ,v0=1为用连续型的函数表达神经元的非线性变换能力,常采用s 型函数:该函数的图像如下图所示)(0j nj jii v wf viu i e u f11)(MP 模型在发表时并没有给出一个学习算法来调整神经元之间的连接权。

但是,我们可以根据需要,采用一些常见的算法来调整神经元连接权,以达到学习目的。

下面介绍的Hebb 学习规则就是一个常见学习算法。

Hebb 学习规则神经网络具有学习功能。

对于人工神经网络而言,这种学习归结为神经元连接权的变化。

调整w ij 的原则为:若第i 和第j 个神经元同时处于兴奋状态,则它们之间的连接应当加强,即:Δw ij =αu i v j这一规则与“条件反射”学说一致,并已得到神经细胞学说的证实。

α是表示学习速率的比例常数。

2感知器模型感知器是一种早期的神经网络模型,由美国学者F.Rosenblatt于1957年提出.感知器中第一次引入了学习的概念,使人脑所具备的学习功能在基于符号处理的数学到了一定程度的模拟,所以引起了广泛的关注。

1简单感知器简单感知器模型实际上仍然是MP模型的结构,但是它通过采用监督学习来逐步增强模式划分的能力,达到所谓学习的目的。

神经⽹络模型基本原理⼈⼯神经⽹络是⼀个数学模型,旨在模拟⼈脑的神经系统对复杂信息的处理机制,其⽹络结构是对⼈脑神经元⽹络的抽象,两者有很多相似之处。

当然 ANN 还远没有达到模拟⼈脑的地步,但其效果也让⼈眼前⼀亮。

1. ⼈⼯神经元结构⼈⼯神经元是⼀个多输⼊单输出的信息处理单元,是对⽣物神经元的建模。

建模⽅式可以有很多种,不同的建模⽅式就意味着不同的⼈⼯神经元结构。

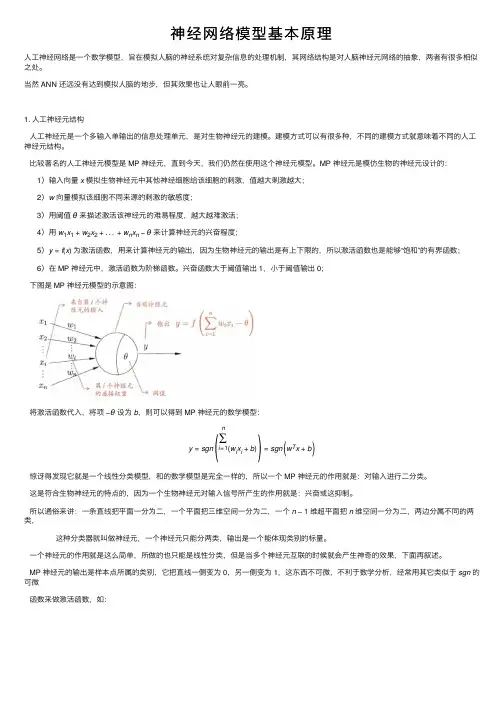

⽐较著名的⼈⼯神经元模型是 MP 神经元,直到今天,我们仍然在使⽤这个神经元模型。

MP 神经元是模仿⽣物的神经元设计的: 1)输⼊向量 x 模拟⽣物神经元中其他神经细胞给该细胞的刺激,值越⼤刺激越⼤; 2)w 向量模拟该细胞不同来源的刺激的敏感度;3)⽤阈值 θ 来描述激活该神经元的难易程度,越⼤越难激活; 4)⽤ w 1x 1+w 2x 2+...+w n x n −θ 来计算神经元的兴奋程度;5)y =f (x ) 为激活函数,⽤来计算神经元的输出,因为⽣物神经元的输出是有上下限的,所以激活函数也是能够“饱和”的有界函数; 6)在 MP 神经元中,激活函数为阶梯函数。

兴奋函数⼤于阈值输出 1,⼩于阈值输出 0; 下图是 MP 神经元模型的⽰意图:将激活函数代⼊,将项 −θ 设为 b ,则可以得到 MP 神经元的数学模型:y =sgn n∑i =1(w i x i +b )=sgn w T x +b惊讶得发现它就是⼀个线性分类模型,和的数学模型是完全⼀样的,所以⼀个 MP 神经元的作⽤就是:对输⼊进⾏⼆分类。

这是符合⽣物神经元的特点的,因为⼀个⽣物神经元对输⼊信号所产⽣的作⽤就是:兴奋或这抑制。

所以通俗来讲:⼀条直线把平⾯⼀分为⼆,⼀个平⾯把三维空间⼀分为⼆,⼀个 n −1 维超平⾯把 n 维空间⼀分为⼆,两边分属不同的两类,这种分类器就叫做神经元,⼀个神经元只能分两类,输出是⼀个能体现类别的标量。

⼀个神经元的作⽤就是这么简单,所做的也只能是线性分类,但是当多个神经元互联的时候就会产⽣神奇的效果,下⾯再叙述。

基于人工神经网络的预测模型建立一、绪论人工神经网络作为一种模拟生物组织神经元相互连接和相互作用的信息处理系统,能够模拟人脑的神经网络。

目前,神经网络已成为数据处理的一个重要工具,尤其在模式识别和分类问题上表现突出。

本文旨在研究基于人工神经网络的预测模型建立,分析其基本原理以及建模方法。

二、人工神经网络的基本原理和结构人工神经网络是模拟生物神经网络的一种技术,一般由输入层、中间层和输出层组成。

输入层接受外部信号,中间层进行信息处理和传递,最后输出层输出结果。

中间层可以包含多个隐层,每个隐层都是多个神经元构成的。

神经元是神经网络的基本单位,其输入和输出都是数字。

神经元之间的连接可以通过不同的权值来表示不同的影响程度。

神经元之间的信号传递通过正向和反向两种方式进行。

正向传递时,输入信号首先被输入到输入层,然后通过中间层到达输出层进行处理后输出结果。

反向传递时,由于输出结果与实际结果之间的误差,神经网络会不断进行学习和训练,通过调整权值使误差最小化。

三、神经网络的建模方法1. 数据准备首先,需要对数据进行处理和准备,通常包括数据清洗、预处理、变量归一化、特征提取等工作。

2. 神经网络的选择根据问题的性质和数据特点,选取适合问题的神经网络结构,如BP神经网络、RBF神经网络、SOM神经网络等。

3. 网络参数的调节神经网络的性能主要由其参数决定,包括学习率、收敛精度、神经元个数、隐层个数等。

通过交叉验证等方法,调节网络参数,使网络达到最佳性能。

4. 神经网络的训练训练是神经网络的一个关键步骤,包括前向传递和反向传递两个步骤。

前向传递时,输入数据经权值和激活函数处理后传递到输出层,计算并输出结果。

反向传递时,将输出误差反向传递到各个隐层并更新权值,使误差最小化。

5. 神经网络的预测经过训练的神经网络可以用于预测和分类,即通过输入新的数据,通过神经网络计算后输出对应的结果。

四、神经网络在预测中的应用人工神经网络在预测中的应用十分广泛,如股票预测、气象预报、交通流量预测等。

人工神经网络简介本文主要对人工神经网络基础进行了描述,主要包括人工神经网络的概念、发展、特点、结构、模型。

本文是个科普文,来自网络资料的整理。

一、人工神经网络的概念人工神经网络(Artificial Neural Network,ANN)简称神经网络(NN),是基于生物学中神经网络的基本原理,在理解和抽象了人脑结构和外界刺激响应机制后,以网络拓扑知识为理论基础,模拟人脑的神经系统对复杂信息的处理机制的一种数学模型。

该模型以并行分布的处理能力、高容错性、智能化和自学习等能力为特征,将信息的加工和存储结合在一起,以其独特的知识表示方式和智能化的自适应学习能力,引起各学科领域的关注。

它实际上是一个有大量简单元件相互连接而成的复杂网络,具有高度的非线性,能够进行复杂的逻辑操作和非线性关系实现的系统。

神经网络是一种运算模型,由大量的节点(或称神经元)之间相互联接构成。

每个节点代表一种特定的输出函数,称为激活函数(activation function)。

每两个节点间的连接都代表一个对于通过该连接信号的加权值,称之为权重(weight),神经网络就是通过这种方式来模拟人类的记忆。

网络的输出则取决于网络的结构、网络的连接方式、权重和激活函数。

而网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。

神经网络的构筑理念是受到生物的神经网络运作启发而产生的。

人工神经网络则是把对生物神经网络的认识与数学统计模型相结合,借助数学统计工具来实现。

另一方面在人工智能学的人工感知领域,我们通过数学统计学的方法,使神经网络能够具备类似于人的决定能力和简单的判断能力,这种方法是对传统逻辑学演算的进一步延伸。

人工神经网络中,神经元处理单元可表示不同的对象,例如特征、字母、概念,或者一些有意义的抽象模式。

网络中处理单元的类型分为三类:输入单元、输出单元和隐单元。

输入单元接受外部世界的信号与数据;输出单元实现系统处理结果的输出;隐单元是处在输入和输出单元之间,不能由系统外部观察的单元。

基于人工神经网络的大数据预测模型构建随着互联网技术的日益发展,数据量不断增加,人们对数据的需求也越来越大,人工智能技术在数据处理方面的应用变得越来越广泛。

其中,基于人工神经网络的大数据预测模型成为了研究热点之一。

一、人工神经网络简介人工神经网络(Artificial Neural Network,ANN)是一种模拟人脑神经元行为的计算模型。

它是由输入层、隐含层和输出层构成的一种多层前向结构。

输入层接受外部信号,输出层向外部发出处理结果,中间层为隐含层,不进行数据传输,而是对原始数据的信息进行分析和加工。

在神经网络中,每个神经元都会对输入的信息进行加工处理,并传递到下一层的神经元中。

经过多次迭代训练,神经网络可以学会一种模式或模型,用于对未来的数据进行预测或分类。

二、大数据预测模型构建大数据预测模型构建分为数据预处理、神经网络训练和模型评估三个步骤。

数据预处理是构建预测模型的第一步。

它包括数据获取、数据清洗、特征选择、数据归一化等步骤。

在这些步骤中,数据清洗的重要性不言而喻。

如果原始数据存在缺失值或错误数据,就需要进行清洗,以消除不良数据影响。

特征选择是进一步加工清洗后的数据,它是在保持数据完整性的前提下,对数据进行筛选和提取,以确定最终极具代表性的特征。

神经网络训练是即是利用构建的数据集,训练一个完整的神经网络模型。

到了这一步骤,数据即为预处理过后的数据。

此时需要确定一个合适的神经网络结构,并利用已经提取到的数据特征,确定神经元数量、隐层数和学习率等参数。

随后利用BP算法进行网络训练,使网络逐渐收敛,并达到预测准确的模型。

模型评估是对神经网络模型进行评估。

一般通过误差分析和分类精度等指标,对模型进行评价。

若模型精度达到较高水平,则可将模型应用于实际问题的预测和分析。

三、应用场景基于人工神经网络的大数据预测模型可用于各个领域。

例如交通异常预测、金融市场预测等。

下面以气象预测为例。

气象数据量大且多变,传统的气象预测方法需要依赖气象仪器,测量数据精度有限,且具有一定的时滞性。

人工智能中的神经网络模型解析随着互联网的飞速发展,人工智能越来越受到关注。

近年来,人工智能领域的一个热点话题就是神经网络模型。

神经网络模型是人工智能领域的一项重要技术,可以通过模仿人类大脑的神经元进行学习和预测,在图像识别、自然语言处理、机器翻译、语音识别、推荐系统等领域中得到了广泛应用。

本文将从神经元、神经网络模型的结构、训练方法以及示例等方面进行解析。

一、神经元神经元是神经网络模型的基本构建单元。

在人类大脑中,神经元是众多信息传输和处理的元件,通过多个树突接收来自其他神经元的信息,经过细胞核处理后,再通过轴突将信息传递给其他神经元。

神经网络模型模仿了这种结构,将输入信号通过多个输入端口输入到神经元,并根据权重进行加权求和,然后通过激活函数进行处理,输出结果传递给下一层神经元或输出层。

二、神经网络模型的结构神经网络模型的结构可以分为三个层次:输入层、隐藏层和输出层。

其中,输入层接收外部输入数据,输出层输出预测结果,而中间的隐藏层则通过多层的神经元处理将输入层的信息转化到输出层。

在隐藏层和输出层中,每个神经元都与其他神经元相连,形成一张复杂的神经网络。

神经网络模型的结构与人类大脑有相似之处,其中卷积神经网络、循环神经网络、自编码神经网络等模型都属于神经网络模型的范畴。

三、神经网络模型的训练方法神经网络模型的训练是指通过训练样本集对模型进行学习,从而得到模型可靠的预测能力。

神经网络模型的训练通常采用反向传播算法。

该算法通过将每个样本的误差反向传播,从而修正神经元之间的连接权重,从而使得模型的预测结果更加准确。

神经网络模型的训练需要注意避免过拟合现象。

过拟合是指模型在训练过程中过于拟合了训练数据,导致模型的泛化能力较差,在新的数据集上预测的效果较差。

四、神经网络模型的示例神经网络模型已经在图像识别、自然语言处理、机器翻译、语音识别、推荐系统等领域中得到广泛应用。

其中,卷积神经网络在图像识别中表现优异,循环神经网络在自然语言处理中表现突出。

人工神经网络的模型:人工神经元的模型、常用的激活转移函数、MP模型神经元人工神经元的主要结构单元是信号的输入、综合处理和输出人工神经元之间通过互相联接形成网络,称为人工神经网络神经元之间相互联接的方式称为联接模式。

相互之间的联接强度由联接权值体现。

在人工神经网络中,改变信息处理及能力的过程,就是修改网络权值的过程。

人工神经网络的构造大体上都采用如下的一些原则:由一定数量的基本神经元分层联接;每个神经元的输入、输出信号以及综合处理内容都比较简单;网络的学习和知识存储体现在各神经元之间的联接强度上。

神经网络解决问题的能力与功效除了与网络结构有关外,在很大程度上取决于网络激活函数。

人工神经网络是对人类神经系统的一种模拟。

尽管人类神经系统规模宏大、结构复杂、功能神奇,但其最基本的处理单元却只有神经元。

人工神经系统的功能实际上是通过大量神经元的广泛互连,以规模宏伟的并行运算来实现的。

人工神经网络模型至少有几十种,其分类方法也有多种。

例如,若按网络拓扑结构,可分为无反馈网络与有反馈网络;若按网络的学习方法,可分为有教师的学习网络和无教师的学习网络;若按网络的性能,可分为连续型网络与离散型网络,或分为确定性网络与随机型网络;若按突触连接的性质,可分为一阶线性关联网络与高阶非线性关联网络。

人工神经网络的局限性:(1) 受到脑科学研究的限制:由于生理实验的困难性,因此目前人类对思维和记忆机制的认识还很肤浅,还有很多问题需要解决;(2) 还没有完整成熟的理论体系;(3) 还带有浓厚的策略和经验色彩;(4) 与传统技术的接口不成熟。

如果将大量功能简单的形式神经元通过一定的拓扑结构组织起来,构成群体并行分布式处理的计算结构,那么这种结构就是人工神经网络,在不引起混淆的情况下,统称为神经网络。

根据神经元之间连接的拓扑结构上的不同,可将神经网络结构分为两大类:分层网络相互连接型网络分层网络可以细分为三种互连形式:简单的前向网络;具有反馈的前向网络;层内有相互连接的前向网络。

神经网络的学习分为三种类型:有导师学习、强化学习无导师学习有导师学习:必须预先知道学习的期望结果——教师信息,并依此按照某一学习规则来修正权值。

强化学习:利用某一表示“奖/惩”的全局信号,衡量与强化输入相关的局部决策如何。

无导师学习:不需要教师信息或强化信号,只要给定输入信息,网络通过自组织调整,自学习并给出一定意义下的输出响应。

神经网络结构变化的角度,学习技术还可分为三种: 权值修正、拓扑变化、权值与拓扑修正学习技术又还可分为:确定性学习、随机性学习人工神经网络人工神经网络是生物神经网络的某种模型(数学模型);是对生物神经网络的模仿基本处理单元为人工神经元生物神经元(neuron)是基本的信息处理单元是对的模拟。

大量简单的以某种形式连接,形成一个.其中某些因素,如:连接连接,其大小决定信号传递强弱); ,神经元的输入输出特性);甚至等, 可依某种规则随外部数据进人工神经网络计算单元(结点,神经元)网络强度行适当调整,最终实现某种功能。

(权值结点 神经网络计算特性(激活特性网络结的计算通过网络结构实现; 生 物神经 构系统 不同网络结构可以体现各种不同的功能; 网络结构的是通过逐渐参数学习修正的。

00⎧>⎧⎪⎨<⎩⎪⎪⎨⎪⎪⎪⎩权值,激活 连接权值,突触连接强度权值,抑制 输入信号关于神经元突触的线性加权 将神经元的输出信号限制在有限范围内一组连接 一个加法器一个激励函数人工神经元模型的三要素:()⎧⎪⎨⎪⎩网络结构或拓扑(连接形式)神经元的计算特性传递函数学习规则上述要素不同组合,形成各种神经网络模型3. 人工神经网络三个要素()()()()()()23Hopfield SOM ⎧⎪⎪⎪⎪⎪⎪⎪⎨⎪⎪⎪⎪⎪⎪⎪⎩.1 网络 神经网络feedfroward network feedback network competitive learning network4 神经网络三种基本前馈型模神经网络-反馈网络竞争学习重点介绍网络型多层感知器 BP 网络 RBF 网络⎧⎨⎩ 自学习 自适应 并行处理 分布表达与计算回归状态预测 可应用到众多领域,如:优化计算;信号处理;智能控制; 模式识别;机器视觉;等等。

神经网络特点神经网络应用神经网络本质上,可以理解为函数逼近前馈(forward)神经网络各神经元接受来自前级的输入,并产生输出到下一级,无反馈,可用一有向无环图表示。

网络中的节点分两类:输入节点;计算节点(神经元节点) 节点按层(layer)组织 :第i 层的输入只与第i-1层的输出相连。

输入信号由输入层输入,由第一层节点输出,传向下层,…… 前馈:信息由低层向高层单向流动。

可见层输入层 (input layer) 输入节点所在层,无计算能力输出层 (output layer) 节点为神经元隐含层( hidden layer) 中间层,节点为神经元BP 神经网络训练的两个阶段 (1)信号正向传递过程输入信息从输入层经隐层逐层、正向传递,直至得到各计算单元的输出 (2)误差反向传播过程输出层误差从输出层开始,逐层、反向传播,可间接计算隐层各单元的误差,并用此误差修正前层的权值.()[]()()()()1011,,20121301,...,14ω-===-=-=-=--B ,...,P -1=L 维输入向量层神经网络层号 输入层层号 隐含层层号 输出层各层节点输入节点,计算节点数目, 输入层输出层相邻层连接权值来自与第层的当前的连接节点第层节点权值Tn lL lij n x x x L l l L l L n l L n nn l i l j m算法训练过程描述约定:标准化()1115111,...,,1,...,,1,...,i,j,k j O i j j k ωω-++-+===BP :第层为当前处理层;其前一层、当前层、后一层的计算单元序号为; 位于当前层第个计算单元的输出为, 前层第个单元到本层第个单元的连接权值为 本层第个单元到后层第个单元的连接权值为注:采用修正权值,输出函数应连续可微,选l j ll ij l l jk l l l l l j n i n k n sigm 算法训练过程描述假定梯度法函数。

oid()()()(),00~0~11ηα⎧⎪⎪±⎨⎪⎪⎩.3.10.3.9 输入向量,期望输出,如 "小随机数"如:之间 通常固定之间;也可动态调整 通常之间包括 输入层节点数;隐含层数目;各隐含层节点数目; 输出层节点数;各神经元节点的激活函数最大可允许迭代p p x D STEP 训练样本权值初始化首先明确学习步长惯性样本集的标准化冲量项系数确定神经网络结构,设定终止条件:处理;()()0⎧⎪⎪⎪⎪⎪⎪⎨⎪⎪⎪⎪⎪=⎪⎩次数硬条件; 训练精度软条件记训练时间时间t 以小随机数初始化网络权值;()()()[][]()[]111121121,,,,,2,,1m j=1y f y ωωω=-====∈=∈=⎛⎛⎫ ⎪⎝⎫= ⎪⎝⎭⎭∑∑D BP L L L L :按随机或任意顺序从训练集中抽取1个训练样本 计算输入时,当前网络的续Tnn Tmm Tn l L l r sr jk n l i i s j i STEP x D x x x R d d R x y y f f x 重复如下过程直至满足算法终止条件样本输入 期望输出 实际输 出算法步骤()()()()()()2121,...,11'11ααααααα-=---⎛⎫= ⎪⎪⎝⎭⎧=⎪+⎪⎨-=-=-⎪⎪+⎩∑ 激活函数其中L n r mf e e f f f e()()()()()()()()11311,...,1,...,111,...,ωωωωηδδ--+=+∆==∆==-=--=≤<BP -1 对于第层,修正权值权值修正项 输出层,具体为 间层:中l l l ij ij ij l ll l ij i l j j j j l j j l t t t i n j n t x l L y y d y j m l 算法步权骤调整值从 输出层开始()()()1111111,...,δδω+++=⎧⎪⎪⎪⎨-=-⎪⎪⎪=⎩∑l n l l l l l j j j k jk k l L x x t j n()()()()()41←⎧⎪⎨⎪⎩1<121<3 更新全部权值,对所有训练样本重新计算输出;计算更新后网络输出与期望输出的误差; 检查算法若不满足终止条件,则 ,转向若条件满足,则终止,转向:算法结束.输出各层连接权值。

可以是如下之一:网络实际输出与期望输出 最近轮训练中所有权值变化 算法达到最大允t t +1STEP3STEP3终止条件终止条件总误差最大值阈值阈值2⎧⎪⎨⎪⎩= 许的 阈值3 总训练次数BP 网络的优点①特别适合于求解内部机制复杂的问题BP 网络实质上实现了一个从输入到输出的映射功能,而数学理论已证明它具有实现任何复杂非线性映射的功能 ②具有自学习能力网络能通过学习带正确答案的实例集自动提取“合理的”求解规则 ③网络具有一定的推广、概括能力。

BP 网络的问题,如: ①BP 算法的学习速度较慢 ②网络训练失败的可能性较大③网络结构的选择尚无一种统一而完整的理论指导,一般只能由经验选定。

④网络的预测能力(泛化能力、推广能力)与训练能力(逼近能力、学习能力)的矛盾 回归估计例:基于BP 神经网络的公路运量(客运量、货运量)预测 公路运量与该地区人数、机动车数量、公路面积有关。

已知某地区20年的公路运量有关数据,对于未来某两年,若明确该地区人数、机动车数量、公路面积,要求:预测该地区的公路运量。

分析:(1)明确模型输入输出关系 (2)建模:原始数据读取;数据标准化处理;网络训练; (3)模型评价:对原始数据仿真,明确预测误差 (4)输出预测结果:对新数据预测结果 牛顿法及其收敛性牛顿法是一种线性化方法,其基本思想是将非线性方程 逐步归结为某种线性方程来求解. 设已知方程 0)(=x f有近似根kx (假定)(≠'k x f ),将函数)(x f在点kx 展开,有),)(()()(k k k x x x f x f x f -'+≈于是方程0)(=x f可近似地表示为.0))(()(=-'+k k k x x x f x f这是个线性方程,记其根为1+k x ,则1+k x 的计算公式为),,1,0()()(1Λ='-=+k x f x f x x k k k k交叉演化算法代码实现%F0是变异率%Gm 最大迭代次数Gm = 10000;F0 = 0.5;Np = 100;CR = 0.9; %交叉概率G= 1; %初始化代数D = 10; %所求问题的维数Gmin = zeros(1,Gm); %各代的最优值best_x = zeros(Gm,D); %各代的最优解value = zeros(1,Np);%产生初始种群xmin = -5.12;xmax = 5.12;function y = f(v)%Rastrigr 函数y = sum(v.^2 - 10.*cos(2.*pi.*v) + 10);X0 = (xmax-xmin)*rand(Np,D) + xmin; %产生Np个D维向量XG = X0;XG_next_1= zeros(Np,D); %初始化XG_next_2 = zeros(Np,D);XG_next = zeros(Np,D);while G <= Gm%变异操作for i = 1:Np%产生j,k,p三个不同的数a = 1;b = Np;dx = randperm(b-a+1) + a- 1;j = dx(1);k = dx(2);p = dx(3);%要保证与i不同if j == ij = dx(4);else if k == ik = dx(4);else if p == ip = dx(4);endendend%变异算子suanzi = exp(1-Gm/(Gm + 1-G));F = F0*2.^suanzi;%变异的个体来自三个随机父代son = XG(p,:) + F*(XG(j,:) - XG(k,:));for j = 1: Dif son(1,j) >xmin & son(1,j) < xmax %防止变异超出边界XG_next_1(i,j) = son(1,j);elseXG_next_1(i,j) = (xmax - xmin)*rand(1) + xmin;endendend%-交叉操作for i = 1: Nprandx = randperm(D);% [1,2,3,...D]的随机序列for j = 1: Dif rand > CR & randx(1) ~= j % CR = 0.9XG_next_2(i,j) = XG(i,j);elseXG_next_2(i,j) = XG_next_1(i,j);endendend%-选择操作for i = 1:Npif f(XG_next_2(i,:)) < f(XG(i,:))XG_next(i,:) = XG_next_2(i,:);elseXG_next(i,:) = XG(i,:);endend%找出最小值for i = 1:Npvalue(i) = f(XG_next(i,:));end[value_min,pos_min] = min(value);%第G代中的目标函数的最小值Gmin(G) = value_min;%保存最优的个体best_x(G,:) = XG_next(pos_min,:);XG = XG_next;trace(G,1) = G;trace(G,2) = value_min;G = G + 1;end盛年不重来,一日难再晨。