神经网络分类器

- 格式:doc

- 大小:239.50 KB

- 文档页数:6

2021575作为脑健康服务的核心部件,在线脑电分类能远程监测和评估脑障碍状态(如癫痫[1]和抑郁症(MDD)[2])而蓬勃发展。

对于MDD,准确评估脑状态并及时跟踪其发展状态可以将其陷入危险和自杀的风险降为最低[3]。

EEG通常是弱信号、强噪声和非平稳的混合体,对其准确分类仍然是一个亟需解决的问题[4]。

几十年来,其活跃在两个研究领域:(1)预处理;(2)特征提取。

预处理旨在去除脑电信号中的噪声与伪逆。

在大多数情况下,噪声和干扰与患者密切相关,其去除即使理论上可行,也需要昂贵的人工处理[5];特征提取能够实现降维,并支持对感兴趣信号的有效探索[6]。

在众多特征提取方法中,共有空间模式的精度最高,达到87.4%[7],矩阵分解方法精度达到86.61%,近年来,作为脑电特征提取的主导方法,时频分析的精度达到87.5%[8]。

传统的预处理卷积神经网络及其分析在抑郁症判别中的应用王凤琴1,柯亨进21.湖北师范大学物理与电子科学学院,湖北黄石4351062.武汉大学计算机学院,武汉435001摘要:在线脑电分类能准确评估严重抑郁症患者的脑状态并及时跟踪其发展状态可以将其陷入危险和自杀的风险降为最低。

然而,在无经验监督条件下,在线脑电分类应用面临更大的挑战:脑电数据往往具有弱信号、高噪声与非平稳特性;缺乏有效解耦脑疾病发作时脑区与神经网路的复杂关系。

为此,设计一个以卷积神经网络为核心的云辅助在线脑电分类系统,该系统直接应用于原始脑电信号,无需进行预处理和特征提取,能精准、快速判别抑郁症状态。

在公开数据集上进行抑郁症评估实验,对健康控制组和抑郁症对照组分类的准确率、敏感度和特异度分别为99.08%、98.77%和99.42%。

另外,通过对神经网络进行定量解释,表明抑郁症病人的左右颞叶脑区与正常人存在明显差异。

关键词:神经网络;模型解释;抑郁症;脑电分类;云计算文献标志码:A中图分类号:TP391doi:10.3778/j.issn.1002-8331.2008-0261Application of CNN and Its Analysis in Depression IdentificationWANG Fengqin1,KE Hengjin21.School of Physics and Electronic Science,Hubei Normal University,Huangshi,Hubei435106,China2.School of Computer Science,Wuhan University,Wuhan435001,ChinaAbstract:Online EEG classification can accurately assess the brain status of patients with Major Depression Disable (MDD)and track their development status in time,which can minimize the risk of falling into danger and suicide.However, it remains a grand research due to the embedded intensive noises and the intrinsic non-stationarity determined by the evolution of brain states,the lack of effective decoupling of the complex relationship between brain region and neural network during the attack of brain diseases.This study designs an online EEG classification system aided by cloud centering on a CNN.Experiments on depression evaluation has been performed against raw EEG without the need for preprocessing and feature extraction to distinguish Healthy&MDD.Results indicate that MDD can be identified with an accuracy,sensi-tivity,and specificity of99.08%,98.77%and99.42%,respectively.Furthermore,the experiments on quantitative interpre-tation of CNN illustrate that there are significant differences between the left and right temporal lobes of depression patients and normal control group.Key words:neural network;model interpretation;depression;EEG classification;cloud computation基金项目:湖北省教育厅科学技术研究计划指导性项目(B2018142)。

分类器总结分类器是一种机器学习方法,它可以根据输入数据的特征,将其分为不同的类别。

分类器在各个领域都有广泛的应用,如医学诊断、垃圾邮件过滤、情感分析等。

本文将对分类器的基本原理、不同类别的分类器、优缺点以及应用领域进行总结。

分类器的基本原理是根据训练样本的特征,建立一个分类函数,从而预测新样本的类别。

分类器的训练过程包括特征提取、特征选择、训练数据的预处理和使用合适的学习算法。

常见的学习算法包括朴素贝叶斯、决策树、支持向量机、神经网络等。

朴素贝叶斯分类器是一种基于贝叶斯定理的分类器,它假设样本的特征是条件独立的。

这种分类器简单且高效,在文本分类等领域有广泛应用。

决策树分类器是一种采用树形结构的分类模型,它通过对特征的逐步划分,最终将样本分为不同的类别。

这种分类器易于理解和解释,但在处理噪声和复杂问题时可能产生过拟合现象。

支持向量机分类器是一种构建超平面以将样本分离的分类器,它可以处理高维特征空间和非线性可分问题。

神经网络分类器是一种模仿人脑神经元网络的分类器,它可以学习复杂的非线性关系,但需要大量的训练样本和计算资源。

不同分类器的优缺点各有差异。

朴素贝叶斯分类器具有参数少、适合处理大规模数据、天然处理特征相关性等优点,但对输入数据的分布假设过于简单,可能导致分类效果不理想。

决策树分类器易于理解和解释,对异常值不敏感,但在特征空间很大时容易过拟合。

支持向量机分类器可以处理高维特征空间和非线性关系,但对大规模数据和噪声敏感。

神经网络分类器可以学习复杂的非线性关系,但需要大量的训练样本和计算资源。

分类器在各个领域都有广泛的应用。

在医学诊断中,分类器可以根据病人的症状和检查结果,预测其患有某种疾病的可能性,帮助医生进行诊断和治疗。

在垃圾邮件过滤中,分类器可以根据邮件的特征,将其分类为垃圾邮件或正常邮件,帮助用户过滤垃圾邮件。

在情感分析中,分类器可以根据文本的特征,将其分类为积极、消极或中性,帮助企业了解公众对其产品的反馈。

基于MPSO-BP神经网络方法的人体步态识别孙楠;骆敏舟;王玉成;赵汉宾【摘要】为提高人体下肢步态相位识别准确率以实现外骨骼机器人控制,采用一种改进的粒子群优化MPSO-BP神经网络方法识别不同运动模式下的人体步态相位.通过自适应调整学习因子构造MPSO-BP神经网络分类器,以多种传感信息组成的特征向量样本集训练神经网络分类器,用于识别人体下肢在平地行走、上楼梯和起坐三种典型运动模式下的步态相位.实验结果表明,MPSO-BP神经网络分类器能有效识别三种不同运动模式的步态相位,识别准确率均达到96%以上,识别性能优于传统的BP神经网络模型和粒子群优化神经网络模型.%To improve the accuracy rate of human gait phase recognition for controlling the exoskeleton robot, an approach based on Modified Particle Swarm Optimization algorithm-Back Propagation(MPSO-BP)neural network is utilized to divide three types of gait into different phases. Firstly, the MPSO-BP neural network classifier is constructed through regulating the learning factor adaptively, and then the classifier is trained using sample set containing multi-sensor information. Secondly, test the classifier on gait phase recognition in three types of human gait including walk, upstairs and sit-down. The experimental results show that the MPSO-BP neural network classifier can successfully increase the accuracy rate up to averaged 96%above, which is superior to the BP neural network and the particle swarm optimization BP neural network methods.【期刊名称】《计算机工程与应用》【年(卷),期】2017(053)021【总页数】5页(P121-125)【关键词】步态识别;步态相位;神经网络;粒子群算法【作者】孙楠;骆敏舟;王玉成;赵汉宾【作者单位】常州大学机械工程学院,江苏常州 213164;中国科学院合肥物质科学研究院先进制造技术研究所,江苏常州 213164;中国科学院合肥物质科学研究院先进制造技术研究所,江苏常州 213164;中国科学院合肥物质科学研究院先进制造技术研究所,江苏常州 213164;中国科学院合肥物质科学研究院先进制造技术研究所,江苏常州 213164【正文语种】中文【中图分类】TP242.步态相位识别是实现人体运动意图识别进而实现外骨骼机器人控制的关键技术之一[1]。

Softmax原理及Sigmoid和Softmax⽤于分类的区别1、什么是 softmax机器学习总归是要接触到 softmax 的,那么这个东东倒底是怎么来的呢?实际上 softmax 可能指两种相似但不相同的东东。

1.1. softmax function这函数定义⽐较符合 softmax 这个名字:可见 softmax function 是从⼀个输⼊序列⾥算出⼀个值。

可见 softmax 确实会返回输⼊序列中最⼤的那个值的近似值。

softmax 是对真 max 函数的近似,softmax 的函数曲线是光滑的(处处可微分),⽽ max(0,x) 之类的函数则会有折点。

在机器学习领域,多分类算法需要从⼀组可能的结果中找出概率最⾼的那个,正需要使⽤ max 函数。

⽽为了能进⾏优化,⽤于描述问题的函数必须是可微分的,这样 softmax 就是⼀个⾮常合适的选择了。

1.2. softmax activation function这是机器学习领域⼴为使⽤的⼀个函数,也叫归⼀化指数数函,它的定义是:可见 softmax activation function 返回的是⼀个序列,这个函数的分母部分跟 softmax function 有⼀部分是相同的,并且在效果上也有⼀点⼉相似:通过运算会扩⼤最⼤项的优势并抑制序列中其余的项。

1.3.历史能在互联⽹上查到的记录显⽰,1989 年 John S. Bridle 在论⽂“Probabilistic Interpretation of Feedforward Classification Network Outputs, with relationships to statistical pattern recognition” 中⾸次引⼊了 softmax activation function 。

这位 2013 年加⼊苹果⾄今,在搞 Siri 。

1.4.softmax activation function 的特性和应⽤这个函数能够将输⼊序列的每⼀个值挤压到[0,1]范围内,并且所有项的和为1。

人工智能课内实验报告(四)班级:姓名:学号:实验题目:神经网络分类器实验目的通过编写神经网络分类器,掌握神经网络的分类方法;掌握BP算法及其具体应用。

实验内容本次实验是对在和不在正弦函数曲线上的两类点进行分类。

所使用的算法是神经网络中的BP算法。

实验原理及算法描述线性分类器不能解决非线性问题,因此必须使用非线性分类器解决非线性问题。

非线性分类常采用神经网络算法,本次实验中使用的是BP算法。

BP (Back Propagation)神经网络是一种神经网络学习算法。

其由输入层、隐层、输出层组成的阶层型神经网络,隐层可扩展为多层。

相邻层之间各神经元进行全连接,而每层各神经元之间无连接,网络按有教师示教的方式进行学习,当一对学习模式提供给网络后,各神经元获得网络的输入响应产生连接权值(Weight)。

然后按减小希望输出与实际输出误差的方向,从输出层经各中间层逐层修正各连接权,回到输入层。

此过程反复交替进行,直至网络的全局误差趋向给定的极小值,即完成学习的过程。

算法描述:x;输入层: 单元i的输入:i单元数量:d;x;单元i的输出:i单元i的激活函数:线性函数;隐层: 单元j 的输入:netj ;单元数量:nH ;01j d t j ji i j i net x x ωωω==+=∑010(,,....,),1t d x x x x x ==01(,,....,)t j j j jd ωωωω=单元j 的输出:()j j y f net =;单元j 的激活函数:非线性函数; 输出层: 单元k 的输入: k net ;单元数量:c ;01Hn t k kj j k k j net y yωωω==+=∑ 010(,,....,),1H t n y y y y y ==01(,,....,)Ht k k k kn ωωωω=单元k 的输出:()k k z f net =单元k 的激活函数:非线性函数两层神经网络图如下:分析:(1)给定隐层单元及输出层单元的激活函数,一个神经网络就可以实现一个对输入特征向量x 的非线性映射。

Matlab中的神经网络工具箱介绍与使用神经网络是一种模拟人脑思维方式的计算模型,它通过由多个神经元组成的网络,学习数据的特征和规律。

在计算机科学领域,神经网络被广泛应用于模式识别、数据挖掘、图像处理等诸多领域。

Matlab作为一种功能强大的科学计算软件,提供了专门用于神经网络设计和实现的工具箱。

本文将介绍Matlab中的神经网络工具箱,并探讨其使用方法。

一、神经网络工具箱的概述Matlab中的神经网络工具箱(Neural Network Toolbox)是一款用于构建和训练神经网络的软件包。

它提供了丰富的函数和工具,可用于创建不同类型的神经网络结构,如前向神经网络、反向传播神经网络、径向基函数神经网络等。

神经网络工具箱还包括了各种训练算法和性能函数,帮助用户对神经网络进行优化和评估。

二、神经网络的构建与训练在使用神经网络工具箱前,我们需要先了解神经网络的基本结构和原理。

神经网络由输入层、隐藏层和输出层组成,每一层都包含多个神经元。

输入层接受外部输入数据,通过权重和偏置项传递给隐藏层,最终输出到输出层,形成网络的输出结果。

构建神经网络的第一步是定义网络的结构,可以使用神经网络工具箱中的函数创建不同层和神经元的结构。

例如,使用feedforwardnet函数可以创建一个前向神经网络,输入参数指定了每个隐藏层的神经元数量。

然后,可以使用train函数对神经网络进行训练。

train函数可以选择不同的训练算法,如标准反向传播算法、Levenberg-Marquardt算法等。

通过设置训练参数,例如训练迭代次数和学习速率等,可以对网络进行优化。

三、神经网络的应用案例神经网络在许多领域都有广泛的应用,下面以图像分类为例,介绍如何使用神经网络工具箱来训练一个图像分类器。

首先,我们需要准备训练数据和测试数据。

训练数据通常包含一组已经标记好的图像和相应的标签。

为了方便处理,我们可以将图像转化为一维向量,并将标签转化为二进制编码。

人工智能导论第四章课后答案1. 什么是先验概率?举例说明。

先验概率是指在考虑新的证据之前,先已知一些先前的概率,然后根据这些先前的概率来计算得到新的概率。

例如,在掷硬币的情况下,如果每个面出现的概率都是50%,那么在扔出正面之前,出现正面的先验概率为0.5。

2. 什么是后验概率?举例说明。

后验概率是指在获得新的证据后,重新计算概率。

例如,在掷硬币的情况下,如果前10次硬币都是正面朝上,那么出现正面的后验概率已经不再是0.5,而是根据已有的数据计算得出的新概率。

3. 什么是朴素贝叶斯分类器?其基本假设是什么?朴素贝叶斯分类器是一种基于贝叶斯定理的分类器。

它假设特征之间相互独立,即给定类别C,所有特征之间都是条件独立的。

这个假设使得朴素贝叶斯分类器能够通过简单的计算得出后验概率,从而进行分类。

4. 什么是决策树分类器?请描述它的工作过程。

决策树分类器是一种基于树形结构的分类器。

它通过不断地对特征进行分类来最终确定样本所属的类别,其工作过程如下:1.在样本集中找到一个关于分类问题的最好特征进行划分。

2.根据该特征将样本集分成若干个子集,每个子集对应该特征的一个取值。

3.对每个子集重复第1步和第2步操作,直到子集内所有样本的类别均相同,或者子集样本过小无法继续划分。

4.构建出一棵树模型,将每个子集对应于树上的一个节点。

5.对于新的样本,从根节点开始沿着树的路径不断前进,直到达到一个叶子节点,该叶子节点的类别即为样本的预测类别。

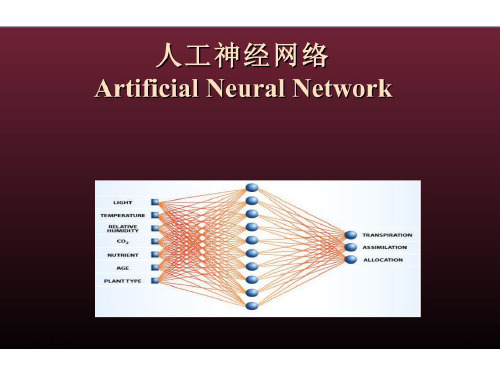

5. 什么是神经网络分类器?请描述其基本结构和工作原理。

神经网络分类器是一种基于人工神经网络的分类器。

它基于反向传播算法学习样本,通过不断调整网络权重使得输出结果接近真实标签。

神经网络分类器的基本结构由多个神经元组成,其在输入和输出层之间包括若干个隐藏层。

神经元通过输入层接受输入信号,该信号被赋予权值,然后被传递到下一层。

每个神经元接受到多个输入信号,经加权处理后只输出一个值,该值将作为输入传递到下一层。

分类问题的求解过程如下图:2.⽤pytorch的逻辑回归实现图像分类#导⼊包#损失函数和优化器import torch.nn.functional as Fimport torch.optim as optimlearning_rate=0.001loss = nn.CrossEntropyLoss()#定义交叉熵损失函数, 这个⽅法集成了softmax计算optimizer = torch.optim.SGD(linearnet.parameters(),lr=learning_rate)#SGD优化器#测试集数据评估def evaluate_accuracy(data_iter, net):acc_sum, n =0.0, 0for data in data_iter:X, y=dataX, y=X.to(device),y.to(device)acc_sum +=(net(X).argmax(dim=1)== y).float().sum().item()n += y.shape[0]return acc_sum / n#定义训练过程epochs =200def train_model(optimizer):for epoch in range(epochs):train_loss_sum, train_acc_sum, n =0.0, 0.0, 0for data in trainloader:inputs, y=datainputs, y=inputs.to(device),y.to(device)#print(inputs)y_hat = linearnet(inputs)cost = loss(y_hat, y).sum()optimizer.zero_grad()cost.backward()optimizer.step()train_loss_sum += cost.item()train_acc_sum +=(torch.argmax(y_hat, dim=1)== y).float().sum().item()n += y.shape[0]test_acc = evaluate_accuracy(testloader, linearnet)print('epoch %d, loss %.4f, train acc %.4f, test acc %.4f' % (epoch + 1, train_loss_sum / n, train_acc_sum / n, test_acc)) #调⽤函数训练数据train_model(optimizer)#结果可视化#准确度绘制import matplotlib.pyplot as plt# 绘制训练%验证的精度Trainacc=[]#请输⼊上述训练过程中保存的数据Testacc=[]##请输⼊上述训练过程中保存的数据plt.plot(Trainacc)plt.plot(Testacc)plt.title('qijiajing-Residual Block Model accuracy')plt.xlabel('Epoch')plt.ylabel('Accuracy')plt.legend(['Train acc', 'Test acc'], loc='upper left')plt.show()#loss绘制import matplotlib.pyplot as pltloss=[]plt.plot(loss)plt.xlabel('Epoch')plt.ylabel('Loss')plt.title('qijiajing-Model accuracy')我们进⾏了250次迭代,最终训练集精度稳定在43.5%左右,测试集精度稳定在41%左右,是随机猜测10%的四倍。

matlab神经网络43个案例分析MATLAB神经网络是一种广泛使用的机器学习工具,可以应用于多种问题的解决。

下面为大家介绍43个用MATLAB神经网络解决的案例分析。

1. 基于神经网络的股票市场预测通过分析历史数据,建立神经网络模型,预测未来股票市场走势。

2. 神经网络分类器建模分析通过建立分类模型,对不同类型数据进行分类处理。

3. 基于神经网络的信用评估模型通过收集客户的基本信息和信用历史,建立神经网络模型,对客户的信用进行评估。

4. 神经网络医学图像分析通过医学图像数据,建立神经网络模型,进行疾病诊断与分析。

5. 基于神经网络的机器人动作控制通过神经网络,训练机器人进行动作控制,提高机器人的智能化水平。

6. 神经网络预测库存需求通过分析历史销售数据,建立神经网络模型,预测未来库存需求,提高企业的运作效率。

7. 基于神经网络的人脸识别通过收集人脸数据,建立神经网络模型,实现人脸识别功能。

8. 神经网络垃圾邮件过滤通过建立神经网络模型,对邮件进行分类,筛选出垃圾邮件。

9. 基于神经网络的语音识别通过收集语音数据,建立神经网络模型,实现语音识别功能。

10. 神经网络飞机失速预测通过分析飞机数据和空气动力学知识,建立神经网络模型,预测飞机发生失速的概率。

11. 基于神经网络的目标识别通过收集目标数据,建立神经网络模型,实现目标识别功能。

12. 神经网络电力负荷预测通过历史电力数据,建立神经网络模型,预测未来电力负荷。

13. 基于神经网络的网络入侵检测通过建立神经网络模型,检测网络攻击行为。

14. 神经网络手写数字识别通过收集手写数字数据,建立神经网络模型,实现手写数字识别功能。

15. 基于神经网络的情感分析通过对情感文本数据进行分析,建立神经网络模型,实现情感分析功能。

16. 神经网络自然语言处理通过对自然语言文本数据进行处理和分析,建立神经网络模型,实现自然语言处理功能。

17. 基于神经网络的物体识别通过收集物体数据,建立神经网络模型,实现物体识别功能。

使用GMR探头和人工神经网络检测和表征缺陷这项工作提出基于巨磁阻(GMR)传感装置上的涡流检测系统。

在铝板无损检测应用,以提取有关可能存在的缺陷的信息:裂缝,孔洞等机械损伤。

涡流检测(ECT)呈现主要优点,例如成本低,高检测速度,鲁棒性和高灵敏度,以大的类的缺陷。

线圈基础的架构的探针或线圈磁阻的探针通常用在ECT。

在我们的应用GMR传感器用于检测磁场成分平行于板面,当垂直于板的激励场施加。

的神经网络处理架构,其中包括一多层感知和有竞争力的神经网络,被用于分类使用涡流探针(ECP)和其操作频率的输出振幅的缺陷。

裂缝检测,分类和估计的几何特性,对不同类别的缺陷,在该论文中描述。

关键词:无损检测;涡流;磁阻传感器;神经网络分类器1.介绍X射线,超声波检测和涡流检测[1] 是现今进行使用不同的方法使用非破坏性测试的机械部件的预期寿命的评估瑕疵不同类型的准确的评估[2]。

涡流检查是快速和有效地发生在导电材料检测缺陷,如疲劳裂纹,夹杂物,气泡和腐蚀[3],[4]和[5]。

随时间变化的磁场的应用引起的导电试样涡流。

的缺陷,它作为高电阻的障碍的存在,被关联到了在使用不同种类的探针检测到的涡电流的流动扰动。

涡流探针(ECP)的最简单的形式是用于诱导磁场中的导电材料,其阻抗的变化,测定这种方式所造成的缺陷[6]所述扰动的单一激磁线圈。

简单的励磁线圈探头代表一个强大的解决方案。

然而,低的灵敏度和分辨率低表征该探针。

这些缺点是过度通过,基于涡流探针的架构,包括激发和检测线圈开发新的线圈[7]和[8]。

这种探针是一种良好的解决方案,以检测在考虑到所述导电材料表面上的缺陷,对于良好的敏感性,他们需要一个相对高的激励正弦信号频率[9]。

在导电材料深埋缺陷是难以用全线圈涡流探头架构来检测。

为了克服单一频率的限制,脉冲涡流被使用并且报道为具有稍微更好的结果[10]和[11]一个有趣的解决方案。

在这种技术中,探头很高兴与重复的宽带脉冲。

神经网络在多标签分类任务中的应用在机器学习领域,多标签分类是一个重要的任务。

与传统的单标签分类任务不同,多标签分类任务需要模型能够对输入数据进行多个标签的预测。

神经网络作为一种强大的模型,在多标签分类任务中也有着广泛的应用。

本文将探讨如何利用神经网络进行多标签分类任务,并介绍一些常用的方法和技巧。

多标签分类任务的定义首先,我们来定义一下多标签分类任务。

在多标签分类任务中,每个样本可以被赋予多个标签,而不是仅仅一个标签。

这意味着每个样本可以属于多个类别,而不是仅属于一个类别。

例如,在图像分类任务中,一张照片中可能同时包含了“猫”和“树”的标签,这就是一个多标签分类的例子。

神经网络在多标签分类任务中的应用神经网络由多个神经元组成的层级结构,可以通过学习数据的特征来进行分类和预测。

在多标签分类任务中,神经网络可以通过适当的结构和训练方法来学习样本的多个标签之间的相关性,从而实现对多标签的准确预测。

常用的多标签分类神经网络结构在多标签分类任务中,常用的神经网络结构包括多输出神经网络、神经网络与逻辑回归模型的结合等。

多输出神经网络是指在输出层中有多个神经元,每个神经元对应一个标签,通过训练来学习每个标签的预测概率。

而将神经网络与逻辑回归模型结合则是通过将神经网络的输出输入到逻辑回归模型中,从而实现多标签分类的预测。

数据处理和特征提取在进行多标签分类任务时,数据处理和特征提取也是非常重要的环节。

对于图像数据,可以使用卷积神经网络(CNN)来提取图像特征,对于文本数据,可以使用循环神经网络(RNN)或者Transformer模型来提取文本特征。

在数据处理和特征提取的过程中,需要注意样本的标签信息,以便神经网络能够学习到标签之间的相关性。

损失函数的选择在多标签分类任务中,损失函数的选择也是非常重要的。

常用的损失函数包括二元交叉熵损失函数、sigmoid交叉熵损失函数等。

这些损失函数可以帮助神经网络更好地学习样本的多个标签之间的相关性,从而提高多标签分类的准确性。

人工智能课内实验报告(四)

班级:

姓名:

学号:

实验题目:

神经网络分类器

实验目得

通过编写神经网络分类器,掌握神经网络得分类方法;

掌握BP 算法及其具体应用。

实验内容

本次实验就是对在与不在正弦函数曲线上得两类点进行分类。

所使用得算法就是神经网络中得BP 算法。

实验原理及算法描述

线性分类器不能解决非线性问题,因此必须使用非线性分类器解决非线性问题。

非线性分类常采用神经网络算法,本次实验中使用得就是BP 算法。

BP (Back Propagation)神经网络就是一种神经网络学习算法。

其由输入层、隐层、输出层组成得阶层型神经网络,隐层可扩展为多层。

相邻层之间各神经元进行全连接,而每层各神经元之间无连接,网络按有教师示教得方式进行学习,当一对学习模式提供给网络后,各神经元获得网络得输入响应产生连接权值(Weight )。

然后按减小希望输出与实际输出误差得方向,从输出层经各中间层逐层修正各连接权,回到输入层。

此过程反复交替进行,直至网络得全局误差趋向给定得极小值,即完成学习得过程。

算法描述:

输入层: 单元i 得输入:i

x ; 单元数量:d ;

单元i 得输出:i

x ;

单元i 得激活函数:线性函数;

隐层: 单元j 得输入:netj ;

单元数量:nH ;

01

j d

t

j ji i j i net x x ωωω==+=∑ 010(,,....,),1t d x x x x x ==

01(,,....,)t j j j jd ωωωω=

单元j 得输出:()j j y f net =;

单元j 得激活函数:非线性函数; 输出层: 单元k 得输入: k net ;

单元数量:c ;

01H

n t k kj j k k j net y y

ωωω==+=∑ 010(,,....,),1H t n y y y y y ==

01(,,....,)H

t k k k kn ωωωω=

单元k 得输出:()k k z f net =

单元k 得激活函数:非线性函数

两层神经网络图如下:

分析:

(1)给定隐层单元及输出层单元得激活函数,一个神经网络就可以实现一个对输入特征向量x 得非线性映射。

因此,神经网络本质上就是一个非线性函数。

(2)给定隐层单元及输出层单元得激活函数,该非线性函数所对应得映射关系完全由权系数决定。

不同得权系数对应不同得非线性映射。

(3)神经网络学习得目得,就就是根据已知得训练样本,确定神经网络得权系数。

这一过程称为训练过程。

在训练过程结束后,对于新样本x ,根据神经网络得输出进行判决。

(4)对于C 类分类问题,神经网络得输出为(),1,...,k z x k c =。

神经网络得判决规则为:如果()(),1,...,,k l

z x z x l c l k ≥=≠,则判x 属于wk 。

(5)令()(),1,...,k k

g x z x k c ==,可以瞧出神经网络实际上实现了C 个非线性

得鉴别函数,并根据鉴别函数得取值进行分类。

(6)神经网络得训练目标:调整权系数w ,即所有得wkj 及wij ,使得对于训练集中得每一个训练样本(x,t),网络得输出尽可能满足: 11()()......()c c z x t z x t z x t ⎛⎫⎛⎫

⎪ ⎪=== ⎪ ⎪ ⎪ ⎪⎝⎭⎝⎭

(7)优化准则:对于样本集D ,使下述误差函数取得最小值: ()()

x x D

J J ωω∈=∑

()211()()2c

x k k k J t z x ω==-∑ 权系数得调整:

kj kj kj J

ωωηω∂←-∂ ()'()k j k k k k kj J y t z f net δδω∂==--∂,

1

()c ji ji j i j j k kj k ji ji J J x f net ωωηδδδωωω=∂∂'←-==∂∂∑,, BP 算法描述:

对于给定得样本集D={(x,t)},初始化网络结构d*nH*c 。

初始化权系数w ,学习效率η、阈值θ。

随机从D 中取出一个样本(x,t),根据该样本更新权系数w : kj kj kj

J

ωωηω∂←-∂

ji ji ji

J ωωηω∂←-∂ 计算()()pre J J J ωω∆=-,如果J θ∆<结束训练,并认为此时得w 为最优。

否则转第2步继续进行循环。

实验结果

运行程序

选择初始参数,输入正弦函数参数:

采样文件输出至当前目录下得initSample、dat文件中,第一列为x坐标,第二列为y坐标,第三列为t值,在正弦曲线上为1,不在为-1:

再选择训练样本,屏幕上输出最优权值,第一行wkj为隐层到输出层得权值,第二、三行wij为输入层到隐层得权值:

TestSample、dat如下:

其中第三列大于0得点在曲线上,小于0得点不在曲线上。

结果分析:

通过测试,测试样本中92%得数据测试正确,有8%得数据判错。

实验总结

通过本次实验,我对神经网络分类器得原理有了更加深刻得体会。