信息071信息论试卷-A

- 格式:doc

- 大小:120.50 KB

- 文档页数:6

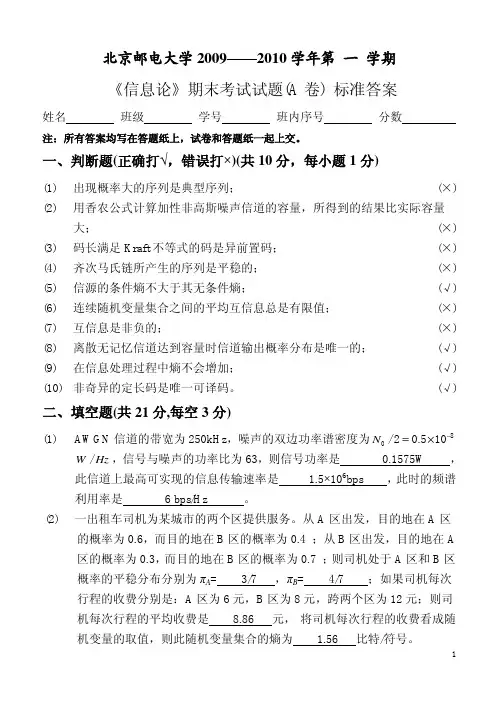

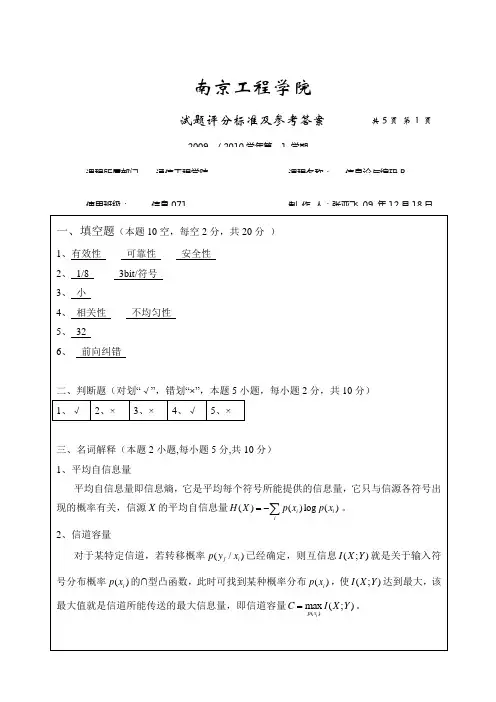

《信息论基础》参考答案一、填空题(共15分,每空1分)1、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。

2、信源的剩余度主要来自两个方面,一是信源符号间的相关性,二是信源符号的统计不均匀性。

3、三进制信源的最小熵为0,最大熵为32log bit/符号。

4、无失真信源编码的平均码长最小理论极限制为信源熵(或H(S)/logr= H r (S))。

5、当R=C 或(信道剩余度为0)时,信源与信道达到匹配。

6、根据信道特性是否随时间变化,信道可以分为恒参信道和随参信道。

7、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。

8、若连续信源输出信号的平均功率为2σ,则输出信号幅度的概率密度是高斯分布或正态分布或()222x f x σ-=时,信源具有最大熵,其值为值21log 22e πσ。

9、在下面空格中选择填入数学符号“,,,=≥≤〉”或“〈”(1)当X 和Y 相互独立时,H (XY )=H(X)+H(X/Y)=H(Y)+H(X)。

(2)()()1222H X X H X =≥()()12333H X X X H X = (3)假设信道输入用X 表示,信道输出用Y 表示。

在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y)<H(X)。

二、(6分)若连续信源输出的幅度被限定在【2,6】区域内,当输出信号的概率密度是均匀分布时,计算该信源的相对熵,并说明该信源的绝对熵为多少。

()1,2640,x f x ⎧≤≤⎪=⎨⎪⎩Q 其它()()()62log f x f x dx ∴=-⎰相对熵h x=2bit/自由度该信源的绝对熵为无穷大。

三、(16分)已知信源1234560.20.20.20.20.10.1S s s s s s s P ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦(1)用霍夫曼编码法编成二进制变长码;(6分) (2)计算平均码长L ;(4分)(3)计算编码信息率R ';(2分)(4)计算编码后信息传输率R ;(2分) (5)计算编码效率η。

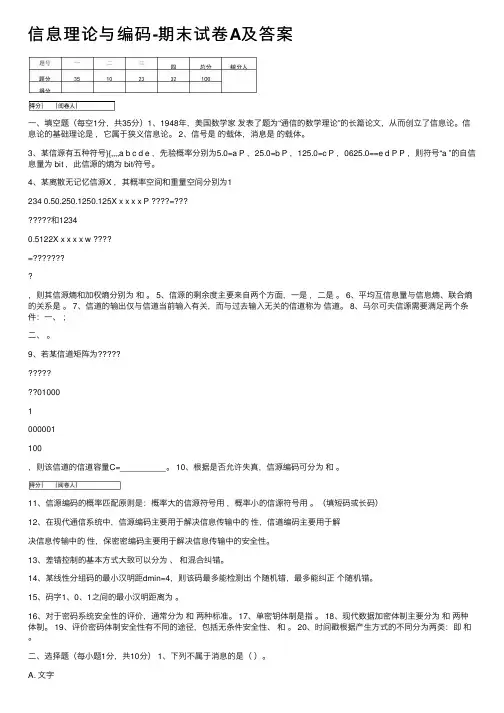

信息理论与编码-期末试卷A及答案⼀、填空题(每空1分,共35分)1、1948年,美国数学家发表了题为“通信的数学理论”的长篇论⽂,从⽽创⽴了信息论。

信息论的基础理论是,它属于狭义信息论。

2、信号是的载体,消息是的载体。

3、某信源有五种符号}{,,,,a b c d e ,先验概率分别为5.0=a P ,25.0=b P ,125.0=c P ,0625.0==e d P P ,则符号“a ”的⾃信息量为 bit ,此信源的熵为 bit/符号。

4、某离散⽆记忆信源X ,其概率空间和重量空间分别为1234 0.50.250.1250.125X x x x x P =???和12340.5122X x x x x w=,则其信源熵和加权熵分别为和。

5、信源的剩余度主要来⾃两个⽅⾯,⼀是,⼆是。

6、平均互信息量与信息熵、联合熵的关系是。

7、信道的输出仅与信道当前输⼊有关,⽽与过去输⼊⽆关的信道称为信道。

8、马尔可夫信源需要满⾜两个条件:⼀、;⼆、。

9、若某信道矩阵为010001000001100,则该信道的信道容量C=__________。

10、根据是否允许失真,信源编码可分为和。

11、信源编码的概率匹配原则是:概率⼤的信源符号⽤,概率⼩的信源符号⽤。

(填短码或长码)12、在现代通信系统中,信源编码主要⽤于解决信息传输中的性,信道编码主要⽤于解决信息传输中的性,保密密编码主要⽤于解决信息传输中的安全性。

13、差错控制的基本⽅式⼤致可以分为、和混合纠错。

14、某线性分组码的最⼩汉明距dmin=4,则该码最多能检测出个随机错,最多能纠正个随机错。

15、码字1、0、1之间的最⼩汉明距离为。

16、对于密码系统安全性的评价,通常分为和两种标准。

17、单密钥体制是指。

18、现代数据加密体制主要分为和两种体制。

19、评价密码体制安全性有不同的途径,包括⽆条件安全性、和。

20、时间戳根据产⽣⽅式的不同分为两类:即和。

一.填空1.设X的取值受限于有限区间[a,b ],则X 服从 均匀 分布时,其熵达到最大;如X 的均值为μ,方差受限为2σ,则X 服从 高斯 分布时,其熵达到最大。

2.信息论不等式:对于任意实数0>z ,有1ln -≤z z ,当且仅当1=z 时等式成立。

3.设信源为X={0,1},P (0)=1/8,则信源的熵为 )8/7(log 8/78log 8/122+比特/符号,如信源发出由m 个“0”和(100-m )个“1”构成的序列,序列的自信息量为)8/7(log )100(8log22m m -+比特/符号。

4.离散对称信道输入等概率时,输出为 等概 分布。

5.根据码字所含的码元的个数,编码可分为 定长 编码和 变长 编码。

6.设DMS 为⎥⎦⎤⎢⎣⎡=⎥⎦⎤⎢⎣⎡03.007.010.018.025.037.0.654321u u u u u u P U U ,用二元符号表}1,0{21===x x X 对其进行定长编码,若所编的码为{000,001,010,011,100,101},则编码器输出码元的一维概率=)(1x P 0.747 , =)(2x P 0.253 。

12设有DMC,其转移矩阵为[]⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡=2/16/13/13/12/16/16/13/12/1|XY P ,若信道输入概率为[][]25.025.05.0=X P ,试确定最佳译码规则和极大似然译码规则,并计算出相应的平均差错率。

解:⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡=8/124/112/112/18/124/112/16/14/1][XYP最佳译码规则:⎪⎩⎪⎨⎧===331211)()()(ab F a b F a b F ,平均差错率为1-1/4-1/6-1/8=11/24;极大似然规则:⎪⎩⎪⎨⎧===332211)()()(ab F a b F a b F ,平均差错率为1-1/4-1/8-1/8=1/2。

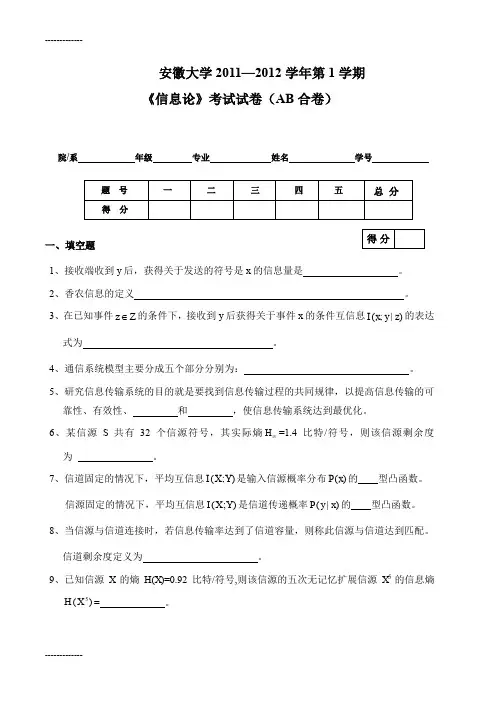

安徽大学2011—2012学年第1学期 《信息论》考试试卷(AB 合卷)院/系 年级 专业 姓名 学号一、填空题1、接收端收到y 后,获得关于发送的符号是x 的信息量是 。

2、香农信息的定义 。

3、在已知事件z Z ∈的条件下,接收到y 后获得关于事件x 的条件互信息(;|)I x y z 的表达式为 。

4、通信系统模型主要分成五个部分分别为: 。

5、研究信息传输系统的目的就是要找到信息传输过程的共同规律,以提高信息传输的可靠性、有效性、 和 ,使信息传输系统达到最优化。

6、某信源S 共有32个信源符号,其实际熵H ∞=1.4比特/符号,则该信源剩余度为 。

7、信道固定的情况下,平均互信息(;)I X Y 是输入信源概率分布()Px 的 型凸函数。

信源固定的情况下,平均互信息(;)I X Y 是信道传递概率(|)P y x 的 型凸函数。

8、当信源与信道连接时,若信息传输率达到了信道容量,则称此信源与信道达到匹配。

信道剩余度定义为 。

9、已知信源X 的熵H (X )=0.92比特/符号,则该信源的五次无记忆扩展信源X 5的信息熵5()H X = 。

10、将∞H ,6H ,0H ,4H ,1H 从大到小排列为 。

11、根据香农第一定理,对于离散无记忆信源S ,用含r 个字母的码符号集对N 长信源符号序列进行变长编码,总能找到一种无失真的唯一可译码,使每个信源符号所需平均码长满足: 。

12、多项式剩余类环[]())q F x f x 是域的充要条件为 。

13、多项式剩余类环[](1)n q F x x -的任一理想的生成元()g x 与1n x -关系为 。

14、有限域122F 的全部子域为 。

15、国际标准书号(ISBN )由十位数字12345678910a a a a a a a a a a 组成(诸i a ∈11F ,满足:1010(mod11)ii ia=≡∑),其中前九位均为0-9,末位0-10,当末位为10时用X 表示。

信息论基础》试卷(期末A卷重庆邮电大学2007/2008学年2学期《信息论基础》试卷(期末)(A卷)(半开卷)一、填空题(本大题共10小空,每小空1分,共20分)1.按信源发出符号所对应的随机变量之间的无统计依赖关系,可将离散信源分为有记忆信源和无记忆信源两大类。

2.一个八进制信源的最大熵为3bit/符号3.有一信源X,其概率分布为123x x xX111P244⎛⎫⎡⎤ ⎪=⎢⎥ ⎪⎣⎦⎝⎭,其信源剩余度为94.64%;若对该信源进行十次扩展,则每十个符号的平均信息量是 15bit。

4.若一连续消息通过放大器,该放大器输出的最大瞬间电压为b,最小瞬时电压为a。

若消息从放大器中输出,则该信源的绝对熵是∞;其能在每个自由度熵的最大熵是log(b-a)bit/自由度;若放大器的最高频率为F,则单位时间内输出的最大信息量是 2Flog(b-a)bit/s.5. 若某一信源X,其平均功率受限为16w,其概率密度函数是高斯分布时,差熵的最大值为1log32e2π;与其熵相等的非高斯分布信源的功率为16w≥6、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。

7、无失真信源编码的平均码长最小理论极限制为信源熵(或H(S)/logr= H r(S))。

8、当R=C或(信道剩余度为0)时,信源与信道达到匹配。

9、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。

10、在下面空格中选择填入数学符号“,,,=≥≤〉”或“〈”(1)当X和Y相互独立时,H(XY)=H(X)+H(X/Y)。

(2)假设信道输入用X表示,信道输出用Y表示。

在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y)<H(X)。

二、掷两粒骰子,各面出现的概率都是1/6,计算信息量:1.当点数和为3时,该消息包含的信息量是多少?2.当点数和为7是,该消息包含的信息量是多少?3.两个点数中没有一个是1的自信息是多少?解:1.P (“点数和为3”)=P (1,2)+ P (1,2)=1/36+1/36=1/18 则该消息包含的信息量是:I=-logP (“点数和为3”)=log18=4.17bit2.P (“点数和为7”)=P (1,6)+ P (6,1)+ P (5,2)+ P (2,5)+ P (3,4)+ P (4,3)=1/36 ⨯6=1/6 则该消息包含的信息量是:I=-logP (“点数和为7”)=log6=2.585bit3.P (“两个点数没有一个是1”)=1-P (“两个点数中至少有一个是1”) =1-P(1,1or1,jori,1)=1-(1/36+5/36+5/36)=25/36则该消息包含的信息量是:I=-logP (“两个点数中没有一个是1”)=log25/36=0.53bit三、设X 、Y 是两个相互统计独立的二元随机变量,其取-1或1的概率相等。

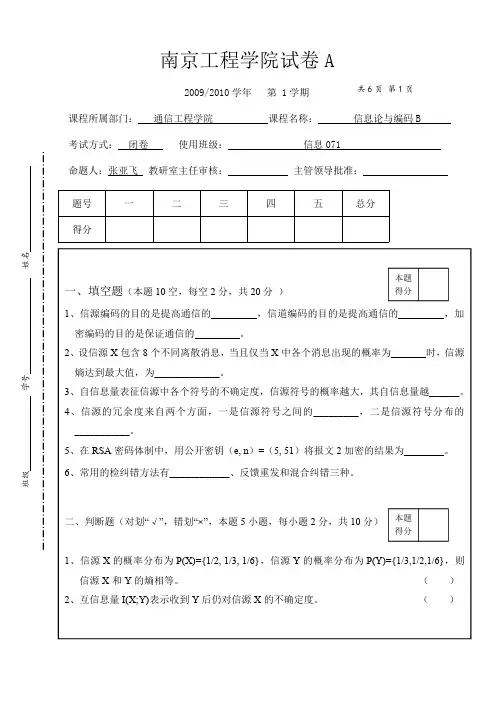

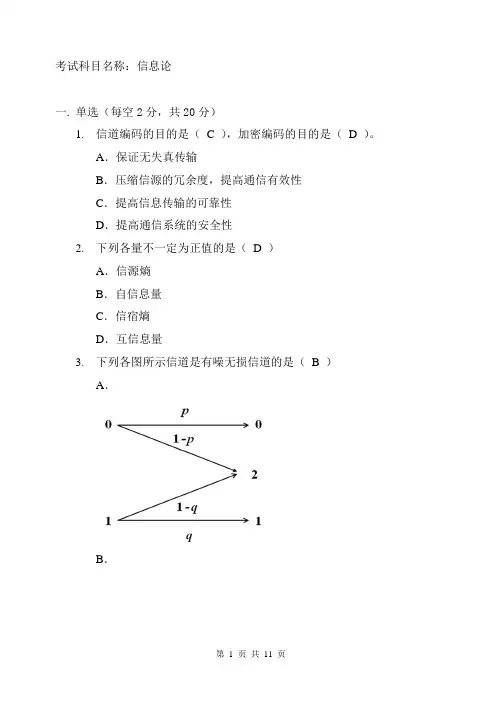

考试科目名称:信息论一. 单选(每空2分,共20分)1.信道编码的目的是(C ),加密编码的目的是(D )。

A.保证无失真传输B.压缩信源的冗余度,提高通信有效性C.提高信息传输的可靠性D.提高通信系统的安全性2.下列各量不一定为正值的是(D )A.信源熵B.自信息量C.信宿熵D.互信息量3.下列各图所示信道是有噪无损信道的是(B )A.B.C.D.4.下表中符合等长编码的是( A )5.联合熵H(XY)与熵H(X)及条件熵H(X/Y)之间存在关系正确的是(A )A.H(XY)=H(X)+H(Y/X)B.H(XY)=H(X)+H(X/Y)C.H(XY)=H(Y)+H(X)D.若X和Y相互独立,H(Y)=H(YX)6.一个n位的二进制数,该数的每一位可从等概率出现的二进制码元(0,1)中任取一个,这个n位的二进制数的自信息量为(C )A.n2B.1 bitC.n bitnD.27.已知发送26个英文字母和空格,其最大信源熵为H0 = log27 = 4.76比特/符号;在字母发送概率不等时,其信源熵为H1 = 4.03比特/符号;考虑字母之间相关性时,其信源熵为H2 = 3.32比特/符号;以此类推,极限熵H=1.5比特/符号。

问若用一般传送方式,冗余度为( B )∞A.0.32B.0.68C .0.63D .0.378. 某对称离散信道的信道矩阵为 ,信道容量为( B )A .)61,61,31,31(24log H C -= B .)61,61,31,31(4log H C -= C .)61,61,31,31(2log H C -= D .)61,31(2log H C -= 9. 下面不属于最佳变长编码的是( D )A .香农编码和哈夫曼编码B .费诺编码和哈夫曼编码C .费诺编码和香农编码D .算术编码和游程编码二. 综合(共80分)1. (10分)试写出信源编码的分类,并叙述各种分类编码的概念和特性。

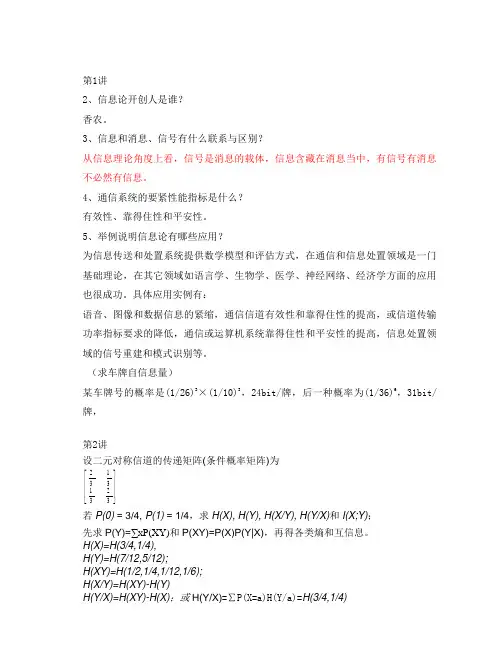

第1讲2、信息论开创人是谁? 香农。

3、信息和消息、信号有什么联系与区别?从信息理论角度上看,信号是消息的载体,信息含藏在消息当中,有信号有消息不必然有信息。

4、通信系统的要紧性能指标是什么? 有效性、靠得住性和平安性。

5、举例说明信息论有哪些应用?为信息传送和处置系统提供数学模型和评估方式,在通信和信息处置领域是一门基础理论,在其它领域如语言学、生物学、医学、神经网络、经济学方面的应用也很成功。

具体应用实例有:语音、图像和数据信息的紧缩,通信信道有效性和靠得住性的提高,或信道传输功率指标要求的降低,通信或运算机系统靠得住性和平安性的提高,信息处置领域的信号重建和模式识别等。

(求车牌自信息量)某车牌号的概率是(1/26)3×(1/10)3,24bit/牌,后一种概率为(1/36)6,31bit/牌, 第2讲设二元对称信道的传递矩阵(条件概率矩阵)为⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡32313132若P(0) = 3/4, P(1) = 1/4,求H(X), H(Y), H(X/Y), H(Y/X)和I(X;Y); 先求P(Y)=∑X P(XY)和P(XY)=P(X)P(Y|X),再得各类熵和互信息。

H(X)=H(3/4,1/4), H(Y)=H(7/12,5/12);H(XY)=H(1/2,1/4,1/12,1/6); H(X/Y)=H(XY)-H(Y)H(Y/X)=H(XY)-H(X);或H(Y/X)=∑P(X=a)H(Y/a)=H(3/4,1/4)I(X;Y)=H(X)-H(X/Y)=H(X)+H(Y)-H(XY);(求条件信息量)1.6米以上女孩是条件,某个1.6米以上的女大学生是概率事件,得条件概率为:P=×==3/8,信息量为I= =比特。

(1)(2)(由联合概率散布求熵、联合熵和条件熵)(1)思路:先求出X、Y、Z、XZ、YZ、XYZ的概率或联合散布,再求其熵。

如:P(Z=XY=0)=1-P(XY=1)=7/8,P(ZX=1)=P(YX=1)=1/8,..(2)思路:通过X、Y、Z及其联合概率散布求X/Y等条件概率散布P(X/Y)=P(XY)/P(Y),再求其熵H(X/Y)=∑P(Y=b)H(X/b)。

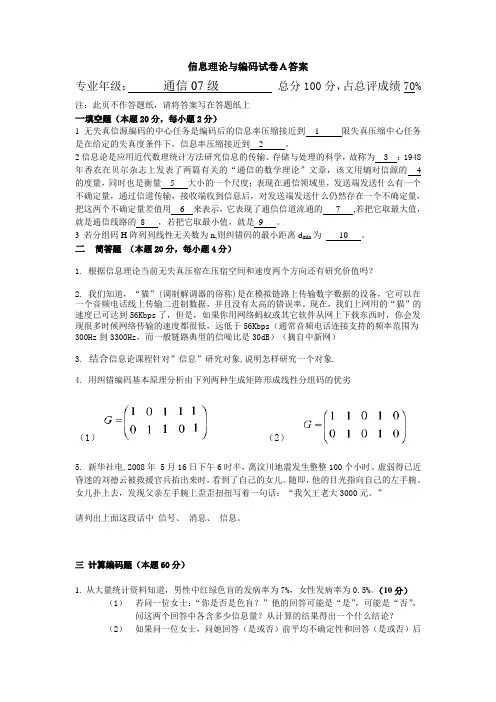

信息理论与编码试卷A答案专业年级:通信07级总分100分,占总评成绩70%注:此页不作答题纸,请将答案写在答题纸上一填空题(本题20分,每小题2分)1 无失真信源编码的中心任务是编码后的信息率压缩接近到 1 限失真压缩中心任务是在给定的失真度条件下,信息率压缩接近到2 。

2信息论是应用近代数理统计方法研究信息的传输、存储与处理的科学,故称为 3 ;1948年香农在贝尔杂志上发表了两篇有关的“通信的数学理论”文章,该文用熵对信源的 4 的度量,同时也是衡量 5 大小的一个尺度;表现在通信领域里,发送端发送什么有一个不确定量,通过信道传输,接收端收到信息后,对发送端发送什么仍然存在一个不确定量,把这两个不确定量差值用 6 来表示,它表现了通信信道流通的7 ,若把它取最大值,就是通信线路的8 ,若把它取最小值,就是9 。

3 若分组码H阵列列线性无关数为n,则纠错码的最小距离d min为10 。

二简答题(本题20分,每小题4分)1. 根据信息理论当前无失真压宿在压宿空间和速度两个方向还有研究价值吗?2. 我们知道,“猫”(调制解调器的俗称)是在模拟链路上传输数字数据的设备,它可以在一个音频电话线上传输二进制数据,并且没有太高的错误率。

现在,我们上网用的“猫”的速度已可达到56Kbps了,但是,如果你用网络蚂蚁或其它软件从网上下载东西时,你会发现很多时候网络传输的速度都很低,远低于56Kbps(通常音频电话连接支持的频率范围为300Hz到3300Hz,而一般链路典型的信噪比是30dB)(摘自中新网)3.结合信息论课程针对”信息”研究对象,说明怎样研究一个对象.4. 用纠错编码基本原理分析由下列两种生成矩阵形成线性分组码的优劣(1)(2)5. 新华社电,2008年 5月16日下午6时半,离汶川地震发生整整100个小时。

虚弱得已近昏迷的刘德云被救援官兵抬出来时,看到了自己的女儿。

随即,他的目光指向自己的左手腕。

考试科目名称:信息论一. 单选(每空2分,共20分)1.一个m位的二进制数的自信息量为(A )A.m bitB.1 bitC.m2mD.22.信源编码的目的是(A )A.提高通信有效性B.提高信息传输的可靠性C.提高通信系统的安全性D.压缩信源的冗余度3.下面属于最佳变长编码的是(C )A.算术编码和游程编码B.香农编码和游程编码C.哈夫曼编码和费诺编码D.预测编码和香农编码4.表中符合即时码的是(A )和(D )5.下列各量可能为负值的是(B )A.自信息量B.互信息量C.信息熵D.平均互信息量6.联合熵H(XY)与熵H(X)及条件熵H(X/Y)之间存在关系错误的是(D )A.H(XY)=H(X)+H(Y/X)B.若X和Y相互独立,H(Y)=H(Y/X)C.H(XY)=H(Y)+H(X/Y)D.H(XY)=H(X)+H(X/Y)7.已知发送26个英文字母(包括空格),其最大信源熵(发送概率相等)为H0 = log27 = 4.76比特/符号;在字母发送概率不等时,其信源熵为H1 = 4.03比特/符号;考虑字母之间相关性时,其信源熵为H2 = 3.32=1.4比特/符号。

问若用一般传送比特/符号;以此类推,极限熵H∞方式,冗余度γ为( B )A.0.58B.0.71C.0.65D.0.298. 某信道传递矩阵为,其信道容量为( D )A .)41log 4143log 43()81,81,41,21(4log ++-=H C B .)41log 4343log 41()81,81,41,21(2log +--=H C C .)41log 4143log 43()81,81,41,21(4log +--=H CD .)41log 4143log 43()81,81,41,21(2log +--=H C9. 下列各图所示信道是对称信道的是( C )A .B .C .⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡=8181214181814121PD.二. 综合(共80分)1.(10分)试画出通信系统的模型,并叙述各部分的定义和作用。

《信息论基础》参考答案一、填空题(共15分,每空1分)1、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。

2、信源的剩余度主要来自两个方面,一是信源符号间的相关性,二是信源符号的统计不均匀性。

3、三进制信源的最小熵为0,最大熵为32log bit/符号。

4、无失真信源编码的平均码长最小理论极限制为信源熵(或H(S)/logr= H r (S))。

5、当R=C 或(信道剩余度为0)时,信源与信道达到匹配。

6、根据信道特性是否随时间变化,信道可以分为恒参信道和随参信道。

7、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。

8、若连续信源输出信号的平均功率为2σ,则输出信号幅度的概率密度是高斯分布或正态分布或()222x f x σ-=时,信源具有最大熵,其值为值21log 22e πσ。

9、在下面空格中选择填入数学符号“,,,=≥≤〉”或“〈”(1)当X 和Y 相互独立时,H (XY )=H(X)+H(X/Y)=H(Y)+H(X)。

(2)()()1222H X X H X =≥()()12333H X X X H X = (3)假设信道输入用X 表示,信道输出用Y 表示。

在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y)<H(X)。

二、(6分)若连续信源输出的幅度被限定在【2,6】区域内,当输出信号的概率密度是均匀分布时,计算该信源的相对熵,并说明该信源的绝对熵为多少。

()1,2640,x f x ⎧≤≤⎪=⎨⎪⎩Q 其它()()()62log f x f x dx ∴=-⎰相对熵h x=2bit/自由度该信源的绝对熵为无穷大。

三、(16分)已知信源1234560.20.20.20.20.10.1S s s s s s s P ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦(1)用霍夫曼编码法编成二进制变长码;(6分) (2)计算平均码长L ;(4分)(3)计算编码信息率R ';(2分)(4)计算编码后信息传输率R ;(2分) (5)计算编码效率η。

信息论与编码总结试 题:一 填空题(共15 分,每题1 分)1 单符号离散信源一般用随机变量描述,而多符号信源一般用随机矢量描述。

2 离散平稳无记忆信源X 的N 次扩展信源的熵等于离散信源X 的熵的N 倍。

3 对于一阶马尔可夫信源,其状态空间共有m n 个不同的状态。

4 根据输入输出的信号特点,可将信道分成离散信道、连续信道、半离散或半连续信道 。

5 对于离散无记忆信道和信源的N 次扩展,其信道容量N C = NC6 信道编码论定理是一个理想编码存在性理论,即:信道无失真传递信息的条件是 信息传输速率小于信道容量。

7 信源编码的目的是 提高通信的有效性 。

8 对于香农编码、费诺编码和哈夫曼编码,编码方法唯一的是 香农编码 。

9 在多符号的消息序列中,大量重复出现的,只起占时作用的符号称为 冗余位 。

10 若纠错码的最小距离为d m in ,则可以纠错任意小于等于21min -d个差错。

11 线性分组码是同时具有 分组特性和线性特性 的纠错码。

12 平均功率为P 的高斯分布的连续信源,其信源熵为 ()eP X H c π2log 212=13 当连续信源和连续信道都是无记忆时,则)()(∑==Ni i i y x I y x I 1,,14 信源编码与信道编码之间的最大区别是,信源编码需 减少 信源的剩余度,而信道编码需 增加 信源的剩余度。

15 离散信源的熵值H(X)越小,说明该信源消息之间的平均不确定性 减弱 。

二 选择题 (共15分,每题3分)1 离散信源熵表示信源输出一个消息所给出的( B )。

A 、实际信息量;B 、统计平均信息量;C 、最大信息量;D 、最小信息量; 解:选择B 。

2 )。

A 、H(X)> H(Y);B 、H(X)< H(Y);C 、H(X)= H(Y);D 、H(Y)=2H(X);解:选择A 。

241log 41)(4=-=⎰dx X H2ln 21181log 81)(4-=-=⎰ydy y Y H3 平均互信息I(X,Y)等于( C )。

期终练习,10%就是胖子 ,80%不胖不瘦 ,10%就是瘦子;已知胖子得高血压的概率 一,某地区的人群中 就是 15% ,不胖不瘦者得高血压的概率就是 10%,瘦子得高血压的概率就是 5% ,就“该地区的 某一位高血压者就是胖子”这句话包含了多少信息量;解: 设大事 A: 某人就是胖子 ; B: 某人就是不胖不瘦 C:某人就是瘦子D: 某人就是高血压者依据题意 ,可知 :P(A)=0 , 1 P(B)=0 , 8 P(C)=0 ,1P(D|A)=0 , 15 P(D|B)=0 , 1 P(D|C)=0 , 05而“该地区的某一位高血压者就是胖子” 这一消息说明在 D 大事发生的条件下 ,A 大事 的发生 ,故其概率为 依据贝叶斯定律 P(A|D),可得 :P(D) = P(A)* P(D|A) + P(B)* P(D|B) +P(C)* P(D|C) = 0, 1P(A|D) = P(AD)/P(D) = P(D|A)*P(A)/ P(D) = 0, 15*0 , 1/0, 1= 0,15故得知“该地区的某一位高血压者就是胖子”这一消息获得的多少信息量为 I(A|D) = - logP(A|D)=log(0 ,15) ≈ 2, 73 (bit): 二,设有一个马尔可夫信源 ,它的状态集为 {S 1,S 2,S 3}, 符号集为 {a 1,a 2,a 3 }, 以及在某状态下发出 p (a k | s i ) (i,k=1,2,3), 如下列图符号集的概率就是 (1) 求图中马尔可夫信源的状态极限概率并找出符号的极限概率(2) 运算信源处在某一状态下输出符号的条件熵 H(X|S=j) (j=s 1,s 2,s 3)(3) 求出马尔可夫信源熵 H解 :(1) 该信源达到平稳后 , 有以下关系成立 :Q( E 1 ) Q(E 3 ) 273727Q(E 1 )3 4 1 4 1 2 1 2 Q( E 2 ) Q(E 1 ) Q( E 2 )Q(E )可得 2 Q( E 3 ) Q(E 1 ) Q( E 2 )Q(E ) 3Q( E 1 ) Q(E 2 ) Q(E 3 ) 133 72 73 7 p(a 1)Q(E i ) p( a 1 |E i ) i 13 p(a 2 )Q(E i ) p(a 2 |E i ) i 1 3p(a ) Q(E ) p(a |E ) 3 i 3 i i 13 p(a k |S 1 ) log p(a k | S 1) 1.(5 bit/ 符号)H ( X | S 1 ) k 13(1 bit/ 符号)(2) H ( X | S 2 ) p(a k |S 2 ) log p(a k | S 2 ) k 13p(a k |S 3 ) log p(a k | S 3 ) 0(bit/ 符号)H ( X | S 3 ) k 13(3) H Q(E i ) H (X | E i ) 2 / 7*3/ 2 3/ 7*1 2 / 7*0 6 / 7 (比特 /符号 )i 1三,二元对称信道的传递矩阵为 (1) 如 P(0)=3/4,P(1)=1/4, 求 H(X),H(X|Y) 与 I(X;Y)(2) 求该信道的信道容量及其最大信道容量对应的正确输入分布2解: ⑴ H ( X ) = p(x i )log p( x i ) 75 25 0, 811(比特 /符号 )= i 1p( y 1 ) p( x 1 ) p( y 1 | x 1 ) p( x 2 ) p( y 1 | x 2 ) =0,75*0 ,6+0 , 25*0 , 4=0 , 55 p( y 2 ) p( x 1 ) p( y 2 | x 1 ) p( x 2 ) p( y 2 | x 2 ) 0, 75*0 , 4+0 , 25*0 , 6=0, 45 H (Y) 0, 992(比特 /符号 )H (Y | X ) p( x)H (Y | x 1) p(x 2 ) H (Y | x 2 ) H (0.6,0.4) H (0.4,0.6) 0.4)7(1 比特 / 符号)H ( X | Y ) H ( XY ) H (Y) H ( X ) H (Y | X ) H (Y)0, 811+0, 971-0 , 992=0, 79 (比特 /符号 )I(X;Y)=H(X)-H(X|Y) =0, 811-0, 79=0, 021(比特 /符号 )(2) 此信道为二元对称信道 ,所以信道容量为C=1-H(p)=1-H(0 , 6)=1-0 , 971=0, 029( 比特 /符号 )当输入等概分布时达到信道容量p p 22pp2244,其中p 1 p ;四,求信道的信道容量0 44 0p p 22pp22解: 这就是一个准对称信道,可把信道矩阵分为: ,N1 M 1 1 4 , N 2 4 , M 422C log r H ( p 2, p 2 ,0,4 ) Nk log Mkk 1log 2 H ( p 2 , p 2 ,0,4 )(1 4 )log(1 44)4log 4(比特/ 符号)故1H ( p 2 , p 2 ,4 ) (1 4 )log(1 4 ) log 4 当输入等概分布时达到信道容量;1XP( x) x1x2x3x4x5x6五,信源(1) 利用霍夫曼码编成二元变长的惟一可译码,并求其L,并求其L(2) 利用费诺码编成二元变长的惟一可译码(3) 利用香农码编成二元变长的惟一可译码(1) 香农编码:,并求其信源符号x 1x 2x 3x 4x 5x 6概率P(x i)0,40,20,20,10,050,05码长233455累积概率0,40,60,80,90,95码字0001110011001110011110l i PL =0 ,4×2+0,2×3+0,2×3+0,1×4+0,05×5+0,05×5=2,9(码元/信源符号)η=H(X)/( L logr)=2 ,222/2,9=0 ,7662(2) 霍夫曼编码:L =0 ,4×2+0,2×2×2+0 ,1×3+0,05×4×2=2,3(码元/信源符号)η=H(X)/( L logr)=0 ,9964(3)费诺编码:L =0 ,4×2+0,2×2×2+0 ,1×3+0,05×4×2=2,3(码元/信源符号)η=H(X)/( L logr)= 0 ,99641 21312161613121613六,设有一离散信道,传递矩阵为设P(x1 )= P(x 2)=1/4,P(x 3)=1/2,试分别按最小错误概率准就与最大似然译码准就确定译码规章并相应的运算机平均错误概率的大小;解:(1) 按最大似然译码准就,F(y1)=x1 F(y2)=x2 F(y3)=x3P(E)=1/2(1/3+1/6)+1/4 ×2×(1/3+1/6)=1/2(2) 联合概率矩阵为,就按最小错误概率准1 8 1 24 1 61121811212411214F(y1)=x3 F(y2)=x2 F(y3)=x3 P(E)= 1/8+1/24+2/12 +1/24+1/12=11/240,131,13213UP(u)八,一个三元对称信源0 1 1 1 0 1 11接收符号为 V = {0,1,2}, 其失真矩阵为 (1)求 D max 与 D min 及信源的 R(D) 函数;(2)求出达到 R(D ) 的正向试验信道的传递概率1 r2 3解 :(1) D max = min P ( u ) d(u ,v) 1 V U 3D min = P ( u ) min d (u , v) 0 j i 1由于就是三元对称信源 ,又就是等概分布 ,所以依据 r 元离散对称信源可得 R(D) =log3 - Dlog2 -H(D) = log3 - D - H(D) 0<=D<=2/3= 0 D>2/3(2)满意 R(D) 函数的信道其反向传递概率为1 D (i j )P(u i | v j ) D2 (i j )13以及有 P(v j )= 依据依据贝叶斯定律 ,可得该信道的正向传递概率为 :1 D2 D (i j )P( v j | u i ) (i j )九,设二元码为 C=[11100,01001,10010,00111](1) 求此码的最小距离 d min ;(2) 采纳最小距离译码准就 ,试问接收序列 10000,01100 与 00100 应译成什么码字?(3) 此码能订正几位码元的错误?解:(1) 码距如左图11100 01001 10010 001111110001001 10010 00111 33 4 43 3故 d min = 3(2) 码距如右图故 10000 译为 译为 11100,00100 译为 11100 或 0011110010,01100 d min 2 e 1,知此码能订正一位码元的错误;(3) 依据。

信息论基础理论与应用考试题一﹑填空题(每题2分,共20分)1.信息论研究的目的就是要找到信息传输过程的共同规律,以提高信息传输的 (可靠性)﹑(有效性)﹑XX 性和认证性,使信息传输系统达到最优化。

(考点:信息论的研究目的)2.电视屏上约有500×600=3×510个格点,按每点有10个不同的灰度等级考虑,则可组成531010⨯个不同的画面。

按等概计算,平均每个画面可提供的信息量约为(610bit /画面)。

(考点:信息量的概念与计算)3.按噪声对信号的作用功能来分类信道可分为 (加性信道)和 (乘性信道)。

(考点:信道按噪声统计特性的分类)4.英文电报有32个符号(26个英文字母加上6个字符),即q=32。

若r=2,N=1,即对信源S 的逐个符号进行二元编码,则每个英文电报符号至少要用 (5)位二元符号编码才行。

(考点:等长码编码位数的计算)5.如果采用这样一种译码函数,它对于每一个输出符号均译成具有最大后验概率的那个输入符号,则信道的错误概率最小,这种译码规则称为(最大后验概率准则)或(最小错误概率准则)。

(考点:错误概率和译码准则的概念)6.按码的结构中对信息序列处理方式不同,可将纠错码分为(分组码)和(卷积码)。

(考点:纠错码的分类)7.码C={(0,0,0,0),(0,1,0,1),(0,1,1,0),(0,0,1,1)}是((4,2))线性分组码。

(考点:线性分组码的基本概念)8.定义自信息的数学期望为信源的平均自信息量,即(11()log ()log ()()q i i i i H X E P a P a P a =⎡⎤==-⎢⎥⎣⎦∑)。

(考点:平均信息量的定义)9.对于一个(n,k)分组码,其最小距离为d,那么,若能纠正t个随机错误,同时能检测e(e≥t)个随机错误,则要求(d≥t+e+1)。

(考点:线性分组码的纠检错能力概念)10.和离散信道一样,对于固定的连续信道和波形信道都有一个最大的信息传输速率,称之为(信道容量)。