小词汇量语音识别系统的实现

徐晓聃殷福亮

(大连理工大学电信学院信号与信息处理专业)

【摘要】小词汇量语音识别系统是指词汇量在100以下的识别系统,其研究重点和难点在于减少系统的运算量和存储量,提高系统的实时性. 本文用C语言实现了一个小词汇量语音识别系统,在详细分析系统各个部分关键算法的基础上,改进了系统的实时性和抗噪性.

【关键词】端点判别,特征提取,矢量量化,隐含马尔可夫模型

分类号:TN912.34

小词汇量语音识别系统是指词汇量在100以下的语音识别系统. 它的应用范围极其广泛,如语音指令控制,数码串识别系统等. 因此,对小词汇量语音识别系统的研究具有重要的实用价值. 小词汇量语音识别系统在算法复杂度和实现难度上比大词汇量语音识别系统小许多,比较容易在脱机系统,如PDA等手持设备上实现. 芯片化也是其发展趋势之一.

小词汇量语音识别技术已经相当成熟,实现高识别率并非难事. 目前面对的问题是如何在保持高识别率下降低算法的复杂度,减少运算量和存储量,使得系统能在高速DSP上实时实现.

本文用C语言实现了一个小词汇量的语音识别系统,并从实际应用着眼,提高了系统的实时性和实用性.

1 小词汇量语音识别系统的基本结构

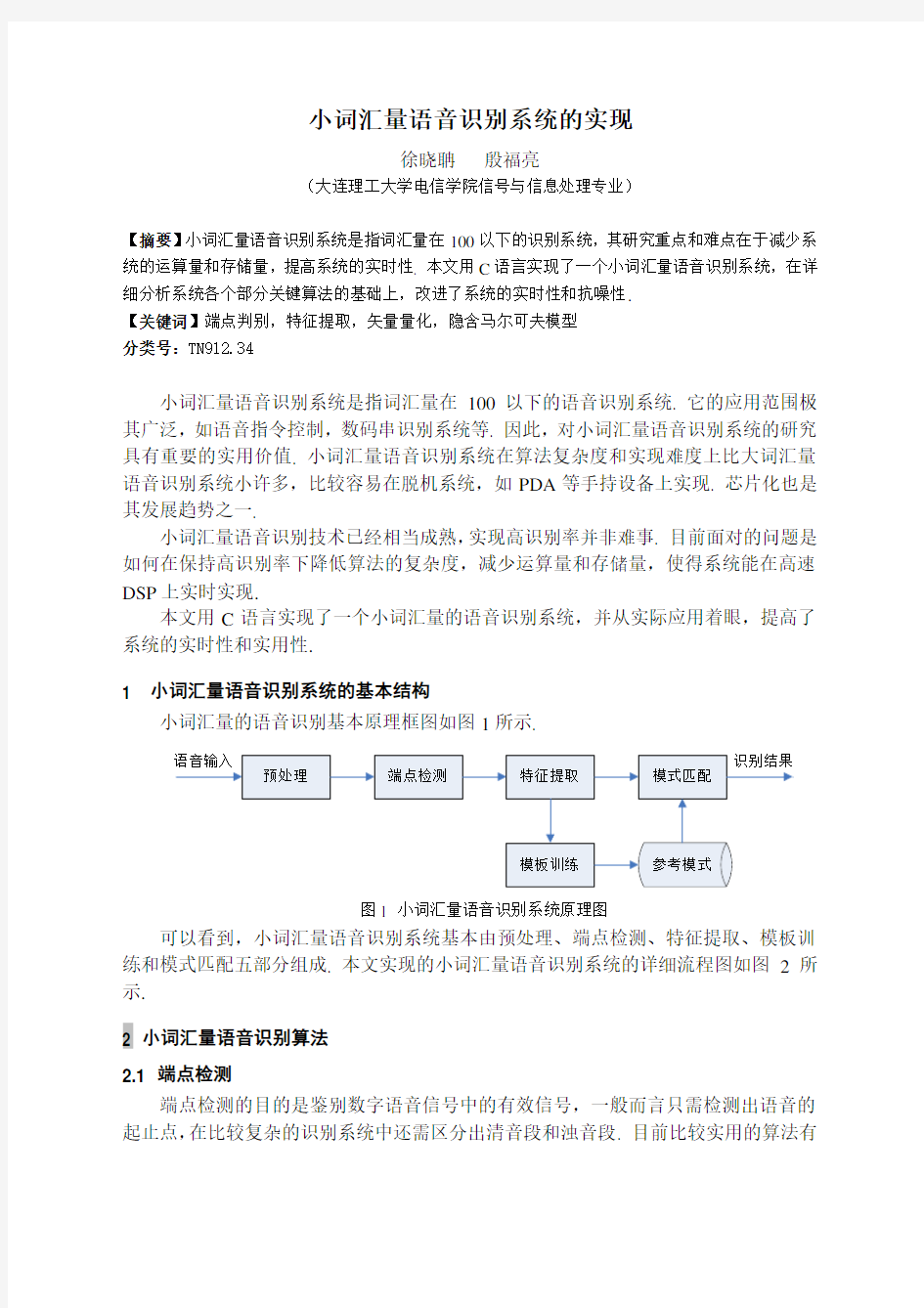

小词汇量的语音识别基本原理框图如图1所示.

图1 小词汇量语音识别系统原理图

可以看到,小词汇量语音识别系统基本由预处理、端点检测、特征提取、模板训练和模式匹配五部分组成. 本文实现的小词汇量语音识别系统的详细流程图如图2所示.

2 小词汇量语音识别算法

2.1 端点检测

端点检测的目的是鉴别数字语音信号中的有效信号,一般而言只需检测出语音的起止点,在比较复杂的识别系统中还需区分出清音段和浊音段. 目前比较实用的算法有

图2 本文识别系统流程图

VUS(V oice – Unvoice – Silence)算法[1]、FED (Fast Endpoint Detection) 算法[2]和FRED (Feature-based Real-time Endpoint Detection)算法[3]等. 其特点分别为: VUS算法. 根据语音信号的能量和短时过零率区分有效语音和背景噪声. 算法简单,运算量小是这种算法最大的优点. 在信噪比比较平均的情况下,VUS算

法简单可靠,但因为其阈值都是事先在特定环境下根据经验设定的,当环境变

化时,阈值的可靠程度降低,故其抗噪能力较弱. 另外,因为检测必须在语音

采样完成以后进行,因此实时性较差.

FED 算法. 和VUS一样,也是根据语音信号的能量和短时过零率区分有效语音和背景噪声,不同的是其阈值由语音两端的噪声动态设定,所以FED算法

有较好的抗噪声性能. 而且由于采用了语音能量变化率为检测标准,精度较高.

同样,FED算法的判定在语音采样完成以后,因此其实时性不高. 而且,FED

算法对语音两端噪声一致性要求过于苛刻,使得许多语音被拒绝进行端点检测.

FRED算法. 根据语音的频率特性判别有效语音. 这种算法可以在提取语音特征后进行,不必等待语音全部采样完毕,实时性较好. 而且判别依据反映了语

音的本质特征,抗噪性能优于前两种方法. 但FRED算法需要进行FFT计算求

得语音信号的频谱信息,因此运算量远大于前两种算法,一般与需要进行频域

变换的特征提取方法同时使用.

上述方法皆有利弊。可以看到,VUS算法计算量小,简单可靠,是最适合在小词

汇量语音识别系统上实现的端点判别算法。借鉴到FRED 算法的思想,分帧处理可以提高其实时性。改进后的VUS 算法步骤如下:

1) 采样开始,计算阈值[4]. 记标志位false IsStart =.

首先根据发音刚开始前已知无语音状态的连续10帧数据,计算出过零率的阈值IZCT :

min[,2]IZCT IF IZCT σ=+ (1) 其中IZCT 和σ分别为根据采样值算得的均值和标准差. IF 为定值,取25.

计算此10帧数据的平均幅度,最大值为IMX ,最小值为IMN ,分别计算1I 和2I 为:

10.03()I IMX IMN IMN =?+, 24I IMN = (2)

于是得到高能量阈值ITU 和低能量阈值ITL 为:

ITU a ITL =?,12min(,)ITL I I = (3) a 是一个经验常数,一般取5.

2) 分帧,加窗,将加窗语音帧存入长度为50ms 的循环缓冲区. 新数据从缓冲区

头部进入,旧数据从缓冲区尾部抛弃.

3) 取出缓冲区中间的语音帧,

也就是约为25ms 处的语音帧,计算其平均幅度0E . 0()&(!)E ITU IsStart > 判定浊音区开始,向缓冲区头部搜索精确起点.

100[()()]arg min i

F E i ITL Z i IZCT >>=|| (4)

并记标志位true IsStart =,0()E i 和0()Z i 分别为缓冲区内第i 帧的平均幅度和

短时过零率;0()&()E ITU IsStart < 判定浊音区结束,向缓冲区尾部搜索精确

终点.

20[()]arg max i

B E i ITL => (5)

并记标志位false IsStart =

4) true IsStart =,则开始对语音起始帧进行特征提取和矢量量化,将码本标号记

录;false IsStart =,则计算语音段长度,若过短则判定端点判别失败,否则将记录的码本标号送交下一级识别.

从上述判别步骤可以看出,这个算法有如下特点:

判别基于语音帧,因此精度不如VUS ,而和FRED 相同.

保留了VUS 的运算量小和灵活性高的特点. 此算法是从VUS 算法上衍生而

来,因此运算量和VUS 相当.

提高了实时性. 此算法有一定延时,因为需要将数据倒入缓冲区,故至少有

50ms 的算法延时,而且另开缓冲区的原因,存储量有一定消耗. 但因为节约了采样时间,在采样的同时即可进行特征提取,如果使用矢量量化,则存储量也大为节省,因此在实时性上优于VUS 而略差于FRED ,很容易用于实时系统上.

判别阈值根据实际语音动态确定,抗噪性有所提高.

2.2特征提取

在语音识别系统中, 模拟信号在完成A/D 转换后成为数字信号, 但时域上的语音

信号很难直接用于识别, 因此我们需要从语音信号中提取语音的特征,一方面可以获得语音的本质特征, 另一方面也起到数据压缩的作用. 不同的语音特征对不同的语音敏感度也不一样. 任何输入的语音信号相关参数都可以选作语音特征. 优秀的语音特征应该对于不同的字音特征间距离较大,而相同字音特征间距离较小. 若以前者距离与后者距离之比为优化准则,则该值越大,语音特征越优异.

倒谱特征是一种良好的语音特征,它利用将信号做适当的同态滤波可分离其卷积的性质将语音的声道频率响应和激励信号源分离,因此其识别性能相当稳定. 常用的倒谱特征有LPCC(Linear Prediction Cepstrum Coefficient ,线性预测倒谱参数)[1][4]和MFCC (Mel Frequency Cepstrum Coefficient,Mel 频标倒谱系数)[5],其特点为:

LPCC 是基于语音信号为自回归信号的假设,利用线性预测分析获得倒谱系

数的一种倒谱特征. LPCC 参数的优点是计算量小,

对元音有较好的描述能力,其缺点在于对辅音的描述能力较差,抗噪性能较差.

MFCC 将频谱转化为基于Mel 频标的非线性频谱,然后转换到倒谱域上. 由于

充分模拟了人的听觉特性,而且没有任何前提假设,MFCC 参数具有识别性能和抗噪能力优异的特点. 但MFCC 的运算量较大.

虽然MFCC 的识别率和抗噪性能都优于LPCC ,但是LPCC 的运算量小许多,因此更适合用在小词汇量语音识别系统上.

为了提升LPCC 的抗噪性能,本文用单边自相关序列代替原语音序列. 设原始信号为()s n ,0,1,,1n N =?L ,则单边自相关序列为:

1

01()()0,1,1()00N m n s n s n m m N R m N m ??=?+ =??=??

∑L (6)

用()R m ,0,1,,1m N =?L 代替原始信号()s n ,0,1,,1n N =?L ,可以有效的消除加性噪声的影响. 被加性噪声污染的语音为可以表示为:

()()()X n S n N n =+ (7) 则其单边自相关序列为

()()()()()X XX NN XN NX R m R m R m R m R m =+++ (8)

由于噪声的随机性,噪声和语音,噪声之间的相关性很小可以忽略,因此(8)式可以近似为:

()()X XX R m R m = (9)

可见语音的自相关序列的抗加性噪声性能要优于原始语音信号.

本文的LPCC 特征矢量取14维,加上差分倒谱参数,一共28维.

2.3矢量量化

矢量量化(Vector Quantization ,VQ )是一种极其重要的信号压缩方法,广泛应用于图像信号压缩、语音信号压缩等领域. 在语音信号数字处理的许多重要研究课题中,特别是低速语音编译码器和语音识别的研究中,VQ 都起着非常重要的作用. 对于小词

汇量的语音识别系统,一般都要求能实时实现,而系统的资源相当有限,采用VQ 技术来压缩数据存储量是一种常用的减轻系统负荷的方法.

码本的搜索是矢量量化中一个重要的环节,如果采用全搜索的方式,其运算量相当大,成为系统的瓶颈之一. 本文采用的方法是近邻划分算法[6].

近邻划分算法的思想很简单,如果已经知道待量化变量X 与某个码字A 较近,并不需要计算X 与每个码字的距离才能找到与X 最近的码字,而只需要计算X 与A 的相邻码字,找出离X 更近的码字B ,以此类推,因为每次码字都比上一次离X 近,因此肯定可以找到离X 最近的码字.

进行码本训练时,需要对码字执行近邻划分. 首先对码字进行标量量化. 设码本01127[,,,]Y Y Y Y =L ,计算码字i Y (0,1,,127i =L )各维数值之和i ∑,以i ∑为基准将码字

进行降序排列,并记录i ∑. 然后确定各码字的邻接码字. 对于任意码字i Y ,计算与码本

中其他码字的距离(,)l i d Y Y ,0~127,l l i =≠,若j Y 与i Y 距离最小,即

((,))arg min l i l

j d Y Y = (10)

则将i Y 划分为j Y 的邻接码字. 对每个码字执行这一操作,即可确定所有码字的邻接码字.

量化矢量时,按如下步骤进行搜索.

1) 确定初始码字并设其标号为l . 计算待量化矢量X 各维数值之和∑,若j Y 是使

得j ∑与∑距离最小的码字,即满足:

(||)arg min j i

j =∑?∑ (11)

则j Y 为初始码字. 因为码本已经按照i ∑进行降序排列,因此搜索初始码字可以采用二分法等快速算法.

2) 计算输入矢量X 与l Y 的距离(,)l d X Y .

3) 计算X 与l Y 所有邻接码字之间的距离,如果失真都大于(,)l d X Y ,那么l Y 就是

所求的最佳码字. 搜索结束.

4) 如果在l Y 所有邻接码字中有一个k Y ,它与X 的距离小于(,)l d X Y ,那么以k Y 为

初始码字,转入步骤3继续搜索.

近邻划分大大增加了训练码本的运算量. 容量为128的码本,执行近邻划分需128127/28128×=次求距离运算,对于28维的特征矢量,每次求距离运算需要执行28次乘法运算,则近邻划分给训练码本的过程增加了812828227584×=次乘法运算. 这是一个巨大的数字. 但在实际应用过程中,码本训练的过程仅需一次,而识别过程却被反复使用,因此增加训练过程的运算量来减少识别过程的运算量是合适的.

2.4 隐含马尔可夫模型HMM

HMM 是于上世纪80年代引入语音识别领域的. 用HMM 描述语音信号的产生是语音信号数字处理技术的一项重大进展. 目前比较成功的语音识别系统大都基于HMM 模型.

HMM 模型可以分为离散HMM(DHMM)、连续HMM(CDHMM)和半连续HMM(SCHMM). DHMM 运算量最小,且对于训练量不够充分时,其识别率优于后两

者. 因此本文采用DHMM 实现识别系统.

一个HMM 模型可由初始概率分布π、状态转移矩阵A 及输出概率矩阵B 决定. 其训练方法是Baum-Welch 参数重估算法,识别方法一般采用Viterbi 算法[1][7].

为了防止由于训练数据不够,使得一些出现概率较小的事件估值为零,可以对训练后得到的B 矩阵的每一个元素ij b 设置最低阈值. 即:

b b b b ij ij ij ij =>≤???

εεε (12) 实验表明[7],修正因子ε在1.0×1010-~1.0×310-这样宽的变化范围内,系统误识率的变化很小.

在实际应用过程中,计算前后向概率容易出现下溢问题. 每一次递推都将乘以小于1甚至远小于1的数,因此,每当n 增加1,前后向概率都有明显减小,而在实际语音处理过程中训练序列Y 的长度可以达到50~100,甚至更大,这使得前后向概率在递推的最后阶段都变得非常小,以致超出计算动态范围的下限. 解决下溢问题一般的途径是将前后向概率乘以一个合适的放大因子,其修正方法为[1]:

1.计算修正前向概率?()n l α

和放大因子n φ. 111()()l l l l a b αα==%,

1~l L = (13) 11

?()[()]L

n n il ln i l i A b αα+==∑%g ,

1~l L =,2~n N = (14) 11[()]L n n l l φα?==∑%,

1~n N = (15) ?()()n n n l l αφα=%,1~n N = (16)

2.计算修正后向概率?()n

l β. ?()N N

l βφ=,1~l L = (17) 1(1)1??(){()}L

n n n li i n i l i A b βφβ++==∑ (18)

在进行HMM 参数重估计算时,直接可以用修正后的前后向概率?()n l α和?()n

l β代替原始前后向概率()n l α和()n l β计算.

引入放大因子的做法虽然可以比较圆满的解决递推过程中的下溢问题,但是不可避免的带来了大量的计算量. 考虑到实时语音处理系统大多是在定点DSP 上实现,可以根据定点DSP 的特点寻找出更直接的方法.

引起下溢问题的原因究其根本是动态范围不够. PC 上高级语言中双精度浮点数的动态范围一般为3083081.710~1.710?××,用64bit 存放,其中10bit 用来存放指数. 而定点DSP 上大动态浮点数的指数和尾数是分别存放的. 如果采用指数16bit 、尾数16bit 的方法存放浮点数,则可表示的数值范围可达986498641.410~1.410?××. 在不额外增加计算量和存储量的情况下,可以处理相当长的语音序列而不发生下溢现象. 如果需要进一步提高数值的动态范围,只需要增加指数的表示位即可.

值得注意的是,在计算机上虽然也可以采用增加指数表示位的方法来处理下溢问题,但是因为要处理加法的对齐问题,因此并不能比乘以放大因子的方法节省运算量. 对于定点DSP ,因为本身处理浮点数也必须用分离尾指数和对齐相加的方法,因此使用增加指数表示位的方法要理想得多.

3 仿真实验与结论

本文使用了一个包含10人20个汉字孤立字发音的语音库来测试系统的性能,库中语音采样率为8000Hz,量化精度为16bit线性量化,录音背景为普通办公室环境. 测试时语音分测试语音和训练语音两部分,测试语音与训练语音没有交集. 最终系统识别率为93.0%.

为了测试系统的抗噪声性能,本文以直接使用原始语音信号的识别系统作为原系统,以使用单边自相关序列的识别系统作为增强系统,对比了两者在不同信噪比下的性能表现。结果如图3所示,其中所加噪声为加性高斯白噪声。

图3 原系统和增强系统识别性能比较

从实验结果可以得出如下结论:

1) 识别率基本达到预计要求,但本文组成的系统结构比较简单,还有提高的余地

和必要;

2) 在高信噪比下,原系统和增强系统识别率相近,因此采用自相关信号代替原始

语音信号并没有降低系统在安静状态下的性能;

3) 增强系统的识别率曲线比原系统平坦,有效的提高了系统在低信噪比环境下的

性能,系统鲁棒性有所提高;

4) 增强系统在低信噪比环境下的识别率仍然不理想。这是因为噪声不可能完全不

相关,因此采用单边自相关序列有一定局限性.

综上所述,本文实现的小词汇量语音识别系统有以下特点:

1) 采用基于帧的VUS算法进行端点判别,提高了实时性并保有了VUS算法原有

的运算量小的特点.

2) 用单边自相关序列代替原始语音序列,提高了系统的抗噪性.

3) 使用近邻划分方法搜索码本,用分离存储尾数和指数的方法解决下溢问题,减

小了系统的运算量.

参考文献

1.杨行峻,迟惠生. 语音数字信号处理. 北京:电子工业出版社,1995. 26~27,62~85,129~160

2.E. S. Dermatas. Fast Endpoint detection algorithm for isolated Word Recognition in office Environment. ICASSP, 1991:733~736

3.李虎生,刘加,刘润生. 高性能汉语数码语音识别算法. 清华大学学报(自然科学版),2000,40(1):32~34

4.陈尚勤,罗承烈,杨雪. 近代语音识别. 成都:电子科技大学出版社,1991. 54~55,33~34

5.S. B. Davis, P. Mermelstein. Comparison of parametric representations for monosyllabic word recognition in continuously spoken sentences. IEEE Trans. on Audio, Speech

Signal Processing , 1980, 28:357~366

6.R. L. Joshi. A New MMSE Encoding Algorithm for Vector Quantization. Proceeding ICASSP, 1991, 1:645~648

7.L. R. Rabiner, S. E. Levinson, M. M. Sondi. On the application of vector quantization and Hidden Markov Models to speaker-independent, isolated word

recognition. Bell System Technique Journal, 1983, 62(4):1075~1103

Realization of Small V ocabulary Speech Recognition System

Xu Xiaodan, Yin Fuliang

(Signal and Information Processing, Dept. Electronic and Information, Dalian Univ. of

Technology)

Abstract: Small vocabulary speech recognition system is the speech recognition system whose vocabulary volume is less than 100. Reducing system complexity and operating system real-timely are the

key points and the difficulties in research. This paper realizes a small vocabulary speech recognition

system in C language, and improves the real-time and anti-noise character base on analyzing each part of

the algorithm.

Key word: endpoint detector, feature extraction, vector quantization, hidden Markov model

1.什么是MSP 移动互联网已迅速成为当今世界发展最快、规模最大和市场前景最好的行业,已吸引众多知名IT公司进军该领域。由于现有移动终端设备交互方式存在诸多局限,如键盘太小,输入文字不便;屏幕太小,阅读信息不便;以及无法处理特定场景下的交互,如开车和步行情形。语音技术是人机交互最自然的方式,可以给以上缺陷提供完美的解决方法,移动互联网对语音技术有着天然的需求。 科大讯飞拥有全球领先的中文智能语音技术,多年来一直致力于研发将语音技术应用到千家万户,MSP(iFLY Mobile Speech Platform)便在此背景下诞生。通过MSP,移动互联网的终端用户可以随时随地的使用语音服务。语音技术带来品质生活,始终是MSP团队所坚持不懈的理念。 1.1主要功能 iFLY Mobile Speech Platform(以下简称MSP)是一个应用于移动互联网的语音服务平台,其主要目标是: 1) 实现可面向移动2G/3G网络及互联网提供语音服务的服务器,在现有科大讯飞电信级语音服务平台ISP基础上为移动终端应用程序提供多路并发的语音合成、语音识别、语音听写功能,通过架设在互联网的语音应用服务器,用户可以随时随地获得高质量的语音服务; 2) 实现基于移动终端以及桌面平台的语音应用客户端,提供统一的语音应用开发接口,通过该接口用户可以方便、快速地开发语音应用;同时,MSP也将开放一些基于移动以及桌面平台的语音应用,用于展示MSP语音服务平台的功能和使用方法,让用户直接体验到最新的语音技术; MSP最终提供了架构于互联网的语音云服务和一套移动互联网语音解决方案、应用示例,把语音服务的应用范围拓宽到移动互联网领域,为语音服务产品走向移动互联网市场开辟全新的应用模式。 MSP平台整合了科大讯飞研究院、中国科技大学讯飞语音实验室以及清华大学讯飞语音实验室在语音识别、语音合成等技术上多年的技术成果,语音核心技术上达到了国际领先水平。 MSP系统采用分布式架构,继承了科大讯飞成熟的电信级语音平台高稳定的特点,可以满足电信级应用的高可靠性、高可用性要求。针对传统语音应用集成开发困难,业务设计繁琐的问题,MSP产品大大简化了集成开发和业务开发的复杂度,为系统集成人员和业务开发人员提供了便捷、高效的开发环境。 1.2语音技术介绍 语音是智能人机交互的最直接最便捷的手段,近些年来,语音正在日益影响和改变人们的日常生活。随着移动互联网时代的到来,移动终端由于本身输入手段的限制,语音技术带来的交互优势更加明显,可以大大提高移动终端的交互体验和交互效率。智能语音技术包含语音识别和语音合成技术,这两个技术使得终端具备了能听会说的能力。 语音识别(Auto Speech Recognize,ASR)技术,是让机器通过识别和理解过程使之听懂人类语言的技术。语音识别技术是信息技术中人机交互的关键技术,目前已经在呼叫中心、电信增值业务、企业信息化系统中有了广泛的应用。随着语音识别在语音搜索、语音控制等全新应用领域的深入应用,语音识别技术被业界权威人士誉为有可能引发人机界面领域革命的关键技术。自动语音识别技术所要解决的问题是让计算机能够“听懂”人类的语音,将语音中包含的文字信息“提取”出来。ASR技术在“能听会说”的智能计算机系统中扮演着重要角色,相当于给计算机系统安装上“耳朵”,使其具备“能听”的功能,进而实现信息时代利用“语音”这一最自然、最便捷的手段进行人机通信和交互。 语音合成(Text To Speech,TTS)技术能够自动将任意文字实时转换为连续的自然语音,是一种能够在任何时间、任何地点,向任何人提供语音信息服务的高效便捷手段,非常符合信息时代海量数据、动态更新和个性化查询的需求。 近年来,语音识别、语音合成等语音技术取得了长足的进步,科大讯飞语音技术历经20年不懈创新,自90年代中期以来,在历次的国内国外评测中,各项关键指标均名列第一。MSP移动语音平台是科大讯飞针对日益丰富多样的移动互联网应用需求,向移动互联网推出“即开即有、按需取用”的语音服务能力,为快速构建各种各样移动语音应用程序提供强大、稳定、易用的互联网动力引擎。 1.3系统架构 MSP讯飞语音云平台采用基于互联网的C/S架构,基本拓扑结构如下图:

最近想做语音识别玩玩,网上查了查,找到一个用Atmega32实现的语音识别机械车 地址是:https://www.doczj.com/doc/d72678258.html,/e ... h8_css34/index.html 貌似是利用带通滤波取得频谱(或者叫功率谱?),看不太懂.我决定用DFT 算法,因为它节约内存 DFT程序借借鉴了 hendry 单片机 DTMF 软解码算法的实现 https://www.doczj.com/doc/d72678258.html,/forum.php?m ... &highlight=dtmf //-------------------------------------------------- //DFT运算 //注意,ad是有符号数,无符号的AD值需减128 //返回值为1表示已经计算了功率谱 //-------------------------------------------------- U8 dft(S8 ad) { U8 i; U8 offset;//查表指针 U32 temp; //ad-=128;//去直流分量 for(i=0;i

语音识别技术综述

语音识别技术综述 电子信息工程2010级1班郭珊珊 【摘要】随着计算机处理能力的迅速提高,语音识别技术得到了飞速发展,该技术的发展和应用改变了人们的生产和生活方式,正逐步成为计算机处理技术中的关键技术。语音技术的应用已经成为一个具有竞争性的新兴高技术产业。 【关键词】语音识别;语音识别原理;语音识别发展;产品 语音识别是以语音为研究对象,通过语音信号处理和模式识别让机器人自动识别和理解人类口述的语言。语音识别技术就是让机器通过识别和理解过程把语音信号转变为相应的命令或文本的高新技术。 1 语音识别的原理 语音识别系统本质是一种模式识别系统,包括特征提取、模式匹配、参考模式库等三个基本单位元。未知语音经过话筒变换成电信号后加载识

别系统的输入端,首先经过预处理,再根据人的语音特点建立语音模型,对输入的语音信号进行分析,并抽取所需特征,在此基础上建立语音识别所需的模板。 计算机在识别过程中要根据语音识别的模型,将计算机中存放的语音模板与输入的语音信号的特征进行比较,根据一定的搜索和匹配策略,找出一系列最优的与输入语音匹配的模板。然后根据此模板的定义,通过查表可给出计算机的识别结果。这种最优的结果与特征的选择、语音模型的好坏、模板是否准确都有直接的关系。 2 语音识别系统的分类 语音识别系统可以根据对输入语音的限制加以分类。 2.1从说话者与识别系统的相关性考虑 可以将识别系统分为3类:(1)特定人语音识别系统:仅考虑对于专人的话音进行识别;(2)非特定人语音系统:识别的语音与人无关,通常要用大量不同人的语音数据库对识

别系统进行学习;(3)多人的识别系统:通常能识别一组人的语音,或者成为特定组语音识别系统,该系统仅要求对要识别的那组人的语音进行训练。 2.2从说话的方式考虑 也可以将识别系统分为3类:(1)孤立词语音识别系统:孤立词识别系统要求输入每个词后要停顿;(2)连接词语音识别系统:连接词输入系统要求对每个词都清楚发音,一些连音现象开始出现;(3)连续语音识别系统:连续语音输入是自然流利的连续语音输入,大量连音和变音会出现。 2.3从识别系统的词汇量大小考虑 也可以将识别系统分为3类:(1)小词汇量语音识别系统。通常包括几十个词的语音识别系统。(2)中等词汇量的语音识别系统。通常包括几百个词到上千个词的识别系统。(3)大词汇量语音识别系统。通常包括几千到几万个词的语音识别系统。随着计算机与数字信号处理器运算能力以及识别系统精度的提高,识别

matlab语音识别系统(源代码)最新版

目录 一、设计任务及要求 (1) 二、语音识别的简单介绍 2.1语者识别的概念 (2) 2.2特征参数的提取 (3) 2.3用矢量量化聚类法生成码本 (3) 2.4VQ的说话人识别 (4) 三、算法程序分析 3.1函数关系 (4) 3.2代码说明 (5) 3.2.1函数mfcc (5) 3.2.2函数disteu (5) 3.2.3函数vqlbg (6) 3.2.4函数test (6) 3.2.5函数testDB (7) 3.2.6 函数train (8) 3.2.7函数melfb (8) 四、演示分析 (9) 五、心得体会 (11) 附:GUI程序代码 (12)

一、设计任务及要求 用MATLAB实现简单的语音识别功能; 具体设计要求如下: 用MATLAB实现简单的数字1~9的语音识别功能。 二、语音识别的简单介绍 基于VQ的说话人识别系统,矢量量化起着双重作用。在训练阶段,把每一个说话者所提取的特征参数进行分类,产生不同码字所组成的码本。在识别(匹配)阶段,我们用VQ方法计算平均失真测度(本系统在计算距离d时,采用欧氏距离测度),从而判断说话人是谁。 语音识别系统结构框图如图1所示。 图1 语音识别系统结构框图 2.1语者识别的概念 语者识别就是根据说话人的语音信号来判别说话人的身份。语音是人的自然属性之一,由于说话人发音器官的生理差异以及后天形成的行为差异,每个人的语音都带有强烈的个人色彩,这就使得通过分析语音信号来识别说话人成为可能。用语音来鉴别说话人的身份有着许多独特的优点,如语音是人的固有的特征,不会丢失或遗忘;语音信号的采集方便,系统设备成本低;利用电话网络还可实现远程客户服务等。因此,近几年来,说话人识别越来越多的受到人们的重视。与其他生物识别技术如指纹识别、手形识别等相比较,说话人识别不仅使用方便,而且属于非接触性,容易被用户接受,并且在已有的各种生物特征识别技术中,是唯一可以用作远程验证的识别技术。因此,说话人识别的应用前景非常广泛:今天,说话人识别技术已经关系到多学科的研究领域,不同领域中的进步都对说话人识别的发展做出了贡献。说话人识别技术是集声学、语言学、计算机、信息处理和人工智能等诸多领域的一项综合技术,应用需求将十分广阔。在吃力语音信号的时候如何提取信号中关键的成分尤为重要。语音信号的特征参数的好坏直接导致了辨别的准确性。

关于语音识别的研究 网络工程专业网络C071班贾鸿姗 076040 摘要:语音识别技术的广泛应用 1前言: 语音识别技术也被称为自动语音识别 (ASR),其目标是将人类的语音中的词汇内容转换为计算机可读的输入,例如按键、二进制编码或者字符序列。与说话人识别及说话人确认不同,后者尝试识别或确认发出语音的说话人而非其中所包含的词汇内容。语音识别是一门交叉学科。近二十年来,语音识别技术取得显著进步,开始从实验室走向市场。人们预计,未来10年内,语音识别技术将进入工业、家电、通信、汽车电子、医疗、家庭服务、消费电子产品等各个领域。语音识别技术所涉及的领域包括:信号处理、模式识别、概率论和信息论、发声机理和听觉机理、人工智能等等。 早在计算机发明之前,自动语音识别的设想就已经被提上了议事日程,早期的声码器可被视作语音识别及合成的雏形。而1920年代生产的"Radio Rex"玩具狗可能是最早的语音识别器,当这只狗的名字被呼唤的时候,它能够从底座上弹出来。最早的基于电子计算机的语音识别系统是由AT&T 贝尔实验室开发的Audrey语音识别系统,它能够识别10个英文数字。其识别方法是跟踪语音中的共振峰。该系统得到了98%的正确率。。到1950年代末,伦敦学院(Colledge of London)的Denes 已经将语法概率加入语音识别中。 1960年代,人工神经网络被引入了语音识别。这一时代的两大突破是线性预测编码Linear Predictive Coding (LPC),及动态时间弯折Dynamic Time Warp技术。 语音识别技术的最重大突破是隐含马尔科夫模型Hidden Markov Model的应用。从Baum提出相关数学推理,经过Labiner等人的研究,卡内基梅隆大学的李开复最终实现了第一个基于隐马尔科夫模型的大词汇量语音识别系统Sphinx。。此后严格来说语音识别技术并没有脱离HMM框架。 尽管多年来研究人员一直尝试将“听写机”推广,语音识别技术在目前还无法支持无限领域,无限说话人的听写机应用。 2 正文 2.1应用领域 2.1.1.电话通信的语音拨号 特别是在中、高档移动电话上,现已普遍的具有语音拨号的功能。随着语音识别芯片的价格降低,普通电话上也将具备语音拨号的功能。 2.1.2.汽车的语音控制 由于在汽车的行驶过程中,驾驶员的手必须放在方向盘上,因此在汽车上拨打电话,需要使用具有语音拨号功能的免提电话通信方式。此外,对汽车的卫星导航定位系统(GPS)的操作,汽车空调、照明以及音响等设备的操作,同样也可以由语音来方便的控制。 工业控制及医疗领域。当操作人员的眼或手已经被占用的情况下,在增加控制操作时,最好的办法就是增加人与机器的语音交互界面。由语音对机器发出命令,机器用语音做出应答。 2.1.3数字助理 个人数字助理(Personal Digital Assistant,PDA)的语音交互界面。PDA的体积很小,人机界面一直是其应用和技术的瓶颈之一。由于在PDA上使用键盘非常不便,因此,现多采用手写体识别的方法输入和查询信息。但是,这种方法仍然让用户感到很不方便。现在业界一致认为,PDA的最佳人机交互界面是以语音作为传输介质的交互方法,并且已有少量应用。随着语音识别技术的提高,可以预见,在不久的将来,语音将成为PDA主要的人机交互界面。 智能玩具 通过语音识别技术,我们可以与智能娃娃对话,可以用语音对玩具发出命令,让其完成一些简单的任务,甚至可以制造具有语音锁功能的电子看门狗。智能玩具有很大的市场潜力,而其关键在

基于单片机的语音识别系统毕业设计 目录 摘要..................................... 错误!未定义书签。Abstract ................................. 错误!未定义书签。目录..................................................... I 前言.. (1) 1 方案介绍及设计简介 (2) 1.1小车的控制要求及设计方案 (2) 1.1.1小车的控制要求 (2) 1.1.2方案设计与论证 (2) 1.2SPCE061A 简介 (3) 1.2.1SPCE061A单片机概述 (5) 1.2.2SPCE061A的介绍 (7) 1.2.3SPCE061A的结构 (7) 1.3SPCE061A 单片机强大的语音功能 (7) 1.3.1语音识别的原理 (8) 1.3.2系统的结构框图 (9) 1.4语音控制小车设计要求 (10) 1.4.1功能要求 (10) 1.4.2语音控制小车的主要功能 (10) 1.4.3参数说明 (10) 1.4.4注意事项 (10) 2电路设计及程序设计 (11) 2.1电路设计基础知识 (11) 2.2电路方框图及说明 (13) 2.3各部分电路设计 (13) 2.3.1电机的选择 (14)

2.3.2继电器驱动电路的设计 (14) 2.3.3行驶状态控制电路设计 (15) 2.3.4麦克录音输入及AGC电路 (16) 2.3.5语音播报电路 (18) 3软件设计 (19) 3.1软件流程图及设计思路说明 (19) 3.1.1程序设计 (20) 3.2模块设计 (20) 3.2.1中断流程图部分 (20) 3.2.2语音识别部分 (22) 4连接和操作说明 (25) 4.1硬件模块连接图 (25) 4.1.1功能说明 (25) 4.1.2代码下载 (26) 4.1.3训练小车 (27) 4.1.4声控小车 (28) 4.1.5重新训练 (28) 总结 (30) 致谢 (31) 参考文献 (32) 附件1 系统程序说明 (33)

目前主流的语音识别技术是基于统计模式识别的基本理论。一个完整的语音识别系统可大致分为三部分: (1)语音特征提取: (2)声学模型与模式匹配(识别算法) (3)语义理解:计算机对识别结果进行语法、语义分析。 语音识别技术,也被称为自动语音识别Automatic Speech Recognition,(ASR), 语音识别的发展简史 1952年AT& T Bell实验室实现了一个单一发音人孤立发音的十个英文数字的语音识别系统,到现在的人机语音交互。语音识别研究从二十世纪50年代开始到现在历半个多世纪的蓬勃发展,在这期间获得了巨大的进展。 现代语音识别技术研究重点包括即兴口语的识别和理解,自然口语对话,以及多语种的语音同声翻译。 语音识别应用的特点 1.语音识别系统必须覆盖的功能包括: (1)语音识别系统要对用户有益(希望它是能检测到的)。例如提高生产率,容易使用,更好的人机界面,或更自然的信息交流模式。 (2)语音识别系统要对用户“友好”。这种“友好”的含义是:用户在和系统进行语音对话时感到舒适;系统的语音提示既有帮助,又很亲近。 (3)语音识别系统必须有足够的精度 (4)语音识别系统要有实时处理能力;例如系统对用户询问的响应时间要很短。 2. 语音识别错误的处理 有以下四种方式可以处理这个问题。 (1)错误弱化法。这种处理仅仅花费用户很少一点时间,对用户几乎没什么其它不利影响。 (2)错误自检纠正法 系统利用已知任务的限制自动地检测并纠正错误。 (3)确认或多层次判定

(4)拒绝/转向人工座席。系统对其中通常较易导致系统识别错误的极少部分语音指令拒绝做出识别决定,而是将其转给人工座席。 在很多情况下,语音识别技术可以充分发挥出RFID的潜能: 1.积压产品、脱销产品 2.被废弃、被召回或已过期产品 3.回收的商品 4.促销产品 RFID系统在利用原有语音导向投资的情况下可以大大增加收益 语音识别技术在邮件分拣中的应用 现代化分拣设备在邮政上的应用大大提高了邮件处理的效率。但是,并不是所有的邮件都能上分拣机处理,那些需要人工处理的邮件成了邮政企业实现自动化的瓶颈。邮政使用人工标码技术以及先进的计算机软件 系统来处理不能上机的邮件,仍需要大量的劳动力。 由MailCode公司开发并准备申请专利的Spell-ItTM软件技术通过提高系统数据库能力的方式对语音识别自动化设备进行了革命性的变革。这种技术提供了无限的数据库能力,并且保证分拣速度不会因数据库的增大而减小。由各大语音引擎公司开发的系统还支持世界上的各种主要语言,这样,语音技术就成为世界性的产品。 以英语语音识别系统为例,系统建立了36个可识别字符26个字母加上0~9的10个数字,同时还建立了一套关键词。Spell-It软件使用这些字符来识别成千上万的口语词汇和无数的词语组合。 对于大公司的邮件收发中心来说,使用MailCode公司的Spell-It软件技术,分拣员实际上只需发出几个字符的音来找到和数据库中相对应的词。例如:碰到了寄给Joseph Schneider的邮件,操作员只需发出“J”、“S”、“C”和“H”几个音就可以得到准确的分拣信息。 姓名和邮箱编码:Jennifer Schroeder, 软件工程部;Joseph Schneider, 技术操作部;Josh Schriver, 技术操作部,因为这三个姓名全都符合(J,S,C,H)的发音标准。邮件中心的操作员知道邮件实际上是寄给Joseph Schneider的,就可以把邮件投入Joseph Schneide的信箱了。 邮局要把邮件按投递路线分发,分拣员必须熟悉长长的投递段列表以及各种各样的国际邮件投递信息。Spell-It技术把地址、投递路线等信息都存入了系统,这样就大大方便了分拣工作。 例如,有一件寄往Stonehollow 路2036号的邮件。使用语音识别技术,分拣员仅仅需要发出“2”、“0”、“S”、“T”和“O”几个音,如表2所示,数据库就会给出所有可能和这几

内蒙古科技大学 本科生毕业设计说明书(毕业论文) 题目:基于语音识别的家居智能监控系统 学生姓名: 学号: 专业:测控技术与仪器 班级: 指导教师:

基于语音识别的家居智能监控系统 摘要 智能家居系统大体而言可分为高层的信息娱乐网络和底层的数据采集与网络控制,在底层以微控制器为核心作为智能家居网络结点是目前智能家居的主要实现方式,语音识别技术在我国的研究成果也不是很高,但是用语音识别技术来与家居智能控制相结合是非常创新的。 本设计是采用AT89C52单片机为核心控制器的智能家居监控系统,系统通过无线nrf905作为信息传输媒介,将语音识别软件收到的具体指令发送至现场对单片机进行控制,从而控制家居的动作;同时现场单片机将数据通过无线发送至主控单片机,通过PC 界面实时监控家居各模块的运行状态。 该系统的功能模块分为:语音控制窗帘模块、温度检测模块、火焰检测模块和防盗报警模块。通过C#编程,在Microsoft Speech SDK的基础上实现对家具的智能监控,在PC机界面上直观的看到家居所有情况。 关键字:单片机;语音识别;nrf905;温度检测;防盗报警

Speech recognition-based smart home monitoring system Abstaract Generally speaking the smart home system can be divided into high-level information and entertainment network,the underlying data collection and network control in the bottom to the microcontroller as the core as a smart home network node,this is the main achievement of smart home way,the speech recognition technology inour research is not very high,but the voice recognition technology to the home intelligent combination of the control is very innovative. The design is using AT89S52 MCU core controller intelligent home monitoring system,the system through wireless nrf905 as information transmission medium,that specific instructions received by the voice recognition software is sent to the scene to control the MCU to control the actions of home;at the same time the scene SCM data through the wireless sent to the host microcontroller,real-time monitoring via a PC interface home run of the module state. The functional modules of the system is divided into,the voice control the curtains module temperature detection module,the flame detection module,and burglar alarm module. On the basis of the Microsoft Speech SDK,C # Programming,intelligent monitoring of the furniture intuitive interface of the PC,see the home in all cases. Keywords: SCM;speech recognition;nrf905;temperature detection;burglar alarm

语音识别系统调研报告 姓名:罗小嘉学号:2801305018 1、摘要:本文简要的介绍了语音识别系统的原理,发展和在各个方面的应用前景。 2、关键词:语音识别;应用 3、引言:语音识别主要是指用机器在各种情况下,根据信息执行人的各种意图,有效地了解、识别语音和其它声音。它是近十几年来发展起来的具有理论价值和实用价值的新兴学科:从计算机大学科角度看,可视为智能计算机的智能接口;从信息处理学科来看,可视为信息识别的一个重要分支;从自动控制学科来看,又可视为模式识别的一个重要组成部分. 早在18 世纪,人们就对语音学进行了科学研究,但由于各种条件的限制,语音识别仅在计算机技术迅速发展之后,才成为一个非常活跃的研究领域. 60 年代末期,面对语音识别的种种困难,人们开始研究特定人、孤立词、小词汇量的识别,从而使语音识别的问题能够在当时的条件下得以开展;70年代后期,特定人、孤立词、小词汇量的语音识别取得较为满意的效果,语音识别的研究则沿着特定人向非特定人、孤立词向连续词、小词汇量向大词汇量方向扩展研究领域和目标;80 年代中期以来,计算机技术、信息技术及模式识别等技术的迅猛发展,极大地促进了语音识别技术的发展. 4、正文:语音识别系统要求能够实现实时语音识别。该语音识别系统的关键技术主要是语言实时识别技术、语音端点检测与声韵分割。如图: 对于语音端点检测与声韵分割的问题,从背景噪声中找出语音的开始和终止,这在语音处理中是很基本的问题,因为准确的端点检测,不仅可以提高识别精度,还可以避免计算噪声,减少计算量. 大多数语音处理系统采用过零率和能量两参数作端点检测. 但过零率受噪声影响较大,采用多门限过零率作语音起点检测,将能量信息直接反应在门限中,同时将分析窗长取小,使起点检测比较准确,效果较好. 语音识别技术的应用可以分为两个发展方向:一个方向是大词汇

BMW中文声控系统 声控启动语音控制支持方言专车专用 宝马中文声控系统市场前景 在庞大的汽车销量的基础上,车载语音系统已成为现代汽车的重要亮点之一,但是由于技术的局限性,国内车载语音系统的发展始终比较缓慢,在国外广泛发展的车载语音控制系统在国内却处于技术空白阶段。现在,Qdis-isods让这种情况得到了根本性的改变。 qdis品牌联合众多院校精英,由多名各领域资深人士参与研发,根据中国市场特点以及中国用户使用习惯进行特殊定制,成功推出Qdis-isods系列产品,为广大车主提供车载语音控制的解决方案和专业服务。加载Qdis-isods车载语音系统后,用户用自己的声音即可完成相关操作,而不再只是使用传统的指定命令。 Qdis-isods系列产品支持中国多种方言,声音识别准确率高并支持多人识别,一举攻克了之前的技术难题,让车载语音系统全面进入中国市场。以前需要手动操作的控制,现在您和爱车直接对话就能实现,而且还能语音识别并控制后装增配的产品,满足客户多种智能语音操作的需求。随着车联网技术的发展,汽车的互联性会越来越强,我们可以把语音技术扩展到除终端和嵌入式系统以外的所有设备上,从而完成更复杂的识别控制任务。我们依然在不断创新实践,以谋求更多的成功案例。 Qdis-isods车载语音系统可以完美支持各类车型,金鼓德达将以一贯优秀的无损加装技术,让您在驾驶生活中发现更多乐趣。QDIS-ISODS系列,爱车从此智能! 一、BMW中文声控系统主要功能 1.语音识别启动引擎 语音指令随时学习,支持所有方言,指令内容可以自由定义; 不影响原车启动键启动功能; 可以同时利用方向盘按键组合为密码启动; 语言指令和方向盘密码可以任意修改; 2.语音指令控制原车 语音指令随时学习,支持所有方言,指令内容可以自由定义;

语音识别芯片所涉及的技术包括:信号处理、模式识别、概率论和信息论、发声机理和听觉机理、人工智能等等。 语音识别分类 按照使用者的限制而言,语音识别芯片可以分为特定人语音识别芯片和非特定人语音识别芯片。 特定人语音识别芯片是针对指定人的语音识别,其他人的话不识别,须先把使用者的语音参考样本存入当成比对的资料库,即特定人语音识别在使用前必须要进行语音训练,一般按照机器提示训练2遍语音词条即可使用。 非特定人语音识别是不用针对指定的人的识别技术,不分年龄、性别,只要说相同语言就可以,应用模式是在产品定型前按照确定的十几个语音交互词条,采集200人左右的声音样本,经过PC算法处理得到交互词条的语音模型和特征数据库,然后烧录到芯片上。应用这种芯片的机器(智能娃娃、电子宠物、儿童电脑)就具有交互功能了。 非特定人语音识别应用有的是基于音素的算法,这种模式下不需要采集很多人的声音样本就可以做交互识别,但是缺点是识别率不高,识别性能不稳定。 语音识别基本原理 嵌入式语音识别系统都采用了模式匹配的原理。录入的语音信号首先经过预处理,包括语音信号的采样、反混叠滤波、语音增强,接下来是特征提取,用以从语音信号波形中提取一组或几组能够描述语音信号特征的参数。特征提取之后的数据一般分为两个步骤,第一步是系统"学习"或"训练"阶段,这一阶段的任务是构建参考模式库,词表中每个词对应一个参考模式,它由这个词重复发音多遍,再经特征提取和某种训练中得到。第二是"识别"或"测试"阶段,按照一定的准则求取待测语音特征参数和语音信息与模式库中相应模板之间的失真测度,最匹配的就是识别结果。 语音识别四大平台 1、科大讯飞 科大讯飞股份有限公司成立于1999年,是一家专业从事智能语音及语言技术、人工智能技术研究,软件及芯片产品开发,语音信息服务及电子政务系统集成的国家级骨干软件企业。2008年,科大讯飞在深圳证券交易所挂牌上市,股票代码:002230。 11月23日科大讯飞轮值总裁胡郁在发布会上引述了罗永浩在9 月锤子发布会上的演示数据,表示科大讯飞的语音输入识别成功率也达到了97%,即使是离线识别准确率也达到了95%。 2、云知声 云知声成立于2012年6月。之前1年,Siri的发布再度唤醒了大家对语音识别的关注。经过四年多的积累,云知声的合作伙伴数量超过2万家,覆盖用户超过1.8亿,其中语音云平台覆盖城市超过470个,覆盖设备超过9000万台。 3、百度 百度则在11月22日宣布向开发者开放了情感合成、远场方案、唤醒二期和长语音方案等四项语音识别技术。百度语音开放平台自2013 年10 月上线以来每日在线语音识别请求已经达到了1.4 亿次,开发者数量超过14 万。在如此庞大的数据支撑下,百度语音在“安静条件下”的识别准确率达到了97%。4、搜狗 搜狗语音团队在11 月21 日推出了自己的语音实时翻译技术。搜狗的这项技术主要包括两个方面,分别是语音识别和机器翻译。根据该团队的介绍,搜狗语音识别的准确率达到了97%,支持最快400 字每秒的听写。 语音识别芯片原厂及芯片方案 1、ICRoute 总部:上海 简介:ICRoute专注于开拓语音识别的芯片市场,致力于研发出高性能的语音识别,语音处理芯片。为各种平台的电子产品提供VUI(Voice User Interface)语音人机交互界面。目前提供的语音识别芯片,可以在

用单片机实现语音控制机器人 制作人:潘磊pb02023035 卢恒pb02006088 题目:用凌阳单片机实现语音识别功能并传递给PIC单片机信号,由PIC单片机控制机器人实现动作 关键字:PIC单片机,凌阳单片机,语音控制 单片机在现今生活中占有越来越重要的地位,用语音控制单片机实现控制更具有 广泛的应用价值。用语音控制舞蹈机器人做一些动作是我们这次实现的功能,虽然这 在语音控制方面仍处于起步阶段,但他体现了语音控制的原理和基本实现,也为更高 级的运用打下了基础。 原理: 1.语音识别原理 语音识别电路基本结构如上图所示:语音识别分为特定发音人识别(Speaker Dependent)和非特定发音人识别(Speaker Independent)两种方式。 特定发音人识别是指语音样板由单个人训练,对训练人的语音命令识别准确率较高,而其他人的语音命令识别准确率较低或不识别。非特定发音人识别:是指语音样板由不同年龄、不同性别、不同口音的人进行训练,可以识别一群人的命令。语音样板的提取非常重要。我们将标准模式的存储空间称之为“词库”,而把标准模式称之为“词条”或“样板”。所谓建立词库,就是将待识别的命令进行频谱分析,提取特征参数作为识别的标准模式。 识别过程首先要滤除输入语音信号的噪音和进行预加重处理,提升高频分量,然后用线性预测系数等方法进行频谱分析,找出语音的特征参数作为未知模式,接着与预先存储的标准模式进行比较,当输入的未知模式与标准模式的特征相一致时,便被机器识别,产生识别结果输出。如果输入的语音与标准模式的特征完全一致固然好,但是语音含有不确定因素,完全一致的条件往往不存在,事实上没有人能以绝对相同的语调把一个词说两遍,因此,预先制定好计算输入语音的特征模式与各特征模式的类似程度,或距离度的算法规则固化在ROM

信息学院 《人工智能及其应用》课程论文题目:基于神经网络的语音信号识别 作者黄超班级自动08-1BF班 系别信息学院专业自动化 完成时间 2011.6.12

基于神经网络的语音信号识别 摘要 语言是人类之间交流信息的主要手段之一,自电脑发明以来,人们就一直致力于使电 脑能够理解自然语言。语音识别技术是集声学、语音学、语言学、计算机、信息处理和人工 智能等诸领域的一项综合技术,应用需求十分广阔,长期以来一直是人们研究的热点。 神经网络是在现代科学研究成果的基础上提出来的模拟人脑结构机制的一门新兴科 学,它模拟了人类神经元活动的原理,具有自学习、联想、对比、推理和概括能力,为很好 地解决语音识别这样一个复杂的模式分类问题提供了新的途径。 本文针时语音识别的特点.对BP神经网络在语音识别技术中的应用进行了探索性研究, 进而结合人工智能领域较为有效的方法——遗传(GA)算法。针对传统BP算法识别准确率高 但训练速度慢的缺点,对BP网络进行改进,构建了一种基于遗传神经网络的语音识别算法(GABP),并建立相应的语音识别系统。仿真实验表明,该算法有效地缩短了识别时问,提 高了网络训练速度和语音的识别率。 关键词:语音识别,神经网络,遗传算法,遗传神经网络,BP网络 THE RSREARCH OF SPEECH RECOGNITION BASED ON THE NEURAL NETWORK ABSTRACT Language is one of the most important means of exchanging information among the mankind.Since the computer was invented,many scientists have been devoted to enabling the computer to understand the natural language.Speech recognition is a comprehensive technology of such areas as acoustics,phonetics,linguistics,computer science,information processing and artificial intelligence,which can be used widely.The research of speech recognition technology has been focused by the world for a long time.The neural network is a new developing science,which simulates the mechanism of human brain and was putted forward by the developing of modern science.It is not the overall description of human brain,but the abstract,simulation and simplifying of the physical neural networks of human beings. The purpose of the research in this area is exploring the human brain mechanisms in information processing,storing and searching.If people can understand these mechanisms,a new way for the research of artificial intelligence,information processing and etc.

基于语音识别技术的智能家居控制系统的 设计 基于语音辨认技术的智能家居控制系统的设计摘要 21 世纪经济快速发展,人们对物资文化的需求也愈来愈高。在信息科技的支持下,事物在朝着简单化、便捷化、智能化的方向发展。在此背景下应运而生而生的智能家居,正是信息时期的典型产物。 本文设计了1套基于语音辨认技术的智能家居控制系统,能够在客户端输入语音信号,完成对家居装备的控制,使得家居装备更加智能化。本文首先对语音辨认的相干理论知识进行了详细的论述,利用麻省理工学院(Massachusetts Institute of Technology, MIT)语音服务器完成对语音信号的特点提取和辨认进程,并且该服务器内有自动的高频噪声滤波器,避免声音信号产生失真现象。其次Zigbee模块完成了数据传输的功能,能够在网络拓扑较为稳定的家 居环境中实现对数据的传输,消耗的功率下降,本钱也较低。最后基于安卓手机到达控制家具的目的,在手机客户端输入语音信号以后,服务器将翻译出来的语音信息传递给后台,由手机通过无线网络传递给家居装备,从而到达传递控制指令的目的。最后本文在测试阶段对本文设计的基于语音辨认技术的智能家居控制系统进行了性能测试,测试结果良好,能够到达预期的目标。 关键词:智能家居;语音辨认;控制系统 Abstract With the rapid development of the economy in the 21st century, people's demand for material culture is also increasing. With the support of information technology, things are developing in the direction of simplification, convenience and intelligence. The smart home that emerged in this context is

摘要 随着科学技术水平的不断提高,社会文明的不断进步,人类对生活质量的追求也越来越高。智能手机的兴起,使终端应用成为高新技术的发展平台.苹果公司的Siri将语音识别技术投入到智能手机中,引发了人机交互语音识别技术的热潮。语音是人类相互交流中最直接有效的沟通方式,与键盘,鼠标这些输入设备相比,语音是最自然的输入方式。从上世纪五十年代开始,到现在语音识别技术有了长足的发展,移动终端设备的发展迫使人们把语音识别实验室技术引入到生活中。 本系统基于科大讯飞的MSC,采取面向对象的的方法,以统一建模语言(UML)为分析设计语言,对系统进行分析与设计。通过设计Android语音助手,旨在帮助用户更好的与机器交互,并且通过使用“语音“这个生活中直接存在的交流沟通方式来帮助用户改善生活方式和习惯,让用户拥有一个可对话的语音助手。本系统针对可行性研究,需求分析,概要设计,详细设计以及系统测试等情况进行了详细介绍。通过合理的模块划分,该系统实现了语音语义识别模块,播放音乐模块,打电话、发短信模块,地图模块,查询模块,语音合成模块。系统明确了各模块的分工,降低了各模块之间的耦合度,提高模块间的沟通效率。 关键词:语音识别、Android、人机交互、面向对象

Abstract With the development of science and technology, the continuous progress of social civilization, people’s pursuit to life quality is higher and higher. The rise of intelligent mobile phone makes terminal applications become a platform for high-tech. For example, the Siri of Apple applies speech recognition technology to intelligent mobile phones, which has triggered the boom of human-computer interaction speech recognition technology. Compared with such input devices as keyboard and mouse, voice is the most direct and effective communication way and the most natural input way. Speech recognition technology has been developed a lot since the 50s of last century. Also, with the development of mobile terminal devices, laboratory speech recognition technology has been introduced to daily life. Based on the MSC of iFLYTEK, this system is analyzed and designed through object-oriented method with unified modeling language (UML). The Android speech assistant is aimed to help users for better human-computer interaction and to improve users’ lifestyles and habits through voice—the direct communication way in our life. It allows users to have a communicable speech assistant. This system introduces such cases as feasibility study, requirement analysis, preliminary design, detailed design and system test in detail. Through reasonable module division, it reduces the coupling degree and improves the communication efficiency among modules with clear module division by implementing speech and semantic recognition module, music-play module, phone-call and SMS module, map module, query module and speech synthesis module. Keywords: speech recognition, android, human-computer interaction, object-oriented