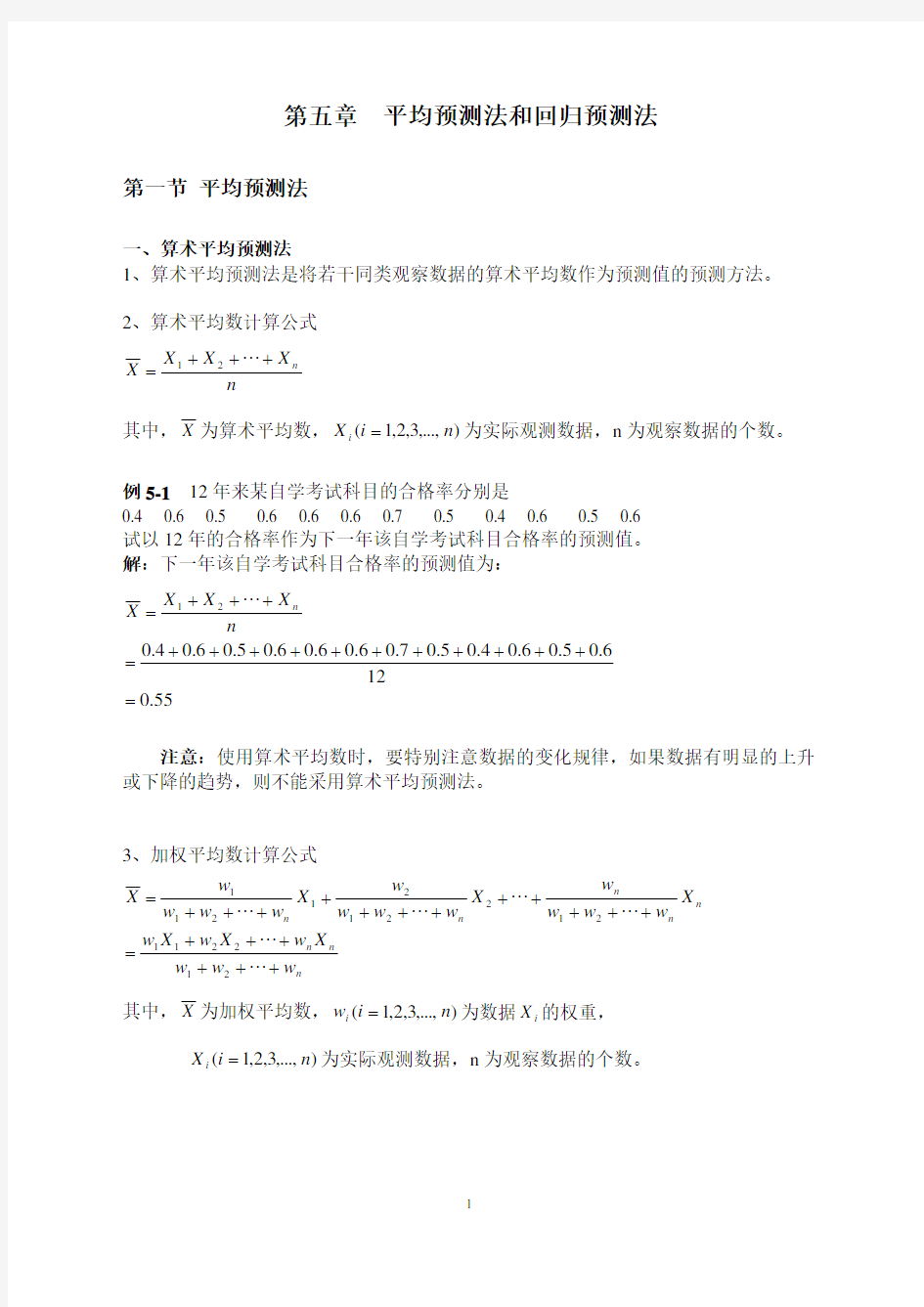

第五章 平均预测法和回归预测法

第一节 平均预测法

一、算术平均预测法

1、算术平均预测法是将若干同类观察数据的算术平均数作为预测值的预测方法。

2、算术平均数计算公式

n

X X X X n

+++=

21

其中,X 为算术平均数,),...,3,2,1(n i X i =为实际观测数据,n 为观察数据的个数。

例5-1 12年来某自学考试科目的合格率分别是

0.4 0.6 0.5 0.6 0.6 0.6 0.7 0.5 0.4 0.6 0.5 0.6 试以12年的合格率作为下一年该自学考试科目合格率的预测值。 解:下一年该自学考试科目合格率的预测值为:

55.012

6.05.06.04.05.0

7.06.06.06.05.06.04.021=+++++++++++=+++=

n

X X X X n

注意:使用算术平均数时,要特别注意数据的变化规律,如果数据有明显的上升或下降的趋势,则不能采用算术平均预测法。

3、加权平均数计算公式

n

n

n n

n

n n n w w w X w X w X w X w w w w X w w w w X w w w w X ++++++=++++++++++++=

21221

1212212

1211

其中,X 为加权平均数,),...,3,2,1(n i w i =为数据i X 的权重,

),...,3,2,1(n i X i =为实际观测数据,n 为观察数据的个数。

例5-2 6年来有一自学考试科目的合格率分别是

0.20 0.35 0.25 0.30 0.40 0.35 它们的权重分别为0.1 0.1 0.15 0.15 0.2 0.3 求:6年来该自考科目合格率的加权平均数。 解:6年来该自考科目合格率的加权平均数为:

3225.03

.02.015.015.01.01.035

.03.04.02.03.015.025.015.035.01.02.01.0212211=+++++?+?+?+?+?+?=

++++++=n

n

n w w w X w X w X w X

注意:在加权平均数的计算中,权数通常是由有关专家根据掌握的预测对象的本质规律和经验确定的,权数的确定是否合适,直接关系到加权平均的结果,因此权数的选取应该认真对待。

二、移动平均预测法

1、移动平均预测法

在平均间隔不变情况下,每次后移一位求相应间隔平均数,并根据此平均数列的变化规律来进行预测的方法,称为移动平均预测法。

2、移动平均数的计算公式:

K

X X X X k t t t 1

1+--+++=

其中,X 为t 时期的移动平均数,),...,3,2,1(n i X i =为第i 时期的观测数据,

t 表示时间序列的时期序号;k 表示选取的时间间隔。

例5-3 表5-1的第三栏是某校1986-1999年在校学生人数,试计算间隔三年、五年的移动平均数数列。

第二节 指数平滑预测法

一、指数平滑预测法的意义

加权平均数中的权重大小按时间由近到远逐步递减排序,当权重系数按照指数规律递减时,这种加权平均预测法称为指数平滑预测法。

二、一次指数平滑预测法

一次指数平滑预测法的计算公式:

0111)1()1()1()1(Y Y Y Y S t t t t t ααααααα-+-++-+=-- (5-5)

其中:)1(t S 代表第t 个时点的一次指数平滑值; t Y 代表第t 个时点的实际值;

α代表平滑系数,其取值范围为10<<α; 通常情况下,用实际值0Y 作为初始指数平滑值)1(0S ; 由(5-5)可得公式:)

1(1)

1()1(--+=t t t S Y S αα (5-6)

在(5-6)中t 时的一次指数平滑值)1(t S 作为t+1时点的预测值1

?+t Y , 就得到一次指数平滑预测模型公式:

)1(1

1)1(?-+-+=t t t S Y Y αα (5-7)

用t 时点的预测值t Y ?代替)1(1-t S ,可得如下公式:

)?(??)1(?1t

t t t t t Y Y Y Y Y Y -+=-+=+ααα (5-8)

例5-4 取平滑系数值为0.1,0.5,0.9,考察指数平滑值的情况。

注:(1)平滑系数α的作用:不同平滑系数α的值,对预测效果的影响有明显的差异。平滑系数α的值越小,其平滑功能越强。在实际选取平滑系数α的值时,需要考虑历史数据的特征以及预测误差的大小。

(2)如何选取平滑系数α的值?

如果得用直观方法选择平滑系数α的值时,那么,当时间序列的变化比较稳定时,应该取较小的α值;如果历史的数据的增减变化幅度较大时,则应取较大的α值。

如果采用统计比较方法来选取α值时,则需要计算不同的α值的预测误差,取综合误差较小的α值。

估计综合预测误差,可采用如下公式

n

Y Y

AD n

t t

t

∑=-=

?

其中:AD 代表平均预测误差;n 代表预测值的个数;

t Y 代表t 时点的实际值;t

Y ?代表t 时点的预测值。

25413

1300

160010101200100011001.0=-++-+-=

AD

10213

1618

160010501200100011005.0=-++-+-=

AD

8513

1689

160010901200100011009.0=-++-+-=

AD

因为9.05.01.0AD AD AD >>,所以取9.0=α比较合适。

第三节 回归预测法

一、回归预测法的意义

回归预测法是通过建立回归模型来实现预测对象的预测方法。回归预测分为线性回归预测和非线性回归预测。

二、散点图

什么是散点图?有什么优点?

三、一元线性回归方程

1、回归直线方程形式如:X b b Y 1

0?+=

称为一元线性回归方程。

2、利用最小二乘法求出系数0b 和1b 。计算公式如下:

∑∑∑∑====--=

n

i i

n

i i

n

i i

n

i i

i X X X

Y X Y X b 1

1211

1

X

b Y b 10-=

3、检验Y 与X 的线性关系的近似程度,可采用相关系数检验、t 检验、F 检验等方法。

下面介绍相关系数检验法。

(1)积差相关系数的计算公式:

2

1

1

221

1

21

1

1

)()(∑∑∑∑∑∑∑=======---=

n

i i n i i n i i n i i n

i i

n i i i n i i Y Y n X X n Y X Y X n r

其中:i X ,i Y 为两组数据,n 为数据对的数目,

(2)检验:取检验水平α,一般地取α=0.05或0.01; 自由度df=n-2,查积差相关系数表,得α)(df r ; 若α)(df r r >,则X 与Y 相关密切,达显著水平,否则相关不显著。

例5-5 根据资料,求因变量大学毛入率Y 关于自变量年人均教育经费X 的一元线性回归方程。并检验线性回归方程是否可用。

(2)计算回归系数:

0005

.000

.26727.2476632287

.027.241364.61

1

2111=?-?-=

--=

∑∑∑∑====n

i i

n

i i

n

i i

n i i i X X X

Y

X Y X b

0087

.027.240005.00208.010=?-=-=X b Y b

(3)建立回归方程

X Y

0005.00087.0?+=

(4)检验:

91

.02287

.00051.0112677663112287

.02671364.611)()

(2

2

2

1

1

22

1

1

21

1

1

=-?-??-?=

---=

∑∑∑∑∑∑∑=======n

i i n i i n

i i n i i

n

i i

n

i i i n

i i Y Y n X X n Y X Y X n r

自由度df=n-1=11-2=9,查相关系数表,得735.0)9(01.0=r

因为)9(01.0735.091.0r r

=>=,所以认为Y 与X 之间存在

显著的一元线性回归关系。可以使用回归方程:X Y

0005.00087.0?+=

多元线性回归分析预测法 (重定向自多元线性回归预测法) 多元线性回归分析预测法(Multi factor line regression method,多元线性回归分析法) [编辑] 多元线性回归分析预测法概述 在市场的经济活动中,经常会遇到某一市场现象的发展和变化取决于几个影响因素的情况,也就是一个因变量和几个自变量有依存关系的情况。而且有时几个影响因素主次难以区分,或者有的因素虽属次要,但也不能略去其作用。例如,某一商品的销售量既与人口的增长变化有关,也与商品价格变化有关。这时采用一元回归分析预测法进行预测是难以奏效的,需要采用多元回归分析预测法。 多元回归分析预测法,是指通过对两上或两个以上的自变量与一个因变量的相关分析,建立预测模型进行预测的方法。当自变量与因变量之间存在线性关系时,称为多元线性回归分析。 [编辑] 多元线性回归的计算模型[1] 一元线性回归是一个主要影响因素作为自变量来解释因变量的变化,在现实问题研究中,因变量的变化往往受几个重要因素的影响,此时就需要用两个或两个以上的影响因素作为自变量来解释

因变量的变化,这就是多元回归亦称多重回归。当多个自变量与因变量之间是线性关系时,所进行的回归分析就是多元性回归。 设y为因变量,为自变量,并且自变量与因变量之间为线性关系时,则多元线性回归模型为: 其中,b0为常数项,为回归系数,b1为固定时,x1每增加一 个单位对y的效应,即x1对y的偏回归系数;同理b2为固定时,x2每增加一个单位对y的效应,即,x2对y的偏回归系数,等等。如果两个自变量x1,x2同一个因变量y呈线相关时,可用二元线性回归模型描述为: 其中,b0为常数项,为回归系数,b1为固定时,x2每增加一 个单位对y的效应,即x2对y的偏回归系数,等等。如果两个自变量x1,x2同一个因变量y呈线相关时,可用二元线性回归模型描述为: y = b0 + b1x1 + b2x2 + e 建立多元性回归模型时,为了保证回归模型具有优良的解释能力和预测效果,应首先注意自变量的选择,其准则是: (1)自变量对因变量必须有显著的影响,并呈密切的线性相关; (2)自变量与因变量之间的线性相关必须是真实的,而不是形式上的; (3)自变量之彰应具有一定的互斥性,即自变量之彰的相关程度不应高于自变量与因变量之因的相关程度; (4)自变量应具有完整的统计数据,其预测值容易确定。 多元性回归模型的参数估计,同一元线性回归方程一样,也是在要求误差平方和()为最小的前提下,用最小二乘法求解参数。以二线性回归模型为例,求解回归参数的标准方程组为 解此方程可求得b0,b1,b2的数值。亦可用下列矩阵法求得

MATLAB---回归预测模型 Matlab统计工具箱用命令regress实现多元线性回归,用的方法是最小二乘法,用法是:b=regress(Y,X) [b,bint,r,rint,stats]=regress(Y,X,alpha) Y,X为提供的X和Y数组,alpha为显着性水平(缺省时设定为0.05),b,bint为回归系数估计值和它们的置信区间,r,rint为残差(向量)及其置信区间,stats是用于检验回归模型的统计量,有四个数值,第一个是R2,第二个是F,第三个是与F对应的概率 p ,p <α拒绝 H0,回归模型成立,第四个是残差的方差 s2 。 残差及其置信区间可以用 rcoplot(r,rint)画图。 例1合金的强度y与其中的碳含量x有比较密切的关系,今从生产中收集了一批数据如下表 1。 先画出散点图如下: x=0.1:0.01:0.18; y=[42,41.5,45.0,45.5,45.0,47.5,49.0,55.0,50.0]; plot(x,y,'+') 可知 y 与 x 大致上为线性关系。 设回归模型为y =β 0+β 1 x

用regress 和rcoplot 编程如下: clc,clear x1=[0.1:0.01:0.18]'; y=[42,41.5,45.0,45.5,45.0,47.5,49.0,55.0,50.0]'; x=[ones(9,1),x1]; [b,bint,r,rint,stats]=regress(y,x); b,bint,stats,rcoplot(r,rint) 得到 b =27.4722 137.5000 bint =18.6851 36.2594 75.7755 199.2245 stats =0.7985 27.7469 0.0012 4.0883 即β 0=27.4722 β 1 =137.5000 β 的置信区间是[18.6851,36.2594], β 1 的置信区间是[75.7755,199.2245]; R2= 0.7985 , F = 27.7469 , p = 0.0012 , s2 =4.0883 。可知模型(41)成立。

y1 1 x11 x12 x1p 0 1 3.1 y2 1 x21 x22 x2p 1 + 2 即y=x + yn 1 xn1 xn2 xnp p n 基本假定 (1) 解释变量x1,x2…,xp 是确定性变量,不是随机变量,且要求 rank(X)=p+1 n 注 tr(H) h 1 3.4不能断定这个方程一定很理想,因为样本决定系数与回归方程中 自变量的数目以及样本量n 有关,当样本量个数n 太小,而自变量又较 多,使样本量与自变量的个数接近时, R 2易接近1,其中隐藏一些虚 假成分。 3.5当接受H o 时,认定在给定的显著性水平 下,自变量x1,x2, xp 对因变量y 无显著影响,于是通过x1,x2, xp 去推断y 也就无多大意 义,在这种情况下,一方面可能这个问题本来应该用非线性模型去描 述,而误用了线性模型,使得自变量对因变量无显著影响;另一方面 可能是在考虑自变量时,把影响因变量y 的自变量漏掉了,可以重新 考虑建模问题。 当拒绝H o 时,我们也不能过于相信这个检验,认为这个回归模型 已经完美了,当拒绝H o 时,我们只能认为这个模型在一定程度上说明 了自变量x1,x2, xp 与自变量y 的线性关系,这时仍不能排除排除我 们漏掉了一些重要的自变量。 3.6中心化经验回归方程的常数项为0,回归方程只包含p 个参数估计 值1, 2, p 比一般的经验回归方程减少了一个未知参数,在变量较 SSE (y y)2 e12 e22 1 2 1 E( ) E( - SSE* - n p 1 n p n 2 [D(e) (E(e ))2 ] 1 n (1 1 n 2 en n E( e 1 1 n p 1 1 n p 1 1 "1 1 n p 1 J (n D(e) 1 (p 1)) 1_ p 1 1 1 n p 1 2 2 n E(e 2 ) (1 h ) 2 1 第一节一元线性回归分析预测法 一、概念(思路) 根据预测变量(因变量)Y和影响因素(自变量)X的历史统计数据,建立一元线性回归方程,然后代入X的预测值,求出Y的预测值的方法。 基本公式:y=a+bx 其中:a、b为回归系数,是未知参数。 基本思路: 1、利用X,Y的历史统计数据,求出合理的回归系数:a、b,确 定出回归方程 2、根据预计的自变量x的取值,求出因变量y的预测值。 二、一元线性回归方程的建立 1、使用散点图定性判断变量间是否存在线性关系 例:某地区民航运输总周转量和该地区社会总产值由密切相关关系。 2、使用最小二乘法确定回归系数 使实际值与理论值误差平方和最小的参数取值。 对应于自变量x i,预测值(理论值)为b+m*x i,实际值y i, min∑(y i-b-mx i)2,求a、b的值。 使用微积分中求极值的方法,得: 由下列方程代表的直线的最小二乘拟合直线的参数公式: 其中 m 代表斜率,b 代表截距。 一元线性回归.xls 三、回归方程的显著性检验 判断X、Y之间是否确有线性关系,判定回归方程是否有意义。 有两类检验方法:相关系数检验法和方差分析法 1、相关系数检验法 构造统计量r 相关系数的取值范围为:[-1,1],|r|的大小反映了两个变量间线性关系的密切程度,利用它可以判断两个变量间的关系是否可以用直线方程表示。 两个变量是否存在线性相关关系的定量判断规则: 对于给定的置信水平α,从相关系数临界值表中查出r临(n-2),把其与用样本计算出来的统计量r0比较: 若|r0|〉r临(n-2)成立,则认为X、Y之间存在线性关系,回归方程在α水平上显著。差异越大,线性关系越好。反之则认为不显著,回归方程无意义,变量间不存在线性关系。 其中:n为样本数。 2、方差分析法: 方差分析的基本特点是把因变量的总变动平方和分为两部分,一部分反映因变量的实际值与用回归方程计算出的理论值之差,一部分反映理论值与实际值的平均值之差。 Y的总变差=Y的残余变差+Y的说明变差,SST=SSE+SSR 或:总离差平方和=剩余平方和+回归平方和 回归平方和U与剩余平方和Q相比越大,说明回归效果越好。 一元回归分析 在数学关系式中只描述了一个变量与另一个变量之间的数量变化关系,则称其为一元回归分析。 其回归模型为 y 称为因变量,x称为自变量,称为随机误差,a,b 称为待估计的回归参数,下标i表示第i个观测值。 如果给出a和b的估计量分别为,,则经验回归方程: 一般把称为残差,残差可视为扰动的“估计量”。 例子: 湖北省汉阳县历年越冬代二化螟发蛾盛期与当年三月上旬平均气温的数据如表1-1,分析三月上旬平均温度与越冬代二化螟发蛾盛期的关系。 表1-1 三月上旬平均温度与越冬代二化螟发蛾盛期的情况表 数据保存在“DATA6-1.SAV”文件中。 1)准备分析数据 在数据编辑窗口中输入数据。建立因变量历期“历期” 在SPSS数据编辑窗口中,创建“年份”、“温度”和“发蛾盛期”变量,并把数据输入相应的变量中。或者打开已存在的数据文件“DATA6-1.SAV”。 2)启动线性回归过程 单击SPSS主菜单的“Analyze”下的“Regression”中“Linear”项,将打开如图1-1所示的线性回归过程窗口。 图1-1 线性回归对话窗口 3) 设置分析变量 设置因变量:本例为“发蛾盛期”变量,用鼠标选中左边变量列表中的“发蛾盛期”变量,然后点击“Dependent”栏左边的向右拉按钮,该变量就自动调入“Dependent”显示栏里。 设置自变量:选择一个变量作为自变量进入“Independent(S)”框中。用鼠标选中左边变量列表中的“温度”变量,然后点击“Independent(S)”栏左边的向右拉按钮,该变量就自动调入“Independent(S)”显示栏里。 注:SPSS中一元回归和多元回归以及多元逐步回归都是使用同一过程,所以该栏可以输入多个自变量。 设置控制变量 “Selection Variable”为控制变量输入栏。控制变量相当于过滤变量,即必须当该变量的值满足设置的条件时,观测量才 最小平方法在回归分析和趋势预测中的应用 最小平方法,又称最小二乘法。其方法的计算依据是利用算术平均数的数学性质,在我们介绍算术平均数的数学性质时,有两条性质分别是:一、各个变量值与平均数的离差之和等于零,用表达式表示即0)(=-∑x x ;二、各个变量值与平均数的离差平方之和为最小值,用表达式表示为最小值 =-∑2 ) (x x 。这两条数学性质已证明过,我们把它们应用到 回归分析和趋势预测中来。回归分析和时间序列趋势预测中,主要是为求得回归方程或趋势方程,但在求得方程的参数时,就要用到上面的两条数学性质。 最小平方法的数学依据是实际值(观察值)与理论值(趋势值)的离差平方和为最小。据此来拟合回归方程或趋势方程。 1、利用最小平方法拟合直线回归方程 拟合直线回归方程的主要问题就在于估计待定参数a 和b 之值,而用最小平方法求出的回归直线是原有资料的“最佳”拟合直线。 假设直线回归方程为:bx a y c +=,其中a 是直线的截距,b 是直线的斜率,称回归系数。a 和b 都是待定参数。将给定的自变量x 之值代入上述方程中,可求出估计的因变量 y 之值。这个估计值不是一个确定的数值,而是y 许多可能取值的平均数,所以用c y 表示。当x 取某一个值时,y 有多个可能值。因此,将给定的x 值代入方程后得出的c y 值,只能 看作是一种平均数或期望值。配合直线方程的具体方法如下: ∑=-= 最小值 2 )(c y y Q (1) 用直线方程bx a y c +=代入式(1)得: 最小值 =--= ∑2 ) (bx a y Q (2) 分别求Q 关于a 和Q 关于b 的偏导,并令它们等于0: ?????=---=??=---=??∑∑0 ))((20)1)((2x bx a y b Q bx a y a Q 整理后得出由下列两个方程式所组成的标准方程组: ???+=+=∑∑∑∑∑2 x b x a xy x b na y (3) 根据已知的或样本的相应资料x 、y 值代入式(3),可求出a 和b 两个参数: 应用回归分析第三章习题 3.1 y x =β 基本假定: (1) 诸1234n x ,x x ,x x ……非随机变量,rank (x )=p+1,X 为满秩矩阵 (2) 误差项()()200i i j E ,i j cov ,,i j ?ε=? ?δ=?εε=??≠?? (3)()2 0i i j ~N ,,?εδ??εε??诸相互独立 3.2 ()10111 ?X X X X |rank(X X )p rank(X )p n p -'β'≠'=+≥+≥+存在,必须使存在。即|则必有故 3.3 ()()()() ()22 11 122 12 22211111111 n n n i i ii i i i n ii i n i i E e D e h n h n p ?E E e n p n p n p =====??==-δ ????? =-δ=--δ ??? ??∴δ ==--δ=δ ? ----??∑∑∑∑∑ 3.4 并不能这样武断地下结论。2 R 与回归方程中的自变量数目以及样本量n 有关,当样本量n 与自变量个数接近时,2 R 易接近1,其中隐含着一些虚假成分。因此,并不能仅凭很大的2 R 就模型的优劣程度。 3.5 首先,对回归方程的显著性进行整体上的检验——F 检验 001230p H :β=β=β=β==β=…… 接受原假设:在显著水平α下,表示随机变量y 与诸x 之间的关系由线性模型表示不合适 拒绝原假设:认为在显著性水平α下,y 与诸x 之间有显著的线性关系 第二,对单个自变量的回归系数进行显著性检验。 00i H :β= 接受原假设:认为i β=0,自变量i x 对y 的线性效果并不显著 3.6 原始数据由于自变量的单位往往不同,会给分析带来一定的困难;又由于设计的数据量较大,可能会以为舍入误差而使得计算结果并不理想。中心化和标准化回归系数有利于消除由于量纲不同、数量级不同带来的影响,避免不必要的误差。 3.7 11 22 011122201122p p p p p p p ?????y x x x ??????y y (x x )(x x )(x x )????y x x )x x )x x )y =β +β+β++β-=β+β-+β-++β--ββ=-+-++-=对最小二乘法求得一般回归方程: ……对方程进行如下运算: …… ……*j j ?+β=……即 3.8 121321233132212312212331 312311232332 13 231313********* 111 r r r r r r r r r r r r r r r r r r r r r ?? ?= ? ????==-?= =-?= =-即证 第3章回归预测方法 思考与练习(参考答案) 1.简要论述相关分析与回归分析的区别与联系。 答:相关分析与回归分析的主要区别: (1)相关分析的任务是确定两个变量之间相关的方向和密切程度。回归分析的任务是寻找因变量对自变量依赖关系的数学表达式。 (2)相关分析中,两个变量要求都是随机变量,并且不必区分自变量和因变量;而回归分析中自变量是普通变量,因变量是随机变量,并且必须明确哪个是因变量,哪些是自变量; (3)相关分析中两变量是对等的,改变两者的地位,并不影响相关系数的数值,只有一个相关系数。而在回归分析中,改变两个变量的位置会得到两个不同的回归方程。 联系为: (1)相关分析是回归分析的基础和前提。只有在相关分析确定了变量之间存在一定相关关系的基础上建立的回归方程才有意义。 (2)回归分析是相关分析的继续和深化。只有建立了回归方程才能表明变量之间的依赖关系,并进一步进行预测。 2.某行业8个企业的产品销售额和销售利润资料如下: (1)计算产品销售额与利润额的相关系数; r=,说明销售额与利润额高度相关。 解:应用Excel软件数据分析功能求得相关系数0.9934 (2)建立以销售利润为因变量的一元线性回归模型,并对回归模型进行显着性检验(取α=); 解:应用Excel 软件数据分析功能求得回归方程的参数为: 7.273,0.074a b =-= 据此,建立的线性回归方程为 ?7.2730.074Y x =-+ ① 模型拟合优度的检验 由于相关系数0.9934r =,所以模型的拟合度高。 ② 回归方程的显着性检验 应用Excel 软件数据分析功能得0.05 ?=450.167(1,6) 5.99F F >=,说明在α=水平下回归效果显着. ③ 回归系数的显着性检验 0.025?=21.22(6) 2.447t t >=,说明在α=水平下回归效果显着. 实际上,一元线性回归模型由于自变量只有一个,因此回归方程的显着性检验与回归系数b 的 显着性检验是等价的。 (3)若企业产品销售额为500万元,试预测其销售利润。 根据建立的线性回归方程 ?7.2730.074Y x =-+,当销售额500x =时,销售利润?29.73Y =万元。 3.某公司下属企业的设备能力和劳动生产率的统计资料如下: 企业代号 1 2 3 4 5 6 7 8 9 10 11 12 13 14 设备能力 (千瓦/人) 劳动生产率(万元/人) 该公司现计划新建一家企业,设备能力为千瓦/人,试预测其劳动生产率,并求出 其95%的置信区间。 解:绘制散点图如下: 散点图近似一条直线,计算设备能力和劳动生产率的相关系数为,故可以采用线性回归模型进行拟合。 应用Excel 软件数据分析功能求得回归方程的参数为: 3.115, 1.43a b == 第三章 回归预测法 基本内容 一、一元线性回归预测法 是指成对的两个变量数据分布大体上呈直线趋势时,运用合适的参数估计方法,求出一元线性回归模型,然后根据自变量与因变量之间的关系,预测因变量的趋势。由于很多社会经济现象之间都存在相关关系,因此,一元线性回归预测具有很广泛的应用。进行一元线性回归预测时,必须选用合适的统计方法估计模型参数,并对模型及其参数进行统计检验。 1、建立模型 一元线性回归模型: i i i x b b y μ++=10 其中,0b ,1b 是未知参数,i μ为剩余残差项或称随机扰动项。 2、用最小二乘法进行参数的估计时,要求i μ满足一定的假设条件: ①i μ是一个随机变量; ②i μ的均值为零,即()0=i E μ; ③在每一个时期中,i μ的方差为常量,即()2 σμ=i D ; ④各个i μ相互独立; ⑤i μ与自变量无关; 3、参数估计 用最小二乘法进行参数估计,得到的0b ,1b 的公式为: ()()() ∑∑---= 2 1 x x y y x x b x b y b 10-= 4、进行检验 ①标准误差:估计值与因变量值间的平均平方误差。其计算公式为:()2 ?2 --= ∑n y y SE 。 ②可决系数:衡量自变量与因变量关系密切程度的指标,在0与1之间取值。其计算公式 为:()()()() ()()∑∑∑∑∑---=??? ??? ? ? ----=222 2 2 2 ?1y y y y y y x x y y x x R 。 ③相关系数;计算公式为:()()()() ∑∑∑----=2 2 y y x x y y x x r 。 ④回归系数显著性检验 i 检验假设:0:10=b H ,0:11≠b H 。 ii 检验统计量:b S b t 1 = ~()2-n t ,其中() ∑-=2 x x SE S b 。 iii 检验规则:给定显著性水平α,若αt t >,则回归系数显著。 ⑤回归模型的显著性检验 i 检验假设::0H 回归方程不显著 ,:1H 回归方程显著。 ii 检验统计量:()()() 2??2 2 ---= ∑∑n y y y y F ~()2,1-n F 。 iii 检验规则:给定显著性水平α,若()2,1->n F F α,则回归方程显著。 ⑥得宾—沃森统计量(D —W ):检验i μ之间是否存在自相关关系。 ()∑∑==--= -n i i n i i i W D 1 222 1μ μμ,其中i i i y y ?-=μ。 5、进行预测 小样本情况下,近似的置信区间的常用公式为:置信区间=tSE y ±?。 二、多元线性回归预测法 社会经济现象的变化往往受到多个因素的影响,因此,一般要进行多元回归分析,我们把包括两个或两个以上自变量的回归成为多元回归。多元回归与医院回归类似,可以用最小二乘法估计模型参数。也需对模型及模型参数进行统计检验。选择合适的自变量是正确进行多元回归预测的前提之一,多元回归模型自变量的选择可以利用变量之间的相关矩阵来解决。 1、 建立模型—以二元线性回归模型为例 二元线性回归模型:222110i i x b x b b y μ+++=。类似使用最小二乘法进行参数估计。 2、 拟合优度指标 ①标准误差:对y 值与模型估计值之间的离差的一种度量。其计算公式为: ()3 ?2 --= ∑n y y SE 第5章自变量选择与逐步回归 思考与练习参考答案 自变量选择对回归参数的估计有何影响 答:回归自变量的选择是建立回归模型得一个极为重要的问题。如果模型中丢掉了重要的自变量, 出现模型的设定偏误,这样模型容易出现异方差或自相关性,影响回归的效果;如果模型中增加了不必要的自变量, 或者数据质量很差的自变量, 不仅使得建模计算量增大, 自变量之间信息有重叠,而且得到的模型稳定性较差,影响回归模型的应用。 自变量选择对回归预测有何影响 答:当全模型(m元)正确采用选模型(p元)时,我们舍弃了m-p个自变量,回归系数的最小二乘估计是全模型相应参数的有偏估计,使得用选模型的预测是有偏的,但由于选模型的参数估计、预测残差和预测均方误差具有较小的方差,所以全模型正确而误用选模型有利有弊。当选模型(p元)正确采用全模型(m 元)时,全模型回归系数的最小二乘估计是相应参数的有偏估计,使得用模型的预测是有偏的,并且全模型的参数估计、预测残差和预测均方误差的方差都比选模型的大,所以回归自变量的选择应少而精。 如果所建模型主要用于预测,应该用哪个准则来衡量回归方程的优劣 C统计量达到最小的准则来衡量回答:如果所建模型主要用于预测,则应使用 p 归方程的优劣。 试述前进法的思想方法。 答:前进法的基本思想方法是:首先因变量Y对全部的自变量x1,x2,...,xm建立m 个一元线性回归方程, 并计算F检验值,选择偏回归平方和显着的变量(F值最大且大于临界值)进入回归方程。每一步只引入一个变量,同时建立m-1个二元线性回归方程,计算它们的F检验值,选择偏回归平方和显着的两变量变量(F 值最大且大于临界值)进入回归方程。在确定引入的两个自变量以后,再引入一个变量,建立m-2个三元线性回归方程,计算它们的F检验值,选择偏回归平方和显着的三个变量(F值最大)进入回归方程。不断重复这一过程,直到无法再引入新的自变量时,即所有未被引入的自变量的F检验值均小于F检验临界值 第5章参考答案 5.1 自变量选择对回归参数的估计有何影响? 答:回归自变量的选择是建立回归模型得一个极为重要的问题。如果模型中丢掉了重要的自变量, 出现模型的设定偏误,这样模型容易出现异方差或自相关性,影响回归的效果;如果模型中增加了不必要的自变量, 或者数据质量很差的自变量, 不仅使得建模计算量增大, 自变量之间信息有重叠,而且得到的模型稳定性较差,影响回归模型的应用。 5.2自变量选择对回归预测有何影响? 答:当全模型(m元)正确采用选模型(p元)时,我们舍弃了m-p个自变量,回归系数的最小二乘估计是全模型相应参数的有偏估计,使得用选模型的预测是有偏的,但由于选模型的参数估计、预测残差和预测均方误差具有较小的方差,所以全模型正确而误用选模型有利有弊。当选模型(p元)正确采用全模型(m 元)时,全模型回归系数的最小二乘估计是相应参数的有偏估计,使得用模型的预测是有偏的,并且全模型的参数估计、预测残差和预测均方误差的方差都比选模型的大,所以回归自变量的选择应少而精。 5.3 如果所建模型主要用于预测,应该用哪个准则来衡量回归方程的优劣? C统计量达到最小的准则来衡量回答:如果所建模型主要用于预测,则应使用 p 归方程的优劣。 5.4 试述前进法的思想方法。 答:前进法的基本思想方法是:首先因变量Y对全部的自变量x1,x2,...,xm建立m个一元线性回归方程, 并计算F检验值,选择偏回归平方和显著的变量(F值最大且大于临界值)进入回归方程。每一步只引入一个变量,同时建立m-1个二元线性回归方程,计算它们的F检验值,选择偏回归平方和显著的两变量变量(F值最大且大于临界值)进入回归方程。在确定引入的两个自变量以后,再引入一个变量,建立m-2个三元线性回归方程,计算它们的F检验值,选择偏回归平方和显著的三个变量(F值最大)进入回归方程。不断重复这一过程,直到无法再引入新的自变量时,即所有未被引入的自变量的F检验值均小于F检验临界值Fα(1,n-p-1),回归过程结束。 5.5 试述后退法的思想方法。 什么是回归分析预测法 回归分析预测法,是在分析市场现象自变量和因变量之间相关关系的基础上,建立变量之间的回归方程,并将回归方程作为预测模型,根据自变量在预测期的数量变化来预测因变量关系大多表现为相关关系,因此,回归分析预测法是一种重要的市场预测方法,当我们在对市场现象未来发展状况和水平进行预测时,如果能将影响市场预测对象的主要因素找到,并且能够取得其数量资料,就可以采用回归分析预测法进行预测。它是一种具体的、行之有效的、实用价值很高的常用市场预测方法。 [编辑] 回归分析预测法的分类 回归分析预测法有多种类型。依据相关关系中自变量的个数不同分类,可分为一元回归分析预测法和多元回归分析预测法。在一元回归分析预测法中,自变量只有一个,而在多元回归分析预测法中,自变量有两个以上。依据自变量和因变量之间的相关关系不同,可分为线性回归预测和非线性回归预测。 [编辑] 回归分析预测法的步骤 1.根据预测目标,确定自变量和因变量 明确预测的具体目标,也就确定了因变量。如预测具体目标是下一年度的销售量,那么销售量Y就是因变量。通过市场调查和查阅资料,寻找与预测目标的相关影响因素,即自变量,并从中选出主要的影响因素。 2.建立回归预测模型 依据自变量和因变量的历史统计资料进行计算,在此基础上建立回归分析方程,即回归分析预测模型。 3.进行相关分析 回归分析是对具有因果关系的影响因素(自变量)和预测对象(因变量)所进行的数理统计分析处理。只有当变量与因变量确实存在某种关系时,建立的回归方程才有意义。因此,作为自变量的因素与作为因变量的预测对象是否有关,相关程度如何,以及判断这种相关程度的把握性多大,就成为进行回归分析必须要解决的问题。进行相关分析,一般要求出相关关系,以相关系数的大小来判断自变量和因变量的相关的程度。 4.检验回归预测模型,计算预测误差 回归预测模型是否可用于实际预测,取决于对回归预测模型的检验和对预测误差的计算。回归方程只有通过各种检验,且预测误差较小,才能将回归方程作为预测模型进行预测。 5.计算并确定预测值 利用回归预测模型计算预测值,并对预测值进行综合分析,确定最后的预测值。[编辑] 应用回归预测法时应注意的问题 应用回归预测法时应首先确定变量之间是否存在相关关系。如果变量之间不存在相关关系,对这些变量应用回归预测法就会得出错误的结果。 正确应用回归分析预测时应注意: ①用定性分析判断现象之间的依存关系; ②避免回归预测的任意外推; 所属章节:第五章相关分析与回归分析 1■在线性相关中,若两个变量的变动方向相反,一个变量的数值增加,另一个变量数值随之减少,或一个变量的数值减少,另一个变量的数值随之增加,则称为()。 答案:负相关。干扰项:正相关。干扰项:完全相关。干扰项:非线性相关。 提示与解答:本题的正确答案为:负相关。 2■在线性相关中,若两个变量的变动方向相同,一个变量的数值增加,另一个变量数值随之增加,或一个变量的数值减少,另一个变量的数值随之减少,则称为()。 答案:正相关。干扰项:负相关。干扰项:完全相关。干扰项:非线性相关。 提示与解答:本题的正确答案为:正相关。 3■下面的陈述中哪一个是错误的()。 答案:相关系数不会取负值。干扰项:相关系数是度量两个变量之间线性关系强度的统计量。干扰项:相关系数是一个随机变量。干扰项:相关系数的绝对值不会大于1。 提示与解答:本题的正确答案为:相关系数不会取负值。 4■下面的陈述中哪一个是错误的()。 答案:回归分析中回归系数的显著性检验的原假设是:所检验的回归系数的真值不为0。 干扰项:相关系数显著性检验的原假设是:总体中两个变量不存在相关关系。 干扰项:回归分析中回归系数的显著性检验的原假设是:所检验的回归系数的真值为0。 干扰项:回归分析中多元线性回归方程的整体显著性检验的原假设是:自变量前的偏回归系数的真值同时为0。 提示与解答:本题的正确答案为:回归分析中回归系数的显著性检验的原假设是:所检验的回归系数的真值不为0。 5■根据你的判断,下面的相关系数值哪一个是错误的()。 答案:1.25。干扰项:-0.86。干扰项:0.78。干扰项:0。 提示与解答:本题的正确答案为:1.25。 6■下面关于相关系数的陈述中哪一个是错误的()。 答案:数值越大说明两个变量之间的关系越强,数值越小说明两个变量之间的关系越弱。 干扰项:仅仅是两个变量之间线性关系的一个度量,不能直接用于描述非线性关系。 干扰项:只是两个变量之间线性关系的一个度量,不一定意味着两个变量之间存在因果关系。 干扰项:绝对值不会大于1。 提示与解答:本题的正确答案为:数值越大说明两个变量之间的关系越强,数值越小说明两个变量之间的关系越弱。 7■如果相关系数r=0,则表明两个变量之间()。 答案:不存在线性相关关系。干扰项:相关程度很低。 干扰项:不存在任何关系。干扰项:存在非线性相关关系。 提示与解答:本题的正确答案为:不存在线性相关关系。 8■在线性回归模型中,随机误差项ε被假定服从()。 答案:正态分布。干扰项:二项分布。干扰项:指数分布。干扰项:t分布。 第十五章 SPSS回归分析与市场预测 市场营销活动中常常要用到市场预测。市场预测就是运用科学的方法,对影响市场供求变化的诸因素进行调查研究,分析和预见其发展趋势,掌握市场供求变化的规律,为经营决策提供可靠的依据。预测的目的是为了提高管理的科学水平,减少盲目的决策,通过预测来把握经济发展或者未来市场变化的有关动态,减少未来的不确定性,降低决策可能遇到的风险,进而使决策目标得以顺利实现。 回归分析是研究两个变量或多个变量之间因果关系的统计方法。其基本思想是,在相关分析的基础上,对具有相关关系的两个或多个变量之间数量变化的一般关系进行测定,确立一个合适的数学模型,以便从一个已知量来推断另一个未知量。 15.1 回归分析概述 相关回归分析预测法,是在分析市场现象自变量和因变量之间相关关系的基础上,建立变量之间的回归方程,并将回归方程作为预测模型,根据自变量在预测期的数量变化来预测因变量在预测期变化结果的预测方法。根据市场现象所存在的相关关系,对它进行定量分析,从而达到对市场现象进行预测的目的,就是相关回归分析市场预测法。 相关回归分析市场预测法的种类:根据相关关系中自变量不同分类,有以下几种主要类型:1、一元相关回归分析市场预测法,也称简单相关回归分析市场预测法。它是用相关回归分析法对一个自变量与一个因变量之间的相关关系进行分析,建立一元回归方程作为预测模型,对市场现象进行预测的方法。2、多元相关回归市场预测法,也称复相关回归分析市场预测法。它是用相关分析法对多个自变量与一个因变量之间的相关关系进行分析,建立多元回归方程作为预测模型,对市场现象进行预测的方法。 回归模型的建立步骤: 1)做出散点图,观察变量间的趋势。如果是多个变量,则还应当做出散点图矩阵、重叠散点图和三维散点图。 2)考察数据的分布,进行必要的预处理。即分析变量的正态性、方差齐等问题。并确定是否可以直接进行线性回归分析。如果进行了变量变换,则应当重新绘制散点图,以确保线性趋势在变换后任然存在。 第五章 回归分析 一、填空题 1、一元线性回归分析的数学模型为 。 2、多元线性回归模型=+Y βX ε中,β的最小二乘估计?β 的协方差矩阵?β Cov()=_______ . 解:1?σ-'2Cov(β)=()X X . 3、为了估计山上积雪溶化后对河流下游灌溉的影响,在山上建立观测站,测得连续10年的观测数据如下表(见表3)。 表3 最大积雪深度与灌溉面积的10年观测数据 则y 关于x 的线性回归模型为 答案: x y 813.1356.2?+= 4、多元线性回归模型=+Y βX ε中,β的最小二乘估计是?β= _______ . 解:1?-''X Y β= ()X X . 5、设由一组观测数据(i i y x ,)(i =1,2,…,n )计算得200,150==y x , 25)(1 2 =-=∑=n i i xx x x l ,∑==--=n i i i xy y y x x l 1 75))((则y 对x 的线性回归方程 为 . 二、简述题 1、回归分析是什么样的一种数学方法?它可以解决什么样的问题? 2、多元线性回归分析的数学模型是什么? 3、一元线性回归分析中检验变量之间有没有线性关系常用的方法有哪几个? 4、线性回归分析的主要内容及应用中注意的问题。 5、如何看待多元统计方法在实际数据处理中的作用与地位。 6、试简要论述线性回归分析包括哪些内容或步骤. 解:建立模型、参数估计、回归方程检验、回归系数检验、变量剔除、预测. 三、单选题 1、在一元回归分析中,判定系数定义为2T S R S = 回 ,则( ). A 2R 接近0时回归效果显著; B 2R 接近1时回归效果显著; C 2R 接近∞时回归效果显著; D 前述都不对. 2、在回归分析中,t 检验主要是用来检验( ) A.回归系数的显著性 B.线性关系的显著性 C.相关系数的显著性 D.估计标准误差的显著性 3、设有一组观测数据(x i ,y i ),i =1,2,…,n ,其散点图呈线性趋势,若要拟合一 元线性回归方程x y 1 0???ββ+=,且n i x y i i ,,2,1,???10 =+=ββ,则估计参数β0,β1时应使( ) A .∑=-n i i i y y 1)(最小 B .∑=-n i i i y y 1)(最大 C .∑=-n i i i y y 1 )?(2 最小 D .∑=-n i i i y y 1 )?(2最大 四、计算题 1、为研究家庭收入X (元)和食品支出Y (元)关系,随机抽取了12个家庭的样本,得到数据如下表 第五章 平均预测法和回归预测法 第一节 平均预测法 一、算术平均预测法 1、算术平均预测法是将若干同类观察数据的算术平均数作为预测值的预测方法。 2、算术平均数计算公式 n X X X X n +++= 21 其中,X 为算术平均数,),...,3,2,1(n i X i =为实际观测数据,n 为观察数据的个数。 例5-1 12年来某自学考试科目的合格率分别是 0.4 0.6 0.5 0.6 0.6 0.6 0.7 0.5 0.4 0.6 0.5 0.6 试以12年的合格率作为下一年该自学考试科目合格率的预测值。 解:下一年该自学考试科目合格率的预测值为: 55.012 6.05.06.04.05.0 7.06.06.06.05.06.04.021=+++++++++++=+++= n X X X X n 注意:使用算术平均数时,要特别注意数据的变化规律,如果数据有明显的上升或下降的趋势,则不能采用算术平均预测法。 3、加权平均数计算公式 n n n n n n n n w w w X w X w X w X w w w w X w w w w X w w w w X ++++++=++++++++++++= 21221 1212212 1211 其中,X 为加权平均数,),...,3,2,1(n i w i =为数据i X 的权重, ),...,3,2,1(n i X i =为实际观测数据,n 为观察数据的个数。 例5-2 6年来有一自学考试科目的合格率分别是 0.20 0.35 0.25 0.30 0.40 0.35 它们的权重分别为0.1 0.1 0.15 0.15 0.2 0.3 求:6年来该自考科目合格率的加权平均数。 解:6年来该自考科目合格率的加权平均数为: 3225.03 .02.015.015.01.01.035 .03.04.02.03.015.025.015.035.01.02.01.0212211=+++++?+?+?+?+?+?= ++++++=n n n w w w X w X w X w X 注意:在加权平均数的计算中,权数通常是由有关专家根据掌握的预测对象的本质规律和经验确定的,权数的确定是否合适,直接关系到加权平均的结果,因此权数的选取应该认真对待。 二、移动平均预测法 1、移动平均预测法 在平均间隔不变情况下,每次后移一位求相应间隔平均数,并根据此平均数列的变化规律来进行预测的方法,称为移动平均预测法。 2、移动平均数的计算公式: K X X X X k t t t 1 1+--+++= 其中,X 为t 时期的移动平均数,),...,3,2,1(n i X i =为第i 时期的观测数据, t 表示时间序列的时期序号;k 表示选取的时间间隔。 例5-3 表5-1的第三栏是某校1986-1999年在校学生人数,试计算间隔三年、五年的移动平均数数列。 第一节 一元线性回归分析预测法 一、 概念(思路) 根据预测变量(因变量)Y 和影响因素(自变量)X 的历史统计数 据,建立一元线性回归方程x b a y ???+=,然后代入X 的预测值, 求出Y 的预测值的方法。 基本公式:y=a+bx 其中:a 、b 为回归系数,是未知参数。 基本思路: 1、 利用X ,Y 的历史统计数据,求出合理的回归系数:a 、b , 确定出回归方程 2、 根据预计的自变量x 的取值,求出因变量y 的预测值。 二、 一元线性回归方程的建立 1、 使用散点图定性判断变量间是否存在线性关系 例:某地区民航运输总周转量和该地区社会总产值由密切相关关系。 2、使用最小二乘法确定回归系数 使实际值与理论值误差平方和最小的参数取值。 对应于自变量x i,预测值(理论值)为b+m*x i,实际值y i, min∑(y i-b-mx i)2,求a、b的值。 使用微积分中求极值的方法,得: 由下列方程代表的直线的最小二乘拟合直线的参数公式: 其中 m 代表斜率 ,b 代表截距。 一元线性回归.xls 三、 回归方程的显著性检验 判断X 、Y 之间是否确有线性关系,判定回归方程是否有意义。 有两类检验方法:相关系数检验法和方差分析法 x m y b x x n y x y x n m b mx y i i i i i i ??) (?2 2 -=--=+=∑∑∑∑∑ 1、 相关系数检验法 构造统计量r ∑∑∑∑∑∑∑∑∑∑--?-= ?=-?---=] )(][)([) ()())((22222 2 i i i i i i i i yy xx xy i i i i y y n x x n y x y x n s s S y y x x y y x x r 相关系数的取值围为:[-1,1],|r|的大小反映了两个变量间线性关系的密切程度,利用它可以判断两个变量间的关系是否可以用直线方程表示。 第三章相关分析与回归模型的建立与分析相关分析和回归分析是统计分析方法中最重要内容之一,是多元统计分析方法的 基础。相关分析和回归分析主要用于研究和分析变量之间的相关关系,在变量之间寻求合适的函数关系式,特别是线性表达式。 ◆本章主要内容: 1、对变量之间的相关关系进行分析(Correlate)。其中包括简单相关分析 (Bivariate)和偏相关分析(Partial)。 2、建立因变量和自变量之间回归模型(Regression),其中包括线性回归分析 (Linear)和曲线估计(Curve Estimation)。 ◆数据条件:参与分析的变量数据是数值型变量或有序变量。 §3.1 相关分析 在SPSS中,可以通过Analyze菜单进行相关分析(Correlate),Correlate菜单如图3.1所示。 图3.1 Correlate 相关分析菜单 §3.1.1 简单相关分析 两个变量之间的相关关系称简单相关关系。有两种方法可以反映简单相关关系。一是通过散点图直观地显示变量之间关系,二是通过相关系数准确地反映两变量的关系程度。 §3.1.1.1 散点图 SPSS软件的绘图命令集中在Graphs菜单。下面通过例题来介绍具体操作方法。 例1:数据库SY-8中的变量X表示山东省人均国内生产总值,Y表示山东省城镇居民的消费额(资料来源:山东省2003年统计年鉴),现画出散点图来观察两个变量的关联程度。具体操作步骤如下: 首先打开数据SY-8,然后单击Graphs Scatter,打开Scatter plot散点图对话框,如图3.2所示。然后选择需要的散点图,图中的四个选项依次是: Simple 简单散点图Matrix 矩阵散点图 Overlay 重叠散点图3-D 三维散点图 图3.2 散点图对话框 如果只考虑两个变量,可选择简单的散点图Simple,然后点击Define,打开Simple Scatterplot对话框,如图3.3所示。 图3.3 Simple Scatterplot对话框 选择变量分别进入X轴和Y轴,点击OK后就可以得到散点图,见图3.4。 从下面输出的人均国内生产总值与城镇居民消费额的散点图3.4中可以粗略地看出,两个变量之间有强正相关的线性关系。最新整理第五章回归分析预测法.doc

SPSS第五章 回归分析

最小平方法在回归分析和趋势预测中的应用最新

应用回归分析第三版·何晓群-第三章所有习题答案

回归预测方法

第三章 回归预测法

应用回归分析,第5章课后习题参考答案

应用回归分析_第5章答案

回归分析预测法

统计学习题集第五章相关与回归分析

第15章 SPSS回归分析与市场预测

第五章 回归分析

第5章 平均预测法和回归预测法

一元线性回归分析预测法与多元回归分析报告

spss教程第三章--相关分析与回归模型的建立与分析