第2章习题

2-3 同时掷两个正常的骰子,也就是各面呈现的概率都是l/6,求: (1) “3和5同时出现”事件的自信息量; (2)“两个1同时出现”事件的自信息量;

(3)两个点数的各种组合(无序对)的熵或平均信息量; (4) 两个点数之和(即 2,3,…,12构成的子集)的熵; (5)两个点数中至少有一个是1的自信息。 解:(1)P (3、5或5、3)=P (3、5)+P (5、3)=1/18

I =log2(18)= 4.1699bit 。

(2)P (1、1)=l/36。I =log2(36)=5.1699bit 。

(3)相同点出现时(11、22、33、44、55、66)有6种,概率1/36。 不同点出现时有15种,概率1/18。

H (i ,j )=6*1/36*log 2(36)+15*1/18*log 2(18)=4.3366bit/事件。

=3.2744bit/事件。

(5)P (1、1or1、j or i 、1)=1/36+5/36+5/36=11/36。 I =log2(36/11)=1.7105bit/

2-5 居住某地区的女孩中有25%是大学生,在女大学生中有75%身高为1.6m 以

上,而女孩中身高1.6m 以上的占总数一半。假如得知“身高1.6m 以上的某女孩是大学 生”的消息,问获得多少信息量?、

解:P (女大学生)=1/4;P (身高>1.6m / 女大学生)=3/4;P (身高>1.6m )=1/2; P (女大学生 / 身高>1.6m )=P (身高>1.6m 、女大学生)/P (身高>1.6m ) =3/4*1/4*2=3/8 I =log2(8/3)=1.4150bit 。

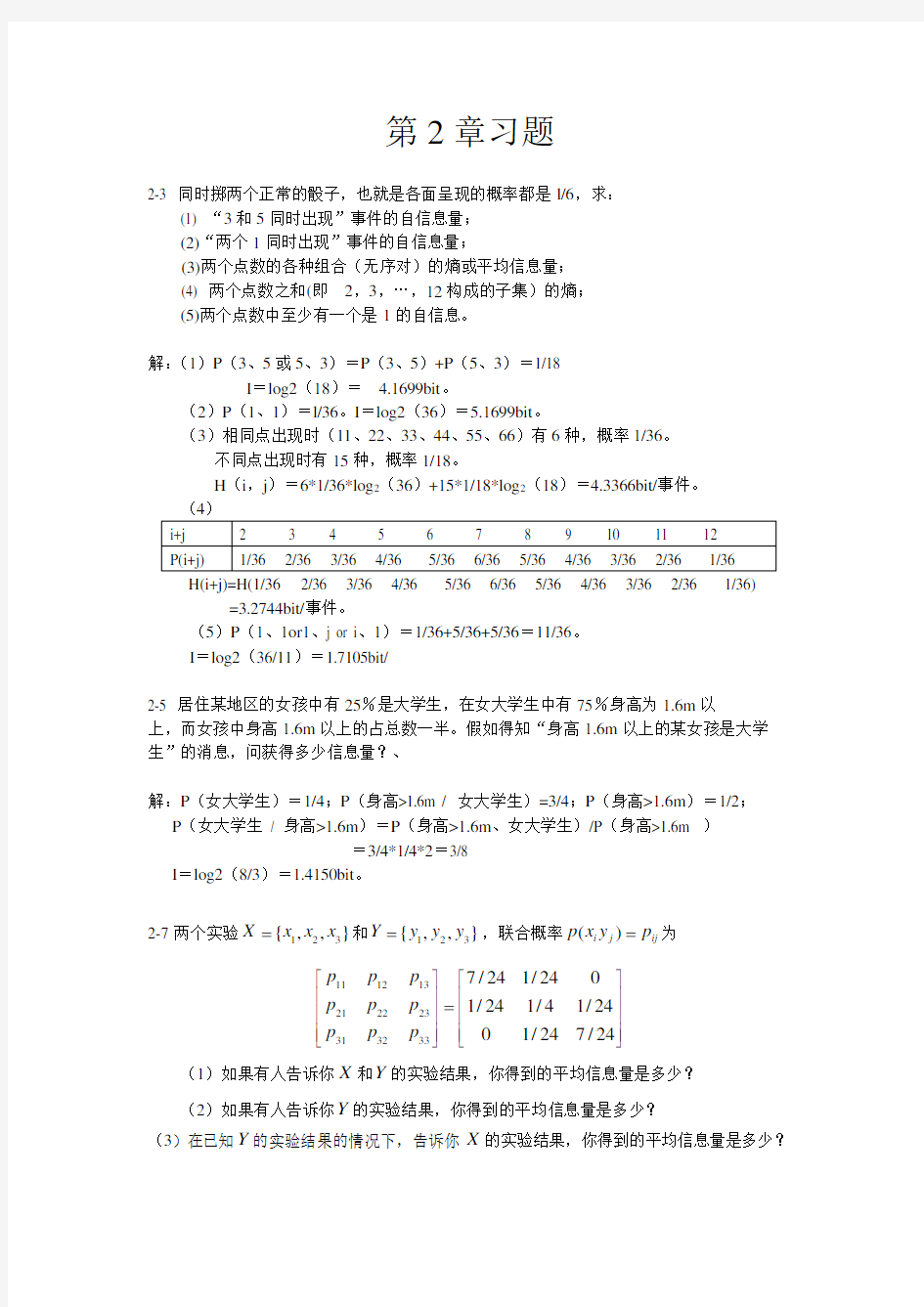

2-7两个实验123{,,}X x x x =和123{,,}Y y y y =,联合概率()i j ij p x y p =为

11121321222331

32

337/241/2401/241/41/2401/247/24p p p p p p p p p ????

????=????????????

(1)如果有人告诉你X 和Y 的实验结果,你得到的平均信息量是多少? (2)如果有人告诉你Y 的实验结果,你得到的平均信息量是多少?

(3)在已知Y 的实验结果的情况下,告诉你X 的实验结果,你得到的平均信息量是多少?

解:

(1)

33

11

(,)(,)log (,)

2.301/i j i j i j H X Y p x y P x y bit symbol

===-=∑∑

(2)

3

1

()()log ()

1.5894/j j j H Y p y p y bit symbol

==-=∑

(3)

(|)(,)()

2.301 1.58940.7151/H X Y H X Y H Y bit symbol

=-=-=

2.11某一无记忆信源的符号集为{}0,1,已知01/4p =,13/4p =。

(1)求信源符号的平均信息量;

(2)由100个符号构成的序列,求某一特定序列(例如有m 个0和100m -个1)的

信息量的表达

(3)计算(2)中的序列熵。

解:(1)因为信源是无记忆信源,所以符号的平均熵

()符号/..,81bit 041504324

1

4341X =?+?=??? ??H =H

(2)某一特定序列(例如:m 个0和100-m 个1)出现的概率为

()

()()[]()[]

m

-100m m

-100m

10021L 43411P 0P X X X P X P ??

?

????? ??===,,,Λ

所以,自信息量为

()()

()

bit m)(X P ,X ,,X X I -m

m L 3

log 1002004341log log 210010021--=????

????????? ????? ??-=-=Λ

(3)序列的熵

()

()序列/81bit X 100X L =H =H

2-13 有一个马尔可夫信源,已知转移概率为

1121122221

(|),(|),(|)1,(|)033

P S S P S S P S S P S S ====。

试画出状态转移图,并求出信源熵。

解:(1)由题意可得状态转移图

一步转移矩阵???

????

?=01313

2

P 由∑=i

j ij i W p W 和1p j

ij =∑可得方程组

???

?

?

?

???

=+=+=1W W W 31W W W 32W 2112

211 解方程组得到各状态的稳态分布概率???==4

1W 4

3W 21//,

因为()()()001S X 3132S X 21=H =H ??

?

??H =H ,/,

,/,

所以信源的熵

()()()符号/..,/69bit 09204

3

3132H 43s X H s p X i

i i =?=??????=

=H ∑∞

2-14有一个一阶马尔可夫链,,,,,21ΛΛr X X X 各r X 取值于集},,,{21q a a a A Λ=,已知

起始概率为4

1

,21)(3211=====p p x X P p ,其转移概率如下:

(1)求321X X X 的联合熵和平均符号熵; (2)求这个链的极限平均符号熵;

(3)求210H H H 、、和它们对应的冗余度。

解:(1) 方法一、

因为()()()()()()()23121213121321/x x P /x x P x P x /x x P /x x P x P x x x P ==

可以计算得到

()()()()()()()()()()()(),,,161/a a P /a a P a P a a a P 16

1

/a a P /a a P a P a a a P 81/a a P /a a P a P a a a P 131113111211121111111111=====

= ()()(),,,241a a a P 0a a a P 12

1

a a a P 3212211

21===

()()(),,,0a a a P 241a a a P 121a a a P 331231131===

()()(),

,,24

1a a a P 241a a a P 121

a a a P 312212112===()()(),,,0a a a P 0a a a P 0a a a P 3222221

22=== ()()(),

,,0a a a P 36

1

a a a P 18

1a a a P 332232132===

()()(),,,

241a a a P 24

1

a a a P 121

a a a P 313213113===

()()(),

,,361a a a P 0a a a P 181a a a P 323223123=== ()()(),

,,0a a a P 0a a a P 0a a a P 333233133=== 所以,

()

()()

三个符号3.967bit/log363612log181812log242416log121214log161612log881x x x logP x x x P X X X 321X X X 321321123

=??+?+??+??+??+?=

-=H ∑∑∑所以,平均符号熵()

()符号/1.322bit X X X 3

1

X 32133=H =H 方法二、

()

()()()三个符号

3.967bit/ 1.26209151/X X /X X X X X X 23121321=++=H +H +H =H ..

所以,平均符号熵()

()符号/1.322bit X X X 3

1

X 32133=H =

H (2)因为这个信源是一阶马尔可夫链,其状态极限概率分布就是信源达到平稳后的符号概率分布.

由题意得到一步转移矩阵?????

???????????=03132310

3

2414121P 由∑=i

j ij i W p W 和1p j

ij =∑可得方程组

??

??????

??

?

=+++=+=++=1

W W W W 31W 41W W 31W 41W W 32W 32W 21W 3212

133

123211

解方程组得到各状态的稳态分布概率???

??===143W 143W 74W 321///,

所以信源平稳后的概率分布为()()()??

?

??===14

3a P 143a P 74a P 321///

因为信源为一阶马尔可夫信源,所以信源的熵

()()

符号/.,,,,,,/251bit 103132H 14331032H 143414121H 74X X X 1

22=???

???+??????+??????=H =H =H ∞ (3)符号/.585bit 1log30==H

符号,,/.414bit 1143143741=???

???H =H

()符号/./251bit 1X X 122=H =H ()符号/./251bit 1X X 12=H =H ∞

对应的冗余度分别为

145.01540.010

10

2

20

1

10

00=H H -

==H H -==H H

-=γγγ 2-16 一阶马尔可夫信源的状态如图所示,信源X 的符号集为{0,1,2}。

(1)求平稳后的信源的概率分布; (2)求信源熵∞H ;

(3)求当0p =和1p =时信源的熵,并说明其理由。

解:(1)由状态转移图可得状态一步转移矩阵

??

??

?

?????=p p 00p p p 0p P 由状态转移图可知:该马尔可夫链具有遍历性,平稳后状态的极限分布存在。 由∑=i

j ij i W p W 和1p j

ij =∑可得方程组

??????

?=+++=+=+=1

W W W W p pW W pW W p W pW W p W 3213133

22211 解方程组得到各状态的稳态分布概率???

??===31W 31W 3

1W 321///,

所以信源平稳后的概率分布为()()()??

?

??===312p 311p 310p ///

(2)因为信源为一阶马尔可夫信源,所以信源的熵

()()()()()()()()()

[][][][][]p H p p H p p,0,H 3

1

0p p,H 31p 0p H 312X H 2p 1X H 1p 0X H 0p s X H s p X i

i i ==++=++==H ∑∞,,,,////

(3)当0p =或1p =时,信源的熵为0。因为此时它表明信源从某一状态出发转移到另一状态的情况是一定发生或一定不发生,即是确定的事件。

p

2-19设有一信源,它在开始时以()0.6,()0.3,()0.1P a P b P c ===的概率发出1X ,如果1

X 为a 时,则2X 为c b a ,,的概率为

31;如果1X 为b 时,则2X 为c b a ,,的概率为31

;如果1X 为c 时,则2X 为b a ,概率为2

1

,为c 的概率为0。而且后面发出i X 的概率只与

1-i X 有关。有121(|)(|),3i i P X X P X X i -=≥。试利用马尔可夫信源的图示法画出状

态转移图,并且计算信源熵∞H 。

解:(1)由题目可知,这个信源为一阶马尔可夫信源,状态空间就等于信源符号集合{a,b,c},其状态转移图为

(2)由状态转移图可知:该马尔可夫链具有遍历性,平稳后状态的极限分布存在。

一步转移矩阵?????

???????

????=02121313131313131P 由∑=i

j ij i W p W 和1p j

ij =∑可得方程组

???????????

=+++=++=++=

1W W W W 31W 31W W 2

1W 31W 31W W 21

W 31W 31W 321

2133

2123211

解方程组得到各状态的稳态分布概率???

??===41W 83W 83W 3

21///,

因为信源为一阶马尔可夫信源,所以信源的熵

()()()()()()()()()

符号/.,,,,,////439bit 12121H 41313131H 83313131H 83c X H c p b X H b p a X H a p s X H s p X i

i i =??

?

???+??????+??????=++==H ∑∞

(资料素材和资料部分来自网络,供参考。可复制、编制,期待你的好评与关注)

各章参考答案 2.1. (1)4.17比特 ;(2)5.17比特 ; (3)1.17比特 ;(4)3.17比特 2.2. 1.42比特 2.3. (1)225.6比特 ;(2)13.2比特 2.4. (1)24.07比特; (2)31.02比特 2.5. (1)根据熵的可加性,一个复合事件的平均不确定性可以通过多次实验逐步解除。如果我们使每次实验所获得的信息量最大。那么所需要的总实验次数就最少。用无砝码天平的一次称重实验结果所得到的信息量为log3,k 次称重所得的信息量为klog3。从12个硬币中鉴别其中的一个重量不同(不知是否轻或重)所需信息量为log24。因为3log3=log27>log24。所以在理论上用3次称重能够鉴别硬币并判断其轻或重。每次实验应使结果具有最大的熵。其中的一个方法如下:第一次称重:将天平左右两盘各放4枚硬币,观察其结果:①平衡 ②左倾 ③右倾。ⅰ)若结果为①,则假币在未放入的4枚币,第二次称重:将未放入的4枚中的3枚和已称过的3枚分别放到左右两盘,根据结果可判断出盘中没有假币;若有,还能判断出轻和重,第三次称重:将判断出含有假币的三枚硬币中的两枚放到左右两盘中,便可判断出假币。ⅱ)若结果为②或③即将左盘中的3枚取下,将右盘中的3枚放到左盘中,未称的3枚放到右盘中,观察称重砝码,若平衡,说明取下的3枚中含假币,只能判出轻重,若倾斜方向不变,说明在左、右盘中未动的两枚中其中有一枚为假币,若倾斜方向变反,说明从右盘取过的3枚中有假币,便可判出轻重。 (2)第三次称重 类似ⅰ)的情况,但当两个硬币知其中一个为假,不知为哪个时, 第三步用一个真币与其中一个称重比较即可。 对13个外形相同的硬币情况.第一次按4,4,5分别称重,如果假币在五个硬币的组里,则鉴 别所需信息量为log10>log9=2log3,所以剩下的2次称重不能获得所需的信息. 2.6. (1)215 log =15比特; (2) 1比特;(3)15个问题 2. 7. 证明: (略) 2.8. 证明: (略) 2.9. 31)(11= b a p ,121 )(21=b a p , 121 )(31= b a p , 61)()(1312= =b a b a p p , 241)()()()(33233222= ===b a b a b a b a p p p p 。 2.10. 证明: (略) 2.11. 证明: (略)

1. 在无失真的信源中,信源输出由 H (X ) 来度量;在有失真的信源中,信源输出由 R (D ) 来度量。 2. 要使通信系统做到传输信息有效、可靠和保密,必须首先 信源 编码, 然后_____加密____编码,再______信道_____编码,最后送入信道。 3. 带限AWGN 波形信道在平均功率受限条件下信道容量的基本公式,也就是有名的香农公式是log(1)C W SNR =+;当归一化信道容量C/W 趋近于零时,也即信道完全丧失了通信能力,此时E b /N 0为 -1.6 dB ,我们将它称作香农限,是一切编码方式所能达到的理论极限。 4. 保密系统的密钥量越小,密钥熵H (K )就越 小 ,其密文中含有的关于明文的信息量I (M ;C )就越 大 。 5. 已知n =7的循环码42()1g x x x x =+++,则信息位长度k 为 3 ,校验多项式 h(x)= 3 1x x ++ 。 6. 设输入符号表为X ={0,1},输出符号表为Y ={0,1}。输入信号的概率分布为p =(1/2,1/2),失真函数为d (0,0) = d (1,1) = 0,d (0,1) =2,d (1,0) = 1,则D min = 0 ,R (D min )= 1bit/symbol ,相应的编码器转移概率矩阵[p(y/x )]=1001?? ???? ;D max = 0.5 ,R (D max )= 0 ,相应的编码器转移概率矩阵[p(y/x )]=1010?? ? ??? 。 7. 已知用户A 的RSA 公开密钥(e,n )=(3,55),5,11p q ==,则()φn = 40 ,他的秘密密钥(d,n )=(27,55) 。若用户B 向用户A 发送m =2的加密消息,则该加密后的消息为 8 。 二、判断题 1. 可以用克劳夫特不等式作为唯一可译码存在的判据。 (√ ) 2. 线性码一定包含全零码。 (√ ) 3. 算术编码是一种无失真的分组信源编码,其基本思想是将一定精度数值作为序列的 编码,是以另外一种形式实现的最佳统计匹配编码。 (×) 4. 某一信源,不管它是否输出符号,只要这些符号具有某些概率特性,就有信息量。 (×) 5. 离散平稳有记忆信源符号序列的平均符号熵随着序列长度L 的增大而增大。 (×) 6. 限平均功率最大熵定理指出对于相关矩阵一定的随机矢量X ,当它是正态分布时具 有最大熵。 (√ ) 7. 循环码的码集中的任何一个码字的循环移位仍是码字。 (√ )

模拟试题一 一、概念简答题(共10题,每题5分) 1.简述离散信源和连续信源的最大熵定理。 2.什么是平均自信息(信息熵)?什么是平均互信息?比较一下两个概念的异同之处。 3.解释等长信源编码定理和无失真变长信源编码定理,说明对于等长码和变长码,最佳码的每符号平均码长最小为多少?编码效率最高可达多少? 4.解释最小错误概率译码准则,最大似然译码准则和最小距离译码准则,说明三者的关系。 5.设某二元码字C={111000,001011,010110,101110}, ①假设码字等概率分布,计算此码的编码效率? ②采用最小距离译码准则,当接收序列为110110时,应译成什么码字? 6.一平稳二元信源,它在任意时间,不论以前发出过什么符号,都按 发出符号,求

和平均符号熵 7.分别说明信源的概率分布和信道转移概率对平均互信息的影响,说明平均互信息与信道容量的关系。 8.二元无记忆信源,有求: (1)某一信源序列由100个二元符号组成,其中有m个“1”,求其自信息量?

(2)求100个符号构成的信源序列的熵。 9.求以下三个信道的信道容量: , ,10.已知一(3,1,3)卷积码编码器,输入输出关系为:

试给出其编码原理框图。 二、综合题(共5题,每题10分) 1.二元平稳马氏链,已知P(0/0)=0.9,P(1/1)=0.8,求: (1)求该马氏信源的符号熵。 (2)每三个符号合成一个来编二进制Huffman码,试建立新信源的模型,给出编码结果。 (3)求每符号对应的平均码长和编码效率。 2.设有一离散信道,其信道矩阵为,求:(1)最佳概率分布?

《信息论基础》答案 一、填空题(本大题共10小空,每小空1分,共20分) 1.按信源发出符号所对应的随机变量之间的无统计依赖关系,可将离散信源分为有记忆信源和无记忆信源两大类。 2.一个八进制信源的最大熵为3bit/符号 3.有一信源X ,其概率分布为1 23x x x X 1 11P 244?? ?? ? =?? ????? ,其信源剩余度为94.64%;若对该信源进行十次扩展,则每十个符号的平均信息量是 15bit 。 4.若一连续消息通过放大器,该放大器输出的最大瞬间电压为b ,最小瞬时电压为a 。若消息从放大器中输出,则该信源的绝对熵是∞;其能在每个自由度熵的最大熵是log (b-a )bit/自由度;若放大器的最高频率为F ,则单位时间内输出的最大信息量是 2Flog (b-a )bit/s. 5. 若某一 信源X ,其平均功率受限为16w ,其概率密度函数是高斯分布时,差熵的最大值为 1 log32e 2 π;与其熵相等的非高斯分布信源的功率为16w ≥ 6、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。 7、无失真信源编码的平均码长最小理论极限制为信源熵(或H(S)/logr= H r (S))。 8、当R=C 或(信道剩余度为0)时,信源与信道达到匹配。 9、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。 10、在下面空格中选择填入数学符号“,,,=≥≤?”或“?” (1)当X 和Y 相互独立时,H (XY )=H(X)+H(X/Y)。 (2)假设信道输入用X 表示,信道输出用Y 表示。在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y) 第二章 信息量与熵 2、2 八元编码系统,码长为3,第一个符号用于同步,每秒1000个码字,求它的信息速率。 解:同步信息均相同,不含信息,因此 每个码字的信息量为 2?8log =2?3=6 bit 因此,信息速率为 6?1000=6000 bit/s 2、3 掷一对无偏骰子,告诉您得到的总的点数为:(a) 7; (b) 12。问各得到多少信息量。 解:(1) 可能的组合为 {1,6},{2,5},{3,4},{4,3},{5,2},{6,1} )(a p =366=6 1 得到的信息量 =)(1log a p =6log =2、585 bit (2) 可能的唯一,为 {6,6} )(b p =36 1 得到的信息量=)(1log b p =36log =5、17 bit 2、4 经过充分洗牌后的一副扑克(52张),问: (a) 任何一种特定的排列所给出的信息量就是多少? (b) 若从中抽取13张牌,所给出的点数都不相同时得到多少信息量? 解:(a) )(a p =! 521 信息量=) (1log a p =!52log =225、58 bit (b) ???????花色任选 种点数任意排列 13413!13 )(b p =1352 134!13A ?=135213 4C 信息量=1313524log log -C =13、208 bit 2、9 随机掷3颗骰子,X 表示第一颗骰子的结果,Y 表示第一与第二颗骰子的点数之与,Z 表 示3颗骰子的点数之与,试求)|(Y Z H 、)|(Y X H 、),|(Y X Z H 、)|,(Y Z X H 、)|(X Z H 。 解:令第一第二第三颗骰子的结果分别为321,,x x x ,1x ,2x ,3x 相互独立,则 1x X =,21x x Y +=,321x x x Z ++= )|(Y Z H =)(3x H =log 6=2、585 bit )|(X Z H =)(32x x H +=)(Y H =2?(361log 36+362log 18+363log 12+364log 9+365log 536)+36 6log 6 =3、2744 bit )|(Y X H =)(X H -);(Y X I =)(X H -[)(Y H -)|(X Y H ] 而)|(X Y H =)(X H ,所以)|(Y X H = 2)(X H -)(Y H =1、8955 bit 或)|(Y X H =)(XY H -)(Y H =)(X H +)|(X Y H -)(Y H 而)|(X Y H =)(X H ,所以)|(Y X H =2)(X H -)(Y H =1、8955 bit ),|(Y X Z H =)|(Y Z H =)(X H =2、585 bit )|,(Y Z X H =)|(Y X H +)|(XY Z H =1、8955+2、585=4、4805 bit 一、设X 、Y 就是两个相互统计独立的二元随机变量,其取-1或1的概率相等。定义另一个二元随机变量Z,取Z=YX(一般乘积)。试计算: 1、H(Y)、H(Z); 2、H(YZ); 3、I(X;Y)、I(Y;Z); 二、如图所示为一个三状态马尔科夫信源的转移概率矩阵 1. 绘制状态转移图; 2、 求该马尔科夫信源的稳态分布; 3、 求极限熵 ; 三、在干扰离散对称信道上传输符号1与0,已知P(0)=1/4,P(1)=3/4,试求: 1. 信道转移概率矩阵P 2、信道疑义度 3、信道容量以及其输入概率分布 四、某信道的转移矩阵?? ????=1.006.03.001.03.06.0P ,求信道容量,最佳输入概率分布。 五、求下列各离散信道的容量(其条件概率P(Y/X)如下 :) 六、求以下各信道矩阵代表的信道的容量 答案 一、设X 、Y 就是两个相互统计独立的二元随机变量,其取-1或1的概率相等。定义另一个二元随机变量Z,取Z=YX(一般乘积)。试计算: 1、H(Y)、H(Z); 2、H(XY)、H(YZ); 3、I(X;Y)、I(Y;Z); 解:1、 2 i 11111H Y P y logP y log log 2222i i =??=-+????∑()=-()()=1bit/符号 Z=YX 而且X 与Y 相互独立 ∴ 1(1)(1)(1)P P X P Y P X ?=+=-?=-(Z =1)=P(Y=1)= 1111122222 ?+?= 2(1)(1)(1)P P X P Y P X ?=-+=-?=(Z =-1)=P(Y=1)= 1111122222 ?+?= 故H(Z)= i 2i 1(z )log (z )i P P =- ∑=1bit/符号 2、从上式可以瞧出:Y 与X 的联合概率分布为: 《信息论基础》试卷第1页 《信息论基础》试卷答案 一、填空题(共25分,每空1分) 1、连续信源的绝对熵为 无穷大。(或()()lg lim lg p x p x dx +∞-∞ ?→∞ --?? ) 2、离散无记忆信源在进行无失真变长信源编码时,编码效率最大可以达到 1 。 3、无记忆信源是指 信源先后发生的符号彼此统计独立 。 4、离散无记忆信源在进行无失真变长编码时,码字长度是变化的。根据信源符号的统计特性,对概率大的符号用 短 码,对概率小的符号用 长 码,这样平均码长就可以降低,从而提高 有效性(传输速率或编码效率) 。 5、为了提高系统的有效性可以采用 信源编码 ,为了提高系统的可靠性可以采用 信道编码 。 6、八进制信源的最小熵为 0 ,最大熵为 3bit/符号 。 7、若连续信源输出信号的平均功率为1瓦特,则输出信号幅度的概率密度函数为 高斯分布(或()0,1x N 2 2 x - )时,信源具有最大熵,其值为 0.6155hart(或 1.625bit 或 1lg 22 e π)。 8、即时码是指 任一码字都不是其它码字的前缀 。 9、无失真信源编码定理指出平均码长的理论极限值为 信源熵(或H r (S)或()lg H s r ),此 时编码效率为 1 ,编码后的信息传输率为 lg r bit/码元 。 10、一个事件发生的概率为0.125,则自信息量为 3bit/符号 。 11、信源的剩余度主要来自两个方面,一是 信源符号间的相关性 ,二是 信源符号概率分布的不均匀性 。 12、m 阶马尔可夫信源的记忆长度为 m+1 ,信源可以有 q m 个不同的状态。 13、同时扔出一对均匀的骰子,当得知“两骰子面朝上点数之和为2”所获得的信息量为 lg36=5.17 比特,当得知“面朝上点数之和为8”所获得的信息量为 lg36/5=2.85 比特。 14.在下面空格中选择填入的数学符号“=,≥,≤,>”或“<” H(XY) = H(Y)+H(X ∣Y) ≤ H(Y)+H(X) 信息论与编码习题参考答案 第一章 单符号离散信源 同时掷一对均匀的子,试求: (1)“2和6同时出现”这一事件的自信息量; (2)“两个5同时出现”这一事件的自信息量; (3)两个点数的各种组合的熵; (4)两个点数之和的熵; (5)“两个点数中至少有一个是1”的自信息量。 解: bit P a I N n P bit P a I N n P c c N 17.536log log )(361 )2(17.418log log )(362)1(36 662221111 616==-=∴====-=∴== =?==样本空间: (3)信源空间: bit x H 32.436log 36 16236log 36215)(=??+?? =∴ (4)信源空间: bit x H 71.3636 log 366536log 3610 436log 368336log 366236log 36436log 362)(=??+?+?+??= ∴++ (5) bit P a I N n P 17.111 36 log log )(3611333==-=∴== 如有6行、8列的棋型方格,若有两个质点A 和B ,分别以等概落入任一方格内,且它们的坐标分别为(Xa ,Ya ), (Xb ,Yb ),但A ,B 不能同时落入同一方格内。 (1) 若仅有质点A ,求A 落入任一方格的平均信息量; (2) 若已知A 已落入,求B 落入的平均信息量; (3) 若A ,B 是可辨认的,求A ,B 落入的平均信息量。 解: bit a P a P a a P a I a P A i 58.548log )(log )()(H 48log )(log )(481 )(:)1(48 1 i i i i i ==-=∴=-=∴= ∑=落入任一格的概率Θ bit b P b P b b P b I b P A i 55.547log )(log )()(H 47 log )(log )(47 1 )(:B ,)2(48 1i i i i i ==-=∴=-=∴=∑=落入任一格的概率是落入任一格的情况下在已知Θ 一、(11’)填空题 (1)1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。 (2)必然事件的自信息是 0 。 (3)离散平稳无记忆信源X的N次扩展信源的熵等于离散信源X的熵的 N倍。 (4)对于离散无记忆信源,当信源熵有最大值时,满足条件为__信源符号等概分布_。 (5)若一离散无记忆信源的信源熵H(X)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为 3 。 (6)对于香农编码、费诺编码和霍夫曼编码,编码方法惟一的是香农编码。(7)已知某线性分组码的最小汉明距离为3,那么这组码最多能检测出_2_______个码元错误,最多能纠正___1__个码元错误。 (8)设有一离散无记忆平稳信道,其信道容量为C,只要待传送的信息传输率R__小于___C(大于、小于或者等于),则存在一种编码,当输入序列长度n足够大,使译码错误概率任意小。(9)平均错误概率不仅与信道本身的统计特性有关,还与___译码规则____________和___编码方法___有关 三、(5')居住在某地区的女孩中有25%是大学生,在女大学生中有75%是身高1.6米以上的,而女孩中身高1.6米以上的占总数的一半。 假如我们得知“身高1.6米以上的某女孩是大学生”的消息,问获得多少信息量? 解:设A表示“大学生”这一事件,B表示“身高1.60以上”这一事件,则 P(A)=0.25 p(B)=0.5 p(B|A)=0.75 (2分) 故 p(A|B)=p(AB)/p(B)=p(A)p(B|A)/p(B)=0.75*0.25/0.5=0.375 (2分) I(A|B)=-log0.375=1.42bit (1分) 四、(5')证明:平均互信息量同信息熵之间满足 I(X;Y)=H(X)+H(Y)-H(XY) 证明: 信息论试卷题目及答案 ————————————————————————————————作者:————————————————————————————————日期: 2 中国海洋大学2008—2009学年第一学期 一、填空题(每空2分,共20分) 1、1948年,美国数学家 香农 发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。 2、信源编码的目的是提高通信的有效性。信道编码的最终目的是提高信号传输的可靠性。 3、离散平稳无记忆信源X 的N 次扩展信源的熵等于离散信源X 的熵的N 倍。 4、对于香农编码、费诺编码和哈夫曼编码,编码方法惟一的是香农编码。 5、信道输入与输出间的平均互信息是信道转移概率的 下凸 函数,是输入概率的 上凸 函数。 6、信道矩阵??????10002/12/1代表的信道的信道容量C=符号/1bit ,达到信道容量的条件是输入符号等概分布。 7、 设某二进制码{00011,10110,01101,11000,10010,10001},则码的最小距离是2 ,假设码字等概分布,则该码的码率为 0.517比特/符号 ,这时若通过二元对称信道接收码字为01100和00110时,应译为01101 , 10110 。。 二、判断题(每题2分,共10分) 1、必然事件和不可能事件的自信息量都是0 。(错) 2、最大后验概率准则与最大似然准则是等价的。(错) 3、如果信息传输速率大于信道容量,就不存在使传输差错率任意小的信道编码。(对) 4、连续信源和离散信源的熵都具有非负性。(错) 5、相同功率的噪声中,高斯噪声使信道容量最小。(对) 三、简答题(第1、2题各6分,第三题10分,共22分) 1、简述最大离散熵定理。对于一个有m 个符号的离散信源,其最大熵是什么? 答:最大离散熵定理为:离散无记忆信源,等概率分布时熵最大。 (3分) 最大熵值为 m H 2max log = (3分) 2、对于任意概率事件集X 、Y 、Z ,证明下述三角不等式成立()()()Z X H Z Y H Y X H ≥+ 证:因为)|()|(Y X H YZ X H ≤ ,(3分) 所以: ) |()|()|() |,() |()|()|()|(Z Y H XZ Y H Z Y H Z Y X I YZ X H Z X H Y X H Z X H ≤-==-≤-(3分) 信息论基础理论与应用考试题 一﹑填空题(每题2分,共20分) 1.信息论研究的目的就是要找到信息传输过程的共同规律,以提高信息传输的 (可靠性)﹑(有效性)﹑保密性和认证性,使信息传输系统达到最优化。 (考点:信息论的研究目的) 2.电视屏上约有500×600=3×510个格点,按每点有10个不同的灰度等级考虑,则可组成5 31010?个不同的画面。按等概计算,平均每个画面可提供的信息量约为(610bit /画面)。 (考点:信息量的概念及计算) 3.按噪声对信号的作用功能来分类信道可分为 (加性信道)和 (乘性信道)。 (考点:信道按噪声统计特性的分类) 4.英文电报有32个符号(26个英文字母加上6个字符),即q=32。若r=2,N=1,即对信源S 的逐个符号进行二元编码,则每个英文电报符号至少要用 (5)位二元符号编码才行。 (考点:等长码编码位数的计算) 5.如果采用这样一种译码函数,它对于每一个输出符号均译成具有最大后验概率的那个输入符号,则信道的错误概率最小,这种译码规则称为(最大后验概率准则)或(最小错误概率准则)。 (考点:错误概率和译码准则的概念) 6.按码的结构中对信息序列处理方式不同,可将纠错码分为(分组码)和(卷积码)。 (考点:纠错码的分类) 7.码C={(0,0,0,0),(0,1,0,1),(0,1,1,0),(0,0,1,1)}是((4, 2))线性分组码。 (考点:线性分组码的基本概念) 8.定义自信息的数学期望为信源的平均自信息量,即(11()log ()log ()()q i i i i H X E P a P a P a =??==-????∑)。 重庆邮电大学2007/2008学年2学期 《信息论基础》试卷(期末)(A卷)(半开卷) 一、填空题(本大题共10小空,每小空1分,共20分) 1.按信源发出符号所对应的随机变量之间的无统计依赖关系,可将离散信源分为有记忆信源和无记忆信源两大类。 2.一个八进制信源的最大熵为3bit/符号 3.有一信源X,其概率分布为 123 x x x X 111 P 244 ?? ?? ? = ?? ? ?? ?? ,其信源剩余度为94.64%;若对该信源进行十次扩展,则 每十个符号的平均信息量是 15bit。 4.若一连续消息通过放大器,该放大器输出的最大瞬间电压为b,最小瞬时电压为a。若消息从放大器中输出,则该信源的绝对熵是∞;其能在每个自由度熵的最大熵是log(b-a)bit/自由度;若放大器的最高频率为F,则单位时间内输出的最大信息量是 2Flog(b-a)bit/s. 5. 若某一信源X,其平均功率受限为16w,其概率密度函数是高斯分布时,差熵的最大值为1 log32e 2 π;与其 熵相等的非高斯分布信源的功率为16w ≥ 6、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。 7、无失真信源编码的平均码长最小理论极限制为信源熵(或H(S)/logr= H r(S))。 8、当R=C或(信道剩余度为0)时,信源与信道达到匹配。 9、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。 10、在下面空格中选择填入数学符号“,,, =≥≤?”或“?” (1)当X和Y相互独立时,H(XY)=H(X)+H(X/Y)。 (2)假设信道输入用X表示,信道输出用Y表示。在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y) 《信息论基础》模拟试卷 一、填空题(共15分,每空1分) 1、信源编码的主要目的是 ,信道编码的主要目的是 。 2、信源的剩余度主要来自两个方面,一是 ,二是 。 3、三进制信源的最小熵为 ,最大熵为 。 4、无失真信源编码的平均码长最小理论极限制为 。 5、当 时,信源与信道达到匹配。 6、根据信道特性是否随时间变化,信道可以分为 和 。 7、根据是否允许失真,信源编码可分为 和 。 8、若连续信源输出信号的平均功率为2σ,则输出信号幅度的概率密度是 时,信源具有最大熵,其值为值 。 9、在下面空格中选择填入数学符号“,,,=≥≤?”或“?” (1)当X 和Y 相互独立时,H (XY ) H(X)+H(X/Y) H(Y)+H(X)。 (2)()() 1222 H X X H X = ()()12333H X X X H X = (3)假设信道输入用X 表示,信道输出用Y 表示。在无噪有损信道中,H(X/Y) 0, H(Y/X) 0,I(X;Y) H(X)。 二、(6分)若连续信源输出的幅度被限定在【2,6】区域内,当输出信号的概率密度是均匀分布时,计算该信源的相对熵,并说明该信源的绝对熵为多少。 三、(16分)已知信源 1234560.20.20.20.20.10.1S s s s s s s P ????=???????? (1)用霍夫曼编码法编成二进制变长码;(6分) (2)计算平均码长L ;(4分) (3)计算编码信息率R ';(2分) (4)计算编码后信息传输率R ;(2分) (5)计算编码效率η。(2分) 四、(10分)某信源输出A 、B 、C 、D 、E 五种符号,每一个符号独立出现,出现概率分别为1/8、1/8、1/8、1/2、1/8。如果符号的码元宽度为0.5s μ。计算: (1)信息传输速率t R 。(5分) (2)将这些数据通过一个带宽为B=2000kHz 的加性白高斯噪声信道传输,噪声的单边功率谱密度为 6010W n Hz -=。试计算正确传输这些数据最少需要的发送功率P 。(5分) 《信息论基础》答案 一、填空题(共15分,每空1分) 1、若一连续消息通过某放大器,该放大器输出的最大瞬时电压为b,最小瞬时电压为a。 若消息从放大器中输出,则该信源的绝对熵是无穷大;其能在每个自由度熵的最 大熵是log b-a 。 2、高斯白噪声信道是指信道噪声服从正态分布,且功率谱为常数。 3、若连续信源的平均功率为 5 W,则最大熵为1.2 Iog10 e ,达到最大值的条件是高 斯信道。 4、离散信源存在剩余度的原因是信源有记忆(或输岀符号之间存在相关性)和不 等概。 5、离散无记忆信源在进行无失真变长信源编码时,编码效率最大可以达到 1 。 6、离散无记忆信源在进行无失真变长信源编码时,码字长度是变化的。根据信源符号 的统计特性,对概率大的符号用短码,对概率小的符号用长码,这样平均码长 就可以降低,从而提高编码效率。 7、八进制信源的最小熵为0 ,最大熵为3bit 。 8、一个事件发生概率为,则自信息量为3bit 。 9、在下面空格中选择填入数字符号“,,,”或“ <” H XY 二HY HXY HY H X 二、判断题(正确打",错误打X)(共5分,每小题1分) 1)离散无(")记忆等概信源的剩余度为0 。 2) 离散无记忆信源N次扩展源的熵是原信息熵的N倍(") 3) 互信息可正、可负、可为零。 (") 4) 信源的真正功率P 永远不会大于熵功率P ,即P P (X ) 5) 信道容量与信源输出符号的概率分布有关。 (X ) 、(5分)已知信源的概率密度函数p x如下图所示,求信源的相对熵 * p x 0.5 4 h x 2 p x log p x dx 1bit自由度 四、(15分)设一个离散无记忆信源的概率空间为P x 0.5 0.5 它们通过干扰信道,信道输出端的接收信号集为丫= 示。 试计算: (1)信源X中事件x的自信息量;(3分) (2)信源X的信息熵;(3分) (3)共熵H XY ; ( 3 分) (4)噪声熵H Y X ;(3分) (5)收到信息丫后获得的关于信源X的平均信息量。(1)I x11bit (2)H丄,丄1bit/符号 2 2,已知信道出书概率如下图所 (3 分) 3-1 设有一离散无记忆信源,其概率空间为12()0.60.4X x x P x ???? =? ??? ???? ,信源发出符号通过一干扰信道,接收符号为12{,}Y y y =,信道传递矩阵为516 61344P ???? =? ?????? ? ,求: (1)信源X 中事件1x 和2x 分别含有的自信息量; (2)收到消息j y (j =1,2)后,获得的关于i x (i =1,2)的信息量; (3)信源X 和信宿Y 的信息熵; (4)信道疑义度(/)H X Y 和噪声熵(/)H Y X ; (5)接收到消息Y 后获得的平均互信息量(;)I X Y 。 解:(1)12()0.737,() 1.322I x bit I x bit == (2)11(;)0.474I x y bit =,12(;) 1.263I x y bit =-,21(;) 1.263I x y bit =-, 22(;)0.907I x y bit = (3)()(0.6,0.4)0.971/H X H bit symbol == ()(0.6,0.4)0.971/H Y H bit symbol == (4)()(0.5,0.1,0.1,0.3) 1.685/H XY H bit symbol == (/) 1.6850.9710.714/H X Y bit symbol =-= (/)0.714/H Y X bit symbol = (5)(;)0.9710.7140.257/I X Y bit symbol =-= 3-2 设有扰离散信道的输入端是以等概率出现的A 、B 、C 、D 四个字母。该信道的正 确传输概率为0.5,错误传输概率平均分布在其他三个字母上。验证在该信道上每个字母传输的平均信息量为0.21比特。 证明:信道传输矩阵为: 第二章 1 ■一阶齐次马尔柯夫信源消息集X ∈{321,,a a a },状态集S ∈{321,,S S S }。且令3,2,1,==i a S i i , 符号条件转移概率为[] ??? ?????=21414141214113131)/(i j S a P (1) 画出该信源的状态转移图;(2)解:(1) []11 13331114 241114 42 (|)j i p S S ????=?????? (2)111123 1344111 1232324111 12333421 231w w w w w w w w w w w w w w w ++=??++=??++=??++=?3 11142114 311 w w w =??=??=? H(X|S 1)=H (1/3,1/3,1/3)=1.58bit/符号 H(X|S 2)=H (1/4,1/2,1/4)=1.5bit/符号= H(X|S 3) 3 34 11111 ()(|) 1.58 1.52 1.52i i i H X w H X S ∞===?+??=∑bit/符号 2 如果你确定你的朋友是6月的生日,但是不知道具体是哪一天。那么你问你的朋友“你的生日是6月哪一天?”,则答案中含有的信息量为4.91bit ; 3p42 2-12 4 p42 2-13 5 p43 2-19 6 p44 2-29 第三章 1. ■设信道的转移概率矩阵为P =0.90.10.10.9?? ???? (1)若p(x 0)=0.4,p(x 1)=0.6,求H(X ),H(Y ),H(Y|X )和I(X ;Y ); 信息论基础1答案 《信息论基础》答案 一、填空题(本大题共10小空,每小空1分,共20分) 1.按信源发出符号所对应的随机变量之间的无统计依赖关系,可将离散信源分为有记忆信源和无记忆信源两大类。 2.一个八进制信源的最大熵为3bit/符号 3.有一信源X ,其概率分布为 123x x x X 111P 2 44?? ?? ?=?? ??? ?? , 其信源剩余度为94.64%;若对该信源进行十次扩展,则每十个符号的平均信息量是 15bit 。 4.若一连续消息通过放大器,该放大器输出的最大瞬间电压为b ,最小瞬时电压为a 。若消息从放大器中输出,则该信源的绝对熵是 ∞ ;其能在每个自由度熵的最大熵是log (b-a ) bit/自由度;若放大器的最高频率为F ,则单位时间内输出的最大信息量是 2Flog (b-a )bit/s. 5. 若某一 信源X ,其平均功率受限为 16w,其概率密度函数是高斯分布时,差熵的 最大值为1log32e π;与其熵相等的非高斯分布信2 源的功率为16w ≥ 6、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。 7、无失真信源编码的平均码长最小理论极限 (S))。 制为信源熵(或H(S)/logr= H r 8、当R=C或(信道剩余度为0)时,信源与信道达到匹配。 9、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。 10、在下面空格中选择填入数学符号“,,, =≥≤?”或“?” (1)当X和Y相互独立时,H(XY)=H(X)+H(X/Y)。 (2)假设信道输入用X表示,信道输出用Y 表示。在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y) 1.设信源?? ????=????? ?4.06.0)(21x x X P X 通过一干扰信道,接收符号为Y = { y 1, y 2 },信道转移矩阵为? ?????????43416165,求: (1) 信源X 中事件x 1和事件x 2分别包含的自信息量; (2) 收到消息y j (j=1,2)后,获得的关于x i (i=1,2)的信息量; (3) 信源X 和信宿Y 的信息熵; (4) 信道疑义度H(X/Y)和噪声熵H(Y/X); (5) 接收到信息Y 后获得的平均互信息量。 解: 1) bit x p x I bit x p x I 322.14.0log )(log )( 737.06.0log )(log )(22222121=-=-==-=-= 2) bit y p x y p y x I bit y p x y p y x I bit y p x y p y x I bit y p x y p y x I x y p x p x y p x p y p x y p x p x y p x p y p 907.04 .04 /3log )()/(log );( 263.16.04 /1log )()/(log );( 263.14.06 /1log )()/(log );( 474.06.06 /5log )()/(log );(4 .04 3 4.0616.0)/()()/()()(6 .041 4.0656.0)/()()/()()(22222 2221212122212221211121122212122121111===-===-=======?+?=+==?+?=+= 3) symbol bit y p y p Y H symbol bit x p x p X H j j j i i i / 971.010log )4.0log 4.06.0log 6.0()(log )()(/ 971.010log )4.0log 4.06.0log 6.0()(log )()(22=+-=-==+-=-=∑∑ 4) symbol bit Y H X Y H X H Y X H Y X H Y H X Y H X H symbol bit x y p x y p x p X Y H i j i j i j i / 715.0971.0715.0971.0 )()/()()/() /()()/()(/ 715.0 10 log )4 3 log 434.041log 414.061log 616.065log 656.0( ) /(log )/()()/(2=-+=-+=∴+=+=??+?+?+?-=-=∑∑ 安徽大学2011—2012学年第1学期 《信息论》考试试卷(AB 合卷) 院/系 年级 专业 姓名 学号 一、填空题 1、接收端收到y 后,获得关于发送的符号是x 的信息量是 。 2、香农信息的定义 。 3、在已知事件z Z ∈的条件下,接收到y 后获得关于事件x 的条件互信息(;|)I x y z 的表达式为 。 4、通信系统模型主要分成五个部分分别为: 。 5、研究信息传输系统的目的就是要找到信息传输过程的共同规律,以提高信息传输的可靠性、有效性、 和 ,使信息传输系统达到最优化。 6、某信源S 共有32个信源符号,其实际熵H ∞=1.4比特/符号,则该信源剩余度为 。 7、信道固定的情况下,平均互信息(;)I X Y 是输入信源概率分布()P x 的 型凸函数。 信源固定的情况下,平均互信息(;)I X Y 是信道传递概率(|)P y x 的 型凸函数。 8、当信源与信道连接时,若信息传输率达到了信道容量,则称此信源与信道达到匹配。信道剩余度定义为 。 9、已知信源X 的熵H (X )=0.92比特/符号,则该信源的五次无记忆扩展信源X 5的信息熵 5()H X = 。 10、将∞H ,6H ,0H ,4H ,1H 从大到小排列为 。 11、根据香农第一定理,对于离散无记忆信源S ,用含r 个字母的码符号集对N 长信源符号序列进行变长编码,总能找到一种无失真的唯一可译码,使每个信源符号所需平均码长满足: 。 12、多项式剩余类环[]())q F x f x 是域的充要条件为 。 13、多项式剩余类环[](1)n q F x x -的任一理想的生成元()g x 与1n x -关系为 。 14、有限域12 2F 的全部子域为 。 15、国际标准书号(ISBN )由十位数字12345678910a a a a a a a a a a 组成(诸i a ∈11F ,满足: 10 1 0(mod11)i i ia =≡∑) ,其中前九位均为0-9,末位0-10,当末位为10时用X 表示。《Handbook of Applied Cryptography 》的书号为ISBN :7-121-01339- ,《Coding and Information Theory 》的书号为ISBN :7-5062-3392- 。 二、判断题 1、互信息(;)I x y 与平均互信息(;)I X Y 都具有非负性质。 ( ) 2、离散信源的信息熵是信源无失真数据压缩的极限值。 ( ) 3、对于无噪无损信道,其输入和输出有确定的一一对应关系。 ( ) 4、对于有噪无损信道,其输入和输出有确定的一一对应关系。 ( ) 5、设有噪信道的信道容量为C ,若信息传输率R C >,只要码长n 足够长,必存在一种信道编码和相应的译码规则,使译码平均错误概率E P 为任意小。反之,若R C <则不存在以R 传输信息而E P 为任意小的码。 ( ) 6、在任何信息传输系统中,最后获得的信息至多是信源所提供的信息。如果一旦在某一 1.6为了使电视图象获得良好的清晰度和规定的对比度,需要用5×105个像素和10个不同的亮度电平,并设每秒要传送30帧图象,所有的像素是独立的,且所有亮度电平等概出现。求传输此图象所需要的信息率(bit/s )。 解: bit/s 104.98310661.130)/)(()/(R bit/frame 10661.1322.3105)(H 105)(H bit/pels 322.310log )(log )()(H 76650510 10?=??=?=∴?=??=??====∑=frame bit X H s frame r x X a p a p x i i i 所需信息速率为:每帧图像的熵是:每个像素的熵是:,由熵的极值性: 由于亮度电平等概出现 1.7设某彩电系统,除了满足对于黑白电视系统的上述要求外,还必须有30个不同的色彩度。试证明传输这种彩电系统的信息率要比黑白系统的信息率大 2.5倍左右。 证: . 5.2,,5.25.2477.210 log 300log )(H )(H pels /bit 300log )(log )()(H bit 3001030,10,,3001300 11倍左右比黑白电视系统高彩色电视系统信息率要图形所以传输相同的倍作用大信息量比黑白电视系统彩色电视系统每个像素每个像素的熵是:量化 所以每个像素需要用个亮度每个色彩度需要求下在满足黑白电视系统要个不同色彩度增加∴≈====∴=?∑=x x b p b p x i i i Θ 1.8每帧电视图像可以认为是由3×105个像素组成,所以像素均是独立变化,且每像素又取128个不同的亮度电平,并设亮度电平是等概出现。问每帧图像含有多少信息量?若现在有一个广播员,在约10000个汉字中选1000个字来口述这一电视图像,试问若要恰当地描述此图像,广播员在口述中至少需要多少汉字? 解: 个汉字 最少需要数描述一帧图像需要汉字每个汉字所包含信息量每个汉字所出现概率每帧图象所含信息量556 6 5 5 10322.6/10322.61 .0log 101.2)()()()(,log H(c):1.010000 1000 symble /bit 101.2128log 103)(103)(: ?∴?=-?=≥ ≤-=∴== ?=??=??=frame c H X H n c nH X H n p p x H X H 1.9 给 定 一 个 概 率 分 布 ) ,...,,(21n p p p 和一个整数m , n m ≤≤0。定义 ∑=-=m i i m p q 1 1,证明: )log(),,...,,(),...,,(2121m n q q p p p H p p p H m m m n -+≤。并说明等式何时成立? 证: ∑∑+==- -=>-=<-=''-=''∴>- =''-=''>-=n m i i i m i i i n p p p p p p p H x x x x f x e x x x f x x e x x x f x x x x f 1 121log log ),...,,( )0(log )( 0log )log ()(0 log )log ()()0(log )(ΘΘ又为凸函数。即又为凸函数,如下:先证明 时等式成立。 当且仅当时等式成立。当且仅当即可得: 的算术平均值的函数,函数的平均值小于变量由凸函数的性质,变量n m m m m m n m m m i i i m m m m m m i i i n m i i i m i i i n n m m m m m n m i i i m m n m i i n m i i n m i i n m i i n m i i i p p p m n q q p p p H p p p H q q p p q p p p H m n q q q p p p p p p p p p H p p p m n q q q p p m n q q m n p m n p m n m n p f m n m n p f m n p p ===-+≤--=-+--≤- -=∴===-+-≤- --=----=---≤---=- ++==+==+++=+=+=+=+=+=∑∑∑∑∑∑∑∑∑ ∑...)log(),,...,,(),...,,(log log ),,...,,() log(log log log log ),...,,(...) log(log log log log )()()() ()(log 2121211 211 1 1 21211 1111 1 ΘΘ 2.13把n 个二进制对称信道串接起来,每个二进制对称信道的错误传输概率为p(0信息论习题解答

信息论测试题及答案

信息论基础及答案

信息论与编码习题参考答案(全)

信息论与编码试卷与答案

信息论试卷题目及标准答案

信息论基础理论与应用考试题及答案

信息论基础》试卷(期末A卷

信息论试卷含答案

信息论基础答案2

信息论基础与编码课后题答案第三章

信息论作业答案

信息论基础1答案

信息论习题答案Word版

(整理)信息论期末考试试题1.

(完整版)信息论与编码习题参考答案